데이터 처리 파이프라인 설정 및 관리

이 문서는 보안 엔지니어가 Google SecOps에서 데이터 처리 파이프라인을 설정하고 관리하여 수집 전에 이벤트를 필터링하거나, 필드를 변환하거나, 민감한 값을 수정하는 데 도움이 됩니다. 이 기능은 데이터 수집 프로세스에 대한 강력한 사전 파싱 제어를 제공합니다. 이 가이드에 권장된 방법을 따르면 데이터 호환성을 최적화하고 비용을 절감하며 Google SecOps 내에서 민감한 정보를 보호할 수 있습니다.

데이터 처리는 다음 핵심 작업을 통해 로그 관리를 간소화합니다.

- 필터링: 관련 이벤트만 수집하여 노이즈와 비용을 줄입니다.

- 변환: 데이터 형식을 수정하고, 필드를 파싱하고, 로그를 보강하여 유용성을 높입니다.

- Redact: 저장하기 전에 민감한 값을 마스킹하거나 삭제하여 민감한 정보를 보호합니다.

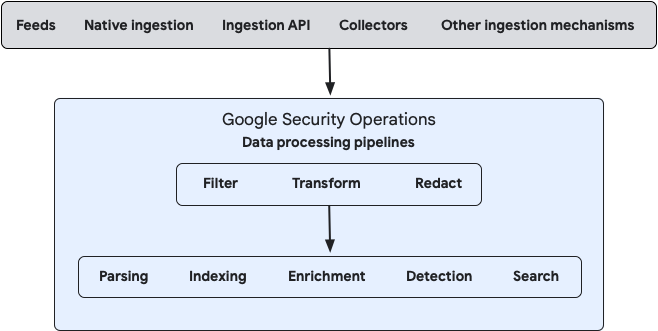

다음 다이어그램은 데이터가 Google SecOps로 흐르는 방식과 시스템에서 해당 데이터를 처리하는 방식을 보여줍니다.

Bindplane 관리 콘솔을 사용하거나 공개 Google SecOps 데이터 파이프라인 API를 직접 사용하여 온프레미스 및 클라우드 데이터 스트림 모두에 대해 데이터 처리를 구성할 수 있습니다.

일반적인 사용 사례

데이터 처리의 사용 사례는 다음과 같습니다.

- 원시 로그에서 빈 키-값 쌍을 삭제합니다.

- 민감한 정보를 수정합니다.

- 원시 로그 콘텐츠에서 수집 라벨을 추가합니다.

- 다중 인스턴스 환경에서는 직접 수집 로그 데이터에 수집 라벨을 적용하여 소스 스트림 인스턴스 (예:Google Cloud Workspace)를 식별합니다.

- 필드 값으로 Palo Alto Cortex 데이터를 필터링합니다.

- 카테고리별로 SentinelOne 데이터를 줄입니다.

- 피드 및 직접 수집 로그에서 호스트 정보를 추출하고 Cloud Monitoring의

ingestion_source필드에 매핑합니다.

주요 용어

데이터 처리에는 다음 요소가 사용됩니다.

- 스트림: 로그 유형 및 수집 소스 (예: 피드 또는 API)로 정의되며 데이터 처리 파이프라인의 입력으로 사용되는 특정 데이터 흐름입니다.

- 프로세서 노드: 필터, 변환, 수정 작업과 같은 하나 이상의 프로세서를 포함하는 파이프라인 내 구성요소입니다. 이러한 프로세서는 데이터가 노드를 통과할 때 순차적으로 데이터를 조작합니다.

- 대상: 데이터 처리 파이프라인의 엔드포인트로, 일반적으로 처리된 데이터가 최종 수집 및 분석을 위해 전송되는 Google SecOps 인스턴스입니다.

시작하기 전에

데이터 처리 파이프라인을 설정하기 전에 다음 요구사항을 검토하세요.

- API 지원: Chronicle API를 호출하여 푸시 기반 스트림의 데이터 처리가 지원됩니다.

- 데이터 가시성: 포워더 및 Bindplane에서 수집된 데이터에는 직접 수집 스트림과 구별되는

collectorID가 태그됩니다. 전체 로그 가시성을 지원하려면 데이터 소스를 쿼리할 때 모든 수집 방법을 선택하거나 API와 상호작용할 때 관련collectorID를 명시적으로 참조해야 합니다. Bindplane 콘솔 설정: 설정 및 관리에 Bindplane 콘솔을 사용하려면 다음 단계를 완료하세요.

Google SecOps 콘솔에서 Bindplane 통합을 구성하는 데 사용할 사용자 또는 서비스 계정에 다음 역할 중 하나를 부여합니다.

다음 권한이 있는 맞춤 역할:

chronicle.logProcessingPipelines.associateStreamschronicle.logProcessingPipelines.createchronicle.logProcessingPipelines.deletechronicle.logProcessingPipelines.dissociateStreamschronicle.logProcessingPipelines.fetchAssociatedPipelinechronicle.logProcessingPipelines.fetchSampleLogsByStreamschronicle.logProcessingPipelines.getchronicle.logProcessingPipelines.listchronicle.logProcessingPipelines.testPipelinechronicle.logProcessingPipelines.updatechronicle.logTypes.getchronicle.logTypes.listchronicle.feeds.getchronicle.feeds.listchronicle.logs.list

지정된 필수 권한이 있는 맞춤 역할을 사용하는 것이 좋습니다.

자세한 내용은 커스텀 역할 만들기 및 관리 및 IAM을 사용하여 기능 액세스 제어 구성을 참고하세요.

사전 정의된 Chronicle API 관리자

roles/chronicle.admin역할자세한 내용은 전용 프로젝트에서 프로젝트 IAM 관리자 역할 할당을 참고하세요.

Bindplane 서버 콘솔을 설치합니다. SaaS 또는 온프레미스의 경우 Bindplane 서버 콘솔 설치를 참고하세요. 최신 버전의 Bindplane (또는 Bindplane 버전 1.96.4 이상)을 설치해야 합니다.

Bindplane 콘솔에서 Google SecOps 대상 인스턴스를 Bindplane 프로젝트에 연결합니다. 자세한 내용은 Google SecOps 인스턴스에 연결을 참고하세요.

Google SecOps 인스턴스에 연결

시작하기 전에 프로젝트 통합 페이지에 액세스할 수 있는 Bindplane 프로젝트 관리자 권한이 있는지 확인합니다.

Google SecOps 인스턴스는 데이터 출력의 대상으로 사용됩니다.

Bindplane Server 콘솔을 사용하여 Google SecOps 인스턴스에 연결하려면 다음을 수행하세요.

- Bindplane Server 콘솔에서 메뉴를 클릭하고 프로젝트 설정을 선택합니다.

- 프로젝트 설정 페이지에서 통합 카드로 이동하여 Google SecOps에 연결을 클릭하여 통합 수정 창을 엽니다.

Google SecOps 대상 인스턴스의 세부정보를 입력합니다.

이 인스턴스는 다음과 같이 처리된 데이터 (데이터 처리의 출력)를 수집합니다.필드 설명 리전 Google SecOps 인스턴스의 리전입니다.

Google Cloud 콘솔에서 인스턴스를 찾으려면 보안 > 감지 및 제어 > Google Security Operations > 인스턴스 세부정보로 이동합니다.고객 ID Google SecOps 인스턴스의 고객 ID입니다.

Google SecOps 콘솔에서 SIEM 설정 > 프로필 > 조직 세부정보로 이동합니다.Google Cloud 프로젝트 번호 Google Cloud Google SecOps 인스턴스의 프로젝트 번호입니다.

Google SecOps 콘솔에서 프로젝트 번호를 찾으려면 SIEM 설정 > 프로필 > 조직 세부정보로 이동합니다.사용자 인증 정보 서비스 계정 사용자 인증 정보는 Google SecOps Data Pipeline API를 인증하고 액세스하는 데 필요한 JSON 값입니다. Google 서비스 계정 사용자 인증 정보 파일에서 이 JSON 값을 가져옵니다.

서비스 계정은 Google SecOps 인스턴스와 동일한 Google Cloud 프로젝트에 있어야 하며 Chronicle API 관리자 역할 (roles/chronicle.admin) 권한 또는 필요한 권한이 있는 맞춤 역할이 필요합니다 (기본 요건 참고).

서비스 계정을 만들고 JSON 파일을 다운로드하는 방법은 서비스 계정 키 만들기 및 삭제를 참고하세요.

또는 Bindplane Cloud 배포에서 인증을 위해 워크로드 아이덴티티 제휴 (WIF)를 지원합니다. WIF는 자체 호스팅 Bindplane 배포에서 지원되지 않습니다. 자세한 내용은 WIF 인증으로 Google SecOps 통합 연결을 참고하세요.연결을 클릭합니다. 연결 세부정보가 올바르고 Google SecOps에 성공적으로 연결되면 다음을 기대할 수 있습니다.

- Google SecOps 인스턴스에 대한 연결이 열립니다.

- 처음 연결하면 Bindplane 콘솔에 SecOps 파이프라인 탭이 표시됩니다.

- Bindplane 콘솔에는 API를 사용하여 이 인스턴스에 대해 이전에 설정한 처리된 데이터가 표시됩니다. 시스템은 API를 사용하여 구성한 일부 프로세서를 Bindplane 프로세서로 변환하고 다른 프로세서는 원시 OpenTelemetry 변환 언어 (OTTL) 형식으로 표시합니다. Bindplane 콘솔을 사용하여 API를 통해 이전에 설정한 파이프라인과 프로세서를 수정할 수 있습니다.

Google SecOps 인스턴스에 대한 연결을 만든 후 데이터 처리를 설정할 수 있습니다.

Bindplane 콘솔을 사용하여 데이터 처리 설정

이 섹션에서는 Bindplane 콘솔을 사용하여 Google SecOps에서 새 로그 처리 파이프라인을 프로비저닝하고 배포하는 방법을 설명합니다. Bindplane 콘솔을 사용하여 API를 통해 이전에 설정한 파이프라인을 관리할 수도 있습니다.

새 Google SecOps 파이프라인 만들기

Google SecOps 파이프라인은 데이터 처리 컨테이너 하나를 구성할 수 있는 컨테이너입니다. 새 Google SecOps 파이프라인 컨테이너를 만들려면 다음 단계를 따르세요.

- Bindplane 콘솔에서 SecOps 파이프라인 탭을 클릭하여 SecOps 파이프라인 페이지를 엽니다.

- SecOps 파이프라인 만들기를 클릭합니다.

SecOps 파이프라인 이름과 설명을 입력합니다.

만들기를 클릭합니다. SecOps 파이프라인 페이지에 새 파이프라인 컨테이너가 표시됩니다.

이 컨테이너 내에서 데이터 처리 컨테이너 스트림과 프로세서를 구성합니다.

데이터 처리 컨테이너 구성

데이터 처리 컨테이너는 수집할 스트림과 데이터가 대상에 도달하기 전에 적용할 프로세서를 정의합니다.

파이프라인 구성 카드에서 스트림과 프로세서 노드를 구성합니다.

데이터 처리 컨테이너를 구성하려면 다음 단계를 따르세요.

- 아직 만들지 않았다면 새 Google SecOps 파이프라인을 만듭니다.

- Bindplane 콘솔에서 SecOps 파이프라인 탭을 클릭하여 SecOps 파이프라인 페이지를 엽니다.

- 새 데이터 처리 컨테이너를 구성할 Google SecOps 파이프라인을 선택합니다.

파이프라인 구성 카드에서 다음을 수행합니다.

이러한 구성이 완료되면 데이터 처리 출시를 참고하여 데이터 처리를 시작하세요.

스트림 추가

스트림을 추가하려면 다음 단계를 따르세요.

- 파이프라인 구성 카드에서 추가 스트림 추가를 클릭하여 스트림 추가 창을 엽니다.

스트림 추가 창에서 다음 필드의 세부정보를 입력합니다.

필드 설명 로그 유형 수집할 데이터의 로그 유형을 선택합니다. 예를 들면 CrowdStrike Falcon (CS_EDR)입니다.

참고: 경고 경고 아이콘은 로그 유형이 이미 다른 스트림 (이 파이프라인 또는 Google SecOps 인스턴스의 다른 파이프라인)에 구성되어 있음을 나타냅니다.

사용할 수 없는 로그 유형을 사용하려면 먼저 다른 스트림 구성에서 삭제해야 합니다.

로그 유형이 구성된 스트림 구성을 찾는 방법은 SecOps 파이프라인 구성 필터링을 참고하세요.수집 방법 선택한 로그 유형의 데이터를 수집하는 데 사용할 수집 방법을 선택합니다. 이러한 수집 방법은 이전에 Google SecOps 인스턴스에 대해 정의되었습니다.

다음 옵션 중 하나를 선택해야 합니다.

- 모든 수집 방법: 선택한 로그 유형의 모든 수집 방법을 포함합니다. 이 옵션을 선택하면 동일한 로그 유형에 특정 수집 방법을 사용하는 후속 스트림을 추가할 수 없습니다. 예외: 다른 스트림에서 이 로그 유형에 대해 구성되지 않은 다른 특정 수집 방법을 선택할 수 있습니다.

Cloud Native Ingestion,Feed,Ingestion API,Workspace Ingestion과 같은 특정 수집 방법

피드 수집 방법으로 Feed을 선택하면 선택한 로그 유형에 사용할 수 있는 피드 이름 목록 (Google SecOps 인스턴스에서 사전 구성됨)이 있는 후속 필드가 표시됩니다. 구성을 완료하려면 관련 피드를 선택해야 합니다. 사용 가능한 피드를 보고 관리하려면 SIEM 설정 > 피드 표로 이동하세요.- 모든 수집 방법: 선택한 로그 유형의 모든 수집 방법을 포함합니다. 이 옵션을 선택하면 동일한 로그 유형에 특정 수집 방법을 사용하는 후속 스트림을 추가할 수 없습니다. 예외: 다른 스트림에서 이 로그 유형에 대해 구성되지 않은 다른 특정 수집 방법을 선택할 수 있습니다.

스트림 추가를 클릭하여 새 스트림을 저장합니다.새 데이터 스트림이 파이프라인 구성 카드에 즉시 표시됩니다. 스트림은 프로세서 노드와 Google SecOps 대상에 자동으로 연결됩니다.

SecOps 파이프라인 구성 필터링

SecOps 파이프라인 페이지의 검색창을 사용하면 여러 구성 요소를 기반으로 Google SecOps 파이프라인 (데이터 처리 컨테이너)을 필터링하고 찾을 수 있습니다. 로그 유형, 수집 방법, 피드 이름과 같은 특정 기준을 검색하여 파이프라인을 필터링할 수 있습니다.

다음 구문을 사용하여 필터링합니다.

logType:valueingestionMethod:valuefeed:value

예를 들어 특정 로그 유형이 포함된 스트림 구성을 식별하려면 검색창에 logtype:를 입력하고 결과 목록에서 로그 유형을 선택합니다.

프로세서 구성

데이터 처리 컨테이너에는 하나 이상의 프로세서를 보유하는 프로세서 노드가 하나 있습니다. 각 프로세서는 스트림 데이터를 순차적으로 조작합니다.

- 첫 번째 프로세서는 원시 스트림 데이터를 처리합니다.

- 첫 번째 프로세서의 결과 출력은 시퀀스에서 다음 프로세서의 입력이 됩니다.

- 이 시퀀스는 프로세서 창에 표시되는 정확한 순서대로 모든 후속 프로세서에 대해 계속되며, 하나의 출력이 다음의 입력이 됩니다.

- 하나 이상의 프로세서를 추가, 삭제 또는 순서를 변경하여 프로세서 노드를 구성합니다.

다음 표에는 프로세서가 나열되어 있습니다.

| 프로세서 유형 | 기능 |

|---|---|

| 필터 | 조건별 필터링 |

| 필터 | HTTP 상태로 필터링 |

| 필터 | 측정항목 이름으로 필터링 |

| 필터 | 필터링 기준: 정규 표현식 |

| 필터 | 심각도별 필터링 |

| 수정 | 민감한 정보 수정 |

| 변환 | 입력란 추가 |

| 변환 | 합병 |

| 변환 | Concat |

| 변환 | 필드 복사 |

| 변환 | 필드 삭제 |

| 변환 | Marshal |

| 변환 | 필드 이동 |

| 변환 | CSV 파싱 |

| 변환 | JSON 파싱 |

| 변환 | 키 값 파싱 |

| 변환 | 심각도 필드 파싱 |

| 변환 | 타임스탬프 파싱 |

| 변환 | 정규식으로 파싱 |

| 변환 | XML 파싱 |

| 변환 | 필드 이름 바꾸기 |

| 변환 | 타임스탬프 재작성 |

| 변환 | 분할 |

| 변환 | 변환 |

프로세서 추가

프로세서를 추가하려면 다음 단계를 따르세요.

파이프라인 구성 카드에서 프로세서 노드를 클릭하여 프로세서 수정 창을 엽니다. 프로세서 수정 창은 데이터 흐름에 따라 다음과 같은 창으로 나뉩니다.

- 입력 (또는 소스 데이터): 최근에 수신된 스트림 로그 데이터 (처리 전)

- 구성 (또는 프로세서 목록): 프로세서 및 해당 구성

- 출력(또는 결과): 최근에 처리된 결과 로그 데이터

이전에 파이프라인이 출시된 경우 시스템에 최근 수신 로그 데이터 (처리 전)와 최근 발신 로그 데이터 (처리 후)가 창에 표시됩니다.

프로세서 추가를 클릭하여 프로세서 목록을 표시합니다. 편의를 위해 프로세서 목록은 프로세서 유형별로 그룹화되어 있습니다. 목록을 정리하고 자체 번들을 추가하려면 하나 이상의 프로세서를 선택하고 새 프로세서 번들 추가를 클릭합니다.

프로세서 목록에서 추가할 프로세서를 선택합니다.

필요에 따라 프로세서를 구성합니다.

저장을 클릭하여 프로세서 노드에 프로세서 구성을 저장합니다.

시스템은 입력 창에서 수신되는 스트림 데이터의 새 샘플을 처리하여 새 구성을 즉시 테스트하고 결과로 생성되는 발신 데이터를 출력 창에 표시합니다.

데이터 처리 파이프라인 출시

스트림 및 프로세서 구성이 완료되면 파이프라인을 출시하여 데이터 처리를 시작해야 합니다.

- 출시 시작을 클릭합니다. 이렇게 하면 데이터 처리가 즉시 활성화되고 Google 인프라에서 구성에 따라 데이터 처리를 시작할 수 있습니다. 출시가 성공하면 데이터 처리 컨테이너의 버전 번호가 증가하고 컨테이너의

name옆에 표시됩니다.

API 메서드를 사용하여 데이터 처리 설정

Bindplane 콘솔 대신 Google SecOps 데이터 파이프라인 메서드를 사용하여 처리된 데이터를 관리할 수 있습니다. 이러한 데이터 파이프라인 메서드에는 파이프라인 생성, 업데이트, 삭제, 나열과 피드 및 로그 유형을 파이프라인과 연결하는 작업이 포함됩니다.

이 섹션의 예시를 사용하려면 다음을 수행하세요.

- 고객별 매개변수 (예: URL 및 피드 ID)를 자체 환경에 적합한 매개변수로 바꿉니다.

- 자체 인증을 삽입합니다. 이 섹션에서는 전달자 토큰이

******로 수정됩니다.

특정 Google SecOps 인스턴스의 모든 파이프라인 나열

다음 명령어는 특정 Google SecOps 인스턴스에 있는 모든 파이프라인을 나열합니다.

curl --location 'https://abc.def.googleapis.com/v123/'\

'projects/projectabc-byop/locations/us/'\

'instances/aaaa1aa1-111a-11a1-1111-11111a1aa1aa/'\

'logProcessingPipelines' \

--header 'Authorization: Bearer ******'

프로세서 하나로 기본 파이프라인 만들기

맞춤 수집 라벨의 값을 upsert하고 세 개의 소스를 연결하는 단일 변환 프로세서가 있는 기본 파이프라인을 만들려면 다음을 실행하세요.

다음 명령어를 실행합니다.

curl --location 'https://abc.def.googleapis.com/v123/projects/projectabc-byop/locations/us/instances/aaaa1aa1-111a-11a1-1111-11111a1aa1aa/logProcessingPipelines' \ --header 'Content-Type: application/json' \ --header 'Authorization: Bearer ******' \ --data '{ "displayName": "Example Pipeline", "description": "My description", "processors": [ { "transformProcessor": { "statements": [ "set(attributes[\"labels.myLabel.value\"], \"myValue\")" ] } } ] }'응답에서

name필드 값을 복사합니다.다음 명령어를 실행하여 세 개의 스트림 (로그 유형, 수집기 ID가 있는 로그 유형, 피드)을 파이프라인과 연결합니다.

name필드의 값을{pipelineName}값으로 사용합니다.curl --location 'https://abc.def.googleapis.com/v123/{pipelineName}:associateStreams' \ --header 'Content-Type: application/json' \ --header 'Authorization: Bearer ******' \ --data '{ "streams": [ { "logType": "MICROSOFT_SENTINEL" }, { "logType": "A10_LOAD_BALANCER", "collectorId": "dddddddd-dddd-dddd-dddd-dddddddddddd" }, { "feed": "1a1a1a1a-1a1a-1a1a-1a1a-1a1a1a1a1a1a" } ] }'

프로세서가 3개인 파이프라인 만들기

파이프라인은 다음 프로세서를 사용합니다.

- 필터: 수집 라벨을 기반으로 조건과 일치하는 로그를 필터링합니다.

- 변환: 네임스페이스 값을 업데이트합니다.

- 수정: 맞춤 정규식 패턴을 기반으로 로그 데이터에서 이메일 주소와 주민등록번호를 수정합니다.

파이프라인을 만들고 세 개의 소스를 연결하려면 다음을 실행하세요.

다음 명령어를 실행합니다.

curl --location 'https://abc.def.googleapis.com/v123/projects/projectabc-byop/locations/us/instances/aaaa1aa1-111a-11a1-1111-11111a1aa1aa/logProcessingPipelines' \ --header 'Content-Type: application/json' \ --header 'Authorization: Bearer ******' \ --data-raw '{ "displayName": "My Pipeline 2", "description": "My description 2", "processors": [ { "filterProcessor": { "logConditions": [ "attributes[\"labels.log_source.value\"] == \"myLogSourceToFilterOut\"" ] } }, { "transformProcessor": { "statements": [ "set(attributes[\"environment_namespace\"], \"myValue\")" ] } }, { "redactProcessor": { "blockedValues": [ "\\b\\d{3}[- ]\\d{2}[- ]\\d{4}\\b", "\\b[a-zA-Z0-9._/\\+\\-—|]+@[A-Za-z0-9\\-—|]+\\.[a-zA-Z|]{2,6}\\b" ], "allowAllKeys": true } } ] }'응답에서

name필드 값을 복사합니다.다음 명령어를 실행하여 세 개의 스트림 (로그 유형, 수집기 ID가 있는 로그 유형, 피드)을 파이프라인과 연결합니다.

name필드의 값을{pipelineName}값으로 사용합니다.curl --location 'https://abc.def.googleapis.com/v123/{pipelineName}:associateStreams' \ --header 'Content-Type: application/json' \ --header 'Authorization: Bearer ******' \ --data '{ "streams": [ { "logType": "MICROSOFT_SENTINEL" }, { "logType": "A10_LOAD_BALANCER", "collectorId": "dddddddd-dddd-dddd-dddd-dddddddddddd" }, { "feed": "1a1a1a1a-1a1a-1a1a-1a1a-1a1a1a1a1a1a" } ] }'

문제 해결

이 섹션에서는 성능 기대치를 설명하고 일반적인 문제에 대한 셀프 서비스 해결 방법을 제공합니다.

지연 시간 및 제한

수집 API를 사용하여 에이전트를 구성하면 볼륨이 낮은 Google SecOps 파이프라인의 승인 시간이 길어질 수 있습니다.

지연 시간 평균이 700ms에서 최대 2초까지 증가할 수 있습니다. 필요에 따라 제한 시간과 메모리를 늘립니다. 데이터 처리량이 4MB를 초과하면 확인 시간이 줄어듭니다.

유효성 검사 및 테스트

Google SecOps 콘솔에서 데이터 처리 세부정보를 확인할 수 있습니다.

모든 데이터 처리 구성 보기

- Google SecOps 콘솔에서 SIEM 설정 > 데이터 처리로 이동하여 구성된 모든 파이프라인을 확인할 수 있습니다.

- 수신 데이터 파이프라인 검색창에서 빌드한 파이프라인을 검색합니다. 파이프라인 이름 또는 구성요소와 같은 요소로 검색할 수 있습니다. 검색 결과에 파이프라인의 프로세서와 구성 요약이 표시됩니다.

- 파이프라인 요약에서 다음 작업을 수행할 수 있습니다.

- 프로세서 구성을 검토합니다.

- 구성 세부정보를 복사합니다.

- Bindplane에서 열기를 클릭하여 Bindplane 콘솔 내에서 직접 파이프라인에 액세스하고 관리합니다.

구성된 피드 보기

시스템에서 구성된 피드를 보려면 다음 단계를 따르세요.

- Google SecOps 콘솔에서 SIEM 설정 > 피드로 이동합니다. 피드 페이지에는 시스템에서 구성한 모든 피드가 표시됩니다.

- 각 행 위로 포인터를 가져가면 피드 세부정보를 확인하고, 피드를 수정, 사용 중지 또는 삭제할 수 있는 ⋮ 더보기 메뉴가 표시됩니다.

- 세부정보 보기를 클릭하여 세부정보 창을 확인합니다.

- Bindplane에서 열기를 클릭하여 Bindplane 콘솔에서 해당 피드의 스트림 구성을 엽니다.

사용 가능한 로그 유형의 데이터 처리 세부정보 보기

사용 가능한 로그 유형 페이지에서 데이터 처리 세부정보를 보려면 다음 단계를 따르세요. 이 페이지에서는 사용 가능한 모든 로그 유형을 볼 수 있습니다.

- Google SecOps 콘솔에서 SIEM 설정 > 사용 가능한 로그 유형으로 이동합니다. 기본 페이지에는 모든 로그 유형이 표시됩니다.

- 각 피드 행 위로 마우스 포인터를 가져가면 more_vert 더보기 메뉴가 표시됩니다. 이 메뉴를 사용하면 피드 세부정보를 확인, 수정, 사용 중지 또는 삭제할 수 있습니다.

- 데이터 처리 보기를 클릭하여 피드의 구성을 확인합니다.

- Bindplane에서 열기를 클릭하여 Bindplane 콘솔에서 해당 프로세서의 프로세서 구성을 엽니다.

도움이 더 필요하신가요? 커뮤니티 회원 및 Google SecOps 전문가에게 문의하여 답변을 받으세요.