Der Gen AI Evaluation Service bietet Tools auf Unternehmensniveau für eine objektive, datengestützte Bewertung von Modellen, die auf generativer KI basieren. Er unterstützt und informiert eine Reihe von Entwicklungsaufgaben wie Modellmigrationen, Prompt-Bearbeitung und Feinabstimmung.

Funktionen des Gen AI Evaluation Service

Das entscheidende Merkmal des Gen AI Evaluation Service ist die Möglichkeit, adaptive Bewertungsschemas zu verwenden. Das sind maßgeschneiderte Bestanden/Nicht bestanden-Tests für jeden einzelnen Prompt. Bewertungsschemas ähneln Unittests in der Softwareentwicklung und zielen darauf ab, die Modellleistung für eine Vielzahl von Aufgaben zu verbessern.

Der Gen AI Evaluation Service unterstützt die folgenden gängigen Bewertungsmethoden:

Adaptive Bewertungsschemas (empfohlen): Generiert für jeden einzelnen Prompt in Ihrem Dataset einen eindeutigen Satz von Bestanden/Nicht bestanden-Bewertungsschemas.

Statische Bewertungsschemas: Wenden Sie für alle Prompts einen festen Satz von Bewertungskriterien an.

Berechnungsbasierte Messwerte: Verwenden Sie deterministische Algorithmen wie

ROUGEoderBLEU, wenn eine Ground Truth verfügbar ist.Benutzerdefinierte Funktionen: Definieren Sie Ihre eigene Bewertungslogik in Python für spezielle Anforderungen.

Bewertungs-Dataset generieren

Sie können ein Bewertungs-Dataset mit den folgenden Methoden erstellen:

Datei hochladen , die vollständige Prompt-Instanzen enthält, oder eine Prompt-Vorlage zusammen mit einer entsprechenden Datei mit Variablenwerten bereitstellen, um die vollständigen Prompts zu erstellen.

Direkt aus Produktionslogs abrufen , um die tatsächliche Nutzung Ihres Modells zu bewerten.

Synthetische Daten generieren , um eine große Anzahl konsistenter Beispiele für eine beliebige Prompt-Vorlage zu erstellen.

Unterstützte Schnittstellen

Sie können Ihre Bewertungen mit den folgenden Schnittstellen definieren und ausführen:

Google Cloud Konsole: Eine Webbenutzeroberfläche, die einen geführten End-to-End-Workflow bietet. Verwalten Sie Ihre Datasets, führen Sie Bewertungen aus und sehen Sie sich interaktive Berichte und Visualisierungen an. Weitere Informationen finden Sie unter Bewertung mit der Konsole durchführen.

Python SDK: Führen Sie Bewertungen programmatisch aus und rendern Sie Modellvergleiche direkt in Ihrer Colab- oder Jupyter-Umgebung. Weitere Informationen finden Sie unter Bewertung mit dem GenAI Client im Agent Platform SDK durchführen.

Anwendungsfälle

Mit dem Gen AI Evaluation Service können Sie sehen, wie ein Modell bei Ihren spezifischen Aufgaben und anhand Ihrer individuellen Kriterien abschneidet. So erhalten Sie wertvolle Einblicke, die nicht aus öffentlichen Bestenlisten und allgemeinen Benchmarks abgeleitet werden können. Dies unterstützt wichtige Entwicklungsaufgaben, darunter:

Modellmigrationen: Vergleichen Sie Modellversionen, um Verhaltensunterschiede zu erkennen und Ihre Prompts und Einstellungen entsprechend anzupassen.

Bestes Modell finden: Führen Sie direkte Vergleiche von Google- und Drittanbietermodellen mit Ihren Daten durch, um eine Leistungsbaseline zu erstellen und das beste Modell für Ihren Anwendungsfall zu ermitteln.

Prompt-Verbesserung: Verwenden Sie Bewertungsergebnisse, um Ihre Anpassungsbemühungen zu steuern. Wenn Sie eine Bewertung noch einmal ausführen, entsteht ein enger Feedback-Loop, der sofortiges, quantifizierbares Feedback zu Ihren Änderungen liefert.

Modellabstimmung: Bewerten Sie die Qualität eines abgestimmten Modells, indem Sie bei jeder Ausführung konsistente Bewertungskriterien anwenden.

Agentenbewertung: Bewerten Sie die Leistung eines Agenten anhand agentspezifischer Messwerte wie Agententraces und Antwortqualität.

Bewertungs-Workflow

Für eine Bewertung sind in der Regel die folgenden Schritte erforderlich:

Bewertungs-Dataset erstellen: Stellen Sie ein Dataset mit Prompt-Instanzen zusammen, die Ihren spezifischen Anwendungsfall widerspiegeln. Sie können Referenzantworten (Ground Truth) einfügen, wenn Sie berechnungsbasierte Messwerte verwenden möchten.

Bewertungsmesswerte definieren: Wählen Sie die Messwerte aus, mit denen Sie die Modellleistung messen möchten.

Modellantworten generieren: Wählen Sie ein oder mehrere Modelle aus, um Antworten für Ihr Dataset zu generieren. Das Agent Platform SDK unterstützt alle Modelle, die über

LiteLLMaufgerufen werden können, während die Console Google Gemini-Modelle unterstützt.Bewertung ausführen: Führen Sie den Bewertungsjob aus, bei dem die Antworten der einzelnen Modelle anhand der ausgewählten Messwerte bewertet werden.

Ergebnisse interpretieren: Sehen Sie sich die aggregierten Ergebnisse und einzelnen Antworten an, um die Modellleistung zu analysieren.

Bewertungsmesswerte

Die folgenden Konzepte sind für Bewertungsmesswerte von Bedeutung:

Bewertungsschemas: Die Kriterien für die Bewertung der Antwort eines LLM-Modells oder einer LLM-Anwendung.

Messwerte: Eine Punktzahl, die die Modellausgabe anhand der Bewertungsschemas misst.

Der Gen AI Evaluation Service bietet die folgenden Kategorien von Messwerten:

Auf Bewertungsschemas basierende Messwerte: LLMs in Bewertungs-Workflows einbinden, um die Qualität der Antworten von Modellen zu bewerten. Auf Bewertungsschemas basierende Bewertungen eignen sich für eine Vielzahl von Aufgaben, insbesondere für die Bewertung der Schreibqualität, der Sicherheit und der Befolgung von Anweisungen, die oft schwer mit deterministischen Algorithmen zu bewerten sind.

Adaptive Bewertungsschemas (empfohlen): Bewertungsschemas werden dynamisch generiert für jeden Prompt, ähnlich wie Unittests. Antworten werden mit einem eindeutigen Satz von Bestanden/Nicht bestanden-Tests für jeden einzelnen Prompt in Ihrem Dataset bewertet. Die Bewertungsschemas sorgen dafür, dass die Bewertung für die angeforderte Aufgabe relevant ist, und zielen darauf ab, objektive, erklärbare und konsistente Ergebnisse zu liefern.

Adaptive Bewertungsschemas sind in der Regel der schnellste Weg, um mit Bewertungen zu beginnen. Sie sorgen dafür, dass jede Bewertung für die spezifische Aufgabe relevant ist, die bewertet wird.

Statische Bewertungsschemas: Bewertungsschemas werden explizit definiert und dasselbe Bewertungsschema wird auf alle Prompts angewendet. Antworten werden mit demselben Satz von numerischen Bewertungsalgorithmen bewertet. Eine einzelne numerische Punktzahl (z. B. 1–5) pro Prompt. Verwenden Sie statische Bewertungsschemas, wenn eine Bewertung für eine sehr spezifische Dimension erforderlich ist oder wenn für alle Prompts genau dasselbe Bewertungsschema erforderlich ist.

Berechnungsbasierte Messwerte: Antworten mit deterministischen Algorithmen bewerten, in der Regel mit Ground Truth. Eine numerische Punktzahl (z.B.0,0–1,0) pro Prompt. Wenn Ground Truth verfügbar ist und mit einer deterministischen Methode abgeglichen werden kann.

Benutzerdefinierte Funktionsmesswerte (nur Agent Platform SDK ): Definieren Sie Ihren eigenen Messwert über eine Python-Funktion.

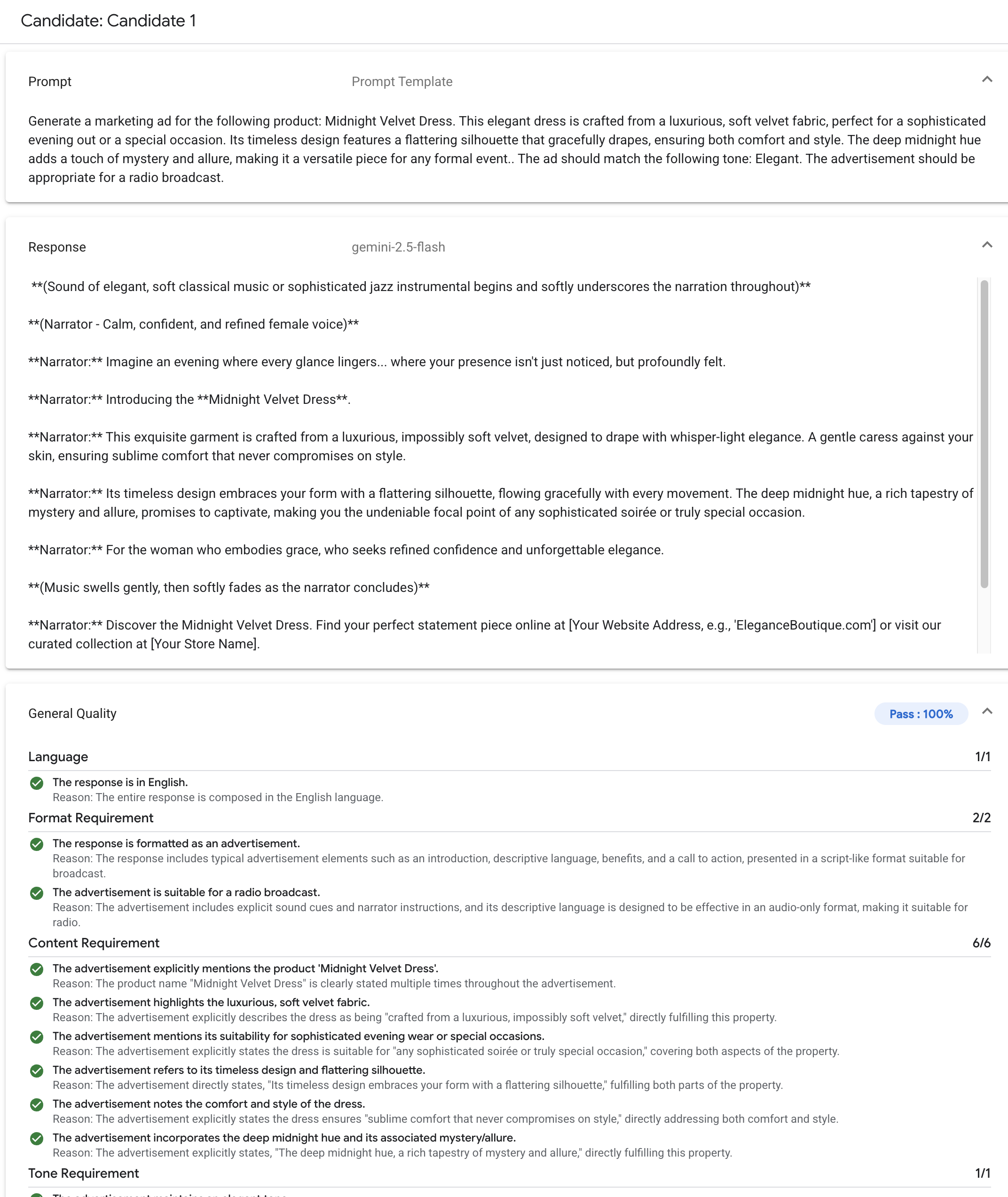

Beispiel für adaptive Bewertungsschemas

Der Bewertungsprozess für jeden Prompt verwendet ein zweistufiges System:

Bewertungsschema-Generierung: Der Dienst analysiert zuerst Ihren Prompt und generiert eine Liste spezifischer, überprüfbarer Tests – die Bewertungsschemas –, die eine gute Antwort erfüllen sollte.

Bewertungsschema-Validierung: Nachdem Ihr Modell eine Antwort generiert hat, bewertet der Dienst die Antwort anhand jedes Bewertungsschemas und liefert ein eindeutiges

PassoderFailund eine Begründung.

Das Endergebnis ist eine aggregierte Bestanden-Rate und eine detaillierte Aufschlüsselung der Bewertungsschemas, die das Modell bestanden hat. So erhalten Sie umsetzbare Erkenntnisse, um Probleme zu diagnostizieren und Verbesserungen zu messen.

Indem Sie von allgemeinen, subjektiven Punktzahlen zu detaillierten, objektiven Testergebnissen übergehen, können Sie einen bewertungsgesteuerten Entwicklungszyklus einführen und die Best Practices der Softwareentwicklung auf den Prozess der Entwicklung generativer KI-Anwendungen anwenden.

Das folgende Beispiel zeigt adaptive Bewertungsschemas, die für eine Reihe von Prompts generiert wurden:

Nutzer-Prompt: Write a four-sentence summary of the provided article about renewable energy, maintaining an optimistic tone.

Für diesen Prompt könnte im Schritt Bewertungsschema-Generierung Folgendes generiert werden:

Bewertungsschema 1: Die Antwort ist eine Zusammenfassung des bereitgestellten Artikels.

Bewertungsschema 2: Die Antwort enthält genau vier Sätze.

Bewertungsschema 3: Die Antwort hat einen optimistischen Ton.

Ihr Modell kann die folgende Antwort liefern: The article highlights significant growth in solar and wind power. These advancements are making clean energy more affordable. The future looks bright for renewables. However, the report also notes challenges with grid infrastructure.

Bei der Bewertungsschema-Validierung bewertet der Gen AI Evaluation Service die Antwort anhand jedes Bewertungsschemas:

Bewertungsschema 1: Die Antwort ist eine Zusammenfassung des bereitgestellten Artikels.

Urteil:

PassGrund: Die Antwort fasst die wichtigsten Punkte genau zusammen.

Bewertungsschema 2: Die Antwort enthält genau vier Sätze.

Urteil:

PassGrund: Die Antwort besteht aus vier verschiedenen Sätzen.

Bewertungsschema 3: Die Antwort hat einen optimistischen Ton.

Urteil:

FailGrund: Der letzte Satz enthält einen negativen Punkt, der den optimistischen Ton beeinträchtigt.

Die endgültige Bestanden-Rate für diese Antwort beträgt 66,7%. Wenn Sie zwei Modelle vergleichen möchten, können Sie ihre Antworten anhand desselben Satzes generierter Tests bewerten und ihre Gesamtbestanden-Raten vergleichen.

Erste Schritte mit Bewertungen

Sie können mit Bewertungen über die Console beginnen.

Alternativ zeigt der folgende Code, wie Sie eine Bewertung mit dem GenAI Client im Agent Platform SDK durchführen:

from vertexai import Client

from vertexai import types

import pandas as pd

client = Client(project=PROJECT_ID, location=LOCATION)

# Create an evaluation dataset

prompts_df = pd.DataFrame({

"prompt": [

"Write a simple story about a dinosaur",

"Generate a poem about Agent Platform",

],

})

# Get responses from one or multiple models

eval_dataset = client.evals.run_inference(model="gemini-2.5-flash", src=prompts_df)

# Define the evaluation metrics and run the evaluation job

eval_result = client.evals.evaluate(

dataset=eval_dataset,

metrics=[types.RubricMetric.GENERAL_QUALITY]

)

# View the evaluation results

eval_result.show()

Der Gen AI Evaluation Service bietet zwei Agent Platform SDK -Schnittstellen:

GenAI Client im Agent Platform SDK (empfohlen) (Vorabversion)

from vertexai import clientDer GenAI Client ist die neuere, empfohlene Schnittstelle für die Bewertung, auf die über die einheitliche Client-Klasse zugegriffen wird. Er unterstützt alle Bewertungsmethoden und ist für Workflows konzipiert, die Modellvergleiche, Visualisierungen im Notebook und Erkenntnisse für die Modellanpassung umfassen.

Bewertungsmodul im Agent Platform SDK (GA)

from vertexai.evaluation import EvalTaskDas Bewertungsmodul ist die ältere Schnittstelle, die aus Gründen der Abwärtskompatibilität mit bestehenden Workflows beibehalten wird, aber nicht mehr aktiv weiterentwickelt wird. Der Zugriff erfolgt über die Klasse

EvalTask. Diese Methode unterstützt Standard-LLM-as-a-Judge- und berechnungsbasierte Messwerte, aber keine neueren Bewertungsmethoden wie adaptive Bewertungsschemas.

Unterstützte Regionen

Die folgenden Regionen werden für den Gen AI Evaluation Service unterstützt:

Iowa (

us-central1)Virginia (

us-east4)Oregon (

us-west1)Las Vegas, Nevada (

us-west4)Belgien (

europe-west1)Niederlande (

europe-west4)Paris, Frankreich (

europe-west9)

Verfügbare Notebooks

| Notebook-Links | Beschreibung |

|---|---|

| Erste Schritte: Schnelle Bewertung mit generativer KI | Bietet eine Einführung in den Gen AI Evaluation Service. |

| Bewertung von Drittanbietermodellen mit dem Gen AI Evaluation Service | Zeigt, wie Sie das **Agent Platform SDK** verwenden, um verschiedene Arten von Drittanbietermodellen zu bewerten, darunter Modelle, auf die über die API zugegriffen wird (z. B. OpenAI, Anthropic), Model as a Service (MaaS) aus dem Vertex Model Garden und Bring Your Own Model (BYOM)-Endpunkte. |

| Modellmigration mit dem Gen AI Evaluation Service | Zeigt, wie Sie das **Agent Platform SDK** für den Gen AI Evaluation Service verwenden, um zwei proprietäre Modelle zu vergleichen (z. B. Gemini 2.0 Flash mit Gemini 2.5 Flash). Es wird hervorgehoben, wie vordefinierte adaptive auf Bewertungsschemas basierende Messwerte verwendet werden und wie Bewertungsergebnisse zur Optimierung von Prompts beitragen können. Wichtige Funktionen wie die Bewertung mehrerer Kandidaten, die Visualisierung im Notebook und die asynchrone Batchbewertung werden ebenfalls behandelt. |

| Bewertung der Qualität von Text-zu-Bild mit dem Gen AI Evaluation Service | Zeigt, wie Sie das Vertex AI SDK für den Gen AI Evaluation Service verwenden, um die Qualität generierter Bilder anhand von Text-Prompts zu bewerten. Es wird die Verwendung des vordefinierten adaptiven auf Bewertungsschemas basierenden Gecko-Messwerts demonstriert. |

| Bewertung der Qualität von Text-zu-Video mit dem Gen AI Evaluation Service | Zeigt, wie Sie das **Agent Platform SDK** für den Gen AI Evaluation Service verwenden, um die Qualität generierter Videos anhand von Text-Prompts zu bewerten. Es wird die Verwendung des vordefinierten adaptiven auf Bewertungsschemas basierenden Gecko-Messwerts demonstriert. |