Vous pouvez explorer les résultats de requêtes à l'aide de cellules SQL ou de cellules de code dans les notebooks BigQuery Colab Enterprise.

Dans ce tutoriel, vous allez interroger les données d'un ensemble de données public BigQuery et explorer les résultats de la requête dans un notebook.

Objectifs

- Créer et exécuter une requête dans BigQuery

- Explorer les résultats de la requête dans un notebook à l'aide de cellules SQL et de cellules de code

Coûts

Ce tutoriel utilise un ensemble de données disponible via le programme d'ensembles de données publicsGoogle Cloud . Google prend en charge le stockage de ces ensembles de données et fournit un accès public aux données. Des frais vous sont facturés pour les requêtes que vous effectuez sur les données. Pour en savoir plus, consultez la page décrivant les tarifs de BigQuery.

Avant de commencer

-

Dans la console Google Cloud , sur la page de sélection du projet, sélectionnez ou créez un projet Google Cloud .

Rôles requis pour sélectionner ou créer un projet

- Sélectionnez un projet : la sélection d'un projet ne nécessite pas de rôle IAM spécifique. Vous pouvez sélectionner n'importe quel projet pour lequel un rôle vous a été attribué.

-

Créer un projet : pour créer un projet, vous devez disposer du rôle Créateur de projet (

roles/resourcemanager.projectCreator), qui contient l'autorisationresourcemanager.projects.create. Découvrez comment attribuer des rôles.

-

Vérifiez que la facturation est activée pour votre projet Google Cloud .

-

Activez l'API BigQuery.

Rôles requis pour activer les API

Pour activer les API, vous avez besoin du rôle IAM Administrateur Service Usage (

roles/serviceusage.serviceUsageAdmin), qui contient l'autorisationserviceusage.services.enable. Découvrez comment attribuer des rôles.BigQuery est automatiquement activé dans les nouveaux projets.

Définir la région par défaut des composants de code

Tous les nouveaux composants de code de votre projet Google Cloud utilisent une région par défaut. Une fois le composant créé, vous ne pouvez plus modifier sa région.

Pour définir la région par défaut des nouveaux composants de code :

Accédez à la page BigQuery.

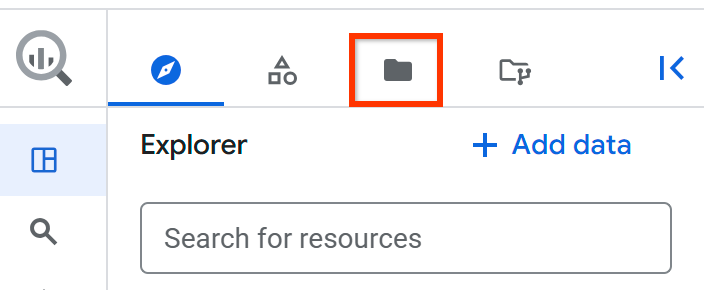

Dans le volet de gauche, cliquez sur Fichiers pour ouvrir l'explorateur de fichiers :

À côté du nom du projet, cliquez sur Afficher les actions du panneau de fichiers > Changer de région de code.

Sélectionnez la région de code que vous souhaitez utiliser par défaut.

Cliquez sur Enregistrer.

Pour obtenir la liste des régions compatibles, consultez Emplacements BigQuery Studio.

Autorisations requises

Pour créer et exécuter des notebooks, vous avez besoin des rôles IAM (Identity and Access Management) suivants :

- Utilisateur BigQuery (

roles/bigquery.user) - Utilisateur de l'environnement d'exécution de notebook (

roles/aiplatform.notebookRuntimeUser) - Créateur de code (

roles/dataform.codeCreator)

Ouvrir les résultats de la requête dans un notebook

Vous pouvez exécuter une requête SQL, puis utiliser un notebook pour explorer les données. Cette approche est utile si vous souhaitez modifier les données dans BigQuery avant de les exploiter, ou si vous n'avez besoin que d'un sous-ensemble des champs de la table.

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur.

Accédez au projet

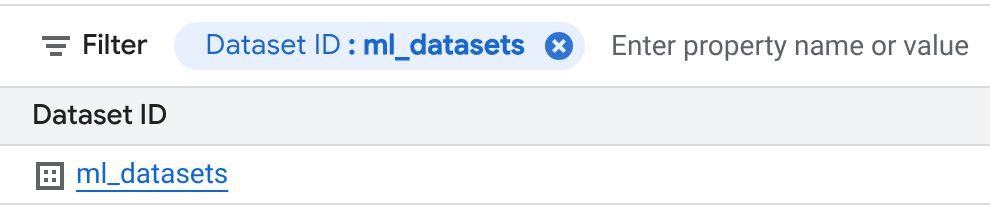

bigquery-public-data, cliquez sur Développer/réduire le nœud pour le développer, puis cliquez sur Ensembles de données. Un nouvel onglet s'ouvre dans le volet "Détails" et affiche la liste de tous les ensembles de données du projet.Dans la zone Filtre , sélectionnez ID de l'ensemble de données et saisissez ml_datasets.

Sur la page Ensembles de données, cliquez sur ml_datasets > penguins.

Cliquez sur Requête.

Ajoutez un astérisque (

*) pour sélectionner les champs pour la requête générée, de sorte qu'elle se présente comme dans l'exemple suivant :SELECT * FROM `bigquery-public-data.ml_datasets.penguins` LIMIT 1000;

Cliquez sur Exécuter.

Dans la section Résultats de la requête, cliquez sur Ouvrir dans, puis sur Notebook.

Préparer le notebook en vue de son utilisation

Préparez le notebook pour l'utiliser en vous connectant à un environnement d'exécution et en définissant les valeurs par défaut de l'application.

Dans l'en-tête du notebook, cliquez sur Connecter pour vous connecter à l'environnement d'exécution par défaut.

Dans le bloc de code Configuration, cliquez sur Exécuter la cellule.

Explorer les données

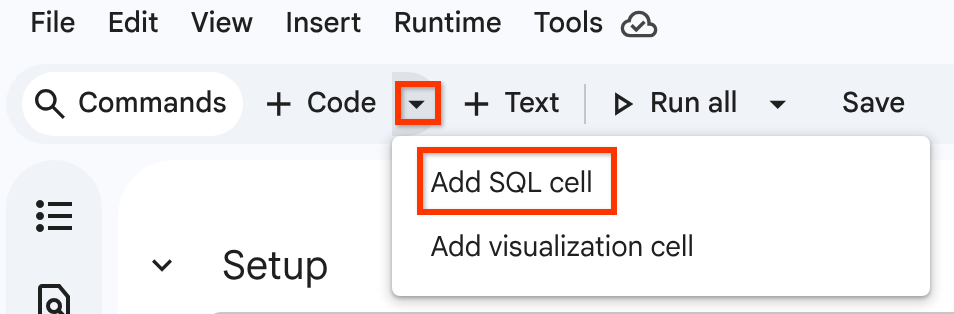

Cliquez sur Options d'insertion de cellule de code> Ajouter une cellule SQL.

Saisissez la requête suivante dans la cellule SQL :

SELECT * FROM `bigquery-public-data.ml_datasets.penguins` LIMIT 1000;Cliquez sur Exécuter la cellule.

Les résultats de la requête s'affichent dans un DataFrame BigQuery.

Vous pouvez également charger les résultats de la requête dans un DataFrame BigQuery à l'aide du job de requête que vous avez exécuté précédemment dans l'éditeur de requêtes. Pour ce faire :

Accédez à la section Ensemble de résultats chargé à partir d'un job BigQuery en tant que DataFrame.

Dans le bloc de code, cliquez sur Exécuter la cellule.

Les résultats de la requête s'affichent dans un DataFrame BigQuery.

Pour obtenir des métriques descriptives pour les données, procédez comme suit :

Accédez à la section Afficher les statistiques descriptives à l'aide de describe().

Dans le bloc de code, cliquez sur Exécuter la cellule.

Les résultats s'affichent dans un DataFrame BigQuery.

Facultatif : Utilisez d'autres fonctions ou packages Python pour explorer et analyser les données.

L'exemple de code suivant montre comment utiliser :

bigframes.pandas pour analyser des données et bigframes.ml

pour créer un modèle de régression linéaire à partir de données penguins

dans un DataFrame BigQuery :

Effectuer un nettoyage

Pour éviter que les ressources utilisées lors de ce tutoriel soient facturées sur votre compte Google Cloud, supprimez le projet contenant les ressources, ou conservez le projet et supprimez les ressources individuelles.

Le moyen le plus simple d'empêcher la facturation est de supprimer le projet Google Cloud que vous avez créé pour ce tutoriel.

- Dans la console Google Cloud , accédez à la page Gérer les ressources.

- Dans la liste des projets, sélectionnez le projet que vous souhaitez supprimer, puis cliquez sur Supprimer.

- Dans la boîte de dialogue, saisissez l'ID du projet, puis cliquez sur Arrêter pour supprimer le projet.

Étapes suivantes

- Découvrez comment créer des notebooks dans BigQuery.

- En savoir plus sur l'exploration des données avec les DataFrames BigQuery.