Présentation des pipelines BigQuery

Vous pouvez utiliser des pipelines BigQuery pour automatiser et simplifier vos processus de données BigQuery. Avec les pipelines, vous pouvez planifier et exécuter des composants de code de manière séquentielle afin d'améliorer l'efficacité et de réduire les efforts manuels.

Présentation

Les pipelines sont alimentés par Dataform.

Un pipeline comprend un ou plusieurs des composants de code suivants :

Vous pouvez utiliser des pipelines pour planifier l'exécution de composants de code. Par exemple, vous pouvez planifier l'exécution quotidienne d'une requête SQL et mettre à jour une table avec les données sources les plus récentes, qui peuvent ensuite alimenter un tableau de bord.

Dans un pipeline comportant plusieurs composants de code, vous définissez la séquence d'exécution. Par exemple, pour entraîner un modèle de machine learning, vous pouvez créer un workflow dans lequel une requête SQL prépare les données, puis un notebook ultérieur entraîne le modèle à l'aide de ces données.

Capacités

Dans un pipeline, vous pouvez effectuer les opérations suivantes :

- Créer ou importer des requêtes SQL ou des notebooks existants dans un pipeline.

- Planifier l'exécution automatique d'un pipeline à une heure et une fréquence spécifiées.

- Partager un pipeline avec les utilisateurs ou les groupes que vous spécifiez.

- Partager un lien vers un pipeline.

Limites

Les pipelines sont soumis aux limites suivantes :

- Les pipelines ne sont disponibles que dans la Google Cloud console.

- Vous ne pouvez pas modifier la région de stockage d'un pipeline après sa création.

- Vous pouvez accorder aux utilisateurs ou aux groupes l'accès à un pipeline sélectionné, mais vous ne pouvez pas leur accorder l'accès à des tâches individuelles au sein du pipeline.

- Si une exécution de pipeline planifiée ne se termine pas avant le début de l'exécution planifiée suivante, cette dernière est ignorée et marquée comme une erreur.

Définir la région par défaut des composants de code

Tous les nouveaux composants de code de votre Google Cloud projet utilisent une région par défaut. Une fois le composant créé, vous ne pouvez plus modifier sa région.

Pour définir la région par défaut des nouveaux composants de code, procédez comme suit :

Accédez à la page BigQuery.

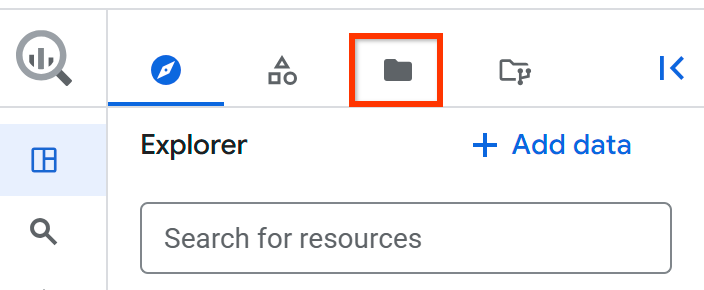

Dans le volet de gauche, cliquez sur Fichiers pour ouvrir l'explorateur de fichiers :

À côté du nom du projet, cliquez sur Afficher les actions du panneau de fichiers > Changer de région de code.

Sélectionnez la région de code que vous souhaitez utiliser par défaut.

Cliquez sur Enregistrer.

Pour obtenir la liste des régions compatibles, consultez la section Emplacements de BigQuery Studio.

Régions où le service est disponible

Tous les composants de code sont stockés dans votre région par défaut pour les composants de code. La mise à jour de la région par défaut modifie la région pour tous les composants de code créés par la suite.

Le tableau suivant regroupe les régions où les pipelines sont disponibles :

| Description de la région | Nom de la région | Détails | |

|---|---|---|---|

| Afrique | |||

| Johannesburg | africa-south1 |

||

| Amériques | |||

| Columbus | us-east5 |

||

| Dallas | us-south1 |

|

|

| Iowa | us-central1 |

|

|

| Las Vegas | us-west4 |

||

| Los Angeles | us-west2 |

||

| Mexique | northamerica-south1 |

||

| Montréal | northamerica-northeast1 |

|

|

| Virginie du Nord | us-east4 |

||

| Oklahoma | us-central2 |

|

|

| Oregon | us-west1 |

|

|

| Salt Lake City | us-west3 |

||

| Santiago | southamerica-west1 |

|

|

| São Paulo | southamerica-east1 |

|

|

| Caroline du Sud | us-east1 |

||

| Toronto | northamerica-northeast2 |

|

|

| Asie-Pacifique | |||

| Bangkok | asia-southeast3 |

||

| Delhi | asia-south2 |

||

| Hong Kong | asia-east2 |

||

| Jakarta | asia-southeast2 |

||

| Melbourne | australia-southeast2 |

||

| Mumbai | asia-south1 |

||

| Osaka | asia-northeast2 |

||

| Séoul | asia-northeast3 |

||

| Singapour | asia-southeast1 |

||

| Sydney | australia-southeast1 |

||

| Taïwan | asia-east1 |

||

| Tokyo | asia-northeast1 |

||

| Europe | |||

| Belgique | europe-west1 |

|

|

| Berlin | europe-west10 |

||

| Finlande | europe-north1 |

|

|

| Francfort | europe-west3 |

||

| Londres | europe-west2 |

|

|

| Madrid | europe-southwest1 |

|

|

| Milan | europe-west8 |

||

| Pays-Bas | europe-west4 |

|

|

| Paris | europe-west9 |

|

|

| Stockholm | europe-north2 |

|

|

| Turin | europe-west12 |

||

| Varsovie | europe-central2 |

||

| Zurich | europe-west6 |

|

|

| Moyen-Orient | |||

| Dammam | me-central2 |

||

| Doha | me-central1 |

||

| Tel Aviv | me-west1 |

||

Quotas et limites

Les pipelines BigQuery sont soumis aux quotas et limites de Dataform.

Tarifs

L'exécution des tâches de pipeline BigQuery entraîne des frais de calcul et de stockage dans BigQuery. Pour en savoir plus, consultez la page relative aux tarifs de BigQuery .

Les pipelines contenant des notebooks entraînent des frais d'exécution Colab Enterprise en fonction du type de machine par défaut. Pour en savoir plus sur les tarifs, consultez la page Tarifs de Colab Enterprise.

Chaque exécution de pipeline BigQuery est journalisée à l'aide de Cloud Logging. La journalisation est automatiquement activée pour les exécutions de pipeline BigQuery, ce qui peut entraîner des frais de facturation Cloud Logging. Pour en savoir plus, consultez la section sur les tarifs de Cloud Logging .

Étape suivante

- Découvrez comment créer des pipelines.

- Découvrez comment gérer des pipelines.

- Découvrez comment planifier des pipelines.