Pianificare un trasferimento Snowflake

Il connettore Snowflake fornito da BigQuery Data Transfer Service consente di pianificare e gestire i job di trasferimento automatico per eseguire la migrazione dei dati da Snowflake a BigQuery utilizzando le liste consentite di IP pubblici.

Panoramica

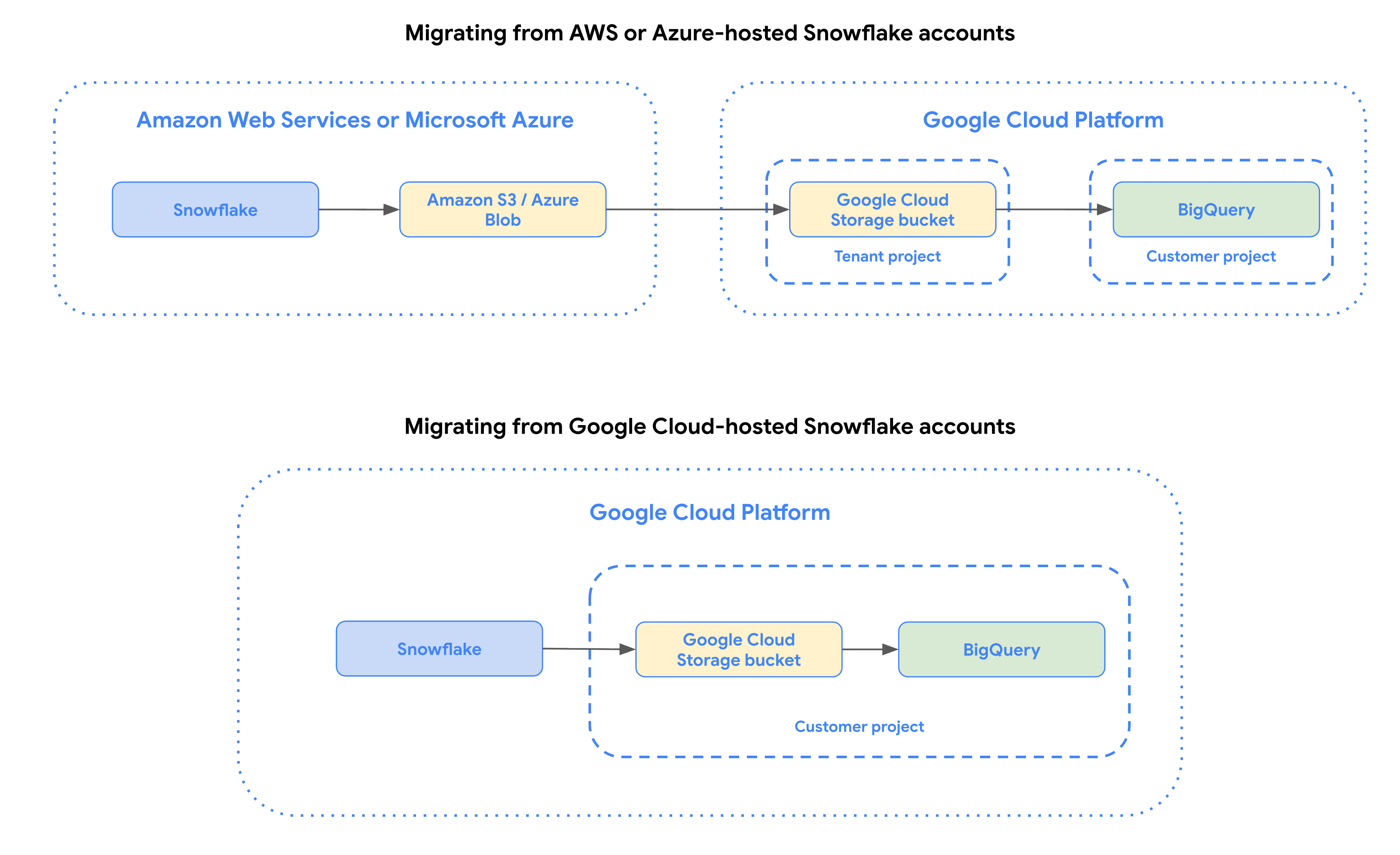

Il connettore Snowflake impiega agenti di migrazione in Google Kubernetes Engine e attiva un'operazione di caricamento da Snowflake a un'area temporanea all'interno dello stesso provider cloud in cui è ospitato Snowflake.

- Per gli account Snowflake ospitati su Amazon Web Services (AWS), i dati vengono prima preparati nel bucket Amazon S3, che viene poi trasferito a BigQuery con BigQuery Data Transfer Service.

- Per gli account Snowflake ospitati su Google Cloud, i dati vengono prima organizzati in gestione temporanea nel bucket Cloud Storage, che viene poi trasferito a BigQuery con BigQuery Data Transfer Service.

- Per gli account Snowflake ospitati su Azure, i dati vengono prima inseriti temporaneamente nel tuo contenitore Azure Blob Storage, che viene poi trasferito a BigQuery con BigQuery Data Transfer Service.

Il seguente diagramma confronta i trasferimenti di dati dagli account Snowflake ospitati su altri cloud provider e dagli account Snowflake ospitati su Google Cloud.

Limitazioni

I trasferimenti di dati effettuati utilizzando il connettore Snowflake sono soggetti alle seguenti limitazioni:

- Il connettore Snowflake supporta solo i trasferimenti dalle tabelle all'interno di un singolo database e schema Snowflake. Per eseguire il trasferimento da tabelle con più database o schemi Snowflake, puoi configurare ogni job di trasferimento separatamente.

- La velocità di caricamento dei dati da Snowflake al bucket Amazon S3, al contenitore Azure Blob Storage o al bucket Cloud Storage è limitata dal warehouse Snowflake che hai scelto per questo trasferimento.

- BigQuery scrive i dati da Snowflake a

Cloud Storage come file Parquet. I file Parquet non supportano i tipi di dati

TIMESTAMP_TZeTIMESTAMP_LTZ. Se i tuoi dati contengono questi tipi, puoi esportarli in Amazon S3 come file CSV e poi importare i file CSV in BigQuery. Per saperne di più, consulta Panoramica dei trasferimenti di Amazon S3.

Prima di iniziare

Prima di configurare un trasferimento Snowflake, devi eseguire tutti i passaggi elencati in questa sezione. Di seguito è riportato un elenco di tutti i passaggi obbligatori.

- Preparare il Google Cloud progetto

- Ruoli BigQuery richiesti

- Prepara il bucket di gestione temporanea

- Crea un utente Snowflake con le autorizzazioni richieste

- Aggiungere policy di rete

- (Facoltativo) Rilevamento e mappatura dello schema

- Valuta Snowflake per verificare la presenza di tipi di dati non supportati

- (Facoltativo) Attiva i trasferimenti incrementali

- (Facoltativo) Abilita la connettività privata

- Raccogliere informazioni sul trasferimento

- Se prevedi di specificare una chiave di crittografia gestita dal cliente (CMEK), assicurati che il tuo service account disponga delle autorizzazioni per criptare e decriptare e di disporre dell'ID risorsa chiave Cloud KMS necessario per utilizzare CMEK. Per informazioni su come funziona la CMEK con i trasferimenti, vedi Specifica la chiave di crittografia con i trasferimenti.

Prepara il progetto Google Cloud

Crea e configura il tuo progetto Google Cloud per un trasferimento Snowflake con i seguenti passaggi:

Crea un Google Cloud progetto o selezionane uno esistente.

Verifica di aver completato tutte le azioni necessarie per attivare BigQuery Data Transfer Service.

Crea un set di dati BigQuery per archiviare i tuoi dati. Non devi creare tabelle.

Ruoli BigQuery richiesti

Per ottenere le autorizzazioni

necessarie per creare un trasferimento di dati BigQuery Data Transfer Service,

chiedi all'amministratore di concederti il ruolo IAM

Amministratore BigQuery (roles/bigquery.admin) nel tuo progetto.

Per saperne di più sulla concessione dei ruoli, consulta Gestisci l'accesso a progetti, cartelle e organizzazioni.

Questo ruolo predefinito contiene le autorizzazioni necessarie per creare un trasferimento di dati BigQuery Data Transfer Service. Per vedere quali sono esattamente le autorizzazioni richieste, espandi la sezione Autorizzazioni obbligatorie:

Autorizzazioni obbligatorie

Per creare un trasferimento di dati di BigQuery Data Transfer Service sono necessarie le seguenti autorizzazioni:

-

Autorizzazioni BigQuery Data Transfer Service:

-

bigquery.transfers.update -

bigquery.transfers.get

-

-

Autorizzazioni BigQuery:

-

bigquery.datasets.get -

bigquery.datasets.getIamPolicy -

bigquery.datasets.update -

bigquery.datasets.setIamPolicy -

bigquery.jobs.create

-

Potresti anche ottenere queste autorizzazioni con ruoli personalizzati o altri ruoli predefiniti.

Per maggiori informazioni, vedi Concedere l'accesso a bigquery.admin.

Prepara il bucket di gestione temporanea

Per completare un trasferimento di dati Snowflake, devi creare un bucket di staging e poi configurarlo per consentire l'accesso in scrittura da Snowflake.

Seleziona una delle seguenti opzioni:

AWS

Bucket di staging per l'account Snowflake ospitato su AWS

Per l'account Snowflake ospitato su AWS, crea un bucket Amazon S3 per preparare i dati Snowflake prima che vengano caricati in BigQuery.

Crea e configura un oggetto di integrazione dell'archiviazione Snowflake per consentire a Snowflake di scrivere dati nel bucket Amazon S3 come area di gestione temporanea esterna.

Per consentire l'accesso in lettura al tuo bucket Amazon S3, devi anche:

Crea un utente Amazon IAM dedicato e concedigli la policy AmazonS3ReadOnlyAccess.

Crea una coppia di chiavi di accesso Amazon per l'utente IAM.

Azure

Container Azure Blob Storage di staging per l'account Snowflake ospitato su Azure

Per gli account Snowflake ospitati su Azure, crea un container Azure Blob Storage per preparare i dati Snowflake prima che vengano caricati in BigQuery.

- Crea un account di archiviazione Azure e un contenitore di archiviazione al suo interno.

- Crea e configura un oggetto di integrazione dell'archiviazione Snowflake per consentire a Snowflake di scrivere dati nel container di archiviazione Azure come area di gestione temporanea esterna. Tieni presente che il passaggio 3: creazione di un ambiente esterno può essere ignorato perché non lo utilizziamo.

Per consentire l'accesso in lettura al tuo contenitore Azure, genera un token SAS.

Google Cloud

Bucket di staging per l'account Snowflake ospitato su Google Cloud

Per gli account Snowflake ospitati da Google Cloud, crea un bucket Cloud Storage per preparare i dati Snowflake prima che vengano caricati in BigQuery.

- Crea un bucket Cloud Storage.

- Crea e configura un oggetto di integrazione dell'archiviazione Snowflake per consentire a Snowflake di scrivere dati nel bucket Cloud Storage come area di staging esterna.

Per consentire l'accesso al bucket di staging, concedi all'agente di servizio DTS il ruolo

roles/storage.objectViewercon il seguente comando:gcloud storage buckets add-iam-policy-binding gs://STAGING_BUCKET_NAME \ --member=serviceAccount:service-PROJECT_NUMBER@gcp-sa-bigquerydatatransfer.iam.gserviceaccount.com \ --role=roles/storage.objectViewer

Crea un utente Snowflake con le autorizzazioni richieste

Durante un trasferimento Snowflake, il connettore Snowflake si connette al tuo account Snowflake utilizzando una connessione JDBC. Devi creare un nuovo utente Snowflake con un ruolo personalizzato che disponga solo dei privilegi necessari per eseguire il trasferimento dei dati:

// Create and configure new role, MIGRATION_ROLE

GRANT USAGE

ON WAREHOUSE WAREHOUSE_NAME

TO ROLE MIGRATION_ROLE;

GRANT USAGE

ON DATABASE DATABASE_NAME

TO ROLE MIGRATION_ROLE;

GRANT USAGE

ON SCHEMA DATABASE_NAME.SCHEMA_NAME

TO ROLE MIGRATION_ROLE;

// You can modify this to give select permissions for all tables in a schema

GRANT SELECT

ON TABLE DATABASE_NAME.SCHEMA_NAME.TABLE_NAME

TO ROLE MIGRATION_ROLE;

GRANT USAGE

ON STORAGE_INTEGRATION_OBJECT_NAME

TO ROLE MIGRATION_ROLE;

Sostituisci quanto segue:

MIGRATION_ROLE: il nome del ruolo personalizzato che stai creandoWAREHOUSE_NAME: il nome del data warehouseDATABASE_NAME: il nome del database SnowflakeSCHEMA_NAME: il nome dello schema SnowflakeTABLE_NAME: il nome di Snowflake incluso in questo trasferimento di datiSTORAGE_INTEGRATION_OBJECT_NAME: il nome dell'oggetto di integrazione dell'archiviazione Snowflake.

Generare una coppia di chiavi per l'autenticazione

A causa del ritiro degli accessi con password a un solo fattore da parte di Snowflake, ti consigliamo di utilizzare la coppia di chiavi per l'autenticazione.

Puoi configurare una coppia di chiavi generando una coppia di chiave RSA criptata o non criptata, quindi assegnando la chiave pubblica a un utente Snowflake. Per saperne di più, consulta Configurazione dell'autenticazione con coppie di chiavi.

Aggiungere criteri di rete

Per la connettività pubblica, l'account Snowflake consente la connessione pubblica con le credenziali del database per impostazione predefinita. Tuttavia, potresti aver configurato regole o criteri di rete che potrebbero impedire al connettore Snowflake di connettersi al tuo account. In questo caso, devi aggiungere gli indirizzi IP necessari alla tua lista consentita. Per saperne di più, consulta Configura le policy di rete per i trasferimenti Snowflake.

Rilevamento e mappatura dello schema

Per definire lo schema, puoi utilizzare BigQuery Data Transfer Service per rilevare automaticamente lo schema e il mapping dei tipi di dati durante il trasferimento dei dati da Snowflake a BigQuery. In alternativa, puoi utilizzare il motore di traduzione per definire manualmente lo schema e i tipi di dati.

Per ulteriori informazioni, consulta Rilevamento e mappatura dello schema per Snowflake.

Attiva i trasferimenti incrementali

Per configurare un trasferimento incrementale dei dati di Snowflake, vedi Configurare i trasferimenti incrementali per Snowflake.

Abilita la connettività privata

Se vuoi creare un trasferimento di dati Snowflake privato, devi configurare la rete per la connettività privata.

Raccogliere informazioni sul trasferimento

Raccogli le informazioni necessarie per configurare la migrazione con BigQuery Data Transfer Service:

- L'identificatore dell'account Snowflake, ovvero il prefisso nell'URL dell'account Snowflake. Ad esempio,

ACCOUNT_IDENTIFIER.snowflakecomputing.com. - Il nome utente e la chiave privata associata con le autorizzazioni appropriate per il tuo database Snowflake. Può avere solo le autorizzazioni richieste per eseguire il trasferimento dei dati.

- L'URI del bucket di staging che vuoi utilizzare per il trasferimento:

- Per un account Snowflake ospitato su AWS, è necessario un URI bucket Amazon S3 insieme alle credenziali di accesso.

- Per un'istanza di Snowflake ospitata su Azure, è necessario un account e un contenitore Azure Blob Storage.

- Per un account Snowflake ospitato su Google Cloud, è richiesto un URI bucket Cloud Storage. Ti consigliamo di configurare una policy del ciclo di vita per questo bucket per evitare addebiti non necessari.

- L'URI del bucket Cloud Storage in cui hai archiviato i file di mappatura dello schema ottenuti dal motore di traduzione.

Configura un trasferimento Snowflake

Seleziona una delle seguenti opzioni:

Console

Vai alla pagina Trasferimenti di dati nella console Google Cloud .

Fai clic su Crea trasferimento.

Nella sezione Tipo di origine, seleziona Migrazione Snowflake dall'elenco Origine.

Nella sezione Nome configurazione di trasferimento, inserisci un nome per il trasferimento, ad esempio

My migration, nel campo Nome visualizzato. Il nome visualizzato può essere qualsiasi valore che ti consenta di identificare il trasferimento se devi modificarlo in un secondo momento.Nella sezione Impostazioni destinazione, scegli il set di dati che hai creato dall'elenco Set di dati.

Nella sezione Credenziali Snowflake, segui questi passaggi:

- Per Identificatore account, inserisci un identificatore univoco per il tuo account Snowflake, che è una combinazione del nome dell'organizzazione e del nome dell'account. L'identificatore è il prefisso dell'URL dell'account Snowflake e non l'URL completo. Ad esempio,

ACCOUNT_IDENTIFIER.snowflakecomputing.com. - In Nome utente, inserisci il nome utente dell'utente Snowflake le cui credenziali e autorizzazione vengono utilizzate per accedere al database per trasferire le tabelle Snowflake. Ti consigliamo di utilizzare l'utente che hai creato per questo trasferimento.

- Per Authentication Mechanism (Meccanismo di autenticazione), seleziona un metodo di autenticazione utente Snowflake:

PASSWORD

- In Password, inserisci la password dell'utente Snowflake.

KEY_PAIR

- Per Chiave privata, inserisci la chiave privata collegata alla chiave pubblica associata all'utente Snowflake.

- Per Is Private Key Encrypted (La chiave privata è criptata), seleziona questo campo se la chiave privata è criptata con una passphrase.

- In Passphrase chiave privata, inserisci la passphrase per la chiave privata criptata. Questo campo è obbligatorio se hai selezionato Is Private Key Encrypted. Per saperne di più, vedi Generare una coppia di chiavi per l'autenticazione.

- Per Warehouse, inserisci un warehouse utilizzato per l'esecuzione di questo trasferimento di dati.

- In Database Snowflake, inserisci il nome del database Snowflake che contiene le tabelle incluse in questo trasferimento di dati.

- Per Schema Snowflake, inserisci il nome dello schema Snowflake che contiene le tabelle incluse in questo trasferimento di dati.

- Per Identificatore account, inserisci un identificatore univoco per il tuo account Snowflake, che è una combinazione del nome dell'organizzazione e del nome dell'account. L'identificatore è il prefisso dell'URL dell'account Snowflake e non l'URL completo. Ad esempio,

Nella sezione Configurazione dell'archiviazione, segui questi passaggi:

- Per Nome oggetto integrazione storage, inserisci il nome dell'oggetto integrazione storage Snowflake.

- (Facoltativo) Per Dimensione massima file, specifica la dimensione massima di ogni file scaricato da Snowflake nella posizione di staging (in MB).

Per Cloud provider, seleziona

AWS,AZUREoGCPa seconda del cloud provider che ospita il tuo account Snowflake.AWS

- Per URI Amazon S3, inserisci l'URI del bucket Amazon S3 da utilizzare come area di staging.

- In ID chiave di accesso e Chiave di accesso segreta, inserisci la coppia di chiavi di accesso.

Azure

- Per Nome account Azure Storage e Il contenitore nell'account Azure Storage, inserisci il nome dell'account di archiviazione e del contenitore di Azure Blob Storage da utilizzare come area di gestione temporanea.

- In Token SAS, inserisci il token SAS generato per il contenitore.

Google Cloud

- In URI GCS, inserisci l'URI di Cloud Storage da utilizzare come area di gestione temporanea.

Nella sezione Service Account, segui questi passaggi:

- In Service account, inserisci un account di servizio da utilizzare con questo trasferimento di dati. Il account di servizio deve appartenere allo stesso progettoGoogle Cloud in cui vengono creati la configurazione del trasferimento e il set di dati di destinazione. Il account di servizio deve disporre delle autorizzazioni richieste

storage.objects.listestorage.objects.get.

- In Service account, inserisci un account di servizio da utilizzare con questo trasferimento di dati. Il account di servizio deve appartenere allo stesso progettoGoogle Cloud in cui vengono creati la configurazione del trasferimento e il set di dati di destinazione. Il account di servizio deve disporre delle autorizzazioni richieste

Nella sezione Configurazione schema, segui questi passaggi:

- Per Tipo di importazione, seleziona Completa o Incrementale. Per maggiori informazioni, consulta Configura i trasferimenti incrementali.

- Per Pattern del nome della tabella, specifica una tabella da trasferire inserendo

un nome o un pattern che corrisponda al nome della tabella nello schema. Puoi

utilizzare espressioni regolari per specificare il pattern, ad esempio

table1_regex;table2_regex. Il pattern deve seguire la sintassi delle espressioni regolari Java. Ad esempio,lineitem;ordertbcorrisponde alle tabelle denominatelineitemeordertb..*corrisponde a tutte le tabelle.

- (Facoltativo) Per Utilizza l'output di BigQuery Translation Engine, seleziona questo campo se vuoi specificare un percorso di output di traduzione personalizzato.

- (Facoltativo) Per Percorso GCS di output della traduzione, specifica un percorso della cartella Cloud Storage che contiene i file di mapping dello schema del motore di traduzione. Puoi lasciare questo campo vuoto per consentire al connettore Snowflake di rilevare automaticamente lo schema.

- Il percorso deve seguire il formato

translation_target_base_uri/metadata/config/db/schema/e deve terminare con/.

- Il percorso deve seguire il formato

- (Facoltativo) Per Percorso file schema personalizzato, specifica il percorso Cloud Storage di un file di schema personalizzato.

- (Facoltativo) Per Mappa NUMBER Snowflake con scala zero a INT64 BigQuery, seleziona questo campo se vuoi che i tipi

NUMBER(p, 0)di Snowflake vengano mappati aINT64di BigQuery.

Nella sezione Connettività di rete, segui questi passaggi:

- Per Utilizza rete privata, se stai creando un trasferimento di dati privati, seleziona True.

- Per il collegamento di servizio PSC, se stai creando una connessione privata, inserisci l'URI del collegamento di servizio. Per saperne di più, consulta Creare una configurazione di trasferimento privato Snowflake.

- Per Private Network Service, se stai creando un trasferimento privato di dati, inserisci il self-link di Service Directory. Per saperne di più, consulta Creare una configurazione di trasferimento privato Snowflake.

(Facoltativo) Nella sezione Opzioni di notifica, segui questi passaggi:

- Fai clic sul pulsante di attivazione/disattivazione per abilitare le notifiche via email. Quando attivi questa opzione, l'amministratore del trasferimento riceve una notifica via email quando l'esecuzione di un trasferimento non riesce.

- In Seleziona un argomento Pub/Sub, scegli il nome dell'argomento o fai clic su Crea un argomento. Questa opzione configura l'esecuzione delle notifiche di Pub/Sub in relazione al trasferimento.

Se utilizzi le CMEK, nella sezione Opzioni avanzate, seleziona Chiave gestita dal cliente. Viene visualizzato un elenco di CMEK disponibili tra cui scegliere. Per informazioni su come funzionano le CMEK con BigQuery Data Transfer Service, vedi Specificare la chiave di crittografia con i trasferimenti.

Fai clic su Salva.

La console Google Cloud mostra tutti i dettagli della configurazione del trasferimento, incluso un Nome risorsa per questo trasferimento.

bq

Inserisci il comando bq mk e fornisci il flag di creazione del trasferimento

--transfer_config. Sono necessari anche i seguenti flag:

--project_id--data_source--target_dataset--display_name--params

bq mk \ --transfer_config \ --project_id=project_id \ --data_source=data_source \ --target_dataset=dataset \ --display_name=name \ --service_account_name=service_account \ --params='parameters'

Sostituisci quanto segue:

- project_id: il tuo ID progetto Google Cloud . Se

--project_idnon è specificato, viene utilizzato il progetto predefinito. - data_source: l'origine dati,

snowflake_migration. - dataset: il set di dati BigQuery di destinazione per la configurazione del trasferimento.

- name: il nome visualizzato per la configurazione del trasferimento. Il nome del trasferimento può essere qualsiasi valore che ti consenta di identificare il trasferimento se devi modificarlo in un secondo momento.

- service_account: (facoltativo) il nome del account di servizio utilizzato per

autenticare il trasferimento. Il account di servizio deve essere di proprietà dello stesso

project_idutilizzato per creare il trasferimento e deve disporre di tutti i ruoli richiesti. - parameters: i parametri per la configurazione del trasferimento creato in formato JSON. Ad esempio:

--params='{"param":"param_value"}'.

Puoi configurare i seguenti parametri per la configurazione del trasferimento Snowflake:

account_identifier: specifica un identificatore univoco per il tuo account Snowflake, che è una combinazione del nome dell'organizzazione e del nome dell'account. L'identificatore è il prefisso dell'URL dell'account Snowflake e non l'URL completo. Ad esempio,account_identifier.snowflakecomputing.com.username: specifica il nome utente dell'utente Snowflake le cui credenziali e autorizzazione vengono utilizzate per accedere al tuo database per trasferire le tabelle Snowflake.auth_mechanism: specifica il metodo di autenticazione utente Snowflake. I valori supportati sonoPASSWORDeKEY_PAIR. Per saperne di più, vedi Generare una coppia di chiavi per l'autenticazione.password: specifica la password dell'utente Snowflake. Questo campo è obbligatorio se hai specificatoPASSWORDnel campoauth_mechanism.private_key: specifica la chiave privata collegata alla chiave pubblica associata all'utente Snowflake. Questo campo è obbligatorio se hai specificatoKEY_PAIRnel campoauth_mechanism.is_private_key_encrypted: specificatruese la chiave privata è criptata con una passphrase.private_key_passphrase: specifica la passphrase per la chiave privata criptata. Questo campo è obbligatorio se hai specificatoKEY_PAIRnel campoauth_mechanismetruenel campois_private_key_encrypted.warehouse: specifica un warehouse utilizzato per l'esecuzione di questo trasferimento di dati.service_account: specifica un account di servizio da utilizzare con questo trasferimento di dati. Il account di servizio deve appartenere allo stesso progetto Google Cloud in cui vengono creati la configurazione del trasferimento e il set di dati di destinazione. Il account di servizio deve disporre delle autorizzazioni richiestestorage.objects.listestorage.objects.get.database: specifica il nome del database Snowflake che contiene le tabelle incluse in questo trasferimento di dati.schema: specifica il nome dello schema Snowflake che contiene le tabelle incluse in questo trasferimento di dati.table_name_patterns: specifica una tabella da trasferire inserendo un nome o un pattern che corrisponda al nome della tabella nello schema. Puoi utilizzare espressioni regolari per specificare il pattern, ad esempiotable1_regex;table2_regex. Il pattern deve seguire la sintassi delle espressioni regolari Java. Ad esempio,lineitem;ordertbcorrisponde alle tabelle denominatelineitemeordertb..*corrisponde a tutte le tabelle.Puoi anche lasciare vuoto questo campo per eseguire la migrazione di tutte le tabelle dallo schema specificato.

ingestion_mode: specifica la modalità di importazione per il trasferimento. I valori supportati sonoFULLeINCREMENTAL. Per maggiori informazioni, vedi Configurare i trasferimenti incrementali.translation_output_gcs_path: (Facoltativo) specifica un percorso della cartella Cloud Storage che contiene i file di mappatura dello schema del motore di traduzione. Puoi lasciare questo campo vuoto per consentire al connettore Snowflake di rilevare automaticamente lo schema.- Il percorso deve seguire il formato

gs://translation_target_base_uri/metadata/config/db/schema/e deve terminare con/.

- Il percorso deve seguire il formato

storage_integration_object_name: specifica il nome dell'oggetto di integrazione dell'archiviazione Snowflake.cloud_provider: inserisciAWS,AZUREoGCPa seconda del provider di servizi cloud che ospita il tuo account Snowflake.staging_s3_uri: inserisci l'URI del bucket S3 da utilizzare come area di staging. Obbligatorio solo quandocloud_providerèAWS.aws_access_key_id: inserisci la coppia di chiavi di accesso. Obbligatorio solo quandocloud_providerèAWS.aws_secret_access_key: inserisci la coppia di chiavi di accesso. Obbligatorio solo quandocloud_providerèAWS.azure_storage_account: inserisci il nome dell'account di archiviazione da utilizzare come area di gestione temporanea. Obbligatorio solo quandocloud_providerèAZURE.staging_azure_container: inserisci il container in Azure Blob Storage da utilizzare come area di staging. Obbligatorio solo quandocloud_providerèAZURE.azure_sas_token: inserisci il token SAS. Obbligatorio solo quandocloud_providerèAZURE.staging_gcs_uri: inserisci l'URI di Cloud Storage da utilizzare come area di gestione temporanea. Obbligatorio solo quandocloud_providerèGCP.use_private_network: se stai creando un trasferimento di dati privati, imposta questo campo suTRUE.service_attachment: se stai creando un trasferimento di dati privato, specifica l'URI del collegamento al servizio. Per saperne di più, consulta Creare una configurazione di trasferimento privato Snowflake.private_network_service: se stai creando un trasferimento di dati privato, specifica il self-link del servizio NLB. Per saperne di più, consulta Creare una configurazione di trasferimento privato Snowflake.

Ad esempio, per un account Snowflake ospitato su AWS, il seguente comando crea un trasferimento Snowflake denominato Snowflake transfer config con un set di dati di destinazione denominato your_bq_dataset e un progetto con l'ID your_project_id.

PARAMS='{ "account_identifier": "your_account_identifier", "auth_mechanism": "KEY_PAIR", "aws_access_key_id": "your_access_key_id", "aws_secret_access_key": "your_aws_secret_access_key", "cloud_provider": "AWS", "database": "your_sf_database", "ingestion_mode": "INCREMENTAL", "private_key": "-----BEGIN PRIVATE KEY----- privatekey\nseparatedwith\nnewlinecharacters=-----END PRIVATE KEY-----", "schema": "your_snowflake_schema", "service_account": "your_service_account", "storage_integration_object_name": "your_storage_integration_object", "staging_s3_uri": "s3://your/s3/bucket/uri", "table_name_patterns": ".*", "translation_output_gcs_path": "gs://sf_test_translation/output/metadata/config/database_name/schema_name/", "username": "your_sf_username", "warehouse": "your_warehouse" }' bq mk --transfer_config \ --project_id=your_project_id \ --target_dataset=your_bq_dataset \ --display_name='snowflake transfer config' \ --params="$PARAMS" \ --data_source=snowflake_migration

API

Utilizza il metodo projects.locations.transferConfigs.create e fornisci un'istanza della risorsa TransferConfig.

Specifica la chiave di crittografia con i trasferimenti

Puoi specificare le chiavi di crittografia gestite dal cliente (CMEK) per criptare i dati per un'esecuzione del trasferimento. Puoi utilizzare una chiave CMEK per supportare i trasferimenti da Snowflake.Quando specifichi una CMEK con un trasferimento, BigQuery Data Transfer Service la applica a qualsiasi cache su disco intermedia dei dati importati, in modo che l'intero flusso di lavoro di trasferimento dei dati sia conforme alla CMEK.

Non puoi aggiornare un trasferimento esistente per aggiungere una chiave CMEK se il trasferimento non è stato originariamente creato con una chiave CMEK. Ad esempio, non puoi modificare una tabella di destinazione che originariamente era criptata per impostazione predefinita in modo che ora sia criptata con CMEK. Al contrario, non puoi modificare una tabella di destinazione criptata con CMEK in modo che abbia un tipo di crittografia diverso.

Puoi aggiornare una CMEK per un trasferimento se la configurazione del trasferimento è stata originariamente creata con una crittografia CMEK. Quando aggiorni una CMEK per una configurazione di trasferimento, BigQuery Data Transfer Service la propaga alle tabelle di destinazione alla successiva esecuzione del trasferimento, durante la quale BigQuery Data Transfer Service sostituisce le CMEK obsolete con la nuova CMEK. Per saperne di più, vedi Aggiornare un trasferimento.

Puoi anche utilizzare le chiavi predefinite del progetto. Quando specifichi una chiave predefinita del progetto con un trasferimento, BigQuery Data Transfer Service utilizza la chiave predefinita del progetto come chiave predefinita per qualsiasi nuova configurazione di trasferimento.

Quote e limiti

Per impostazione predefinita, BigQuery ha una quota di caricamento di 15 TB per ogni job di caricamento per ogni tabella. Internamente, Snowflake comprime i dati della tabella, quindi la dimensione della tabella esportata è maggiore di quella riportata da Snowflake.

Per migliorare i tempi di caricamento delle tabelle più grandi, specifica il tipo di prestazione PIPELINE

per l'assegnazione della prenotazione.

A causa del modello di coerenza di Amazon S3, è possibile che alcuni file non vengano inclusi nel trasferimento a BigQuery.

Ottimizzare il rendimento del trasferimento dei dati

Puoi monitorare il rendimento dei trasferimenti di dati visualizzando i log per il trasferimento di dati. Per migliorare il rendimento dei trasferimenti di dati, ti consigliamo di eseguire i seguenti passaggi di ottimizzazione:

- Mantieni l'istanza Snowflake, il bucket di staging e il set di dati BigQuery nella stessa regione

- Puoi migliorare la velocità di scaricamento delle tabelle nel seguente modo:

- Aumenta le dimensioni del tuo warehouse virtuale Snowflake, soprattutto quando trasferisci tabelle Snowflake di grandi dimensioni (1 TiB o più).

- Modifica l'opzione

MAX_FILE_SIZEnella configurazione del trasferimento.- File di dimensioni ridotte possono migliorare le velocità di trasferimento, ma se sono troppo piccoli possono portare a un numero eccessivo di file.

- Puoi migliorare la velocità di caricamento delle tabelle aumentando il numero di prenotazioni di slot BigQuery per i tipi di job

PIPELINEeQUERY. - Quando esegui un trasferimento completo, evita il clustering e il partizionamento nella tabella BigQuery di destinazione.

- Quando esegui un trasferimento incrementale in modalità Upsert, valuta il clustering e il partizionamento delle colonne della chiave primaria per migliorare il rendimento del trasferimento.

- Tuttavia, evita il clustering e il partizionamento nelle colonne delle chiavi non primarie per evitare operazioni di unione più lente.

Prezzi

Per informazioni sui prezzi di BigQuery Data Transfer Service, consulta la pagina Prezzi.

- Se il warehouse Snowflake e il bucket Amazon S3 si trovano in regioni diverse, Snowflake applica addebiti per l'uscita quando esegui un trasferimento di dati Snowflake. Non sono previsti costi di uscita per i trasferimenti di dati Snowflake se sia il warehouse Snowflake sia il bucket Amazon S3 si trovano nella stessa regione.

- Quando i dati vengono trasferiti da AWS a Google Cloud, vengono applicati costi di uscita inter-cloud.

Passaggi successivi

- Scopri di più su BigQuery Data Transfer Service.

- Esegui la migrazione del codice SQL con la traduzione SQL batch.