Menjadwalkan transfer Snowflake

Konektor Snowflake yang disediakan oleh BigQuery Data Transfer Service memungkinkan Anda menjadwalkan dan mengelola tugas transfer otomatis untuk memigrasikan data dari Snowflake ke BigQuery menggunakan daftar yang diizinkan IP publik.

Ringkasan

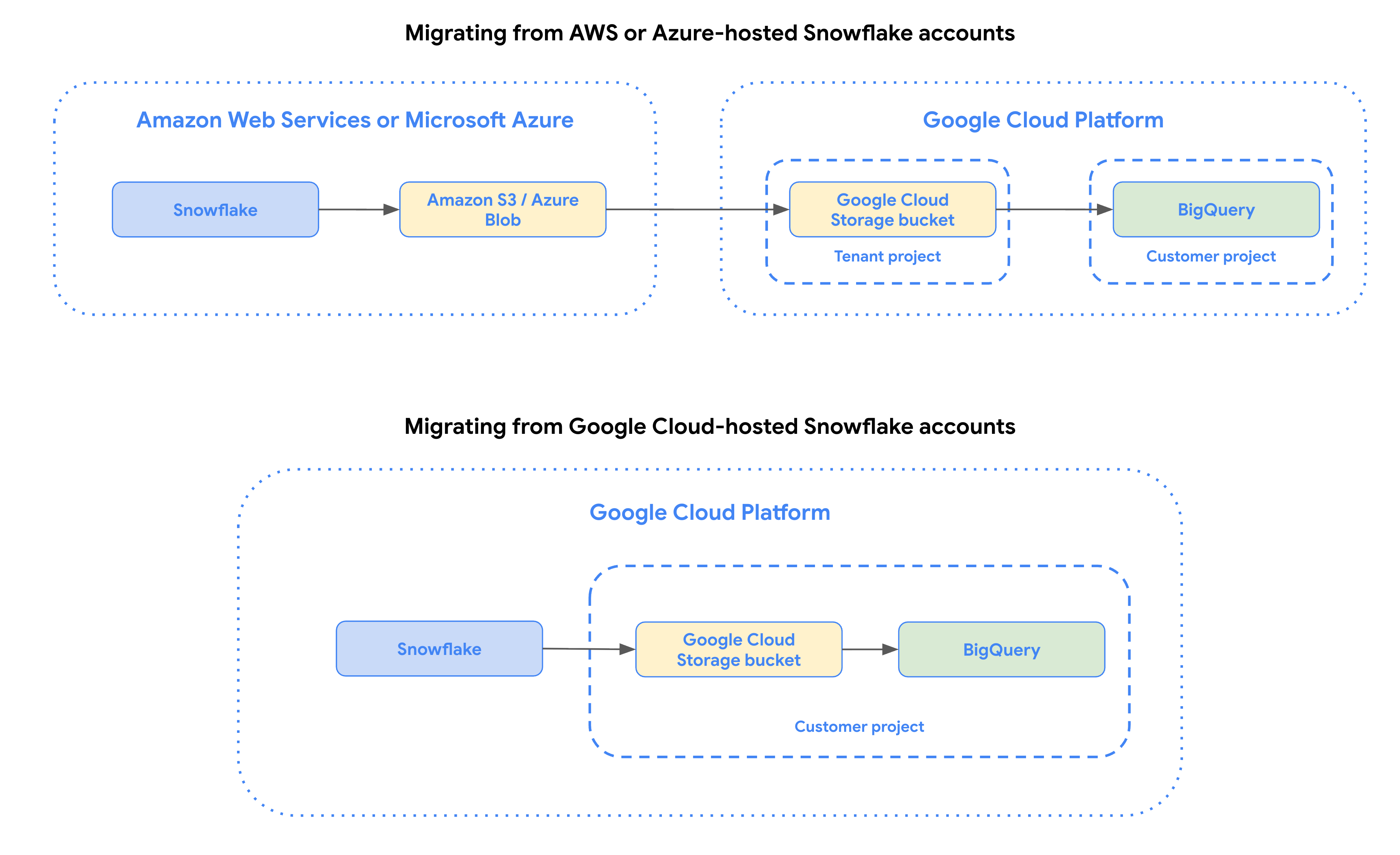

Konektor Snowflake melibatkan agen migrasi di Google Kubernetes Engine dan memicu operasi pemuatan dari Snowflake ke area staging dalam penyedia cloud yang sama tempat Snowflake dihosting.

- Untuk akun Snowflake yang dihosting Amazon Web Services (AWS), data pertama-tama diatur dalam bucket Amazon S3 Anda, yang kemudian ditransfer ke BigQuery dengan BigQuery Data Transfer Service.

- Untuk akun Snowflake yang dihosting diGoogle Cloud, data pertama-tama akan di-staging di bucket Cloud Storage Anda, yang kemudian ditransfer ke BigQuery dengan BigQuery Data Transfer Service.

- Untuk akun Snowflake yang dihosting di Azure, data pertama-tama ditahapkan di penampung Azure Blob Storage Anda, yang kemudian ditransfer ke BigQuery dengan BigQuery Data Transfer Service.

Diagram berikut membandingkan transfer data dari akun Snowflake yang dihosting di penyedia cloud lain, dan akun Snowflake yang dihosting di Google Cloud.

Batasan

Transfer data yang dilakukan menggunakan konektor Snowflake tunduk pada batasan berikut:

- Konektor Snowflake hanya mendukung transfer dari tabel dalam satu database dan skema Snowflake. Untuk mentransfer dari tabel dengan beberapa database atau skema Snowflake, Anda dapat menyiapkan setiap tugas transfer secara terpisah.

- Kecepatan pemuatan data dari Snowflake ke bucket Amazon S3 atau container Azure Blob Storage atau bucket Cloud Storage dibatasi oleh warehouse Snowflake yang telah Anda pilih untuk transfer ini.

- BigQuery menulis data dari Snowflake ke

Cloud Storage sebagai file Parquet. File Parquet tidak mendukung jenis data

TIMESTAMP_TZdanTIMESTAMP_LTZ. Jika data Anda berisi jenis ini, Anda dapat mengekspornya ke Amazon S3 sebagai file CSV, lalu mengimpor file CSV tersebut ke BigQuery. Untuk mengetahui informasi selengkapnya, lihat Ringkasan transfer Amazon S3.

Sebelum memulai

Sebelum menyiapkan transfer Snowflake, Anda harus melakukan semua langkah yang tercantum di bagian ini. Berikut adalah daftar semua langkah yang diperlukan.

- Menyiapkan Google Cloud project

- Peran BigQuery yang diperlukan

- Menyiapkan bucket penyiapan

- Membuat pengguna Snowflake dengan izin yang diperlukan

- Menambahkan kebijakan jaringan

- Opsional: Deteksi dan pemetaan skema

- Menilai Snowflake Anda untuk mengetahui apakah ada jenis data yang tidak didukung

- Opsional: Mengaktifkan transfer inkremental

- Opsional: Aktifkan konektivitas pribadi

- Mengumpulkan informasi transfer

- Jika Anda berencana menentukan kunci enkripsi yang dikelola pelanggan (CMEK), pastikan bahwa akun layanan memiliki izin untuk mengenkripsi dan mendekripsi, dan Anda memiliki ID resource kunci Cloud KMS yang diperlukan untuk menggunakan CMEK. Untuk mengetahui informasi tentang cara kerja CMEK dengan transfer, lihat Menentukan kunci enkripsi dengan transfer.

Menyiapkan project Google Cloud

Buat dan konfigurasi project Google Cloud untuk transfer Snowflake dengan langkah-langkah berikut:

Buat project Google Cloud atau pilih project yang ada.

Pastikan Anda telah menyelesaikan semua tindakan yang diperlukan untuk mengaktifkan BigQuery Data Transfer Service.

Buat set data BigQuery untuk menyimpan data Anda. Anda tidak perlu membuat tabel apa pun.

Peran BigQuery yang diperlukan

Untuk mendapatkan izin yang diperlukan guna membuat transfer data BigQuery Data Transfer Service,

minta administrator untuk memberi Anda

peran IAM BigQuery Admin (roles/bigquery.admin) di project Anda.

Untuk mengetahui informasi selengkapnya tentang cara memberikan peran, lihat Mengelola akses ke project, folder, dan organisasi.

Peran bawaan ini berisi izin yang diperlukan untuk membuat transfer data BigQuery Data Transfer Service. Untuk melihat izin yang benar-benar diperlukan, perluas bagian Izin yang diperlukan:

Izin yang diperlukan

Izin berikut diperlukan untuk membuat transfer data BigQuery Data Transfer Service:

-

Izin BigQuery Data Transfer Service:

-

bigquery.transfers.update -

bigquery.transfers.get

-

-

Izin BigQuery:

-

bigquery.datasets.get -

bigquery.datasets.getIamPolicy -

bigquery.datasets.update -

bigquery.datasets.setIamPolicy -

bigquery.jobs.create

-

Anda mungkin juga bisa mendapatkan izin ini dengan peran khusus atau peran bawaan lainnya.

Untuk mengetahui informasi selengkapnya, lihat Memberikan akses bigquery.admin.

Menyiapkan bucket staging

Untuk menyelesaikan transfer data Snowflake, Anda harus membuat bucket penyiapan, lalu mengonfigurasinya agar mengizinkan akses tulis dari Snowflake.

Pilih salah satu opsi berikut:

AWS

Bucket penyiapan untuk akun Snowflake yang dihosting di AWS

Untuk akun Snowflake yang dihosting AWS, buat bucket Amazon S3 untuk melakukan staging data Snowflake sebelum dimuat ke BigQuery.

Buat dan konfigurasi objek integrasi penyimpanan Snowflake untuk mengizinkan Snowflake menulis data ke bucket Amazon S3 sebagai tahap eksternal.

Untuk mengizinkan akses baca di bucket Amazon S3, Anda juga harus melakukan hal berikut:

Buat pengguna IAM Amazon khusus dan berikan kebijakan AmazonS3ReadOnlyAccess kepadanya.

Buat pasangan kunci akses Amazon untuk pengguna IAM.

Azure

Menyiapkan kontainer Azure Blob Storage untuk akun Snowflake yang dihosting di Azure

Untuk akun Snowflake yang dihosting di Azure, buat kontainer Azure Blob Storage untuk menyiapkan data Snowflake sebelum dimuat ke BigQuery.

- Buat akun penyimpanan Azure dan penampung penyimpanan di dalamnya.

- Buat dan konfigurasi objek integrasi penyimpanan Snowflake untuk mengizinkan Snowflake menulis data ke dalam kontainer penyimpanan Azure sebagai tahap eksternal. Perhatikan bahwa 'Langkah 3: Membuat panggung eksternal' dapat dilewati karena kita tidak menggunakannya.

Untuk mengizinkan akses baca pada penampung Azure Anda, buat Token SAS untuk penampung tersebut.

Google Cloud

Bucket penyiapan untuk akun Snowflake yang dihosting Google Cloud

Untuk akun Snowflake yang dihosting Google Cloud, buat bucket Cloud Storage untuk menyimpan data Snowflake sebelum dimuat ke BigQuery.

- Buat bucket Cloud Storage.

- Buat dan konfigurasi objek integrasi penyimpanan Snowflake untuk mengizinkan Snowflake menulis data ke bucket Cloud Storage sebagai tahap eksternal.

Untuk mengizinkan akses ke bucket penyiapan, Berikan peran

roles/storage.objectViewerkepada agen layanan DTS dengan perintah berikut:gcloud storage buckets add-iam-policy-binding gs://STAGING_BUCKET_NAME \ --member=serviceAccount:service-PROJECT_NUMBER@gcp-sa-bigquerydatatransfer.iam.gserviceaccount.com \ --role=roles/storage.objectViewer

Buat pengguna Snowflake dengan izin yang diperlukan

Selama transfer Snowflake, konektor Snowflake terhubung ke akun Snowflake Anda menggunakan koneksi JDBC. Anda harus membuat pengguna Snowflake baru dengan peran kustom yang hanya memiliki hak istimewa yang diperlukan untuk melakukan transfer data:

// Create and configure new role, MIGRATION_ROLE

GRANT USAGE

ON WAREHOUSE WAREHOUSE_NAME

TO ROLE MIGRATION_ROLE;

GRANT USAGE

ON DATABASE DATABASE_NAME

TO ROLE MIGRATION_ROLE;

GRANT USAGE

ON SCHEMA DATABASE_NAME.SCHEMA_NAME

TO ROLE MIGRATION_ROLE;

// You can modify this to give select permissions for all tables in a schema

GRANT SELECT

ON TABLE DATABASE_NAME.SCHEMA_NAME.TABLE_NAME

TO ROLE MIGRATION_ROLE;

GRANT USAGE

ON STORAGE_INTEGRATION_OBJECT_NAME

TO ROLE MIGRATION_ROLE;

Ganti kode berikut:

MIGRATION_ROLE: nama peran kustom yang Anda buatWAREHOUSE_NAME: nama data warehouse AndaDATABASE_NAME: nama database Snowflake AndaSCHEMA_NAME: nama skema Snowflake AndaTABLE_NAME: nama Snowflake yang disertakan dalam transfer data iniSTORAGE_INTEGRATION_OBJECT_NAME: nama objek integrasi penyimpanan Snowflake Anda.

Membuat pasangan kunci untuk autentikasi

Karena penghentian penggunaan login sandi satu faktor oleh Snowflake, sebaiknya gunakan pasangan kunci untuk autentikasi.

Anda dapat mengonfigurasi pasangan kunci dengan membuat pasangan kunci RSA terenkripsi atau tidak terenkripsi, lalu menetapkan kunci publik ke pengguna Snowflake. Untuk mengetahui informasi selengkapnya, lihat Mengonfigurasi autentikasi pasangan kunci.

Menambahkan kebijakan jaringan

Untuk konektivitas publik, akun Snowflake mengizinkan koneksi publik dengan kredensial database secara default. Namun, Anda mungkin telah mengonfigurasi aturan atau kebijakan jaringan yang dapat mencegah konektor Snowflake terhubung ke akun Anda. Dalam hal ini, Anda harus menambahkan alamat IP yang diperlukan ke daftar yang diizinkan. Untuk mengetahui informasi selengkapnya, lihat Mengonfigurasi kebijakan jaringan untuk transfer Snowflake.

Deteksi dan pemetaan skema

Untuk menentukan skema, Anda dapat menggunakan BigQuery Data Transfer Service untuk mendeteksi skema dan pemetaan jenis data secara otomatis saat mentransfer data dari Snowflake ke BigQuery. Atau, Anda dapat menggunakan mesin terjemahan untuk menentukan skema dan jenis data secara manual.

Untuk mengetahui informasi selengkapnya, lihat Deteksi dan pemetaan skema untuk Snowflake.

Mengaktifkan transfer inkremental

Untuk menyiapkan transfer data Snowflake inkremental, lihat Menyiapkan transfer inkremental untuk Snowflake.

Mengaktifkan konektivitas pribadi

Jika ingin membuat transfer data Snowflake pribadi, Anda harus mengonfigurasi jaringan untuk konektivitas pribadi.

Mengumpulkan informasi transfer

Kumpulkan informasi yang Anda perlukan untuk menyiapkan migrasi dengan BigQuery Data Transfer Service:

- ID akun Snowflake Anda, yang merupakan awalan di URL akun Snowflake Anda. Misalnya,

ACCOUNT_IDENTIFIER.snowflakecomputing.com. - Nama pengguna dan kunci pribadi terkait dengan izin yang sesuai ke database Snowflake Anda. Akun tersebut hanya dapat memiliki izin yang diperlukan untuk menjalankan transfer data.

- URI bucket penyiapan yang ingin Anda gunakan untuk transfer:

- Untuk akun Snowflake yang dihosting AWS, URI bucket Amazon S3 diperlukan bersama dengan kredensial akses.

- Untuk Snowflake yang dihosting di Azure, akun dan kontainer Azure Blob Storage diperlukan.

- Untuk akun Snowflake yang dihosting Google Cloud, diperlukan URI bucket Cloud Storage. Sebaiknya siapkan kebijakan siklus proses untuk bucket ini guna menghindari biaya yang tidak perlu.

- URI bucket Cloud Storage tempat Anda menyimpan file pemetaan skema yang diperoleh dari mesin terjemahan.

Menyiapkan transfer Snowflake

Pilih salah satu opsi berikut:

Konsol

Buka halaman Transfer data di konsol Google Cloud .

Klik Create transfer.

Di bagian Jenis sumber, pilih Snowflake Migration dari daftar Sumber.

Di bagian Transfer nama konfigurasi, masukkan nama untuk transfer, misalnya

My migration, di kolom Nama tampilan. Nama tampilan dapat berupa nilai apa pun yang memungkinkan Anda mengidentifikasi transfer jika perlu mengubahnya nanti.Di bagian Setelan tujuan, pilih set data yang Anda buat dari daftar Set data.

Di bagian Snowflake Credentials, lakukan hal berikut:

- Untuk Account Identifier, masukkan ID unik untuk akun Snowflake Anda, yang merupakan kombinasi nama organisasi dan nama akun Anda. ID adalah awalan URL akun Snowflake, bukan URL lengkap. Contoh,

ACCOUNT_IDENTIFIER.snowflakecomputing.com. - Untuk Nama pengguna, masukkan nama pengguna Snowflake yang kredensial dan otorisasinya digunakan untuk mengakses database Anda guna mentransfer tabel Snowflake. Sebaiknya gunakan pengguna yang Anda buat untuk transfer ini.

- Untuk Authentication Mechanism, pilih metode autentikasi pengguna Snowflake:

PASSWORD

- Untuk Password, masukkan sandi pengguna Snowflake.

KEY_PAIR

- Untuk Private Key, masukkan kunci pribadi yang ditautkan dengan kunci publik yang terkait dengan pengguna Snowflake.

- Untuk Is Private Key Encrypted, pilih kolom ini jika kunci pribadi dienkripsi dengan frasa sandi.

- Untuk Private Key Passphrase, masukkan frasa sandi untuk kunci pribadi terenkripsi. Kolom ini wajib diisi jika Anda telah memilih Apakah Kunci Pribadi dienkripsi. Untuk mengetahui informasi selengkapnya, lihat Membuat pasangan kunci untuk autentikasi

- Untuk Warehouse, masukkan warehouse yang digunakan untuk eksekusi transfer data ini.

- Untuk Database Snowflake, masukkan nama database Snowflake yang berisi tabel yang disertakan dalam transfer data ini.

- Untuk Skema Snowflake, masukkan nama skema Snowflake yang berisi tabel yang disertakan dalam transfer data ini.

- Untuk Account Identifier, masukkan ID unik untuk akun Snowflake Anda, yang merupakan kombinasi nama organisasi dan nama akun Anda. ID adalah awalan URL akun Snowflake, bukan URL lengkap. Contoh,

Di bagian Storage Configuration, lakukan hal berikut:

- Untuk Storage integration object name, masukkan nama objek integrasi penyimpanan Snowflake.

- Opsional: Untuk Ukuran file maks, tentukan ukuran maksimum setiap file yang dibongkar dari Snowflake ke lokasi penyiapan (dalam MB).

Untuk Cloud Provider, pilih

AWSatauAZUREatauGCP, bergantung pada penyedia cloud yang menghosting akun Snowflake Anda.AWS

- Untuk Amazon S3 URI, masukkan URI bucket Amazon S3 yang akan digunakan sebagai area staging.

- Untuk Access key ID dan Secret access key, masukkan pasangan kunci akses.

Azure

- Untuk Nama akun penyimpanan Azure dan Container di akun penyimpanan Azure, masukkan nama akun penyimpanan dan container Azure Blob Storage yang akan digunakan sebagai area penyiapan.

- Untuk Token SAS, masukkan token SAS yang dibuat untuk penampung.

Google Cloud

- Untuk GCS URI, masukkan URI Cloud Storage yang akan digunakan sebagai area staging.

Di bagian Service Account, lakukan tindakan berikut:

- Untuk Akun Layanan, masukkan akun layanan yang akan digunakan dengan transfer data ini. Akun layanan harus termasuk dalam projectGoogle Cloud yang sama tempat konfigurasi transfer dan set data tujuan dibuat. Akun layanan harus memiliki izin yang diperlukan

storage.objects.listdanstorage.objects.get.

- Untuk Akun Layanan, masukkan akun layanan yang akan digunakan dengan transfer data ini. Akun layanan harus termasuk dalam projectGoogle Cloud yang sama tempat konfigurasi transfer dan set data tujuan dibuat. Akun layanan harus memiliki izin yang diperlukan

Di bagian Konfigurasi Skema, lakukan hal berikut:

- Untuk Ingestion type, pilih Full atau Incremental. Untuk mengetahui informasi selengkapnya, lihat Mengonfigurasi transfer inkremental.

- Untuk Pola nama tabel, tentukan tabel yang akan ditransfer dengan memasukkan

nama atau pola yang cocok dengan nama tabel dalam skema. Anda

dapat menggunakan ekspresi reguler untuk menentukan pola, misalnya

table1_regex;table2_regex. Pola ini harus mengikuti sintaksis ekspresi reguler Java. Misalnya,lineitem;ordertbcocok dengan tabel yang bernamalineitemdanordertb..*cocok dengan semua tabel.

- Opsional: Untuk Gunakan Output Mesin Terjemahan BigQuery, pilih kolom ini jika Anda ingin menentukan jalur output terjemahan kustom.

- Opsional: Untuk Translation output GCS path, tentukan jalur ke

folder Cloud Storage yang berisi file pemetaan skema dari mesin terjemahan. Anda dapat membiarkannya kosong agar konektor Snowflake mendeteksi skema Anda secara otomatis.

- Jalur harus mengikuti format

translation_target_base_uri/metadata/config/db/schema/dan harus diakhiri dengan/.

- Jalur harus mengikuti format

- Opsional: Untuk Jalur file skema kustom, tentukan jalur Cloud Storage ke file skema kustom.

- Opsional: Untuk Petakan NUMBER Snowflake skala nol ke INT64 BigQuery, pilih kolom ini jika Anda ingin jenis

NUMBER(p, 0)Snowflake dipetakan keINT64BigQuery.

Di bagian Network Connectivity, lakukan hal berikut:

- Untuk Gunakan Jaringan Pribadi, jika Anda membuat transfer data pribadi, pilih Benar.

- Untuk PSC Service Attachment, jika Anda membuat koneksi pribadi, masukkan URI lampiran layanan. Untuk mengetahui informasi selengkapnya, lihat Membuat konfigurasi transfer Snowflake pribadi.

- Untuk Private Network Service, jika Anda membuat transfer data pribadi, masukkan link mandiri direktori layanan. Untuk mengetahui informasi selengkapnya, lihat Membuat konfigurasi transfer Snowflake pribadi.

Opsional: Di bagian Opsi notifikasi, lakukan hal berikut:

- Klik tombol untuk mengaktifkan notifikasi email. Saat Anda mengaktifkan opsi ini, administrator transfer akan menerima notifikasi email saat proses transfer gagal.

- Untuk Select a Pub/Sub topic, pilih nama topik atau klik Create a topic. Opsi ini mengonfigurasi notifikasi operasi Pub/Sub untuk transfer Anda.

Jika Anda menggunakan CMEK, di bagian Advanced options, pilih Customer-managed key. Daftar CMEK yang tersedia akan muncul dan dapat Anda pilih. Untuk mengetahui informasi tentang cara kerja CMEK dengan BigQuery Data Transfer Service, lihat Menentukan kunci enkripsi dengan transfer.

Klik Simpan.

Konsol Google Cloud menampilkan semua detail penyiapan transfer, termasuk Nama resource untuk transfer ini.

bq

Masukkan perintah bq mk dan berikan flag pembuatan transfer --transfer_config. Flag berikut juga diperlukan:

--project_id--data_source--target_dataset--display_name--params

bq mk \ --transfer_config \ --project_id=project_id \ --data_source=data_source \ --target_dataset=dataset \ --display_name=name \ --service_account_name=service_account \ --params='parameters'

Ganti kode berikut:

- project_id: Google Cloud Project ID Anda. Jika

--project_idtidak ditentukan, project default akan digunakan. - data_source: sumber data,

snowflake_migration. - dataset: set data target BigQuery untuk konfigurasi transfer.

- name: nama tampilan untuk konfigurasi transfer. Nama transfer dapat berupa nilai apa pun yang memungkinkan Anda mengidentifikasi transfer jika perlu mengubahnya nanti.

- service_account: (Opsional) nama akun layanan yang digunakan untuk

mengautentikasi transfer Anda. Akun layanan harus dimiliki oleh

project_idyang sama yang digunakan untuk membuat transfer dan harus memiliki semua peran yang diperlukan. - parameters: parameter untuk konfigurasi transfer yang dibuat dalam format JSON. Contoh:

--params='{"param":"param_value"}'.

Anda dapat mengonfigurasi parameter berikut untuk konfigurasi transfer Snowflake:

account_identifier: tentukan ID unik untuk akun Snowflake Anda, yang merupakan kombinasi nama organisasi dan nama akun Anda. ID adalah awalan URL akun Snowflake, bukan URL lengkap. Contoh,account_identifier.snowflakecomputing.com.username: tentukan nama pengguna Snowflake yang kredensial dan otorisasinya digunakan untuk mengakses database Anda guna mentransfer tabel Snowflake.auth_mechanism: menentukan metode autentikasi pengguna Snowflake. Nilai yang didukung adalahPASSWORDdanKEY_PAIR. Untuk mengetahui informasi selengkapnya, lihat Membuat pasangan kunci untuk autentikasi.password: tentukan sandi pengguna Snowflake. Kolom ini wajib diisi jika Anda telah menentukanPASSWORDdi kolomauth_mechanism.private_key: tentukan kunci pribadi yang ditautkan dengan kunci publik yang terkait dengan pengguna Snowflake. Kolom ini wajib diisi jika Anda telah menentukanKEY_PAIRdi kolomauth_mechanism.is_private_key_encrypted: tentukantruejika kunci pribadi dienkripsi dengan frasa sandi.private_key_passphrase: tentukan frasa sandi untuk kunci pribadi terenkripsi. Kolom ini wajib diisi jika Anda telah menentukanKEY_PAIRdi kolomauth_mechanismdan menentukantruedi kolomis_private_key_encrypted.warehouse: tentukan gudang yang digunakan untuk eksekusi transfer data ini.service_account: tentukan akun layanan yang akan digunakan dengan transfer data ini. Akun layanan harus termasuk dalam project Google Cloud yang sama dengan tempat konfigurasi transfer dan set data tujuan dibuat. Akun layanan harus memiliki izin yang diperlukanstorage.objects.listdanstorage.objects.get.database: tentukan nama database Snowflake yang berisi tabel yang disertakan dalam transfer data ini.schema: tentukan nama skema Snowflake yang berisi tabel yang disertakan dalam transfer data ini.table_name_patterns: tentukan tabel yang akan ditransfer dengan memasukkan nama atau pola yang cocok dengan nama tabel dalam skema. Anda dapat menggunakan ekspresi reguler untuk menentukan pola, misalnyatable1_regex;table2_regex. Pola harus mengikuti sintaksis ekspresi reguler Java. Misalnya,lineitem;ordertbcocok dengan tabel yang bernamalineitemdanordertb..*cocok dengan semua tabel.Anda juga dapat mengosongkan kolom ini untuk memigrasikan semua tabel dari skema yang ditentukan.

ingestion_mode: menentukan mode penyerapan untuk transfer. Nilai yang didukung adalahFULLdanINCREMENTAL. Untuk informasi selengkapnya, lihat Mengonfigurasi transfer inkremental.translation_output_gcs_path: (Opsional) tentukan jalur ke folder Cloud Storage yang berisi file pemetaan skema dari mesin terjemahan. Anda dapat membiarkannya kosong agar konektor Snowflake mendeteksi skema Anda secara otomatis.- Jalur harus mengikuti format

gs://translation_target_base_uri/metadata/config/db/schema/dan harus diakhiri dengan/.

- Jalur harus mengikuti format

storage_integration_object_name: tentukan nama objek integrasi penyimpanan Snowflake.cloud_provider: masukkanAWSatauAZUREatauGCP, bergantung pada penyedia cloud yang menghosting akun Snowflake Anda.staging_s3_uri: masukkan URI bucket S3 yang akan digunakan sebagai area staging. Hanya diperlukan jikacloud_providerAnda adalahAWS.aws_access_key_id: masukkan pasangan kunci akses. Hanya diperlukan jikacloud_providerAnda adalahAWS.aws_secret_access_key: masukkan pasangan kunci akses. Hanya diperlukan jikacloud_providerAnda adalahAWS.azure_storage_account: masukkan nama akun penyimpanan yang akan digunakan sebagai area penahapan. Hanya diperlukan jikacloud_providerAnda adalahAZURE.staging_azure_container: masukkan kontainer dalam Azure Blob Storage untuk digunakan sebagai area penahapan. Hanya diperlukan jikacloud_providerAnda adalahAZURE.azure_sas_token: masukkan token SAS. Hanya diperlukan jikacloud_providerAnda adalahAZURE.staging_gcs_uri: masukkan URI Cloud Storage yang akan digunakan sebagai area penyiapan. Hanya diperlukan jikacloud_providerAnda adalahGCP.use_private_network: jika Anda membuat transfer data pribadi, setel keTRUE.service_attachment: jika Anda membuat transfer data pribadi, tentukan URI lampiran layanan. Untuk mengetahui informasi selengkapnya, lihat Membuat konfigurasi transfer Snowflake pribadi.private_network_service: jika Anda membuat transfer data pribadi, tentukan link mandiri layanan NLB. Untuk mengetahui informasi selengkapnya, lihat Membuat konfigurasi transfer Snowflake pribadi.

Misalnya, untuk akun Snowflake yang dihosting di AWS, perintah berikut akan membuat transfer Snowflake bernama Snowflake transfer config dengan set data target bernama your_bq_dataset dan project dengan ID your_project_id.

PARAMS='{ "account_identifier": "your_account_identifier", "auth_mechanism": "KEY_PAIR", "aws_access_key_id": "your_access_key_id", "aws_secret_access_key": "your_aws_secret_access_key", "cloud_provider": "AWS", "database": "your_sf_database", "ingestion_mode": "INCREMENTAL", "private_key": "-----BEGIN PRIVATE KEY----- privatekey\nseparatedwith\nnewlinecharacters=-----END PRIVATE KEY-----", "schema": "your_snowflake_schema", "service_account": "your_service_account", "storage_integration_object_name": "your_storage_integration_object", "staging_s3_uri": "s3://your/s3/bucket/uri", "table_name_patterns": ".*", "translation_output_gcs_path": "gs://sf_test_translation/output/metadata/config/database_name/schema_name/", "username": "your_sf_username", "warehouse": "your_warehouse" }' bq mk --transfer_config \ --project_id=your_project_id \ --target_dataset=your_bq_dataset \ --display_name='snowflake transfer config' \ --params="$PARAMS" \ --data_source=snowflake_migration

API

Gunakan metode projects.locations.transferConfigs.create

dan berikan instance resource

TransferConfig.

Menentukan kunci enkripsi dengan transfer

Anda dapat menentukan kunci enkripsi yang dikelola pelanggan (CMEK) guna mengenkripsi data untuk proses transfer. Anda dapat menggunakan CMEK untuk mendukung transfer dari Snowflake.Saat Anda menentukan CMEK dengan transfer, BigQuery Data Transfer Service akan menerapkan CMEK ke cache perantara data yang diserap dalam disk, sehingga seluruh alur kerja transfer data mematuhi CMEK.

Anda tidak dapat memperbarui transfer yang sudah ada untuk menambahkan CMEK jika transfer tersebut awalnya tidak dibuat dengan CMEK. Misalnya, Anda tidak dapat mengubah tabel tujuan yang awalnya dienkripsi secara default menjadi kini dienkripsi dengan CMEK. Sebaliknya, Anda juga tidak dapat mengubah tabel tujuan yang dienkripsi CMEK agar memiliki jenis enkripsi yang berbeda.

Anda dapat memperbarui CMEK untuk transfer jika konfigurasi transfer awalnya dibuat dengan enkripsi CMEK. Saat Anda memperbarui CMEK untuk konfigurasi transfer, BigQuery Data Transfer Service akan menyebarkan CMEK ke tabel tujuan pada proses transfer berikutnya. Di sini, BigQuery Data Transfer Service akan mengganti CMEK yang sudah usang dengan CMEK baru selama proses transfer. Untuk informasi selengkapnya, lihat Memperbarui transfer.

Anda juga dapat menggunakan kunci default project. Saat Anda menentukan kunci default project dengan transfer, BigQuery Data Transfer Service akan menggunakan kunci default project sebagai kunci default untuk setiap konfigurasi transfer baru.

Kuota dan batas

BigQuery memiliki kuota muatan sebesar 15 TB untuk setiap tugas pemuatan untuk setiap tabel secara default. Secara internal, Snowflake mengompresi data tabel, sehingga ukuran tabel yang diekspor lebih besar daripada ukuran tabel yang dilaporkan oleh Snowflake.

Untuk meningkatkan waktu pemuatan tabel yang lebih besar, tentukan jenis tugas PIPELINE

untuk penetapan pemesanan Anda.

Karena model konsistensi Amazon S3, ada kemungkinan bahwa beberapa file tidak akan disertakan dalam transfer ke BigQuery.

Mengoptimalkan performa transfer data

Anda dapat memantau performa transfer data dengan melihat log untuk transfer data. Untuk meningkatkan performa transfer data, sebaiknya lakukan langkah-langkah pengoptimalan berikut:

- Simpan instance Snowflake, bucket penyiapan, dan set data BigQuery Anda di region yang sama

- Anda dapat meningkatkan kecepatan pelepasan tabel dengan melakukan hal berikut:

- Tingkatkan ukuran virtual warehouse Snowflake Anda, terutama saat mentransfer tabel Snowflake berukuran besar (1 TiB atau lebih tinggi).

- Sesuaikan opsi

MAX_FILE_SIZEdalam konfigurasi transfer.- Ukuran file yang lebih kecil dapat meningkatkan kecepatan transfer, tetapi jika terlalu kecil dapat menyebabkan terlalu banyak file.

- Anda dapat meningkatkan kecepatan pemuatan tabel dengan meningkatkan jumlah reservasi slot BigQuery untuk jenis tugas

PIPELINEdanQUERY. - Saat melakukan transfer penuh, hindari pengelompokan dan partisi pada tabel BigQuery tujuan.

- Saat melakukan transfer inkremental dalam mode Upsert, pertimbangkan pengelompokan dan partisi pada kolom kunci utama untuk meningkatkan performa transfer.

- Namun, hindari pengelompokan dan partisi pada kolom kunci non-primer untuk mencegah operasi penggabungan yang lebih lambat.

Harga

Untuk mengetahui informasi tentang harga BigQuery Data Transfer Service, lihat halaman Harga.

- Jika data warehouse Snowflake dan bucket Amazon S3 berada di region yang berbeda, Snowflake akan mengenakan biaya keluar saat Anda menjalankan transfer data Snowflake. Tidak ada biaya keluar untuk transfer data Snowflake jika gudang Snowflake dan bucket Amazon S3 berada di region yang sama.

- Saat data ditransfer dari AWS ke Google Cloud, biaya traffic keluar antar-cloud akan dikenakan.

Langkah berikutnya

- Pelajari BigQuery Data Transfer Service lebih lanjut.

- Migrasikan kode SQL dengan terjemahan Batch SQL.