데이터 엔지니어링 에이전트를 사용하여 데이터 파이프라인 빌드 및 수정

데이터 엔지니어링 에이전트를 사용하면 자연어 프롬프트를 사용하여 BigQuery에서 데이터 파이프라인을 빌드, 수정, 문제 해결할 수 있습니다. 데이터 엔지니어링 에이전트는 BigQuery로 데이터를 수집하는 데이터 엔지니어링 워크플로를 간소화하기 위해 다음과 같은 기능을 제공합니다.

- Dataform 통합: 에이전트가 Dataform 저장소 및 작업공간 내에서 직접 데이터 파이프라인 코드를 생성하고 정리합니다.

- 계획 생성: 에이전트가 자신의 생각을 요약하고 계획을 생성하여 사용자가 계속 진행하기 전에 에이전트의 계획을 검토하고 확인할 수 있습니다.

- 코드 유효성 검사: 에이전트가 생성된 코드의 컴파일 오류를 자동으로 검증하고 수정하여 데이터 파이프라인이 작동하는지 확인합니다.

- 자동 데이터 랭글링: 에이전트가 데이터 랭글링을 수행하고 수동 개입 없이 원시 데이터를 구조화된 표로 변환합니다.

- 맞춤 안내: 에이전트는 자연어로 특정 규칙과 재사용 가능한 가이드라인을 정의할 수 있는 맞춤 에이전트 안내를 지원합니다.

- 외부 컨텍스트: 에이전트가 추가 컨텍스트를 위해 Knowledge Catalog와 통합됨

- 파이프라인 제어: 작업이 실행되기 전에 생성된 에이전트 계획을 검토하고 맞춤설정할 수 있습니다.

- 최적화: 에이전트는 데이터 파이프라인의 성능을 최적화할 수 있습니다.

- 문제 해결 및 복구: 에이전트가 파이프라인 실패를 문제 해결하고 코드를 수정할 수 있습니다.

데이터 엔지니어링 에이전트와 함께 사용할 수 있는 프롬프트의 더 많은 예시는 샘플 프롬프트를 참고하세요.

A2A 프로토콜을 사용하는 데이터 엔지니어링 에이전트 API를 사용하여 에이전트와 상호작용할 수도 있습니다.

제한사항

데이터 엔지니어링 에이전트에는 다음과 같은 제한사항이 있습니다.

- 데이터 엔지니어링 에이전트는 다음 파일 유형에 대한 자연어 명령어를 지원하지 않습니다.

- Notebooks

- 데이터 준비

- SQLX 내의 JavaScript

- 데이터 엔지니어링 에이전트가 파이프라인을 실행할 수 없습니다. 파이프라인을 검토하고 실행하거나 예약해야 합니다.

- 데이터 엔지니어링 에이전트는 전체 파이프라인 호출(사용자 트리거) 없이 존재하지 않는 중간 리소스에 종속된 SQL을 검증할 수 없습니다.

- 데이터 엔지니어링 에이전트는 안내 또는 직접 프롬프트를 통해 제공된 웹 링크나 URL을 검색할 수 없습니다.

- 에이전트 명령 파일에서 파일을 가져올 때

@가져오기 구문은./,/또는 문자로 시작하는 경로만 지원합니다. - 데이터 미리보기 기능은

hasOutput플래그가true로 설정된 테이블, 선언 또는 쿼리에만 지원됩니다. - 데이터 엔지니어링 에이전트에는 AI 기술의 일반적인 제한사항이 적용됩니다.

데이터 엔지니어링 에이전트가 사용자의 데이터를 사용하는 방식

데이터 엔지니어링 에이전트는 더 높은 품질의 에이전트 응답을 생성하기 위해 BigQuery 테이블의 샘플 행과 Knowledge Catalog에서 생성된 데이터 스캔 프로필을 비롯한 추가 데이터와 메타데이터를 BigQuery 및 Knowledge Catalog에서 가져올 수 있습니다. 에이전트는 이 데이터를 학습에 사용하지 않습니다. 에이전트 대화 중에 응답을 알리기 위한 추가 컨텍스트로만 데이터를 사용합니다.

데이터 엔지니어링 에이전트가 데이터를 처리하는 위치

데이터 엔지니어링 에이전트가 데이터를 처리하는 위치에 대한 자세한 내용은 BigQuery의 Gemini에서 데이터를 처리하는 위치를 참고하세요.

시작하기 전에

데이터 엔지니어링 에이전트를 사용하기 전에 이 섹션의 단계를 수행하세요.

BigQuery에서 Gemini 사용 설정

Google Cloud 프로젝트에 BigQuery의 Gemini가 사용 설정되어 있는지 확인합니다. 자세한 내용은 BigQuery의 Gemini 설정을 참고하세요.

필요한 API 사용 설정

콘솔

Conversational Analytics API로 사용할 Google Cloud프로젝트의 Google Cloud 콘솔에서 다음 API를 사용 설정합니다.

gcloud

Gemini 데이터 분석 API, Gemini for Google Cloud

API, BigQuery API를 사용 설정하려면 Google Cloud CLI를 사용하여 다음 gcloud

services enable 명령어를 실행합니다.

gcloud services enable geminidataanalytics.googleapis.com --project=PROJECT_ID gcloud services enable cloudaicompanion.googleapis.com --project=PROJECT_ID gcloud services enable bigquery.googleapis.com --project=PROJECT_ID

PROJECT_ID를 Google Cloud 프로젝트 ID로 바꿉니다.

필요한 역할

데이터 엔지니어링 에이전트를 사용하는 데 필요한 권한을 얻으려면 관리자에게 프로젝트에 대한 다음 IAM 역할을 부여해 달라고 요청하세요.

- Dataform 코드 편집기 (

roles/dataform.codeEditor) - BigQuery 작업 사용자 (

roles/bigquery.jobuser) - Gemini 데이터 분석 스테이트리스(Stateless) 채팅 사용자 (

roles/geminidataanalytics.dataAgentStatelessUser)

역할 부여에 대한 자세한 내용은 프로젝트, 폴더, 조직에 대한 액세스 관리를 참조하세요.

이 사전 정의된 역할에는 데이터 엔지니어링 에이전트를 사용하는 데 필요한 geminidataanalytics.locations.useDataEngineeringAgent 권한이 포함되어 있습니다.

커스텀 역할이나 다른 사전 정의된 역할을 사용하여 이 권한을 가져올 수도 있습니다.

Knowledge Catalog 통합 기본 요건

Data Engineering Agent를 Knowledge Catalog와 통합하는 데 필요한 권한을 얻으려면 관리자에게 프로젝트에 대한 Dataplex Knowledge Catalog 편집자 (roles/dataplex.catalogEditor) IAM 역할을 부여해 달라고 요청하세요.

역할 부여에 대한 자세한 내용은 프로젝트, 폴더, 조직에 대한 액세스 관리를 참조하세요.

이 사전 정의된 역할에는 Data Engineering Agent를 Knowledge Catalog와 통합하는 데 필요한 geminidataanalytics.locations.useDataEngineeringAgent 권한이 포함되어 있습니다.

커스텀 역할이나 다른 사전 정의된 역할을 사용하여 이 권한을 가져올 수도 있습니다.

Knowledge Catalog API도 사용 설정해야 합니다.

Cloud Key Management Service 키로 데이터 암호화

BigQuery에서 기본 고객 관리 Cloud Key Management Service 키를 사용하여 데이터 세트 또는 프로젝트 수준에서 데이터를 암호화할 수 있습니다. 자세한 내용은 데이터 세트 기본 키 설정 및 프로젝트 기본 키 설정을 참고하세요.

기본 Dataform Cloud Key Management Service 키를 설정하여 프로젝트 수준에서 파이프라인 코드를 암호화할 수 있습니다.

VPC 서비스 제어 경계 구성

VPC 서비스 제어를 사용하는 경우 Dataform, BigQuery, Conversational Analytics API를 보호하도록 경계를 구성해야 합니다. 자세한 내용은 Dataform, BigQuery, 대화형 분석 API를 참고하세요.

데이터 엔지니어링 에이전트로 데이터 파이프라인 생성

BigQuery에서 데이터 엔지니어링 에이전트를 사용하려면 다음 옵션 중 하나를 선택하세요.

BigQuery 파이프라인

다음과 같이 BigQuery 파이프라인 인터페이스에서 데이터 엔지니어링 에이전트를 사용할 수 있습니다.

BigQuery 페이지로 이동합니다.

쿼리 편집기에서 arrow_drop_down 새로 만들기 > 파이프라인을 클릭합니다.

실행 사용자 인증 정보 옵션을 선택한 다음 시작하기를 클릭합니다. 이 사용자 인증 정보는 에이전트에서 사용하지 않지만 생성된 데이터 파이프라인을 실행하는 데 필요합니다.

데이터 파이프라인의 에이전트 환경 사용해 보기를 클릭합니다.

에이전트에게 질문하기 필드에 자연어 프롬프트를 입력하여 데이터 파이프라인을 생성합니다(예:

Create dimension tables for a taxi trips star schema from new_york_taxi_trips.tlc_green_trips_2022. Generate surrogate keys and all the descriptive attributes.프롬프트를 입력한 후 보내기를 클릭합니다.

데이터 엔지니어링 에이전트는 프롬프트에 따라 데이터 파이프라인을 생성합니다.

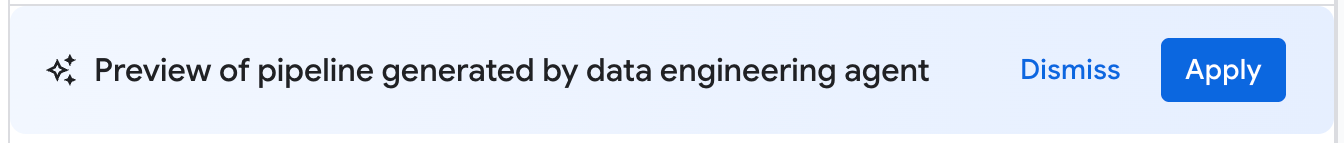

데이터 엔지니어링 에이전트가 데이터 파이프라인의 제안된 초안을 생성합니다. 파이프라인 노드를 클릭하여 생성된 SQLX 쿼리를 검토할 수 있습니다. 에이전트가 제안한 데이터 파이프라인을 적용하려면 적용을 클릭합니다.

Dataform

다음과 같이 Dataform에서 데이터 엔지니어링 에이전트를 사용할 수 있습니다.

Dataform으로 이동합니다.

저장소를 선택합니다.

개발 작업공간을 선택하거나 만듭니다.

작업공간에서 Ask Agent를 클릭합니다.

표시되는 에이전트에게 질문하기 프롬프트에 데이터 파이프라인을 생성하기 위한 자연어 프롬프트를 입력합니다(예:

Create dimension tables for a taxi trips star schema from new_york_taxi_trips.tlc_green_trips_2022. Generate surrogate keys and all the descriptive attributes.프롬프트를 입력한 후 보내기를 클릭합니다.

프롬프트가 전송되면 데이터 엔지니어링 에이전트가 데이터 파이프라인을 생성하고 프롬프트에 따라 Dataform SQLX 파일을 수정합니다. 에이전트는 이러한 변경사항을 작업공간 파일에 직접 적용합니다.

데이터 파이프라인 수정

데이터 파이프라인을 수정하려면 에이전트에게 질문하기를 클릭한 다음 데이터 파이프라인의 변경사항을 제안하는 프롬프트를 입력합니다.

데이터 엔지니어링 에이전트가 제안한 변경사항을 검토한 다음 적용을 클릭하여 변경사항을 적용합니다.

파이프라인 노드를 선택한 다음 열기를 클릭하여 SQLX 쿼리를 수동으로 수정할 수도 있습니다.

데이터 파이프라인 검토

데이터 엔지니어링 에이전트가 생성한 데이터 파이프라인에서 파이프라인 노드를 클릭하여 검토할 수 있습니다.

- 구성 탭에는 노드와 연결된 생성된 SQLX 쿼리가 표시됩니다.

- 데이터 미리보기 탭에는 파일의 입력 및 출력 테이블이 표시됩니다. 태스크 실행을 클릭하여 종속 항목이 있거나 없는 태스크를 실행하면 이 노드를 통해 데이터 변환을 미리 볼 수 있습니다.

데이터 파이프라인 오류 문제 해결

데이터 파이프라인 생성 중에 오류가 발생하면 데이터 엔지니어링 에이전트를 실행하기 위한 모든 기본 요건을 충족했는지 확인합니다. 자세한 내용은 시작하기 전에를 참고하세요.

Gemini Cloud Assist 조사 실행

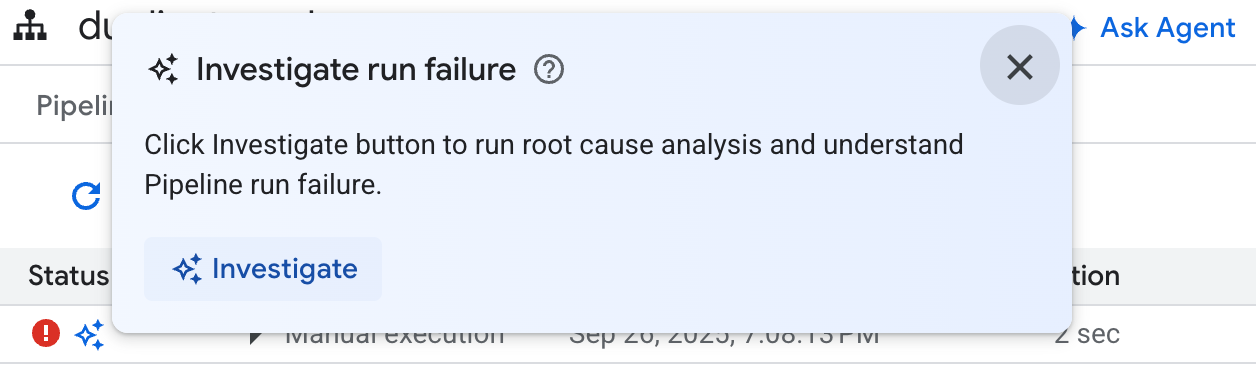

파이프라인 문제 해결을 위해 데이터 엔지니어링 에이전트를 사용하여 근본 원인 분석을 실행하고 문제 해결 권장사항을 제안할 수 있습니다.

이 기능은 Gemini Cloud Assist 조사(프리뷰)를 사용하며 프리미엄 지원 계약이 있는 사용자만 사용할 수 있습니다. Gemini Cloud Assist 조사를 사용 설정하는 방법에 대한 자세한 내용은 Gemini Cloud Assist 조사로 문제 해결을 참고하세요.

다음 단계에 따라 데이터 엔지니어링 에이전트를 사용하여 데이터 파이프라인 오류를 해결할 수 있습니다.

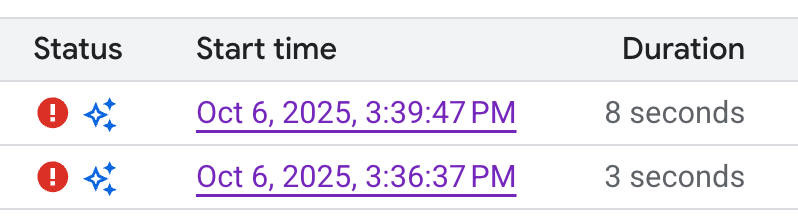

- 파이프라인 또는 개발 작업공간에서 실행 탭을 클릭합니다.

실행 목록에서 실패한 데이터 파이프라인 실행을 찾습니다. 상태 열에서 실패한 실행을 확인할 수 있습니다.

아이콘 위로 마우스를 가져간 다음 조사하기를 클릭합니다. 데이터 엔지니어링 에이전트는 데이터 파이프라인 실행에 대한 근본 원인 분석 (RCA)을 실행하여 오류를 파악합니다.

분석이 완료되면 데이터 엔지니어링 에이전트가 관찰 및 가설 섹션에 보고서를 생성합니다. 보고서에는 다음이 포함됩니다.

- 데이터 파이프라인 실행 로그에서 추출된 관측치 및 데이터 포인트입니다.

- 실패의 가능한 원인입니다.

- 확인된 문제를 해결하기 위한 실행 가능한 단계 또는 권장사항의 집합입니다.

데이터 엔지니어링 에이전트의 문제 해결 보고서를 사용하면 추천을 수동으로 구현할 수 있습니다. 다음 단계를 수행하여 데이터 엔지니어링 에이전트가 수정사항을 적용하도록 지시할 수도 있습니다.

- 문제 해결 보고서의 제안사항을 복사합니다.

- 데이터 엔지니어링 에이전트로 돌아갑니다.

- BigQuery 파이프라인을 사용하는 경우 파이프라인 페이지로 이동한 다음 상담사에게 문의를 클릭합니다.

- Dataform을 사용하는 경우 Ask agent를 클릭합니다.

- 제안사항을 프롬프트에 붙여넣은 다음 데이터 엔지니어링 에이전트에게 데이터 파이프라인을 직접 수정하도록 지시합니다.

- 보내기를 클릭합니다.

추가 상담사 기능 및 맞춤설정

다음 섹션에서는 추가 에이전트 기능과 데이터 엔지니어링 에이전트를 맞춤설정하는 기타 방법을 설명합니다.

에이전트 요청 사항 만들기

에이전트 지침은 데이터 엔지니어링 에이전트를 위한 자연어 지침으로, 지속적인 지침을 저장하여 에이전트가 사전 정의된 맞춤 규칙을 따르도록 할 수 있습니다. 조직 전체에서 에이전트의 결과가 일관되도록 하려면(예: 명명 규칙을 사용하거나 스타일 가이드를 적용하는 경우) 에이전트 지침을 사용하세요.

데이터 엔지니어링 에이전트의 에이전트 명령 파일로 GEMINI.MD 컨텍스트 파일을 만들 수 있습니다. 로컬 작업공간에서 사용할 에이전트 명령 파일 또는 외부 저장소와 함께 여러 데이터 파이프라인에서 동일한 명령 파일을 사용할 수 있습니다.

상담사 안내를 만들려면 다음 단계를 따르세요.

- 에이전트에게 질문하기에서 파이프라인 안내를 클릭합니다.

- 파이프라인 안내 창에서 안내 파일 만들기를 클릭합니다.

표시되는

GEMINI.MD파일에 자연어로 지침을 입력합니다.다음 예시는 여러 규칙이 있는 에이전트 명령 파일입니다.

1. All event-specific tables MUST be prefixed with `cs_event_`. 2. The primary key for any player activity table is a composite key of `player_id` and `event_timestamp_micros`. 3. Filter out any player actions where `mana_spent` is greater than `max_mana_pool`. This is considered a data anomaly.저장을 클릭합니다.

에이전트 명령어 파일을 가장 효과적으로 구조화하는 방법에 관한 자세한 내용은 에이전트 명령어 파일 관련 권장사항을 참고하세요.

외부 저장소에서 에이전트 안내 로드

여러 데이터 파이프라인에서 에이전트 명령어 세트를 재사용하려면 외부 저장소를 연결하세요.

- 에이전트에게 질문하기에서 파이프라인 안내를 클릭합니다.

- 외부 저장소에서 외부 저장소의 안내 사용을 선택합니다.

- 제공된 필드에 데이터 파이프라인과 함께 사용할 에이전트 명령어가 포함된 저장소를 지정합니다.

- 저장을 클릭합니다.

추가 로컬 파일을 에이전트 안내로 가져오기

@file.md 구문을 사용하여 데이터 엔지니어링 에이전트의 다른 명령 파일도 GEMINI.md 파일로 가져올 수 있습니다. 자세한 내용은 메모리 가져오기 프로세서를 참고하세요.

자동 데이터 랭글링

데이터 엔지니어링 에이전트를 사용하여 처리되지 않은 원시 데이터를 데이터 분석에 적합한 구조화된 테이블로 변환할 수 있습니다. 요청이 있으면 에이전트는 먼저 각 표준 테이블 또는 외부 테이블에서 최대 1,000,000개의 레코드를 샘플링합니다. 그런 다음 에이전트는 이 샘플에서 프로파일링 쿼리를 실행하여 심층 데이터 분석을 실행합니다. 데이터 변환을 생성한 후 에이전트는 이 샘플링 및 프로파일링 프로세스를 반복하여 변환의 품질을 평가합니다. 이러한 데이터 랭글링 변환에는 데이터 불일치, 이상치 또는 유형 불일치 수정이 포함될 수 있습니다. 그러면 데이터 엔지니어링 에이전트가 제안된 랭글링 단계를 간략하게 설명하는 계획을 만들어 사용자가 검토하고 수정할 수 있도록 합니다.

데이터 엔지니어링 에이전트는 CSV 기반 외부 테이블과 같은 원시 테이블을 추가할 때마다 데이터 랭글링 분석을 시작합니다. 데이터 랭글링 계획을 검토하고 대화형 명령어로 조정할 수 있습니다.

데이터 샘플링 및 프로파일링은 BigQuery 리소스를 사용하며 BigQuery 가격 책정이 적용됩니다.

데이터 엔지니어링 에이전트는 다음 데이터 랭글링 변환을 지원합니다.

- 데이터 정리 에이전트는 원시 데이터를 분석하고 이상치 삭제, 누락되거나 일관성 없는 값 채우기(데이터 대치), 중복 데이터 수정, 데이터 형식 표준화(예: 전화번호 또는 주소)와 같은 정리 기회를 제안할 수 있습니다.

- 구조적 변환 타겟 스키마가 제공되면 에이전트는

JSON,ARRAY또는STRUCT유형에서 값을 중첩 해제하거나 추출하고, 여러 열을 하나로 병합하거나, 하나의 열을 여러 열로 분할할 수 있습니다. - 데이터 유형 감지 및 변환 에이전트는 데이터를 분석하여 적절한 필드 유형을 결정할 수 있습니다. 그러면 에이전트가 보안 유형 변환을 실행하여 date, time, datetime 또는 timestamp 필드 내의 형식 불일치를 해결할 수 있습니다.

- 단위 변환 에이전트는 필드 내의 다양한 단위를 하나의 일관된 단위로 자동 변환하여 데이터를 표준화할 수 있습니다.

정확성을 보장하기 위해 에이전트는 데이터의 대표 샘플을 사용하여 문제를 감지하고 변환 로직을 검증합니다.

에이전트 계획 생성 및 검토

데이터 엔지니어링 에이전트는 요청을 완료하기 위해 취하는 목표와 단계의 요약 및 개요를 제공하는 에이전트 계획을 생성할 수 있습니다. 많은 변경사항이 필요한 복잡한 요청으로 에이전트를 프롬프트할 때는 에이전트가 작업을 실행하기 전에 에이전트의 의도를 검토할 수 있도록 에이전트 계획을 제공해 달라고 요청하는 것이 좋습니다. 데이터 엔지니어링 에이전트 계획은 일반적으로 다음으로 구성됩니다.

- 특정 요청에 대한 에이전트의 목표

- 에이전트가 수행할 단계의 대략적인 개요

- 상담사가 하는 가정

- 에이전트가 수정할 계획인 파일

- 실행할 최적화 또는 정리 단계

- 단계별 실행 계획

프롬프트에 계획을 검토하고 승인해야 한다는 내용을 포함하여 상담사가 명시적인 승인 없이 조치를 취하지 않도록 할 수 있습니다. 예를 들면 다음과 같습니다.

Create a plan for a pipeline that finds the top N pick up and drop off locations in NYC. I want to review the plan and approve it before you create the pipeline.

에이전트가 에이전트 계획을 자동으로 생성하고 승인을 요청할 수도 있습니다. 프롬프트가 너무 모호하거나 에이전트가 요청을 처리하기 위해 더 명확한 정보가 필요한 경우 이러한 결과가 발생할 수 있습니다.

에이전트 요금제 사용에 관한 권장사항은 권장사항을 참고하세요.

Knowledge Catalog에서 컨텍스트 추가

데이터 엔지니어링 에이전트는 용어집 용어를 BigQuery 테이블 및 열에 연결하고 데이터 프로필 스캔을 생성하여 Knowledge Catalog를 사용합니다. 용어집 용어는 특별한 처리 지침이 필요한 개인 식별 정보 (PII)가 포함된 열과 같이 추가 컨텍스트가 필요한 열에 태그를 지정하거나 테이블 간에 이름이 다른 일치하는 열을 식별할 수 있습니다.

Knowledge Catalog는 데이터 프로파일링도 활용합니다. 이를 통해 에이전트는 표 열 내 데이터 분포를 더 잘 이해하고 에이전트가 더 구체적인 데이터 품질 어설션을 만들 수 있습니다.

기존 테이블에 데이터 품질 확인 추가

에이전트에게 품질 검사를 추가하라고 프롬프트하면 에이전트는 스키마와 샘플을 기반으로 테이블에 적합한 검사를 추론합니다. 프롬프트의 일부로 의견이 있는 어설션을 추가할 수도 있습니다. 예를 들면 다음과 같습니다.

Add data quality checks for bigquery-public-data.thelook_ecommerce.users.

데이터 파이프라인 최적화

에이전트에게 데이터 파이프라인을 최적화하라고 요청할 수 있습니다. 새 테이블의 DDL을 생성할 때 데이터 엔지니어링 에이전트는 분석된 데이터 사용 패턴을 기반으로 파티셔닝 및 클러스터링을 추천합니다. 또한 에이전트는 다른 파이프라인 최적화를 자동으로 적용할 수 있습니다. 가능한 최적화의 예는 다음과 같습니다.

- 스토리지에서 읽어오는 데이터를 줄여 기본 비용 및 성능 드라이버 역할을 하는 열 가지치기

- 실행 계획 초기에 데이터를 필터링하여 후속 작업에서 처리하는 볼륨을 크게 줄이는 조건자 푸시다운

- 공통 하위 표현식을 제거하여 공유 변환 로직을 한 번만 식별하고 계산함으로써 효율성을 개선합니다. 이렇게 하면 큰 테이블을 여러 번 스캔하고 조인하는 것과 같은 비효율적인 관행을 방지할 수 있습니다.

- 실행할 때마다 전체 테이블을 다시 빌드하는 대신 마지막 실행 이후의 새 데이터 또는 변경된 데이터만 처리하는 증분 모델

샘플 프롬프트

다음 섹션에서는 데이터 엔지니어링 에이전트와 함께 사용하여 데이터 파이프라인을 개발할 수 있는 샘플 프롬프트를 제공합니다.

기존 데이터를 새 테이블로 집계

이 프롬프트에서 데이터 엔지니어링 에이전트는 스키마와 샘플을 사용하여 키별 데이터 그룹화를 추론합니다. 에이전트는 일반적으로 테이블 및 열 설명이 포함된 새 테이블 구성을 설정합니다.

Create a daily sales report from the

bigquery-public-data.thelook_ecommerce.order_items table into a

reporting.daily_sales_aggregation table.

새 파생 열을 만들고 새 테이블에 데이터 품질 검사 추가

이 프롬프트는 테이블과 열을 추가하고 동시에 테이블에 품질 검사를 지정하는 방법을 보여줍니다.

Create a new table named staging.products from

bigquery-public-data.thelook_ecommerce.products and add a calculated column

named gross_profit, which is the retail_price minus the cost.

Also, add the following assertions: ID must not be null and must be unique.

The retail_price must be greater than or equal to the cost. The department

column can only contain 'Men' or 'Women'.

모델 정의의 일부로 UDF 만들기

데이터 엔지니어링 에이전트는 사용자 정의 함수 (UDF)를 생성하는 DDL을 설정할 수도 있습니다. 에이전트가 실제로 UDF를 만들지는 않지만 데이터 파이프라인을 실행하여 UDF를 만들 수 있습니다. 이러한 UDF는 데이터 파이프라인의 모델 정의에서 사용할 수 있습니다.

Create a user-defined function (UDF) named get_age_group that takes an integer

age as input and returns a string representing the age group ('Gen Z',

'Millennial', 'Gen X', 'Baby Boomer').

Use this UDF on the age column from the

bigquery-public-data.thelook_ecommerce.users table to create a new view called

reporting.user_age_demographics that includes user_id, age, and the calculated

age_group.

권장사항

데이터 엔지니어링 에이전트 및 Dataform을 사용할 때 결과를 개선하려면 다음을 수행하는 것이 좋습니다.

일반적인 요청에 에이전트 안내 사용 특정 기법을 자주 적용하거나 에이전트에 동일한 수정사항을 자주 적용하는 경우 에이전트 요청 사항을 중앙 위치로 사용하여 일반적인 요청 사항을 저장하세요.

에이전트 계획을 활용합니다. 에이전트 계획은 복잡한 파이프라인 작업을 분류하는 데 유용합니다. 상담사 계획에는 상담사의 가정과 의도도 표시되므로 이러한 계획을 검토하여 상담사에게 올바른 컨텍스트가 제공되는지 확인하는 것이 좋습니다.

계획을 검토한 후 데이터 엔지니어링 에이전트에게 의견과 변경사항을 프롬프트하여 계획을 수정할 수 있습니다. 예를 들면 다음과 같습니다.

In the plan, ensure that all of the intermediate tables are views.

경우에 따라 상담사에게 명시적인 승인이 필요하지 않은 계획을 생성해 달라고 요청하는 것이 유용할 수 있습니다. 에이전트가 계획을 세우도록 하면 데이터 엔지니어링 에이전트가 작업을 분류해야 하므로 결과가 더 나은 경우가 많습니다. 에이전트가 계획을 생성하고 자동으로 실행하도록 강제할 수 있습니다. 예를 들면 다음과 같습니다.

Create a plan for a pipeline that finds the

top N pick up and drop off locations in NYC. You have my explicit pre-approval

to go ahead and execute this plan.

명확하게 작성합니다. 요청을 명확하게 서술하고 모호하게 표현하지 마세요. 가능한 경우 다음 예와 같이 프롬프트에 소스 및 대상 데이터 소스를 제공하세요.

Extract data from the sales.customers table in the us_west_1 region, and load

it into the reporting.dim_customers table in BigQuery. Match the schema of the

destination table.

직접적이고 범위가 지정된 요청을 제공하세요. 한 번에 하나의 질문을 하고 프롬프트는 간결하게 유지하세요. 질문이 두 개 이상인 프롬프트의 경우 다음 예와 같이 질문의 각 부분을 명확하게 구분하여 나열하세요.

1. Create a new table named staging.events_cleaned. Use raw.events as the

source. This new table should filter out any records where the user_agent

matches the pattern '%bot%'. All original columns should be included.

2. Next, create a table named analytics.user_sessions. Use

staging.events_cleaned as the source. This table should calculate the

duration for each session by grouping by session_id and finding the

difference between the MAX(event_timestamp) and MIN(event_timestamp).

명시적인 요청 사항을 제공하고 주요 용어를 강조합니다. 다음 예와 같이 프롬프트에서 주요 용어나 개념을 강조하고 특정 요구사항을 중요하다고 표시할 수 있습니다.

When creating the staging.customers table, it is *VERY IMPORTANT* that you

transform the email column from the source table bronze.raw_customers.

Coalesce any NULL values in the email column to an empty string ''.

작업 순서를 지정합니다. 순서가 지정된 작업의 경우 다음 예와 같이 목록에 프롬프트를 구조화합니다. 목록 항목은 집중적으로 수행할 수 있는 작은 단계로 나뉩니다.

Create a pipeline with the following steps:

1. Extract data from the ecomm.orders table.

2. Join the extracted data with the marts.customers table on customer_id.

3. Load the final result into the reporting.customer_orders table.

수정하고 반복하세요. 다양한 문구와 접근 방식을 시도하여 가장 좋은 결과를 얻는 방법을 알아보세요. 에이전트가 잘못된 SQL을 생성하거나 다른 실수를 하는 경우 예시나 공개 문서를 사용하여 에이전트를 안내하세요.

The previous query was incorrect because it removed the timestamp. Please

correct the SQL. Use the TIMESTAMP_TRUNC function to truncate the

event_timestamp to the nearest hour, instead of casting it as a DATE. For

example: TIMESTAMP_TRUNC(event_timestamp, HOUR).

에이전트 요청 사항 파일 관련 권장사항

에이전트 명령어 파일 만들기를 통해 필요에 맞게 데이터 엔지니어링 에이전트를 맞춤설정합니다. 에이전트 안내를 사용할 때는 다음을 권장합니다.

- Dataform의 모든 파일 경로는 저장소의 루트를 기준으로 합니다.

@file.md구문에 상대 경로를 사용하여GEMINI.md에 안내를 올바르게 가져옵니다. GEMINI.md에서 가져온 파일 자체에 가져오기가 포함될 수 있으며, 이로 인해 중첩된 구조가 생성될 수 있습니다. 무한 재귀를 방지하기 위해GEMINI.md의 최대 가져오기 깊이는 5단계입니다.- 데이터 파이프라인 간에 안내를 공유하려면 중앙 Dataform 저장소에 안내를 저장하고 작업 Dataform 저장소에 연결하세요. 로컬 명령어를 사용하여 파이프라인별 동작에 대한 중앙 규칙을 재정의할 수 있습니다.

- 프로젝트의 일관성을 유지하기 위해 이름 지정 규칙 파일이나 스타일 가이드에 연결하고 데이터 파이프라인을 사용할 때 이러한 가이드를 따르도록 에이전트에게 지시할 수 있습니다.

- 안내 파일에서 데이터 레이어를 제안하여 다양한 유형의 데이터를 함께 그룹화할 수 있습니다.

- 에이전트 안내 파일에 제목과 목록을 사용하면 데이터 엔지니어링 에이전트의 안내를 정리하고 명확하게 할 수 있습니다.

- 의미 있는 파일 이름을 지정하고 유사한 안내를 하나의 파일로 그룹화합니다. 마크다운 제목을 사용하여 카테고리, 기능 또는 기능별로 규칙을 논리적으로 정리합니다.

- 충돌하는 요청 사항을 방지하려면 각 요청 사항이 적용되는 특정 조건을 명확하게 정의하세요.

- 프롬프트와 워크플로를 반복하고 개선합니다. 에이전트 출시 및 모델 업그레이드에 따라 시간이 지남에 따라 에이전트 동작이 변경되므로 다양한 프롬프트로 규칙을 반복하여 개선이 필요한 영역을 파악하는 것이 좋습니다. 데이터 파이프라인의 변경사항에 맞춰 규칙 파일을 동기화하세요.

다음 예시는 데이터 엔지니어링 에이전트를 효과적으로 사용하기 위한 권장사항을 활용하는 GEMINI.md라는 에이전트 요청 사항 파일을 보여줍니다.

### Naming Conventions

* Datasets: [business_domain]_[use_case] (e.g., ecommerce_sales)

* Tables:

- Raw/External: raw_[source_name]

- Staging: stg_[business_entity]

- Dimension: dim_[dimension_name]

- Fact: fct_[fact_name]

* Dataform Folders:

- sources

- staging

- marts

- dataProducts

* Views: vw_[view_name]

* Columns: snake_case (e.g., order_id, customer_name)

## Cloud Storage data load

* When ingesting data from Cloud Storage, create external tables.

## Null handling

* Filter out null id values

## String normalization

* Standardize string columns by converting to lower case

## Data Cleaning Guidelines

@./generic_cleaning.md