Pipelines erstellen

In diesem Dokument wird beschrieben, wie Sie Pipelines in BigQuery erstellen. Pipelines basieren auf Dataform.

Hinweis

- Melden Sie sich in Ihrem Google Cloud -Konto an. Wenn Sie mit Google Cloudnoch nicht vertraut sind, erstellen Sie ein Konto, um die Leistungsfähigkeit unserer Produkte in der Praxis sehen und bewerten zu können. Neukunden erhalten außerdem ein Guthaben von 300 $, um Arbeitslasten auszuführen, zu testen und bereitzustellen.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the BigQuery, Dataform, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the BigQuery, Dataform, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Erforderliche Rollen für Pipelines

Bitten Sie Ihren Administrator, Ihnen die folgenden IAM-Rollen für das Projekt zuzuweisen, um die Berechtigungen zu erhalten, die Sie zum Erstellen von Pipelines benötigen:

-

So erstellen Sie Pipelines:

Code Creator (

roles/dataform.codeCreator) -

So bearbeiten und führen Sie Pipelines aus:

Dataform-Bearbeiter (

roles/dataform.editor)

Weitere Informationen zum Zuweisen von Rollen finden Sie unter Zugriff auf Projekte, Ordner und Organisationen verwalten.

Sie können die erforderlichen Berechtigungen auch über benutzerdefinierte Rollen oder andere vordefinierte Rollen erhalten.

Weitere Informationen zu Dataform IAM finden Sie unter Zugriff mit IAM steuern.

Erforderliche Rollen für Notebook-Optionen

Bitten Sie Ihren Administrator, Ihnen die IAM-Rolle Notebook Runtime User (roles/aiplatform.notebookRuntimeUser) für das Projekt zuzuweisen, um die Berechtigungen zu erhalten, die Sie zum Auswählen einer Laufzeitvorlage in den Notebook-Optionen benötigen.

Weitere Informationen zum Zuweisen von Rollen finden Sie unter Zugriff auf Projekte, Ordner und Organisationen verwalten.

Sie können die erforderlichen Berechtigungen auch über benutzerdefinierte Rollen oder andere vordefinierte Rollen erhalten.

Wenn Sie diese Rolle nicht haben, können Sie die Standard-Notebook-Laufzeitspezifikation auswählen.

Standardregion für Code-Assets festlegen

Für alle neuen Code-Assets in Ihrem Google Cloud -Projekt wird eine Standardregion verwendet. Nachdem das Asset erstellt wurde, können Sie seine Region nicht mehr ändern.

So legen Sie die Standardregion für neue Code-Assets fest:

Rufen Sie die Seite BigQuery auf.

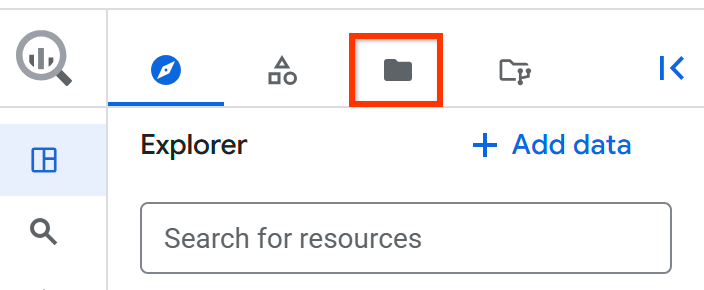

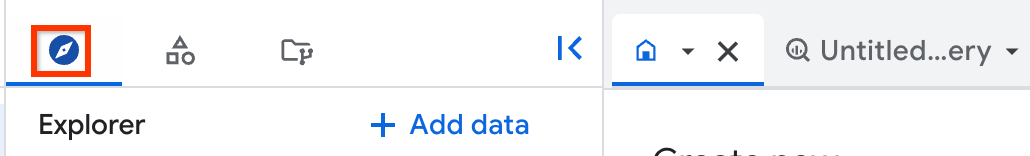

Klicken Sie im linken Bereich auf Dateien, um den Dateibrowser zu öffnen:

Klicken Sie neben dem Projektnamen auf Aktionen für den Bereich „Dateien“ ansehen > Code-Region wechseln.

Wählen Sie die Code-Region aus, die Sie als Standard verwenden möchten.

Klicken Sie auf Speichern.

Eine Liste der unterstützten Regionen finden Sie unter BigQuery Studio-Standorte.

Pipeline erstellen

Sie können auch die Seite Pipelines & Connections (Pipelines und Verbindungen) in der Google Cloud Konsole verwenden, um eine Dataform-Pipeline zu erstellen, die einen optimierten, BigQuery-spezifischen Workflow verwendet. Dieses Feature befindet sich im Vorschaumodus.

So erstellen Sie eine Pipeline:

Rufen Sie die Seite BigQuery auf.

Klicken Sie in der Tableiste des Editorbereichs auf den Pfeil neben dem +-Zeichen und dann auf Pipeline.

Optional: Wenn Sie die Pipeline umbenennen möchten, klicken Sie auf den Namen der Pipeline und geben Sie dann einen neuen Namen ein.

Klicken Sie auf Jetzt starten und dann auf den Tab Einstellungen.

Wählen Sie im Abschnitt Authentifizierung aus, ob die Pipeline mit den Nutzeranmeldedaten für Ihr Google-Konto oder mit einem Dienstkonto autorisiert werden soll.

Wenn Sie die Nutzeranmeldedaten für Ihr Google-Konto verwenden möchten (Vorschau), wählen Sie Mit meinen Nutzeranmeldedaten ausführen aus.

ausführen möchten, müssen Sie die Pipeline so konfigurieren, dass ein Dienstkonto verwendet wird.Wenn Sie ein Dienstkonto verwenden möchten, wählen Sie Mit ausgewähltem Dienstkonto ausführen aus und wählen Sie dann ein Dienstkonto aus. Wenn Sie ein Dienstkonto erstellen müssen, klicken Sie auf Neues Dienstkonto.

Wählen Sie im Abschnitt Verarbeitungsort einen Verarbeitungsort für die Pipeline aus.

Wenn Sie die automatische Auswahl eines Standorts aktivieren möchten, wählen Sie Automatische Standortauswahl aus. Bei dieser Option wird ein Standort anhand der in der Anfrage referenzierten Datasets ausgewählt. Der Auswahlprozess läuft so ab:

- Wenn in Ihrer Abfrage auf Datasets am selben Standort verwiesen wird, verwendet BigQuery diesen Standort.

- Wenn Ihre Abfrage auf Datasets aus zwei oder mehr verschiedenen Standorten verweist, tritt ein Fehler auf. Weitere Informationen zu dieser Einschränkung finden Sie unter Regionenübergreifende Dataset-Replikation.

- Wenn in Ihrer Abfrage keine Datasets referenziert werden, verwendet BigQuery standardmäßig die Multiregion

US.

Wenn Sie eine bestimmte Region auswählen möchten, wählen Sie Region und dann im Menü Region eine Region aus. Alternativ können Sie die

@@location-Systemvariable in Ihrer Abfrage verwenden. Weitere Informationen finden Sie unter Standorte angeben.Wenn Sie eine Multiregion auswählen möchten, wählen Sie Multiregion und dann im Menü Multiregion eine Multiregion aus.

Der Ort der Pipelineverarbeitung muss nicht mit dem Standardspeicherort für Code-Assets übereinstimmen.

SQLX-Optionen

So konfigurieren Sie die SQLX-Einstellungen für Ihre Pipeline:

Geben Sie im Feld Standardprojekt den Namen eines vorhandenenGoogle Cloud -Projekts ein. Dieser Wert wird für

defaultProjectin der Dateiworkflow_settings.yamlund fürdefaultDatabasein der Dateidataform.jsonverwendet. Das Standardprojekt wird von Pipelineaufgaben während der Ausführung verwendet.Optional: Suchen Sie im Feld Standard-Dataset nach einem vorhandenen Dataset und wählen Sie es aus. Die Liste der verfügbaren Datasets wird nach dem ausgewählten Projekt und Verarbeitungsstandort gefiltert. Dieser Wert wird für

defaultDatasetin der Dateiworkflow_settings.yamlverwendet. Das Standard-Dataset wird von Pipeline-Aufgaben während der Ausführung verwendet.

Notebookoptionen

So fügen Sie Ihrer Pipeline ein Notebook hinzu:

Übernehmen Sie im Feld Laufzeitvorlage entweder die Standardlaufzeit für Notebooks oder suchen Sie nach einer vorhandenen Laufzeit und wählen Sie sie aus.

- Klicken Sie auf den Pfeil daneben, um die Spezifikationen für die Standardlaufzeit aufzurufen.

- Informationen zum Erstellen einer neuen Laufzeit finden Sie unter Laufzeitvorlage erstellen.

Klicken Sie im Feld Cloud Storage-Bucket auf Durchsuchen und wählen Sie einen Cloud Storage-Bucket zum Speichern der Ausgabe von Notebooks in Ihrer Pipeline aus oder erstellen Sie einen.

Folgen Sie der Anleitung unter Richtlinie auf Bucket-Ebene ein Hauptkonto hinzufügen, um Ihrem benutzerdefinierten Dataform-Dienstkonto ein Hauptkonto für den Cloud Storage-Bucket hinzuzufügen, den Sie zum Speichern der Ausgabe geplanter Pipelineausführungen verwenden möchten, und diesem Hauptkonto die Rolle „Storage-Administrator“ (

roles/storage.admin) zuzuweisen.Dem ausgewählten benutzerdefinierten Dataform-Dienstkonto muss die IAM-Rolle „Storage Admin“ für den ausgewählten Bucket zugewiesen sein.

Pipelineaufgabe hinzufügen

So fügen Sie einer Pipeline eine Aufgabe hinzu:

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

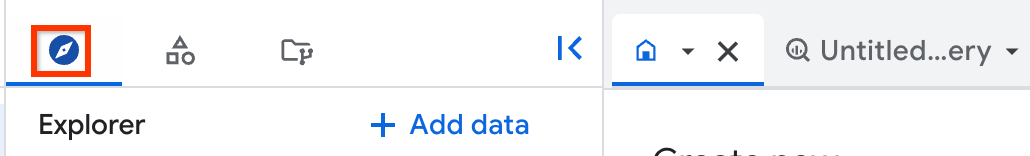

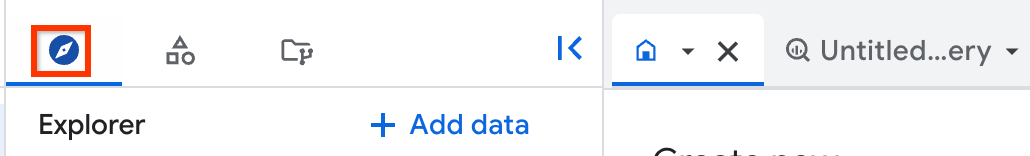

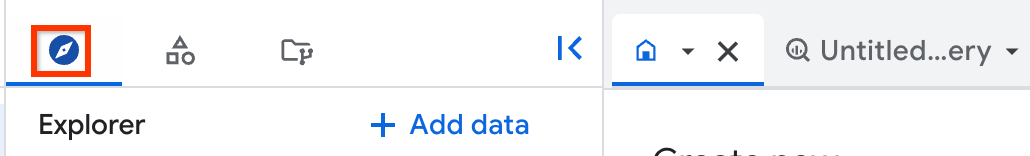

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Wählen Sie eine der folgenden Optionen aus, um ein Code-Asset hinzuzufügen:

SQL-Abfrage

Klicken Sie auf Aufgabe hinzufügen und wählen Sie Abfrage aus. Sie können entweder eine neue Abfrage erstellen oder eine vorhandene importieren.

Optional: Wählen Sie im Bereich Abfrageaufgaben – Details im Menü Nach eine Aufgabe aus, die vor Ihrer Abfrage ausgeführt werden soll.

Neue Abfrage erstellen

Klicken Sie auf das -Pfeilmenü neben Abfrage bearbeiten und wählen Sie entweder Im Kontext oder In neuem Tab aus.

Nach einer vorhandenen Abfrage suchen

Wählen Sie einen Abfragenamen aus und drücken Sie die Eingabetaste.

Klicken Sie auf Speichern.

Optional: Wenn Sie die Abfrage umbenennen möchten, klicken Sie im Pipelinebereich auf den Namen der Abfrage, dann auf Abfrage bearbeiten, oben auf dem Bildschirm auf den vorhandenen Namen der Abfrage und geben Sie dann einen neuen Namen ein.

Vorhandene Abfrage importieren

Klicken Sie neben Abfrage bearbeiten auf das Menü und dann auf Kopie importieren.

Suchen Sie nach einer vorhandenen Abfrage, die Sie importieren möchten, oder wählen Sie eine vorhandene Abfrage im Suchbereich aus. Wenn Sie eine Abfrage importieren, bleibt das Original unverändert, da die Quelldatei der Abfrage in die Pipeline kopiert wird.

Klicken Sie auf Bearbeiten, um die importierte Abfrage zu öffnen.

Klicken Sie auf Speichern.

Notebook

Klicken Sie auf Aufgabe hinzufügen und wählen Sie Notizbuch aus. Sie können entweder ein neues Notebook erstellen oder ein vorhandenes importieren. Informationen zum Ändern der Einstellungen für Notebook-Laufzeitvorlagen finden Sie unter Notebook-Optionen.

Optional: Wählen Sie im Bereich Notebook-Aufgabendetails im Menü Nach eine Aufgabe aus, die vor dem Notebook ausgeführt werden soll.

Neues Notebook erstellen

Klicken Sie neben Notebook bearbeiten auf das Menü mit dem -Pfeil und wählen Sie entweder Im Kontext oder In neuem Tab aus.

Suchen Sie nach einem vorhandenen Notebook.

Wählen Sie einen Notebook-Namen aus und drücken Sie die Eingabetaste.

Klicken Sie auf Speichern.

Optional: Wenn Sie das Notebook umbenennen möchten, klicken Sie im Pipelinebereich auf den Namen des Notebooks, dann auf Notebook bearbeiten, oben auf dem Bildschirm auf den vorhandenen Namen des Notebooks und geben Sie dann einen neuen Namen ein.

Vorhandenes Notebook importieren

Klicken Sie neben Notebook bearbeiten auf das Menü und dann auf Kopie importieren.

Suchen Sie nach einem vorhandenen Notebook, das Sie importieren möchten, oder wählen Sie ein vorhandenes Notebook im Suchbereich aus. Wenn Sie ein Notebook importieren, bleibt das Original unverändert, da die Quelldatei des Notebooks in die Pipeline kopiert wird.

Klicken Sie auf Bearbeiten, um das importierte Notebook zu öffnen.

Klicken Sie auf Speichern.

Datenvorbereitung

Klicken Sie auf Aufgabe hinzufügen und wählen Sie Datenvorbereitung aus. Sie können entweder eine neue Datenvorbereitung erstellen oder eine vorhandene importieren.

Optional: Wählen Sie im Bereich Details zur Datenvorbereitungsaufgabe im Menü Nach eine Aufgabe aus, die vor der Datenvorbereitung ausgeführt werden soll.

Neue Datenvorbereitung erstellen

Klicken Sie neben Datenvorbereitung bearbeiten auf das Menü mit dem -Pfeil und wählen Sie entweder Im Kontext oder In neuem Tab aus.

Nach einer vorhandenen Datenaufbereitung suchen

Wählen Sie einen Namen für die Datenvorbereitung aus und drücken Sie die Eingabetaste.

Klicken Sie auf Speichern.

Optional: Wenn Sie die Datenaufbereitung umbenennen möchten, klicken Sie im Pipelinebereich auf den Namen der Datenaufbereitung, dann auf Datenaufbereitung bearbeiten, oben auf den Namen und geben Sie einen neuen Namen ein.

Vorhandene Datenaufbereitung importieren

Klicken Sie neben Datenaufbereitung bearbeiten auf das Drop-down-Menü und dann auf Kopie importieren.

Suchen Sie nach einer vorhandenen Datenaufbereitung, die Sie importieren möchten, oder wählen Sie eine vorhandene Datenaufbereitung im Suchbereich aus. Wenn Sie eine Datenaufbereitung importieren, bleibt das Original unverändert, da die Quelldatei der Datenaufbereitung in die Pipeline kopiert wird.

Klicken Sie auf Bearbeiten, um die importierte Datenaufbereitung zu öffnen.

Klicken Sie auf Speichern.

Tabelle

Klicken Sie auf Aufgabe hinzufügen und wählen Sie Tabelle aus.

Wählen Sie im Bereich Neu erstellen die Option Tabelle oder Inkrementelle Tabelle aus.

Prüfen Sie das Standardprojekt für die Tabelle oder wählen Sie ein neues Projekt aus.

Prüfen Sie das Standard-Dataset für die Tabelle oder wählen Sie ein neues Dataset aus.

Geben Sie einen Namen für die Tabelle ein.

Klicken Sie im Bereich Details zur Tabellenaufgabe auf Öffnen, um die Aufgabe zu öffnen.

Konfigurieren Sie die Aufgabe mit den Einstellungen unter Details > Konfiguration oder im

config-Block des Code-Editors für die Tabelle.Verwenden Sie für Änderungen an Metadaten den Tab Konfiguration. Auf diesem Tab können Sie einen bestimmten Wert im

config-Block des Code-Editors bearbeiten, z. B. einen String oder ein Array, der wie ein JavaScript-Objekt formatiert ist. So lassen sich Syntaxfehler vermeiden und Sie können prüfen, ob Ihre Einstellungen korrekt sind.Optional: Wählen Sie im Menü Nach eine Aufgabe aus, die vor der Tabelle ausgeführt werden soll.

Sie können die Metadaten für Ihre Pipeline-Aufgabe auch im

config-Block im Editor definieren. Weitere Informationen finden Sie unter Tabellen erstellen.Der Editor validiert Ihren Code und zeigt den Validierungsstatus an.

Unter Details > Kompilierte Abfragen können Sie den aus dem SQLX-Code kompilierten SQL-Code ansehen.

Klicken Sie auf Ausführen, um den SQL-Code in Ihrer Pipeline auszuführen.

Sehen Sie sich in Abfrageergebnisse die Datenvorschau an.

Ansehen

Klicken Sie auf Aufgabe hinzufügen und wählen Sie Ansehen aus.

Wählen Sie im Bereich Neu erstellen die Option Ansicht oder Materialisierte Ansicht aus.

Prüfen Sie das Standardprojekt für die Ansicht oder wählen Sie ein neues Projekt aus.

Prüfen Sie das Standard-Dataset für die Ansicht oder wählen Sie ein neues Dataset aus.

Geben Sie einen Namen für die Ansicht ein.

Klicken Sie im Bereich Aufgabendetails ansehen auf Öffnen, um die Aufgabe zu öffnen.

Konfigurieren Sie die Aufgabe mit den Einstellungen unter Details > Konfiguration oder im

config-Block des Code-Editors für die Ansicht.Verwenden Sie für Änderungen an Metadaten den Tab Konfiguration. Auf diesem Tab können Sie einen bestimmten Wert im

config-Block des Code-Editors bearbeiten, z. B. einen String oder ein Array, der wie ein JavaScript-Objekt formatiert ist. So lassen sich Syntaxfehler vermeiden und Sie können prüfen, ob Ihre Einstellungen korrekt sind.Optional: Wählen Sie im Menü Nach eine Aufgabe aus, die vor der Ansicht ausgeführt werden soll.

Sie können die Metadaten für Ihre Pipeline-Aufgabe auch im

config-Block im Editor definieren. Weitere Informationen finden Sie unter Ansicht mit Dataform Core erstellen.Der Editor validiert Ihren Code und zeigt den Validierungsstatus an.

Unter Details > Kompilierte Abfragen können Sie den aus dem SQLX-Code kompilierten SQL-Code ansehen.

Klicken Sie auf Ausführen, um den SQL-Code in Ihrer Pipeline auszuführen.

Sehen Sie sich in Abfrageergebnisse die Datenvorschau an.

Pipelineaufgabe bearbeiten

So bearbeiten Sie eine Pipeline-Aufgabe:

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Klicken Sie auf die ausgewählte Aufgabe.

Wenn Sie die vorherige Aufgabe ändern möchten, wählen Sie im Menü Nach eine Aufgabe aus, die vor Ihrer Aufgabe ausgeführt werden soll.

Klicken Sie auf Bearbeiten, um den Inhalt der ausgewählten Aufgabe zu bearbeiten.

Bearbeiten Sie auf dem geöffneten neuen Tab den Aufgabeninhalt und speichern Sie die Änderungen an der Aufgabe.

Pipelineaufgabe löschen

So löschen Sie eine Aufgabe aus einer Pipeline:

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Klicken Sie auf die ausgewählte Aufgabe.

Klicken Sie im Bereich Aufgabendetails auf Löschen Löschen.

Pipeline teilen

So geben Sie eine Pipeline frei:

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Klicken Sie auf Teilen und wählen Sie dann Berechtigungen verwalten aus.

Klicken Sie auf Nutzer/Gruppe hinzufügen.

Geben Sie im Feld Neue Hauptkonten den Namen mindestens eines Nutzers oder einer Gruppe ein.

Wählen Sie unter Rollen zuweisen eine Rolle aus.

Klicken Sie auf Speichern.

Link zu einer Pipeline teilen

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Klicken Sie auf Freigeben und wählen Sie dann Link freigeben aus. Die URL für Ihre Pipeline wird in die Zwischenablage Ihres Computers kopiert.

Pipeline ausführen

Wenn Sie eine Pipeline ausführen, können Sie alle Aufgaben in der Pipeline ausführen, bestimmte Aufgaben manuell auswählen oder Aufgaben mit ausgewählten Tags ausführen.

Alle Aufgaben in einer Pipeline ausführen

Wählen Sie eine der folgenden Optionen aus, um die aktuelle Version einer Pipeline manuell auszuführen:

Console

So führen Sie alle Aufgaben in einer Pipeline aus:

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Klicken Sie auf Ausführen > Alle Aufgaben ausführen. Wenn Sie für die Authentifizierung die Option Mit meinen Nutzeranmeldedaten ausführen ausgewählt haben, müssen Sie Ihr Google-Konto autorisieren (Vorschau).

Optional: Wenn Sie die Ausführung prüfen möchten, rufen Sie die letzten manuellen Ausführungen auf.

API

Wenn Sie eine Pipeline manuell ausführen möchten, kompilieren Sie den Standardarbeitsbereich und verwenden Sie das Kompilierungsergebnis, um einen Workflowaufruf zu erstellen.

Verwenden Sie zum Erstellen eines Kompilierungsergebnisses für den Standardarbeitsbereich die Methode

projects.locations.repositories.compilationResults.create.Führen Sie die API-Anfrage mit den folgenden Informationen aus:

curl -X POST \ -H "Authorization: Bearer $(gcloud auth print-access-token)" \ -H "Content-Type: application/json" \ -d '{ "workspace": "projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/workspaces/default" }' \ "https://dataform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/compilationResults"Ersetzen Sie Folgendes:

LOCATION: Die Google Cloud Region für Ihr Repository, z. B.us-central1. Sie finden den Speicherort des Repositorys in der Google Cloud Console. Rufen Sie dazu den Bereich Explorer auf, wählen Sie die Pipeline aus, öffnen Sie den Tab Einstellungen und klicken Sie auf Pipeline in Dataform öffnen. Der Speicherort ist in der URL im Format/locations/LOCATION/angegeben.PROJECT_ID: die eindeutige Kennung IhresGoogle Cloud -Projekts.REPOSITORY_ID: Die eindeutige Kennung für Ihr Dataform-Repository, z. B.my-secure-repo. Sie finden die Repository-ID in der Google Cloud Console. Rufen Sie dazu den Bereich Explorer auf, wählen Sie die Pipeline aus, öffnen Sie den Tab Einstellungen und sehen Sie sich das Feld Dataform-Repository-ID an.

Suchen Sie im Antworttext nach dem Feld

nameund kopieren Sie den Wert, z. B.projects/my-project/locations/us-central1/repositories/my-repo/compilationResults/12345-67890.Lösen Sie die Ausführung der Pipeline mit der Methode

projects.locations.repositories.workflowInvocations.createaus.Führen Sie die API-Anfrage mit den folgenden Informationen aus:

curl -X POST \ -H "Authorization: Bearer $(gcloud auth print-access-token)" \ -H "Content-Type: application/json" \ -d '{ "compilationResult": "COMPILATION_RESULT" }' \ "https://dataform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/workflowInvocations"Ersetzen Sie Folgendes:

COMPILATION_RESULT: Der vollständige Ressourcenname des Kompilierungsergebnisses, das Sie im vorherigen Schritt kopiert haben.LOCATION: Die Google Cloud Region für Ihr Repository, z. B.us-central1.PROJECT_ID: die eindeutige Kennung IhresGoogle Cloud -Projekts.REPOSITORY_ID: Die eindeutige Kennung für Ihr Dataform-Repository, z. B.my-secure-repo.

Ausgewählte Aufgaben in einer Pipeline ausführen

So führen Sie ausgewählte Aufgaben in einer Pipeline aus:

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Klicken Sie auf Ausführen ;> Auszuführende Aufgaben auswählen.

Autorisieren Sie im Bereich Ausführen im Abschnitt Authentifizierung die Ausführung mit den Nutzeranmeldedaten für Ihr Google-Konto oder ein Dienstkonto.

- Wenn Sie die Nutzeranmeldedaten für Ihr Google-Konto verwenden möchten (Vorschau), wählen Sie Mit Nutzeranmeldedaten ausführen aus.

Wenn Sie ein benutzerdefiniertes Dienstkonto verwenden möchten, wählen Sie Mit ausgewähltem Dienstkonto ausführen aus und wählen Sie dann ein benutzerdefiniertes Dienstkonto aus.

Wenn Sie ein Dienstkonto erstellen müssen, klicken Sie auf Neues Dienstkonto.

Achten Sie darauf, dass Auswahl von Aufgaben ausgewählt ist.

Suchen Sie im Menü Tasks für die Ausführung auswählen nach bestimmten Tasks und wählen Sie die Tasks aus, die Sie ausführen möchten.

In der Tabelle Aufgaben sind die ausgewählten Aufgaben aufgeführt. Klicken Sie auf einen Aufgabennamen, um die Aufgabe direkt im SQL-Editor zu öffnen.

Optional: Konfigurieren Sie die folgenden Ausführungsoptionen:

- Abhängigkeiten einbeziehen: Wählen Sie diese Option aus, um die ausgewählten Aufgaben und ihre Abhängigkeiten auszuführen.

- Abhängigkeiten einbeziehen: Wählen Sie diese Option aus, um die ausgewählten Aufgaben und ihre transitiven Downstream-Abhängigkeiten auszuführen.

- Mit vollständiger Aktualisierung ausführen: Wählen Sie diese Option aus, um alle Tabellen von Grund auf neu zu erstellen.

- Als interaktiven Job mit hoher Priorität ausführen (Standardeinstellung): Wählen Sie diese Option aus, um die Priorität des BigQuery-Abfragejobs festzulegen. Standardmäßig führt BigQuery Abfragen als interaktive Abfragejobs aus, die so schnell wie möglich gestartet werden sollen. Wenn Sie diese Option deaktivieren, werden die Abfragen als Batchabfragejobs mit niedrigerer Priorität ausgeführt.

Klicken Sie auf Ausführen. Wenn Sie Mit Nutzeranmeldedaten ausführen als Authentifizierungsmethode ausgewählt haben, müssen Sie Ihr Google-Konto autorisieren (Vorschau).

Optional: Wenn Sie die Ausführung prüfen möchten, rufen Sie die letzten manuellen Ausführungen auf.

Aufgaben mit ausgewählten Tags in einer Pipeline ausführen

So führen Sie Aufgaben mit ausgewählten Tags in einer Pipeline aus:

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer:

Wenn das linke Steuerfeld nicht angezeigt wird, klicken Sie auf Linkes Steuerfeld maximieren, um es zu öffnen.

Maximieren Sie im Bereich Explorer Ihr Projekt, klicken Sie auf Pipelines und wählen Sie dann eine Pipeline aus.

Klicken Sie auf Ausführen ;> Nach Tag ausführen und führen Sie dann einen der folgenden Schritte aus:

- Klicken Sie auf ein Tag, das Sie ausführen möchten.

- Klicken Sie auf Auszuführende Tags auswählen.

Autorisieren Sie im Bereich Ausführen im Abschnitt Authentifizierung die Ausführung mit den Nutzeranmeldedaten für Ihr Google-Konto oder ein Dienstkonto.

- Wenn Sie die Nutzeranmeldedaten für Ihr Google-Konto verwenden möchten (Vorschau), wählen Sie Mit Nutzeranmeldedaten ausführen aus.

Wenn Sie ein benutzerdefiniertes Dienstkonto verwenden möchten, wählen Sie Mit ausgewähltem Dienstkonto ausführen aus und wählen Sie dann ein benutzerdefiniertes Dienstkonto aus.

Wenn Sie ein Dienstkonto erstellen müssen, klicken Sie auf Neues Dienstkonto.

Achten Sie darauf, dass Auswahl von Tags ausgewählt ist.

Suchen Sie im Menü Tags für die Ausführung auswählen nach bestimmten Tags und wählen Sie die Tags aus, die Sie ausführen möchten.

In der Tabelle Aufgaben sind die ausgewählten Aufgaben aufgeführt. Klicken Sie auf einen Aufgabennamen, um die Aufgabe direkt im SQL-Editor zu öffnen.

Optional: Konfigurieren Sie die folgenden Ausführungsoptionen:

- Abhängigkeiten einbeziehen: Wählen Sie diese Option aus, um die ausgewählten Aufgaben und ihre Abhängigkeiten auszuführen.

- Abhängigkeiten einbeziehen: Wählen Sie diese Option aus, um die ausgewählten Aufgaben und ihre transitiven Downstream-Abhängigkeiten auszuführen.

- Mit vollständiger Aktualisierung ausführen: Wählen Sie diese Option aus, um alle Tabellen von Grund auf neu zu erstellen.

- Als interaktiven Job mit hoher Priorität ausführen (Standardeinstellung): Wählen Sie diese Option aus, um die Priorität des BigQuery-Abfragejobs festzulegen. Standardmäßig führt BigQuery Abfragen als interaktive Abfragejobs aus, die so schnell wie möglich gestartet werden sollen. Wenn Sie diese Option deaktivieren, werden die Abfragen als Batchabfragejobs mit niedrigerer Priorität ausgeführt.

Klicken Sie auf Ausführen. Wenn Sie Mit Nutzeranmeldedaten ausführen als Authentifizierungsmethode ausgewählt haben, müssen Sie Ihr Google-Konto autorisieren (Vorschau).

Optional: Wenn Sie die Ausführung prüfen möchten, rufen Sie die letzten manuellen Ausführungen auf.

Google-Konto autorisieren

Wenn Sie die Ressource mit den Nutzeranmeldedaten Ihres Google-Kontos authentifizieren möchten, müssen Sie BigQuery-Pipelines manuell die Berechtigung erteilen, das Zugriffstoken für Ihr Google-Konto abzurufen und in Ihrem Namen auf die Quelldaten zuzugreifen. Sie können die manuelle Genehmigung über die OAuth-Dialogoberfläche erteilen.

Sie müssen BigQuery-Pipelines nur einmal eine Berechtigung erteilen.

So heben Sie die erteilte Berechtigung auf:

- Rufen Sie Ihre Google-Kontoseite auf.

- Klicken Sie auf BigQuery-Pipelines.

- Klicken Sie auf Zugriff entfernen.

Wenn Ihre Pipeline ein Notebook enthält, müssen Sie Colab Enterprise auch manuell die Berechtigung erteilen, das Zugriffstoken für Ihr Google-Konto abzurufen und in Ihrem Namen auf die Quelldaten zuzugreifen. Sie müssen die Berechtigung nur einmal erteilen. Sie können diese Berechtigung auf der Google-Kontoseite widerrufen.