Criar pipelines

Neste documento, descrevemos como criar pipelines no BigQuery. Os pipelines são gerados pelo Dataform.

Antes de começar

- Faça login na sua conta do Google Cloud . Se você começou a usar o Google Cloud, crie uma conta para avaliar o desempenho de nossos produtos em situações reais. Clientes novos também recebem US$ 300 em créditos para executar, testar e implantar cargas de trabalho.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the BigQuery, Dataform, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the BigQuery, Dataform, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Funções necessárias para pipelines

Para receber as permissões necessárias para criar pipelines, peça ao administrador para conceder a você os seguintes papéis do IAM no projeto:

-

Para criar pipelines:

Criador de código (

roles/dataform.codeCreator) -

Para editar e executar pipelines:

Editor do Dataform (

roles/dataform.editor)

Para mais informações sobre a concessão de papéis, consulte Gerenciar o acesso a projetos, pastas e organizações.

Também é possível conseguir as permissões necessárias usando papéis personalizados ou outros papéis predefinidos.

Para mais informações sobre o IAM do Dataform, consulte Controlar o acesso com o IAM.

Papéis necessários para opções de notebook

Para receber as permissões necessárias

para selecionar um modelo de ambiente de execução nas opções do notebook,

peça ao administrador para conceder a você o papel do IAM de

Usuário do ambiente de execução do notebook (roles/aiplatform.notebookRuntimeUser) no projeto.

Para mais informações sobre a concessão de papéis, consulte Gerenciar o acesso a projetos, pastas e organizações.

Também é possível conseguir as permissões necessárias usando papéis personalizados ou outros papéis predefinidos.

Se você não tiver essa função, selecione a especificação padrão de tempo de execução do notebook.

Definir a região padrão para recursos de código

Todos os novos recursos de código no seu projeto Google Cloud usam uma região padrão. Depois que o recurso é criado, não é possível mudar a região dele.

Para definir a região padrão dos novos recursos de código, faça o seguinte:

Acessar a página do BigQuery.

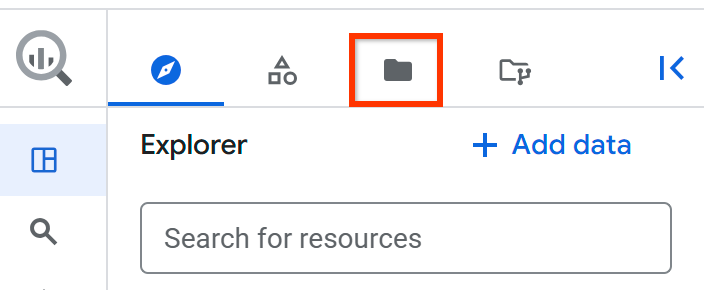

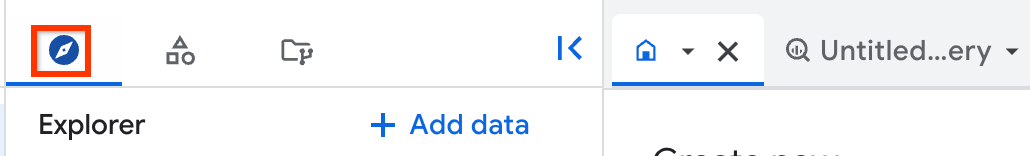

No painel à esquerda, clique em Arquivos para abrir o navegador de arquivos:

Ao lado do nome do projeto, clique em Ver ações do painel de arquivos > Mudar região de código.

Selecione a região de código que você quer usar como padrão.

Clique em Salvar.

Para conferir uma lista de regiões compatíveis, consulte Locais do BigQuery Studio.

Criar um pipeline

Você também pode usar a página Pipelines e conexões do BigQuery no console Google Cloud para criar um pipeline do Dataform que usa um fluxo de trabalho simplificado e específico do BigQuery. Esse recurso está na visualização.

Para criar um pipeline, siga estas etapas:

Acessar a página do BigQuery.

Na barra de guias do painel do editor, clique na seta ao lado do sinal + e clique em Pipeline.

Opcional: para renomear o pipeline, clique no nome dele e digite um novo.

Clique em Começar e acesse a guia Configurações.

Na seção Autenticação, escolha autorizar o pipeline com as credenciais de usuário da sua Conta do Google ou uma conta de serviço.

Para usar as credenciais de usuário da sua Conta do Google (Prévia), selecione Executar com minhas credenciais de usuário.

Para usar uma conta de serviço, selecione Executar com a conta de serviço selecionada e escolha uma conta de serviço. Se você precisar criar uma conta de serviço, clique em Nova conta de serviço.

Na seção Local de processamento, selecione um local para o pipeline.

Para ativar a seleção automática de um local, selecione Seleção automática de local. Essa opção seleciona um local com base nos conjuntos de dados referenciados na solicitação. O processo de seleção é o seguinte:

- Se a consulta fizer referência a conjuntos de dados do mesmo local, o BigQuery usará esse local.

- Se a consulta fizer referência a conjuntos de dados de dois ou mais locais diferentes, um erro vai ocorrer. Para mais detalhes sobre essa limitação, consulte Replicação de conjuntos de dados entre regiões.

- Se a consulta não fizer referência a nenhum conjunto de dados, o BigQuery usará a multirregião

USpor padrão.

Para escolher uma região específica, selecione Região e escolha uma opção no menu Região. Como alternativa, use a variável de sistema

@@locationna sua consulta. Para mais informações, consulte Especificar locais.Para escolher uma multirregião, selecione Multirregião e escolha uma no menu Multirregião.

O local de processamento do pipeline não precisa corresponder ao local de armazenamento padrão dos recursos de código.

Opções do SQLX

Para configurar as opções do SQLX para seu pipeline, faça o seguinte na seção Opções do SQLX:

No campo Projeto padrão, insira o nome de um projetoGoogle Cloud . Esse valor é usado para

defaultProjectno arquivoworkflow_settings.yamle paradefaultDatabaseno arquivodataform.json. O projeto padrão é usado pelas tarefas do pipeline durante a execução.Opcional: no campo Conjunto de dados padrão, pesquise e selecione um conjunto de dados existente. A lista de conjuntos de dados disponíveis é filtrada com base no projeto e no local de processamento selecionados. Esse valor é usado para

defaultDatasetno arquivoworkflow_settings.yaml. O conjunto de dados padrão é usado pelas tarefas do pipeline durante a execução.

Opções do notebook

Para adicionar um notebook ao pipeline, faça o seguinte na seção Opções de notebook:

No campo Modelo de ambiente de execução, aceite o ambiente de execução padrão do notebook ou pesquise e selecione um ambiente de execução existente.

- Para conferir as especificações do ambiente de execução padrão, clique na seta ao lado.

- Para criar um ambiente de execução, consulte Criar um modelo de ambiente de execução.

No campo Bucket do Cloud Storage, clique em Procurar e selecione ou crie um bucket do Cloud Storage para armazenar a saída dos notebooks no pipeline.

Siga as etapas em Adicionar um principal a uma política no nível do bucket para adicionar sua conta de serviço personalizada do Dataform como um principal ao bucket do Cloud Storage que você planeja usar para armazenar a saída de execuções de pipeline programadas e conceda o papel de administrador do Storage (

roles/storage.admin) a esse principal.A conta de serviço personalizada do Dataform selecionada precisa receber o papel do IAM "Administrador de armazenamento" no bucket selecionado.

Adicionar uma tarefa de pipeline

Para adicionar uma tarefa a um pipeline, siga estas etapas:

No console do Google Cloud , acesse a página BigQuery.

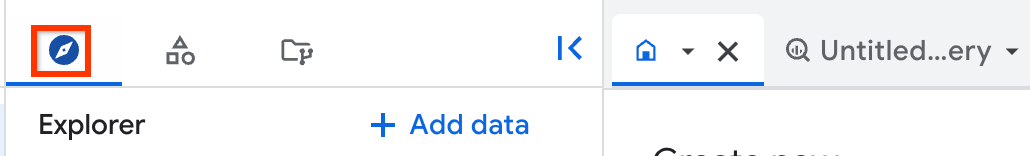

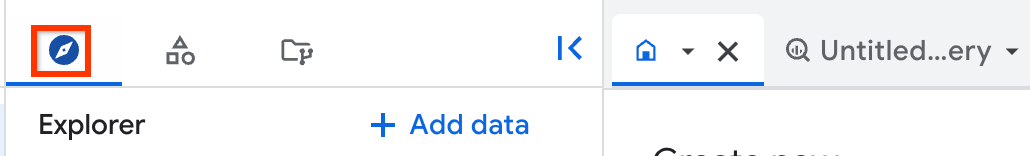

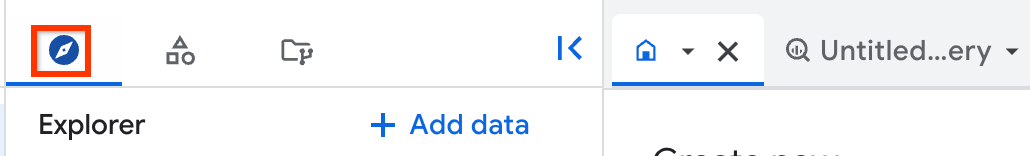

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Para adicionar um recurso de código, selecione uma das seguintes opções:

Consulta SQL

Clique em Adicionar tarefa e selecione Consulta. Você pode criar uma nova consulta ou importar uma já existente.

Opcional: no painel Detalhes da tarefa de consulta, no menu Executar após, selecione uma tarefa para preceder sua consulta.

Criar uma consulta

Clique no menu de seta ao lado de Editar consulta e selecione No contexto ou Em uma nova guia.

Pesquise uma consulta.

Selecione um nome de consulta e pressione Enter.

Clique em Salvar.

Opcional: para renomear a consulta, clique no nome dela no painel de pipeline, clique em Editar consulta, clique no nome da consulta na parte de cima da tela e digite um novo nome.

Importar uma consulta

Clique no menu de seta ao lado de Editar consulta e clique em Importar uma cópia.

Pesquise uma consulta para importar ou selecione uma no painel de pesquisa. Quando você importa uma consulta, a original permanece inalterada porque o arquivo de origem da consulta é copiado para o pipeline.

Clique em Editar para abrir a consulta importada.

Clique em Salvar.

Notebook

Clique em Adicionar tarefa e selecione Notebook. Você pode criar um notebook ou importar um que já existe. Para mudar as configurações dos modelos de ambiente de execução do notebook, consulte Opções do notebook.

Opcional: no painel Detalhes da tarefa do notebook, no menu Executar após, selecione uma tarefa para preceder o notebook.

Criar um notebook

Clique no menu de seta ao lado de Editar notebook e selecione No contexto ou Em uma nova guia.

Pesquise um notebook.

Selecione um nome de notebook e pressione Enter.

Clique em Salvar.

Opcional: para renomear o notebook, clique no nome dele no painel de pipeline, clique em Editar notebook, clique no nome do notebook na parte de cima da tela e digite um novo nome.

Importar um notebook

Clique no menu de seta ao lado de Editar notebook e clique em Importar uma cópia.

Pesquise um notebook para importar ou selecione um no painel de pesquisa. Quando você importa um notebook, o original permanece inalterado porque o arquivo de origem do notebook é copiado para o pipeline.

Para abrir o notebook importado, clique em Editar.

Clique em Salvar.

Preparação de dados

Clique em Adicionar tarefa e selecione Preparação de dados. Você pode criar uma nova preparação de dados ou importar uma já existente.

Opcional: no painel Detalhes da tarefa de preparação de dados, no menu Executar após, selecione uma tarefa para preceder a preparação de dados.

Criar uma nova preparação de dados

Clique no menu de seta ao lado de Editar preparação de dados e selecione No contexto ou Em nova guia.

Pesquise uma preparação de dados.

Selecione um nome de preparação de dados e pressione Enter.

Clique em Salvar.

Opcional: para renomear a preparação de dados, clique no nome dela no painel de pipeline, clique em Editar preparação de dados, clique no nome na parte de cima da tela e insira um novo nome.

Importar uma preparação de dados atual

Clique no menu suspenso de seta ao lado de Editar preparação de dados e clique em Importar uma cópia.

Pesquise uma preparação de dados para importar ou selecione uma no painel de pesquisa. Quando você importa uma preparação de dados, o original permanece inalterado porque o arquivo de origem da preparação de dados é copiado para o pipeline.

Para abrir a preparação de dados importados, clique em Editar.

Clique em Salvar.

Tabela

Clique em Adicionar tarefa e selecione Tabela.

No painel Criar novo, selecione Tabela ou Tabela incremental.

Verifique o projeto padrão da tabela ou selecione um novo.

Verifique o conjunto de dados padrão da tabela ou selecione um novo.

Insira um nome para a tabela.

No painel Detalhes da tarefa da tabela, clique em Abrir para abrir a tarefa.

Configure a tarefa usando as configurações em Detalhes > Configuração ou no bloco

configdo editor de código da tabela.Para mudanças de metadados, use a guia Configuração. Nela, você pode editar um valor específico no bloco

configdo editor de código, como uma string ou uma matriz, que é formatada como um objeto JavaScript. Usar essa guia ajuda a evitar erros de sintaxe e verificar se as configurações estão corretas.Opcional: no menu Executar após, selecione uma tarefa para preceder sua tabela.

Também é possível definir os metadados da tarefa do pipeline no bloco

configdo editor. Para mais informações, consulte Como criar tabelas.O editor valida seu código e mostra o status da validação.

Em Detalhes > Consultas compiladas, confira o SQL compilado do código SQLX.

Clique em Executar para executar o SQL no pipeline.

Em Resultados da consulta, inspecione a prévia dos dados.

Ver

Clique em Adicionar tarefa e selecione Visualizar.

No painel Criar novo, selecione Visualização ou Visualização materializada.

Verifique o projeto padrão da visualização ou selecione um novo.

Verifique o conjunto de dados padrão da visualização ou selecione um novo.

Insira um nome para a visualização.

No painel Ver detalhes da tarefa, clique em Abrir para abrir a tarefa.

Configure a tarefa usando as configurações em Detalhes > Configuração ou no bloco

configdo editor de código da visualização.Para mudanças de metadados, use a guia Configuração. Nela, você pode editar um valor específico no bloco

configdo editor de código, como uma string ou uma matriz, que é formatada como um objeto JavaScript. Usar essa guia ajuda a evitar erros de sintaxe e verificar se as configurações estão corretas.Opcional: no menu Executar após, selecione uma tarefa para preceder sua visualização.

Também é possível definir os metadados da tarefa do pipeline no bloco

configdo editor. Para mais informações, consulte Como criar uma visualização com o Dataform Core.O editor valida seu código e mostra o status da validação.

Em Detalhes > Consultas compiladas, confira o SQL compilado do código SQLX.

Clique em Executar para executar o SQL no pipeline.

Em Resultados da consulta, inspecione a prévia dos dados.

Editar uma tarefa de pipeline

Para editar uma tarefa de pipeline, siga estas etapas:

No console do Google Cloud , acesse a página BigQuery.

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Clique na tarefa selecionada.

Para mudar a tarefa anterior, no menu Executar após, selecione uma tarefa que antecede a sua.

Para editar o conteúdo da tarefa selecionada, clique em Editar.

Na nova guia que abrir, edite o conteúdo da tarefa e salve as mudanças.

Excluir uma tarefa de pipeline

Para excluir uma tarefa de um pipeline, siga estas etapas:

No console do Google Cloud , acesse a página BigQuery.

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Clique na tarefa selecionada.

No painel Detalhes da tarefa, clique em Excluir Excluir.

Compartilhar um pipeline

Para compartilhar um pipeline, siga estas etapas:

No console do Google Cloud , acesse a página BigQuery.

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Clique em Compartilhar e selecione Gerenciar permissões.

Clique em Adicionar usuário/grupo.

No campo Novos participantes, insira o nome de pelo menos um usuário ou grupo.

Em Atribuir papéis, selecione um papel.

Clique em Salvar.

Compartilhar um link para um pipeline

No console do Google Cloud , acesse a página BigQuery.

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Clique em Compartilhar e selecione Compartilhar link. O URL do seu pipeline é copiado para a área de transferência do computador.

Executar um pipeline

Ao executar um pipeline, você pode executar todas as tarefas nele, selecionar manualmente tarefas específicas ou executar tarefas com tags selecionadas.

Executar todas as tarefas em um pipeline

Para executar manualmente a versão atual de um pipeline, selecione uma das seguintes opções:

Console

Para executar todas as tarefas em um pipeline, faça o seguinte:

No console do Google Cloud , acesse a página BigQuery.

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Clique em Executar > Executar todas as tarefas. Se você selecionou Executar com minhas credenciais de usuário para sua autenticação, autorize sua Conta do Google (Prévia).

Opcional: para inspecionar a execução, confira as execuções manuais anteriores.

API

Para executar um pipeline manualmente, compile o espaço de trabalho padrão e use o resultado da compilação para criar uma invocação de fluxo de trabalho.

Para criar um resultado de compilação para o espaço de trabalho padrão, use o método

projects.locations.repositories.compilationResults.create.Execute a solicitação de API com as seguintes informações:

curl -X POST \ -H "Authorization: Bearer $(gcloud auth print-access-token)" \ -H "Content-Type: application/json" \ -d '{ "workspace": "projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/workspaces/default" }' \ "https://dataform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/compilationResults"Substitua:

LOCATION: a região Google Cloud do seu repositório, por exemplo,us-central1. Para encontrar o local do repositório no console do Google Cloud , navegue até o painel Explorer, selecione o pipeline, abra a guia Configurações e clique em Abrir pipeline no Dataform. O local está no URL no formato/locations/LOCATION/.PROJECT_ID: o identificador exclusivo do seu projetoGoogle Cloud .REPOSITORY_ID: o identificador exclusivo do seu repositório do Dataform, por exemplo,my-secure-repo. Para encontrar o ID do repositório no console do Google Cloud , acesse o painel Explorer, selecione o pipeline, abra a guia Configurações e confira o campo ID do repositório do Dataform.

No corpo da resposta, localize o campo

namee copie o valor dele, por exemplo,projects/my-project/locations/us-central1/repositories/my-repo/compilationResults/12345-67890.Acione a execução do pipeline usando o método

projects.locations.repositories.workflowInvocations.create.Execute a solicitação de API com as seguintes informações:

curl -X POST \ -H "Authorization: Bearer $(gcloud auth print-access-token)" \ -H "Content-Type: application/json" \ -d '{ "compilationResult": "COMPILATION_RESULT" }' \ "https://dataform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/workflowInvocations"Substitua:

COMPILATION_RESULT: o nome completo do recurso do resultado da compilação que você copiou na etapa anterior.LOCATION: a região Google Cloud do seu repositório, por exemplo,us-central1.PROJECT_ID: o identificador exclusivo do seu projetoGoogle Cloud .REPOSITORY_ID: o identificador exclusivo do seu repositório do Dataform, por exemplo,my-secure-repo.

Executar tarefas selecionadas em um pipeline

Para executar as tarefas selecionadas em um pipeline, faça o seguinte:

No console do Google Cloud , acesse a página BigQuery.

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Clique em Executar > Selecionar tarefas para executar.

No painel Executar, na seção Autenticação, autorize a execução com as credenciais de usuário da sua Conta do Google ou de uma conta de serviço.

- Para usar as credenciais de usuário da sua Conta do Google (Prévia), selecione Executar com credenciais de usuário.

Para usar uma conta de serviço personalizada, selecione Executar com a conta de serviço selecionada e escolha uma conta de serviço personalizada.

Se você precisar criar uma conta de serviço, clique em Nova conta de serviço.

Verifique se a opção Seleção de tarefas está marcada.

No menu Selecionar tarefas para executar, pesquise tarefas específicas e selecione as que você quer executar.

A tabela Tarefas lista as tarefas selecionadas. Clique no nome de uma tarefa para abrir diretamente no editor de SQL.

Opcional: configure as seguintes opções de execução:

- Incluir dependências: selecione essa opção para executar as tarefas selecionadas e as dependências delas.

- Incluir dependentes: selecione essa opção para executar as tarefas selecionadas e seus dependentes transitivos downstream.

- Executar com atualização completa: selecione essa opção para recriar todas as tabelas do zero.

- Executar como job interativo com alta prioridade (padrão): selecione essa opção para definir a prioridade do job de consulta do BigQuery. Por padrão, o BigQuery executa consultas como jobs de consulta interativos, que são projetados para começar a ser executados o mais rápido possível. Desmarcar essa opção executa as consultas como jobs de consulta em lote, que têm prioridade mais baixa.

Clique em Executar. Se você selecionou Executar com credenciais do usuário como método de autenticação, autorize sua Conta do Google (prévia).

Opcional: para inspecionar a execução, confira as execuções manuais anteriores.

Executar tarefas com tags selecionadas em um pipeline

Para executar tarefas com tags selecionadas em um pipeline, faça o seguinte:

No console do Google Cloud , acesse a página BigQuery.

No painel à esquerda, clique em Explorer:

Se o painel esquerdo não aparecer, clique em Expandir painel esquerdo para abrir.

No painel Explorer, expanda o projeto, clique em Pipelines e selecione um pipeline.

Clique em Executar > Executar por tag e faça uma destas ações:

- Clique na tag que você quer executar.

- Clique em Selecionar tags para executar.

No painel Executar, na seção Autenticação, autorize a execução com as credenciais de usuário da sua Conta do Google ou de uma conta de serviço.

- Para usar as credenciais de usuário da sua Conta do Google (Prévia), selecione Executar com credenciais de usuário.

Para usar uma conta de serviço personalizada, selecione Executar com a conta de serviço selecionada e escolha uma conta de serviço personalizada.

Se você precisar criar uma conta de serviço, clique em Nova conta de serviço.

Verifique se a opção Seleção de tags está marcada.

No menu Selecionar tags para executar, pesquise tags específicas e selecione as que você quer executar.

A tabela Tarefas lista as tarefas selecionadas. Clique no nome de uma tarefa para abrir diretamente no editor de SQL.

Opcional: configure as seguintes opções de execução:

- Incluir dependências: selecione essa opção para executar as tarefas selecionadas e as dependências delas.

- Incluir dependentes: selecione essa opção para executar as tarefas selecionadas e seus dependentes transitivos downstream.

- Executar com atualização completa: selecione essa opção para recriar todas as tabelas do zero.

- Executar como job interativo com alta prioridade (padrão): selecione essa opção para definir a prioridade do job de consulta do BigQuery. Por padrão, o BigQuery executa consultas como jobs de consulta interativos, que são projetados para começar a ser executados o mais rápido possível. Desmarcar essa opção executa as consultas como jobs de consulta em lote, que têm prioridade mais baixa.

Clique em Executar. Se você selecionou Executar com credenciais do usuário como método de autenticação, autorize sua Conta do Google (prévia).

Opcional: para inspecionar a execução, confira as execuções manuais anteriores.

Autorizar sua Conta do Google

Para autenticar o recurso com suas credenciais de usuário da Conta do Google, conceda permissão manualmente para que os pipelines do BigQuery recebam o token de acesso da sua Conta do Google e acessem os dados de origem em seu nome. É possível conceder aprovação manual com a interface da caixa de diálogo do OAuth.

Você só precisa conceder permissão aos pipelines do BigQuery uma vez.

Para revogar a permissão concedida, siga estas etapas:

- Acesse a página da sua Conta do Google.

- Clique em Pipelines do BigQuery.

- Clique em Remover acesso.

Se o pipeline tiver um notebook, você também precisará conceder manualmente permissão para que o Colab Enterprise receba o token de acesso da sua Conta do Google e acesse os dados de origem em seu nome. Você só precisa dar permissão uma vez. É possível revogar essa permissão na página da Conta do Google.

A seguir

- Saiba mais sobre os pipelines do BigQuery.

- Saiba como gerenciar pipelines.

- Saiba como programar pipelines.