Créer des pipelines

Ce document explique comment créer des pipelines dans BigQuery. Les pipelines sont alimentés par Dataform.

Avant de commencer

- Connectez-vous à votre compte Google Cloud . Si vous débutez sur Google Cloud, créez un compte pour évaluer les performances de nos produits en conditions réelles. Les nouveaux clients bénéficient également de 300 $ de crédits sans frais pour exécuter, tester et déployer des charges de travail.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the BigQuery, Dataform, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the BigQuery, Dataform, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Rôles requis pour les pipelines

Pour obtenir les autorisations nécessaires pour créer des pipelines, demandez à votre administrateur de vous accorder les rôles IAM suivants sur le projet :

-

Pour créer des pipelines :

Créateur de code (

roles/dataform.codeCreator) -

Pour modifier et exécuter des pipelines :

Éditeur Dataform (

roles/dataform.editor)

Pour en savoir plus sur l'attribution de rôles, consultez Gérer l'accès aux projets, aux dossiers et aux organisations.

Vous pouvez également obtenir les autorisations requises avec des rôles personnalisés ou d'autres rôles prédéfinis.

Pour en savoir plus sur IAM pour Dataform, consultez la section Contrôler les accès avec IAM.

Rôles requis pour les options de notebook

Pour obtenir les autorisations nécessaires pour sélectionner un modèle d'environnement d'exécution dans les options du notebook, demandez à votre administrateur de vous accorder le rôle IAM Utilisateur de l'exécution du notebook (roles/aiplatform.notebookRuntimeUser) sur le projet.

Pour en savoir plus sur l'attribution de rôles, consultez Gérer l'accès aux projets, aux dossiers et aux organisations.

Vous pouvez également obtenir les autorisations requises avec des rôles personnalisés ou d'autres rôles prédéfinis.

Si vous ne disposez pas de ce rôle, vous pouvez sélectionner la spécification d'exécution du notebook par défaut.

Définir la région par défaut des composants de code

Tous les nouveaux composants de code de votre projet Google Cloud utilisent une région par défaut. Une fois le composant créé, vous ne pouvez plus modifier sa région.

Pour définir la région par défaut des nouveaux composants de code :

Accédez à la page BigQuery.

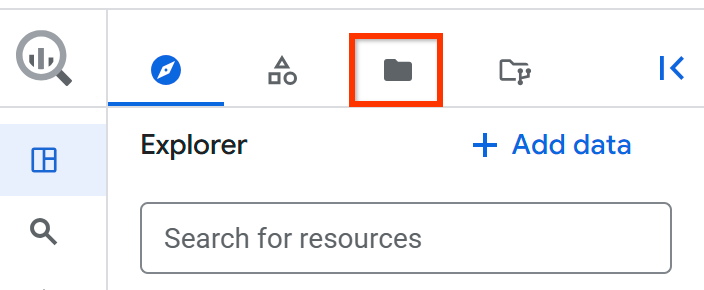

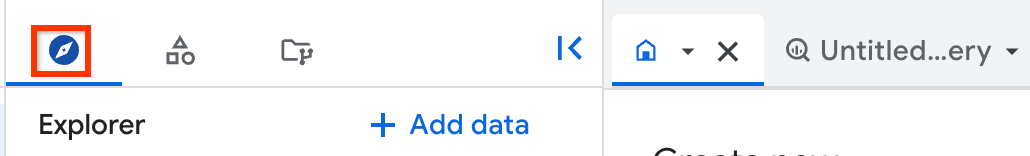

Dans le volet de gauche, cliquez sur Fichiers pour ouvrir l'explorateur de fichiers :

À côté du nom du projet, cliquez sur Afficher les actions du panneau de fichiers > Changer de région de code.

Sélectionnez la région de code que vous souhaitez utiliser par défaut.

Cliquez sur Enregistrer.

Pour obtenir la liste des régions compatibles, consultez Emplacements BigQuery Studio.

Créer un pipeline

Vous pouvez également utiliser la page Pipelines et connexions de BigQuery dans la console Google Cloud pour créer un pipeline Dataform qui utilise un workflow simplifié et spécifique à BigQuery. Cette fonctionnalité est disponible en version preview.

Pour créer un pipeline, procédez comme suit :

Accédez à la page BigQuery.

Dans la barre d'onglets du volet de l'éditeur, cliquez sur la flèche à côté du signe +, puis sur Pipeline.

Facultatif : Pour renommer le pipeline, cliquez sur son nom, puis saisissez un nouveau nom.

Cliquez sur Commencer, puis accédez à l'onglet Paramètres.

Dans la section Authentification, choisissez d'autoriser le pipeline avec les identifiants utilisateur de votre compte Google ou un compte de service.

Pour utiliser les identifiants utilisateur de votre compte Google (Aperçu), sélectionnez Exécuter avec mes identifiants utilisateur.

Pour utiliser un compte de service, sélectionnez Exécuter avec le compte de service sélectionné, puis sélectionnez un compte de service. Si vous devez créer un compte de service, cliquez sur Nouveau compte de service.

Dans la section Emplacement de traitement, sélectionnez un emplacement de traitement pour le pipeline.

Pour activer la sélection automatique d'un emplacement, sélectionnez Sélection automatique de l'emplacement. Cette option sélectionne un emplacement en fonction des ensembles de données référencés dans la requête. Le processus de sélection est le suivant :

- Si votre requête fait référence à des ensembles de données provenant du même emplacement, BigQuery utilise cet emplacement.

- Si votre requête fait référence à des ensembles de données provenant de deux emplacements différents ou plus, une erreur se produit. Pour en savoir plus sur cette limite, consultez Réplication interrégionale d'ensembles de données.

- Si votre requête ne fait référence à aucun ensemble de données, BigQuery utilise par défaut la zone multirégionale

US.

Pour sélectionner une région spécifique, sélectionnez Région, puis choisissez une région dans le menu Région. Vous pouvez également utiliser la variable système

@@locationdans votre requête. Pour en savoir plus, consultez Spécifier des zones.Pour sélectionner un emplacement multirégional, sélectionnez Multirégional, puis choisissez un emplacement multirégional dans le menu Multirégional.

L'emplacement de traitement du pipeline n'a pas besoin de correspondre à votre emplacement de stockage par défaut pour les composants de code.

Options SQLX

Pour configurer les paramètres SQLX de votre pipeline, procédez comme suit dans la section Options SQLX :

Dans le champ Projet par défaut, saisissez le nom d'un projetGoogle Cloud existant. Cette valeur est utilisée pour

defaultProjectdans le fichierworkflow_settings.yamlet pourdefaultDatabasedans le fichierdataform.json. Le projet par défaut est utilisé par les tâches de pipeline lors de leur exécution.Facultatif : Dans le champ Ensemble de données par défaut, recherchez et sélectionnez un ensemble de données existant. La liste des ensembles de données disponibles est filtrée en fonction du projet et de l'emplacement de traitement sélectionnés. Cette valeur est utilisée pour

defaultDatasetdans le fichierworkflow_settings.yaml. L'ensemble de données par défaut est utilisé par les tâches du pipeline lors de leur exécution.

Options du notebook

Pour ajouter un notebook à votre pipeline, procédez comme suit dans la section Options du notebook :

Dans le champ Modèle d'environnement d'exécution, acceptez l'environnement d'exécution de notebook par défaut, ou recherchez et sélectionnez un environnement d'exécution existant.

- Pour afficher les spécifications du runtime par défaut, cliquez sur la flèche à côté.

- Pour créer un environnement d'exécution, consultez Créer un modèle d'exécution.

Dans le champ Bucket Cloud Storage, cliquez sur Parcourir, puis sélectionnez ou créez un bucket Cloud Storage pour stocker la sortie des notebooks dans votre pipeline.

Suivez la procédure décrite dans Ajouter un compte principal à une stratégie au niveau du bucket pour ajouter votre compte de service Dataform personnalisé en tant que compte principal au bucket Cloud Storage que vous prévoyez d'utiliser pour stocker le résultat des exécutions de pipeline programmées, et attribuer le rôle Administrateur de l'espace de stockage (

roles/storage.admin) à ce compte principal.Le compte de service Dataform personnalisé sélectionné doit disposer du rôle IAM "Administrateur de stockage" sur le bucket sélectionné.

Ajouter une tâche de pipeline

Pour ajouter une tâche à un pipeline, procédez comme suit :

Dans la console Google Cloud , accédez à la page BigQuery.

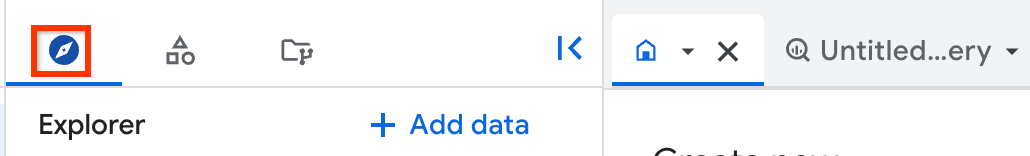

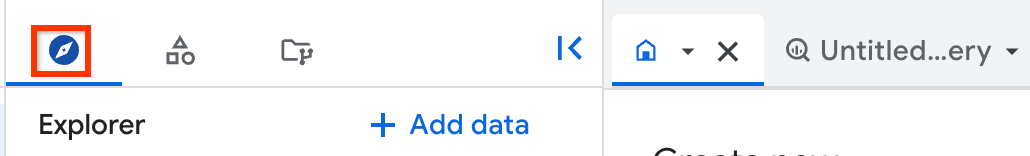

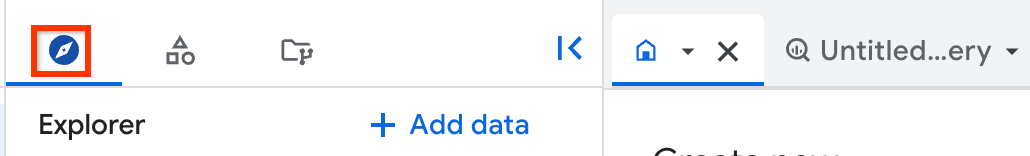

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Pour ajouter un composant code, sélectionnez l'une des options suivantes :

Requête SQL

Cliquez sur Ajouter une tâche, puis sélectionnez Requête. Vous pouvez créer une requête ou en importer une.

Facultatif : Dans le volet Détails de la tâche de requête, dans le menu Exécuter après, sélectionnez une tâche qui précèdera votre requête.

Créer une requête

Cliquez sur le menu déroulant à côté de Modifier la requête, puis sélectionnez Dans le contexte ou Dans un nouvel onglet.

Recherchez une requête existante.

Sélectionnez un nom de requête, puis appuyez sur Entrée.

Cliquez sur Enregistrer.

Facultatif : Pour renommer la requête, cliquez sur son nom dans le volet "Pipeline", puis sur Modifier la requête. Cliquez ensuite sur le nom de la requête existante en haut de l'écran, puis saisissez un nouveau nom.

Importer une requête existante

Cliquez sur le menu déroulant à côté de Modifier la requête, puis sur Importer une copie.

Recherchez une requête existante à importer ou sélectionnez-en une dans le volet de recherche. Lorsque vous importez une requête, l'original reste inchangé, car le fichier source de la requête est copié dans le pipeline.

Cliquez sur Modifier pour ouvrir la requête importée.

Cliquez sur Enregistrer.

Notebook

Cliquez sur Ajouter une tâche, puis sélectionnez Notebook. Vous pouvez créer un notebook ou en importer un existant. Pour modifier les paramètres des modèles d'exécution de notebooks, consultez Options des notebooks.

Facultatif : Dans le volet Détails de la tâche de notebook, dans le menu Exécuter après, sélectionnez une tâche qui précèdera votre notebook.

Créer un notebook

Cliquez sur le menu déroulant à côté de Modifier le notebook, puis sélectionnez Dans le contexte ou Dans un nouvel onglet.

Recherchez un notebook existant.

Sélectionnez le nom d'un notebook, puis appuyez sur Entrée.

Cliquez sur Enregistrer.

Facultatif : Pour renommer le notebook, cliquez sur son nom dans le volet "Pipeline", puis sur Modifier le notebook. Cliquez ensuite sur le nom du notebook existant en haut de l'écran, puis saisissez un nouveau nom.

Importer un notebook existant

Cliquez sur le menu déroulant à côté de Modifier le notebook, puis sur Importer une copie.

Recherchez un notebook existant à importer ou sélectionnez-en un dans le volet de recherche. Lorsque vous importez un notebook, l'original reste inchangé, car le fichier source du notebook est copié dans le pipeline.

Pour ouvrir le notebook importé, cliquez sur Modifier.

Cliquez sur Enregistrer.

Préparation des données

Cliquez sur Ajouter une tâche, puis sélectionnez Préparation des données. Vous pouvez créer une préparation de données ou en importer une.

Facultatif : Dans le volet Détails de la tâche de préparation des données, dans le menu Exécuter après, sélectionnez une tâche qui précèdera la préparation de vos données.

Créer une préparation des données

Cliquez sur le menu déroulant à côté de Modifier la préparation des données, puis sélectionnez Dans le contexte ou Dans un nouvel onglet.

Recherchez une préparation de données existante.

Sélectionnez un nom de préparation des données, puis appuyez sur Entrée.

Cliquez sur Enregistrer.

Facultatif : Pour renommer la préparation des données, cliquez sur son nom dans le volet "Pipeline", puis sur Modifier la préparation des données. Cliquez ensuite sur le nom en haut de l'écran et saisissez-en un nouveau.

Importer une préparation de données existante

Cliquez sur le menu déroulant à côté de Modifier la préparation des données, puis sur Importer une copie.

Recherchez une préparation de données existante à importer ou sélectionnez-en une dans le volet de recherche. Lorsque vous importez une préparation de données, l'original reste inchangé, car le fichier source de la préparation de données est copié dans le pipeline.

Pour ouvrir la préparation des données importées, cliquez sur Modifier.

Cliquez sur Enregistrer.

Table

Cliquez sur Ajouter une tâche, puis sélectionnez Table.

Dans le volet Créer, sélectionnez Table ou Table incrémentielle.

Vérifiez le projet par défaut de la table ou sélectionnez-en un autre.

Vérifiez l'ensemble de données par défaut pour la table ou sélectionnez-en un autre.

Saisissez un nom pour la table.

Dans le volet Détails de la tâche de tableau, cliquez sur Ouvrir pour ouvrir la tâche.

Configurez la tâche à l'aide des paramètres de Détails > Configuration ou dans le bloc

configde l'éditeur de code pour le tableau.Pour les modifications de métadonnées, utilisez l'onglet Configuration. Cet onglet vous permet de modifier une valeur spécifique dans le bloc

configde l'éditeur de code, telle qu'une chaîne ou un tableau, qui est formatée comme un objet JavaScript. Cet onglet vous permet d'éviter les erreurs de syntaxe et de vérifier que vos paramètres sont corrects.Facultatif : Dans le menu Exécuter après, sélectionnez une tâche qui précèdera votre tableau.

Vous pouvez également définir les métadonnées de la tâche de votre pipeline dans le bloc

configde l'éditeur. Pour en savoir plus, consultez Créer des tables.L'éditeur valide votre code et affiche l'état de validation.

Dans Détails > Requêtes compilées, consultez le code SQL compilé à partir du code SQLX.

Cliquez sur Exécuter pour exécuter le code SQL dans votre pipeline.

Dans Résultats de la requête, examinez l'aperçu des données.

Afficher

Cliquez sur Ajouter une tâche, puis sélectionnez Vue.

Dans le volet Créer, sélectionnez Vue ou Vue matérialisée.

Vérifiez le projet par défaut de la vue ou sélectionnez-en un autre.

Vérifiez l'ensemble de données par défaut pour la vue ou sélectionnez-en un autre.

Saisissez un nom pour la vue.

Dans le volet Afficher les détails de la tâche, cliquez sur Ouvrir pour ouvrir la tâche.

Configurez la tâche à l'aide des paramètres de Détails > Configuration ou dans le bloc

configde l'éditeur de code pour la vue.Pour les modifications de métadonnées, utilisez l'onglet Configuration. Cet onglet vous permet de modifier une valeur spécifique dans le bloc

configde l'éditeur de code, telle qu'une chaîne ou un tableau, qui est formatée comme un objet JavaScript. Cet onglet vous permet d'éviter les erreurs de syntaxe et de vérifier que vos paramètres sont corrects.Facultatif : Dans le menu Exécuter après, sélectionnez une tâche qui précédera votre vue.

Vous pouvez également définir les métadonnées de la tâche de votre pipeline dans le bloc

configde l'éditeur. Pour en savoir plus, consultez Créer une vue avec Dataform Core.L'éditeur valide votre code et affiche l'état de validation.

Dans Détails > Requêtes compilées, consultez le code SQL compilé à partir du code SQLX.

Cliquez sur Exécuter pour exécuter le code SQL dans votre pipeline.

Dans Résultats de la requête, examinez l'aperçu des données.

Modifier une tâche de pipeline

Pour modifier une tâche de pipeline, procédez comme suit :

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Cliquez sur la tâche sélectionnée.

Pour modifier la tâche précédente, dans le menu Exécuter après, sélectionnez une tâche qui précèdera votre tâche.

Pour modifier le contenu de la tâche sélectionnée, cliquez sur Modifier.

Dans le nouvel onglet qui s'ouvre, modifiez le contenu de la tâche, puis enregistrez les modifications apportées à la tâche.

Supprimer une tâche de pipeline

Pour supprimer une tâche d'un pipeline, procédez comme suit :

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Cliquez sur la tâche sélectionnée.

Dans le volet Détails de la tâche, cliquez sur Supprimer Supprimer.

Partager un pipeline

Pour partager un pipeline, procédez comme suit :

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Cliquez sur Partager, puis sélectionnez Gérer les autorisations.

Cliquez sur Ajouter un utilisateur/groupe.

Dans le champ Nouveaux comptes principaux, saisissez le nom d'au moins un utilisateur ou groupe.

Pour Attribuer des rôles, sélectionnez un rôle.

Cliquez sur Enregistrer.

Partager un lien vers un pipeline

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Cliquez sur Partager, puis sélectionnez Partager le lien. L'URL de votre pipeline est copiée dans le presse-papiers de votre ordinateur.

Exécuter un pipeline

Lorsque vous exécutez un pipeline, vous pouvez choisir d'exécuter toutes les tâches du pipeline, de sélectionner manuellement des tâches spécifiques à exécuter ou d'exécuter des tâches avec des tags sélectionnés.

Exécuter toutes les tâches d'un pipeline

Pour exécuter manuellement la version actuelle d'un pipeline, sélectionnez l'une des options suivantes :

Console

Pour exécuter toutes les tâches d'un pipeline :

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Cliquez sur Run (Exécuter) > Run all tasks (Exécuter toutes les tâches). Si vous avez sélectionné Exécuter avec mes identifiants utilisateur pour votre authentification, vous devez autoriser votre compte Google (aperçu).

Facultatif : Pour inspecter l'exécution, affichez les exécutions manuelles précédentes.

API

Pour exécuter un pipeline manuellement, compilez l'espace de travail par défaut et utilisez le résultat de la compilation pour créer un appel de workflow.

Pour créer un résultat de compilation pour l'espace de travail par défaut, utilisez la méthode

projects.locations.repositories.compilationResults.create.Exécutez la requête API avec les informations suivantes :

curl -X POST \ -H "Authorization: Bearer $(gcloud auth print-access-token)" \ -H "Content-Type: application/json" \ -d '{ "workspace": "projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/workspaces/default" }' \ "https://dataform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/compilationResults"Remplacez les éléments suivants :

LOCATION: région Google Cloud de votre dépôt, par exempleus-central1. Pour trouver l'emplacement du dépôt dans la console Google Cloud , accédez au volet Explorateur, sélectionnez le pipeline, ouvrez l'onglet Paramètres, puis cliquez sur Ouvrir le pipeline dans Dataform. L'emplacement figure dans l'URL au format/locations/LOCATION/.PROJECT_ID: identifiant unique de votre projetGoogle Cloud .REPOSITORY_ID: identifiant unique de votre dépôt Dataform, par exemplemy-secure-repo. Vous trouverez l'ID du dépôt dans la console Google Cloud . Pour ce faire, accédez au volet Explorateur, sélectionnez le pipeline, ouvrez l'onglet Paramètres, puis consultez le champ ID du dépôt Dataform.

Dans le corps de la réponse, recherchez le champ

nameet copiez sa valeur (par exemple,projects/my-project/locations/us-central1/repositories/my-repo/compilationResults/12345-67890).Déclenchez l'exécution du pipeline à l'aide de la méthode

projects.locations.repositories.workflowInvocations.create.Exécutez la requête API avec les informations suivantes :

curl -X POST \ -H "Authorization: Bearer $(gcloud auth print-access-token)" \ -H "Content-Type: application/json" \ -d '{ "compilationResult": "COMPILATION_RESULT" }' \ "https://dataform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/repositories/REPOSITORY_ID/workflowInvocations"Remplacez les éléments suivants :

COMPILATION_RESULT: nom complet de la ressource du résultat de la compilation que vous avez copié à l'étape précédente.LOCATION: région Google Cloud de votre dépôt, par exempleus-central1.PROJECT_ID: identifiant unique de votre projetGoogle Cloud .REPOSITORY_ID: identifiant unique de votre dépôt Dataform, par exemplemy-secure-repo.

Exécuter des tâches sélectionnées dans un pipeline

Pour exécuter des tâches sélectionnées dans un pipeline :

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Cliquez sur Exécuter > Sélectionner les tâches à exécuter.

Dans le volet Exécuter, dans la section Authentification, autorisez l'exécution avec les identifiants utilisateur de votre compte Google ou d'un compte de service.

- Pour utiliser les identifiants de votre compte Google (Aperçu), sélectionnez Exécuter avec les identifiants utilisateur.

Pour utiliser un compte de service personnalisé, sélectionnez Exécuter avec le compte de service sélectionné, puis sélectionnez un compte de service personnalisé.

Si vous devez créer un compte de service, cliquez sur Nouveau compte de service.

Assurez-vous que l'option Sélection de tâches est sélectionnée.

Dans le menu Sélectionner les tâches à exécuter, recherchez des tâches spécifiques et sélectionnez celles que vous souhaitez exécuter.

Le tableau Tâches liste les tâches que vous avez sélectionnées. Cliquez sur le nom d'une tâche pour l'ouvrir directement dans l'éditeur SQL.

Facultatif : Configurez les options d'exécution suivantes :

- Inclure les dépendances : sélectionnez cette option pour exécuter les tâches sélectionnées et leurs dépendances.

- Inclure les dépendants : sélectionnez cette option pour exécuter les tâches sélectionnées et leurs dépendants transitifs en aval.

- Exécuter avec une actualisation complète : sélectionnez cette option pour reconstruire toutes les tables à partir de zéro.

- Exécuter en tant que job interactif avec une priorité élevée (par défaut) : sélectionnez cette option pour définir la priorité du job de requête BigQuery. Par défaut, BigQuery exécute les requêtes en tant que jobs de requête interactifs, qui sont censés commencer à s'exécuter le plus rapidement possible. Si vous décochez cette option, les requêtes seront exécutées en tant que jobs de requête par lot, qui ont une priorité inférieure.

Cliquez sur Exécuter. Si vous avez sélectionné Exécuter avec les identifiants utilisateur comme méthode d'authentification, vous devez autoriser votre compte Google (Aperçu).

Facultatif : Pour inspecter l'exécution, affichez les exécutions manuelles précédentes.

Exécuter des tâches avec des tags sélectionnés dans un pipeline

Pour exécuter des tâches avec des tags sélectionnés dans un pipeline :

Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet de gauche, cliquez sur Explorateur :

Si le volet de gauche n'apparaît pas, cliquez sur Développer le volet de gauche pour l'ouvrir.

Dans le volet Explorateur, développez votre projet, cliquez sur Pipelines, puis sélectionnez un pipeline.

Cliquez sur Run > Run by tag (Exécuter > Exécuter par tag), puis effectuez l'une des opérations suivantes :

- Cliquez sur un tag que vous souhaitez exécuter.

- Cliquez sur Sélectionner les tags à exécuter.

Dans le volet Exécuter, dans la section Authentification, autorisez l'exécution avec les identifiants utilisateur de votre compte Google ou d'un compte de service.

- Pour utiliser les identifiants de votre compte Google (Aperçu), sélectionnez Exécuter avec les identifiants utilisateur.

Pour utiliser un compte de service personnalisé, sélectionnez Exécuter avec le compte de service sélectionné, puis sélectionnez un compte de service personnalisé.

Si vous devez créer un compte de service, cliquez sur Nouveau compte de service.

Assurez-vous que l'option Sélection de balises est sélectionnée.

Dans le menu Sélectionner les tags à exécuter, recherchez des tags spécifiques et sélectionnez ceux que vous souhaitez exécuter.

Le tableau Tâches liste les tâches que vous avez sélectionnées. Cliquez sur le nom d'une tâche pour l'ouvrir directement dans l'éditeur SQL.

Facultatif : Configurez les options d'exécution suivantes :

- Inclure les dépendances : sélectionnez cette option pour exécuter les tâches sélectionnées et leurs dépendances.

- Inclure les dépendants : sélectionnez cette option pour exécuter les tâches sélectionnées et leurs dépendants transitifs en aval.

- Exécuter avec une actualisation complète : sélectionnez cette option pour reconstruire toutes les tables à partir de zéro.

- Exécuter en tant que job interactif avec une priorité élevée (par défaut) : sélectionnez cette option pour définir la priorité du job de requête BigQuery. Par défaut, BigQuery exécute les requêtes en tant que jobs de requête interactifs, qui sont censés commencer à s'exécuter le plus rapidement possible. Si vous décochez cette option, les requêtes seront exécutées en tant que jobs de requête par lot, qui ont une priorité inférieure.

Cliquez sur Exécuter. Si vous avez sélectionné Exécuter avec les identifiants utilisateur comme méthode d'authentification, vous devez autoriser votre compte Google (Aperçu).

Facultatif : Pour inspecter l'exécution, affichez les exécutions manuelles précédentes.

Autoriser votre compte Google

Pour authentifier la ressource avec vos identifiants de compte utilisateur Google, vous devez accorder manuellement l'autorisation aux pipelines BigQuery pour obtenir le jeton d'accès à votre compte Google et accéder aux données sources en votre nom. Vous pouvez accorder une approbation manuelle à l'aide de l'interface de la boîte de dialogue OAuth.

Vous n'avez besoin d'accorder l'autorisation aux pipelines BigQuery qu'une seule fois.

Pour révoquer l'autorisation que vous avez accordée, procédez comme suit :

- Accédez à la page de votre compte Google.

- Cliquez sur Pipelines BigQuery.

- Cliquez sur Supprimer l'accès.

Si votre pipeline contient un notebook, vous devez également accorder manuellement l'autorisation à Colab Enterprise pour obtenir le jeton d'accès à votre compte Google et accéder aux données sources en votre nom. Vous n'avez besoin d'accorder l'autorisation qu'une seule fois. Vous pouvez révoquer cette autorisation sur la page de votre compte Google.

Étapes suivantes

- En savoir plus sur les pipelines BigQuery

- Découvrez comment gérer les pipelines.

- Découvrez comment planifier des pipelines.