במדריך הזה למתחילים נסביר על טכנולוגיות הליבה של AI גנרטיבי ואיך הן משתלבות זו בזו כדי להפעיל צ'אטבוטים ואפליקציות. AI גנרטיבי (נקרא גם AI גנרטיבי או AI גנרטיבי) הוא תחום בלמידת מכונה (ML) שבו מפתחים מודלים של ML ומשתמשים בהם כדי ליצור תוכן חדש.

מודלים של בינה מלאכותית גנרטיבית נקראים לעיתים קרובות מודלים גדולים של שפה (LLM) בגלל הגודל שלהם והיכולת שלהם להבין וליצור שפה טבעית. עם זאת, בהתאם לנתונים שעליהם המודלים מתאמנים, הם יכולים להבין וליצור תוכן ממגוון קטגוריות, כולל טקסט, תמונות, סרטונים ואודיו. מודלים שעובדים עם כמה אופנים של נתונים נקראים מודלים מולטימודאליים.

Google מספקת את משפחת המודלים של Gemini, מודלים של AI גנרטיבי שנועדו לתרחישי שימוש מולטימודאליים. המודלים האלה מסוגלים לעבד מידע ממודאליות שונות, כולל תמונות, סרטונים וטקסט.

יצירת תוכן

כדי שמודלים של AI גנרטיבי יוכלו ליצור תוכן שימושי ביישומים בעולם האמיתי, הם צריכים להיות בעלי היכולות הבאות:

איך מבצעים משימות חדשות:

מודלים של AI גנרטיבי מיועדים לביצוע משימות כלליות. אם רוצים שמודל יבצע משימות שייחודיות לתרחיש השימוש שלכם, צריך להיות אפשר להתאים אישית את המודל. ב-Vertex AI, אפשר להתאים אישית את המודל באמצעות כוונון המודל.

גישה למידע חיצוני:

מודלים של AI גנרטיבי עוברים אימון על כמויות עצומות של נתונים. עם זאת, כדי שהמודלים האלה יהיו שימושיים, הם צריכים להיות מסוגלים לגשת למידע שלא נכלל בנתוני האימון שלהם. לדוגמה, אם רוצים ליצור צ'אטבוט לשירות לקוחות שמבוסס על מודל AI גנרטיבי, המודל צריך לקבל גישה למידע על המוצרים והשירותים שאתם מציעים. ב-Vertex AI, משתמשים בתכונות 'הארקה' ו'הפעלת פונקציות' כדי לעזור למודל לגשת למידע חיצוני.

חסימת תוכן פוגעני:

מודלים של AI גנרטיבי עשויים ליצור פלט לא צפוי, כולל טקסט פוגעני או חסר רגישות. כדי לשמור על הבטיחות ולמנוע שימוש לרעה, המודלים צריכים מסנני בטיחות שיחסמו הנחיות ותשובות שזוהו כפוטנציאל לתוכן מזיק. ל-Vertex AI יש תכונות בטיחות מובנות שמקדמות שימוש אחראי בשירותי ה-AI הגנרטיבי שלנו.

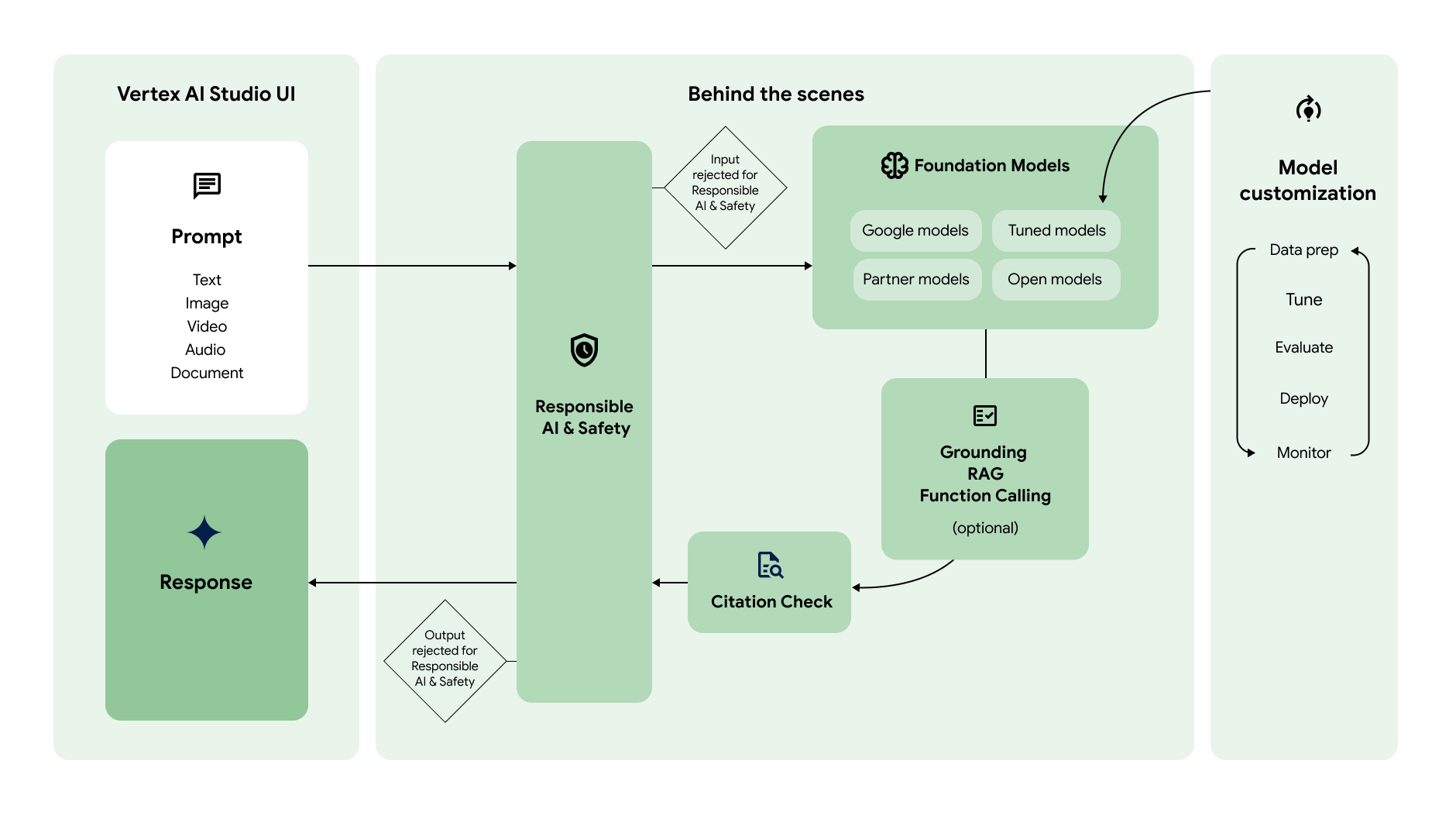

בתרשים הבא מוצג איך היכולות השונות האלה פועלות יחד כדי ליצור את התוכן הרצוי:

הנחיה

|

|

תהליך העבודה של AI גנרטיבי מתחיל בדרך כלל בהזנת הנחיה. הנחיה היא בקשה בשפה טבעית שנשלחת למודל AI גנרטיבי כדי לקבל ממנו תגובה. בהתאם למודל, ההנחיה יכולה להכיל טקסט, תמונות, סרטונים, אודיו, מסמכים וקטגוריות אחרות, או אפילו כמה קטגוריות (מולטי-מודאליות). יצירת הנחיה כדי לקבל מהמודל את התשובה הרצויה נקראת עיצוב הנחיות. עיצוב הנחיות הוא תהליך של ניסוי וטעייה, אבל יש עקרונות ואסטרטגיות לעיצוב הנחיות שבעזרתם אפשר להכווין את המודל להתנהג בצורה הרצויה. ב-Vertex AI Studio יש כלי לניהול הנחיות שעוזר לכם לנהל את ההנחיות. |

למודלים בסיסיים

|

|

ההנחיות נשלחות למודל AI גנרטיבי כדי ליצור תשובה. ב-Vertex AI יש מגוון מודלים בסיסיים של AI גנרטיבי שאפשר לגשת אליהם באמצעות API מנוהל, כולל המודלים הבאים:

ההבדלים בין המודלים הם בגודל, בשיטת הפעולה ובעלות. ב-Model Garden תוכלו לעיין במודלים של Google, במודלים פתוחים ובמודלים של שותפי Google. |

התאמה אישית של מודלים

|

|

אתם יכולים להתאים אישית את התנהגות ברירת המחדל של מודלים בסיסיים של Google כדי ליצור באופן עקבי את התוצאות הרצויות בלי להשתמש בהנחיות מורכבות. תהליך ההתאמה האישית הזה נקרא שיפור המודל. התאמת המודל עוזרת לצמצם את העלות ואת זמן האחזור של הבקשות, כי היא מאפשרת לכם לפשט את ההנחיות. Vertex AI מציע גם כלים להערכת מודלים שיעזרו לכם להעריך את הביצועים של המודל שעבר התאמה. אחרי שהמודל המכוונן מוכן להטמעה בסביבת הייצור, אפשר לפרוס אותו לנקודת קצה ולעקוב אחרי הביצועים שלו, כמו בתהליכי עבודה רגילים של MLOps. |

גישה למידע חיצוני

|

|

ב-Vertex AI יש כמה דרכים לתת למודל גישה לממשקי API חיצוניים ולמידע בזמן אמת.

|

בדיקת ציטוטים

|

|

אחרי שהתשובה נוצרת, מערכת Vertex AI בודקת אם צריך לכלול ציטוטים בתשובה. אם חלק משמעותי מהטקסט בתשובה מגיע ממקור מסוים, המקור הזה יתווסף למטא-נתונים של הציטוט בתשובה. |

אתיקה של בינה מלאכותית ובטיחות

|

|

השכבה האחרונה של הבדיקות שההנחיה והתשובה עוברות לפני שהן מוחזרות היא מסנני הבטיחות. Vertex AI בודק את ההנחיה ואת התשובה כדי לראות עד כמה ההנחיה או התשובה שייכות לקטגוריית בטיחות. אם הסף נחצה בקטגוריה אחת או יותר, התשובה נחסמת ו-Vertex AI מחזיר תשובה חלופית. |

תשובה

|

|

אם ההנחיה והתגובה עוברות את הבדיקות של מסנן הבטיחות, התגובה מוחזרת. בדרך כלל, התשובה מוחזרת בבת אחת. עם זאת, ב-Vertex AI אפשר גם לקבל תשובות באופן הדרגתי בזמן שהן נוצרות, על ידי הפעלת סטרימינג. |

קדימה, מתחילים

כדי להתחיל להשתמש ב-AI גנרטיבי ב-Vertex AI, אפשר לנסות את אחד ממדריכי ההתחלה המהירים האלה:

- יצירת טקסט באמצעות Vertex AI Gemini API: שימוש ב-SDK לשליחת בקשות אל Vertex AI Gemini API

- שליחת הנחיות ל-Gemini באמצעות גלריית ההנחיות של Vertex AI Studio: בדיקת הנחיות ללא צורך בהגדרה

- יצירת תמונה ואימות סימן המים שלה באמצעות Imagen: יצירת תמונה עם סימן מים באמצעות Imagen ב-Vertex AI ב-Vertex AI