Usar o agente de engenharia de dados para criar e modificar pipelines de dados

Este documento mostra como usar o Agente de engenharia de dados no BigQuery e no Dataform para criar e modificar pipelines de dados.

Com o agente de engenharia de dados, é possível criar, modificar e gerenciar pipelines de dados para carregar e processar dados no BigQuery. Com o agente de engenharia de dados, é possível usar comandos em linguagem natural para gerar pipelines de dados de várias fontes ou adaptar pipelines atuais às suas necessidades de engenharia de dados.

O agente gera e organiza o código do pipeline de dados diretamente nos repositórios do Dataform. O agente opera no espaço de trabalho do Dataform, então os pipelines do Dataform ficam disponíveis automaticamente para ele.

Para mais exemplos de comandos que podem ser usados com o Data Engineering Agent, consulte Exemplos de comandos.

Você também pode usar a API Data Engineering Agent, que usa o protocolo A2A, para interagir com o agente.

Limitações

O agente de engenharia de dados tem as seguintes limitações:

- O Agente de engenharia de dados não é compatível com comandos em linguagem natural para os seguintes tipos de arquivo:

- Notebooks

- Preparação de dados

- O agente de engenharia de dados não pode executar pipelines. Você precisa revisar e executar ou programar pipelines.

- O agente de engenharia de dados não pode pesquisar links da Web ou URLs fornecidos por instruções ou comandos diretos.

- Ao importar arquivos em um arquivo de instruções do agente, a sintaxe de importação

@aceita apenas caminhos que começam com./,/ou uma letra. - O recurso prévia dos dados só é compatível com tabelas, declarações ou consultas em que a flag

hasOutputestá definida comotrue. - O agente de engenharia de dados está sujeito às limitações gerais da tecnologia de IA.

- Ao criar pipelines em tabelas externas do Apache Iceberg gerenciadas pelo catálogo do ambiente de execução do Lakehouse (antigo metastore do BigLake), todas as limitações do catálogo do ambiente de execução do Lakehouse se aplicam. Principalmente, o agente não pode gerar mutações de gravação (como

INSERT,UPDATE,DELETEouMERGE) nem instruções DDL (comoCREATE TABLEouDROP TABLE) em tabelas do Iceberg. Para mais informações, consulte Conceitos de endpoint do catálogo REST do Apache Iceberg.

Antes de começar

Antes de usar o agente de engenharia de dados, siga as etapas desta seção.

Ativar o Gemini no BigQuery

Verifique se o Gemini no BigQuery está ativado para seu projetoGoogle Cloud . Para mais informações, consulte Configurar o Gemini no BigQuery.

Ative as APIs necessárias

Console

Ative as seguintes APIs no console do Google Cloud para o projeto Google Cloud que você usa com a API Conversational Analytics.

Ativar a API Gemini Data Analytics

gcloud

Para ativar a API Gemini Data Analytics, a API Gemini para Google Cloud

e a API BigQuery, use a Google Cloud CLI

e execute os seguintes comandos gcloud

services enable:

gcloud services enable geminidataanalytics.googleapis.com --project=PROJECT_ID gcloud services enable cloudaicompanion.googleapis.com --project=PROJECT_ID gcloud services enable bigquery.googleapis.com --project=PROJECT_ID

Substitua PROJECT_ID pelo ID do projeto Google Cloud .

Funções exigidas

Para receber a permissão necessária para usar o agente de engenharia de dados, peça ao administrador para conceder a você os seguintes papéis do IAM no projeto:

- Editor de código do Dataform (

roles/dataform.codeEditor) - Usuário de jobs do BigQuery (

roles/bigquery.jobUser) - Usuário de chat sem estado do Gemini Data Analytics (

roles/geminidataanalytics.dataAgentStatelessUser)

Para mais informações sobre a concessão de papéis, consulte Gerenciar o acesso a projetos, pastas e organizações.

Esse papel predefinido contém a

permissão

geminidataanalytics.locations.useDataEngineeringAgent,

que é necessária para

usar o agente de engenharia de dados.

Também é possível receber essa permissão com papéis personalizados ou outros papéis predefinidos.

Para detalhes sobre os papéis necessários para consultar tabelas do Apache Iceberg, consulte Papéis necessários para o suporte do Apache Iceberg do Lakehouse.

Pré-requisitos da integração do Knowledge Catalog

Para receber a permissão necessária

para integrar o agente de engenharia de dados ao Knowledge Catalog,

peça ao administrador para conceder a você o papel do IAM

Editor do catálogo do Dataplex (roles/dataplex.catalogEditor) no projeto.

Para mais informações sobre a concessão de papéis, consulte Gerenciar o acesso a projetos, pastas e organizações.

Esse papel predefinido contém a permissão

geminidataanalytics.locations.useDataEngineeringAgent,

que é necessária para

integrar o agente de engenharia de dados ao Knowledge Catalog.

Também é possível receber essa permissão com papéis personalizados ou outros papéis predefinidos.

Também é necessário ativar a API Knowledge Catalog.

Criptografar dados com chaves do Cloud Key Management Service

É possível criptografar dados no nível do conjunto de dados ou do projeto com as chaves padrão do Cloud Key Management Service gerenciadas pelo cliente no BigQuery. Para mais informações, consulte Definir uma chave padrão de conjunto de dados e Definir uma chave padrão de projeto.

É possível criptografar o código do pipeline no nível do projeto definindo uma chave padrão do Cloud Key Management Service do Dataform.

Configurar perímetros do VPC Service Controls

Se você usa o VPC Service Controls, configure o perímetro para proteger o Dataform, o BigQuery e a API Conversational Analytics. Para mais informações, consulte Dataform, BigQuery e API Conversational Analytics.

Gerar um pipeline de dados com o agente de engenharia de dados

Para usar o agente de engenharia de dados no BigQuery, selecione uma das seguintes opções:

Pipelines do BigQuery

Para usar o agente de engenharia de dados na interface dos pipelines do BigQuery, faça o seguinte:

Acessar a página do BigQuery.

No editor de consultas, clique em arrow_drop_down Criar novo > Pipeline.

Selecione uma opção para as credenciais de execução e clique em Começar. Essas credenciais não são usadas pelo agente, mas são necessárias para executar o pipeline de dados gerado.

Clique em Testar a experiência do agente para o pipeline de dados.

No campo Perguntar ao agente, insira um comando em linguagem natural para gerar um pipeline de dados. Por exemplo:

Create dimension tables for a taxi trips star schema from new_york_taxi_trips.tlc_green_trips_2022. Generate surrogate keys and all the descriptive attributes.Depois de inserir um comando, clique em Enviar.

O agente de engenharia de dados gera um pipeline de dados com base no seu comando.

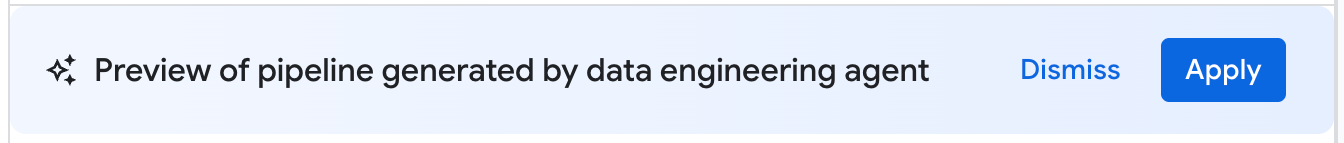

O agente de engenharia de dados gera um rascunho proposto de um pipeline de dados. Clique em um nó de pipeline para analisar a consulta SQLX gerada. Para aplicar o pipeline de dados sugerido pelo agente, clique em Aplicar.

Dataform

Para usar o Agente de engenharia de dados no Dataform, faça o seguinte:

Acesse Dataform.

Selecione um repositório.

Selecione ou crie um espaço de trabalho de desenvolvimento.

No espaço de trabalho, clique em Perguntar ao agente.

No comando Perguntar ao agente que aparece, insira um comando em linguagem natural para gerar um pipeline de dados. Por exemplo:

Create dimension tables for a taxi trips star schema from new_york_taxi_trips.tlc_green_trips_2022. Generate surrogate keys and all the descriptive attributes.Depois de inserir um comando, clique em Enviar.

Depois que o comando é enviado, o agente de engenharia de dados gera um pipeline de dados e modifica os arquivos SQLX do Dataform com base no comando. O agente aplica essas mudanças diretamente aos arquivos do espaço de trabalho.

Editar um pipeline de dados

Para editar seu pipeline de dados, clique em Perguntar ao agente e insira um comando que sugira uma mudança no pipeline.

Revise as mudanças propostas pelo agente de engenharia de dados e clique em Aplicar.

Também é possível editar uma consulta SQLX manualmente. Para isso, selecione um nó de pipeline e clique em Abrir.

Analisar um pipeline de dados

Clique em um nó de pipeline em um pipeline de dados gerado pelo agente de engenharia de dados para analisá-lo.

- A guia Configuração mostra a consulta SQLX gerada associada ao nó.

- A guia Visualização de dados mostra a tabela de entrada e saída do arquivo. Para visualizar a transformação de dados por esse nó, clique em Executar tarefa com ou sem dependências.

Resolver erros de pipeline de dados

Se você encontrar erros durante a geração do pipeline de dados, verifique se concluiu todos os pré-requisitos para executar o agente de engenharia de dados. Para mais informações, consulte Antes de começar.

Executar uma investigação do Gemini Cloud Assist

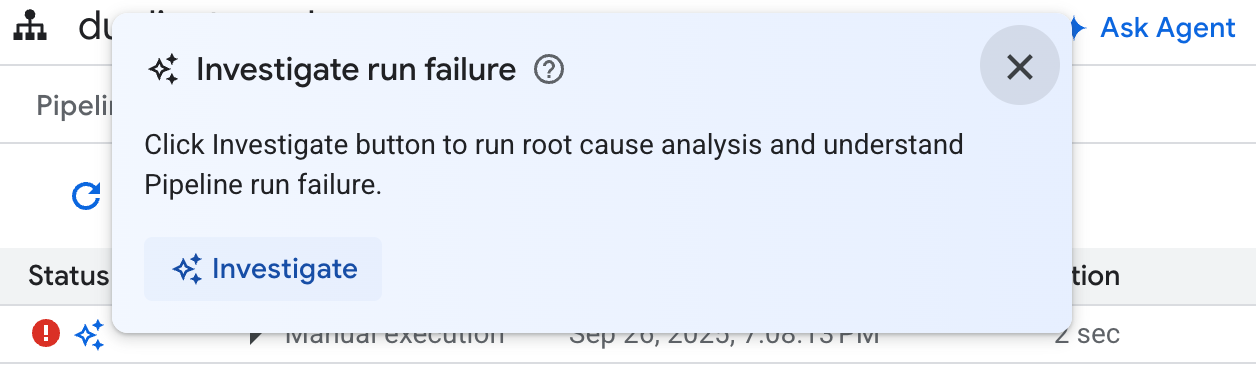

Para mais informações sobre a solução de problemas do pipeline, use o agente de engenharia de dados para executar uma análise de causa raiz e sugerir recomendações de solução de problemas.

Esse recurso usa investigações do Gemini Cloud Assist (pré-lançamento) e está disponível apenas para usuários com um contrato de suporte Premium. Para mais informações sobre como ativar as investigações do Gemini Cloud Assist, consulte Resolver problemas com as investigações do Gemini Cloud Assist.

Use o agente de engenharia de dados para resolver problemas de erros de pipeline de dados com as seguintes etapas:

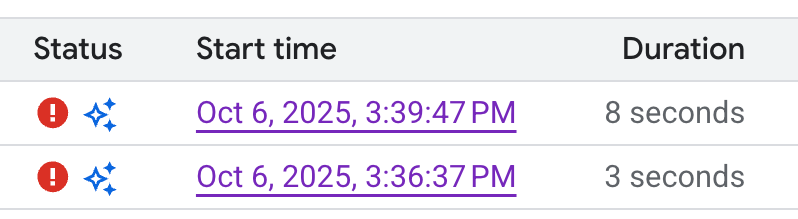

- No pipeline ou no espaço de trabalho de desenvolvimento, clique na guia Execuções.

Na lista de execuções, encontre a execução com falha do pipeline de dados. É possível identificar execuções com falha na coluna Status.

Passe o cursor sobre o ícone e clique em Investigar. O agente de engenharia de dados executa uma análise de causa raiz (RCA) na execução do pipeline de dados para encontrar erros.

Depois que a análise é concluída, o agente de engenharia de dados gera um relatório na seção Observações e hipóteses. O relatório inclui o seguinte:

- Observações e pontos de dados extraídos dos registros de execução do pipeline de dados.

- Causas prováveis da falha.

- Um conjunto de etapas ou recomendações práticas para resolver o problema identificado.

Com o relatório de solução de problemas do agente de engenharia de dados, é possível implementar as recomendações manualmente. Você também pode instruir o agente de engenharia de dados a aplicar a correção para você seguindo estas etapas:

- Copie as sugestões no relatório de solução de problemas.

- Volte ao agente de engenharia de dados:

- Se você estiver usando pipelines do BigQuery, acesse a página de pipelines e clique em Perguntar ao agente.

- Se você estiver usando o Dataform, clique em Perguntar ao agente.

- Cole as sugestões no comando e instrua o agente de engenharia de dados a fazer as correções diretamente no pipeline de dados.

- Clique em Enviar.

Criar instruções do agente

As instruções do agente são instruções em linguagem natural para o agente de engenharia de dados que permitem armazenar instruções persistentes para que o agente siga um conjunto de regras personalizadas e predefinidas. Use instruções do agente se quiser que os resultados dele sejam consistentes em toda a organização, por exemplo, com convenções de nomenclatura ou para aplicar um guia de estilo.

É possível criar um arquivo de contexto GEMINI.MD como um arquivo de instruções do agente para o Data Engineering Agent. É possível criar arquivos de instruções do agente para usar no seu espaço de trabalho local ou usar os mesmos arquivos em vários pipelines de dados com um repositório externo.

Para criar instruções do agente, faça o seguinte:

- Em Perguntar ao agente, clique em Instruções do pipeline.

- No painel Instruções para o pipeline, clique em Criar arquivo de instruções.

No arquivo

GEMINI.MDque aparece, insira suas instruções em linguagem natural.O exemplo a seguir mostra um arquivo de instruções do agente com várias regras:

1. All event-specific tables MUST be prefixed with `cs_event_`. 2. The primary key for any player activity table is a composite key of `player_id` and `event_timestamp_micros`. 3. Filter out any player actions where `mana_spent` is greater than `max_mana_pool`. This is considered a data anomaly.Clique em Salvar.

Para informações sobre como estruturar melhor os arquivos de instruções do agente, consulte Práticas recomendadas com arquivos de instruções do agente.

Carregar instruções do agente de um repositório externo

Para reutilizar um conjunto de instruções do agente em vários pipelines de dados, vincule um repositório externo:

- Em Perguntar ao agente, clique em Instruções do pipeline.

- Em Repositório externo, selecione Usar instruções de um repositório externo.

- Nos campos fornecidos, especifique um repositório que contenha instruções do agente que você quer usar com seu pipeline de dados.

- Clique em Salvar.

Comandos de amostra

As seções a seguir mostram exemplos de comandos que podem ser usados com o Agente de engenharia de dados para desenvolver seu pipeline de dados.

Agregar dados em uma nova tabela

Com esse comando, o agente de engenharia de dados usa o esquema e as amostras para inferir o agrupamento de dados por chave. Normalmente, o agente configura uma nova configuração de tabela com descrições de tabela e coluna.

Create a daily sales report from the

bigquery-public-data.thelook_ecommerce.order_items table into a

reporting.daily_sales_aggregation table.

Criar uma coluna derivada e adicionar verificações de qualidade de dados à nova tabela

Este comando mostra como adicionar uma tabela e uma coluna e especificar verificações de qualidade para a tabela ao mesmo tempo:

Create a new table named staging.products from

bigquery-public-data.thelook_ecommerce.products and add a calculated column

named gross_profit, which is the retail_price minus the cost.

Also, add the following assertions: ID must not be null and must be unique.

The retail_price must be greater than or equal to the cost. The department

column can only contain 'Men' or 'Women'.

Criar UDFs como parte da definição do modelo

O agente de engenharia de dados também pode configurar a DDL para criar funções definidas pelo usuário (UDFs). Embora o agente não crie a UDF, você pode fazer isso executando o pipeline de dados. Essas UDFs podem ser usadas em definições de modelo no pipeline de dados.

Create a user-defined function (UDF) named get_age_group that takes an integer

age as input and returns a string representing the age group ('Gen Z',

'Millennial', 'Gen X', 'Baby Boomer').

Use this UDF on the age column from the

bigquery-public-data.thelook_ecommerce.users table to create a new view called

reporting.user_age_demographics that includes user_id, age, and the calculated

age_group.

Práticas recomendadas

Para melhorar os resultados ao trabalhar com o agente de engenharia de dados e o Dataform, recomendamos que você faça o seguinte:

Use instruções do agente para solicitações comuns: se você costuma aplicar determinadas técnicas ou fazer as mesmas correções no agente, use as instruções como um local centralizado para armazenar instruções e solicitações comuns.

Use planos de agente. Eles podem ajudar a dividir tarefas complexas do pipeline. Também podem mostrar as proposições e intenções do agente. Por isso, recomendamos que você revise esses planos para garantir que o agente receba o contexto correto.

Depois de analisar um plano, você pode editá-lo pedindo ao agente de engenharia de dados feedback e mudanças. Exemplo:

In the plan, ensure that all of the intermediate tables are views.

Em alguns casos, pode ser útil pedir ao agente para gerar um plano que não precise da sua aprovação explícita. O ato de fazer o agente planejar força o Data Engineering Agent a detalhar as ações, o que geralmente leva a melhores resultados. Você pode forçar o agente a gerar e executar um plano automaticamente. Exemplo:

Create a plan for a pipeline that finds the

top N pick up and drop off locations in NYC. You have my explicit pre-approval

to go ahead and execute this plan.

Escreva com clareza. Faça seu pedido de forma clara e evite ser vago. Sempre que possível, forneça fontes de dados de origem e destino ao fazer solicitações, como mostrado no exemplo a seguir:

Extract data from the sales.customers table in the us_west_1 region, and load

it into the reporting.dim_customers table in BigQuery. Match the schema of the

destination table.

Faça solicitações diretas e específicas.Faça uma pergunta por vez e mantenha os comandos concisos. Para comandos com mais de uma pergunta, liste cada parte distinta da pergunta para melhorar a clareza, como mostrado no exemplo a seguir:

1. Create a new table named staging.events_cleaned. Use raw.events as the

source. This new table should filter out any records where the user_agent

matches the pattern '%bot%'. All original columns should be included.

2. Next, create a table named analytics.user_sessions. Use

staging.events_cleaned as the source. This table should calculate the

duration for each session by grouping by session_id and finding the

difference between the MAX(event_timestamp) and MIN(event_timestamp).

Dê instruções explícitas e enfatize os termos-chave. Você pode enfatizar termos ou conceitos-chave nos comandos e rotular determinados requisitos como importantes, conforme mostrado no exemplo a seguir:

When creating the staging.customers table, it is *VERY IMPORTANT* that you

transform the email column from the source table bronze.raw_customers.

Coalesce any NULL values in the email column to an empty string ''.

Especificar a ordem das operações. Para tarefas ordenadas, estruture o comando em listas, em que os itens listados são divididos em etapas pequenas e focadas, conforme mostrado no exemplo a seguir:

Create a pipeline with the following steps:

1. Extract data from the ecomm.orders table.

2. Join the extracted data with the marts.customers table on customer_id.

3. Load the final result into the reporting.customer_orders table.

Refine e itere. Teste frases e abordagens diferentes para saber produz os melhores resultados. Se o agente gerar SQL inválido ou outros erros, dê exemplos ou documentação pública para orientá-lo.

The previous query was incorrect because it removed the timestamp. Please

correct the SQL. Use the TIMESTAMP_TRUNC function to truncate the

event_timestamp to the nearest hour, instead of casting it as a DATE. For

example: TIMESTAMP_TRUNC(event_timestamp, HOUR).