La trascrizione vocale ti consente di convertire i dati audio dello streaming in testo trascritto in tempo reale. Agent Assist fornisce suggerimenti basati sul testo, pertanto i dati audio devono essere convertiti prima di poter essere utilizzati. Puoi anche utilizzare l'audio in streaming trascritto con Customer Experience Insights per raccogliere dati in tempo reale sulle conversazioni degli agenti (ad esempio, Topic Modeling).

Esistono due modi per trascrivere l'audio in streaming da utilizzare con Agent Assist: utilizzando la funzionalità SIPREC o effettuando chiamate gRPC con dati audio come payload. Questa pagina descrive la procedura di trascrizione dei dati audio in streaming utilizzando le chiamate gRPC.

La trascrizione vocale funziona utilizzando il riconoscimento vocale in streaming di Speech-to-Text. Speech-to-Text offre diversi modelli di riconoscimento, standard e migliorati. Agent Assist non limita i modelli che puoi utilizzare con la trascrizione vocale, ma la trascrizione vocale è supportata a livello GA solo se utilizzata con il modello di telefonia o Chirp 3. Per una qualità di trascrizione ottimale, è consigliato il modello Chirp 3, a seconda della disponibilità regionale.

Prerequisiti

- Crea un progetto in Google Cloud.

- Abilita l'API Dialogflow.

- Contatta il tuo rappresentante di Google per assicurarti che il tuo account abbia accesso ai modelli migliorati di Speech-to-Text.

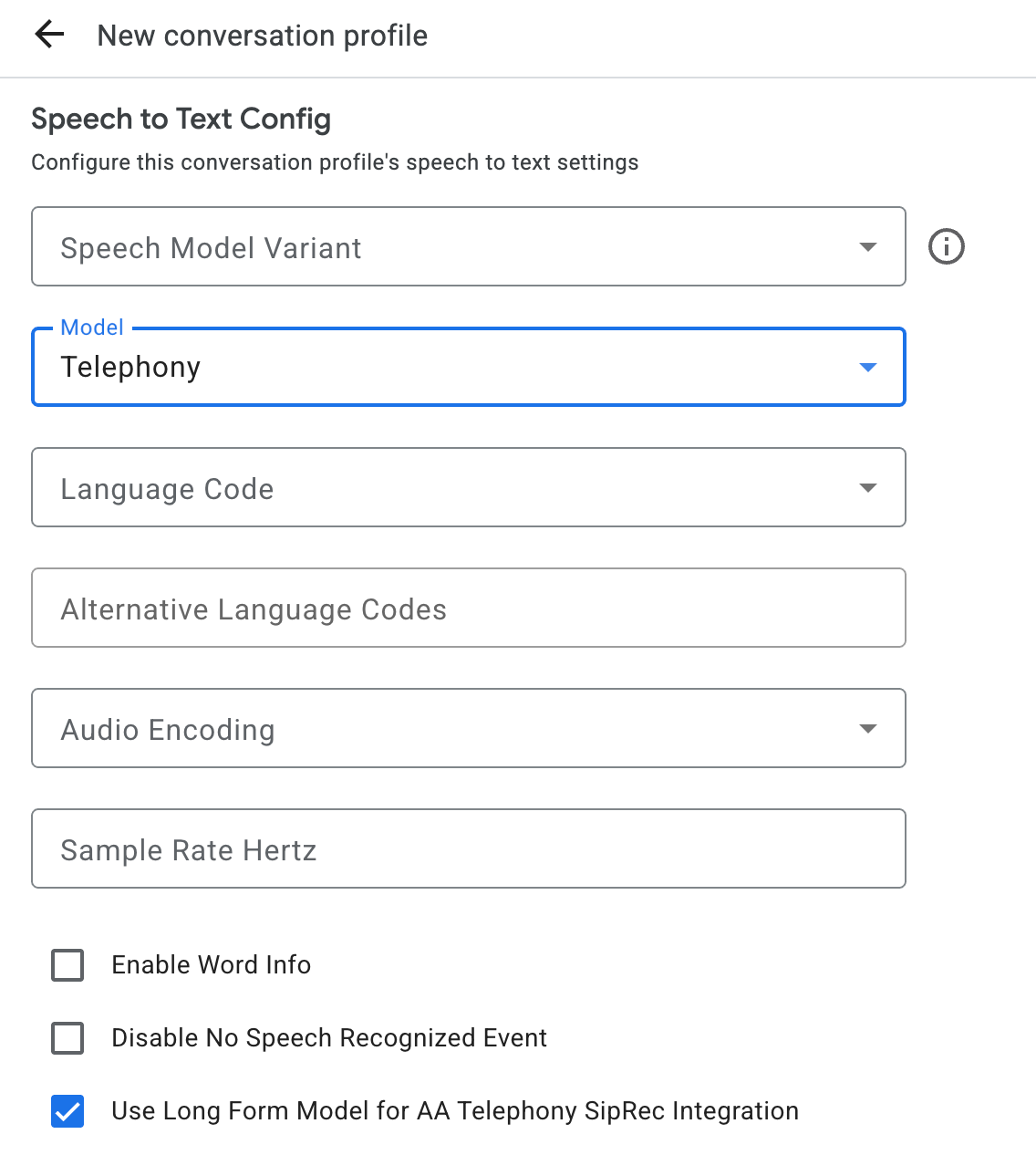

Creare un profilo di conversazione

Per creare un profilo di conversazione, utilizza la console Agent Assist o chiama il metodo create sulla risorsa ConversationProfile direttamente.

Per la trascrizione vocale, ti consigliamo di configurare

ConversationProfile.stt_config come InputAudioConfig predefinito quando invii

dati audio in una conversazione.

Ottenere le trascrizioni durante l'esecuzione della conversazione

Per ottenere le trascrizioni in fase di runtime della conversazione, devi creare i partecipanti alla conversazione e inviare i dati audio per ciascun partecipante.

Creare partecipanti

Esistono tre tipi di

partecipante.

Per ulteriori dettagli sui ruoli, consulta la documentazione

di riferimento. Chiama il metodo create su participant e specifica role. Solo un partecipante END_USER o HUMAN_AGENT

può chiamare StreamingAnalyzeContent, che è necessario per ottenere una

trascrizione.

Inviare dati audio e ricevere una trascrizione

Puoi utilizzare

StreamingAnalyzeContent

per inviare l'audio di un partecipante a Google e ottenere la trascrizione, con i

seguenti parametri:

La prima richiesta nel flusso deve essere

InputAudioConfig. I campi configurati qui sostituiscono le impostazioni corrispondenti inConversationProfile.stt_config. Non inviare alcun input audio fino alla seconda richiesta.audioEncodingdeve essere impostato suAUDIO_ENCODING_LINEAR_16oAUDIO_ENCODING_MULAW.model: il modello Speech-to-Text che vuoi utilizzare per trascrivere l'audio. Imposta questo campo suchirp_3. La variante non influisce sulla qualità della trascrizione, quindi puoi lasciare la variante del modello di riconoscimento vocale non specificata o scegliere Usa la migliore disponibile.singleUtterancedeve essere impostato sufalseper una qualità ottimale della trascrizione. Non devi aspettartiEND_OF_SINGLE_UTTERANCEsesingleUtteranceèfalse, ma puoi fare affidamento suisFinal==trueall'interno diStreamingAnalyzeContentResponse.recognition_resultper chiudere a metà lo stream.- Parametri aggiuntivi facoltativi: i seguenti parametri sono facoltativi. Per ottenere l'accesso a questi parametri, contatta il tuo rappresentante di Google.

languageCode:language_codedell'audio. Il valore predefinito èen-US.alternativeLanguageCodes: questa funzionalità è disponibile solo a livello GA per il modello Chirp 3. Altre lingue che potrebbero essere rilevate nell'audio. Agent Assist utilizza il campolanguage_codeper rilevare automaticamente la lingua all'inizio dell'audio e la imposta come predefinita in tutti i turni di conversazione successivi. Il campoalternativeLanguageCodesti consente di specificare altre opzioni tra cui scegliere per Agent Assist.phraseSets: il nome della risorsaphraseSetadattamento del modello Speech-to-Text.- Per configurare l'adattamento per il modello Chirp 3, aggiungi frasi in linea separate da nuove righe, senza virgole.

- Per utilizzare l'adattamento del modello con altri modelli come

telephonyper la trascrizione vocale, devi prima crearephraseSetutilizzando l'API Speech-to-Text e specificare qui il nome della risorsa.

Dopo aver inviato la seconda richiesta con il payload audio, dovresti iniziare a ricevere alcuni

StreamingAnalyzeContentResponsesdallo stream.- Puoi chiudere a metà lo stream (o interrompere l'invio in alcune lingue come

Python) quando vedi

is_finalimpostato sutrueinStreamingAnalyzeContentResponse.recognition_result. - Dopo aver chiuso a metà lo stream, il server invierà la risposta contenente la trascrizione finale, insieme a potenziali suggerimenti di Dialogflow o di Agent Assist.

- Puoi chiudere a metà lo stream (o interrompere l'invio in alcune lingue come

Python) quando vedi

Puoi trovare la trascrizione finale nelle seguenti posizioni:

StreamingAnalyzeContentResponse.message.content.- Se attivi le notifiche Pub/Sub, puoi visualizzare anche la trascrizione in Pub/Sub.

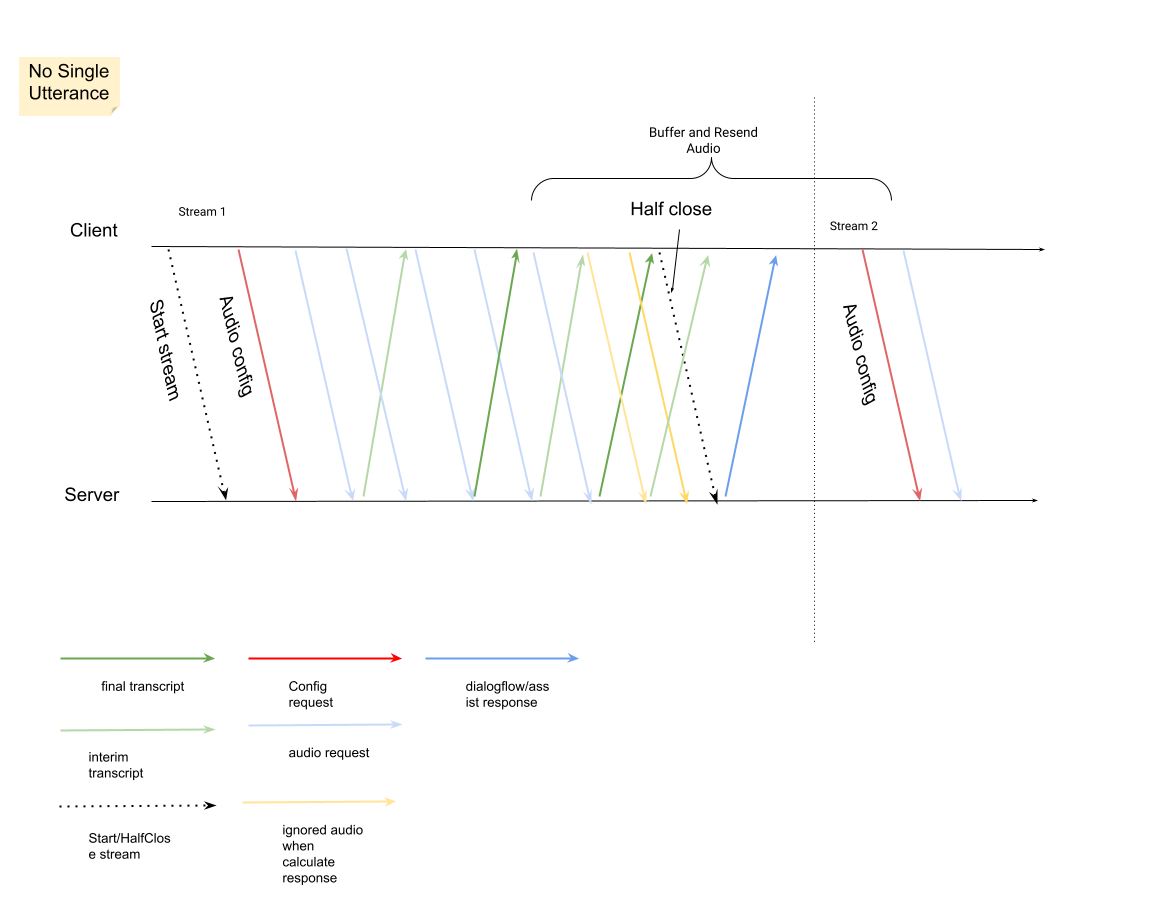

Avvia un nuovo stream dopo la chiusura di quello precedente.

- Invio di nuovo dell'audio: i dati audio generati dopo l'ultimo

speech_end_offsetdella risposta conis_final=trueal nuovo orario di inizio dello stream devono essere inviati di nuovo aStreamingAnalyzeContentper una migliore qualità della trascrizione.

- Invio di nuovo dell'audio: i dati audio generati dopo l'ultimo

Ecco il diagramma che illustra il funzionamento dello stream.

Esempio di codice di richiesta di riconoscimento in streaming

Il seguente esempio di codice mostra come inviare una richiesta di trascrizione in streaming.

Python

Per eseguire l'autenticazione in Agent Assist, configura le Credenziali predefinite dell'applicazione. Per saperne di più, consulta Configura l'autenticazione per un ambiente di sviluppo locale.

Per visualizzare i file Python per conversation_management e participant_management:

Vai al repository GitHub per i documenti Python.

Fai clic su Vai al file e inserisci il nome del file:

conversation_managementoparticipant_management.Fai clic su Invio.

Best practice

L'ora di invio del messaggio è l'ora in cui inizia un'espressione. Utilizza l'ora di invio del messaggio per determinare l'ordine in cui il contact center visualizza o analizza i messaggi vocali.