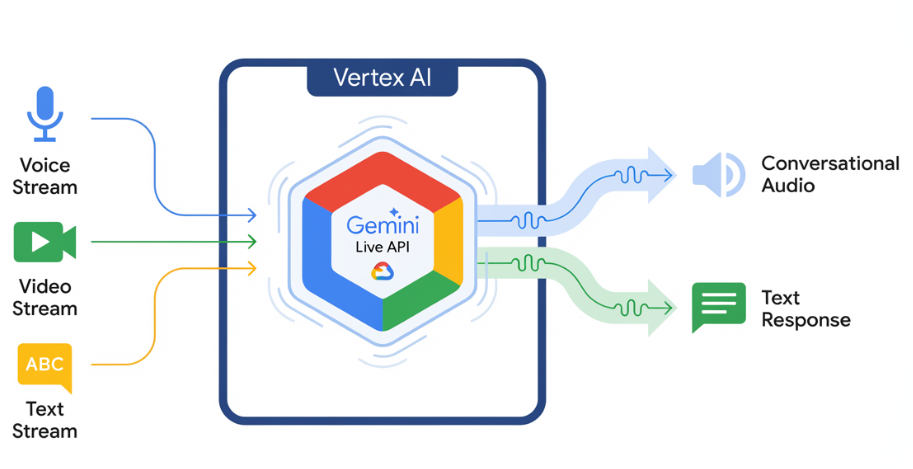

Gemini Live API 支持与 Gemini 进行低延迟、实时的语音和视频交互。它能够处理连续的音频、视频或文本流,以提供即时、自然逼真的语音回答。这为您的用户创造了自然的对话体验。

在 Agent Platform Studio 中试用 Gemini Live API

应用场景示例

Gemini Live API 可用于为各种行业构建实时语音和视频代理,包括:

- 电子商务和零售:提供个性化推荐的购物助理,以及解决客户问题的支持人员。

- 游戏:互动式非玩家角色 (NPC)、游戏内帮助助理和游戏内内容的实时翻译。

- 新一代界面:在机器人、智能眼镜和车辆中提供语音和视频功能。

- 医疗保健:用于患者支持和教育的健康助手。

- 金融服务:用于财富管理和投资指导的 AI 顾问。

- 教育:提供个性化指导和反馈的 AI 导师和学习伙伴。

主要特性

Gemini Live API 提供了一套全面的功能,用于构建强大的语音和视频代理:

- 高音质:Gemini Live API 可提供多种语言的自然、逼真的语音。

- 多语言支持:支持用 24 种语言进行对话。

- 打断功能:用户可以随时中断模型,以便进行响应式互动。

- 共情对话:根据用户输入内容的情绪表达调整回答风格和语气。

- 工具使用:集成函数调用和 Google 搜索等工具,实现动态交互。

- 音频转写:提供用户输入和模型输出的文本转写内容。

- 主动音频:(预览版)可让您控制模型何时响应以及在哪些情境下响应。

技术规范

下表列出了 Gemini Live API 的技术规范。

| 类别 | 详细信息 |

|---|---|

| 输入模态 | 音频(原始 16 位 PCM 音频,16kHz,小端字节序)、图片/视频(JPEG 1FPS)、文本 |

| 输出模态 | 音频(原始 16 位 PCM 音频,24kHz,小端字节序)、文本 |

| 协议 | 有状态 WebSocket 连接 (WSS) |

支持的模型

以下模型支持 Gemini Live API。根据您的交互需求选择合适的模型。

| 模型 ID | 可用性 | 使用场景 | 主要特性 |

|---|---|---|---|

gemini-live-2.5-flash-native-audio |

已全面推出 | 推荐。低延迟语音代理。支持无缝多语言切换和情感基调。 |

|

gemini-live-2.5-flash-preview-native-audio-09-2025 |

公开预览版 | 实时语音代理的成本效益。 |

|

开始使用

选择与您的开发环境相符的指南:

合作伙伴集成

如果您想与我们的部分合作伙伴集成,这些平台已通过 WebRTC 协议集成了 Gemini Live API,可简化实时音频和视频应用的开发。