Cette page décrit comment insérer des objets dans une image, un processus également appelé inpainting. Imagen sur Vertex AI vous permet de spécifier une zone de masque pour insérer des objets dans une image. Vous pouvez fournir votre propre masque ou laisser Imagen en générer un.

Les modèles suivants sont compatibles avec l'insertion d'objets dans une image :

Exemple d'insertion de contenu

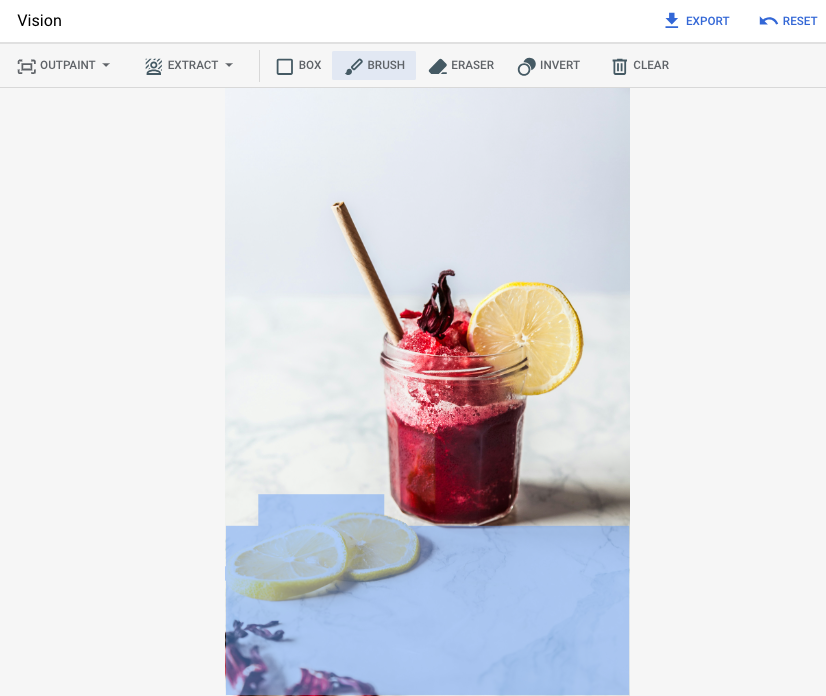

Avec l'inpainting, vous pouvez utiliser une image de base, un masque d'image et une requête textuelle pour ajouter du contenu à une image existante.

Entrées

| Image de base* à modifier | Zone de masque spécifiée à l'aide d'outils de la console Google Cloud | Requête textuelle |

|---|---|---|

|

|

fraises |

* Crédit image : Alex Lvrs sur Unsplash.

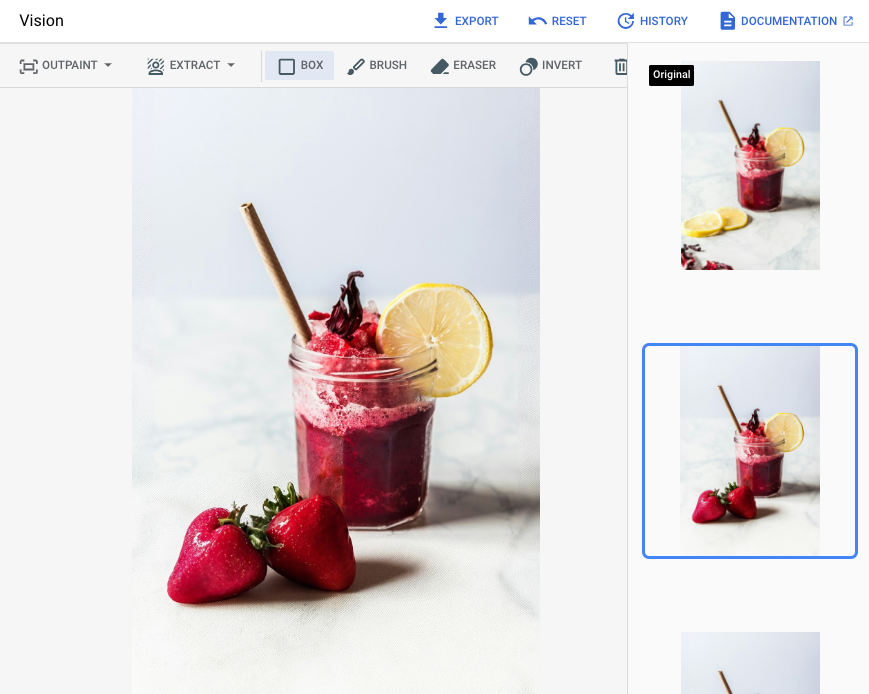

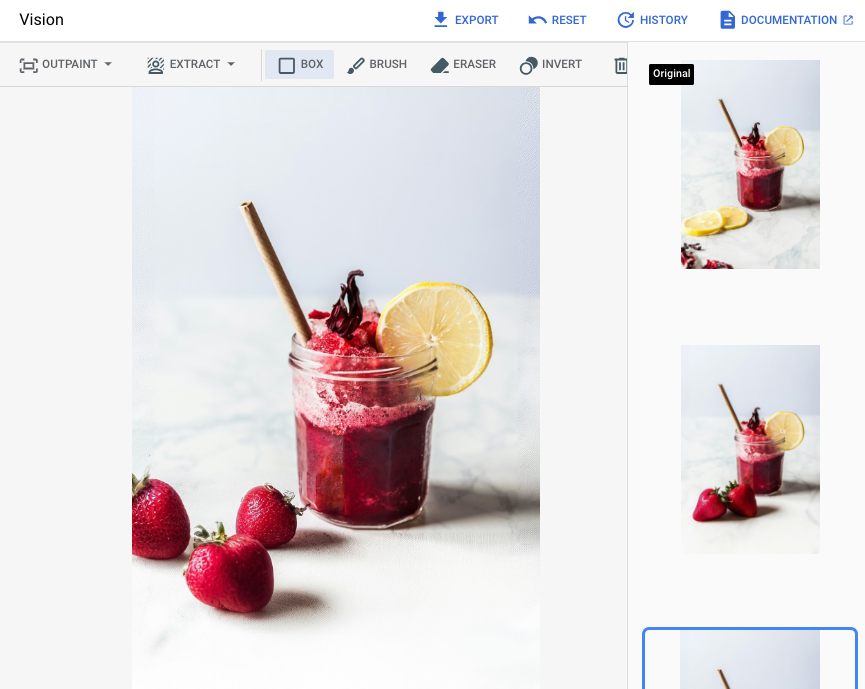

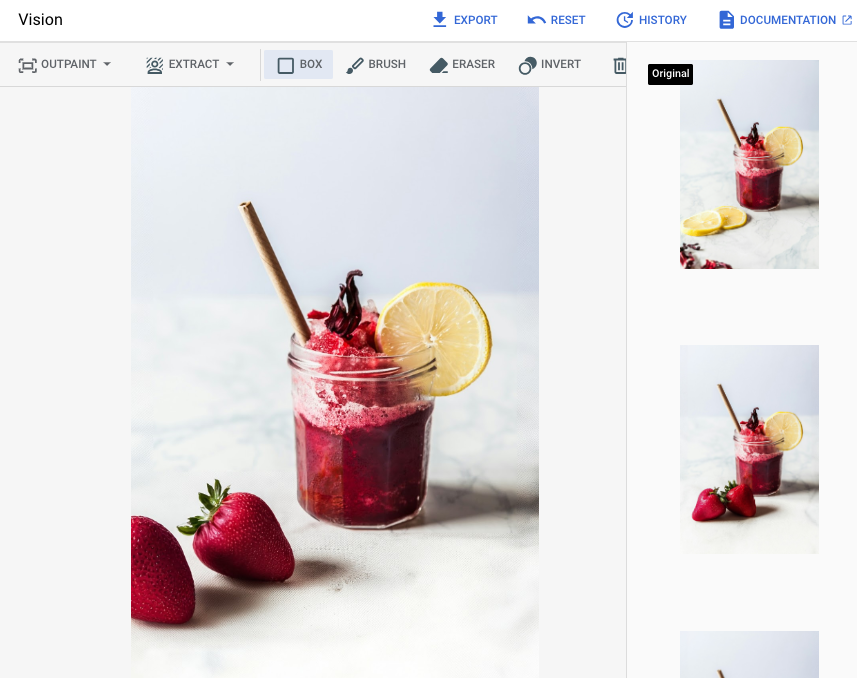

Sortie après avoir spécifié une zone de masque dans la console Google Cloud

|

|

|

Afficher la fiche de modèle Imagen pour la modification et la personnalisation

Avant de commencer

- Connectez-vous à votre compte Google Cloud . Si vous débutez sur Google Cloud, créez un compte pour évaluer les performances de nos produits en conditions réelles. Les nouveaux clients bénéficient également de 300 $de crédits sans frais pour exécuter, tester et déployer des charges de travail.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Vertex AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Vertex AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

Configurez l'authentification pour votre environnement.

Sélectionnez l'onglet correspondant à la façon dont vous prévoyez d'utiliser les exemples de cette page :

Console

Lorsque vous utilisez la console Google Cloud pour accéder aux services Google Cloud et aux API, vous n'avez pas besoin de configurer l'authentification.

Python

Pour utiliser les exemples Python de cette page dans un environnement de développement local, installez et initialisez la gcloud CLI, puis configurez les Identifiants par défaut de l'application avec vos identifiants utilisateur.

-

Installez la Google Cloud CLI.

-

Si vous utilisez un fournisseur d'identité (IdP) externe, vous devez d'abord vous connecter à la gcloud CLI avec votre identité fédérée.

-

Si vous utilisez un shell local, créez des identifiants d'authentification locaux pour votre compte utilisateur :

gcloud auth application-default login

Vous n'avez pas besoin de le faire si vous utilisez Cloud Shell.

Si une erreur d'authentification est renvoyée et que vous utilisez un fournisseur d'identité (IdP) externe, vérifiez que vous vous êtes connecté à la gcloud CLI avec votre identité fédérée.

Pour en savoir plus, consultez Configurer les ADC pour un environnement de développement local dans la documentation sur l'authentification Google Cloud .

REST

Pour utiliser les exemples API REST de cette page dans un environnement de développement local, vous devez utiliser les identifiants que vous fournissez à la gcloud CLI.

Installez la Google Cloud CLI.

Si vous utilisez un fournisseur d'identité (IdP) externe, vous devez d'abord vous connecter à la gcloud CLI avec votre identité fédérée.

Pour en savoir plus, consultez la section S'authentifier pour utiliser REST dans la documentation sur l'authentification Google Cloud .

-

Insérer avec une zone de masque définie

Utilisez les exemples suivants pour envoyer une requête d'inpainting à l'aide du modèle Imagen 3.

Console

Dans la console Google Cloud , accédez à la page Vertex AI>Vertex AI Studio .

Cliquez sur Générer un contenu multimédia.

Cliquez sur Image.

Dans la liste Task (Tâche), sélectionnez Inpaint-add (Ajouter une retouche).

Dans la liste Modèle, sélectionnez le modèle Imagen à utiliser.

Dans Image d'entrée, cliquez sur Ajouter, puis sélectionnez l'image que vous modifiez pour l'importer.

Dans la zone Requête, saisissez une requête décrivant comment modifier l'image.

Pour spécifier un masque, procédez de l'une des manières suivantes :

- Importer votre propre masque :

- Créez un masque sur votre ordinateur.

- Cliquez sur Importer Importer un masque, puis sélectionnez un masque à importer.

- Définissez votre masque : dans la barre d'outils de modification, utilisez les outils de masque (zone, pinceau ou outil d'inversion masked_transitions) pour spécifier la ou les zones dans lesquelles vous souhaitez ajouter du contenu.

- Importer votre propre masque :

Cliquez sur Exécuter.

Python

Installer

pip install --upgrade google-genai

Pour en savoir plus, consultez la documentation de référence du SDK.

Définissez des variables d'environnement pour utiliser le SDK Gen AI avec Vertex AI :

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=us-central1 export GOOGLE_GENAI_USE_VERTEXAI=True

REST

Pour en savoir plus sur l'API Imagen, consultez les ressources suivantes :- Méthode :

endpoints.predict VisionGenerativeModelInstanceVisionGenerativeModelParamsVisionGenerativeModelResult

Avant d'utiliser les données de requête, effectuez les remplacements suivants :

-

REGION: région dans laquelle se trouve votre projet. Pour en savoir plus sur les régions compatibles, consultez Emplacements de l'IA générative sur Vertex AI. -

PROJECT_ID: ID de votre projet Google Cloud . -

TEXT_PROMPT: Facultatif. Une requête textuelle pour guider les images que le modèle génère. Pour de meilleurs résultats, décrivez la zone masquée et évitez les requêtes d'un seul mot. Par exemple, utilisez "un corgi mignon" au lieu de "corgi". -

B64_BASE_IMAGE: image encodée en base64 de l'image en cours de modification, dont la taille ne dépasse pas 10 Mo. Pour en savoir plus sur l'encodage en base64, consultez Encoder et décoder des fichiers en Base64. -

B64_MASK_IMAGE: image de masque en noir et blanc encodée en base64, dont la taille ne dépasse pas 10 Mo. -

MASK_DILATION: Facultatif. Valeur flottante comprise entre 0 et 1 (inclus) représentant le pourcentage de la largeur de l'image à utiliser pour agrandir le masque. L'utilisation dedilationpermet de compenser les masques imprécis. Nous vous recommandons de définir une valeur de0.01. -

EDIT_STEPS: facultatif. Entier représentant le nombre d'étapes d'échantillonnage. Une valeur plus élevée améliore la qualité de l'image, tandis qu'une valeur plus faible améliore la latence.Nous vous recommandons de commencer par

35étapes. Si la qualité ne répond pas à vos exigences, nous vous recommandons d'augmenter la valeur jusqu'à la limite maximale de75. -

SAMPLE_COUNT: Facultatif. Entier qui décrit le nombre d'images à générer. La plage de valeurs acceptée est comprise entre1et4. La valeur par défaut est4.

Méthode HTTP et URL :

POST https://REGION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/REGION/publishers/google/models/imagen-3.0-capability-001:predict

Corps JSON de la requête :

{

"instances": [

{

"prompt": "TEXT_PROMPT",

"referenceImages": [

{

"referenceType": "REFERENCE_TYPE_RAW",

"referenceId": 1,

"referenceImage": {

"bytesBase64Encoded": "B64_BASE_IMAGE"

}

},

{

"referenceType": "REFERENCE_TYPE_MASK",

"referenceImage": {

"bytesBase64Encoded": "B64_MASK_IMAGE"

},

"maskImageConfig": {

"maskMode": "MASK_MODE_USER_PROVIDED",

"dilation": MASK_DILATION

}

}

]

}

],

"parameters": {

"editConfig": {

"baseSteps": EDIT_STEPS

},

"editMode": "EDIT_MODE_INPAINT_INSERTION",

"sampleCount": SAMPLE_COUNT

}

}

Pour envoyer votre requête, choisissez l'une des options suivantes :

curl

Enregistrez le corps de la requête dans un fichier nommé request.json, puis exécutez la commande suivante :

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://REGION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/REGION/publishers/google/models/imagen-3.0-capability-001:predict"

PowerShell

Enregistrez le corps de la requête dans un fichier nommé request.json, puis exécutez la commande suivante :

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://REGION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/REGION/publishers/google/models/imagen-3.0-capability-001:predict" | Select-Object -Expand Content

"sampleCount": 2. La réponse renvoie deux objets de prédiction, avec les octets d'image générés encodés en base64.

{

"predictions": [

{

"bytesBase64Encoded": "BASE64_IMG_BYTES",

"mimeType": "image/png"

},

{

"mimeType": "image/png",

"bytesBase64Encoded": "BASE64_IMG_BYTES"

}

]

}

Insérer avec la détection automatique de masque

Utilisez les exemples suivants pour insérer du contenu par inpainting. Dans ces exemples, vous spécifiez une image de base et un prompt textuel. Imagen détecte et crée automatiquement une zone de masque pour modifier l'image de base.

Console

Dans la console Google Cloud , accédez à la page Vertex AI>Vertex AI Studio .

Cliquez sur Générer un contenu multimédia.

Cliquez sur Image.

Dans la liste Task (Tâche), sélectionnez Inpaint-add (Ajouter une retouche).

Dans la liste Modèle, sélectionnez le modèle Imagen à utiliser.

Dans Image d'entrée, cliquez sur Ajouter, puis sélectionnez l'image que vous modifiez pour l'importer.

Dans la zone Requête, saisissez une requête décrivant comment modifier l'image.

Dans la barre d'outils de modification, cliquez sur background_replaceExtraire le masque.

Sélectionnez l'une des options d'extraction de masque :

Éléments d'arrière-plan : détecte les éléments d'arrière-plan et crée un masque autour de ces éléments.

Éléments de premier plan : détecte les objets au premier plan et crée un masque autour d'eux.

background_replace Personnes : détecte les personnes et crée un masque autour d'elles.

Cliquez sur Exécuter.

Python

Installer

pip install --upgrade google-genai

Pour en savoir plus, consultez la documentation de référence du SDK.

Définissez des variables d'environnement pour utiliser le SDK Gen AI avec Vertex AI :

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=us-central1 export GOOGLE_GENAI_USE_VERTEXAI=True

REST

Pour en savoir plus sur l'API Imagen, consultez les ressources suivantes :

- Méthode :

endpoints.predict VisionGenerativeModelInstanceVisionGenerativeModelParamsVisionGenerativeModelResult

Avant d'utiliser les données de requête, effectuez les remplacements suivants :

- PROJECT_ID : ID de votre projet Google Cloud .

- LOCATION : région de votre projet (

us-central1,europe-west2ouasia-northeast3, par exemple). Pour obtenir la liste des régions disponibles, consultez IA générative sur les emplacements Vertex AI. Lorsqu'un point de terminaison d'API régional est utilisé, la région de l'URL du point de terminaison détermine où la requête est traitée. Si elle est en conflit, cetteLOCATIONdans le chemin d'accès à la ressource est ignorée. - TEXT_PROMPT : prompt textuel qui guide le modèle pour la génération d'images. Lorsque vous utilisez un prompt pour une insertion par inpainting, décrivez la zone de masque pour obtenir de meilleurs résultats. Évitez les prompts à un seul mot. Par exemple, saisissez un corgi mignon au lieu de corgi.

- B64_BASE_IMAGE : image de base à modifier ou à améliorer. L'image doit être spécifiée en tant que chaîne d'octets encodés en base64. Limite de taille : 10 Mo.

- MASK_MODE : chaîne qui définit le type de création automatique de masque utilisé par le modèle.

Valeurs disponibles :

MASK_MODE_BACKGROUND: génère automatiquement un masque à l'aide de la segmentation de l'arrière-plan.MASK_MODE_FOREGROUND: génère automatiquement un masque à l'aide de la segmentation du premier plan.MASK_MODE_SEMANTIC: génère automatiquement un masque à l'aide d'une segmentation sémantique basée sur les classes de segmentation que vous spécifiez dans le tableaumaskImageConfig.maskClasses. Par exemple :"maskImageConfig": { "maskMode": "MASK_MODE_SEMANTIC", "maskClasses": [175, 176], // bicycle, car "dilation": 0.01 }

- MASK_DILATION : float. Pourcentage de la largeur de l'image à utiliser pour dilater ce masque. Nous vous recommandons de définir

0.01comme valeur pour compenser les masques d'entrée imparfaits. - EDIT_STEPS : entier. Nombre d'étapes d'échantillonnage pour le modèle de base. Pour effectuer une insertion par inpainting, commencez avec

35étapes. Augmentez le nombre d'étapes jusqu'à la limite maximale de75si la qualité ne répond pas à vos exigences. L'augmentation du nombre d'étapes augmente également la latence des requêtes. - EDIT_IMAGE_COUNT : nombre d'images modifiées. Valeurs entières acceptées : 1 à 4. Valeur par défaut : 4.

Méthode HTTP et URL :

POST https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict

Corps JSON de la requête :

{

"instances": [

{

"prompt": "TEXT_PROMPT",

"referenceImages": [

{

"referenceType": "REFERENCE_TYPE_RAW",

"referenceId": 1,

"referenceImage": {

"bytesBase64Encoded": "B64_BASE_IMAGE"

}

},

{

"referenceType": "REFERENCE_TYPE_MASK",

"referenceId": 2,

"maskImageConfig": {

"maskMode": "MASK_MODE",

"dilation": MASK_DILATION

}

}

]

}

],

"parameters": {

"editConfig": {

"baseSteps": EDIT_STEPS

},

"editMode": "EDIT_MODE_INPAINT_INSERTION",

"sampleCount": EDIT_IMAGE_COUNT

}

}

Pour envoyer votre requête, choisissez l'une des options suivantes :

curl

Enregistrez le corps de la requête dans un fichier nommé request.json, puis exécutez la commande suivante :

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict"

PowerShell

Enregistrez le corps de la requête dans un fichier nommé request.json, puis exécutez la commande suivante :

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict" | Select-Object -Expand Content

"sampleCount": 2. La réponse renvoie deux objets de prédiction, avec les octets d'image générés encodés en base64.

{

"predictions": [

{

"bytesBase64Encoded": "BASE64_IMG_BYTES",

"mimeType": "image/png"

},

{

"mimeType": "image/png",

"bytesBase64Encoded": "BASE64_IMG_BYTES"

}

]

}

Limites

Les sections suivantes expliquent les limites de la fonctionnalité Supprimer des objets d'Imagen.

Pixels modifiés

Le modèle génère des pixels à sa propre résolution (par exemple, 1 024 x 1 024), qui peut être différente de celle de l'image d'entrée. Cela signifie que l'image générée peut présenter de légères modifications par rapport à l'image d'origine.

Pour préserver parfaitement l'image, nous vous recommandons de fusionner l'image générée avec l'image d'entrée à l'aide du masque. En règle générale, si la résolution de l'image d'entrée est de 2K ou plus, il est nécessaire de fusionner l'image générée et l'image d'entrée.

Insérer une limite

Bien que l'objet inséré corresponde généralement au style de l'image de base, certains mots clés peuvent produire des résultats de type dessin animé au lieu d'un rendu photoréaliste.

Par exemple, si vous demandez une "girafe jaune", vous obtiendrez probablement une image de dessin animé, car les girafes sont naturellement brunes et beiges. Il peut être difficile de générer des images photoréalistes avec des couleurs non naturelles.

Étapes suivantes

Consultez des articles concernant Imagen et d'autres produits d'IA générative sur Vertex AI :

- Guide du développeur pour bien démarrer avec Imagen 3 sur Vertex AI

- Nouveaux outils et modèles multimédias génératifs, conçus avec et pour les créateurs

- Nouveautés dans Gemini : Gems personnalisés et génération d'images améliorée avec Imagen 3

- Google DeepMind : Imagen 3 – Notre modèle texte-vers-image le plus puissant