Puoi esplorare i risultati delle query utilizzando le celle SQL o le celle di codice nei notebook BigQuery Colab Enterprise.

In questo tutorial, eseguirai una query sui dati di un set di dati pubblici BigQuery ed esplorerai i risultati della query in un notebook.

Obiettivi

- Crea ed esegui una query in BigQuery.

- Esplora i risultati della query in un notebook utilizzando le celle SQL e le celle di codice.

Costi

Questo tutorial utilizza un set di dati disponibile tramite il Google Cloud programma Set di dati pubblici. Google paga per l'archiviazione di questi set di dati e fornisce l'accesso pubblico ai dati. Ti vengono addebitati costi per le query che esegui sui dati. Per ulteriori informazioni, vedi Prezzi di BigQuery.

Prima di iniziare

-

Nella Google Cloud console, nella pagina di selezione del progetto, seleziona o crea un Google Cloud progetto.

Ruoli richiesti per selezionare o creare un progetto

- Seleziona un progetto: la selezione di un progetto non richiede un ruolo IAM specifico. Puoi selezionare qualsiasi progetto su cui ti è stato concesso un ruolo.

-

Crea un progetto: per creare un progetto, devi disporre del ruolo Autore progetto

(

roles/resourcemanager.projectCreator), che contiene l'resourcemanager.projects.createautorizzazione. Scopri come concedere i ruoli.

-

Verifica che la fatturazione sia abilitata per il tuo Google Cloud progetto.

-

Abilita l'API BigQuery.

Ruoli richiesti per abilitare le API

Per abilitare le API, devi disporre del ruolo IAM Amministratore utilizzo servizi (

roles/serviceusage.serviceUsageAdmin), che contiene l'autorizzazioneserviceusage.services.enable. Scopri come concedere i ruoli.Per i nuovi progetti, BigQuery è abilitato automaticamente.

Imposta la regione predefinita per gli asset di codice

Tutti i nuovi asset di codice nel tuo Google Cloud progetto utilizzano una regione predefinita. Dopo aver creato l'asset, non puoi modificarne la regione.

Per impostare la regione predefinita per i nuovi asset di codice:

Vai alla pagina BigQuery.

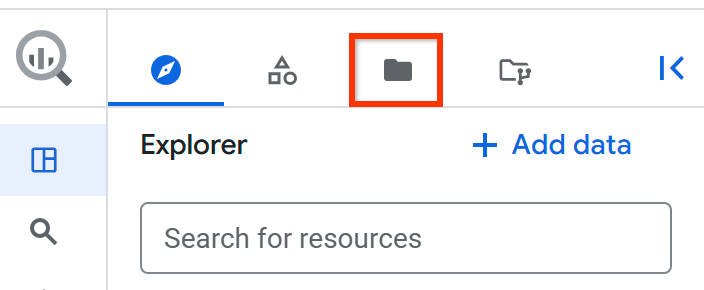

Nel riquadro a sinistra, fai clic su File per aprire il browser dei file:

Accanto al nome del progetto, fai clic su Visualizza azioni del riquadro File > Cambia regione del codice.

Seleziona la regione del codice che vuoi utilizzare come predefinita.

Fai clic su Salva.

Per un elenco delle regioni supportate, vedi Località di BigQuery Studio.

Autorizzazioni obbligatorie

Per creare ed eseguire notebook, devi disporre dei seguenti ruoli Identity and Access Management (IAM):

- Utente BigQuery (

roles/bigquery.user) - Utente runtime blocco note (

roles/aiplatform.notebookRuntimeUser) - Creatore di codice (

roles/dataform.codeCreator)

Apri i risultati della query in un notebook

Puoi eseguire una query SQL e poi utilizzare un notebook per esplorare i dati. Questo approccio è utile se vuoi modificare i dati in BigQuery prima di utilizzarli o se ti serve solo un sottoinsieme dei campi della tabella.

Nella Google Cloud console, vai alla pagina BigQuery.

Nel riquadro a sinistra, fai clic su Explorer.

Vai al progetto

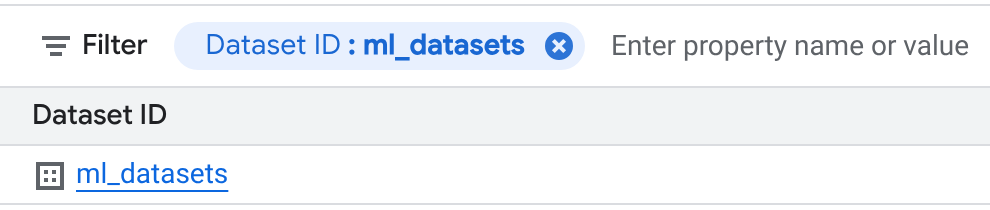

bigquery-public-data, fai clic Attiva/disattiva nodo per espanderlo, quindi fai clic su Set di dati. Nel riquadro dei dettagli si apre una nuova scheda che mostra un elenco di tutti i set di dati del progetto.Nella casella Filtra , scegli ID set di dati e inserisci ml_datasets.

Nella pagina Set di dati, fai clic su ml_datasets > penguins.

Fai clic su Query.

Aggiungi un asterisco (

*) per la selezione dei campi alla query generata, in modo che sia simile all'esempio seguente:SELECT * FROM `bigquery-public-data.ml_datasets.penguins` LIMIT 1000;

Fai clic su Esegui.

Nella sezione Risultati query, fai clic su Apri in, quindi su Notebook.

Prepara il notebook per l'uso

Prepara il notebook per l'uso connettendoti a un runtime e impostando i valori predefiniti dell'applicazione.

Nell'intestazione del notebook, fai clic su Connetti per connetterti al runtime predefinito.

Nel blocco di codice Configurazione, fai clic su Esegui cella.

Esplora i dati

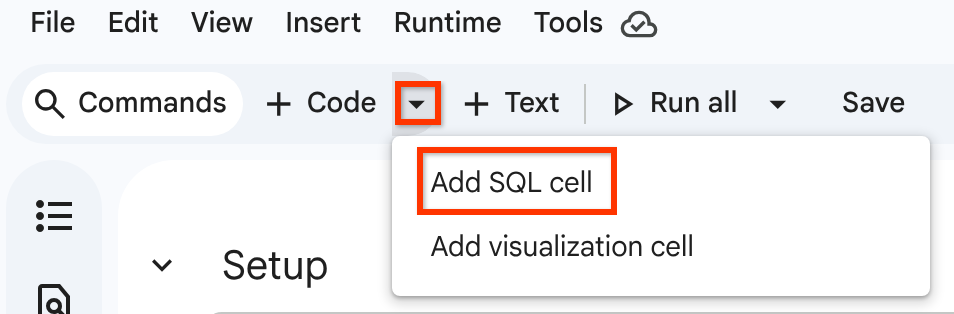

Fai clic su Opzioni per l'inserimento di celle di codice > Aggiungi cella SQL.

Inserisci la seguente query nella cella SQL:

SELECT * FROM `bigquery-public-data.ml_datasets.penguins` LIMIT 1000;Fai clic su Esegui cella.

I risultati della query vengono visualizzati in un BigQuery DataFrame.

In alternativa, per caricare i risultati della query in un DataFrame BigQuery utilizzando il job di query eseguito in precedenza nell'editor di query, segui questi passaggi:

Vai alla sezione Set di risultati caricato da un job BigQuery come DataFrame.

Nel blocco di codice, fai clic su Esegui cella.

I risultati della query vengono visualizzati in un DataFrame BigQuery.

Per ottenere metriche descrittive per i dati:

Vai alla sezione Mostra statistiche descrittive utilizzando describe().

Nel blocco di codice, fai clic su Esegui cella.

I risultati vengono visualizzati in un DataFrame BigQuery.

(Facoltativo) Utilizza altre funzioni o pacchetti Python per esplorare e analizzare i dati.

Il seguente esempio di codice mostra l'utilizzo di

bigframes.pandas

per analizzare i dati e di bigframes.ml

per creare un modello di regressione lineare dai dati penguins in un

DataFrame BigQuery:

Libera spazio

Per evitare che al tuo account Google Cloud vengano addebitati costi relativi alle risorse utilizzate in questo tutorial, elimina il progetto che contiene le risorse oppure mantieni il progetto ed elimina le singole risorse.

Il modo più semplice per eliminare la fatturazione è eliminare il Google Cloud progetto che hai creato per questo tutorial.

- Nella Google Cloud console, vai alla pagina Gestisci risorse.

- Nell'elenco dei progetti, seleziona il progetto che vuoi eliminare, quindi fai clic su Elimina.

- Nella finestra di dialogo, digita l'ID progetto e fai clic su Chiudi per eliminare il progetto.

Passaggi successivi

- Scopri di più su lla creazione di notebook in BigQuery.

- Scopri di più sull'esplorazione dei dati con BigQuery DataFrames.