このチュートリアルでは、エージェントを作成し、Agent Development Kit(ADK)ストリーミングを使用して音声と動画の通信を有効にする方法について説明します。ADK をインストールし、Google 検索を使用する基本エージェントを設定して、adk

web ツールでエージェントを実行します。

始める前に

このガイドは、Windows、macOS、Linux 環境でターミナルを使用した経験があることを前提としています。

環境を設定して ADK をインストールする

このセクションでは、ローカル環境を準備する方法について説明します。

仮想環境を作成して有効にします。仮想環境を使用することをおすすめします。

# Create the environment python -m venv .venv # Activate the environment in each new terminal # For macOS or Linux: source .venv/bin/activate # For Windows CMD: .venv\Scripts\activate.bat # For Windows PowerShell: .venv\Scripts\Activate.ps1ADK をインストールします。

pip install google-adk

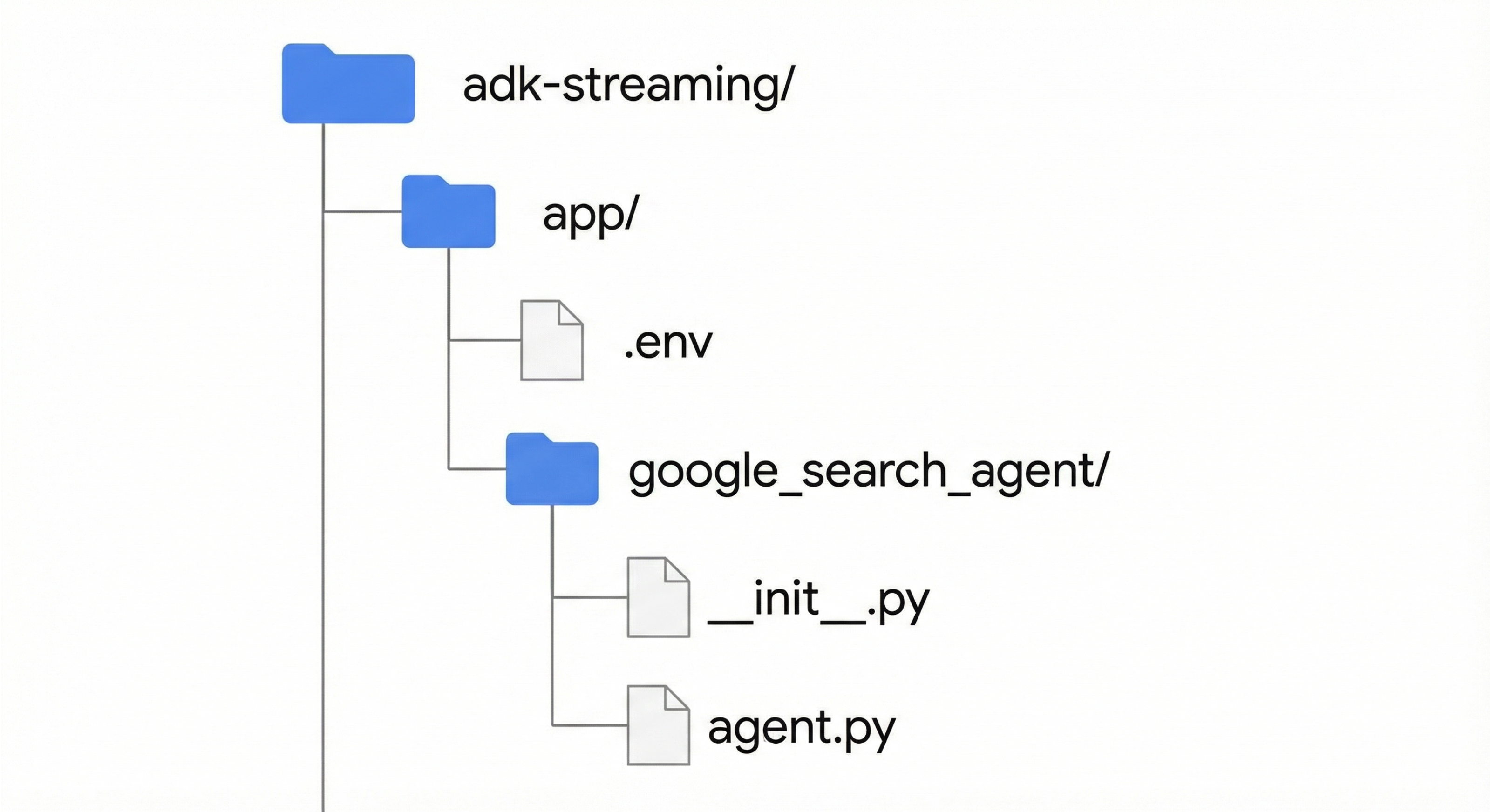

プロジェクトの構造を作成する

エージェントに必要なディレクトリとファイルを作成します。

空のファイルを含む次のフォルダ構造を作成します。

app/google_search_agent/agent.pyファイルに次のコードを追加します。このファイルでエージェントのロジックを定義します。root_agentを定義する必要があります。from google.adk.agents import Agent from google.adk.tools import google_search # Import the tool root_agent = Agent( # A unique name for the agent. name="basic_search_agent", # The Large Language Model (LLM) that agent will use. # Please fill in the latest model id that supports live from # https://google.github.io/adk-docs/get-started/streaming/quickstart-streaming/#supported-models model="...", # for example: model="gemini-live-2.5-flash-preview-native-audio-09-2025" # A short description of the agent's purpose. description="Agent to answer questions using Google Search.", # Instructions to set the agent's behavior. instruction="You are an expert researcher. You always stick to the facts.", # Add google_search tool to perform grounding with Google search. tools=[google_search] )app/google_search_agent/__init__.pyファイルに次のコードを追加します。from . import agent

プラットフォームを設定する

エージェントを実行するには、 Google Cloud Vertex AI を使用するように構成します。

app/ディレクトリにある.envファイルを開きます。このファイルに次の内容を追加します。

PROJECT_IDは実際の Google Cloud プロジェクト ID に、LOCATIONは実際の Google Cloud ロケーションに置き換えます。GOOGLE_CLOUD_PROJECT=PROJECT_ID GOOGLE_CLOUD_LOCATION=LOCATION GOOGLE_GENAI_USE_VERTEXAI=True

開発 UI を使用してエージェントを実行する

開発ユーザー インターフェースを起動して、エージェントを操作します。

現在のディレクトリを

appに変更します。cd appSSL_CERT_FILE環境変数を設定します。このステップは、音声と動画のテストに必要です。macOS / Linux

export SSL_CERT_FILE=$(python -m certifi)

Windows

$env:SSL_CERT_FILE = (python -m certifi)

開発 UI を実行します。

adk webターミナルに表示された URL(通常は

http://localhost:8000またはhttp://127.0.0.1:8000)を開きます。[

google_search_agent] を選択します。

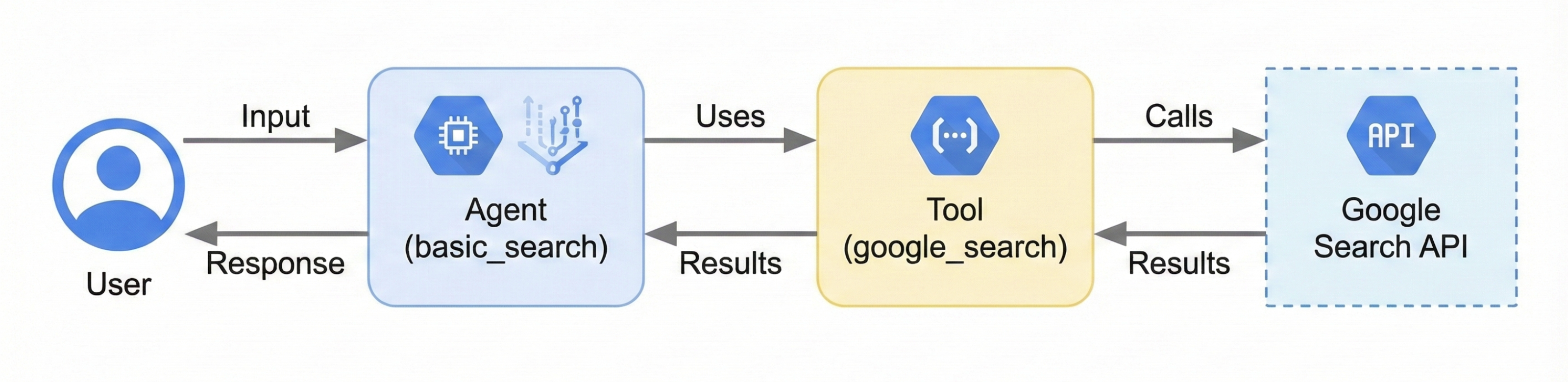

次の図は、ユーザー入力がどのようにエージェントに流れ、エージェントがどのように Google 検索ツールを使用し、エージェントがどのようにレスポンスを返すかを示しています。

エージェントと対話する

開発 UI を起動すると、テキスト、音声、動画を使用してエージェントと対話できます。

テキスト入力を使用する

次のプロンプトを UI に入力して、エージェントのテキストベースのレスポンスをテストします。エージェントは google_search ツールを使用して、以下の質問に回答するための最新情報を取得します。

- ニューヨークの天気は?

- ニューヨークは何時?

- パリの天気は?

- パリは何時?

音声と動画の入力を使用する

音声入力を使用するには、ウェブブラウザを再読み込みしてマイクボタンをクリックします。質問すると、リアルタイムで回答が返ってきます。

動画入力を使用するには、ウェブブラウザを再読み込みしてカメラボタンをクリックします。「何が見えますか?」といった質問をすると、エージェントは動画入力から認識した内容を説明します。

開発 UI を停止する

adk web ツールを停止するには、実行中のターミナルで Ctrl+C を押します。

次のステップ

- ADK を使用した Live API の開発について詳しくは、ADK のドキュメントをご覧ください。

- 双方向ストリーミングのデモをご覧ください。

- Gen AI SDK の使用を開始する。

- WebSocket の使用を開始する。

- Live API デモ ウェブアプリを実行する。