Nesta página, descrevemos como inserir objetos em uma imagem, um processo também conhecido como inpainting. Com o Imagen na Vertex AI, é possível especificar uma área de máscara para inserir objetos em uma imagem. É possível usar sua própria máscara ou permitir que o Imagen gere uma máscara para você.

Os seguintes modelos permitem inserir objetos em uma imagem:

Exemplo de inserção de conteúdo

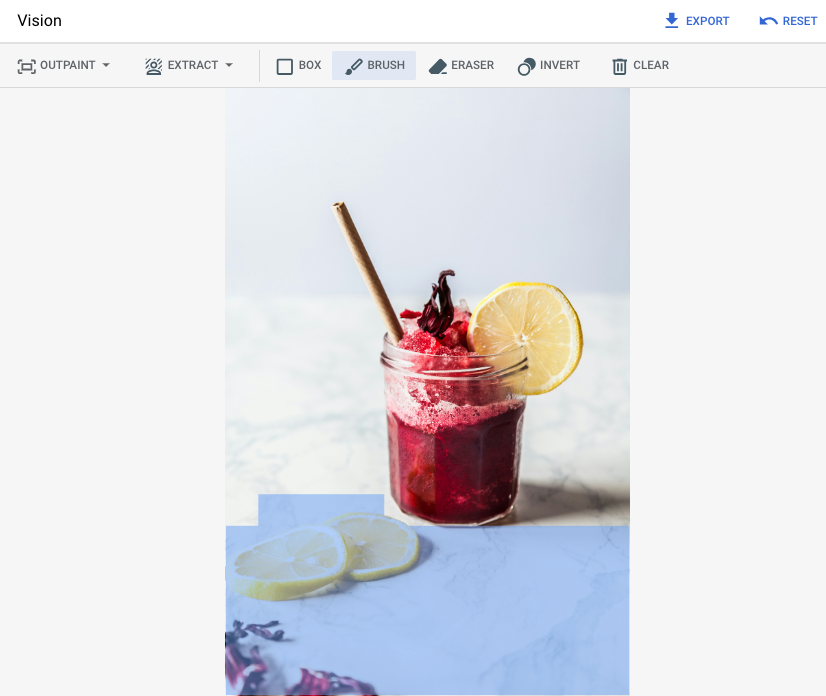

Com o retoque, é possível usar uma imagem de base, uma máscara de imagem e uma solicitação de texto para adicionar conteúdo a uma imagem.

Entradas

| Imagem de base* para editar | Mascarar a área especificada usando ferramentas no console Google Cloud | Comando de texto |

|---|---|---|

|

|

morangos |

* Crédito da imagem: Alex Lvrs no Unsplash.

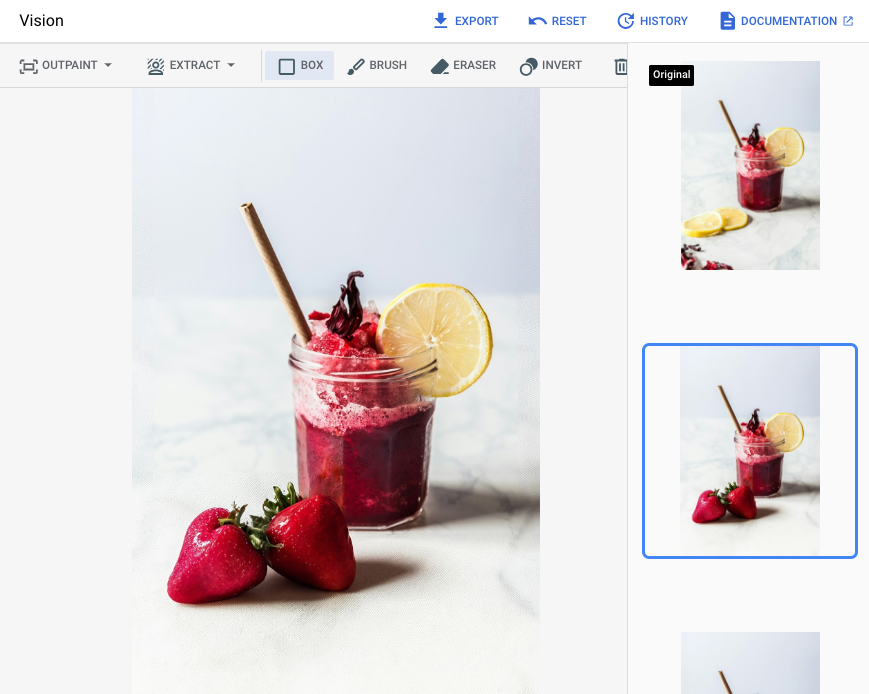

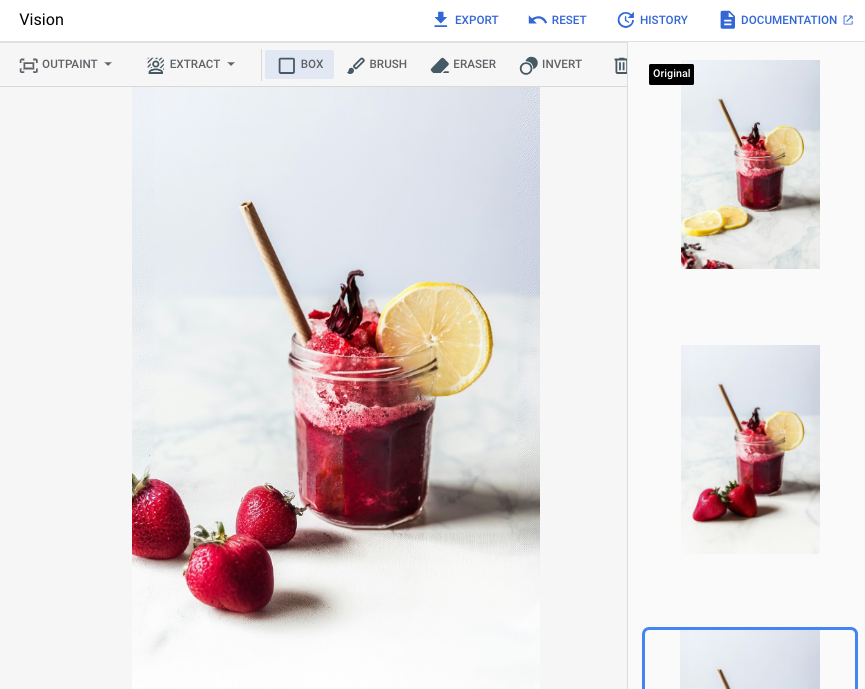

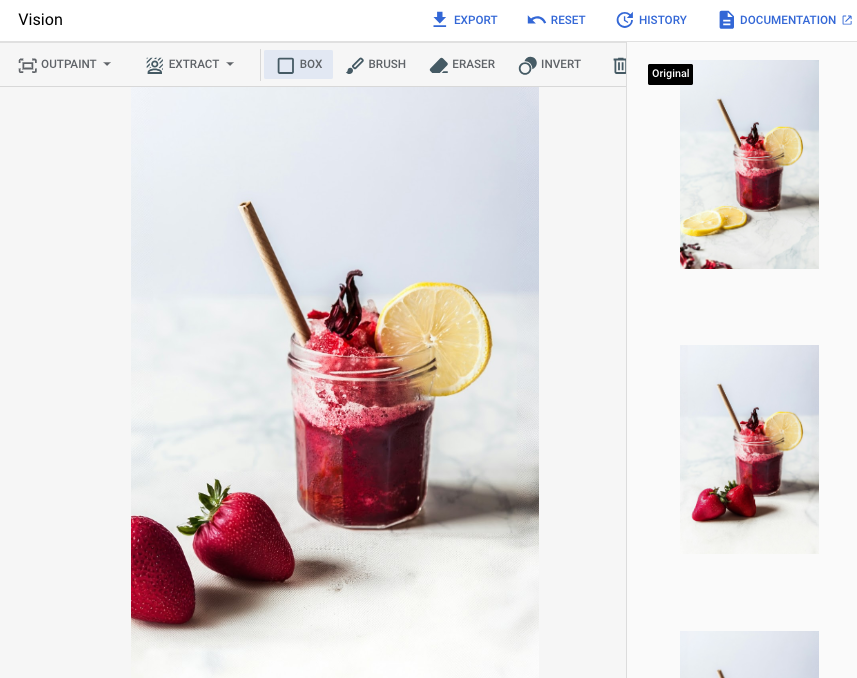

Saída após especificar uma área de máscara no console do Google Cloud

|

|

|

Ver o card de modelo do Imagen para edição e personalização

Antes de começar

- Faça login na sua conta do Google Cloud . Se você começou a usar o Google Cloud, crie uma conta para avaliar o desempenho de nossos produtos em situações reais. Clientes novos também recebem US$ 300 em créditos para executar, testar e implantar cargas de trabalho.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Vertex AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Vertex AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

Configure a autenticação do ambiente.

Selecione a guia para como planeja usar as amostras nesta página:

Console

Quando você usa o console Google Cloud para acessar serviços Google Cloud e APIs, não é necessário configurar a autenticação.

Python

Para usar os exemplos do Python nesta página em um ambiente de desenvolvimento local, instale e inicialize a CLI gcloud e configure o Application Default Credentials com suas credenciais de usuário.

-

Instale a CLI do Google Cloud.

-

Ao usar um provedor de identidade (IdP) externo, primeiro faça login na gcloud CLI com sua identidade federada.

-

Se você estiver usando um shell local, crie credenciais de autenticação local para sua conta de usuário:

gcloud auth application-default login

Não é necessário fazer isso se você estiver usando o Cloud Shell.

Se um erro de autenticação for retornado e você estiver usando um provedor de identidade (IdP) externo, confirme se você fez login na CLI gcloud com sua identidade federada.

Para mais informações, consulte Configurar o ADC para um ambiente de desenvolvimento local na documentação de autenticação do Google Cloud .

REST

Para usar as amostras da API REST desta página em um ambiente de desenvolvimento local, use as credenciais fornecidas para gcloud CLI.

Instale a CLI do Google Cloud.

Ao usar um provedor de identidade (IdP) externo, primeiro faça login na gcloud CLI com sua identidade federada.

Saiba mais em Autenticar para usar REST na documentação de autenticação do Google Cloud .

-

Inserir com uma área de máscara definida

Use os exemplos a seguir para enviar uma solicitação de repintura usando o modelo Imagen 3.

Console

No console do Google Cloud , acesse a página Vertex AI > Vertex AI Studio .

Clique em Gerar mídia.

Clique em Imagem.

Na lista Tarefa, selecione Inpaint-add.

Na lista Modelo, selecione o modelo do Imagen que você quer usar.

Em Imagem de entrada, clique em Adicionar e selecione a imagem que você está editando para fazer o upload.

Na caixa Comando, insira um comando que descreva como editar a imagem.

Faça o seguinte para especificar uma máscara:

- Faça upload da sua própria máscara:

- Crie uma máscara no computador.

- Clique em upload Máscara de importação e selecione uma máscara para fazer upload.

- Defina a máscara: na barra de ferramentas de edição, use as ferramentas de máscara (caixa, pincel ou masked_transitions inverter) para especificar a área ou áreas às quais adicionar conteúdo.

- Faça upload da sua própria máscara:

Clique em Executar.

Python

Instalar

pip install --upgrade google-genai

Para saber mais, consulte a documentação de referência do SDK.

Defina variáveis de ambiente para usar o SDK de IA generativa com a Vertex AI:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=us-central1 export GOOGLE_GENAI_USE_VERTEXAI=True

REST

Para mais informações sobre a API Imagen, consulte:- Método:

endpoints.predict VisionGenerativeModelInstanceVisionGenerativeModelParamsVisionGenerativeModelResult

Antes de usar os dados da solicitação abaixo, faça as substituições a seguir:

-

REGION: a região em que o projeto está localizado. Para mais informações sobre as regiões com suporte, consulte Locais da IA generativa na Vertex AI. -

PROJECT_ID: o ID do projeto do Google Cloud . -

TEXT_PROMPT: Opcional. Um comando de texto para orientar as imagens que o modelo gera. Para ter os melhores resultados, use uma descrição da área mascarada e evite comandos de uma só palavra. Por exemplo, use "um corgi fofo" em vez de "corgi". -

B64_BASE_IMAGE: Uma imagem codificada em base64 da imagem que está sendo editada com tamanho de 10 MB ou menos. Para mais informações sobre a codificação em base64, consulte Codificar e decodificar arquivos em base64. -

B64_MASK_IMAGE: Uma imagem de máscara em preto e branco codificada em base64 com tamanho de até 10 MB. -

MASK_DILATION: Opcional. Um valor de ponto flutuante entre 0 e 1, inclusive, que representa a porcentagem da largura da imagem para aumentar a máscara. O uso dedilationajuda a compensar máscaras imprecisas. Recomendamos um valor de0.01. -

EDIT_STEPS: Opcional. Um número inteiro que representa o número de etapas de amostragem. Um valor mais alto oferece melhor qualidade de imagem, e um valor mais baixo oferece melhor latência.Recomendamos que você siga as etapas

35para começar. Se a qualidade não atender aos seus requisitos, aumente o valor até um limite superior de75. -

SAMPLE_COUNT: Opcional. Um número inteiro que descreve a quantidade de imagens a serem geradas. O intervalo de valores aceito é1-4. O valor padrão é4.

Método HTTP e URL:

POST https://REGION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/REGION/publishers/google/models/imagen-3.0-capability-001:predict

Corpo JSON da solicitação:

{

"instances": [

{

"prompt": "TEXT_PROMPT",

"referenceImages": [

{

"referenceType": "REFERENCE_TYPE_RAW",

"referenceId": 1,

"referenceImage": {

"bytesBase64Encoded": "B64_BASE_IMAGE"

}

},

{

"referenceType": "REFERENCE_TYPE_MASK",

"referenceImage": {

"bytesBase64Encoded": "B64_MASK_IMAGE"

},

"maskImageConfig": {

"maskMode": "MASK_MODE_USER_PROVIDED",

"dilation": MASK_DILATION

}

}

]

}

],

"parameters": {

"editConfig": {

"baseSteps": EDIT_STEPS

},

"editMode": "EDIT_MODE_INPAINT_INSERTION",

"sampleCount": SAMPLE_COUNT

}

}

Para enviar a solicitação, escolha uma destas opções:

curl

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando abaixo:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://REGION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/REGION/publishers/google/models/imagen-3.0-capability-001:predict"

PowerShell

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando abaixo:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://REGION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/REGION/publishers/google/models/imagen-3.0-capability-001:predict" | Select-Object -Expand Content

"sampleCount": 2. A resposta retorna dois objetos de previsão, com os bytes de imagem gerados codificados em base64.

{

"predictions": [

{

"bytesBase64Encoded": "BASE64_IMG_BYTES",

"mimeType": "image/png"

},

{

"mimeType": "image/png",

"bytesBase64Encoded": "BASE64_IMG_BYTES"

}

]

}

Inserir com detecção automática de máscaras

Use os exemplos a seguir para especificar o retoque a fim de inserir conteúdo. Nessas amostras, você especifica uma imagem de base e um comando de texto. O Imagen detecta e cria automaticamente uma área de máscara para modificar a imagem de base.

Console

No console do Google Cloud , acesse a página Vertex AI > Vertex AI Studio .

Clique em Gerar mídia.

Clique em Imagem.

Na lista Tarefa, selecione Inpaint-add.

Na lista Modelo, selecione o modelo do Imagen que você quer usar.

Em Imagem de entrada, clique em Adicionar e selecione a imagem que você está editando para fazer o upload.

Na caixa Comando, insira um comando que descreva como editar a imagem.

Na barra de ferramentas de edição, clique em background_replaceExtrair máscara.

Selecione uma das opções de extração de máscara:

Elementos de segundo plano: detecta os elementos de segundo plano e cria uma máscara em torno deles.

Elementos em primeiro plano: detecta os objetos em primeiro plano e cria uma máscara ao redor deles.

background_replace Pessoas: detecta pessoas e cria uma máscara ao redor delas.

Clique em Executar.

Python

Instalar

pip install --upgrade google-genai

Para saber mais, consulte a documentação de referência do SDK.

Defina variáveis de ambiente para usar o SDK de IA generativa com a Vertex AI:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=us-central1 export GOOGLE_GENAI_USE_VERTEXAI=True

REST

Para mais informações sobre a API Imagen, consulte:

- Método:

endpoints.predict VisionGenerativeModelInstanceVisionGenerativeModelParamsVisionGenerativeModelResult

Antes de usar os dados da solicitação abaixo, faça as substituições a seguir:

- PROJECT_ID: o ID do projeto do Google Cloud .

- LOCATION: a região do seu projeto. Por exemplo,

us-central1,europe-west2ouasia-northeast3. Para uma lista de regiões disponíveis, consulte IA generativa em locais da Vertex AI. Quando um endpoint de API regional é usado, a região do URL do endpoint determina onde a solicitação é processada, e esseLOCATIONno caminho do recurso é ignorado se houver conflito. - TEXT_PROMPT: o prompt de texto fornece orientações sobre quais imagens o modelo gera. Ao usar um comando para inserção de repintura, use uma descrição da área mascarada para ter os melhores resultados. Evite comandos de uma só palavra. Por exemplo, use "um corgi fofo" em vez de "corgi".

- B64_BASE_IMAGE: a imagem de base que será editada ou aprimorada. A imagem precisa ser especificada como uma string de bytes codificada em base64. Limite de tamanho: 10 MB.

- MASK_MODE: uma string que define o tipo de criação automática de máscara usada pelo modelo.

Valores disponíveis:

MASK_MODE_BACKGROUND: gera automaticamente uma máscara usando a segmentação de segundo plano.MASK_MODE_FOREGROUND: gera automaticamente uma máscara usando a segmentação em primeiro plano.MASK_MODE_SEMANTIC: gera automaticamente uma máscara usando a segmentação semântica com base nas classes de segmentação especificadas na matrizmaskImageConfig.maskClasses. Por exemplo:"maskImageConfig": { "maskMode": "MASK_MODE_SEMANTIC", "maskClasses": [175, 176], // bicycle, car "dilation": 0.01 }

- MASK_DILATION: ponto flutuante. A porcentagem da largura da imagem para dilatar essa máscara. Um valor de

0.01é recomendado para compensar máscaras de entrada imperfeitas. - EDIT_STEPS: número inteiro. O número de etapas de amostragem para o modelo de base. Para

inserção de repintura, comece com

35etapas. Aumente as etapas até o limite superior de75se a qualidade não atender aos seus requisitos. Aumentar as etapas também aumenta a latência da solicitação. - EDIT_IMAGE_COUNT: o número de imagens editadas. Valores inteiros aceitos: 1 a 4. Valor padrão: 4.

Método HTTP e URL:

POST https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict

Corpo JSON da solicitação:

{

"instances": [

{

"prompt": "TEXT_PROMPT",

"referenceImages": [

{

"referenceType": "REFERENCE_TYPE_RAW",

"referenceId": 1,

"referenceImage": {

"bytesBase64Encoded": "B64_BASE_IMAGE"

}

},

{

"referenceType": "REFERENCE_TYPE_MASK",

"referenceId": 2,

"maskImageConfig": {

"maskMode": "MASK_MODE",

"dilation": MASK_DILATION

}

}

]

}

],

"parameters": {

"editConfig": {

"baseSteps": EDIT_STEPS

},

"editMode": "EDIT_MODE_INPAINT_INSERTION",

"sampleCount": EDIT_IMAGE_COUNT

}

}

Para enviar a solicitação, escolha uma destas opções:

curl

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando abaixo:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict"

PowerShell

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando a seguir:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict" | Select-Object -Expand Content

"sampleCount": 2. A resposta retorna dois objetos de previsão, com os bytes de imagem gerados codificados em base64.

{

"predictions": [

{

"bytesBase64Encoded": "BASE64_IMG_BYTES",

"mimeType": "image/png"

},

{

"mimeType": "image/png",

"bytesBase64Encoded": "BASE64_IMG_BYTES"

}

]

}

Limitações

As seções a seguir explicam as limitações do recurso de remoção de objetos da Imagen.

Pixels modificados

O modelo gera pixels na própria resolução (por exemplo, 1024 x 1024), que pode ser diferente da resolução da imagem de entrada. Isso significa que a imagem gerada pode ter pequenas mudanças que não estavam na imagem original.

Para preservar perfeitamente a imagem, recomendamos misturar a imagem gerada com a imagem de entrada usando a máscara. Normalmente, se a resolução da imagem de entrada for 2K ou superior, será necessário combinar a imagem gerada e a imagem de entrada.

Inserir limitação

Embora o objeto inserido geralmente corresponda ao estilo da imagem de base, algumas palavras-chave podem produzir resultados semelhantes a desenhos animados em vez de uma saída fotorrealista.

Por exemplo, pedir uma "girafa amarela" pode resultar em uma imagem de desenho animado, porque as girafas são naturalmente marrons e bronzeadas. Gerar imagens fotorrealistas com cores não naturais pode ser difícil.

A seguir

Confira artigos sobre o Imagen e outras IAs generativas nos produtos da Vertex AI:

- Guia para desenvolvedores sobre como começar a usar o Imagen 3 na Vertex AI

- Novos modelos e ferramentas de mídia generativa criados com criadores para criadores

- Novidades no Gemini: Gems personalizados e geração de imagens aprimorada com o Imagen 3

- Google DeepMind: Imagen 3 — Nosso modelo de qualidade mais alta para conversão de texto em imagem