Sie können Abfrageergebnisse mit SQL-Zellen oder Codezellen in BigQuery Colab Enterprise-Notebooks untersuchen.

In dieser Anleitung fragen Sie Daten aus einem öffentlichen BigQuery-Dataset ab und untersuchen die Abfrageergebnisse in einem Notebook.

Lernziele

- Erstellen Sie eine Abfrage in BigQuery und führen Sie sie aus.

- Abfrageergebnisse in einem Notebook mit SQL-Zellen und Codezellen ansehen.

Kosten

In dieser Anleitung wird ein Dataset aus dem Google Cloud Public Datasets-Programm verwendet. Google bezahlt die Speicherung dieser Datasets und bietet öffentlichen Zugriff auf die Daten. Für die Abfragen, die Sie für die Daten ausführen, fallen Kosten an. Weitere Informationen finden Sie unter BigQuery-Preise.

Hinweis

-

Wählen Sie in der Google Cloud Console auf der Seite für die Projektauswahl ein Google Cloud -Projekt aus oder erstellen Sie eines.

Rollen, die zum Auswählen oder Erstellen eines Projekts erforderlich sind

- Projekt auswählen: Für die Auswahl eines Projekts ist keine bestimmte IAM-Rolle erforderlich. Sie können jedes Projekt auswählen, für das Ihnen eine Rolle zugewiesen wurde.

-

Projekt erstellen: Zum Erstellen eines Projekts benötigen Sie die Rolle „Projektersteller“ (

roles/resourcemanager.projectCreator), die die Berechtigungresourcemanager.projects.createenthält. Weitere Informationen zum Zuweisen von Rollen

-

Prüfen Sie, ob für Ihr Google Cloud Projekt die Abrechnung aktiviert ist.

-

Aktivieren Sie die BigQuery API.

Rollen, die zum Aktivieren von APIs erforderlich sind

Zum Aktivieren von APIs benötigen Sie die IAM-Rolle „Service Usage-Administrator“ (

roles/serviceusage.serviceUsageAdmin), die die Berechtigungserviceusage.services.enableenthält. Weitere Informationen zum Zuweisen von RollenBei neuen Projekten ist BigQuery automatisch aktiviert.

Standardregion für Code-Assets festlegen

Für alle neuen Code-Assets in Ihrem Google Cloud -Projekt wird eine Standardregion verwendet. Nachdem das Asset erstellt wurde, können Sie seine Region nicht mehr ändern.

So legen Sie die Standardregion für neue Code-Assets fest:

Rufen Sie die Seite BigQuery auf.

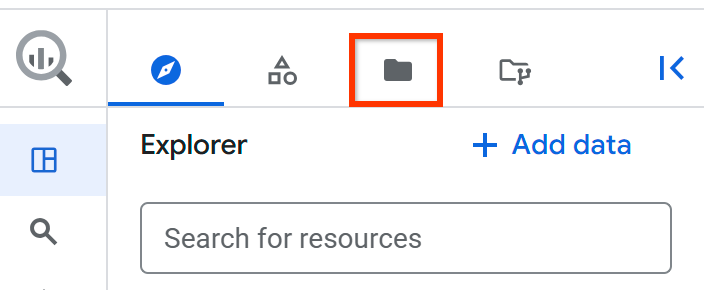

Klicken Sie im linken Bereich auf Dateien, um den Dateibrowser zu öffnen:

Klicken Sie neben dem Projektnamen auf Aktionen für den Bereich „Dateien“ ansehen > Code-Region wechseln.

Wählen Sie die Code-Region aus, die Sie als Standard verwenden möchten.

Klicken Sie auf Speichern.

Eine Liste der unterstützten Regionen finden Sie unter BigQuery Studio-Standorte.

Erforderliche Berechtigungen

Zum Erstellen und Ausführen von Notebooks benötigen Sie die folgenden IAM-Rollen (Identity and Access Management):

- BigQuery-Nutzer (

roles/bigquery.user) - Notebook Runtime-Nutzer (

roles/aiplatform.notebookRuntimeUser) - Code Creator (

roles/dataform.codeCreator)

Abfrageergebnisse in einem Notebook öffnen

Sie können eine SQL-Abfrage ausführen und dann ein Notebook verwenden, um die Daten auszuwerten. Diese Vorgehensweise ist nützlich, wenn Sie die Daten in BigQuery ändern möchten, bevor Sie mit ihnen arbeiten, oder wenn Sie nur eine Teilmenge der Tabellenfelder benötigen.

Rufen Sie in der Google Cloud Console die Seite BigQuery auf.

Klicken Sie im linken Bereich auf Explorer.

Rufen Sie das Projekt

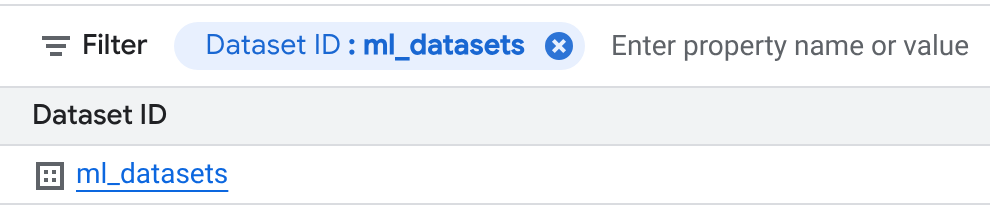

bigquery-public-dataauf, klicken Sie auf Knoten ein-/ausblenden, um es zu maximieren, und klicken Sie dann auf Datasets. Im Detailbereich wird ein neuer Tab geöffnet, auf dem eine Liste aller Datasets im Projekt angezeigt wird.Wählen Sie im Feld Filter die Option Dataset-ID aus und geben Sie ml_datasets ein.

Klicken Sie auf der Seite Datasets auf ml_datasets > penguins.

Klicken Sie auf Abfrage.

Fügen Sie der generierten Abfrage ein Sternchen (

*) für die Feldauswahl hinzu, damit sie wie im folgenden Beispiel aussieht:SELECT * FROM `bigquery-public-data.ml_datasets.penguins` LIMIT 1000;

Klicken Sie auf Ausführen.

Klicken Sie im Bereich Abfrageergebnisse auf Öffnen in und dann auf Notebook.

Notebook für die Verwendung vorbereiten

Bereiten Sie das Notebook für die Verwendung vor, indem Sie eine Verbindung zu einer Laufzeit herstellen und Standardwerte für die Anwendung festlegen.

Klicken Sie in der Notebook-Kopfzeile auf Verbinden, um eine Verbindung zur Standardlaufzeit herzustellen.

Klicken Sie im Codeblock Einrichtung auf Zelle ausführen.

Öffentliche Daten durchsuchen

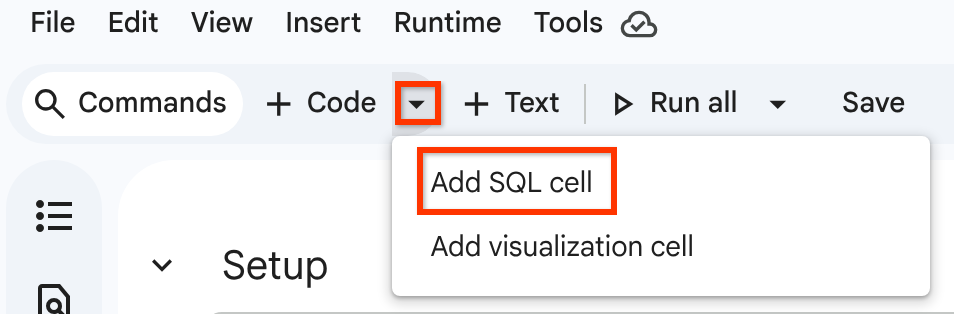

Klicken Sie auf Optionen für das Einfügen von Codezellen> SQL-Zelle hinzufügen.

Geben Sie die folgende Abfrage in die SQL-Zelle ein:

SELECT * FROM `bigquery-public-data.ml_datasets.penguins` LIMIT 1000;Klicken Sie auf Zelle ausführen.

Die Abfrageergebnisse werden in einem BigQuery-DataFrame angezeigt.

Alternativ können Sie die Abfrageergebnisse in einen BigQuery-DataFrame laden. Verwenden Sie dazu den Abfragejob, den Sie zuvor im Abfrageeditor ausgeführt haben. Gehen Sie so vor:

Rufen Sie den Abschnitt Ergebnismenge, die aus dem BigQuery-Job als DataFrame geladen wurde auf.

Klicken Sie im Codeblock auf Zelle ausführen.

Die Abfrageergebnisse werden in einem BigQuery-DataFrame angezeigt.

So rufen Sie deskriptive Messwerte für die Daten ab:

Rufen Sie den Abschnitt Beschreibende Statistiken mit describe() anzeigen auf.

Klicken Sie im Codeblock auf Zelle ausführen.

Die Ergebnisse werden in einem BigQuery-DataFrame angezeigt.

Optional: Verwenden Sie andere Python-Funktionen oder -Pakete, um die Daten auszuwerten und zu analysieren.

Im folgenden Codebeispiel wird die Verwendung von bigframes.pandas zum Analysieren von Daten und von bigframes.ml zum Erstellen eines linearen Regressionsmodells aus Pinguin-Daten in einem BigQuery-DataFrame:

Bereinigen

Damit Ihrem Google Cloud-Konto die in dieser Anleitung verwendeten Ressourcen nicht in Rechnung gestellt werden, löschen Sie entweder das Projekt, das die Ressourcen enthält, oder Sie behalten das Projekt und löschen die einzelnen Ressourcen.

Am einfachsten vermeiden Sie weitere Kosten, indem Sie das für diese Anleitung erstellte Google Cloud Projekt löschen.

- Wechseln Sie in der Google Cloud -Console zur Seite Ressourcen verwalten.

- Wählen Sie in der Projektliste das Projekt aus, das Sie löschen möchten, und klicken Sie dann auf Löschen.

- Geben Sie im Dialogfeld die Projekt-ID ein und klicken Sie auf Shut down (Beenden), um das Projekt zu löschen.

Nächste Schritte

- Weitere Informationen zum Erstellen von Notebooks in BigQuery

- Daten mit BigQuery DataFrames untersuchen