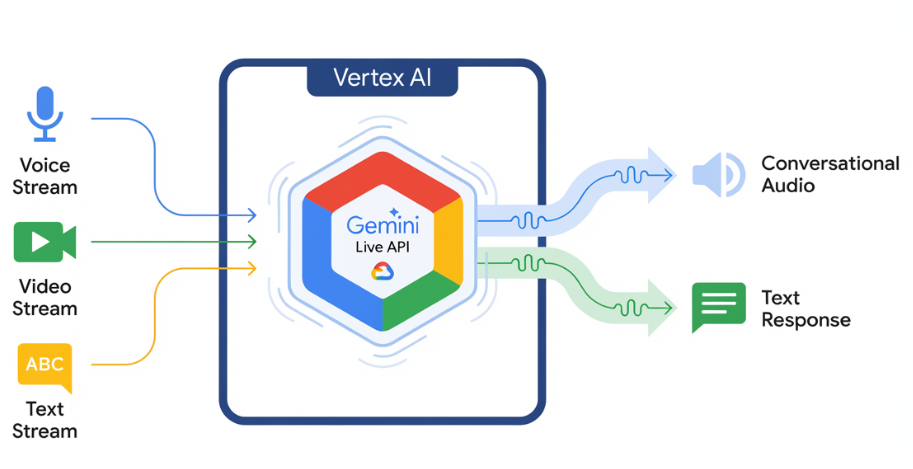

L'API Gemini Live consente interazioni vocali e video a bassa latenza e in tempo reale con Gemini. Elabora flussi continui di audio, video o testo per fornire risposte immediate e simili a quelle umane. In questo modo, gli utenti possono usufruire di un'esperienza di conversazione naturale.

Prova l'API Gemini Live in Vertex AI Studio

Esempi di casi d'uso

L'API Gemini Live può essere utilizzata per creare agenti vocali e video in tempo reale per una varietà di settori, tra cui:

- E-commerce e vendita al dettaglio:assistenti per lo shopping che offrono consigli personalizzati e agenti di assistenza che risolvono i problemi dei clienti.

- Gaming:personaggi non giocanti (NPC) interattivi, assistenti di aiuto in-game e traduzione in tempo reale dei contenuti in-game.

- Interfacce di nuova generazione:esperienze abilitate per voce e video in robotica, occhiali smart e veicoli.

- Sanità:assistenti per la salute per l'assistenza e l'istruzione dei pazienti.

- Servizi finanziari:consulenti AI per la gestione patrimoniale e la consulenza sugli investimenti.

- Istruzione:mentori AI e compagni di apprendimento che forniscono istruzioni e feedback personalizzati.

Funzionalità principali

L'API Gemini Live offre un insieme completo di funzionalità per la creazione di agenti vocali e video robusti:

- Audio di alta qualità: l'API Gemini Live offre una voce naturale e realistica in più lingue.

- Supporto multilingue: Comunica in 24 lingue supportate.

- Interruzione: Gli utenti possono interrompere il modello in qualsiasi momento per interazioni reattive.

- Dialogo affettivo: Adatta lo stile e il tono della risposta in base all'espressione dell'input dell'utente.

- Uso di strumenti: integra strumenti come la chiamata di funzioni e la Ricerca Google per interazioni dinamiche.

- Trascrizioni audio: Fornisce trascrizioni di testo sia dell'input utente sia dell'output del modello.

- Traduzione vocale: (sperimentale privata) Ottimizzata per la traduzione a bassa latenza tra le lingue.

- Audio proattivo: (anteprima) Ti consente di controllare quando e in quali contesti il modello risponde.

Specifiche tecniche

La seguente tabella descrive le specifiche tecniche dell'API Gemini Live:

| Categoria | Dettagli |

|---|---|

| Modalità di input | Audio (audio PCM a 16 bit non elaborato, 16 kHz, little-endian), immagini/video (JPEG 1 FPS), testo |

| Modalità di output | Audio (audio PCM a 16 bit non elaborato, 24 kHz, little-endian), testo |

| Protocollo | Connessione WebSocket con stato (WSS) |

Modelli supportati

I seguenti modelli supportano l'API Gemini Live. Seleziona il modello appropriato in base ai tuoi requisiti di interazione.

| ID modello | Disponibilità | Caso d'uso | Funzionalità principali |

|---|---|---|---|

gemini-live-2.5-flash-native-audio |

Disponibilità generale | Opzione consigliata. Agenti vocali a bassa latenza. Supporta il cambio di lingua senza interruzioni e il tono emotivo. |

|

gemini-live-2.5-flash-preview-native-audio-09-2025 |

Anteprima pubblica | Efficienza dei costi negli agenti vocali in tempo reale. |

|

gemini-2.5-flash-s2st-exp-11-2025 |

Privato sperimentale | Traduzione vocale. Ottimizzato per attività di traduzione vocale in tempo reale. |

|

Inizia

Seleziona la guida corrispondente al tuo ambiente di sviluppo:

Tutorial sull'SDK Gen AI

Connettiti all'API Gemini Live utilizzando l'SDK Gen AI per creare un'applicazione multimodale in tempo reale con un backend Python.

Tutorial su WebSocket

Connettiti all'API Gemini Live utilizzando WebSockets per creare un'applicazione multimodale in tempo reale con un frontend JavaScript e un backend Python.

Tutorial ADK

Crea un agente e utilizza lo streaming dell'Agent Development Kit (ADK) per abilitare la comunicazione vocale e video.

Integrazioni con i partner

Se vuoi effettuare l'integrazione con alcuni dei nostri partner, queste piattaforme hanno già integrato l'API Gemini Live tramite il protocollo WebRTC per semplificare lo sviluppo di applicazioni audio e video in tempo reale.