Vertex AI מספק שירות אימון מנוהל שעוזר לכם להפעיל אימון של מודלים בקנה מידה גדול. אתם יכולים להשתמש ב-Vertex AI כדי להריץ אפליקציות לאימון שמבוססות על כל מסגרת של למידת מכונה (ML) בתשתיתGoogle Cloud . בנוסף, ל-Vertex AI יש תמיכה משולבת במסגרות הפופולריות הבאות של למידת מכונה, שמפשטת את תהליך ההכנה לאימון מודלים ולמילוי בקשות:

בדף הזה מוסבר על היתרונות של אימון ללא שרתים ב-Vertex AI, על תהליך העבודה ועל אפשרויות האימון השונות שזמינות.

אימון ב-Vertex AI בהיקף גדול

יש כמה אתגרים בהפיכת אימון מודלים לפעולה. האתגרים האלה כוללים את הזמן והעלות שנדרשים לאימון מודלים, את רמת המיומנויות שנדרשת לניהול תשתית המחשוב ואת הצורך לספק אבטחה ברמת הארגון. Vertex AI נותן מענה לאתגרים האלה ומספק מגוון יתרונות נוספים.

תשתית מחשוב מנוהלת באופן מלא

|

|

אימון מודלים ב-Vertex AI הוא שירות מנוהל במלואו שלא דורש ניהול של תשתית פיזית. אפשר לאמן מודלים של למידת מכונה בלי להקצות או לנהל שרתים. התשלום הוא רק על משאבי המחשוב שבהם אתם משתמשים. Vertex AI גם מטפל ברישום ביומן, בהוספה לתור ובמעקב של משימות. |

ביצועים גבוהים

|

|

משימות האימון ב-Vertex AI מותאמות לאימון מודלים של למידת מכונה, ולכן הן יכולות לספק ביצועים מהירים יותר מאשר הפעלה ישירה של אפליקציית האימון באשכול Google Kubernetes Engine (GKE). אפשר גם לזהות צווארי בקבוק בביצועים של משימת האימון ולנפות באגים באמצעות Cloud Profiler. |

אימון מבוזר

|

|

Reduction Server הוא אלגוריתם all-reduce ב-Vertex AI שיכול להגדיל את התפוקה ולהקטין את זמן האחזור של אימון מבוזר מרובה צמתים במעבדים גרפיים (GPU) של NVIDIA. האופטימיזציה הזו עוזרת לקצר את הזמן ולצמצם את העלות של השלמת משימות אימון גדולות. |

אופטימיזציה של היפר-פרמטרים

|

|

משימות כוונון של היפר-פרמטר מריצות כמה ניסויים של אפליקציית האימון באמצעות ערכים שונים של היפר-פרמטרים. מציינים טווח של ערכים לבדיקה, ו-Vertex AI מגלה את הערכים האופטימליים למודל בטווח הזה. |

אבטחה לארגונים

|

|

Vertex AI מספק את תכונות האבטחה הבאות ברמת הארגון:

|

שילובים של פעולות למידת מכונה (MLOps)

|

|

Vertex AI מספק חבילה של כלים ותכונות משולבים של MLOps שאפשר להשתמש בהם למטרות הבאות:

|

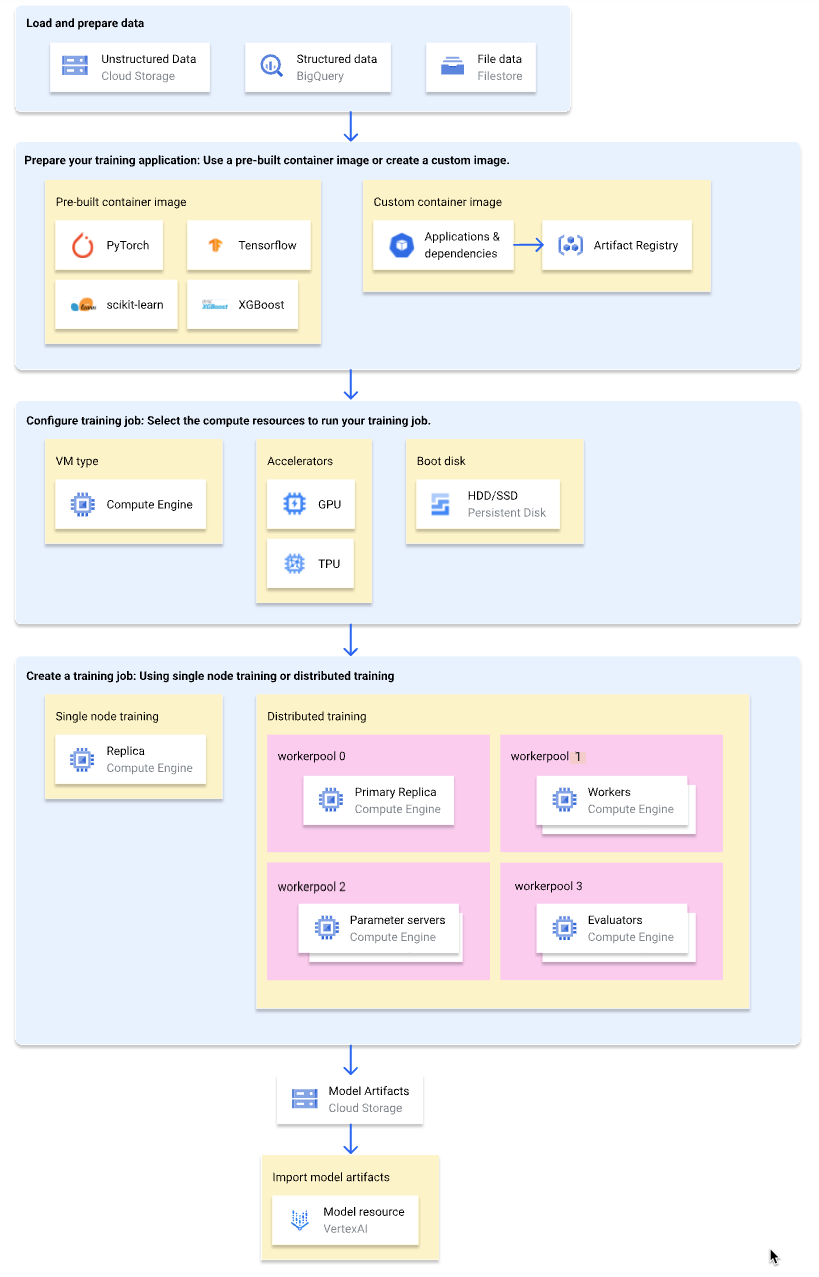

תהליך העבודה לאימון בלי שרת (serverless)

התרשים הבא מציג סקירה כללית ברמה גבוהה של תהליך העבודה של אימון בלי שרת (serverless) ב-Vertex AI. בקטעים הבאים מפורט כל שלב.

טעינה והכנה של נתוני אימון

כדי ליהנות מהביצועים הטובים ביותר ולקבל תמיכה, מומלץ להשתמש באחד מהשירותים הבאים Google Cloud כמקור הנתונים:

- Cloud Storage

- BigQuery

- מערכות קבצים עם רמת ביצועים גבוהה, כמו שיתופי NFS ב-Google Cloud באמצעות שירותים כמו Google Cloud NetApp Volumes או Filestore.

כאן אפשר לראות השוואה בין השירותים האלה.

אפשר גם לציין מערך נתונים מנוהל של Vertex AI כמקור הנתונים כשמשתמשים בצינור אימון כדי לאמן את המודל. אימון של מודל בהתאמה אישית ומודל AutoML באמצעות אותו מערך נתונים מאפשר להשוות את הביצועים של שני המודלים.

הכנת בקשת ההכשרה

כדי להכין את אפליקציית האימון לשימוש ב-Vertex AI, צריך לבצע את הפעולות הבאות:

- ליישם שיטות מומלצות לכתיבת קוד אימון ב-Vertex AI.

- קובעים את סוג קובץ אימג' של קונטיינר שרוצים להשתמש בו.

- אורזים את אפליקציית האימון בפורמט נתמך על סמך סוג קובץ האימג' של הקונטיינר שנבחר.

שימוש בשיטות מומלצות בקוד ההדרכה

באפליקציית האימון צריך להטמיע את השיטות המומלצות לכתיבת קוד אימון ב-Vertex AI. השיטות המומלצות האלה מתייחסות ליכולת של אפליקציית האימון לבצע את הפעולות הבאות:

- גישה Google Cloud לשירותים.

- טוענים את נתוני הקלט.

- הפעלת רישום אוטומטי ביומן למעקב אחר ניסויים.

- ייצוא פריטי מידע שנוצרו בתהליך הפיתוח (Artifact) של המודל.

- משתמשים במשתני הסביבה של Vertex AI.

- איך מוודאים שהמערכת עמידה בפני הפעלה מחדש של VM.

בחירת סוג מאגר

מערכת Vertex AI מריצה את אפליקציית האימון בקובץ אימג' של קונטיינר Docker. קובץ אימג' של קונטיינר Docker הוא חבילת תוכנה עצמאית שכוללת קוד וכל יחסי התלות, שאפשר להריץ כמעט בכל סביבת מחשוב. אפשר לציין את ה-URI של קובץ אימג' של קונטיינר מוכן מראש לשימוש, או ליצור קובץ אימג' של קונטיינר מותאם אישית ולהעלות אותו עם אפליקציית האימון והתלות שכבר מותקנות בו.

בטבלה הבאה מוצגים ההבדלים בין תמונות קונטיינר מוכנות מראש לבין תמונות קונטיינר בהתאמה אישית:

| מפרטים | קובצי אימג' של קונטיינרים מוכנים מראש | קובצי אימג' של קונטיינרים בהתאמה אישית |

|---|---|---|

| מסגרת ML | כל קובץ אימג' של קונטיינר ספציפי למסגרת ML. | אפשר להשתמש בכל מסגרת ML או לא להשתמש באף אחת. |

| גרסת מסגרת ML | כל קובץ אימג' של קונטיינר ספציפי לגרסה של מסגרת ML. | אפשר להשתמש בכל גרסה של framework ללמידת מכונה, כולל גרסאות משניות וגרסאות ליליות. |

| תלויות של אפליקציות | יחסי תלות נפוצים של מסגרת למידת המכונה מותקנים מראש. אתם יכולים לציין יחסי תלות נוספים להתקנה באפליקציית האימון. | מבצעים התקנה מראש של התלויות שהאפליקציה להדרכה צריכה. |

| פורמט שליחת אפליקציות |

|

מתקינים מראש את אפליקציית האימון בקובץ אימג' מותאם אישית של קונטיינר. |

| משך ההגדרה | נמוכה | גבוהה |

| מומלץ ל | אפליקציות לאימון ב-Python שמבוססות על מסגרת ML ועל גרסת המסגרת שיש לה קובץ אימג' מוכן מראש של קונטיינר. |

|

אריזת אפליקציית האימון

אחרי שקובעים את סוג קובץ האימג' של הקונטיינר שבו רוצים להשתמש, צריך לארוז את אפליקציית האימון באחד מהפורמטים הבאים, בהתאם לסוג קובץ האימג' של הקונטיינר:

קובץ Python יחיד לשימוש במאגר שנוצר מראש

כותבים את אפליקציית האימון כקובץ Python יחיד ומשתמשים ב-Vertex AI SDK ל-Python כדי ליצור מחלקה

CustomJobאוCustomTrainingJob. קובץ ה-Python נארז בהפצת מקור של Python ומוטמע בקובץ אימג' של קונטיינר שנבנה מראש. העברת אפליקציית האימון כקובץ Python יחיד מתאימה ליצירת אב טיפוס. בדרך כלל, אפליקציות אימון בסביבת ייצור מחולקות ליותר מקובץ אחד.הפצה של קוד מקור של Python לשימוש במאגר מוכן מראש

אורזים את אפליקציית האימון בהפצות של מקורות Python ומעלים אותן לקטגוריה של Cloud Storage. מערכת Vertex AI מתקינה את הפצות המקור בקובץ אימג' של קונטיינר שנבנה מראש כשיוצרים משימת אימון.

קובץ אימג' של קונטיינר בהתאמה אישית

יוצרים קובץ אימג' של קונטיינר Docker משלכם עם אפליקציית האימון והתלויות שהותקנו מראש, ומעלים אותו ל-Artifact Registry. אם אפליקציית האימון שלכם כתובה ב-Python, תוכלו לבצע את השלבים האלה באמצעות פקודה אחת של Google Cloud CLI.

הגדרת משימת אימון

משימת אימון ב-Vertex AI מבצעת את המשימות הבאות:

- הכלי מקצה מכונה וירטואלית אחת (אימון של צומת יחיד) או יותר (אימון מבוזר).

- מריצה את אפליקציית האימון בקונטיינר במכונות הווירטואליות שהוקצו.

- מחיקת מכונות וירטואליות אחרי שפעולת האימון מסתיימת.

ב-Vertex AI יש שלושה סוגים של משימות אימון להרצת אפליקציית האימון:

-

משימה בהתאמה אישית (

CustomJob) מריצה את אפליקציית האימון. אם משתמשים בקובץ אימג' של קונטיינר שנבנה מראש, פלט הארטיפקטים של המודל מועבר לקטגוריית Cloud Storage שצוינה. במקרה של קובצי אימג' בקונטיינר בהתאמה אישית, אפליקציית האימון יכולה גם להפיק פלט של ארטיפקטים של המודל למיקומים אחרים. -

תהליך אופטימיזציה של היפרפרמטרים (

HyperparameterTuningJob) מריץ כמה ניסויים של אפליקציית האימון באמצעות ערכים שונים של היפרפרמטרים, עד שהוא יוצר ארטיפקטים של מודל עם ערכי ההיפרפרמטרים האופטימליים. מציינים את טווח הערכים של ההיפרפרמטרים שרוצים לבדוק ואת המדדים שרוצים לבצע אופטימיזציה שלהם. -

צינור אימון (

CustomTrainingJob) מריץ משימה מותאמת אישית או משימת כוונון של היפר-פרמטרים, ויכול לייצא את ארטיפקטים של המודל ל-Vertex AI כדי ליצור משאב מודל. אתם יכולים לציין מערך נתונים מנוהל של Vertex AI כמקור הנתונים.

כשיוצרים משימת אימון, מציינים את משאבי המחשוב שבהם רוצים להשתמש כדי להריץ את אפליקציית האימון ומגדירים את הגדרות הקונטיינר.

הגדרות מחשוב

מציינים את משאבי החישוב שבהם רוצים להשתמש למשימת אימון. Vertex AI תומך באימון של צומת יחיד, שבו משימת האימון מופעלת במכונה וירטואלית אחת, ובאימון מבוזר, שבו משימת האימון מופעלת בכמה מכונות וירטואליות.

אלה משאבי המחשוב שאפשר לציין למשימת האימון:

VM machine type

סוגים שונים של מכונות מציעים מעבדים שונים, גודל זיכרון שונה ורוחב פס שונה.

יחידות לעיבוד גרפי (GPU)

אפשר להוסיף יחידת GPU אחת או יותר למכונות וירטואליות (VM) מסוג A2 או N1. אם אפליקציית האימון שלכם מיועדת לשימוש ב-GPU, הוספת GPU יכולה לשפר משמעותית את הביצועים.

יחידות לעיבוד טנסורים (TPU)

יחידות TPU מיועדות במיוחד להאצת עומסי עבודה של למידת מכונה. כשמשתמשים במכונה וירטואלית של TPU לאימון, אפשר לציין רק מאגר עובדים אחד. למאגר העובדים הזה יכולה להיות רק רפליקה אחת.

דיסקים לאתחול

אפשר להשתמש בכונני SSD (ברירת מחדל) או בכונני HDD לדיסק האתחול. אם אפליקציית האימון קוראת וכותבת לדיסק, שימוש בכונני SSD יכול לשפר את הביצועים. אפשר גם לציין את הגודל של דיסק האתחול על סמך כמות הנתונים הזמניים שאפליקציית האימון כותבת לדיסק. גודל דיסקי ההפעלה יכול להיות בין 100GiB (ברירת מחדל) ל-64,000GiB. כל המכונות הווירטואליות במאגר העובדים צריכות להשתמש באותו סוג וגודל של דיסק אתחול.

הגדרות של קונטיינרים

הגדרות הקונטיינר שצריך לבצע תלויות בשאלה אם אתם משתמשים בקובץ אימג' של קונטיינר שנבנה מראש או בקובץ אימג' מותאם אישית.

תצורות של קונטיינרים מוכנים מראש:

- מציינים את ה-URI של קובץ אימג' של קונטיינר המוכנה מראש שבה רוצים להשתמש.

- אם אפליקציית האימון שלכם ארוזה כהפצה של מקור Python, מציינים את ה-URI של Cloud Storage שבו נמצאת החבילה.

- מציינים את מודול נקודת הכניסה של אפליקציית ההדרכה.

- אופציונלי: מציינים רשימה של ארגומנטים בשורת הפקודה שיועברו למודול של נקודת הכניסה של אפליקציית האימון.

הגדרות מותאמות אישית של מאגר תגים:

- מציינים את ה-URI של קובץ האימג' של הקונטיינר בהתאמה אישית, שיכול להיות URI מ-Artifact Registry או מ-Docker Hub.

- אופציונלי: אפשר לבטל את ההוראות

ENTRYPOINTאוCMDבקובץ אימג' של קונטיינר.

יצירת משימת אימון

אחרי שמכינים את הנתונים ואת אפליקציית האימון, מריצים את אפליקציית האימון על ידי יצירת אחת ממשימות האימון הבאות:

כדי ליצור את משימת האימון, אפשר להשתמש ב Google Cloud מסוף, ב-Google Cloud CLI, ב-Vertex AI SDK ל-Python או ב-Vertex AI API.

(אופציונלי) ייבוא ארטיפקטים של מודלים ל-Vertex AI

אפליקציית האימון כנראה תוציא פלט של פריט מידע אחד או יותר של המודל למיקום שצוין, בדרך כלל קטגוריה של Cloud Storage. כדי לקבל מסקנות ב-Vertex AI מארטיפקטים של מודלים, צריך קודם לייבא את הארטיפקטים של המודלים למרשם המודלים של Vertex AI.

בדומה לקובצי אימג' של קונטיינרים לאימון, ב-Vertex AI אפשר לבחור בין שימוש בקובצי אימג' של קונטיינרים שנוצרו מראש לבין שימוש בקובצי אימג' של קונטיינרים בהתאמה אישית להסקת מסקנות. אם יש קובץ אימג' של קונטיינר מוכן מראש להסקת מסקנות עבור מסגרת ה-ML וגרסת המסגרת שלכם, מומלץ להשתמש בקובץ אימג' של קונטיינר מוכן מראש.

המאמרים הבאים

- קבלת מסקנות מהמודל.

- הערכת המודל.

- אפשר לנסות את המדריך Hello serverless training לקבלת הוראות מפורטות לאימון מודל TensorFlow Keras לסיווג תמונות ב-Vertex AI.