Criar um pipeline de dados

Neste guia de início rápido, você vai aprender a fazer o seguinte:

- Crie uma instância do Cloud Data Fusion.

- Implante um pipeline de amostra fornecido com sua instância do Cloud Data Fusion. O pipeline faz o seguinte:

- Lê um arquivo JSON contendo dados de best-sellers do NYT a partir do Cloud Storage.

- Executa transformações no arquivo para analisar e limpar os dados.

- Carrega os livros com melhor classificação adicionados na última semana que custem menos de US$ 25 no BigQuery.

Antes de começar

Conclua as etapas a seguir antes de criar um pipeline de dados.

Criar o projeto

- Faça login na sua conta do Google Cloud . Se você começou a usar o Google Cloud, crie uma conta para avaliar o desempenho de nossos produtos em situações reais. Clientes novos também recebem US$ 300 em créditos para executar, testar e implantar cargas de trabalho.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Funções exigidas

Para receber as permissões necessárias

para criar uma instância do Cloud Data Fusion e gerenciar pipelines,

peça ao administrador para conceder a você o

papel do IAM de Administrador do Cloud Data Fusion (roles/datafusion.admin)

no projeto.

Para mais informações sobre a concessão de papéis, consulte Gerenciar o acesso a projetos, pastas e organizações.

Também é possível conseguir as permissões necessárias usando papéis personalizados ou outros papéis predefinidos.

Para garantir que a conta de serviço padrão do Compute Engine tenha as permissões necessárias para executar o job do Managed Service para Apache Spark, peça ao administrador para conceder os seguintes papéis do IAM à conta de serviço padrão do Compute Engine no projeto:

-

Worker do Dataproc (

roles/dataproc.worker) -

Executor do Cloud Data Fusion (

roles/datafusion.runner)

Para mais informações sobre a concessão de papéis, consulte Gerenciar o acesso a projetos, pastas e organizações.

O administrador também pode conceder à conta de serviço padrão do Compute Engine as permissões necessárias por meio de papéis personalizados ou outros papéis predefinidos.

crie uma instância do Cloud Data Fusion

- Clique em Criar uma instância.

- Insira um Nome de instância.

- Insira uma Descrição para sua instância.

- Insira a Região em que a instância será criada.

- Escolha a versão do Cloud Data Fusion que você quer usar.

- Escolha a edição do Cloud Data Fusion.

- Para as versões 6.2.3 e mais recentes do Cloud Data Fusion, no campo Autorização, escolha a conta de serviço do serviço gerenciado para Apache Spark a ser usada para executar seu pipeline do Cloud Data Fusion no serviço gerenciado para Apache Spark. O valor padrão, a conta do Compute Engine, é pré-selecionado.

- Clique em Criar. O processo de criação da instância leva até 30 minutos para ser concluído. Enquanto o Cloud Data Fusion cria a instância, um indicador de progresso é exibido ao lado do nome dela na página Instâncias. Após a conclusão, o indicador se transforma em uma marca de seleção verde, indicando que a instância já pode ser usada.

Navegar pela interface da Web do Cloud Data Fusion

Ao usar o Cloud Data Fusion, você usa o console Google Cloud e a interface da Web separada do Cloud Data Fusion.

No console Google Cloud , é possível fazer o seguinte:

- Criar um projeto do console do Google Cloud

- Criar e excluir instâncias do Cloud Data Fusion

- Ver os detalhes da instância do Cloud Data Fusion

Na interface da Web do Cloud Data Fusion, é possível usar várias páginas, como o Studio ou o Wrangler, para acessar a funcionalidade do Cloud Data Fusion.

Para navegar na interface do Cloud Data Fusion, siga estas etapas:

- No console do Google Cloud , abra a página Instâncias.

- Na coluna Ações da instância, clique no link Visualizar instância.

- Na interface da Web do Cloud Data Fusion, use o painel de navegação à esquerda para navegar até a página de que você precisa.

Implantar um pipeline de amostra

Os canais de amostra estão disponíveis no Hub do Cloud Data Fusion, que permite compartilhar soluções, plug-ins e pipelines reutilizáveis do Cloud Data Fusion.

- Na interface da Web do Cloud Data Fusion, clique em Hub.

- No painel esquerdo, clique em Pipelines.

- Clique no pipeline do Guia de início rápido do Cloud Data Fusion.

- Clique em Criar.

- No painel de configuração do Guia de início rápido do Cloud Data Fusion, clique em Concluir.

Clique em Personalizar pipeline.

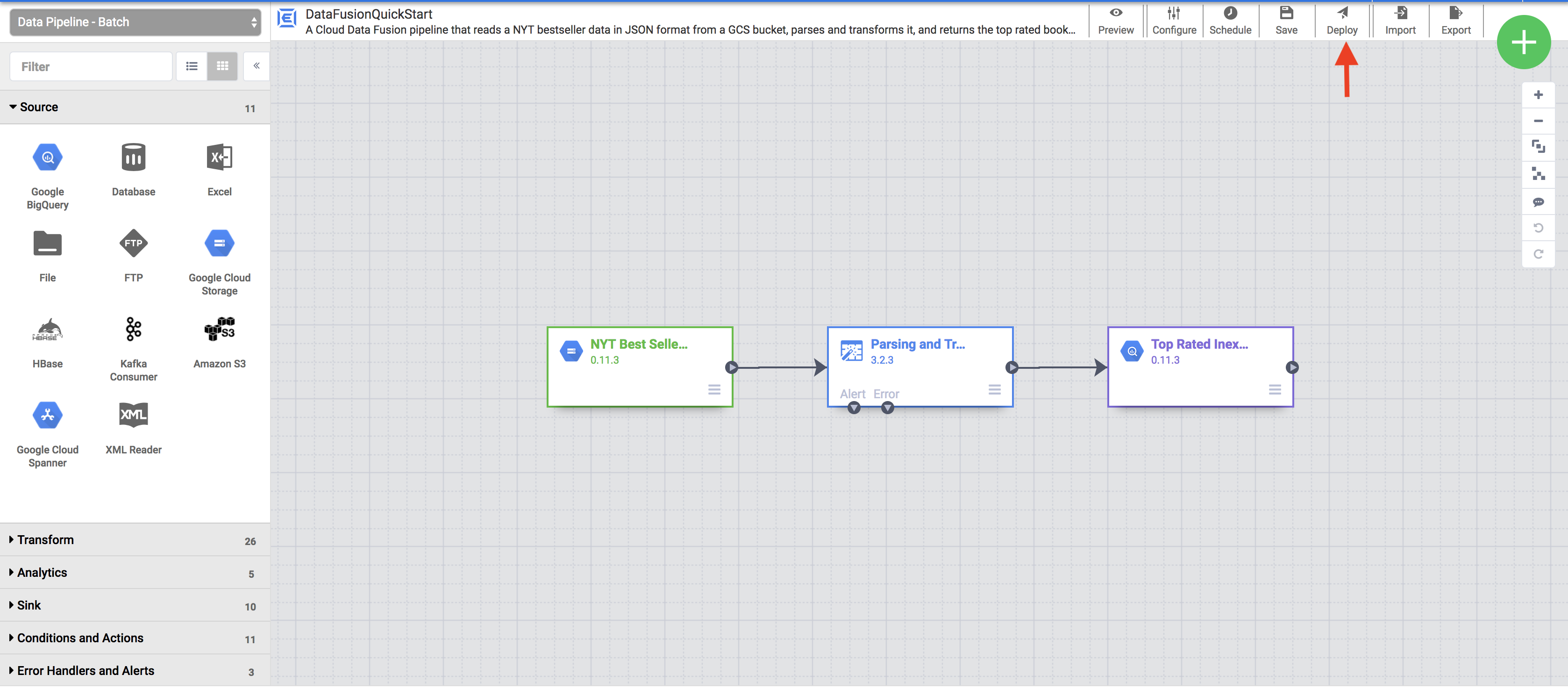

Uma representação visual do pipeline aparece na página Studio, que é uma interface gráfica para desenvolver pipelines de integração de dados. Os plug-ins de pipeline disponíveis são listados à esquerda, e o pipeline é exibido na área de tela principal. Para explorar o pipeline, mantenha o ponteiro sobre cada nó e clique em Propriedades. O menu de propriedades de cada nó permite visualizar os objetos e as operações associadas a ele.

No menu superior direito, clique em Implantar. Essa etapa envia o pipeline para o Cloud Data Fusion. Você executará o pipeline na próxima seção deste guia de início rápido.

Visualizar o pipeline

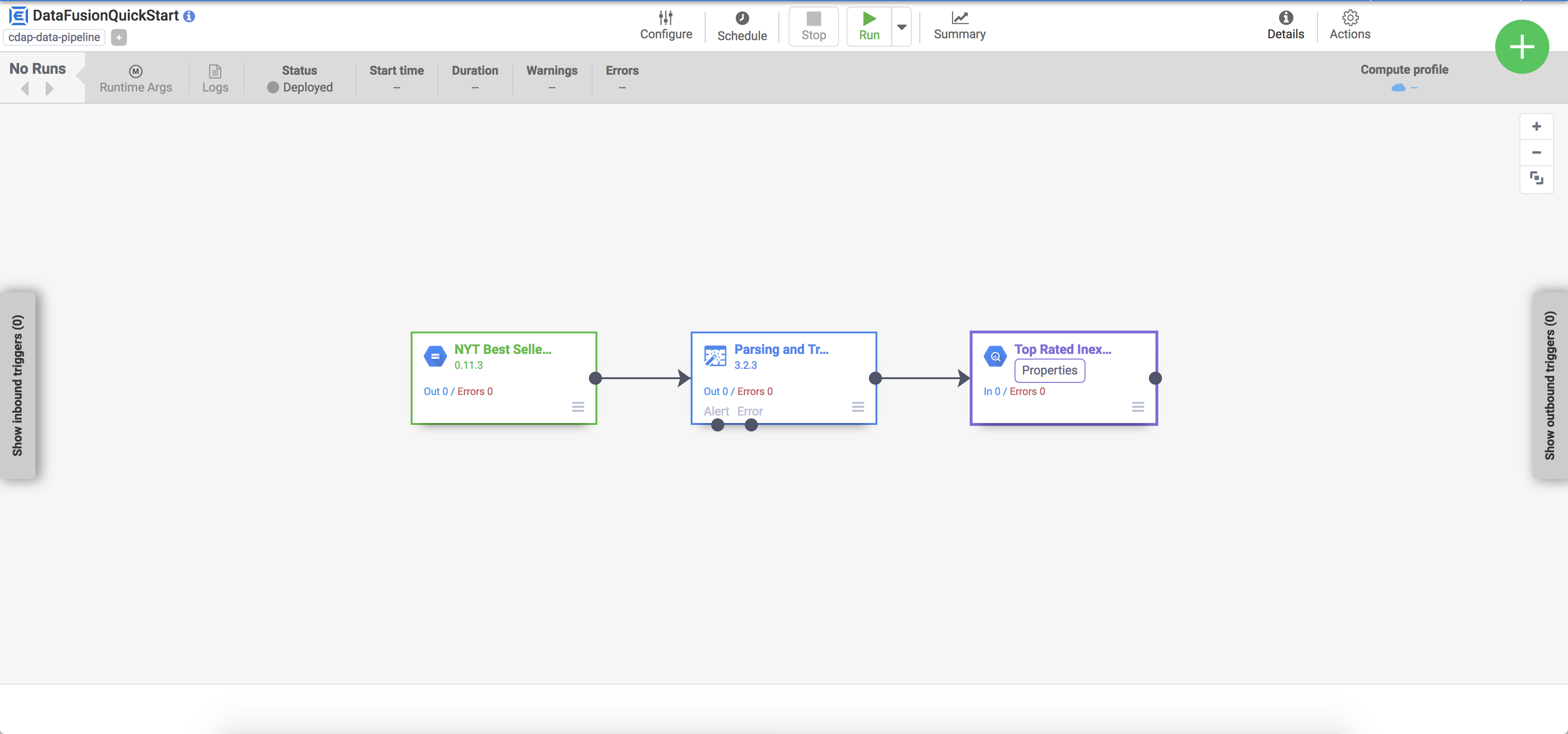

O pipeline implantado aparece na visualização de detalhes do pipeline, onde é possível fazer o seguinte:

- Confira a estrutura e a configuração do pipeline.

- Executar o pipeline manualmente ou configurar uma programação ou um gatilho.

- ver um resumo das execuções históricas do pipeline, incluindo ambientes de execução, registros e métricas.

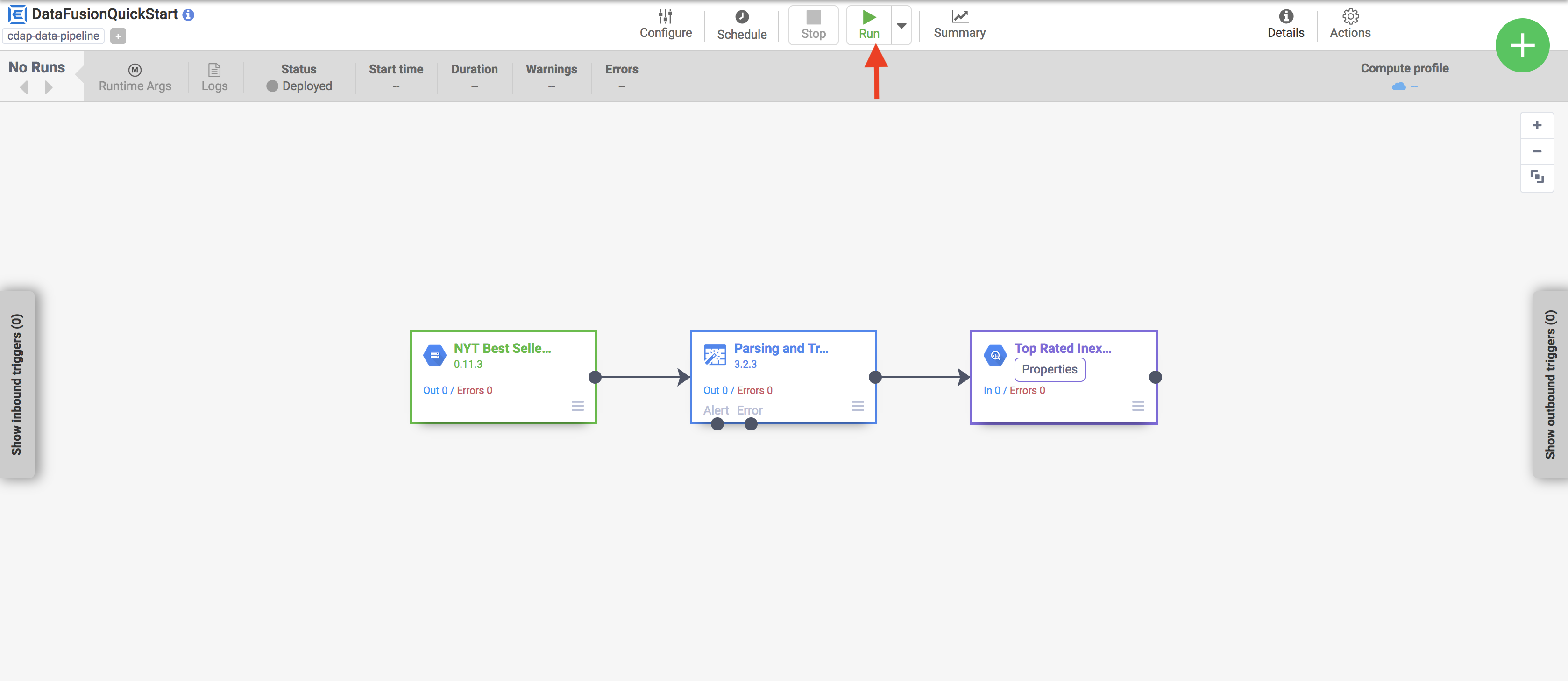

Executar o pipeline

Na visualização de detalhes do pipeline, clique em Executar para executar o pipeline.

Ao executar um pipeline, o Cloud Data Fusion faz o seguinte:

- Provisiona um cluster efêmero do Managed Service for Apache Spark.

- Executa o pipeline no cluster usando o Apache Spark

- Exclui o cluster

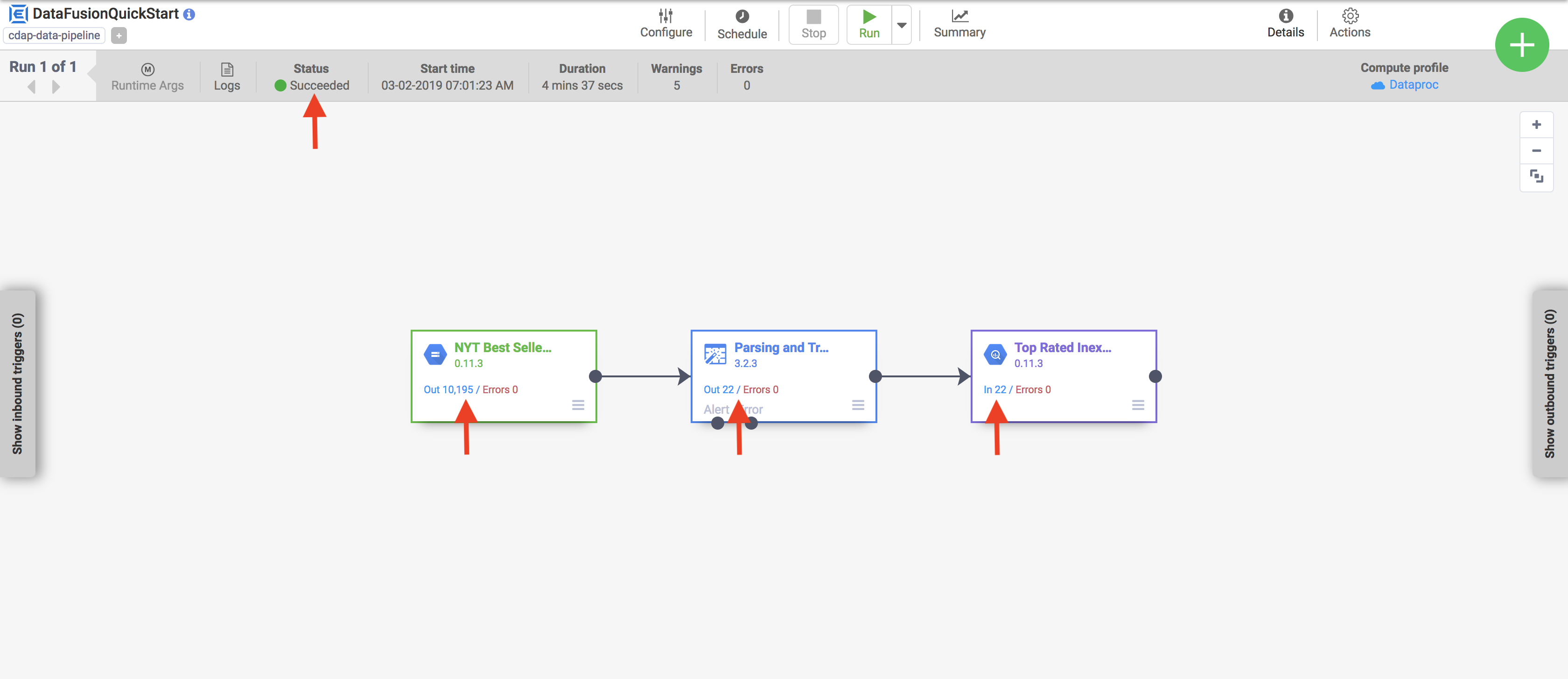

Ver os resultados

Após alguns minutos, o pipeline é concluído. O status do pipeline muda para Concluído e o número de registros processados por cada nó é exibido.

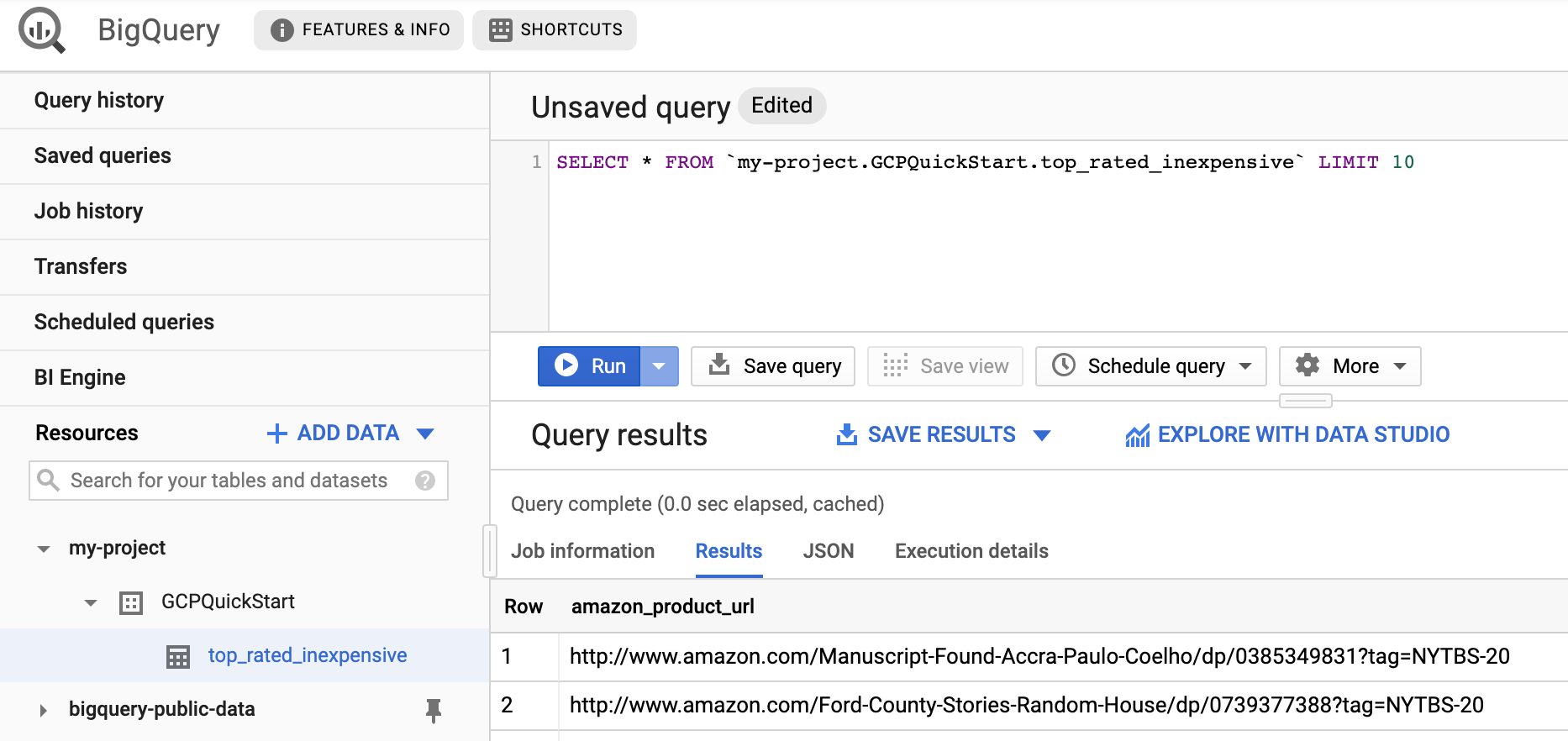

- Acesse a interface da Web do BigQuery.

Para ver uma amostra dos resultados, acesse o conjunto de dados

DataFusionQuickstartno projeto, clique na tabelatop_rated_inexpensivee execute uma consulta simples. Exemplo:SELECT * FROM PROJECT_ID.GCPQuickStart.top_rated_inexpensive LIMIT 10Substitua PROJECT_ID pela ID do seu projeto.

Limpar

Para evitar cobranças na conta do Google Cloud pelos recursos usados nesta página, siga as etapas abaixo.

- Exclua o conjunto de dados do BigQuery em que seu pipeline fez gravações neste guia de início rápido.

Opcional: exclua o projeto.

- No console Google Cloud , acesse a página Gerenciar recursos.

- Na lista de projetos, selecione o projeto que você quer excluir e clique em Excluir .

- Na caixa de diálogo, digite o ID do projeto e clique em Encerrar para excluí-lo.

A seguir

- Siga um tutorial do Cloud Data Fusion.

- Saiba mais sobre os conceitos do Cloud Data Fusion.