이 문서는 Apache Kafka 워크로드를 Google Cloud내의 관리형 서비스인 Apache Kafka용 Google Cloud 관리형 서비스로 마이그레이션하는 데 도움이 됩니다.

Apache Kafka용 관리형 서비스를 사용하면 Google Cloud에서 Apache Kafka를 실행할 수 있습니다. 이 문서화된 솔루션에서는 외부 Apache Kafka 클러스터에서 Apache Kafka용 관리형 서비스 클러스터로 데이터를 이동합니다.

Apache Kafka용 관리형 서비스에 대한 자세한 내용은 Apache Kafka용 관리형 서비스 개요를 참고하세요.

이 마이그레이션에는 Apache Kafka MirrorMaker 2.0을 사용하는 것이 좋습니다.

MirrorMaker 2.0은 Apache Kafka 클러스터 간에 데이터를 실시간으로 복제하는 도구입니다. 데이터 이전, 재해 복구, 데이터 격리, 데이터 집계에 사용할 수 있습니다.

MirrorMaker 2.0에 대한 자세한 내용은 다음 섹션을 참고하세요.

MirrorMaker 2.0이란 무엇인가요?

MirrorMaker 2.0은 Kafka Connect 프레임워크를 사용하여 Kafka 클러스터 간에 데이터를 복제합니다. Kafka Connect는 Kafka 클러스터와 기타 시스템 간에 데이터를 스트리밍하기 위한 프레임워크입니다. 확장 가능하고 안정적인 파이프라인 역할을 합니다. 이 프레임워크는 바로 사용할 수 있는 커넥터를 사용하여 Kafka를 데이터베이스, 메시지 큐, 온라인 스토리지와 같은 다양한 외부 시스템과 통합하는 작업을 간소화합니다. 다음은 MirrorMaker 2.0을 사용할 수 있는 시나리오 목록입니다.

데이터 마이그레이션: 이 가이드에 설명된 대로 Kafka 워크로드를 새 클러스터로 이동합니다.

재해 복구: 장애 발생 시 비즈니스 연속성을 보장하기 위해 백업 클러스터를 만듭니다.

데이터 격리: 비공개 클러스터에서 민감한 정보를 안전하게 유지하면서 주제를 선택적으로 공개 클러스터에 복제합니다.

데이터 집계: 분석 목적으로 여러 Kafka 클러스터의 데이터를 중앙 클러스터로 통합합니다.

MirrorMaker 2.0은 Kafka 버전 2.4.0 이상을 지원하며 다음과 같은 주요 기능을 제공합니다.

포괄적인 복제: 주제, 데이터, 구성, 오프셋이 있는 소비자 그룹, ACL 등 필요한 모든 구성요소를 복제합니다.

파티션 보존: 타겟 클러스터에서 동일한 파티셔닝 체계를 유지하여 애플리케이션의 전환을 간소화합니다.

자동 주제 및 파티션 생성: 새 주제와 파티션을 자동으로 감지하고 복제하여 수동 구성을 최소화합니다.

모니터링 기능: 엔드 투 엔드 복제 지연 시간과 같은 필수 측정항목을 제공하여 복제 프로세스의 상태와 성능을 추적할 수 있습니다.

내결함성 및 확장성: 데이터 볼륨이 많은 경우에도 안정적인 작동을 보장하며 증가하는 워크로드를 처리하기 위해 수평으로 확장할 수 있습니다.

강력성을 위한 내부 주제: 오프셋 동기화, 체크포인트, 하트비트를 위해 내부 주제를 활용합니다. 이러한 주제에는 고가용성과 내결함성을 보장하기 위해

offset.syncs.topic.replication.factor과 같은 구성 가능한 복제 요소가 있습니다.

MirrorMaker 2.0은 두 가지 배포 모드를 제공합니다.

전용 클러스터 모드: MirrorMaker 2.0이 자체 작업자를 관리하는 독립형 클러스터로 실행됩니다. 이 문서에서는 이 모드에 중점을 두고 배포 및 구성의 실제 예를 제공합니다.

Kafka Connect 클러스터 모드: MirrorMaker 2.0은 기존 Kafka Connect 클러스터 내에서 커넥터로 실행됩니다.

대략적인 워크플로

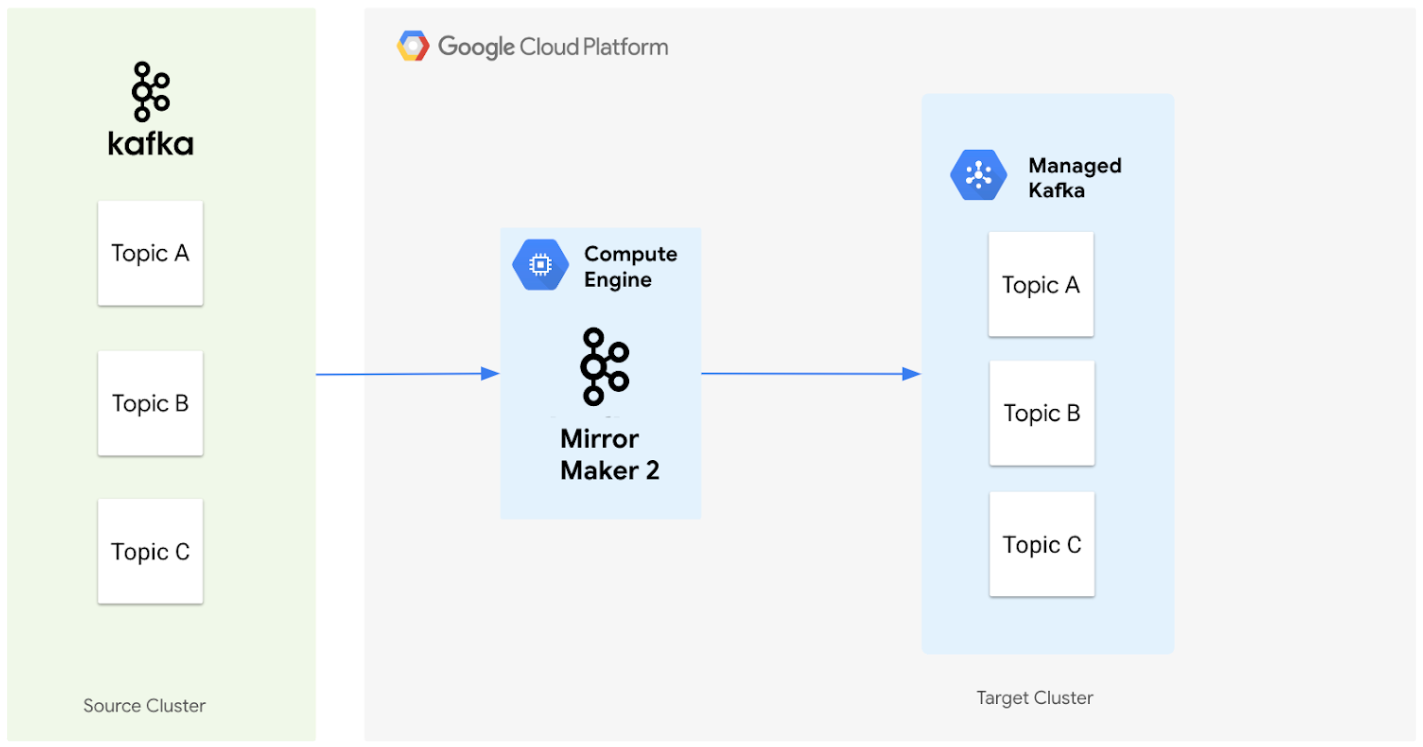

다음 다이어그램은 MirrorMaker 2.0을 사용하여 소스 Apache Kafka 클러스터에서 Managed Service for Apache Kafka 클러스터로 데이터를 이전하는 아키텍처를 보여줍니다.

구성요소는 다음과 같이 함께 작동합니다.

소스 클러스터: 온프레미스 또는 다른 클라우드 환경에 있을 수 있는 기존 Apache Kafka 클러스터를 나타냅니다. 마이그레이션하려는 주제가 포함되어 있습니다. 이 다이어그램에서 소스 Apache Kafka 클러스터에는 주제 A, B, C의 세 가지 주제가 포함되어 있습니다.

MirrorMaker 2.0: Compute Engine VM에 전용 MirrorMaker 2.0 클러스터로 배포되는 이 핵심 구성요소는 소스 Apache Kafka 클러스터에서 타겟 Managed Service for Apache Kafka 클러스터로 데이터를 적극적으로 복제합니다. 중요한 점은 소스 클러스터 설정을 미러링하여 대상 클러스터에 해당 주제와 파티션이 없는 경우 자동으로 생성한다는 것입니다.

타겟 클러스터: Apache Kafka용 관리형 서비스 클러스터입니다. MirrorMaker 2.0을 통해 주제와 파티션이 소스 환경과 일치하도록 생성되므로 Kafka 데이터의 새로운 홈이 됩니다.

다음은 마이그레이션 프로세스의 대략적인 워크플로입니다.

초기 평가

클러스터 크기, 주제, 처리량, 소비자 그룹을 포함하여 기존 Kafka 설정을 문서화합니다.

다운타임 허용 범위 및 전환 접근 방식을 포함하여 이전 목표와 전략을 계획합니다.

Apache Kafka용 관리형 서비스 클러스터에 필요한 리소스를 추정합니다.

준비

Apache Kafka용 관리형 서비스 클러스터를 만듭니다.

기존 Kafka 클러스터와 방금 만든 Apache Kafka용 관리형 서비스 클러스터 간의 네트워크 연결을 구성합니다.

Google Cloud VM에 MirrorMaker 2.0을 배포합니다.

마이그레이션 실행

기존 Kafka 클러스터의 데이터를 Managed Service for Apache Kafka 클러스터로 복제하도록 MirrorMaker 2.0을 구성합니다.

MirrorMaker 2.0 측정항목을 사용하여 복제 프로세스를 모니터링합니다.

소비자와 생산자를 새 Apache Kafka용 관리형 서비스 클러스터로 점진적으로 마이그레이션합니다.

검증 및 전환

Apache Kafka용 관리형 서비스 클러스터에서 데이터 무결성 및 애플리케이션 기능을 검증합니다.

최종 전환을 실행하여 트래픽을 Apache Kafka용 관리형 서비스 클러스터로 리디렉션합니다.

이전 Kafka 클러스터를 사용 중단합니다.

이전 후

Apache Kafka용 관리형 서비스 클러스터의 성능을 지속적으로 모니터링합니다.

변경사항을 반영하도록 문서를 검토하고 업데이트합니다.

마이그레이션 다운타임 최소화

이 섹션에서는 MirrorMaker 2.0을 사용하여 오픈소스 Kafka 데이터를 Apache Kafka용 관리형 서비스로 마이그레이션할 때 고려해야 할 사항을 간략하게 설명합니다. MirrorMaker 2.0은 소비자가 새 클러스터의 올바른 지점에서 재개할 수 있는 데이터 및 오프셋 복제를 지원합니다. 하지만 마이그레이션 프로세스 중에 다운타임을 최소화하려면 신중한 계획이 중요합니다. 다음 전략을 고려하세요.

병렬 배포: 새 Apache Kafka용 관리형 서비스 클러스터로 전환할 때 다운타임을 최소화하려면 이전 클러스터와 새 클러스터 모두에서 애플리케이션의 인스턴스를 병렬로 실행하면 됩니다. 이 전환 중에 알림 전송과 같이 메시지당 한 번만 발생해야 하는 애플리케이션의 작업을 일시적으로 사용 중지합니다. 동일한 메시지를 두 번 처리하여 의도치 않은 결과가 발생하는 것을 방지하려면 이러한 부작용을 사용 중지하세요. 새 인스턴스가 완전히 따라잡은 후 모든 트래픽을 새 클러스터로 리디렉션하고 모든 기능을 다시 사용 설정합니다.

단계적 출시: 덜 중요한 애플리케이션부터 시작하여 관리 가능한 작은 단계로 마이그레이션합니다. 이 접근 방식을 사용하면 잠재적인 문제를 격리하고 중단의 영향을 최소화할 수 있습니다.

블루 및 그린 배포: 기존 프로덕션 환경 (블루)과 함께 프로덕션 환경의 완전한 복제본 (그린)을 만듭니다. 블루에서 그린으로 트래픽을 점진적으로 전환하여 최종 전환 전에 테스트 및 검증을 수행할 수 있습니다. 이 접근 방식은 다운타임을 최소화하지만 리소스 사용률이 증가합니다.

메시지 처리 요구사항: 중복되거나 누락된 메시지에 대한 애플리케이션의 허용 범위를 파악하고 이에 따라 소비자를 구성합니다. MirrorMaker 2.0은 메시지 전송 시맨틱스를 처리하는 구성을 제공합니다. 예를 들어

sync.group.offsets.enabled는 소비자 오프셋 동기화를 지원합니다. 소비자는 동기화된 오프셋을 사용하여 소스 클러스터에서 중단한 위치부터 읽기를 재개할 수 있습니다. 이렇게 하면 메시지 손실을 방지하거나 중복 메시지를 너무 많이 수신하는 것을 방지할 수 있습니다.커뮤니케이션 및 조정: 애플리케이션 팀과의 효과적인 커뮤니케이션은 원활한 이전을 위해 필수적입니다. 명확한 커뮤니케이션 채널을 설정하고 전환 시기를 조율합니다.

온프레미스 Apache Kafka를 Google Cloud에 연결

소스 Apache Kafka 클러스터가 온프레미스에 있는 경우 온프레미스 네트워크와 Apache Kafka용 관리형 서비스 클러스터가 있는 가상 프라이빗 클라우드 (VPC) 간에 보안 연결을 설정해야 합니다. Google Cloud에서 다음 옵션 중 하나를 사용합니다.

Cloud VPN: 대역폭 요구사항이 낮거나 초기 마이그레이션 실험에 적합한 비용 효율적인 솔루션입니다. 공개 인터넷을 통해 암호화된 터널을 만듭니다. Cloud VPN에 대한 자세한 내용은 Cloud VPN 개요를 참고하세요.

Cloud Interconnect: 온프레미스 네트워크와 Google Cloud간에 전용 고대역폭 연결을 제공합니다. 이는 높은 처리량과 낮은 지연 시간이 필요한 엔터프라이즈급 배포에 적합합니다. Dedicated Interconnect (직접 물리적 연결) 또는 Partner Interconnect (지원되는 서비스 제공업체를 통한 연결) 중에서 선택할 수 있습니다. Google CloudInterconnect 문서에 대한 자세한 내용은 Cloud Interconnect 개요를 참고하세요.

Apache Kafka용 관리형 서비스 클러스터를 만들 때는 VPC에서 하나 이상의 서브넷을 선택해야 합니다. 이 서브넷은 클러스터가 VPC의 다른 리소스와 통신하는 데 사용하는 IP 주소를 제공하므로 VPC 네트워크 내에서 클러스터에 액세스할 수 있습니다.

온프레미스 네트워크 또는 다른 VPC 네트워크에서 Managed Service for Apache Kafka 클러스터에 안전하게 연결하려면 Cloud VPN 또는 Cloud Interconnect를 통해 Private Service Connect (PSC)를 사용하면 됩니다. PSC 엔드포인트를 명시적으로 설정할 필요가 없습니다. 클러스터를 만드는 동안 서브넷을 선택하면 Apache Kafka용 관리형 서비스에서 필요한 PSC 엔드포인트를 자동으로 만듭니다. 이렇게 하면 복잡한 방화벽 규칙이나 공개 IP 주소를 관리하지 않고도 VPC 내에서 내부 IP 주소를 사용하여 클러스터에 액세스할 수 있으므로 네트워크 구성이 간소화됩니다.

Apache Kafka용 관리형 서비스의 네트워킹 설정에 대한 자세한 내용은 Apache Kafka용 관리형 서비스의 네트워킹을 참고하세요.

시작하기 전에

마이그레이션 설정을 만들기 전에 현재 Apache Kafka 설정을 문서화해야 합니다. 새 Apache Kafka용 관리형 서비스 클러스터에 필요한 리소스(예: vCPU, 메모리, 스토리지)를 계산하려면 이 정보가 필요합니다. 소스 Apache Kafka 환경에 관한 다음 정보를 수집합니다.

Apache Kafka 버전이 2.4.0 이상인지 확인합니다.

Apache Kafka 클러스터의 버전을 확인하려면 Kafka 설치 디렉터리로 이동하여

bin/kafka-topics.sh --version명령어를 실행합니다.마이그레이션해야 하는 클러스터와 주제를 식별합니다.

각 주제와 연결된 프로듀서와 소비자를 식별합니다.

모든 소비자 그룹을 식별합니다.

클러스터 및 주제 수준에서 메시지 처리량을 확인합니다.

클러스터 및 주제의 복제 요소를 확인합니다.

소비자 구성, 특히 보안 프로토콜 및 기타 Google Cloud 서비스와의 통합을 문서화합니다.

이전 중에 중단을 방지하려면 소스 Kafka 클러스터와 관련된 모든 애플리케이션 종속 항목을 매핑하세요. 프로덕션 환경을 마이그레이션하기 전에 개발 환경에서 중요하지 않은 클러스터를 사용하여 테스트 마이그레이션을 실행하세요. 프로세스를 검증하고 잠재적인 문제를 식별합니다. 마지막으로 필요한 경우 원래 클러스터로 되돌릴 수 있는 포괄적인 롤백 계획을 만듭니다.

대상 클러스터 크기 계산

Apache Kafka용 관리형 서비스 클러스터에 필요한 vCPU 수와 메모리 크기를 추정하려면 Kafka 클러스터 크기 계획을 참고하세요. 디스크 및 브로커 구성은 자동으로 이루어지며 조정할 수 없습니다.

오픈소스 Kafka는 JMX 측정항목을 제공합니다. Apache Kafka용 관리형 서비스에 필요한 클러스터 크기를 정확하게 계산하려면 다음 JMX 측정항목을 사용하면 됩니다. 이러한 측정항목은 브로커 수준에서 보고됩니다. 클러스터 처리량을 계산하려면 모든 브로커의 데이터를 집계해야 합니다.

kafka.server:type=BrokerTopicMetrics,name=BytesInPerSec: 이 측정항목은 모든 주제에 걸쳐 클라이언트로부터 수신되는 바이트 비율을 보고합니다. 모든 주제의 집계 비율을 가져오려면topic={...}매개변수를 생략하세요.kafka.server:type=BrokerTopicMetrics,name=BytesOutPerSec: 이 측정항목은 모든 주제에서 클라이언트로 전송되는 바이트 비율을 보고합니다. 전체 비율을 확인하려면topic={...}매개변수를 생략하세요.

일정 기간 동안 이러한 JMX 측정항목을 모니터링하면 다음을 계산하는 데이터 포인트를 수집할 수 있습니다.

평균 데이터 수신(MB/s): 이 측정항목은 데이터가 Kafka 클러스터로 수집되는 평균 속도를 나타냅니다.

최고 데이터 수신, MB/s: 이 측정항목은 데이터가 Kafka 클러스터로 수집되는 최고 속도를 나타냅니다.

Average Data Out, MB/s: 이 측정항목은 Kafka 클러스터에서 데이터가 소비되는 평균 속도를 나타냅니다.

최고 데이터 출력, MB/s: 이 측정항목은 Kafka 클러스터에서 데이터가 소비되는 최고 속도를 나타냅니다.

데이터를 집계하고 바이트를 MB로 변환하려면 일부 측정항목 계산이 필요할 수 있습니다. 이러한 계산된 값을 사용하여 다음과 같이 쓰기 동등 비율을 추정할 수 있습니다.

Write-equivalent rate (Avg/Peak) = (total write bandwidth) + (total read bandwidth / 4)

이 쓰기 동등 비율은 클러스터의 전체 쓰기 부하를 결정하는 데 도움이 되며, 이는 Apache Kafka용 관리형 서비스 클러스터의 크기를 적절하게 조정하는 데 필요합니다.

Apache Kafka용 관리형 서비스 클러스터 만들기

Apache Kafka용 관리형 서비스 클러스터는 특정Google Cloud 프로젝트와 리전에 있습니다. 가상 프라이빗 클라우드 (VPC)의 하나 이상의 서브넷 내 IP 주소 집합을 사용하여 액세스할 수 있습니다.

클러스터 크기는 클러스터에 할당하는 CPU 수와 총 RAM에 따라 결정됩니다. 이 경우 클러스터 크기는 소스 Apache Kafka 클러스터의 크기를 반영해야 합니다. 이 계산을 실행하는 방법에 대한 자세한 내용은 대상 클러스터 크기 계산을 참고하세요.

클러스터를 만드는 데 필요한 권한을 얻으려면 관리자에게 클러스터를 만드는 사용자 또는 서비스 계정에 프로젝트에 대한 관리형 Kafka 관리자(roles/managedkafka.admin) IAM 역할을 부여해 달라고 요청하세요. 역할 부여에 대한 자세한 내용은 프로젝트, 폴더, 조직에 대한 액세스 관리를 참고하세요.

Apache Kafka용 관리형 서비스 클러스터를 만들려면 CLI로 메시지 생성 및 소비의 빠른 시작 안내를 따르세요. 클러스터를 만드는 데는 일반적으로 20~30분 정도 걸립니다.

독립형 클러스터 모드로 MirrorMaker 2.0 설정

MirrorMaker 2.0 및 Terraform을 사용하여 Kafka 데이터를 Google Cloud로 전송하는 방법을 보여주는 개념 증명 문서와 샘플 코드는 이 GitHub 저장소를 참고하세요.

이 섹션에서는 Google Cloud VM의 독립형 클러스터 모드에서 MirrorMaker 2.0을 설치하고 구성하는 방법을 안내합니다. 이 설정을 사용하면 기존 Apache Kafka 클러스터의 데이터를 Managed Service for Apache Kafka 클러스터로 복제할 수 있습니다.

Apache Kafka용 관리형 서비스 클러스터에 액세스 권한이 부여된 것과 동일한 네트워크에 VM을 만듭니다. gcloud compute instances create 명령어를 사용합니다.

gcloud compute instances create VM_NAME\ --zone=ZONE\ [--image=IMAGE | --image-family=IMAGE_FAMILY]\ --image-project=IMAGE_PROJECT\ --machine-type=MACHINE_TYPE

다음을 바꿉니다.

VM_NAME: 만들려는 VM의 이름입니다.ZONE: VM을 만들려는 영역입니다.IMAGE또는IMAGE_FAMILY: VM에 사용할 이미지 또는 이미지 계열입니다.IMAGE_PROJECT: 이미지가 있는 프로젝트입니다.MACHINE_TYPE: VM에 사용할 머신 유형입니다.

새로 만든 VM에 액세스하려면 SSH를 사용하면 됩니다.

SSH 연결에 대한 자세한 내용은 SSH 연결 정보를 참고하세요.

Kafka를 다운로드한 후 추출하려면 새 VM의 터미널 창에서 다음 명령어를 실행합니다.

wget https://downloads.apache.org/kafka/3.7.1/kafka_2.13-3.7.1.tgz tar -xzvf kafka_2.13-3.7.1.tgzJava를 다운로드하고 패키지를 추출한 다음 Java 경로를 설정합니다.

# Download Java wget https://download.java.net/java/GA/jdk11/9/GPL/openjdk-11.0.2_linux-x64_bin.tar.gz # Extract Java tar -xzvf openjdk-11.0.2_linux-x64_bin.tar.gz # Set Java path export PATH=$PATH:/java/jdk-11.0.2/bin/path/to/kafka/config/mm2.properties파일을 수정하고 다음 속성을 업데이트합니다.clusters = source, target source.bootstrap.servers = <source_kafka_bootstrap_servers> target.bootstrap.servers = <target_kafka_bootstrap_servers> source.security.protocol = SASL_SSL source.sasl.mechanism = PLAIN source.sasl.jaas.config = org.apache.kafka.common.security.plain.PlainLoginModule required username="<source_kafka_username>" password="<source_kafka_password>"; target.security.protocol = SASL_SSL target.sasl.mechanism = PLAIN target.sasl.jaas.config = org.apache.kafka.common.security.plain.PlainLoginModule required username="<target_kafka_username>" password="<target_kafka_password>"; mirrors = source->target source->target.enabled=true topics = .* groups = .* offset.syncs.topic.replication.factor = 3 checkpoints.topic.replication.factor = 3 heartbeats.topic.replication.factor = 3 emit.checkpoints.interval.seconds = 10source_kafka_bootstrap_servers및target_kafka_bootstrap_servers를 각각 소스 및 타겟 Kafka 클러스터의 부트스트랩 서버 주소로 바꿉니다.managed-kafka clusters describeGoogle Cloud CLI 명령어를 사용하여 Apache Kafka용 관리형 서비스의 부트스트랩 서버 주소를 가져올 수 있습니다.source_kafka_username및source_kafka_password를 소스 Kafka 클러스터의 사용자 인증 정보로 바꿉니다.target_kafka_username및target_kafka_password을 대상 Apache Kafka용 관리형 서비스 클러스터의 사용자 인증 정보로 바꿉니다. 사용자 이름과 비밀번호를 구성하려면 SASL/PLAIN 인증을 참고하세요.topics = .\*및groups = .\*설정은 모든 주제와 소비자 그룹을 복제합니다. 필요한 경우 이러한 설정을 더 구체적으로 수정할 수 있습니다.offset.syncs.topic.replication.factor = 3설정은 MirrorMaker 2.0이 소스 클러스터와 타겟 클러스터 간에 소비자 오프셋을 동기화하는 데 사용하는 내부 주제의 복제 요소를 설정합니다. 복제 계수3는 오프셋 데이터가 타겟 클러스터의 브로커 3개에 복제되어 가용성과 내결함성이 높아짐을 의미합니다.checkpoints.topic.replication.factor = 3설정은 MirrorMaker 2.0이 체크포인트를 저장하는 데 사용하는 다른 내부 주제의 복제 요소를 설정합니다. 체크포인트는 MirrorMaker 2.0이 진행 상황을 추적하고 실패 또는 다시 시작 시 올바른 지점에서 복제를 재개하는 데 도움이 됩니다.heartbeats.topic.replication.factor = 3설정은 MirrorMaker 2.0이 하트비트를 전송하는 데 사용하는 내부 주제의 복제 요소를 설정합니다. 하트비트는 MirrorMaker 2.0 프로세스가 활성 상태임을 나타냅니다. 복제 요소가 높을수록 이러한 하트비트가 안정적으로 저장되며 복제 프로세스의 상태를 모니터링하는 데 사용할 수 있습니다.emit.checkpoints.interval.seconds = 10설정은 MirrorMaker 2.0이 체크포인트를 내보내는 빈도를 제어합니다. 이 경우 체크포인트는 10초마다 내보내집니다. 이 빈도는 진행 상황을 추적하는 것과 체크포인트 작성의 오버헤드를 최소화하는 것 사이의 균형을 제공합니다.

MirrorMaker 2.0을 시작합니다.

connect-mirror-maker.sh스크립트를 사용하여 프로세스를 시작합니다.스크립트는 독립형 모드에서 MirrorMaker 2.0을 시작하고 소스 Kafka 클러스터에서 Managed Service for Apache Kafka 클러스터로 데이터 복제를 시작합니다.

추가 고려사항:

네트워킹: Google Cloud VM이 소스 Kafka 클러스터와 타겟 Apache Kafka용 관리형 서비스 클러스터 모두에 대한 네트워크 연결을 갖도록 합니다. 소스 클러스터가 온프레미스에 있는 경우 VPN 또는 Interconnect를 구성해야 할 수 있습니다.

보안: MirrorMaker 2.0 인스턴스와 Kafka 클러스터를 보호하도록 적절한 보안 프로토콜과 방화벽 규칙을 구성합니다.

이 단계를 따르면 Google Cloud VM에 독립형 클러스터 모드로 MirrorMaker 2.0을 설치하고 구성하여 Kafka 데이터를 Managed Service for Apache Kafka로 쉽게 이전할 수 있습니다.

모니터링

MirrorMaker 2.0 프로세스가 올바르게 실행되고 데이터가 예상대로 복제되는지 모니터링합니다. MirrorMaker 2의 기본 제공 측정항목이나 다른 모니터링 도구를 사용할 수 있습니다. 애플리케이션을 마이그레이션한 후 다음을 모니터링하여 성공 여부를 확인합니다.

다운스트림 처리량 비율: 다운스트림 처리량 비율에 큰 변화가 없는지 확인합니다. 예를 들어 다운스트림에서 Dataflow를 사용하는 경우 Kafka와 관련된 처리량과 측정항목이 일관되게 유지되어야 합니다.

CPU 및 메모리 사용률: Cloud Monitoring을 사용하여 Apache Kafka용 관리형 서비스 클러스터의 CPU 및 메모리 사용률을 모니터링합니다. 최적의 성능을 보장하려면 사용률이 75% 미만으로 유지되어야 합니다.

오류 로그: Cloud Logging에서 Apache Kafka용 관리형 서비스 클러스터 또는 애플리케이션과 관련된 오류 로그를 정기적으로 확인합니다. 중단을 방지하려면 오류를 즉시 해결하세요.

제한사항

- MirrorMaker 2.0을 사용하려면 소스 Apache Kafka 클러스터가 버전 2.4.0 이상이어야 합니다.