Knowledge Catalog ist ein auf Gemini basierender Datenkatalog, der universellen geschäftlichen Kontext und Governance für Ihre gesamte Datenlandschaft bietet. Durch das automatische Extrahieren von Semantik aus strukturierten und unstrukturierten Daten wird ein dynamisches Kontextdiagramm erstellt, das KI-Agenten auf Unternehmensdaten stützt und Halluzinationen reduziert. Datenteams und KI-Entwickler verwenden Knowledge Catalog, um Daten zu finden, Richtlinien durchzusetzen und umfassenden Kontext für Analysen und autonome Anwendungen abzurufen.

Dataplex Universal Catalog heißt jetzt Knowledge Catalog

Um die Vision der Vereinheitlichung von Data Governance mit generativen KI-Funktionen besser widerzuspiegeln, heißt Dataplex Universal Catalog jetzt Knowledge Catalog. Diese Weiterentwicklung des Produktnamens stellt eine Verlagerung von einem herkömmlichen, passiven Metadatenregister zu einem aktiven, KI-gestützten Kontextdiagramm dar.

Warum wurde Dataplex zu Knowledge Catalog?

Da Unternehmen die Einführung generativer KI beschleunigen, benötigen KI-Agenten einen umfassenden geschäftlichen Kontext, um genaue und fundierte Antworten zu geben. Knowledge Catalog schließt die Lücke zwischen Data Governance im Unternehmen und KI-Agenten-Workflows.

Was ist der Unterschied zwischen Dataplex und Knowledge Catalog?

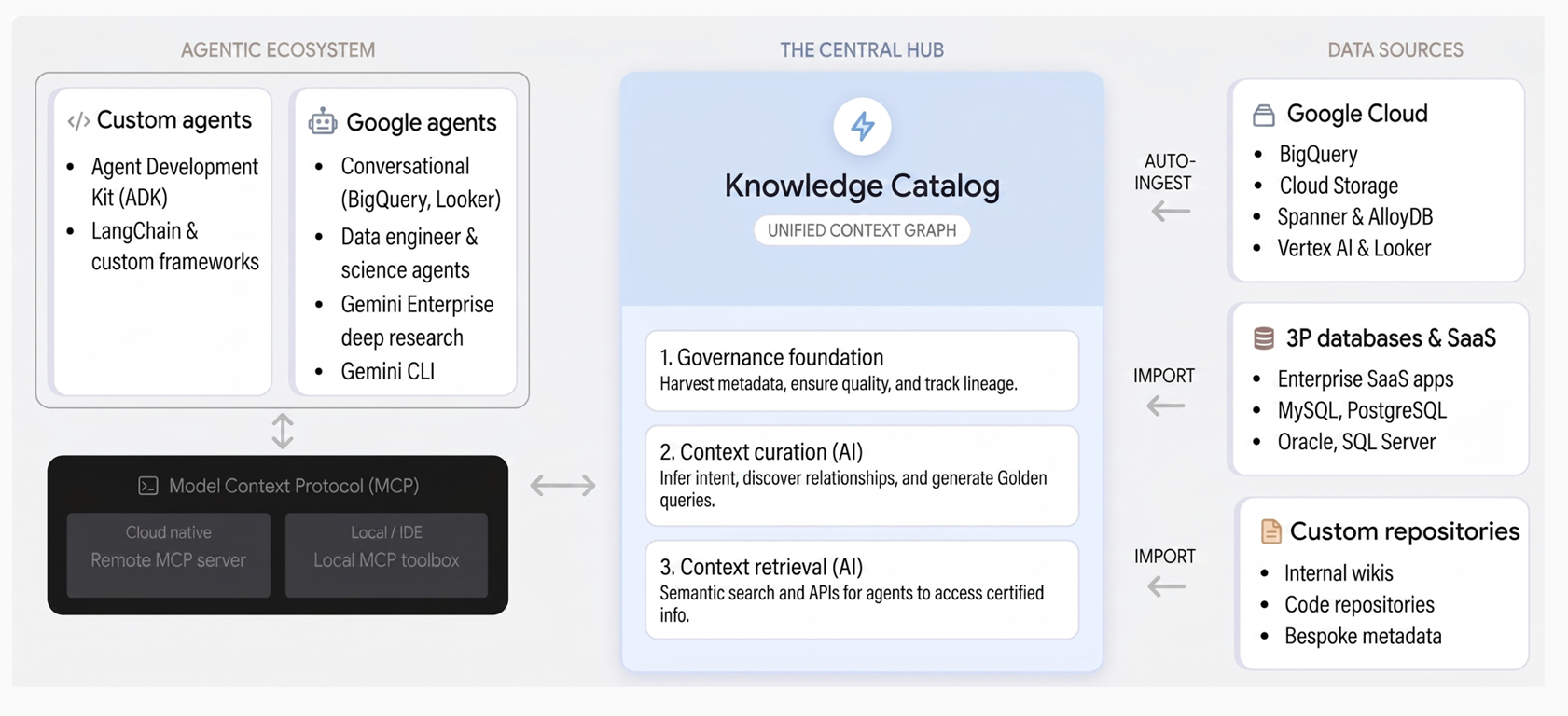

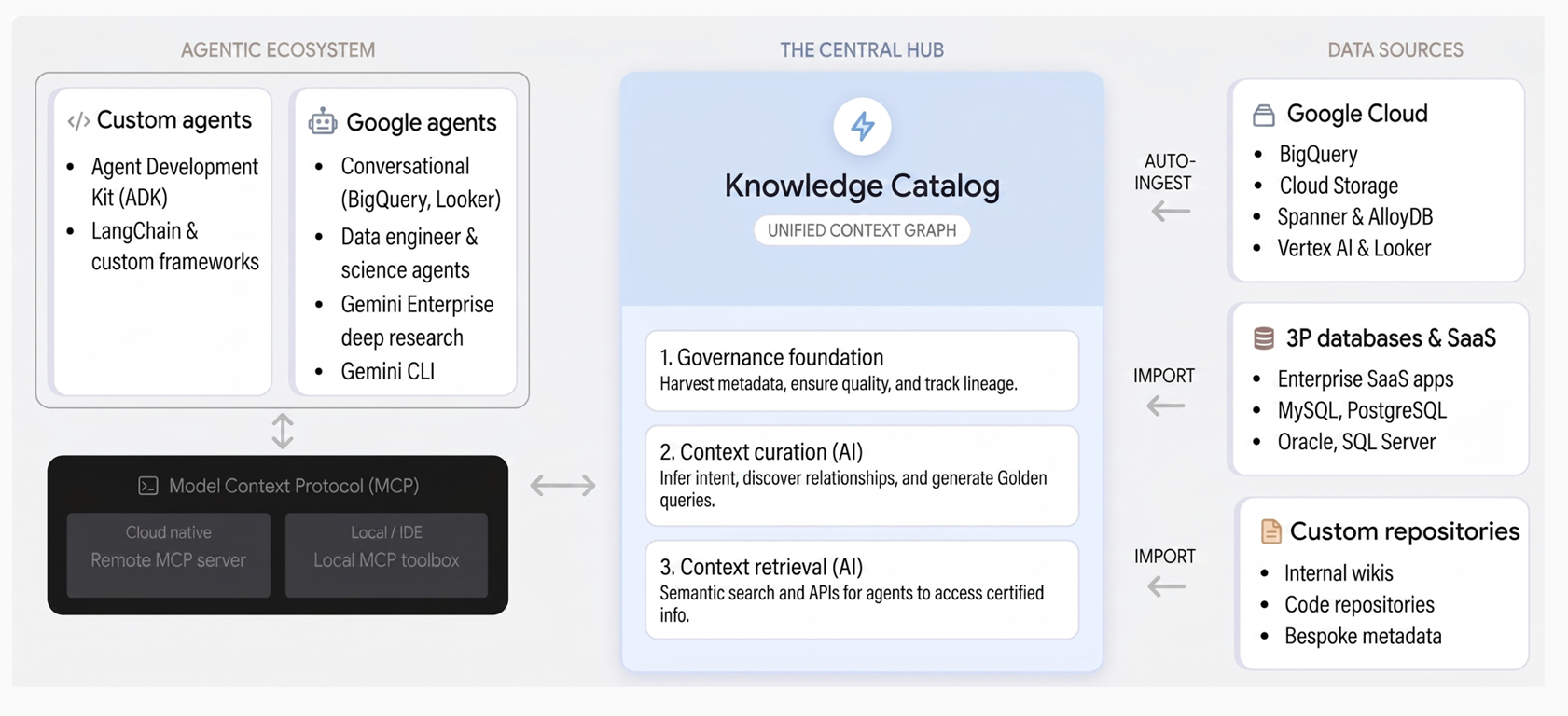

Die Updates von Knowledge Catalog spiegeln neue KI-zentrierte Funktionen wider. Im Gegensatz zu herkömmlichen passiven Katalogen kuratiert Knowledge Catalog automatisch Metadaten, Geschäftslogik und Datenbeziehungen in einem einheitlichen Kontextdiagramm. Dieses Diagramm liefert die zuverlässigen Unternehmensdaten, die KI-Agenten benötigen, um komplexe Aufgaben genau auszuführen. Dabei werden Funktionen wie die automatische Kontextkuratierung, geprüfte Beispielabfragen und lokale und Remote-Integrationen des Model Context Protocol (MCP) genutzt.

Was bleibt gleich?

Ihre vorhandenen Dataplex-Bereitstellungen, APIs und Konfigurationen bleiben in Betrieb. Kernfunktionen wie Datenerkennung, Lineage, Datenqualität und Unternehmensglossare bleiben unverändert und werden weiterhin unterstützt. Ihre vorhandenen Metadaten, Aspekte und Konfigurationen werden ohne manuelle Migration, Datenverschiebung oder Ausfallzeiten auf die neue Knowledge Catalog-Umgebung umgestellt.

APIs und Clientbibliotheken

Durch das Rebranding zu Knowledge Catalog ändern sich die vorhandenen API-Endpunkte, gcloud dataplex-Befehle oder Clientbibliotheken nicht. Sie können weiterhin die Knowledge Catalog APIs und Clientbibliotheken verwenden, um mit Knowledge Catalog zu interagieren:

REST API Weitere Informationen finden Sie in der Knowledge Catalog REST API Dokumentation.

RPC API Weitere Informationen finden Sie in der Knowledge Catalog RPC API Dokumentation.

Clientbibliotheken Verwenden Sie die Knowledge Catalog-Client bibliotheken, um in der Sprache Ihrer Wahl mit Knowledge Catalog zu beginnen.

gcloud-Befehle Verwalten Sie Knowledge Catalog-Ressourcen mit der Befehlsgruppe

gcloud dataplex. Weitere Informationen finden Sie in der gcloud Dataplex-Befehlsreferenz.

Funktionsweise von Knowledge Catalog

Knowledge Catalog vereint Governance und Kontext durch drei Kernsäulen:

Grundlage für Governance Knowledge Catalog erfasst automatisch technische Metadaten aus Google Cloud Diensten wie BigQuery, AlloyDB for PostgreSQL und Spanner sowie aus Drittanbietersystemen. Durch ein zentrales Unternehmensglossar, Datenqualitätsprüfungen, Anomalieerkennung und richtlinienbasierte Governance wird eine vertrauenswürdige Datengrundlage geschaffen.

Kontextkuratierung Mit Gemini leitet der Dienst die geschäftliche Absicht ab, indem er Schemas, Abfragelogs und semantische Modelle in Ihren Daten analysiert. Er generiert Beschreibungen in natürlicher Sprache, erkennt Beziehungen und schlägt geprüfte SQL-Muster in Form von Beispielabfragen vor, die komplexe Geschäftslogik erfassen.

Kontextabruf KI-Agenten und ‑Anwendungen können Assets sofort erkennen und angereicherten Kontext über die semantische Suche und Tools abrufen, die das Model Context Protocol (MCP) unterstützen. So können Agenten auf die Wahrheit im Unternehmen zugreifen, um zuverlässige Entscheidungen zu treffen.

Das folgende Diagramm veranschaulicht die Architektur von Knowledge Catalog und wie es Data Governance mit generativen KI-Workflows vereint:

Gängige Anwendungsfälle

Knowledge Catalog hilft Data Engineers, Data Scientists und KI-Entwicklern, Herausforderungen in den Bereichen Datenverwaltung und KI-Entwicklung zu bewältigen:

Daten für KI anreichern Verwenden Sie Datenanalysen für unstrukturierte Daten, um automatisch Metadaten und Entitäten aus unstrukturierten Dateien wie PDFs in Cloud Storage zu extrahieren. So können KI-Modelle auf Dark Data und Unternehmenswissen zugreifen.

KI-Halluzinationen reduzieren Stellen Sie KI-Agenten vorab geprüfte Beispielabfragen und semantische Leitplanken zur Verfügung, damit sie komplexe Datenabrufe mit einer deterministischeren Genauigkeit ausführen können.

Datenerkennung beschleunigen Verwenden Sie die semantische Suche und ein zentrales Kontextdiagramm, um relevante Datenassets aus verschiedenen Quellen für Analysen und Data-Science-Workflows zu finden.

Erstellung von Datenprodukten automatisieren Leiten Sie Beziehungen in Ihrer Datenlandschaft ab, um Assets in eigenständige Datenprodukte mit integrierten SLAs (Service-Level-Agreements) und Governance-Einschränkungen zu verpacken.

Beispiel-Workflows in Knowledge Catalog

Um zu sehen, wie Sie Ihr Kontextdiagramm erstellen und Ihre Datenlandschaft verwalten können, sehen Sie sich an, wie ein Onlinehändler die folgenden Knowledge Catalog-Funktionen verwenden könnte:

Daten erkennen und katalogisieren Der Händler erfasst automatisch Transaktionsdaten und erhebt Metadaten aus Google Cloud Diensten wie BigQuery, Pub/Sub und Cloud Storage. Der Dienst importiert auch Metadaten aus benutzerdefinierten Inventardatenbanken, um eine ganzheitliche Übersicht der gesamten Datenlandschaft des Einzelhandels zu erstellen. Weitere Informationen finden Sie unter Daten erkennen.

Nach Datenassets suchen Ein Data Scientist findet die benötigten Kundendatenassets mit der Knowledge Catalog-Suchmaschine mit facettierter Filterung, semantischer Suche in natürlicher Sprache und logischen Operatoren. Weitere Informationen finden Sie unter Nach Daten assets suchen.

Daten mit geschäftlichem Kontext anreichern Das Data Governance-Team definiert die Terminologie für den Einzelhandel (z. B. „Lifetime-Wert“ oder „SKU“) mithilfe von Unternehmensglossaren und verwendet KI-gestützte Datenanalysen, um automatisch Beschreibungen für neue Produkttabellen zu generieren. Außerdem werden strukturierte benutzerdefinierte Metadaten und Tags (Aspekte) manuell einheitlich auf alle Assets angewendet. Weitere Informationen finden Sie unter Aspekte verwalten und Metadaten anreichern und Unternehmensglossar verwalten.

Datenbeziehungen mit Lineage verstehen Das Engineering-Team verfolgt automatisch die Datenherkunft, um zu sehen, wie Auftragsdaten in den Systemen verschoben, transformiert und verwendet werden. Mithilfe von Lineage-Diagrammen können sie Fehler in Berichtspipelines beheben, Ursachenanalysen für Fehler an der Kasse durchführen und die Compliance sicherstellen. Weitere Informationen finden Sie unter Datenherkunft übersicht.

Datenprofil erstellen und Qualität messen Der Händler verwendet die automatische Datenprofilerstellung, um Muster und Anomalien in seinen BigQuery-Preistabellen zu erkennen. Er definiert und führt Datenqualitätsprüfungen durch, um sicherzustellen, dass die Lieferadressen der Kunden für nachgelagerte KI- und Fulfillment-Arbeitslasten korrekt, vollständig und zuverlässig sind. Weitere Informationen finden Sie unter Übersicht zur Datenprofilerstellung und Übersicht zur automatischen Datenqualität.

Datenprodukte kuratieren und freigeben Das Datenplattformteam verpackt regionale Verkaufsassets und die zugehörigen Metadaten, Qualitätsbewertungen und Lineage in kuratierte „Customer 360“-Datenprodukte, die von Marketing- und Inventarteams erkannt und verwendet werden. Weitere Informationen finden Sie unter Datenprodukte übersicht.

Knowledge Catalog im Google Cloud Ökosystem

Beim Aufbau einer Datengrundlage ist es wichtig zu verstehen, wie Knowledge Catalog in verwandte Google Cloud Dienste eingebunden wird:

| Dienst | Primäre Rolle | Geeignet für |

|---|---|---|

| Knowledge Catalog | Agentischer Kontext und Data Governance | Zum Katalogisieren von Metadaten, Verwalten der Datenqualität und Bereitstellen einer semantischen Grundlage für KI-Agenten. |

| BigQuery | Data Warehouse der Enterprise-Stufe | Zum Speichern, Abfragen und Analysieren großer Datasets. Knowledge Catalog reichert BigQuery-Daten mit geschäftlichem Kontext an. |

| Vertex AI | Plattform für KI und maschinelles Lernen | Zum Erstellen und Bereitstellen von ML-Modellen und KI-Agenten. Agenten verwenden Knowledge Catalog APIs, um genauen Unternehmenskontext abzurufen. |

| Cloud Storage | Unstrukturierter Datenspeicher | Zum Speichern von Rohdateien. Knowledge Catalog scannt Cloud Storage-Buckets, um durchsuchbare Metadaten und Entitäten zu extrahieren. |

Wichtige Konzepte

Um Knowledge Catalog effektiv zu nutzen, müssen Sie die folgenden wichtigen Konzepte verstehen:

Kontextdiagramm Eine dynamische, einheitliche Darstellung der Beziehungen zwischen Daten und Ihrem Unternehmen. Es verbindet technische Schemas mit Geschäftseinheiten und unstrukturiertem Wissen.

Beispielabfragen Vorab generierte, geprüfte SQL-Muster, die komplexe Geschäftslogik erfassen. Mit diesen Abfragen können sowohl Menschen als auch KI-Agenten Daten genau abfragen, ohne komplexe Tabellenverknüpfungen neu zu erstellen.

Model Context Protocol (MCP) Ein offener Standard, mit dem KI-Agenten verfügbare Tools erkennen und adaptiv verwenden können. Knowledge Catalog verwendet MCP-Tools, um Agenten zertifizierte Unternehmensdaten direkt bereitzustellen. Dabei werden sowohl Remote- als auch lokale MCP-Server verwendet, um die Anforderungen an Zugänglichkeit und Sicherheit zu erfüllen.

-- Example: An example query retrieved by an AI agent to ensure accurate revenue calculation

SELECT customer_id, SUM(transaction_amount) AS total_revenue

FROM `sales.processed_transactions`

WHERE transaction_status = 'COMPLETED'

GROUP BY customer_id;

Aufnahmen

Knowledge Catalog erfasst automatisch Metadaten aus den folgenden Google Cloud Quellen. Bei einigen Diensten wie AlloyDB for PostgreSQL und Cloud SQL müssen Sie zuerst die Knowledge Catalog-Integration aktivieren, bevor Metadaten erfasst werden können:

Analyse und Lakehouse

- BigQuery-Datasets, ‑Tabellen, ‑Ansichten, ‑Modelle, ‑Routinen, ‑Verbindungen und verknüpfte Datasets

- BigQuery Sharing-Einträge (früher Analytics Hub)

- Dataform-Repositories und Code-Assets

- Dataproc Metastore-Dienste, ‑Datenbanken und ‑Tabellen

Iceberg REST Catalog-Tabellen, einschließlich Google Cloud Lakehouse Runtime Catalog IRC, Databricks Unity IRC, AWS Glue Data Catalog IRC und Snowflake Horizon IRC

KI und maschinelles Lernen

- Vertex AI-Modelle, ‑Datasets, ‑Featuregruppen, ‑Featureansichten und ‑Onlineshop-Instanzen

Business Intelligence

- Looker (Google Cloud Core)-Instanzen, ‑Dashboards, ‑Dashboardelemente, ‑Looks, ‑LookML-Projekte, ‑Modelle, ‑Explores und ‑Ansichten (Vorschau)

Datenbanken

- Bigtable-Instanzen, ‑Cluster und ‑Tabellen, einschließlich Details zur Spaltenfamilie

- Spanner-Instanzen, ‑Datenbanken, ‑Tabellen und ‑Ansichten

Streaming und Messaging

- Pub/Sub-Themen

Unstrukturierte Daten

Betriebsdatenbanken

- AlloyDB for PostgreSQL-Cluster, ‑Instanzen, ‑Datenbanken, ‑Schemas, ‑Tabellen und ‑Ansichten (Vorschau) – Informationen finden Sie unter AlloyDB for PostgreSQL in Knowledge Catalog einbinden.

- Cloud SQL-Instanzen, ‑Datenbanken, ‑Schemas, ‑Tabellen, ‑Ansichten – Informationen finden Sie unter Cloud SQL-Integration aktivieren.

Wenn Sie Metadaten aus einer Drittanbieterquelle in Knowledge Catalog importieren möchten, können Sie eine Pipeline für verwaltete Verbindungen verwenden. Weitere Informationen finden Sie unter Übersicht über verwaltete Verbindungen.

Beschränkungen

Beachten Sie bei der Planung Ihrer Bereitstellung die folgenden Einschränkungen:

Unterstützte Einbindungen Knowledge Catalog unterstützt zwar wichtige Drittanbietersysteme, bestimmte automatisierte semantische Extraktionen sind jedoch möglicherweise auf integrierte Google Cloud Dienste beschränkt.

Kontingentlimits Für Standard- Google Cloud API-Kontingente gelten Kontext- abruf- und Metadatenextraktionsvorgänge.

Nächste Schritte

Lesen Sie die Einführung in Knowledge Catalog für KI.

Weitere Informationen zur Metadatenverwaltung in Knowledge Catalog

Informationen zum Suchen nach Datenassets

Informationen zur Datenherkunft

Informationen zur Datenprofilerstellung

Informationen zur automatischen Datenqualität