TPU v5e

Questo documento descrive l'architettura e le configurazioni supportate di Cloud TPU v5e.

TPU v5e supporta l'addestramento su host singolo e multi-host e l'inferenza su host singolo. L'inferenza multi-host è supportata tramite Sax. Per maggiori informazioni, consulta Inferenza di Cloud TPU.

Architettura di sistema

Ogni chip v5e contiene un TensorCore. Ogni TensorCore ha quattro unità di moltiplicazione a matrice (MXU), un'unità vettoriale e un'unità scalare.

Il seguente diagramma illustra un chip TPU v5e.

La tabella seguente mostra le specifiche chiave e i relativi valori per v5e.

| Specifica | Valori |

|---|---|

| Prestazioni/costo totale di proprietà (TCO) (previsto) | 0,65x |

| Picco di computing per chip (bf16) | 197 TFLOP |

| Picco di computing per chip (Int8) | 393 TOP |

| Capacità HBM per chip | 16 GB |

| Larghezza di banda HBM per chip | 800 GiBps |

| Larghezza di banda di interconnessione inter-chip (ICI) bidirezionale (per chip) | 400 GBps |

| Porte ICI per chip | 4 |

| DRAM per host | 512 GiB |

| Chip per host | 8 |

| Dimensioni del pod di TPU | 256 chip |

| Topologia di interconnessione | Toroide 2D |

| Picco di computing BF16 per pod | 50,63 PFLOP |

| Larghezza di banda all-reduce per pod | 51,2 TB/s |

| Larghezza di banda bisezionale per pod | 1,6 TB/s |

| Configurazione NIC per host | NIC 2 x 100 Gbps |

| Larghezza di banda della rete del data center per pod | 6,4 Tbps |

| Picco di computing per pod | 100 PetaOp (Int8) |

Configurazioni

Cloud TPU v5e è un prodotto combinato di addestramento e inferenza (serving). I job di addestramento sono ottimizzati per la velocità effettiva e la disponibilità, mentre i job di serving sono ottimizzati per la latenza. Un job di addestramento sulle TPU di cui è stato eseguito il provisioning per il serving potrebbe avere una disponibilità inferiore e, analogamente, un job di serving eseguito sulle TPU di cui è stato eseguito il provisioning per l'addestramento potrebbe avere una latenza maggiore.

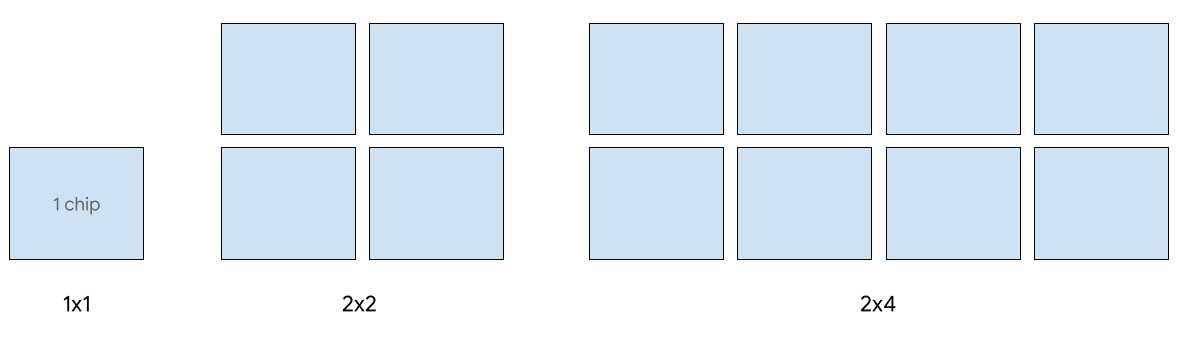

Per v5e sono supportate le seguenti forme di slice 2D:

| Topologia | Numero di chip TPU | Numero di host |

|---|---|---|

| 1x1 | 1 | 1/8 |

| 2x2 | 4 | 1/2 |

| 2x4 | 8 | 1 |

| 4x4 | 16 | 2 |

| 4x8 | 32 | 4 |

| 8x8 | 64 | 8 |

| 8x16 | 128 | 16 |

| 16x16 | 256 | 32 |

Tipi di VM

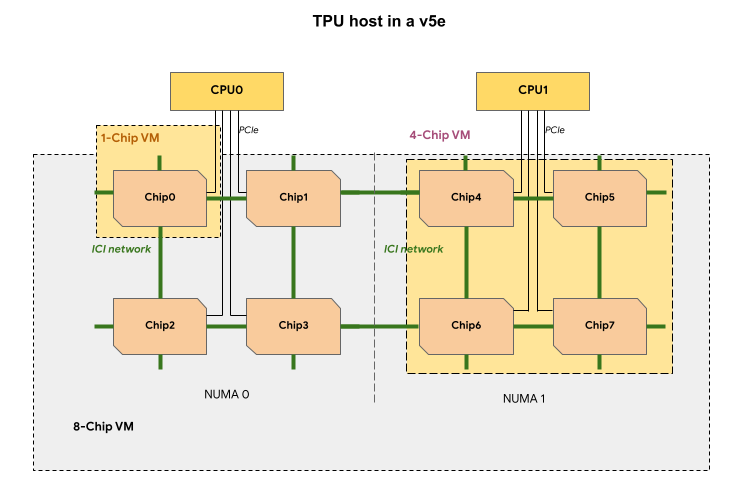

Ogni VM TPU in una slice TPU v5e contiene 1, 4 o 8 chip. Nelle slice con 4 chip o meno, tutti i chip TPU condividono lo stesso nodo NUMA (accesso alla memoria non uniforme).

Per le VM TPU v5e a 8 chip, la comunicazione CPU-TPU sarà più efficiente all'interno delle partizioni NUMA. Ad esempio, nella figura seguente, la comunicazione CPU0-Chip0 sarà più veloce della comunicazione CPU0-Chip4.

La tabella seguente mostra un confronto dei tipi di VM TPU v5e:

| Tipo di VM | Tipo di macchina (API GKE) | Numero di vCPU per VM | RAM (GB) per VM | Numero di nodi NUMA per VM |

|---|---|---|---|---|

| VM a 1 chip | ct5lp-hightpu-1t |

24 | 48 | 1 |

| VM a 4 chip | ct5lp-hightpu-4t |

112 | 192 | 1 |

| VM a 8 chip | ct5lp-hightpu-8t |

224 | 384 | 2 |

Tipi di Cloud TPU v5e per il serving

Il serving su host singolo è supportato per un massimo di 8 chip v5e. Sono supportate le seguenti configurazioni: slice 1x1, 2x2 e 2x4. Ogni slice ha rispettivamente 1, 4 e 8 chip.

Per eseguire il provisioning delle TPU per un job di serving, utilizza una delle seguenti dimensioni di slice TPU nella richiesta di creazione di TPU CLI o API:

| Numero di chip TPU | Tipo di macchina (API GKE) |

|---|---|

1 |

ct5lp-hightpu-1t |

4 |

ct5lp-hightpu-4t |

8 |

ct5lp-hightpu-8t |

Per maggiori informazioni sulla gestione delle TPU, consulta Gestire leTPU. Per maggiori informazioni sull'architettura di sistema di Cloud TPU, consulta Architettura di sistema.

Il serving su più di 8 chip v5e, chiamato anche serving multi-host, è supportato tramite Sax. Per maggiori informazioni, consulta Inferenza di Cloud TPU.

Tipi di Cloud TPU v5e per l'addestramento

L'addestramento è supportato per un massimo di 256 chip.

Per eseguire il provisioning delle TPU per un job di addestramento v5e, utilizza una delle seguenti dimensioni di slice TPU nella richiesta di creazione di TPU CLI o API:

| Numero di chip TPU | Tipo di macchina (API GKE) | Topologia |

|---|---|---|

16 |

ct5lp-hightpu-4t |

4x4 |

32 |

ct5lp-hightpu-4t |

4x8 |

64 |

ct5lp-hightpu-4t |

8x8 |

128 |

ct5lp-hightpu-4t |

8x16 |

256 |

ct5lp-hightpu-4t |

16x16 |

Per maggiori informazioni sulla gestione delle TPU, consulta Gestire leTPU. Per maggiori informazioni sull'architettura di sistema di Cloud TPU, consulta Architettura di sistema.