Auf dieser Seite wird die GPU-Konfiguration für Ihre Cloud Run-Dienste beschrieben. GPUs eignen sich gut für KI-Inferenz-Arbeitslasten wie Large Language Models (LLMs) oder andere rechenintensive, KI-unabhängige Anwendungsfälle wie Videotranscodierung und 3D-Rendering. Google bietet NVIDIA L4-GPUs mit 24 GB GPU-Speicher (VRAM) und NVIDIA RTX PRO 6000 Blackwell-GPUs (Vorschau) mit 96 GB GPU-Speicher (VRAM) an. Dieser Speicher ist vom Instanzspeicher getrennt.

GPUs in Cloud Run werden vollständig verwaltet. Es sind keine zusätzlichen Treiber oder Bibliotheken erforderlich. Die GPU-Funktion bietet On-Demand-Verfügbarkeit ohne erforderliche Reservierungen, ähnlich wie bei On-Demand-CPUs und On-Demand-Arbeitsspeicher in Cloud Run. Instanzen eines Cloud Run-Dienstes, der für die Verwendung von GPUs konfiguriert wurde, können zur Kostensenkung auf null skaliert werden, wenn sie nicht verwendet werden.

Cloud Run-Instanzen mit einer angehängten L4- oder NVIDIA RTX PRO 6000 Blackwell-GPU mit vorinstallierten Treibern werden in etwa 5 Sekunden gestartet. Danach können die in Ihrem Container ausgeführten Prozesse die GPU verwenden.

Sie können eine GPU pro Cloud Run-Instanz konfigurieren. Wenn Sie Sidecar-Container verwenden, kann die GPU nur an einen Container angehängt werden.

Unterstützte GPU-Typen

Cloud Run unterstützt zwei Arten von GPUs:

- L4-GPU mit der aktuellen NVIDIA-Treiberversion: 535.216.03 (12.2). Für L4-GPUs müssen Sie mindestens 4 CPUs und 16 GiB Arbeitsspeicher verwenden.

- NVIDIA RTX PRO 6000 Blackwell-GPU mit der aktuellen NVIDIA-Treiberversion: 580.x.x (13.0) (Vorschau). Für die NVIDIA RTX PRO 6000 Blackwell-GPU müssen Sie mindestens 20 CPUs und 80 GiB Arbeitsspeicher verwenden.

Unterstützte Regionen

Die L4-GPU wird in den folgenden Regionen unterstützt:

asia-southeast1(Singapur)asia-south1(Mumbai) . Diese Region ist nur auf Einladung verfügbar. Wenden Sie sich an Ihr Google Konten-Team, wenn Sie daran interessiert sind.europe-west1(Belgien)Niedriger CO2-Ausstoß

europe-west4(Niederlande)Niedriger CO2-Ausstoß

us-central1(Iowa)Niedriger CO2-Ausstoß . Diese Region ist nur auf Einladung verfügbar. Wenden Sie sich an Ihr Google Konten-Team, wenn Sie daran interessiert sind.

us-east4(Northern Virginia)

Die folgenden Regionen werden von der NVIDIA RTX PRO 6000 Blackwell-GPU (Vorschau) unterstützt:

asia-southeast1(Singapur). Diese Region ist nur auf Einladung verfügbar. Wenden Sie sich an Ihr Google Konten-Team, wenn Sie daran interessiert sind.asia-south2(Delhi, Indien). Diese Region ist nur auf Einladung verfügbar. Wenden Sie sich an Ihr Google Konten-Team, wenn Sie daran interessiert sind.europe-west4(Niederlande)Niedriger CO2-Ausstoß

us-central1(Iowa)Niedriger CO2-Ausstoß

Auswirkungen auf die Kosten

Weitere Informationen zu GPU-Preisen finden Sie unter Cloud Run – Preise. Beachten Sie die folgenden Anforderungen und Hinweise:

- Es fallen keine Gebühren pro Anfrage an. Sie müssen die instanzbasierte Abrechnung verwenden, um die GPU-Funktion zu nutzen. Mindestinstanzen werden auch im Inaktivitätsstatus zum vollen Preis berechnet.

- Es gibt einen Kostenunterschied zwischen zonaler GPU-Redundanz und nicht zonaler Redundanz. Weitere Informationen zu GPU-Preisen finden Sie unter Cloud Run – Preise.

- Wenn Sie einen Cloud Run-Dienst oder eine Cloud Run-Funktion aus Quellcode mit aktivierten GPUs bereitstellen, verwendet Cloud Run den Maschinentyp

e2-highcpu-8anstelle des Standardmaschinentypse2-standard-2, um Ihren Quellcode zu erstellen. Der größere Maschinentyp bietet eine höhere CPU-Unterstützung und eine höhere Netzwerkbandbreite, was zu schnelleren Build-Zeiten führt. - Die CPU- und Speicherkonfigurationen Ihrer Ressource.

- Die GPU wird für die gesamte Dauer des Instanzlebenszyklus abgerechnet.

Optionen für die zonale GPU-Redundanz

Standardmäßig stellt Cloud Run Ihren Dienst in mehreren Zonen innerhalb einer Region bereit. Diese Architektur bietet eine inhärente Resilienz: Wenn es in einer Zone zu einem Ausfall kommt, leitet Cloud Run den Traffic automatisch von der betroffenen Zone zu fehlerfreien Zonen in derselben Region um.

Wenn Sie mit GPU-Ressourcen arbeiten, sollten Sie die spezifischen Kapazitätsbeschränkungen von GPU-Ressourcen beachten. Bei einem Zonenausfall hängt der Standard-Failover-Mechanismus für GPU-Arbeitslasten davon ab, dass in den verbleibenden fehlerfreien Zonen genügend ungenutzte GPU-Kapazität verfügbar ist. Aufgrund der begrenzten Verfügbarkeit von GPUs ist diese Kapazität möglicherweise nicht immer verfügbar.

Um die Verfügbarkeit Ihrer GPU-beschleunigten Dienste bei zonalen Ausfällen zu erhöhen, können Sie die zonale Redundanz speziell für GPUs konfigurieren:

Zonale Redundanz aktiviert (Standard): Cloud Run reserviert GPU-Kapazität für Ihren Dienst in mehreren Zonen. Dadurch wird die Wahrscheinlichkeit, dass Ihr Dienst den von einer betroffenen Zone umgeleiteten Traffic erfolgreich verarbeiten kann, erheblich erhöht. Dies bietet eine höhere Zuverlässigkeit bei zonalen Ausfällen, jedoch zu zusätzlichen Kosten pro GPU-Sekunde.

Zonale Redundanz deaktiviert: Cloud Run versucht, für GPU-Arbeitslasten auf Best-Effort-Basis ein Failover durchzuführen. Der Traffic wird nur dann an andere Zonen weitergeleitet, wenn zu diesem Zeitpunkt genügend GPU-Kapazität verfügbar ist. Diese Option garantiert keine reservierte Kapazität für Failover-Szenarien, führt aber zu niedrigeren Kosten pro GPU-Sekunde.

SLA

Die SLA für Cloud Run mit GPU hängt davon ab, ob für den Dienst die Option für zonale oder nicht zonale Redundanz verwendet wird. Weitere Informationen finden Sie auf der SLA-Seite.

Kontingenterhöhung anfordern

Projekten, in denen Cloud Run-nvidia-l4-GPUs in einer Region zum ersten Mal verwendet werden, wird automatisch ein GPU-Kontingent von 3 Einheiten (zonale Redundanz deaktiviert) gewährt, wenn die erste Bereitstellung erstellt wird. Das Kontingent für Cloud Run nvidia-rtx-pro-6000 GPU wird in Milli-GPUs gewährt. Projekten, in denen die nvidia-rtx-pro-6000-GPU in einer Region zum ersten Mal verwendet wird, werden bei der ersten Bereitstellung automatisch 3.000 milliGPU-Kontingente (zonale Redundanz deaktiviert) zugewiesen. Das entspricht 3 GPUs.

Wenn Sie zusätzliche Cloud Run-GPUs benötigen, müssen Sie eine Kontingenterhöhung für Ihren Cloud Run-Dienst anfordern. Über die Links in den folgenden Schaltflächen können Sie das benötigte Kontingent anfordern.

| Kontingent erforderlich | Kontingentlink |

|---|---|

| L4-GPU mit deaktivierter zonaler Redundanz (niedrigerer Preis) | GPU-Kontingent ohne zonale Redundanz anfordern |

| L4-GPU mit aktivierter zonaler Redundanz (höherer Preis) | GPU-Kontingent mit zonaler Redundanz anfordern |

| NVIDIA RTX PRO 6000 Blackwell-GPU mit deaktivierter zonaler Redundanz (niedrigerer Preis) | GPU-Kontingent ohne zonale Redundanz anfordern |

| NVIDIA RTX PRO 6000 Blackwell-GPU mit aktivierter zonaler Redundanz (höherer Preis) | GPU-Kontingent mit zonaler Redundanz anfordern |

Weitere Informationen zum Anfordern von Kontingenterhöhungen finden Sie unter Kontingent erhöhen.

Hinweis

In der folgenden Liste werden die Anforderungen und Einschränkungen für die Verwendung von GPUs in Cloud Run beschrieben:

- Melden Sie sich in Ihrem Google Cloud -Konto an. Wenn Sie mit Google Cloudnoch nicht vertraut sind, erstellen Sie ein Konto, um die Leistungsfähigkeit unserer Produkte in der Praxis sehen und bewerten zu können. Neukunden erhalten außerdem ein Guthaben von 300 $, um Arbeitslasten auszuführen, zu testen und bereitzustellen.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Cloud Run API aktivieren

Rollen, die zum Aktivieren von APIs erforderlich sind

Zum Aktivieren von APIs benötigen Sie die IAM-Rolle „Service Usage-Administrator“ (

roles/serviceusage.serviceUsageAdmin), die die Berechtigungserviceusage.services.enableenthält. Weitere Informationen zum Zuweisen von Rollen - Erforderliches Kontingent anfordern

- Empfehlungen zum Erstellen Ihres Container-Images und zum Laden großer Modelle finden Sie unter Best Practices: KI-Inferenz in Cloud Run mit GPUs.

- Ihr Cloud Run-Dienst muss die folgenden Konfigurationen haben:

- Konfigurieren Sie die Abrechnungseinstellungen für die instanzbasierte Abrechnung. Dienste, für die die instanzbasierte Abrechnung festgelegt ist, können trotzdem auf null skaliert werden.

- Konfigurieren Sie für die L4-GPU mindestens 4 CPUs für Ihren Dienst (8 CPUs werden empfohlen) und mindestens 16 GiB Arbeitsspeicher (32 GiB werden empfohlen).

- Konfigurieren Sie für die NVIDIA RTX PRO 6000 Blackwell-GPU mindestens 20 CPUs und mindestens 80 GiB Arbeitsspeicher.

- Ermitteln Sie eine optimale maximale Gleichzeitigkeit für die GPU-Nutzung und legen Sie sie fest.

- Die maximale Anzahl von Instanzen muss unter dem zulässigen GPU-Kontingent pro Projekt und Region liegen. Weitere Informationen finden Sie unter GPUs und maximale Instanzen.

Erforderliche Rollen

Bitten Sie Ihren Administrator, Ihnen die folgenden IAM-Rollen für Dienste zuzuweisen, um die Berechtigungen zu erhalten, die Sie zum Konfigurieren und Bereitstellen von Cloud Run-Diensten benötigen:

-

Cloud Run-Entwickler (

roles/run.developer) - der Cloud Run-Dienst - Dienstkontonutzer (

roles/iam.serviceAccountUser) - die Dienstidentität

Wenn Sie einen Dienst oder eine Funktion aus Quellcode bereitstellen, müssen Sie auch zusätzliche Rollen für Ihr Projekt und Ihr Cloud Build-Dienstkonto haben.

Eine Liste der IAM-Rollen und -Berechtigungen im Zusammenhang mit Cloud Run finden Sie unter IAM-Rollen für Cloud Run und IAM-Berechtigungen für Cloud Run. Wenn Ihr Cloud Run-Dienst mitGoogle Cloud -APIs wie Cloud-Clientbibliotheken verknüpft ist, lesen Sie die Konfigurationsanleitung für Dienstidentitäten. Weitere Informationen zum Zuweisen von Rollen finden Sie unter Bereitstellungsberechtigungen und Zugriff verwalten.

Cloud Run-Dienst mit GPU konfigurieren

Jede Konfigurationsänderung führt zur Erstellung einer neuen Überarbeitung. Für nachfolgende Überarbeitungen gilt automatisch dieselbe Konfigurationseinstellung, sofern Sie sie nicht explizit aktualisieren.

Sie können die Google Cloud Console, die Google Cloud CLI oder YAML verwenden, um die GPU zu konfigurieren.

Console

Rufen Sie in der Google Cloud Console Cloud Run auf:

Wählen Sie im Cloud Run-Navigationsmenü Dienste aus und klicken Sie auf Container bereitstellen, um einen neuen Dienst zu konfigurieren. Wenn Sie einen vorhandenen Dienst konfigurieren möchten, klicken Sie auf den Dienst und dann auf Neue Überarbeitung bearbeiten und bereitstellen.

Wenn Sie einen neuen Dienst konfigurieren, füllen Sie die Seite mit den anfänglichen Diensteinstellungen aus und klicken Sie dann auf Container, Volumes, Netzwerk, Sicherheit, um die Seite zur Dienstkonfiguration zu maximieren.

Klicken Sie auf den Tab Container.

- Konfigurieren Sie CPU, Arbeitsspeicher, Nebenläufigkeit, Ausführungsumgebung und Startprüfung gemäß den Empfehlungen unter Vorbereitung.

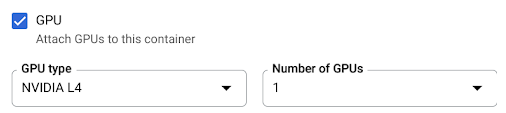

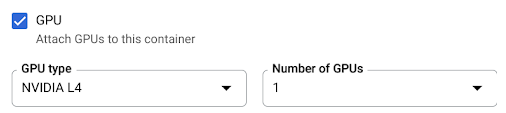

- Aktivieren Sie das GPU-Kästchen und wählen Sie dann im Menü GPU-Typ den GPU-Typ und im Menü Anzahl der GPUs die Anzahl der GPUs aus.

- Für neue Dienste ist die zonale Redundanz standardmäßig aktiviert. Wenn Sie die aktuelle Einstellung ändern möchten, klicken Sie das Kästchen „GPU“ an, um die Optionen für GPU-Redundanz aufzurufen.

- Wählen Sie Keine zonale Redundanz aus, um die zonale Redundanz zu deaktivieren.

- Wählen Sie Zonale Redundanz aus, um die zonale Redundanz zu aktivieren.

Klicken Sie auf Erstellen oder Bereitstellen.

gcloud

Verwenden Sie den Befehl gcloud run deploy, um einen Dienst mit aktivierter GPU zu erstellen:

So stellen Sie einen Container bereit:

gcloud run deploy SERVICE \ --image IMAGE_URL \ --gpu 1

Ersetzen Sie Folgendes:

- SERVICE: Der Name Ihres Cloud Run-Dienstes.

- IMAGE_URL: ein Verweis auf das Container-Image, z. B.

us-docker.pkg.dev/cloudrun/container/hello:latestWenn Sie Artifact Registry verwenden, muss das Repository REPO_NAME bereits erstellt sein. Die URL hat das FormatLOCATION-docker.pkg.dev/PROJECT_ID/REPO_NAME/PATH:TAG.

So stellen Sie aus Quellcode bereit:

gcloud run deploy SERVICE \ --source . \ --gpu 1

Verwenden Sie den Befehl gcloud run services update, um die GPU-Konfiguration für einen Dienst zu aktualisieren. So aktualisieren Sie beispielsweise einen vorhandenen Dienst, für den ein Container-Image angegeben ist:

gcloud run services update SERVICE \ --image IMAGE_URL \ --cpu CPU \ --memory MEMORY \ --no-cpu-throttling \ --gpu GPU_NUMBER \ --gpu-type GPU_TYPE \ --max-instances MAX_INSTANCE --GPU_ZONAL_REDUNDANCY

Ersetzen Sie Folgendes:

- SERVICE: Der Name Ihres Cloud Run-Dienstes.

- IMAGE_URL: ein Verweis auf das Container-Image, z. B.

us-docker.pkg.dev/cloudrun/container/hello:latestWenn Sie Artifact Registry verwenden, muss das Repository REPO_NAME bereits erstellt sein. Die URL hat das FormatLOCATION-docker.pkg.dev/PROJECT_ID/REPO_NAME/PATH:TAG. - CPU: die Anzahl der CPUs. Für die L4-GPU müssen Sie mindestens

4CPUs angeben. Für die NVIDIA RTX PRO 6000 Blackwell-GPU müssen Sie mindestens20CPUs angeben. - MEMORY: die Größe des Arbeitsspeichers. Für die L4-GPU müssen Sie mindestens

16Gi(16 GiB) angeben. Für die NVIDIA RTX PRO 6000 Blackwell-GPU müssen Sie mindestens80Gi(80 GiB) angeben. - GPU_NUMBER: der Wert

1(eins). Wenn dieser Wert nicht angegeben ist, aber ein GPU_TYPE vorhanden ist, ist der Standardwert1. - GPU_TYPE: Der GPU-Typ. Geben Sie für die L4-GPU den Wert

nvidia-l4(nvidia-L4 Kleinbuchstabe L, nicht numerischer Wert vierzehn) ein. NVIDIA RTX PRO 6000 Blackwell-GPU, geben Sienvidia-rtx-pro-6000ein. - MAX_INSTANCE: die maximale Anzahl von Instanzen. Diese Zahl darf das für Ihr Projekt zugewiesene GPU-Kontingent nicht überschreiten.

- GPU_ZONAL_REDUNDANCY:

no-gpu-zonal-redundancyzum Deaktivieren der zonalen Redundanz odergpu-zonal-redundancyzum Aktivieren der zonalen Redundanz.

YAML

Wenn Sie einen neuen Dienst erstellen, überspringen Sie diesen Schritt. Wenn Sie einen vorhandenen Dienst aktualisieren, laden Sie die zugehörige YAML-Konfiguration herunter:

gcloud run services describe SERVICE --format export > service.yaml

Aktualisieren Sie das Attribut

nvidia.com/gpu:undnodeSelector::

run.googleapis.com/accelerator:apiVersion: serving.knative.dev/v1 kind: Service metadata: name: SERVICE spec: template: metadata: annotations: autoscaling.knative.dev/maxScale: 'MAX_INSTANCE' run.googleapis.com/cpu-throttling: 'false' run.googleapis.com/gpu-zonal-redundancy-disabled: 'GPU_ZONAL_REDUNDANCY' spec: containers: - image: IMAGE_URL ports: - containerPort: CONTAINER_PORT name: http1 resources: limits: cpu: 'CPU' memory: 'MEMORY' nvidia.com/gpu: '1' # Optional: use a longer startup probe to allow long starting containers startupProbe: failureThreshold: 1800 periodSeconds: 1 tcpSocket: port: CONTAINER_PORT timeoutSeconds: 1 nodeSelector: run.googleapis.com/accelerator: GPU_TYPE

Ersetzen Sie Folgendes:

- SERVICE: Der Name Ihres Cloud Run-Dienstes.

- IMAGE_URL: ein Verweis auf das Container-Image, z. B.

us-docker.pkg.dev/cloudrun/container/hello:latestWenn Sie Artifact Registry verwenden, muss das Repository REPO_NAME bereits erstellt sein. Die URL hat das FormatLOCATION-docker.pkg.dev/PROJECT_ID/REPO_NAME/PATH:TAG. - CONTAINER_PORT: Der für Ihren Dienst festgelegte Containerport.

- CPU: die Anzahl der CPUs. Für die L4-GPU müssen Sie mindestens

4CPUs angeben. Für die NVIDIA RTX PRO 6000 Blackwell-GPU müssen Sie mindestens20CPUs angeben. - MEMORY: die Größe des Arbeitsspeichers. Für die L4-GPU müssen Sie mindestens

16Gi(16 GiB) angeben. Für die NVIDIA RTX PRO 6000 Blackwell-GPU müssen Sie mindestens80Gi(80 GiB) angeben. - GPU_TYPE: Der GPU-Typ. Geben Sie für die L4-GPU den Wert

nvidia-l4(nvidia-L4 Kleinbuchstabe L, nicht numerischer Wert vierzehn) ein. NVIDIA RTX PRO 6000 Blackwell-GPU, geben Sienvidia-rtx-pro-6000ein. - MAX_INSTANCE: die maximale Anzahl von Instanzen. Diese Zahl darf das für Ihr Projekt zugewiesene GPU-Kontingent nicht überschreiten.

- GPU_ZONAL_REDUNDANCY:

false, um die zonale GPU-Redundanz zu aktivieren, odertrue, um sie zu deaktivieren.

Erstellen oder aktualisieren Sie den Dienst mit dem folgenden Befehl:

gcloud run services replace service.yaml

Terraform

Informationen zum Anwenden oder Entfernen einer Terraform-Konfiguration finden Sie unter Grundlegende Terraform-Befehle.

Fügen Sie einergoogle_cloud_run_v2_service-Ressource in Ihrer Terraform-Konfiguration Folgendes hinzu:resource "google_cloud_run_v2_service" "default" {

provider = google-beta

name = "SERVICE"

location = "europe-west1"

template {

gpu_zonal_redundancy_disabled = "GPU_ZONAL_REDUNDANCY"

containers {

image = "IMAGE_URL"

resources {

limits = {

"cpu" = "CPU"

"memory" = "MEMORY"

"nvidia.com/gpu" = "1"

}

}

}

node_selector {

accelerator = "GPU_TYPE"

}

}

}

Ersetzen Sie Folgendes:

- SERVICE: Der Name Ihres Cloud Run-Dienstes.

- GPU_ZONAL_REDUNDANCY:

false, um die zonale GPU-Redundanz zu aktivieren, odertrue, um sie zu deaktivieren. - IMAGE_URL: ein Verweis auf das Container-Image, z. B.

us-docker.pkg.dev/cloudrun/container/hello:latestWenn Sie Artifact Registry verwenden, muss das Repository REPO_NAME bereits erstellt sein. Die URL hat das FormatLOCATION-docker.pkg.dev/PROJECT_ID/REPO_NAME/PATH:TAG. - CPU: die Anzahl der CPUs. Für die L4-GPU müssen Sie mindestens

4CPUs angeben. Für die NVIDIA RTX PRO 6000 Blackwell-GPU müssen Sie mindestens20CPUs angeben. - MEMORY: die Größe des Arbeitsspeichers. Für die L4-GPU müssen Sie mindestens

16Gi(16 GiB) angeben. Für die NVIDIA RTX PRO 6000 Blackwell-GPU müssen Sie mindestens80Gi(80 GiB) angeben. - GPU_TYPE: Der GPU-Typ. Geben Sie für die L4-GPU den Wert

nvidia-l4(nvidia-L4 Kleinbuchstabe L, nicht numerischer Wert vierzehn) ein. Geben Sie für die NVIDIA RTX PRO 6000 Blackwell-GPUnvidia-rtx-pro-6000ein.

GPU-Einstellungen aufrufen

So rufen Sie die aktuellen GPU-Einstellungen für Ihren Cloud Run-Dienst auf:

Console

Rufen Sie in der Google Cloud Console die Seite Dienste für Cloud Run auf:

Klicken Sie auf den gewünschten Dienst, um die Seite Dienstdetails zu öffnen.

Klicken Sie auf den Tab Überarbeitungen.

Im Detailbereich auf der rechten Seite ist die GPU-Einstellung auf dem Tab Container aufgelistet.

gcloud

Verwenden Sie den folgenden Befehl:

gcloud run services describe SERVICE

Suchen Sie in der zurückgegebenen Konfiguration nach der GPU-Einstellung.

GPU entfernen

Sie können GPUs über die Google Cloud Console, die Google Cloud CLI oder YAML entfernen.

Console

Rufen Sie in der Google Cloud Console Cloud Run auf:

Wählen Sie im Cloud Run-Navigationsmenü Dienste aus und klicken Sie auf Container bereitstellen, um einen neuen Dienst zu konfigurieren. Wenn Sie einen vorhandenen Dienst konfigurieren möchten, klicken Sie auf den Dienst und dann auf Neue Überarbeitung bearbeiten und bereitstellen.

Wenn Sie einen neuen Dienst konfigurieren, füllen Sie die Seite mit den anfänglichen Diensteinstellungen aus und klicken Sie dann auf Container, Volumes, Netzwerk, Sicherheit, um die Seite zur Dienstkonfiguration zu maximieren.

Klicken Sie auf den Tab Container.

- Entfernen Sie das Häkchen aus dem Kästchen für die GPU.

Klicken Sie auf Erstellen oder Bereitstellen.

gcloud

Wenn Sie GPUs entfernen möchten, legen Sie die Anzahl der GPUs mit dem Befehl gcloud run services update auf 0 fest:

gcloud run services update SERVICE --gpu 0

Ersetzen Sie SERVICE durch den Namen Ihres Cloud Run-Dienstes.

YAML

Wenn Sie einen neuen Dienst erstellen, überspringen Sie diesen Schritt. Wenn Sie einen vorhandenen Dienst aktualisieren, laden Sie die zugehörige YAML-Konfiguration herunter:

gcloud run services describe SERVICE --format export > service.yaml

Löschen Sie die Zeilen

nvidia.com/gpu:undnodeSelector: run.googleapis.com/accelerator: GPU_TYPE.Erstellen oder aktualisieren Sie den Dienst mit dem folgenden Befehl:

gcloud run services replace service.yaml

Treiberbibliotheken

Standardmäßig werden alle NVIDIA L4- und NVIDIA RTX PRO 6000 Blackwell-GPU-Treiberbibliotheken unter /usr/local/nvidia/lib64 bereitgestellt. Cloud Run hängt diesen Pfad automatisch an die Umgebungsvariable LD_LIBRARY_PATH (d.h. ${LD_LIBRARY_PATH}:/usr/local/nvidia/lib64) des Containers mit der GPU an. So kann der dynamische Linker die NVIDIA-Treiberbibliotheken finden. Der Linker sucht und löst Pfade in der Reihenfolge auf, die Sie in der Umgebungsvariable LD_LIBRARY_PATH angeben. Alle Werte, die Sie in dieser Variablen angeben, haben Vorrang vor dem Standardpfad für Cloud Run-Treiberbibliotheken /usr/local/nvidia/lib64.

Wenn Sie eine CUDA-Version höher als 12.2 verwenden möchten, ist es am einfachsten, von einem neueren NVIDIA-Basis-Image abzuhängen, auf dem bereits Pakete für die Aufwärtskompatibilität installiert sind. Eine weitere Möglichkeit besteht darin, die NVIDIA-Pakete für die Aufwärtskompatibilität manuell zu installieren und sie zu LD_LIBRARY_PATH hinzuzufügen. Sehen Sie sich die Kompatibilitätsmatrix von NVIDIA an, um zu ermitteln, welche CUDA-Versionen mit der bereitgestellten NVIDIA-Treiberversion aufwärtskompatibel sind.

GPUs und maximale Anzahl von Instanzen

Die Anzahl der Instanzen mit GPUs ist auf zwei Arten begrenzt:

- Die Einstellung Maximale Anzahl von Instanzen begrenzt die Anzahl der Instanzen pro Dienst. Dieser Wert darf nicht höher als das GPU-Kontingent pro Projekt und Region sein.

- Das Kontingent an GPUs, das pro Projekt und Region zulässig ist. Dadurch wird die Anzahl der Instanzen über verschiedene Dienste hinweg in derselben Region begrenzt.

Nächste Schritte

Anleitungen finden Sie unter KI-Inferenzen auf Cloud Run mit GPUs ausführen.