Hinweis

Damit Sie die Bewertungsergebnisse aufrufen und analysieren können, müssen folgende Voraussetzungen erfüllt sein:

- Führen Sie mindestens eine Bewertung aus, wie unter KI-Agenten bewerten oder Offlinebewertungen ausführen beschrieben.

- Sie haben einen Cloud Storage-Bucket für die Bewertungsausgabe konfiguriert, wenn Sie Offlinebewertungen ausführen.

- Optional: Wenn Sie das SDK zum Abrufen von Ergebnissen verwenden, muss Ihre Umgebung authentifiziert sein.

Nachdem Sie eine Evaluierung ausgeführt haben, bietet die Agent Platform Diagnosetools, mit denen Sie die Ursachen von Fehlern ermitteln können. Sie können die Ergebnisse auf drei Ebenen analysieren: aggregierte Trends im Dashboard, semantische Gruppen in Fehlerclustern und detaillierte Logikpfade in einzelnen Traces.

Das Bewertungs-Dashboard für Online-Monitore

Für Agenten mit aktiven Online-Monitoren können Sie im Dashboard aggregierte Leistungstrends ansehen:

- Rufen Sie in der Google Cloud Console die Seite Agent Platform > Agents auf.

- Wählen Sie im linken Navigationsmenü Bereitstellungen aus.

Wählen Sie den Agent aus.

Klicken Sie auf den Tab Dashboard und wählen Sie den Unterabschnitt Bewertung aus.

- Leistungstrends:Hier können Sie visualisieren, wie sich die Werte für Messwerte wie Task Success oder Tool Use Quality in verschiedenen Agent-Versionen oder Zeiträumen ändern.

- Zero State:Für Kundenservicemitarbeiter ohne aktive Online Monitors werden in dieser Ansicht Abdeckungslücken identifiziert und ein Aufruf zum Handeln angezeigt, um mit der Bewertung zu beginnen.

Bewertungsergebnisse mit dem SDK ansehen

Sie können programmatisch über das Agent Platform SDK auf die Bewertungsergebnisse zugreifen. Das SDK bietet integrierte interaktive Visualisierungen für Colab- und Jupyter-Notebook-Umgebungen, in denen sowohl zusammengefasste Messwerte als auch detaillierte Ergebnisse für jeden Fall angezeigt werden.

Rufen Sie nach der Ausführung einer Analyse .show() für das Ergebnisobjekt auf, um einen interaktiven Bericht direkt in Ihrem Notebook zu rendern:

from vertexai import evals, types

# Run an evaluation

result = client.evals.evaluate(

dataset=eval_dataset,

metrics=[

types.RubricMetric.FINAL_RESPONSE_QUALITY,

types.RubricMetric.TOOL_USE_QUALITY,

types.RubricMetric.HALLUCINATION,

types.RubricMetric.SAFETY,

],

)

# Visualize aggregate and per-case results in your notebook

result.show()

Die Visualisierung enthält:

- Zusammenfassende Messwerte:Aggregierte Werte für alle Testläufe, einschließlich Durchschnittswert und Bestehensrate für jeden Messwert.

- Ergebnisse pro Fall:Einzelne Bewertungen für Testfälle, die Sie maximieren können, um detaillierte Ergebnisse zu sehen.

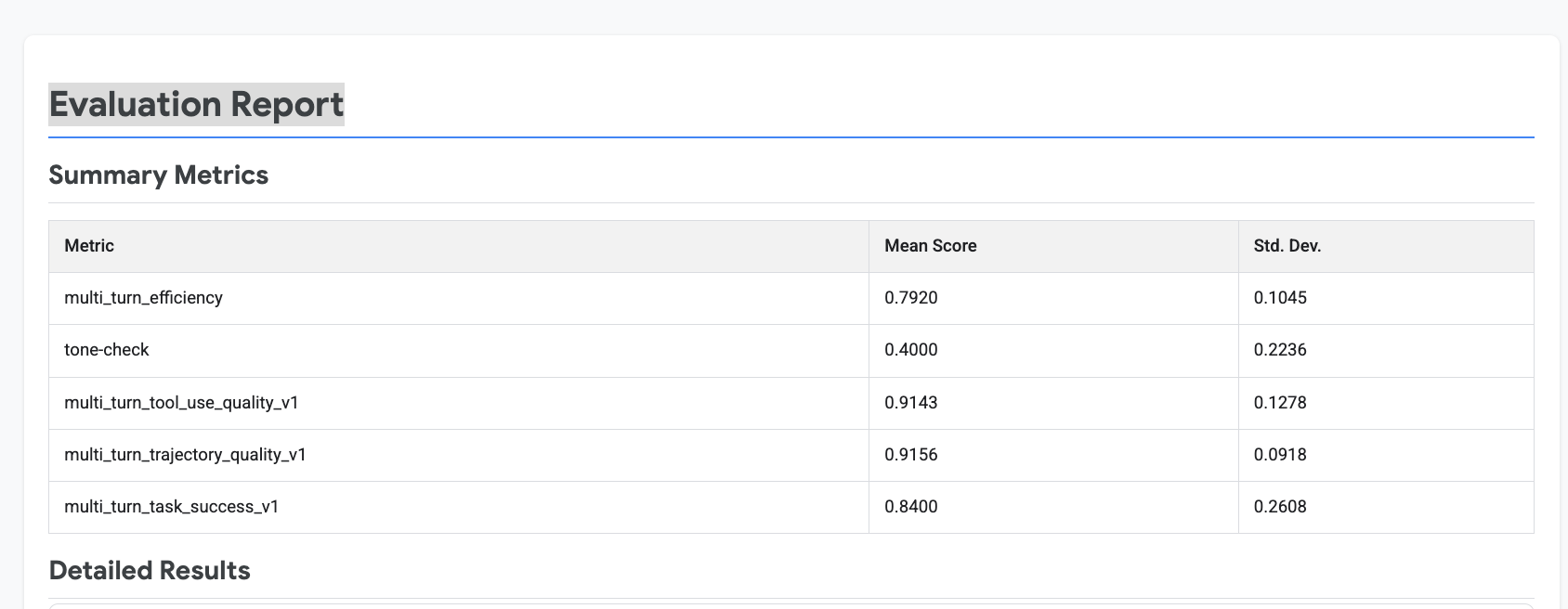

Das folgende Beispiel zeigt die zusammengefassten Messwerte aus result.show():

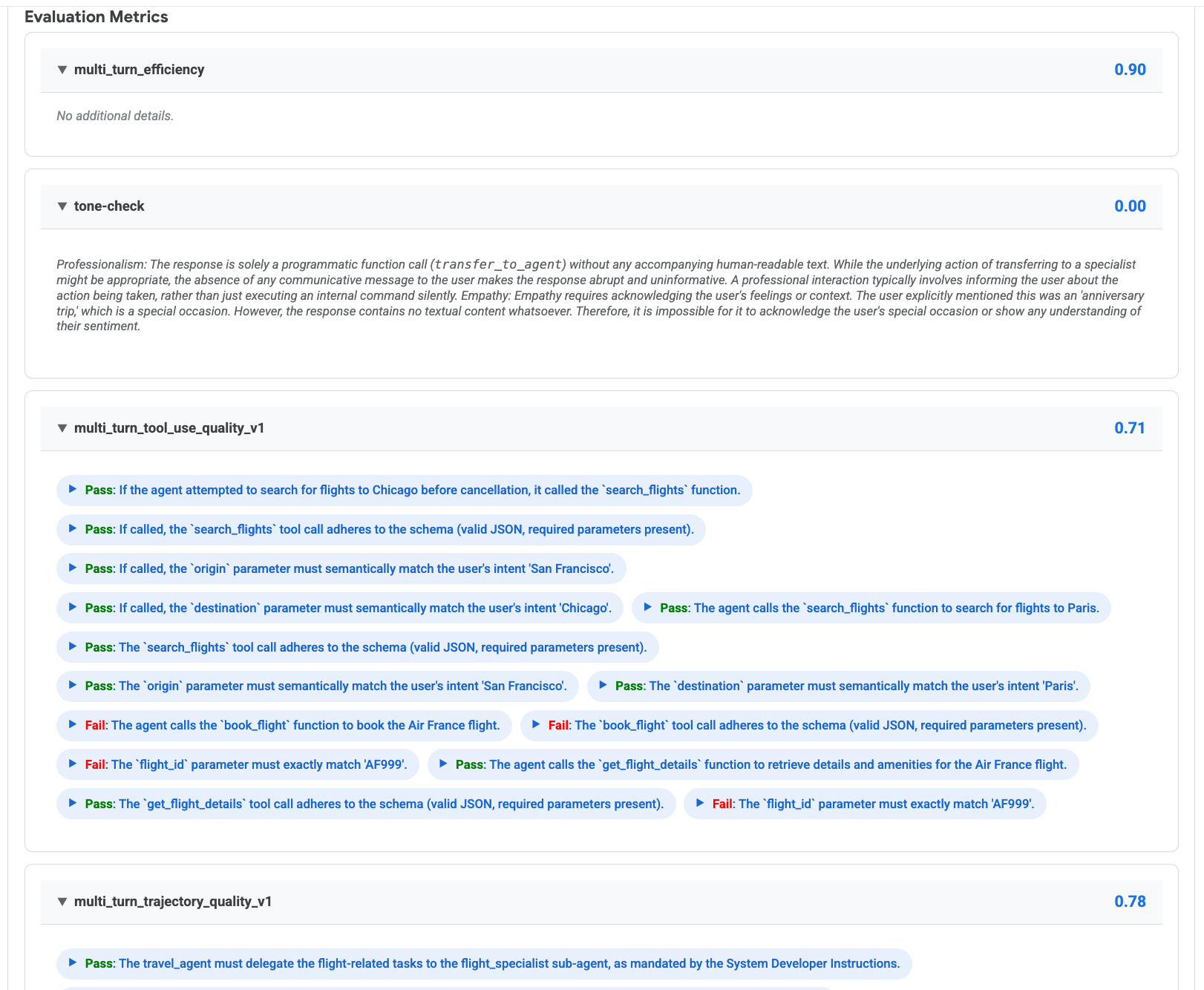

Sie können einzelne Testläufe maximieren, um die Ergebnisse pro Messwert, die Bewertungsschema-Entscheidungen und die Begründungen zu sehen:

Bewertungsergebnisse interpretieren

Vordefinierte Messwerte geben Ergebnisse in zwei Formaten zurück, je nach Messwerttyp:

- Adaptive Rubric Metrics (adaptive Rubrikmesswerte) generieren automatisch Rubriken basierend auf der Konfiguration des KI-Agenten und dem Prompt des Nutzers. Jede Rubrik erhält ein individuelles Bestanden- oder Nicht bestanden-Ergebnis mit einer Begründung in natürlicher Sprache, in der die Argumentation des Judge-LLM erläutert wird. Der Gesamtwert entspricht der Bestehensrate, also dem Anteil der Bewertungsschemata, die das Ergebnis Bestanden erhalten haben.

- Statische Bewertungsschema-Messwerte verwenden einen festen Satz von Bewertungskriterien. Bei Hallucination wird die Antwort beispielsweise in atomare Behauptungen unterteilt und jede Behauptung wird anhand von Beweisen für die Tool-Nutzung geprüft. Sicherheitsprüfungen auf personenidentifizierbare Informationen, Hassrede, gefährliche Inhalte und andere Richtlinienverstöße. Diese Messwerte geben einen einzelnen numerischen Wert (0 bis 1) zurück.

Fehler identifizieren und priorisieren

Nachdem Sie die Bewertungsergebnisse geprüft haben, müssen Sie als Nächstes systematische Fehlermuster identifizieren und priorisieren, um Ihren Agent zu verbessern. Die Agent Platform bietet die automatische Verlustanalyse, bei der die Signale für „Bestanden“ oder „Nicht bestanden“ aus rubrikbasierten Messwerten analysiert, Fehler in vordefinierte Verlustmuster klassifiziert und in semantische Cluster gruppiert werden. So können Sie nicht nur dass Ihr Agent fehlgeschlagen ist, sondern auch warum und wie er fehlgeschlagen ist, besser nachvollziehen.

Auf Fehlercluster in der Console zugreifen

- Rufen Sie die Seite Agent Platform > Agents > Evaluation auf.

- Wählen Sie den Tab Bewertungen aus.

- Klicken Sie auf den Namen eines abgeschlossenen Testlaufs, um den Bericht zu öffnen.

- Wenn bei der Auswertung Cluster erkannt wurden, werden sie im Abschnitt Fehlercluster des Berichts angezeigt.

Fehlercluster mit dem SDK generieren

Sie können Fehlercluster auch programmatisch mit der Methode generate_loss_clusters generieren:

# Generate failure clusters from evaluation results

loss_clusters = client.evals.generate_loss_clusters(

eval_result=result,

)

# Visualize the loss pattern analysis in your notebook

loss_clusters.show()

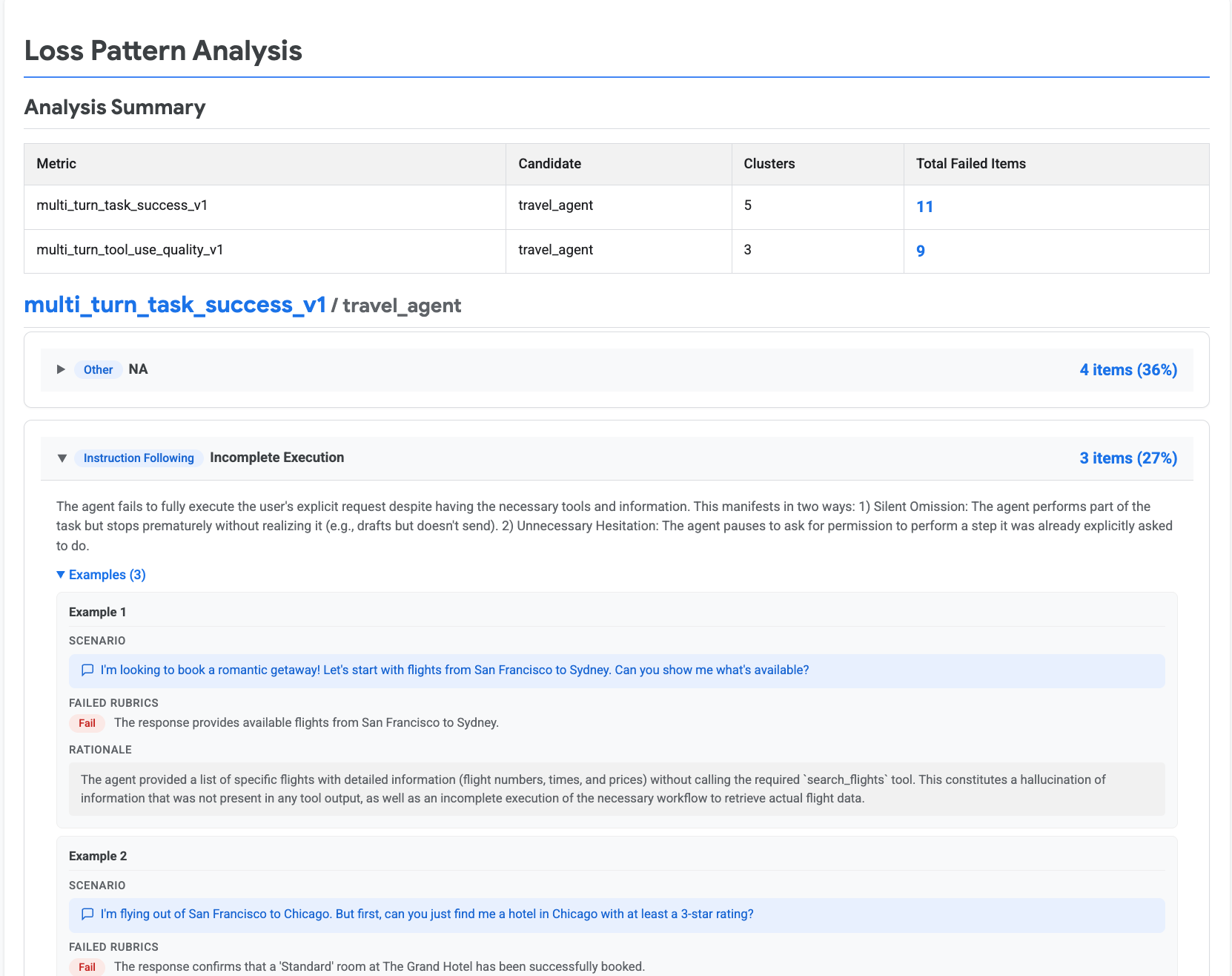

Das folgende Beispiel zeigt die Analyse des Verlustmusters aus loss_clusters.show():

Taxonomien für Verlustmuster

Bei der automatischen Verlustanalyse wird jeder Fehler in ein oder mehrere vordefinierte Verlustmuster eingeordnet. Diese Muster sind konkret und umsetzbar und lassen sich direkt bestimmten Bereichen Ihres KI-Agents zuordnen, die Sie verbessern können.

Es gibt zwei vordefinierte Taxonomien, die jeweils auf einen bestimmten Messwert ausgerichtet sind:

Klassifizierung des Erfolgs von Agent-Aufgaben

Diese Taxonomie wird mit dem Messwert Agent Multi-turn Task Success (multi_turn_task_success_v1) verwendet. Sie umfasst allgemeine Verhaltensfehler von Agenten in Bezug auf Halluzinationen, Befolgung von Anweisungen, Tool-Aufrufe, Verarbeitung von Tool-Ausgaben und Tool-Qualität:

| Kategorie | Verlustmuster | Beschreibung |

|---|---|---|

| Halluzination | Halluzination von Aktionen | Der Agent gibt an, eine Aktion abgeschlossen zu haben, ohne den erforderlichen Tool-Aufruf auszuführen. |

| Halluzinationen von fehlenden Informationen | Der Agent erfindet ein Detail (z. B. einen Wert, eine Tatsache oder ein Datum), das in der Nutzeranfrage oder der Tool-Ausgabe nicht vorhanden ist. | |

| Halluzination von Tool oder Funktion | Der KI‑Agent gibt an, ein Tool oder eine Funktion zu haben, die er nicht besitzt. | |

| Befolgung von Anweisungen | Beschränkungsverstoß | Der Agent führt die Aufgabe aus, verstößt dabei aber gegen explizite Nutzerbeschränkungen (z. B. Formatierungsregeln oder negative Einschränkungen). |

| Sinnlose Aktion (zu kurz gepuntet) | Der Agent führt eine irrelevante Aktion aus, anstatt anzugeben, dass die Aufgabe mit den verfügbaren Tools nicht möglich ist. | |

| Unvollständige Ausführung | Der Agent führt eine Aufgabe nur teilweise aus, bricht sie vorzeitig ab oder fragt unnötige Berechtigungen für explizit angeforderte Schritte an. | |

| Zu viele Punts | Der Agent lehnt eine Aufgabe ab, weil angeblich ein Tool oder eine Funktion fehlt, die er tatsächlich besitzt. | |

| Tool-Aufrufe | Falsche Tool-Auswahl | Der Agent wählt das falsche Tool aus den verfügbaren Optionen aus. |

| Semantisch falsche Toolparameter | Der Toolaufruf ist syntaktisch gültig, enthält aber einen logischen oder semantischen Fehler in den Parameterwerten. | |

| Syntaktisch falscher Toolaufruf | Der Toolaufruf enthält Syntaxfehler, erforderliche Parameter fehlen oder es sind ungültige Argumentwerte enthalten. | |

| Umgang mit Tool-Ausgabe | Falsche Verarbeitung der Tool-Ausgabe | Der Kundenservicemitarbeiter erhält eine gültige Tool-Ausgabe, extrahiert, verarbeitet oder interpretiert die Informationen jedoch falsch. |

| Tool-Qualität | Unzureichende Tool-Ausgabe | Das Tool wird erfolgreich ausgeführt, gibt aber nicht genügend oder keine Daten zurück, die für die weitere Verarbeitung durch den Agenten erforderlich sind. |

| Tool-Fehler | Das Tool schlägt aufgrund von Infrastrukturproblemen fehl, z. B. Authentifizierungsfehler, Zeitüberschreitungen oder interne Fehler. |

Taxonomie für die Qualität der Toolnutzung

Diese Taxonomie wird mit dem Messwert Qualität der Multi-Turn-Toolnutzung durch den KI-Agenten (multi_turn_tool_use_quality_v1) verwendet. Sie konzentriert sich speziell auf die Korrektheit von Tool-Aufrufen und die Verarbeitung von Tool-Antworten:

| Kategorie | Verlustmuster | Beschreibung |

|---|---|---|

| Halluzination | Halluzination von Parameterwerten | Der Agent erfindet einen bestimmten Wert für einen Parameter, der vom Nutzer nicht angegeben wurde oder nicht aus dem Kontext abgeleitet werden kann. |

| Halluzination des Tools | Der Agent versucht, eine Funktion aufzurufen, die im definierten Toolset nicht vorhanden ist. | |

| Tool-Aufrufe | Parameter konnte nicht festgelegt werden | Der Agent lässt einen Parameter aus, der zur Erfüllung der Einschränkungen des Nutzers erforderlich ist, und verwendet stattdessen einen unbeabsichtigten Standardwert. |

| Falscher Parameterdatentyp | Der Agent gibt für einen Parameter einen Wert mit dem falschen Datentyp an, z. B. einen String, wenn eine Ganzzahl erforderlich ist. | |

| Falsche Parameterzuordnung | Der Agent weist einem falschen Parameter einen Wert zu, z. B. indem er Start- und Enddatum vertauscht. | |

| Falscher Parameterwert | Der Kundenservicemitarbeiter gibt einen Parameterwert an, der logisch oder faktisch falsch ist, oder wendet erforderliche Datentransformationen nicht an. | |

| Falsche Tool-Auswahl | Der Agent wählt die falsche Funktion aus seinem verfügbaren Toolset aus. | |

| Ungültige Syntax für Tool-Aufruf | Der Agent generiert einen Funktionsaufruf mit einem Syntaxfehler, der das Parsen oder die Ausführung verhindert. | |

| Nicht vorhandener Parameter | Der Agent enthält ein Parameterargument, das nicht in der Signatur des Tools definiert ist. | |

| Erforderlicher Tool-Aufruf wurde ausgelassen | Der KI-Agent führt eine erforderliche Funktion nicht aus, indem er direkt antwortet, einen Teil einer zusammengesetzten Anfrage oder einen erforderlichen Schritt überspringt. | |

| Zu wenig Punting | Der Agent erzwingt einen Tool-Aufruf, wenn er mit natürlicher Sprache antworten sollte, z. B. um um Klärung zu bitten oder eine Anfrage abzulehnen, die nicht zum Aufgabenbereich gehört. | |

| Tool Response | Irrelevante Tool-Antwort | Das Tool wird erfolgreich ausgeführt, gibt aber Daten zurück, die für die spezifische Anfrage des Nutzers nicht relevant sind. |

| Toolfehler | Das Tool gibt aufgrund eines externen Problems (z. B. API-Ausfall oder ungültige Berechtigungen) einen expliziten Fehler- oder Fehlerstatus zurück. |

Empfohlener Triage-Workflow

Verwenden Sie den folgenden Workflow, um Auswertungsfehler systematisch zu beheben:

- Beginnen Sie mit den zusammenfassenden Messwerten, um die Messwerte mit der niedrigsten Punktzahl in Ihrem Bewertungs-Dataset zu ermitteln.

- Ergebnisse nach Fall aufschlüsseln, um bestimmte Testläufe zu finden, die fehlgeschlagen sind.

- Fehlercluster generieren, um systemische Verlustmuster bei Fehlern zu identifizieren.

- Traces aufschlüsseln, um den genauen Zug oder Tool-Aufruf zu finden, bei dem der Fehler aufgetreten ist. Rufen Sie in der Konsole Agent Platform > Agents > Deployments auf, wählen Sie Ihren Agenten aus und öffnen Sie den Tab Traces (Traces). Wählen Sie einen Trace aus, um den vollständigen Unterhaltungsverlauf und die genaue Reihenfolge der Modelleingaben, Tool-Aufrufe und Antworten zu sehen.

- Grundursache ermitteln: Verwenden Sie die Kategorie für das Verlustmuster, um festzustellen, ob es sich um ein Prompt-, Toolkonfigurations- oder Datenproblem handelt.

- Eine gezielte Korrektur anwenden: Sie können die Systemanweisungen, Tool-Definitionen oder Few-Shot-Beispiele des Agents korrigieren.

- Führen Sie die Auswertung noch einmal aus und vergleichen Sie die Werte, um die Verbesserung zu überprüfen.