Elige modelos y la infraestructura para tu aplicación de IA generativa

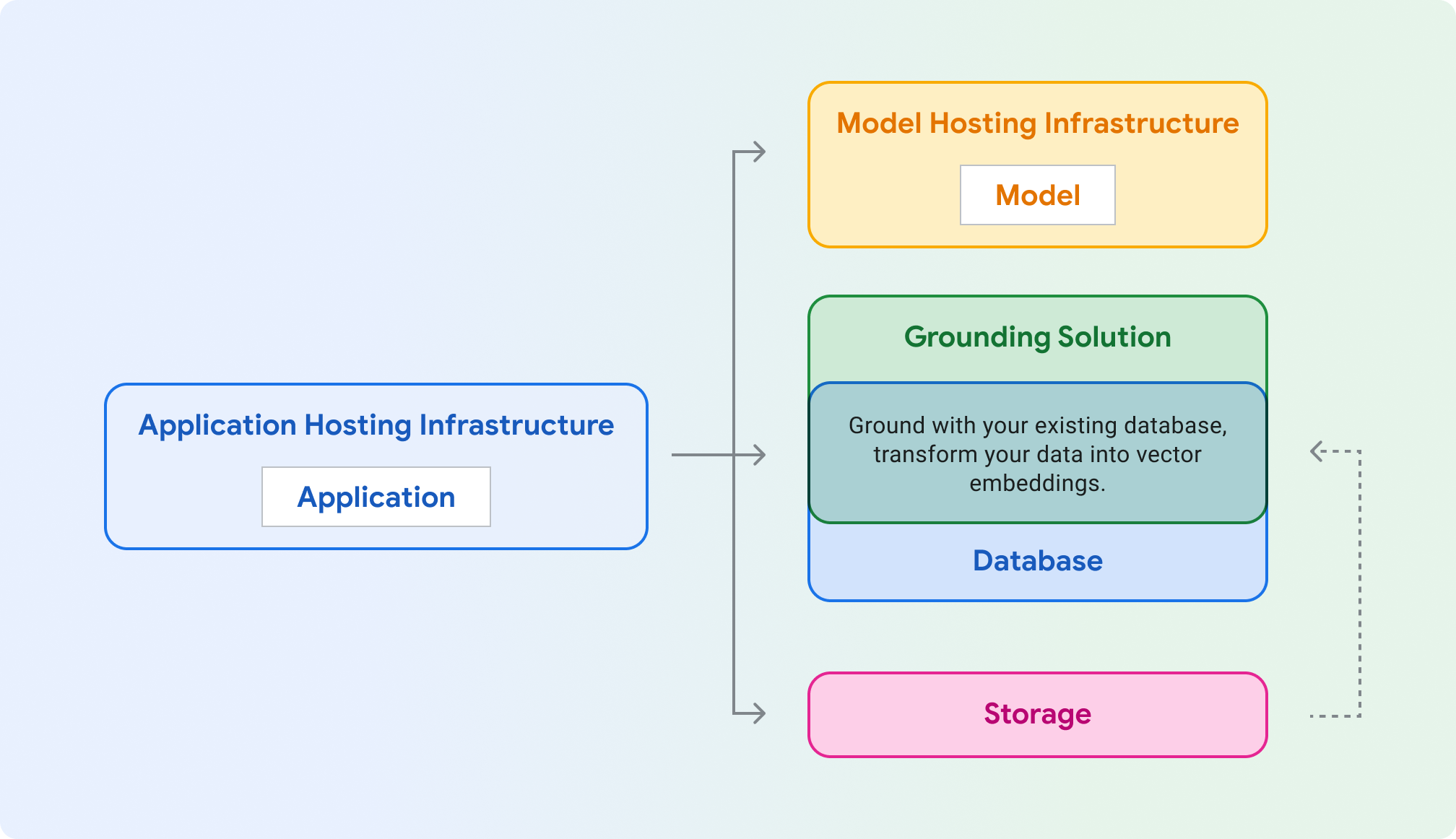

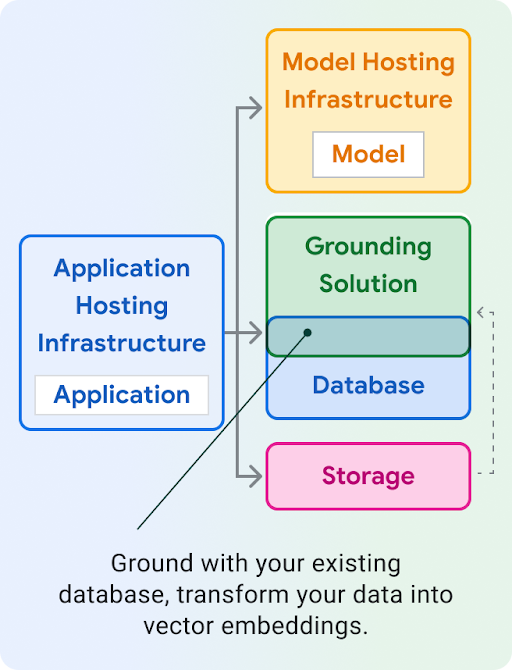

Alojamiento de aplicaciones: Procesamiento para alojar tu aplicación. Tu aplicación puede usar las bibliotecas cliente y los SDK de Google Cloud para comunicarse con diferentes productos de Cloud.

Alojamiento de modelos: Es un alojamiento escalable y seguro para un modelo generativo.

Modelo: Modelo generativo para texto, chat, imágenes, código, incorporaciones y multimodal.

Solución de anclaje: Anclar el resultado del modelo a fuentes de información verificables y actualizadas.

Base de datos: Almacena los datos de tu aplicación. Puedes reutilizar tu base de datos existente como tu solución de fundamentación, mediante el aumento de las instrucciones a través de una consulta en SQL o el almacenamiento de tus datos como incorporaciones vectoriales con una extensión como pgvector.

Almacenamiento: Almacena archivos, como imágenes, videos o frontends web estáticos. También puedes usar Storage para los datos de puesta a tierra sin procesar (p. ej., PDF) que luego conviertes en incorporaciones y almacenas en una base de datos de vectores.

En las siguientes secciones, se explica cada uno de esos componentes para ayudarte a elegir qué productos de Google Cloud probar.

Infraestructura de hosting de aplicaciones

Elige un producto para alojar y entregar la carga de trabajo de tu aplicación, que realiza llamadas al modelo generativo.

Infraestructura de hosting de modelos

Google Cloud proporciona múltiples formas de alojar un modelo generativo, desde la plataforma insignia de Vertex AI, hasta hosting personalizable y portátil en Google Kubernetes Engine.

Usar Gemini y necesitar funciones empresariales, como escalamiento, seguridad, privacidad de los datos y observabilidad

¿Quieres una infraestructura completamente administrada con herramientas y APIs de IA generativa de primer nivel?

¿Tu modelo requiere un kernel especializado, un SO heredado o tiene condiciones de licencia especiales?

Modelo

Google Cloud proporciona un conjunto de modelos de base de última generación a través de Vertex AI, incluido Gemini. También puedes implementar un modelo de terceros en Vertex AI Model Garden o autoalojarlo en GKE, Cloud Run o Compute Engine.

¿Generación de embeddings para la búsqueda, la clasificación o el agrupamiento en clústeres?

Muy bien, quieres generar texto. ¿Quieres incluir imágenes o videos en tus instrucciones de texto? (multimodales)

Muy bien, solo instrucciones de texto. ¿Quieres aprovechar el modelo insignia más capaz de Google?

Implementa un modelo de código abierto en las siguientes plataformas: Vertex AI (Model Garden) GKE (HuggingFace)

Fundamentación y RAG

Para garantizar respuestas del modelo fundamentadas y precisas, fundamenta tu aplicación de IA generativa con datos en tiempo real. Esto se denomina generación mejorada por recuperación (RAG).

Si deseas generar contenido basado en información actualizada de Internet, los modelos de Gemini pueden evaluar si el conocimiento del modelo es suficiente o si se requiere la fundamentación con la Búsqueda de Google.

Puedes implementar la conexión a tierra con un índice de tus datos con un motor de búsqueda. Muchos motores de búsqueda ahora almacenan incorporaciones en una base de datos de vectores, que es un formato óptimo para operaciones como la búsqueda de similitud. Google Cloud ofrece varias soluciones de bases de datos de vectores para diferentes casos de uso.

Nota: Puedes fundamentar con bases de datos no vectoriales. Para ello, consulta una base de datos existente, como Cloud SQL o Firestore, y usa el resultado de la consulta en la instrucción del modelo.

¿Quieres una solución optimizada y completamente administrada que admita la mayoría de las fuentes de datos y evite el acceso directo a las incorporaciones subyacentes?

¿Quieres compilar un motor de búsqueda para RAG con un orquestador administrado con una interfaz similar a LlamaIndex?

¿Necesitas una búsqueda de vectores de baja latencia, una publicación a gran escala o una base de datos de vectores especializada y optimizada?

¿Se accede a tus datos de forma programática (OLTP)? ¿Ya usas una base de datos SQL?

¿Quieres usar modelos de Google AI directamente desde tu base de datos? ¿Necesitas una latencia baja?

¿Tienes un gran conjunto de datos analíticos (OLAP)? ¿Requiere procesamiento por lotes y acceso frecuente a tablas de SQL por parte de humanos o secuencias de comandos (ciencia de datos)?

Fundamentos con APIs

Extensiones de Vertex AI (vista previa privada)

Componentes de LangChain

Fundamentos en Vertex AI

Comienza con la compilación

Configura LangChain

LangChain es un framework de código abierto para apps de IA generativa que te permite crear contexto en tus instrucciones y tomar medidas en función de la respuesta del modelo.

Consulta ejemplos de código y, luego, implementa aplicaciones de ejemplo

Consulta muestras de código para casos de uso populares y ejemplos de implementación de aplicaciones de IA generativa que sean seguras, eficientes, resilientes, de alto rendimiento y rentables.