Datenpipeline erstellen

In dieser Kurzanleitung wird Folgendes beschrieben:

- Erstellen Sie eine Cloud Data Fusion-Instanz.

- Beispielpipeline bereitstellen, die in Ihrer Cloud Data Fusion-Instanz bereitgestellt wird Die Pipeline führt Folgendes aus:

- Eine JSON-Datei mit NYT-Bestseller-Daten aus Cloud Storage lesen

- Transformationen an der Datei ausführen, um die Daten zu analysieren und zu bereinigen

- Die bestbewerteten Bücher, die in der letzten Woche hinzugefügt wurden und weniger als 25 $ kosten, in BigQuery laden

Hinweis

Führen Sie die folgenden Schritte aus, bevor Sie eine Datenpipeline erstellen.

Projekt einrichten

- Melden Sie sich in Ihrem Google Cloud -Konto an. Wenn Sie mit Google Cloudnoch nicht vertraut sind, erstellen Sie ein Konto, um die Leistungsfähigkeit unserer Produkte in der Praxis sehen und bewerten zu können. Neukunden erhalten außerdem ein Guthaben von 300 $, um Arbeitslasten auszuführen, zu testen und bereitzustellen.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Erforderliche Rollen

Bitten Sie Ihren Administrator, Ihnen die IAM-Rolle Cloud Data Fusion Admin (roles/datafusion.admin) für das Projekt zuzuweisen, damit Sie die Berechtigungen erhalten, die Sie zum Erstellen einer Cloud Data Fusion-Instanz und zum Verwalten von Pipelines benötigen.

Weitere Informationen zum Zuweisen von Rollen finden Sie unter Zugriff auf Projekte, Ordner und Organisationen verwalten.

Sie können die erforderlichen Berechtigungen auch über benutzerdefinierte Rollen oder andere vordefinierte Rollen erhalten.

Bitten Sie Ihren Administrator, dem Compute Engine-Standarddienstkonto die folgenden IAM-Rollen für Ihr Projekt zuzuweisen, damit es die erforderlichen Berechtigungen zum Ausführen des Managed Service for Apache Spark-Jobs hat:

- Dataproc-Worker (

roles/dataproc.worker) - Cloud Data Fusion Runner (

roles/datafusion.runner)

Weitere Informationen zum Zuweisen von Rollen finden Sie unter Zugriff auf Projekte, Ordner und Organisationen verwalten.

Ihr Administrator kann dem Compute Engine-Standarddienstkonto möglicherweise auch die erforderlichen Berechtigungen über benutzerdefinierte Rollen oder andere vordefinierte Rollen erteilen.

Erstellen Sie eine Cloud Data Fusion-Instanz.

- Klicken Sie auf Instanz erstellen.

- Geben Sie einen Instanznamen ein.

- Geben Sie eine Beschreibung für Ihre Instanz ein.

- Geben Sie die Region ein, in der die Instanz erstellt werden soll.

- Wählen Sie die Cloud Data Fusion-Version aus, die Sie verwenden möchten.

- Wählen Sie die Version von Cloud Data Fusion aus.

- Wählen Sie für Cloud Data Fusion-Versionen 6.2.3 und höher im Feld Autorisierung das Dienstkonto für Managed Service for Apache Spark aus, das zum Ausführen Ihrer Cloud Data Fusion-Pipeline in Managed Service for Apache Spark verwendet werden soll. Der Standardwert, das Compute Engine-Konto, ist bereits ausgewählt.

- Klicken Sie auf Erstellen. Es kann bis zu 30 Minuten dauern, bis die Instanz erstellt ist. Während Cloud Data Fusion die Instanz erstellt, wird neben dem Instanznamen auf der Seite Instanzen ein Radsymbol angezeigt, das den Fortschritt angibt. Nachdem der Vorgang abgeschlossen ist, wird es zu einem grünen Häkchen. Dies zeigt an, dass Sie die Instanz verwenden können.

In der Weboberfläche von Cloud Data Fusion navigieren

Bei Verwendung von Cloud Data Fusion verwenden Sie sowohl die Google Cloud Console als auch die separate Weboberfläche von Cloud Data Fusion.

In der Google Cloud Console haben Sie folgende Möglichkeiten:

- Google Cloud Console-Projekt erstellen

- Cloud Data Fusion-Instanzen erstellen und löschen

- Details zur Cloud Data Fusion-Instanz ansehen

In der Cloud Data Fusion-Weboberfläche können Sie verschiedene Seiten wie Studio oder Wrangler verwenden, um die Funktionen von Cloud Data Fusion zu nutzen.

So rufen Sie die Benutzeroberfläche von Cloud Data Fusion auf:

- Öffnen Sie in der Google Cloud Console die Seite Instanzen.

- Klicken Sie in der Spalte Aktionen der Instanz auf den Link Instanz aufrufen.

- Rufen Sie in der Web-UI von Cloud Data Fusion über den linken Navigationsbereich die gewünschte Seite auf.

Beispielpipeline bereitstellen

Beispielpipelines sind über den Cloud Data Fusion Hub verfügbar, mit dem Sie wiederverwendbare Pipelines, Plug-ins und Lösungen für Cloud Data Fusion teilen können.

- Klicken Sie in der Web-UI von Cloud Data Fusion auf Hub.

- Klicken Sie im linken Bereich auf Pipelines.

- Klicken Sie auf die Pipeline Cloud Data Fusion-Quickstart.

- Klicken Sie auf Erstellen.

- Klicken Sie im Konfigurationsbereich für „Cloud Data Fusion Quickstart“ auf Finish.

Klicken Sie auf Customize Pipeline.

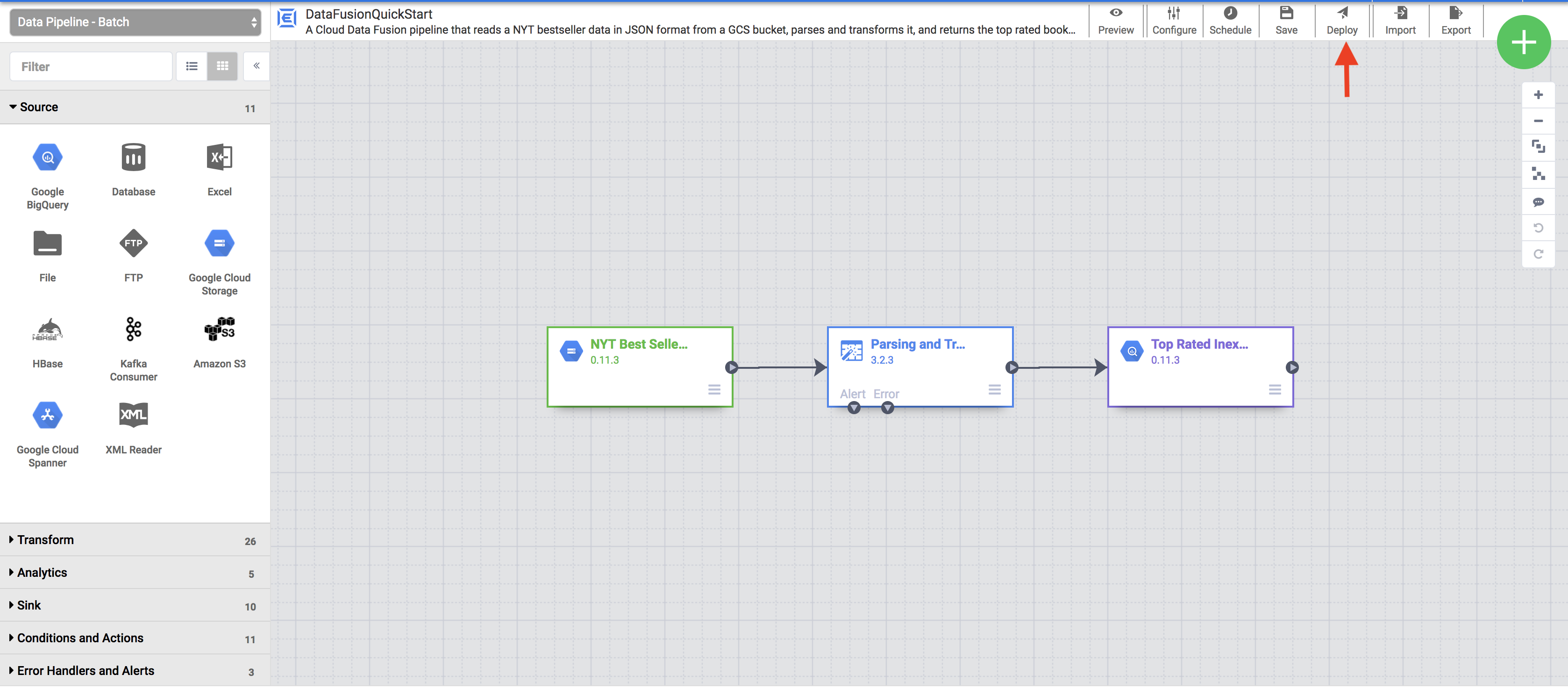

Eine visuelle Darstellung Ihrer Pipeline wird auf der Seite Studio angezeigt. Dies ist eine grafische Benutzeroberfläche zur Entwicklung von Pipelines zur Datenintegration. Auf der linken Seite sind die Pipeline-Plug-ins aufgelistet und Ihre Pipeline wird im Hauptbereich angezeigt. Sie können Ihre Pipeline untersuchen, indem Sie den Mauszeiger auf die einzelnen Knoten der Pipeline bewegen und auf Eigenschaften klicken. Über das Menü „Eigenschaften“ für jeden Knoten können Sie die mit dem Knoten verknüpften Objekte und Vorgänge aufrufen.

Klicken Sie im Menü rechts oben auf Deploy. Mit diesem Schritt wird die Pipeline an Cloud Data Fusion gesendet. Im nächsten Abschnitt dieser Kurzanleitung führen Sie die Pipeline aus.

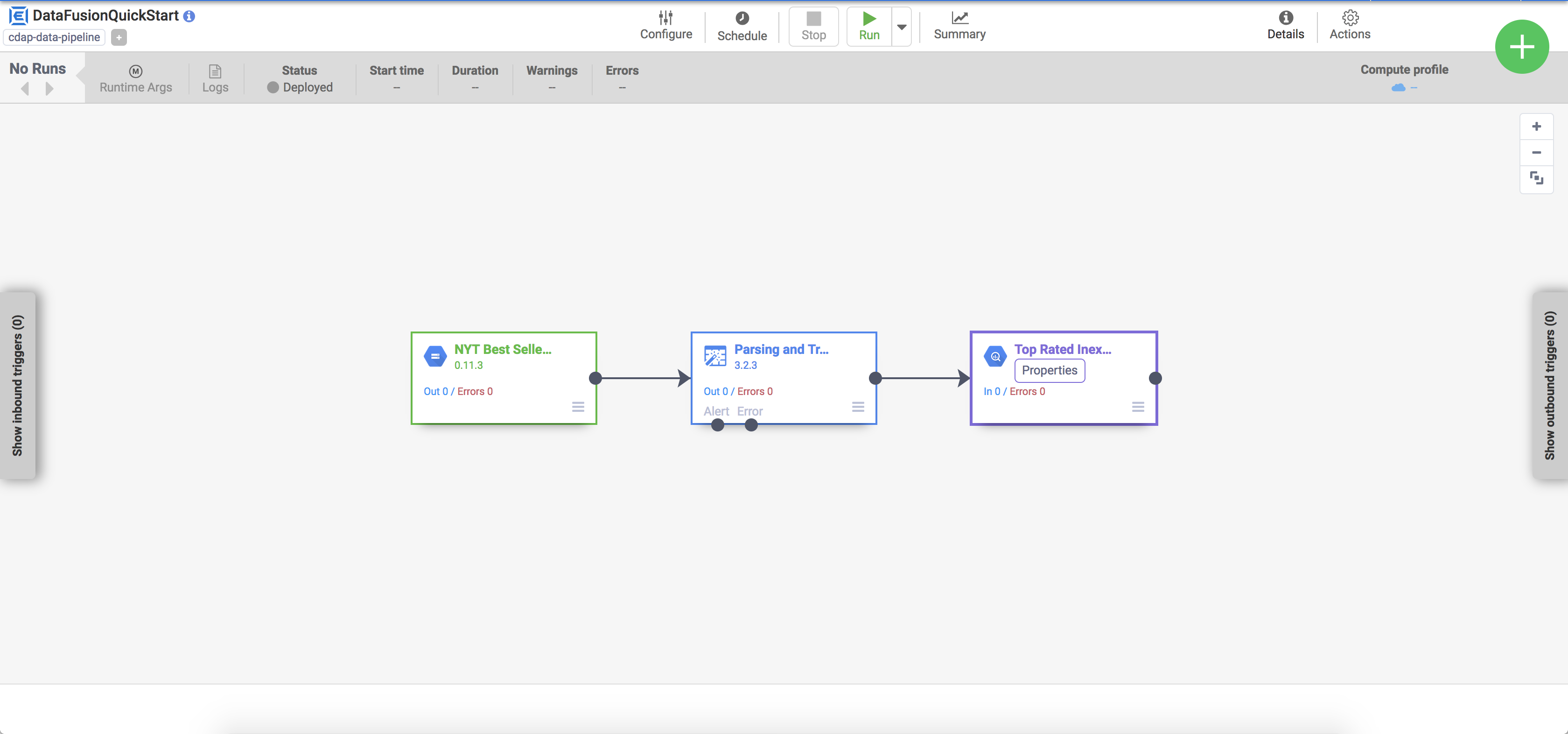

Pipeline anzeigen

Die bereitgestellte Pipeline wird in der Ansicht der Pipelinedetails angezeigt. Hier können Sie Folgendes tun:

- Struktur und Konfiguration der Pipeline ansehen

- Pipeline manuell ausführen oder einen Zeitplan bzw. Trigger einrichten

- Zusammenfassung des Ausführungsverlaufs der Pipeline anzeigen, einschließlich Ausführungszeiten, Logs und Messwerte

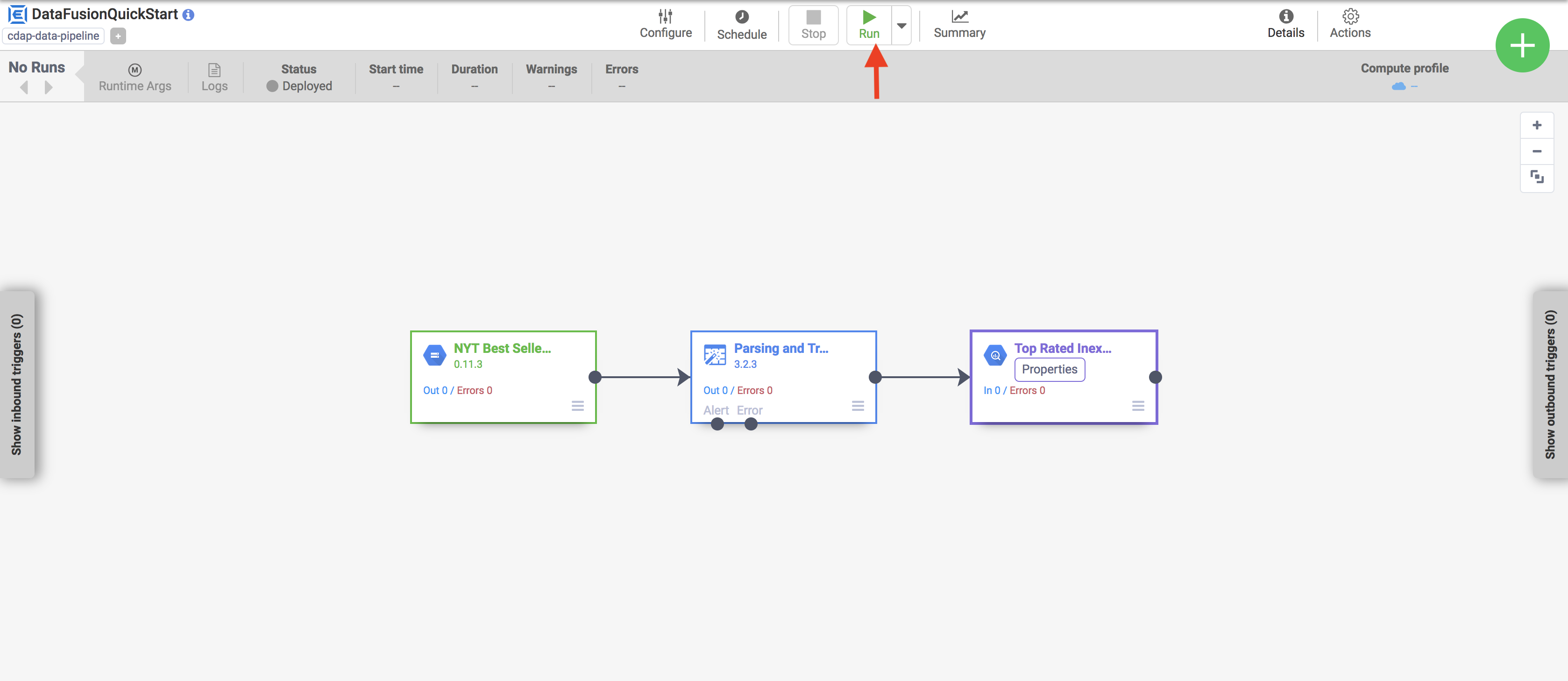

Pipeline ausführen

Klicken Sie in der Ansicht „Pipelinedetails“ auf Ausführen, um die Pipeline auszuführen.

Beim Ausführen einer Pipeline führt Cloud Data Fusion die folgenden Schritte aus:

- Stellt einen kurzlebigen Managed Service for Apache Spark-Cluster bereit

- Führt die Pipeline mit Apache Spark im Cluster aus

- Löscht den Cluster

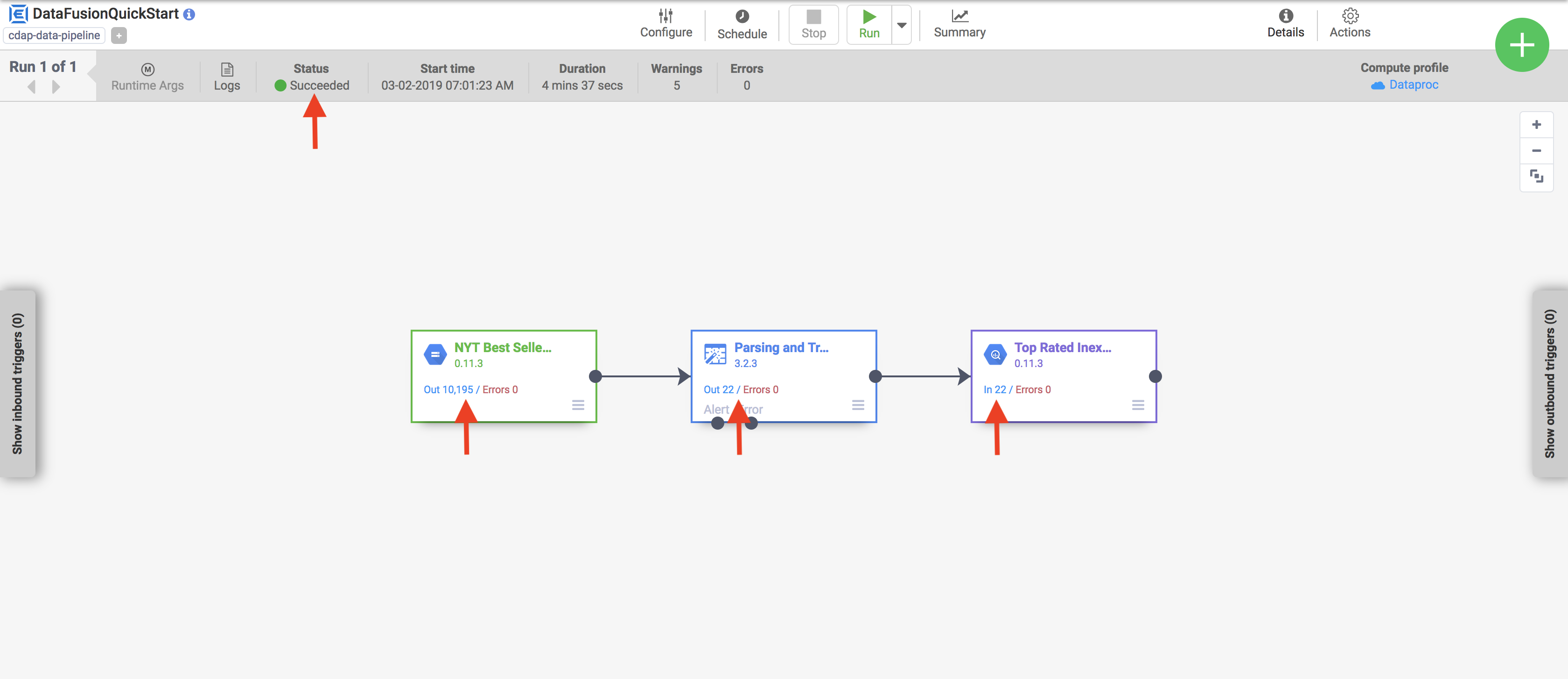

Ergebnisse aufrufen

Nach einigen Minuten ist die Pipeline abgeschlossen. Der Pipelinestatus ändert sich in Erfolgreich und die Anzahl der von jedem Knoten verarbeiteten Datensätze wird angezeigt.

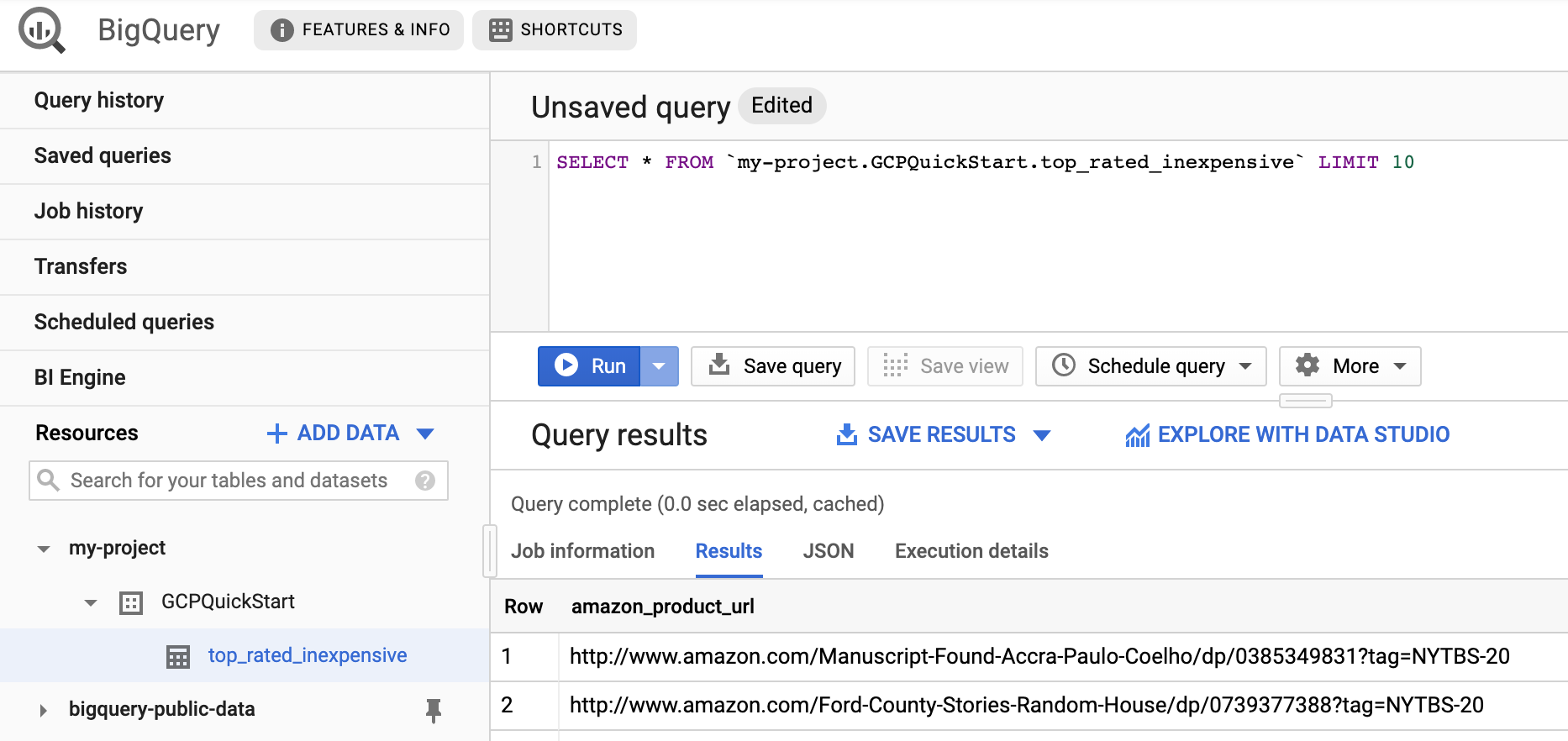

- Rufen Sie die BigQuery-Webbenutzeroberfläche auf.

Wenn Sie sich ein Beispiel der Ergebnisse ansehen möchten, rufen Sie das Dataset

DataFusionQuickstartin Ihrem Projekt auf, klicken Sie auf die Tabelletop_rated_inexpensiveund führen Sie eine einfache Abfrage aus. Beispiel:SELECT * FROM PROJECT_ID.GCPQuickStart.top_rated_inexpensive LIMIT 10Ersetzen Sie PROJECT_ID durch Ihre Projekt-ID.

Bereinigen

Mit den folgenden Schritten vermeiden Sie, dass Ihrem Google Cloud -Konto die auf dieser Seite verwendeten Ressourcen in Rechnung gestellt werden:

- Löschen Sie das BigQuery-Dataset, in das die Pipeline in diesem Schnellstart geschrieben hat.

Optional: Löschen Sie das Projekt.

- Wechseln Sie in der Google Cloud -Console zur Seite Ressourcen verwalten.

- Wählen Sie in der Projektliste das Projekt aus, das Sie löschen möchten, und klicken Sie dann auf Löschen.

- Geben Sie im Dialogfeld die Projekt-ID ein und klicken Sie auf Shut down (Beenden), um das Projekt zu löschen.

Nächste Schritte

- Anleitung zu Cloud Data Fusion

- Informationen über Konzepte zu Cloud Data Fusion