Créer un pipeline de données

Ce guide de démarrage rapide vous explique comment :

- Créer une instance Cloud Data Fusion.

- Déployer un exemple de pipeline fourni avec votre instance Cloud Data Fusion. Le pipeline effectue les opérations suivantes :

- Lit un fichier JSON dans Cloud Storage contenant les données du best-seller du NYT

- Exécute les transformations sur le fichier pour analyser et nettoyer les données

- Importe les livres les mieux classés ajoutés la semaine dernière et coûtant moins de 25 $ dans BigQuery

Avant de commencer

Avant de créer un pipeline de données, procédez comme suit.

Configurer votre projet

- Connectez-vous à votre compte Google Cloud . Si vous débutez sur Google Cloud, créez un compte pour évaluer les performances de nos produits en conditions réelles. Les nouveaux clients bénéficient également de 300 $ de crédits sans frais pour exécuter, tester et déployer des charges de travail.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Rôles requis

Pour obtenir les autorisations nécessaires pour créer une instance Cloud Data Fusion et gérer des pipelines, demandez à votre administrateur de vous attribuer le rôle IAM Administrateur Cloud Data Fusion (roles/datafusion.admin) sur le projet.

Pour en savoir plus sur l'attribution de rôles, consultez Gérer l'accès aux projets, aux dossiers et aux organisations.

Vous pouvez également obtenir les autorisations requises avec des rôles personnalisés ou d'autres rôles prédéfinis.

Pour vous assurer que le compte de service Compute Engine par défaut dispose des autorisations nécessaires pour exécuter le job Managed Service pour Apache Spark, demandez à votre administrateur d'attribuer les rôles IAM suivants au compte de service Compute Engine par défaut dans votre projet :

- Nœud de calcul Dataproc (

roles/dataproc.worker) - Exécuteur Cloud Data Fusion (

roles/datafusion.runner)

Pour en savoir plus sur l'attribution de rôles, consultez Gérer l'accès aux projets, aux dossiers et aux organisations.

Votre administrateur peut également attribuer au compte de service Compute Engine par défaut les autorisations requises à l'aide de rôles personnalisés ou d'autres rôles prédéfinis.

Créer une instance Cloud Data Fusion

- Cliquez sur Create an instance (Créer une instance).

- Saisissez un Nom d'instance.

- Saisissez une Description pour votre instance.

- Saisissez la Région dans laquelle créer l'instance.

- Choisissez la version Cloud Data Fusion à utiliser.

- Choisissez l'édition Cloud Data Fusion.

- Pour Cloud Data Fusion en version 6.2.3 ou ultérieure, dans le champ Autorisation, choisissez le compte de service Managed Service pour Apache Spark à utiliser pour exécuter votre pipeline Cloud Data Fusion dans Managed Service pour Apache Spark. Le compte Compute Engine, qui est la valeur par défaut, est présélectionné.

- Cliquez sur Create (Créer). Le processus de création de l'instance peut prendre jusqu'à 30 minutes. Pendant que Cloud Data Fusion crée votre instance, une icône de progression en forme de roue s'affiche à côté du nom de l'instance sur la page Instances. Une fois l'opération terminée, une coche verte indiquant que vous pouvez commencer à utiliser l'instance s'affiche à la place de la roue.

Parcourir l'interface Web de Cloud Data Fusion

Lorsque vous utilisez Cloud Data Fusion, vous utilisez à la fois la console Google Cloud et l'interface Web distincte de Cloud Data Fusion.

Dans la console Google Cloud , vous pouvez effectuer les opérations suivantes :

- Créer un projet de console Google Cloud

- Créer et supprimer des instances Cloud Data Fusion

- Afficher les détails de l'instance Cloud Data Fusion

Dans l'interface Web de Cloud Data Fusion, vous pouvez utiliser différentes pages, telles que Studio ou Wrangler, pour utiliser les fonctionnalités de Cloud Data Fusion.

Pour parcourir l'interface Cloud Data Fusion, procédez comme suit :

- Dans la console Google Cloud , ouvrez la page Instances.

- Dans la colonne Actions de l'instance, cliquez sur le lien Afficher l'instance.

- Dans l'interface Web de Cloud Data Fusion, utilisez le panneau de navigation de gauche pour accéder à la page dont vous avez besoin.

Déployer un exemple de pipeline

Des exemples de pipelines sont disponibles dans le hub Cloud Data Fusion, qui vous permet de partager des pipelines, des plug-ins et des solutions Cloud Data Fusion réutilisables.

- Dans l'interface Web de Cloud Data Fusion, cliquez sur Hub.

- Dans le panneau de gauche, cliquez sur Pipelines.

- Cliquez sur le pipeline Guide de démarrage rapide de Cloud Data Fusion.

- Cliquez sur Créer.

- Dans le panneau de configuration du pipeline "Cloud Data Fusion Quickstart" (Guide de démarrage rapide de Cloud Data Fusion), cliquez sur Finish (Terminer).

Cliquez sur Customize Pipeline (Personnaliser le pipeline).

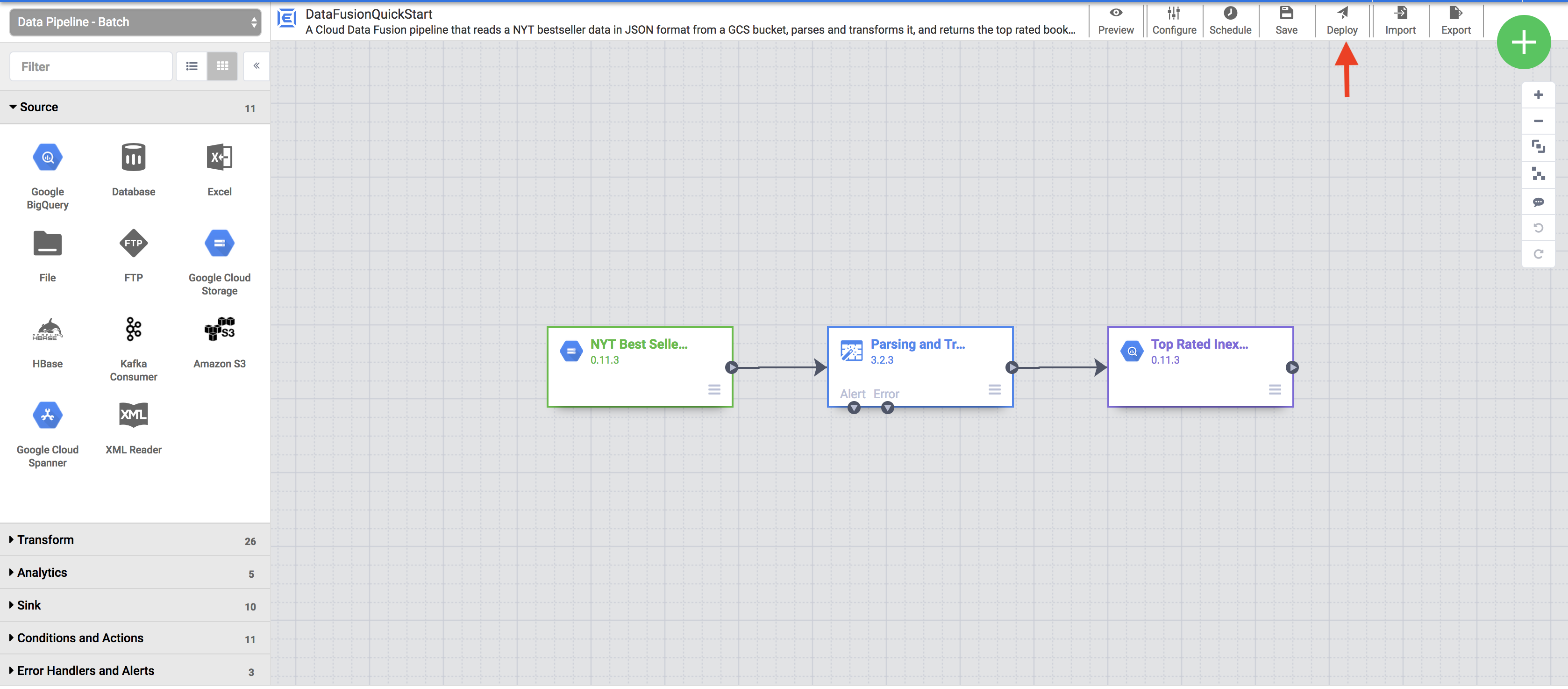

Une représentation visuelle de votre pipeline s'affiche sur la page Studio. Il s'agit d'une interface graphique permettant de développer des pipelines d'intégration de données. Les plug-ins de pipeline disponibles sont répertoriés sur la gauche, et votre pipeline est affiché dans la zone principale du canevas. Vous pouvez explorer votre pipeline en maintenant le pointeur sur chaque nœud de pipeline et en cliquant sur Propriétés. Le menu des propriétés de chaque nœud vous permet d'afficher les objets et les opérations associés au nœud.

Dans le menu situé en haut à droite, cliquez sur Deploy (Déployer). Cette étape envoie le pipeline à Cloud Data Fusion. Vous allez exécuter le pipeline dans la section suivante de ce guide de démarrage rapide.

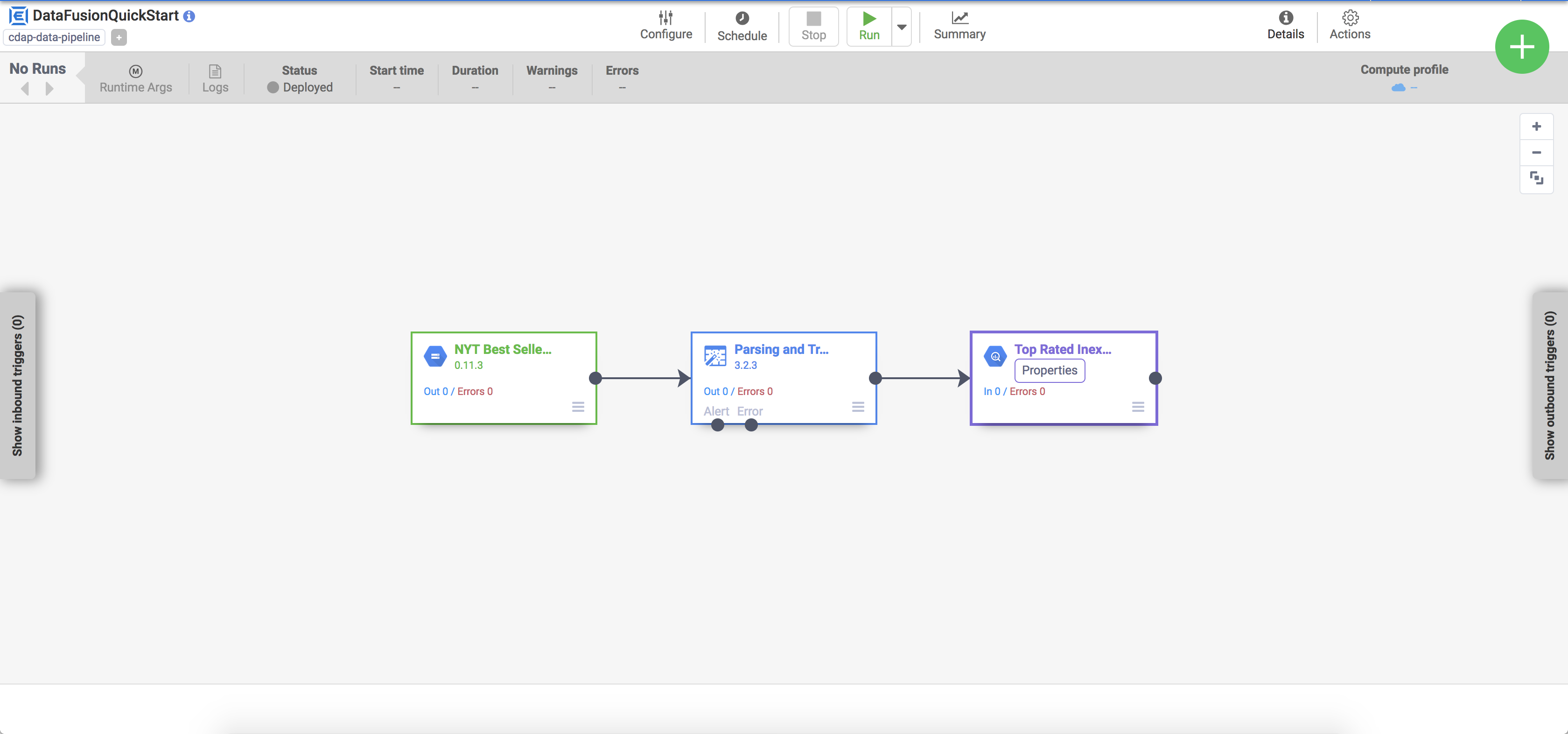

Consulter votre pipeline

Le pipeline déployé apparaît dans l'affichage des détails du pipeline, où vous pouvez effectuer les opérations suivantes :

- afficher la structure et la configuration du pipeline ;

- Exécuter le pipeline manuellement, ou configurer un calendrier ou un déclencheur

- afficher un récapitulatif des exécutions historiques du pipeline, y compris les temps d'exécution, les journaux et les métriques.

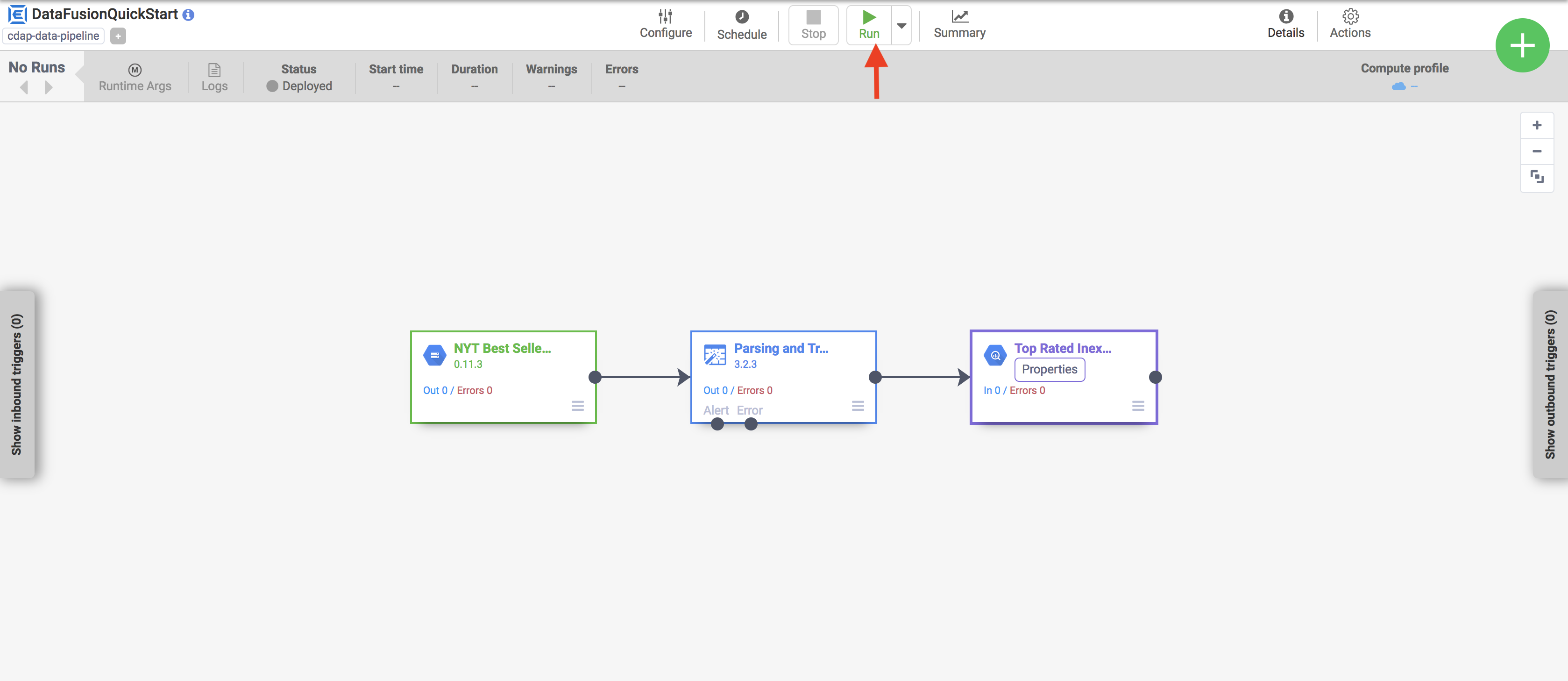

Exécuter votre pipeline

Dans l'affichage des détails du pipeline, cliquez sur Exécuter pour exécuter le pipeline.

Lorsque vous exécutez un pipeline, Cloud Data Fusion effectue les opérations suivantes :

- Provisionne un cluster Managed Service pour Apache Spark éphémère

- exécute le pipeline sur le cluster à l'aide d'Apache Spark ;

- Suppression du cluster

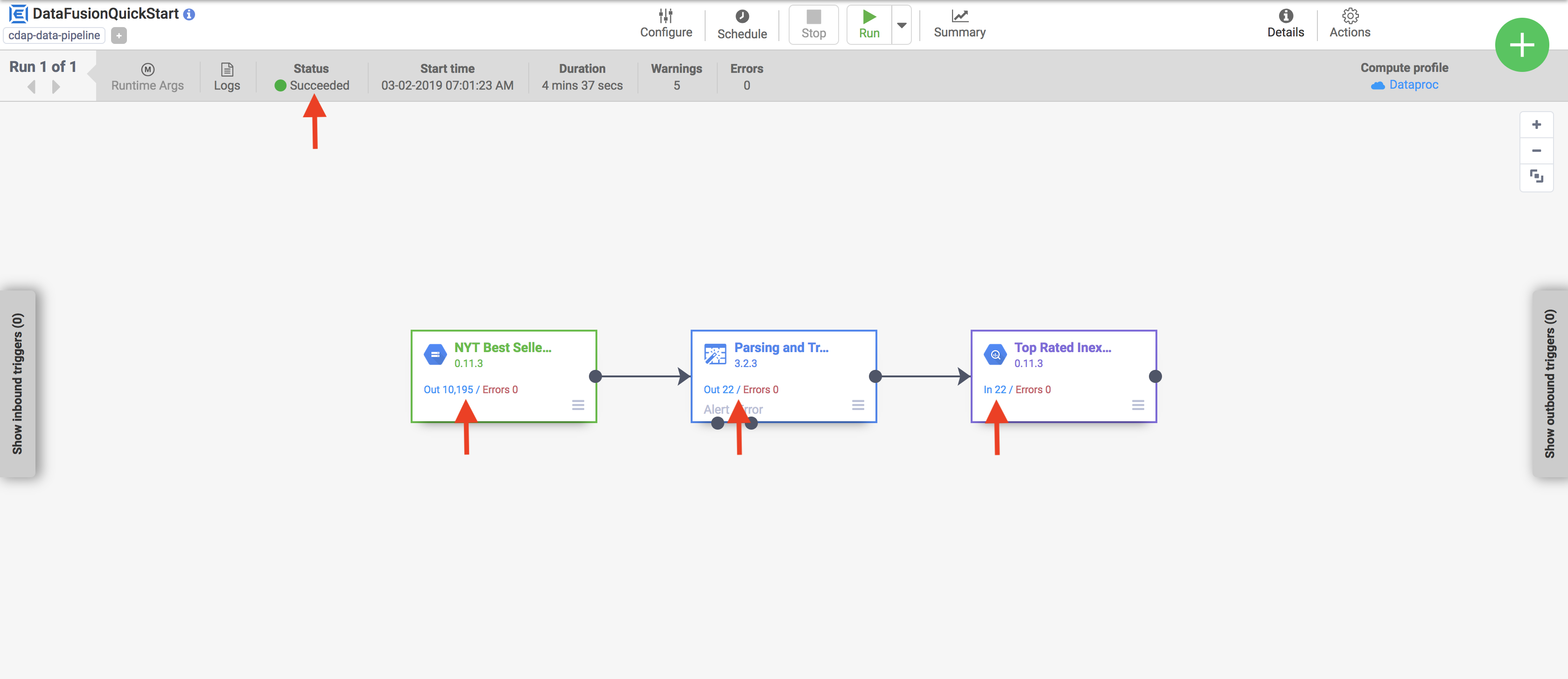

Afficher les résultats

Au bout de quelques minutes, le pipeline se termine. Le pipeline passe à l'état Réussi et le nombre d'enregistrements traités par chaque nœud s'affiche.

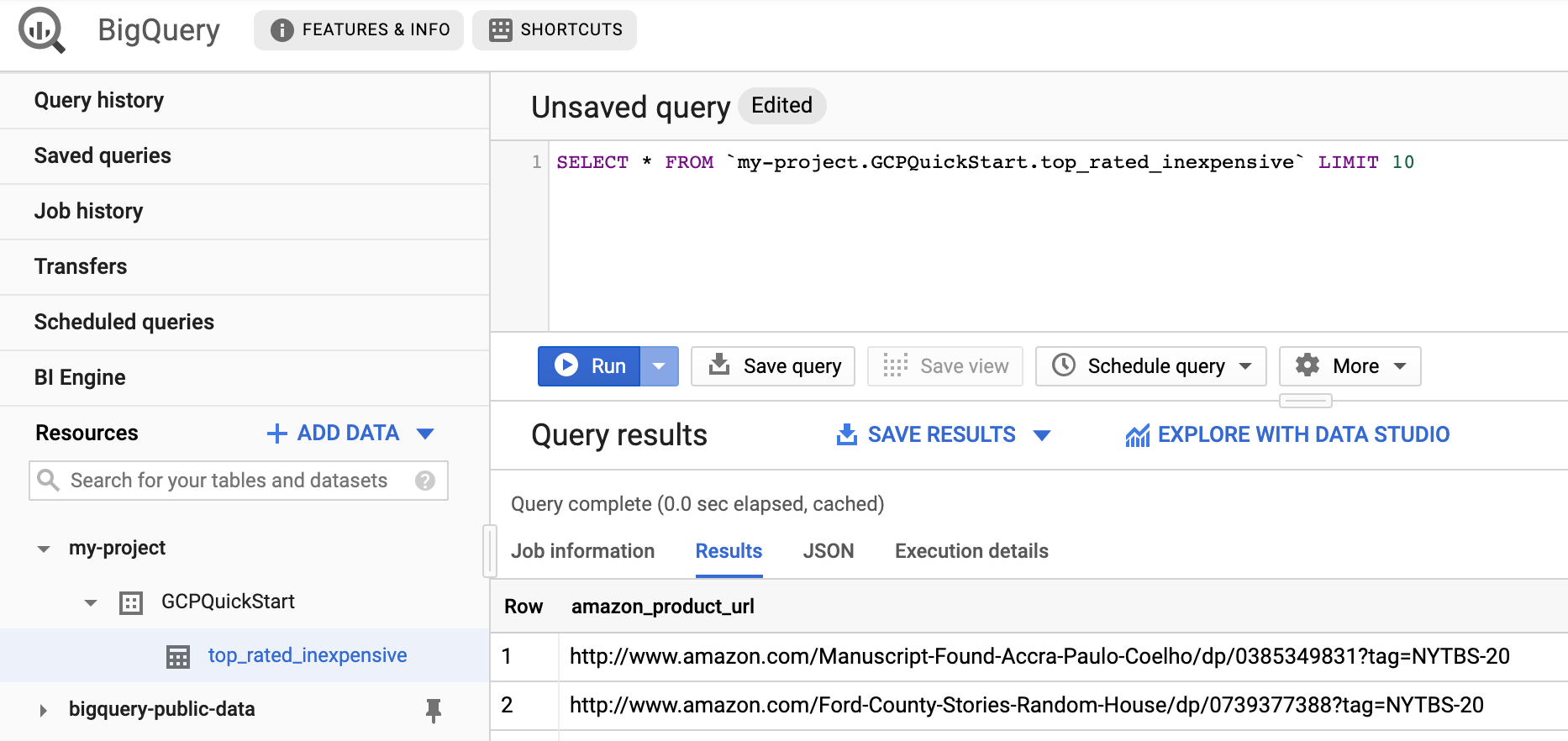

- Accédez à l'interface Web de BigQuery.

Pour afficher un échantillon des résultats, accédez à l'ensemble de données

DataFusionQuickstartde votre projet, cliquez sur la tabletop_rated_inexpensive, puis exécutez une requête simple. Exemple :SELECT * FROM PROJECT_ID.GCPQuickStart.top_rated_inexpensive LIMIT 10Remplacez PROJECT_ID par l'ID du projet.

Effectuer un nettoyage

Pour éviter que les ressources utilisées dans cette démonstration soient facturées sur votre compte Google Cloud , procédez comme suit :

- Supprimez l'ensemble de données BigQuery que votre pipeline a écrit dans ce guide de démarrage.

(Facultatif) Supprimez le projet.

- Dans la console Google Cloud , accédez à la page Gérer les ressources.

- Dans la liste des projets, sélectionnez le projet que vous souhaitez supprimer, puis cliquez sur Supprimer.

- Dans la boîte de dialogue, saisissez l'ID du projet, puis cliquez sur Arrêter pour supprimer le projet.