Membuat pipeline data

Panduan memulai ini menunjukkan cara melakukan hal berikut:

- Buat instance Cloud Data Fusion.

- Men-deploy pipeline sampel yang disediakan dengan instance Cloud Data Fusion Anda. Pipeline ini melakukan hal berikut:

- Membaca file JSON yang berisi data buku terlaris NYT dari Cloud Storage.

- Menjalankan transformasi pada file untuk mengurai dan membersihkan data.

- Memuat buku dengan rating teratas yang ditambahkan dalam seminggu terakhir dan harganya kurang dari $25 ke BigQuery.

Sebelum memulai

Selesaikan langkah-langkah berikut sebelum membuat pipeline data.

Menyiapkan project

- Login ke akun Google Cloud Anda. Jika Anda baru menggunakan Google Cloud, buat akun untuk mengevaluasi performa produk kami dalam skenario dunia nyata. Pelanggan baru juga mendapatkan kredit gratis senilai $300 untuk menjalankan, menguji, dan men-deploy workload.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

Enable the Cloud Data Fusion API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Peran yang diperlukan

Untuk mendapatkan izin yang

diperlukan guna membuat instance Cloud Data Fusion dan mengelola pipeline,

minta administrator untuk memberi Anda peran IAM

Cloud Data Fusion Admin (roles/datafusion.admin) di project.

Untuk mengetahui informasi selengkapnya tentang cara memberikan peran, lihat Mengelola akses ke project, folder, dan organisasi.

Anda mungkin juga bisa mendapatkan izin yang diperlukan melalui peran khusus atau peran bawaan lainnya.

Untuk memastikan bahwa akun layanan default Compute Engine memiliki izin yang diperlukan untuk menjalankan tugas Managed Service for Apache Spark, minta administrator untuk memberikan peran IAM berikut ke akun layanan default Compute Engine di project Anda:

- Worker Dataproc (

roles/dataproc.worker) - Cloud Data Fusion Runner (

roles/datafusion.runner)

Untuk mengetahui informasi selengkapnya tentang pemberian peran, lihat Mengelola akses ke project, folder, dan organisasi.

Administrator Anda mungkin juga dapat memberikan izin yang diperlukan kepada akun layanan default Compute Engine melalui peran khusus atau peran bawaan lainnya.

Membuat instance Cloud Data Fusion

- Klik Create an instance.

- Masukkan Nama instance.

- Masukkan Deskripsi untuk instance Anda.

- Masukkan Region tempat instance akan dibuat.

- Pilih Versi Cloud Data Fusion yang akan digunakan.

- Pilih Edisi Cloud Data Fusion.

- Untuk Cloud Data Fusion versi 6.2.3 dan yang lebih baru, di kolom Authorization, pilih akun layanan Managed Service for Apache Spark yang akan digunakan untuk menjalankan pipeline Cloud Data Fusion di Managed Service for Apache Spark. Nilai default, akun Compute Engine, sudah dipilih sebelumnya.

- Klik Create. Proses pembuatan instance memerlukan waktu hingga 30 menit. Saat Cloud Data Fusion membuat instance Anda, roda progres akan ditampilkan di samping nama instance di halaman Instances. Setelah selesai, ikon akan berubah menjadi tanda centang hijau dan menunjukkan bahwa Anda dapat mulai menggunakan instance.

Membuka antarmuka web Cloud Data Fusion

Saat menggunakan Cloud Data Fusion, Anda menggunakan Google Cloud konsol dan antarmuka web Cloud Data Fusion yang terpisah.

Di konsol Google Cloud , Anda dapat melakukan hal berikut:

- Buat project konsol Google Cloud

- Membuat dan menghapus instance Cloud Data Fusion

- Melihat detail instance Cloud Data Fusion

Di antarmuka web Cloud Data Fusion, Anda dapat menggunakan berbagai halaman, seperti Studio atau Wrangler, untuk menggunakan fungsi Cloud Data Fusion.

Untuk mengakses antarmuka Cloud Data Fusion, ikuti langkah-langkah berikut:

- Di konsol Google Cloud , buka halaman Instances.

- Di kolom Tindakan instance, klik link Lihat Instance.

- Di antarmuka web Cloud Data Fusion, gunakan panel navigasi kiri untuk membuka halaman yang Anda butuhkan.

Men-deploy pipeline sampel

Pipeline sampel tersedia melalui Hub Cloud Data Fusion, yang memungkinkan Anda berbagi pipeline, plugin, dan solusi Cloud Data Fusion yang dapat digunakan ulang.

- Di antarmuka web Cloud Data Fusion, klik Hub.

- Di panel kiri, klik Pipelines.

- Klik pipeline Cloud Data Fusion Quickstart.

- Klik Create.

- Di panel konfigurasi Cloud Data Fusion Quickstart, klik Finish.

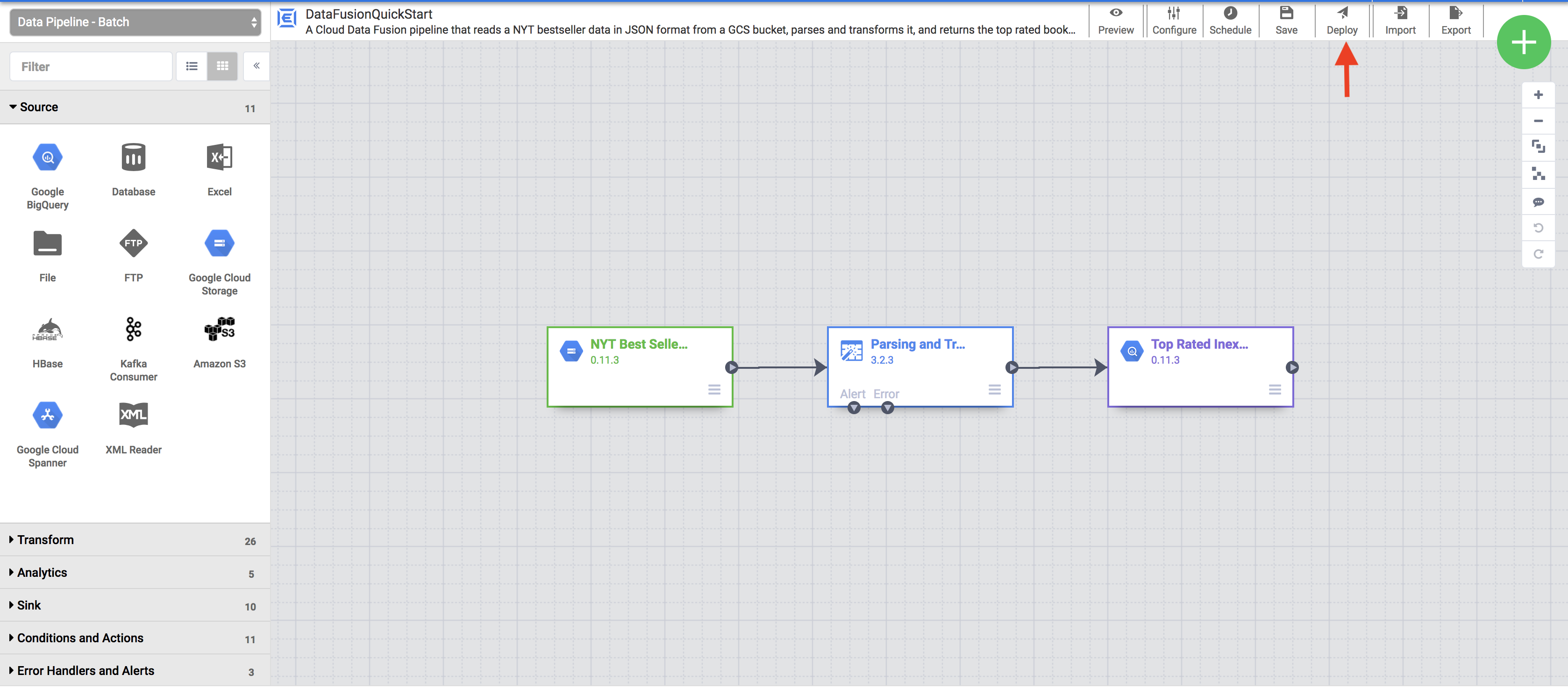

Klik Customize Pipeline.

Representasi visual pipeline Anda akan muncul di halaman Studio, yang merupakan antarmuka grafis untuk mengembangkan pipeline integrasi data. Plugin pipeline yang tersedia tercantum di sebelah kiri, dan pipeline Anda ditampilkan di area kanvas utama. Anda dapat menjelajahi pipeline dengan menahan kursor di setiap node pipeline dan mengklik Properties. Menu properti untuk setiap node memungkinkan Anda melihat objek dan operasi yang terkait dengan node tersebut.

Di menu kanan atas, klik Deploy. Langkah ini mengirimkan pipeline ke Cloud Data Fusion. Anda akan menjalankan pipeline di bagian berikutnya dalam panduan memulai ini.

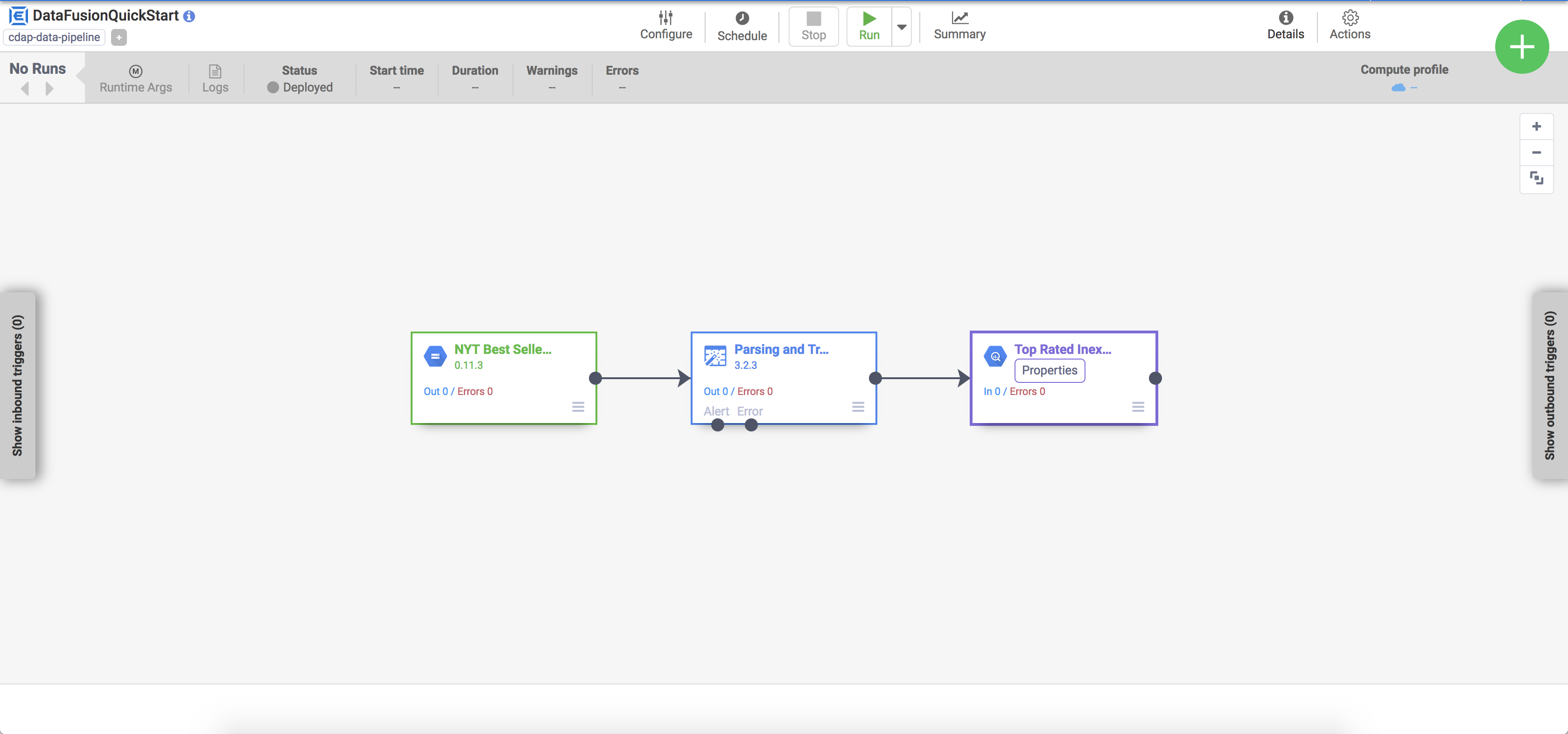

Melihat pipeline Anda

Pipeline yang di-deploy akan muncul di tampilan detail pipeline, tempat Anda dapat melakukan hal berikut:

- Melihat struktur dan konfigurasi pipeline.

- Menjalankan pipeline secara manual dan menyiapkan jadwal atau pemicu.

- Melihat ringkasan histori operasi pipeline, termasuk waktu eksekusi, log, dan metrik.

Menjalankan pipeline Anda

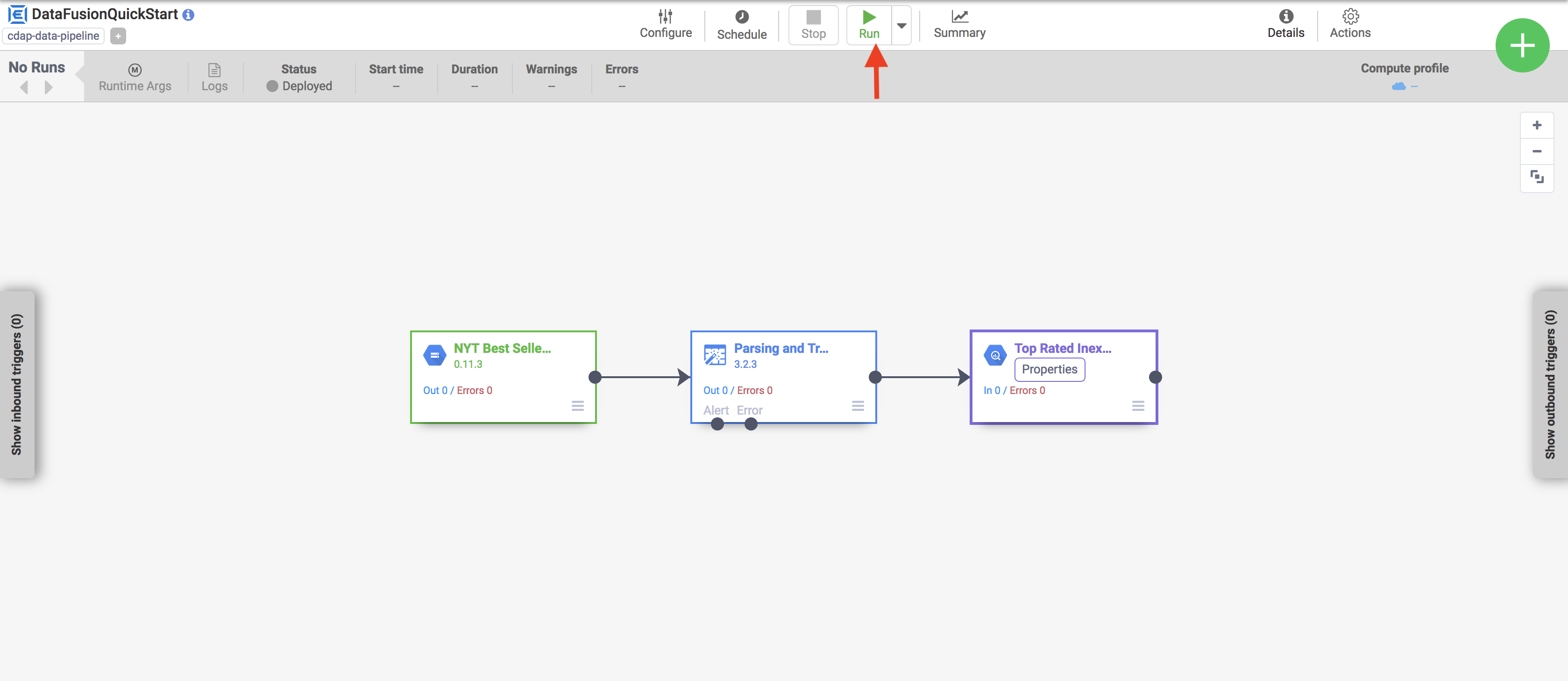

Di tampilan detail pipeline, klik Run untuk menjalankan pipeline Anda.

Saat menjalankan pipeline, Cloud Data Fusion akan melakukan hal berikut:

- Menyediakan cluster Managed Service untuk Apache Spark sementara

- Menjalankan pipeline di cluster menggunakan Apache Spark

- Menghapus cluster

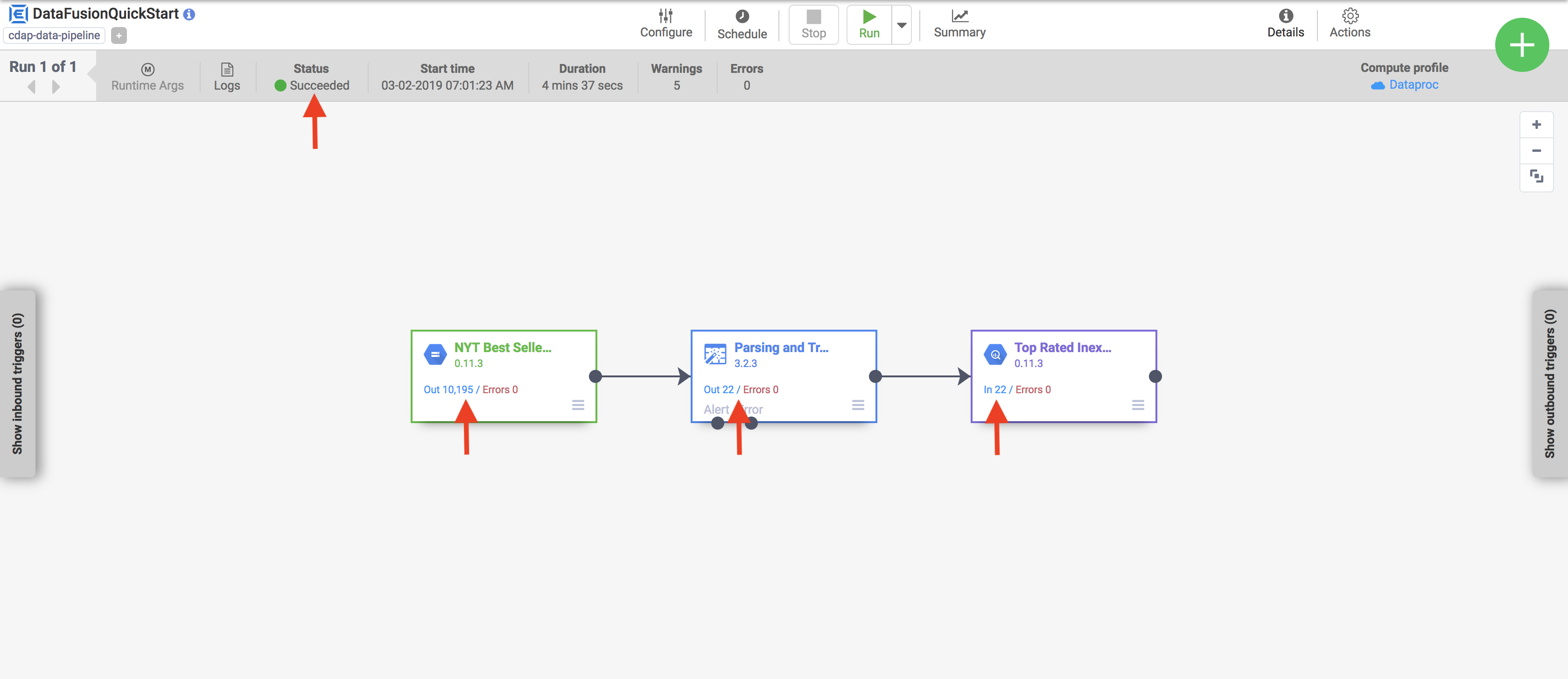

Melihat hasil

Setelah beberapa menit, pipeline akan selesai. Status pipeline berubah menjadi Succeeded dan jumlah kumpulan data yang diproses oleh setiap node akan ditampilkan.

- Buka antarmuka web BigQuery.

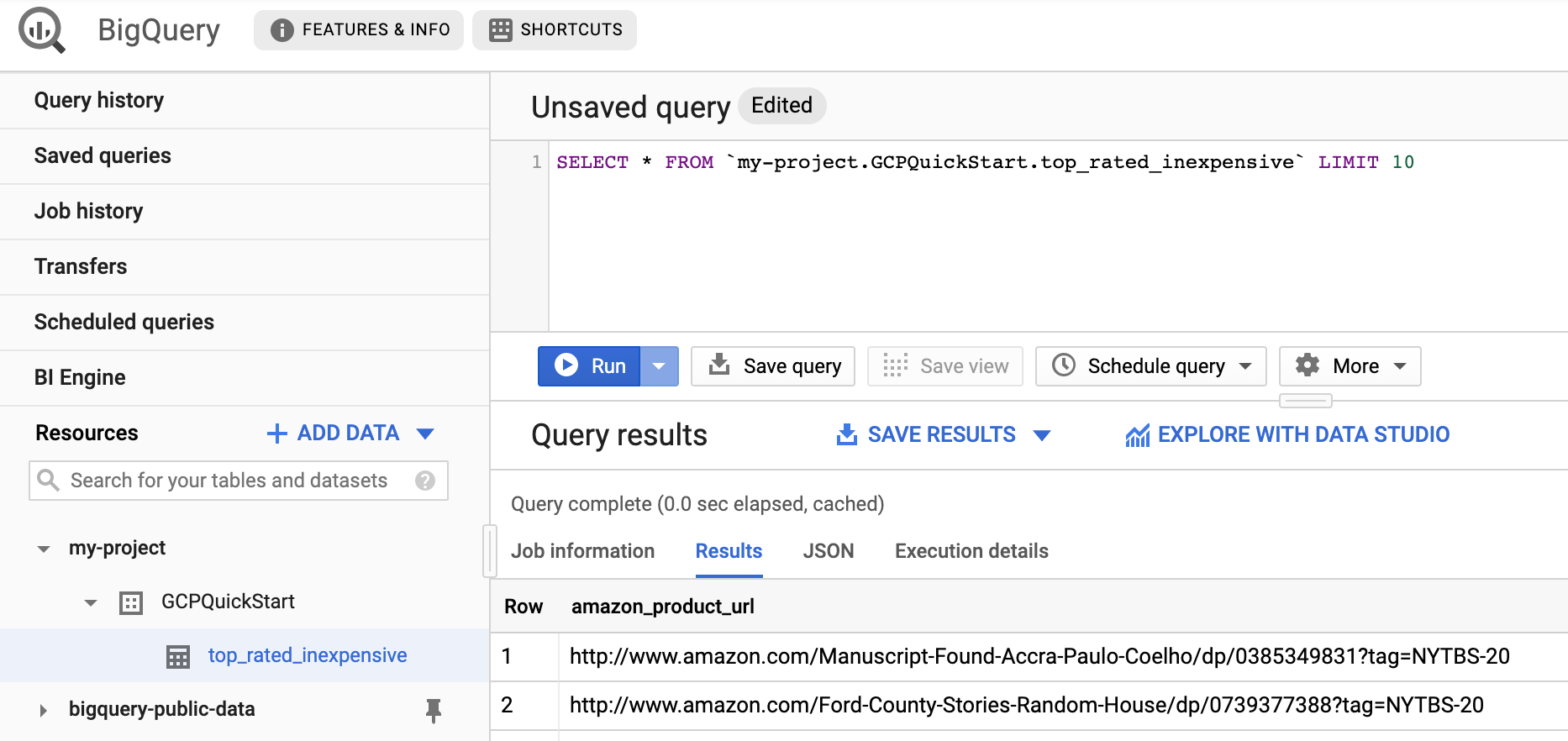

Untuk melihat contoh hasil, buka set data

DataFusionQuickstartdi project Anda, klik tabeltop_rated_inexpensive, lalu jalankan kueri sederhana. Contoh:SELECT * FROM PROJECT_ID.GCPQuickStart.top_rated_inexpensive LIMIT 10Ganti PROJECT_ID dengan project ID Anda.

Pembersihan

Agar akun Google Cloud Anda tidak dikenai biaya untuk resource yang digunakan pada halaman ini, ikuti langkah-langkah berikut.

- Hapus set data BigQuery yang ditulis oleh pipeline Anda dalam panduan memulai ini.

Opsional: Hapus project.

- Di Konsol Google Cloud , buka halaman Manage resources.

- Pada daftar project, pilih project yang ingin Anda hapus, lalu klik Delete.

- Pada dialog, ketik project ID, lalu klik Shut down untuk menghapus project.