Étape 1 : Établir les charges de travail

Cette page vous guide dans la première étape de configuration de votre base de données, qui est au cœur de Cortex Framework. Basée sur le stockage BigQuery, la base de données organise vos données entrantes provenant de diverses sources. Ces données organisées simplifient l'analyse et leur application dans le développement de l'IA.

Configurer l'intégration des données

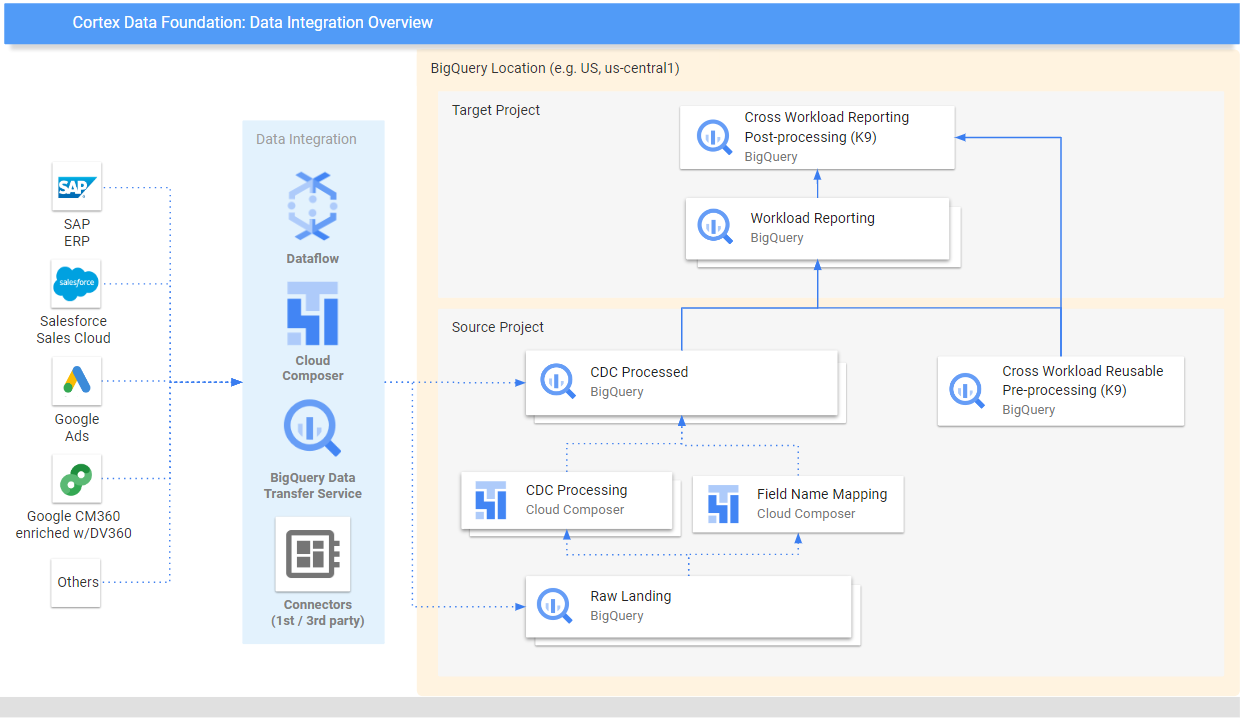

Commencez par définir certains paramètres clés qui serviront de modèle pour organiser et utiliser efficacement vos données dans Cortex Framework. N'oubliez pas que ces paramètres peuvent varier en fonction de la charge de travail spécifique, du flux de données choisi et du mécanisme d'intégration. Le schéma suivant présente un aperçu de l'intégration des données dans Cortex Framework Data Foundation :

Définissez les paramètres suivants avant le déploiement pour une utilisation efficace des données dans Cortex Framework.

Projets

- Projet source : projet dans lequel résident vos données brutes. Vous avez besoin d'au moins un Google Cloud projet pour stocker les données et exécuter le processus de déploiement.

- Projet cible (facultatif) : projet dans lequel Cortex Framework Data Foundation stocke ses modèles de données traités. Il peut s'agir du même projet que le projet source ou d'un projet différent, selon vos besoins.

Si vous souhaitez disposer d'ensembles distincts de projets et d'ensembles de données pour chaque charge de travail (par exemple, un ensemble de projets source et cible pour SAP et un ensemble différent de projets cible et source pour Salesforce), exécutez des déploiements distincts pour chaque charge de travail. Pour en savoir plus, consultez la section Utiliser différents projets pour séparer l'accès dans les étapes facultatives.

Modèle de données

- Déployer des modèles : choisissez si vous devez déployer des modèles pour toutes les charges de travail ou uniquement pour un ensemble de modèles (par exemple, SAP, Salesforce et Meta). Pour en savoir plus, consultez la section Sources de données et charges de travail disponibles.

Ensembles de données BigQuery

- Ensemble de données source (brut) : ensemble de données BigQuery dans lequel les données sources sont répliquées ou dans lequel les données de test sont créées. Nous vous recommandons d'avoir des ensembles de données distincts, un pour chaque source de données. Par exemple, un ensemble de données brutes pour SAP et un ensemble de données brutes pour Google Ads. Cet ensemble de données appartient au projet source.

- Ensemble de données CDC : ensemble de données BigQuery dans lequel les données traitées par CDC sont stockées dans les derniers enregistrements disponibles. Certaines charges de travail permettent le mappage des noms de champs. Nous vous recommandons d'avoir un ensemble de données CDC distinct pour chaque source. Par exemple, un ensemble de données CDC pour SAP et un ensemble de données CDC pour Salesforce. Cet ensemble de données appartient au projet source.

- Ensemble de données de reporting cible : ensemble de données BigQuery dans lequel les modèles de données prédéfinis de Data Foundation sont déployés. Nous vous recommandons d'avoir un ensemble de données de reporting distinct pour chaque source. Par exemple, un ensemble de données de reporting pour SAP et un ensemble de données de reporting pour Salesforce. Cet ensemble de données est créé automatiquement lors du déploiement s'il n'existe pas. Cet ensemble de données appartient au projet cible.

- Ensemble de données K9 de prétraitement : ensemble de données BigQuery dans lequel des composants DAG réutilisables et inter-charges de travail, tels que les dimensions

time, peuvent être déployés. Les charges de travail dépendent de cet ensemble de données, sauf modification. Cet ensemble de données est créé automatiquement lors du déploiement s'il n'existe pas. Cet ensemble de données appartient au projet source. - Ensemble de données K9 de post-traitement : ensemble de données BigQuery dans lequel le reporting inter-charges de travail et les DAG de sources externes supplémentaires (par exemple, l'ingestion de Google Trends) peuvent être déployés. Cet ensemble de données est créé automatiquement lors du déploiement s'il n'existe pas. Cet ensemble de données appartient au projet cible.

Facultatif : Générer des exemples de données

Cortex Framework peut générer des exemples de données et de tables si vous n'avez pas accès à vos propres données, ni à des outils de réplication pour configurer les données, ou même si vous souhaitez simplement voir comment fonctionne Cortex Framework. Toutefois, vous devez toujours créer et identifier les ensembles de données CDC et brutes à l'avance.

Créez des ensembles de données BigQuery pour les données brutes et CDC par source de données, en suivant les instructions ci-dessous.

Console

Ouvrez la page BigQuery dans la Google Cloud console.

Dans le panneau Explorer, sélectionnez le projet dans lequel vous souhaitez créer l'ensemble de données.

Développez l'option Actions, puis cliquez sur Créer un ensemble de données :

Sur la page Créer un ensemble de données , procédez comme suit :

- Pour ID de l'ensemble de données, indiquez le nom d'un ensemble de données unique.

Dans Type d'emplacement, sélectionnez un emplacement géographique pour l'ensemble de données. Une fois l'ensemble de données créé, l'emplacement ne peut plus être modifié.

Facultatif. Pour en savoir plus sur la personnalisation de votre ensemble de données, consultez Créer des ensembles de données : console.

Cliquez sur Créer un ensemble de données.

BigQuery

Créez un ensemble de données pour les données brutes en copiant la commande suivante :

bq --location= LOCATION mk -d SOURCE_PROJECT: DATASET_RAWRemplacez les éléments suivants :

LOCATIONpar l'emplacement de l'ensemble de données.SOURCE_PROJECTavec l'ID de votre projet source.DATASET_RAWpar le nom de votre ensemble de données pour les données brutes. Par exemple,CORTEX_SFDC_RAW.

Créez un ensemble de données pour les données CDC en copiant la commande suivante :

bq --location=LOCATION mk -d SOURCE_PROJECT: DATASET_CDCRemplacez les éléments suivants :

LOCATIONpar l'emplacement de l'ensemble de données.SOURCE_PROJECTavec l'ID de votre projet source.DATASET_CDCpar le nom de votre ensemble de données pour les données CDC. Par exemple,CORTEX_SFDC_CDC.

Vérifiez que les ensembles de données ont été créés à l'aide de la commande suivante :

bq lsFacultatif. Pour en savoir plus sur la création des ensembles de données, consultez la page Créer des ensembles de données.

Étapes suivantes

Une fois cette étape terminée, passez aux étapes de déploiement suivantes :

- Établir les charges de travail (cette page)

- Cloner le dépôt.

- Déterminer le mécanisme d'intégration.

- Configurer les composants.

- Configurer le déploiement.

- Exécuter le déplier.