Google Cloud は、一般的なオペレーティング システム、フレームワーク、ライブラリ、ドライバを含むイメージを提供します。 Google Cloud は、これらの事前構成されたイメージを最適化して、AI と ML のワークロードをサポートします。

このドキュメントでは、AI Hypercomputer 環境でワークロードのデプロイ、管理、実行に使用するイメージの概要について説明します。

画像カテゴリについて

画像は次のカテゴリに分類されます。

- AI および ML のフレームワークとライブラリ: ML モデルの作成、トレーニング、使用を簡素化するために、ML フレームワークとライブラリのバイナリが事前構成された Docker イメージ。AI Hypercomputer では、ディープ ラーニング ソフトウェア レイヤ(DLSL)Docker イメージを使用して、Google Kubernetes Engine(GKE)クラスタで NeMO や MaxText などの ML モデルを実行できます。

- クラスタのデプロイとオーケストレーション: AI ワークロードが実行されるパフォーマンス最適化インフラストラクチャのデプロイと管理に使用するオペレーティング システム(OS)イメージ。AI ワークロードは、GKE クラスタ、Slurm クラスタ、または Compute Engine インスタンスにデプロイできます。詳細については、VM とクラスタの作成の概要をご覧ください。クラスタまたはインスタンスのデプロイには、次のオペレーティング システム イメージを使用できます。

- GKE ノードイメージ: これらのイメージを使用して、GKE クラスタをデプロイできます。

- Slurm OS イメージ: Cluster Toolkit は、これらのイメージをビルドしてデプロイします。これらのイメージは、Slurm ノードに必要なシステム ソフトウェアをインストールします。

- アクセラレータ OS イメージ: これらのイメージを使用して、個々のインスタンスまたはインスタンスのグループを作成できます。

AI と ML のフレームワークとライブラリ

Google Cloud は、一般的な AI および ML のフレームワークとライブラリをパッケージ化した Docker イメージを提供します。これらのイメージは、AI Hypercomputer で実行されている AI 最適化クラスタでのモデルの開発、トレーニング、デプロイを簡素化するために必要なソフトウェアを提供します。

JAX AI イメージ

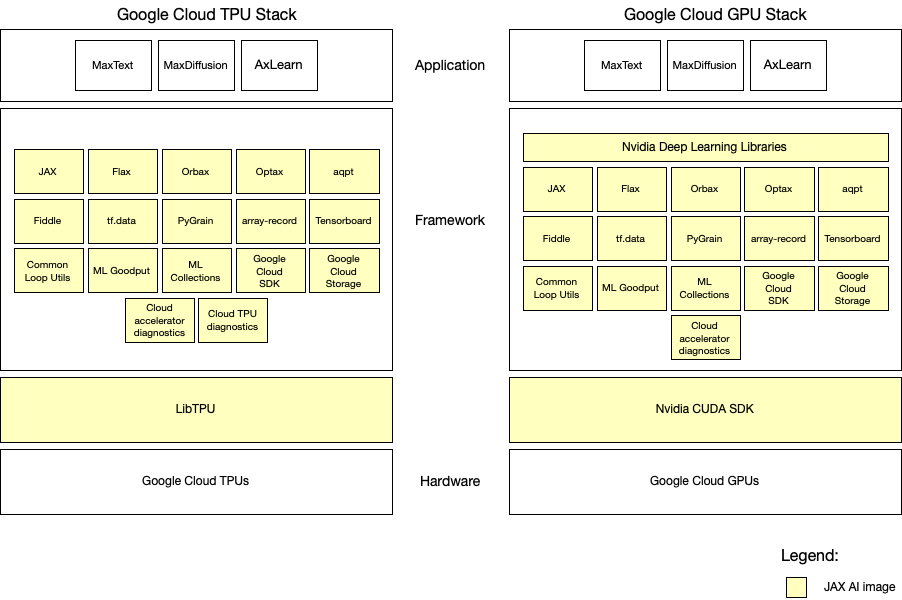

Google Cloud TPU と GPU 用の JAX AI Images(JAII、以前は JAX Stable Stack Images と呼ばれていました)は、JAX フレームワーク、互換性のあるライブラリの厳選されたコレクション、 Google Cloud インフラストラクチャの設定を含む、すぐに使用できる Docker イメージを提供します。JAX AI TPU イメージには、JAX ライブラリと TPU ライブラリが事前に構成されています。JAX AI GPU イメージには、JAX ライブラリと関連する CUDA/NVIDIA ライブラリが事前構成されています。

ハードウェア レイヤ

JAX AI イメージは、アクセラレータ(TPU または GPU)とそれに関連付けられた VM で構成されるハードウェア レイヤの上に配置されます。JAX AI イメージを使用するには、TPU VM または GPU VM をプロビジョニングする必要があります。これを行うには、TPU API、Compute Engine API、または GKE API を使用します。

フレームワーク レイヤ

フレームワーク レイヤは、ML ワークロードを構築するためのツールとライブラリを提供します。JAX AI イメージは、コア JAX ライブラリやその他の重要な依存関係など、JAX ベースの ML ワークロード用に事前構成されたベースを提供し、一貫性のある高性能の開発エクスペリエンスを実現します。

JAX AI イメージの LibTPU レイヤは、それぞれの JAX バージョンで特別にビルドされ、バンドルされています。別の JAX バージョンを使用すると、予期しない動作やエラーが発生する可能性があります。

JAX AI イメージの CUDA レイヤには、GPU トレーニング イメージのベースイメージとして使用される NGC CUDA Deep Learning Image など、NVIDIA が管理するコンポーネントが含まれています。GPU イメージには、NVIDIA GPU での Transformer モデルの高速化に使用されるカスタム NVIDIA ライブラリである Transformer Engine も含まれています。

特定の ML ワークロードでは、JAX AI イメージで提供されるパッケージに加えて、アプリケーション固有の追加パッケージが必要になる場合があります。

JAX AI イメージのライブラリ:

TPU イメージ

| 機能 | パッケージ名 |

|---|---|

| コア ライブラリまたはコンポーネント | |

| ML フレームワーク | JAX と JAX lib |

| LibTPU | Cloud LibTPU 安定版リリース |

| レイヤ/モデル ライブラリ | Flax |

| チェックポイント処理 | Orbax |

| 量子化 | Qwix |

| オプティマイザー | Optax |

| カスタム カーネル | Tokamax |

| 構成 | Fiddle |

| 入力パイプライン | tf.data |

| プロファイリング、デバッグ | TensorBoard |

| utils | 一般的なループ ユーティリティ |

| クラウド固有のツール | |

| Google Cloud | |

| 診断 | |

GPU イメージ

| 機能 | パッケージ名 |

|---|---|

| コア ライブラリまたはコンポーネント | |

| ML フレームワーク | JAX と JAX lib |

| NVIDIA CUDA ライブラリ | CUDA DL イメージ |

| レイヤ/モデル ライブラリ | Flax |

| チェックポイント処理 | Orbax |

| オプティマイザー | |

| 構成 | Fiddle |

| 入力パイプライン | |

| プロファイリング、デバッグ | TensorBoard |

| utils | |

| クラウド固有のツール | |

| Google Cloud | |

| 診断 | Cloud Accelerator Diagnostics |

現在の JAX AI イメージ

TPU イメージ

| JAX AI イメージ | リリース日 |

|---|---|

| JAX 0.9.0 リビジョン 1 | 2026-02-03 |

| JAX 0.8.2 リビジョン 1 | 2026-01-14 |

| JAX 0.8.1 リビジョン 1 | 2025-11-21 |

| JAX 0.8.0 リビジョン 1 | 2025-10-28 |

| JAX 0.7.2 リビジョン 1 | 2025-09-30 |

| JAX 0.7.0 リビジョン 1 | 2025-07-29 |

| JAX 0.6.1 リビジョン 1 | 2025-06-05 |

| JAX 0.5.2 リビジョン 2 | 2025-04-25 |

| JAX 0.5.2 リビジョン 1 | 2025-03-17 |

| JAX 0.4.37 リビジョン 1 | 2024-12-12 |

| JAX 0.4.35 リビジョン 1 | 2024-10-30 |

GPU イメージ

| JAX AI イメージ | リリース日 |

|---|---|

| CUDA DL 25.06 リビジョン 1 を使用した JAX 0.7.2 | 2025-09-30 |

| JAX 0.6.1 と CUDA DL 25.03 リビジョン 1 | 2025-06-05 |

| JAX 0.5.1 と CUDA DL 25.02 リビジョン 1 | 2025-03-17 |

アプリケーション レイヤ

特定の ML ワークロードは、フレームワーク レイヤの上にあるアプリケーション レイヤに実装します。アプリケーション レイヤには、アプリケーション固有のコード、モデル、ロジックが含まれます。これらはすべて、フレームワーク レイヤで提供されるツールとライブラリを使用して構築されます。

このイメージは、JAX ベースの AI ワークロードに堅牢で十分にテストされた基盤を提供しますが、アプリケーション固有の依存関係を追加する必要がある場合があります。その際は、JAX とそのコア依存関係を含む事前構成済みのベースレイヤへの干渉を最小限に抑える方法で行うことをおすすめします。既存の依存関係をオーバーライドまたは競合するアプリケーション レベルの依存関係を導入すると、次のような副作用が発生する可能性があります。

- 予期しない動作: ML ワークロードは、JAX AI イメージに追加の依存関係を導入する前とは異なる動作を示すことがあります。

- パフォーマンスの回帰: 最適化された JAX 関連ライブラリをオーバーライドすると、JAX AI イメージによって提供されるパフォーマンス上のメリットに悪影響を及ぼす可能性があります。

- 安定性の問題: 追加した依存関係とコア JAX 依存関係の間に競合が発生すると、アプリケーション内で不安定性やランタイム エラーが発生する可能性があります。

リリースの頻度

当初、JAX AI 画像は四半期ごとに提供されます。当面の目標は、すべての JAX リリースと同期した公開スケジュールです。これにより、最新の機能や改善が利用可能になるとすぐに利用できるようになります。

サポート

JAX AI イメージの各リリースは、期間限定のサポート ライフサイクルに準拠しています。この期間内に、既存の JAX AI 画像の変更リクエストの特定のカテゴリに対応します。

- セキュリティの脆弱性: JAX Stable Stack Docker イメージのベースイメージまたは依存関係で発見されたセキュリティの脆弱性への対処を優先します。潜在的なリスクを軽減するために、更新されたイメージがリリースされます。

- 互換性を破る変更: JAX AI 画像で使用される基盤となるライブラリまたはフレームワークに互換性を破る重大な変更があった場合、 Google Cloudは互換性を維持するために必要な更新を評価して実装します。これには、更新された依存関係を使用して Docker イメージを再ビルドすることが含まれる場合があります。

JAII 内のライブラリでセキュリティの脆弱性やバグが発見された場合、更新されたライブラリを JAII に組み込み、他のすべてのライブラリ バージョンを固定して全体的な安定性を維持します。これにより、新しい JAII リビジョンが作成されます。

リビジョンの最小限の変更:

JAX-0.4.30-rev1 内のパッケージ「X」でバグが見つかった場合、他のすべてのパッケージを変更しないようにしながら、「X」を次のリリース(v2.0 など)に更新します。これにより、新しいリビジョン(JAX-0.4.30-rev2)が作成され、できるだけ早くリリースされます。

Deep Learning Software Layer(DLSL)Docker イメージ

これらのイメージには、NVIDIA CUDA、NCCL、ML フレームワーク、モデルがパッケージ化されています。ディープ ラーニング ワークロードですぐに使用できる環境を提供します。これらのビルド済み DLSL Docker イメージは、内部の再現性と回帰テストでテストと検証が行われているため、GKE クラスタとシームレスに連携します。

DLSL Docker イメージには次の利点があります。

- 事前構成済みのソフトウェア: DLSL Docker イメージは、内部の再現性と回帰テストで使用される設定を複製します。これらのイメージは、事前構成、テスト、最適化された環境を提供するため、インストールと構成にかかる時間と労力を大幅に節約できます。

- バージョン管理: DLSL Docker イメージは頻繁に更新されます。これらのバージョン アップデートでは、フレームワークとドライバの最新の安定版が提供され、セキュリティ パッチも適用されます。

- インフラストラクチャの互換性: DLSL Docker イメージは、AI Hypercomputer で使用可能な GPU マシンタイプとシームレスに連携するように構築およびテストされています。

- クイックスタートの手順: 一部の DLSL Docker イメージには、事前構成済みのイメージを使用するワークロードを開始する方法を示すサンプル レシピが付属しています。

NeMo + PyTorch + NCCL gIB プラグイン

これらの Docker イメージは NVIDIA NeMo NGC イメージをベースにしています。これらには、Google の NCCL gIB プラグインが含まれており、サポートされている各アクセラレータ マシンでワークロードを実行するために必要なすべての NCCL バイナリがバンドルされています。これらのイメージには、Google Kubernetes Engine にワークロードをデプロイするための gcsfuse などのツールと

gcloud CLI も含まれています。 Google Cloud

| DLSL 画像モード | 依存関係のバージョン | マシンシリーズ | リリース日 | サポート終了日 | DLSL イメージ名 |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 2025 年 7 月 3 日 | 2026 年 7 月 3 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 2025 年 7 月 3 日 | 2026 年 7 月 3 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 2025 年 3 月 14 日 | 2026 年 3 月 14 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2025 年 2 月 2 日 | 2026 年 2 月 2 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2025 年 2 月 2 日 | 2026 年 2 月 2 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 2025 年 2 月 7 日 | 2026 年 2 月 7 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High(8 個の GPU) | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

この Docker イメージは NVIDIA NeMo NGC イメージに基づいており、Google Kubernetes Engine にワークロードをデプロイするための gcsfuse や

gcloud CLI などのツールが含まれています。 Google Cloud

| DLSL 画像モード | 依存関係のバージョン | マシンシリーズ | リリース日 | サポート終了日 | DLSL イメージ名 |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | 2024 年 12 月 19 日 | 2025 年 12 月 19 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High(8 個の GPU) | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

MaxText + JAX ツールボックス

この Docker イメージは NVIDIA JAX ツールボックス イメージに基づいており、Google Kubernetes Engine にワークロードをデプロイするための gcsfuse や

gcloud CLI などのGoogle Cloud ツールが含まれています。

| DLSL 画像モード | 依存関係のバージョン | マシンシリーズ | リリース日 | サポート終了日 | DLSL イメージ名 |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 2025 年 3 月 11 日 | 2026 年 3 月 11 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 2025 年 3 月 17 日 | 2026 年 3 月 17 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High(8 個の GPU) | 2025 年 3 月 17 日 | 2026 年 3 月 17 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

MaxText + JAX Stable Stack

この Docker イメージは、JAX Stable Stack と MaxText に基づいています。このイメージには、Google Kubernetes Engine でワークロードを実行するための dnsutils などの依存関係も含まれています。

| DLSL 画像モード | 依存関係のバージョン | マシンシリーズ | リリース日 | サポート終了日 | DLSL イメージ名 |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 2025 年 3 月 17 日 | 2026 年 3 月 17 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

クラスタのデプロイとオーケストレーション

OS イメージには、コンピューティング インスタンスまたは GKE ノードにオペレーティング システムをデプロイするために必要なすべてのソフトウェア コンポーネントが含まれています。オペレーティング システムは、アクセラレータやネットワーキングなどの基盤となるハードウェア リソースを管理します。これにより、AI ワークロードのコンピューティング リソースが提供されます。

GKE ノードイメージ

GKE は、ノードイメージを使用してクラスタをデプロイします。これらのノードイメージは、Container-Optimized OS、Ubuntu、Windows Server などのさまざまなオペレーティング システムで使用できます。GKE Autopilot クラスタのデプロイに必要な containerd を含む Container-Optimized OS(cos_containerd)ノードイメージには、AI / ML ワークロードをサポートするための最適化が含まれています。

これらのノードイメージの詳細については、ノードイメージをご覧ください。

Slurm OS イメージ

Slurm クラスタは、コンピューティング ノードとコントローラ ノードを Compute Engine のコンピューティング インスタンスとしてデプロイします。

AI 最適化 Slurm クラスタをプロビジョニングするには、Cluster Toolkit を使用する必要があります。Slurm クラスタのデプロイ中に、クラスタ ブループリントは、Slurm ノードにクラスタとワークロードの管理に必要なシステム ソフトウェアをインストールするカスタム OS イメージを自動的にビルドします。デフォルトのブループリントをデプロイ前に変更して、イメージに含まれるソフトウェアの一部をカスタマイズできます。

次のセクションでは、クラスタ ブループリントが A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU)の Slurm ノードにインストールするソフトウェアの概要を説明します。クラスタ ブループリントは、Ubuntu LTS アクセラレータ OS イメージを拡張します。

A4X Max

GitHub で入手できる A4X Max ブループリントには、デフォルトで次のソフトウェアが含まれています。

- Ubuntu 24.04 LTS

- Slurm: バージョン 25.05.2

- 次の Slurm 依存関係:

mungemariadblibjwtlmod

- Open MPI: バージョン 5.0.x

- NFS クライアントとサーバー

- NVIDIA 580 シリーズ ドライバ

- NVIDIA Enroot

- NVIDIA Pyxis

- 次の NVIDIA ツール:

- Data Center GPU Manager(

dcgmi) nvidia-container-toolkit: バージョン 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager(

- CUDA ツールキット: バージョン 13.0

- A4X Max 用 NCCL プラグイン(

nccl-gib-a4x-max-arm64) - DOCA-OFED ドライバ

- Ops エージェント

- Cloud Storage FUSE

A4X

GitHub で入手できる A4X ブループリントには、デフォルトで次のソフトウェアが含まれています。

- Ubuntu 24.04 LTS

- Slurm: バージョン 25.05.2

- 次の Slurm 依存関係:

mungemariadblibjwtlmod

- Open MPI: バージョン 5.0.x

- NFS クライアントとサーバー

- NVIDIA 570 シリーズ ドライバ

- NVIDIA Enroot

- NVIDIA Pyxis

- 次の NVIDIA ツール:

- Data Center GPU Manager(

dcgmi) nvidia-container-toolkit: バージョン 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager(

- CUDA Toolkit: バージョン 12.8

- A4X 用 NCCL プラグイン(

nccl-plugin-gib-arm64) - Ops エージェント

- Cloud Storage FUSE

A4

GitHub で入手できる A4 ブループリントには、デフォルトで次のソフトウェアが含まれています。

- Ubuntu 22.04 LTS

- Slurm: バージョン 25.05.2

- 次の Slurm 依存関係:

mungemariadblibjwtlmod

- Open MPI: 4.1.x の最新リリース

- PMIx: バージョン 4.2.9

- NFS クライアントとサーバー

- NVIDIA 570 シリーズ ドライバ

- NVIDIA enroot コンテナ ランタイム: バージョン 3.5.0(リリース後のバグ修正を含む)

- NVIDIA pyxis

- 次の NVIDIA ツール:

- Data Center GPU Manager(

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- Data Center GPU Manager(

- CUDA Toolkit: バージョン 12.8

ibverbs-utilsを含む Infiniband のサポート- Ops エージェント

- Cloud Storage FUSE

A3 Ultra

GitHub で入手できる A3 Ultra ブループリントには、デフォルトで次のソフトウェアが含まれています。

- Ubuntu 22.04 LTS

- Slurm: バージョン 24.11.2

- 次の Slurm 依存関係:

mungemariadblibjwtlmod

- Open MPI: 4.1.x の最新リリース

- PMIx: バージョン 4.2.9

- NFS クライアントとサーバー

- NVIDIA 570 シリーズ ドライバ

- NVIDIA enroot コンテナ ランタイム: バージョン 3.5.0(リリース後のバグ修正を含む)

- NVIDIA pyxis

- 次の NVIDIA ツール:

- Data Center GPU Manager(

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- Data Center GPU Manager(

- CUDA Toolkit: バージョン 12.8

ibverbs-utilsを含む Infiniband のサポート- Ops エージェント

- Cloud Storage FUSE

A3 Mega

GitHub で入手できる A3 Mega ブループリントには、デフォルトで次のソフトウェアが含まれています。

- Ubuntu 22.04 LTS

- Slurm: バージョン 24.11.2

- 次の Slurm 依存関係:

mungemariadblibjwtlmod

- Open MPI: 4.1.x の最新リリース

- PMIx: バージョン 4.2.9

- NFS クライアントとサーバー

- NVIDIA 550 シリーズ ドライバ

- NVIDIA enroot コンテナ ランタイム: バージョン 3.4.1

- NVIDIA pyxis

- 次の NVIDIA ツール:

- Data Center GPU Manager(

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- Data Center GPU Manager(

- CUDA ツールキット: バージョン 12.4

ibverbs-utilsを含む Infiniband のサポート- A3 Mega の TCPXO: NCCL TCPXO と 1.6 Tbps ネットワーク スタック用の特定のインストーラ

- Ops エージェント

- Cloud Storage FUSE

A3 High

GitHub で入手できる A3 High(8 個の GPU)ブループリントには、デフォルトで次のソフトウェアが含まれています。

- Ubuntu 22.04 LTS

- Slurm: バージョン 24.11.2

- 次の Slurm 依存関係:

mungemariadblibjwtlmod

- Open MPI: 4.1.x の最新リリース

- PMIx: バージョン 4.2.9

- NFS クライアントとサーバー

- NVIDIA 535 または 550 シリーズのドライバ

- NVIDIA enroot コンテナ ランタイム: バージョン 3.4.1

- NVIDIA pyxis

- 次の NVIDIA ツール:

- Data Center GPU Manager(

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- Data Center GPU Manager(

- CUDA ツールキット: バージョン 12.2 または 12.4

ibverbs-utilsを含む Infiniband のサポート- A3 High(8 個の GPU)の TCPX: NCCL TCPX(GPUDirect-TCPX)と 800 Gbps ネットワーク スタック(4 個の NIC)用の特定のインストーラ

- Ops エージェント

- Cloud Storage FUSE

アクセラレータ OS イメージ

AI Hypercomputer を使用すると、個々のコンピューティング インスタンスまたはコンピューティング インスタンスのグループをプロビジョニングできます。これらのインスタンスを作成する場合は、インスタンスの作成時に OS イメージを指定する必要があります。

Google Cloud には、インスタンス作成用の OS イメージのスイートが用意されています。また、 Google Cloud には、AI 最適化インスタンス用の特殊なアクセラレータ OS イメージ一式も用意されています。これらの OS イメージには、NVIDIA ドライバ、Mellanox ドライバ、それらの依存関係など、GPU とネットワーキング機能のコア ドライバが含まれています。

各 OS の詳細については、Compute Engine ドキュメントのオペレーティング システムの詳細ページをご覧ください。

アクセラレータ OS イメージは、Rocky Linux オペレーティング システムと Ubuntu LTS オペレーティング システムで使用できます。

Rocky Linux アクセラレータ

次の Rocky Linux アクセラレータ OS イメージは、各マシンシリーズで使用できます。

| OS バージョン | イメージ ファミリー | アーキテクチャ | マシンシリーズ | イメージ プロジェクト |

|---|---|---|---|---|

| Rocky Linux 9 アクセラレータ | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max、A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | rocky-linux-accelerator-cloud |

|

| Rocky Linux 8 アクセラレータ | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max、A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | rocky-linux-accelerator-cloud |

Ubuntu LTS アクセラレータ

次の Ubuntu LTS アクセラレータ OS イメージは、各マシンシリーズで使用できます。

| OS バージョン | イメージ ファミリー | アーキテクチャ | マシンシリーズ | イメージ プロジェクト |

|---|---|---|---|---|

| Ubuntu 24.04 LTS アクセラレータ | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max、A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | ubuntu-os-accelerator-images |

|

| Ubuntu 22.04 LTS アクセラレータ | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max、A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High(8 個の GPU) | ubuntu-os-accelerator-images |