Questa pagina fornisce una panoramica concettuale dell'esportazione dei dati di traccia utilizzando Cloud Trace. Potresti voler esportare i dati di traccia per i seguenti motivi:

- Per archiviare i dati di traccia per un periodo superiore al periodo di conservazione predefinito di 30 giorni.

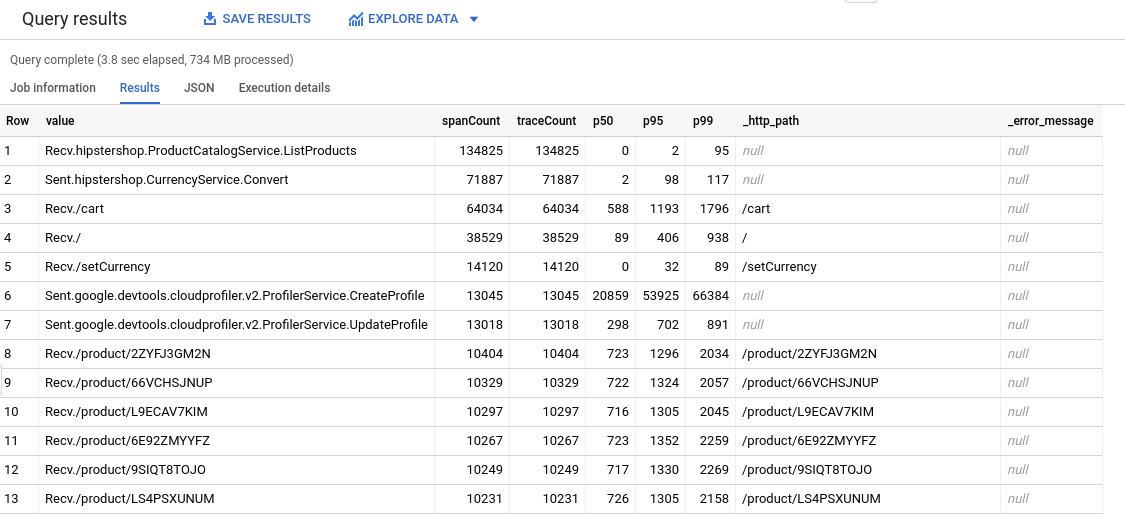

Per consentirti di utilizzare gli strumenti di BigQuery per analizzare i dati di traccia. Ad esempio, utilizzando BigQuery, puoi identificare i conteggi e i quantili degli intervalli. Per informazioni sulla query utilizzata per generare la seguente tabella, consulta Query HipsterShop.

Come funzionano le esportazioni

L'esportazione prevede la creazione di un sink per un Google Cloud progetto. Un sink definisce un set di dati BigQuery come destinazione.

Puoi creare un sink utilizzando l'Cloud Trace API o Google Cloud CLI.

Proprietà e terminologia dei sink

I sink sono definiti per un Google Cloud progetto e hanno le seguenti proprietà:

Nome: un nome per il sink. Ad esempio, un nome potrebbe essere:

"projects/PROJECT_NUMBER/traceSinks/my-sink"

dove

PROJECT_NUMBERè il numero del progetto del sink Google Cloud emy-sinkè l'identificatore del sink.Parent: la risorsa in cui crei il sink. Il parent deve essere un Google Cloud progetto:

"projects/PROJECT_ID"

Il

PROJECT_IDpuò essere un Google Cloud identificatore o un numero di progetto.Destinazione: un unico luogo in cui inviare gli intervalli di traccia. Trace supporta l'esportazione delle tracce in BigQuery. La destinazione può essere il progetto del sink o qualsiasi altro progetto della stessa organizzazione. Google Cloud Google Cloud

Ad esempio, una destinazione valida è:

bigquery.googleapis.com/projects/DESTINATION_PROJECT_NUMBER/datasets/DATASET_ID

dove

DESTINATION_PROJECT_NUMBERè il Google Cloud numero del progetto di destinazione eDATASET_IDè l'identificatore del set di dati BigQuery.Writer Identity: un nome di account di servizio. Il proprietario della destinazione di esportazione deve concedere a questo account di servizio le autorizzazioni per scrivere nella destinazione di esportazione. Quando esporta le tracce, Trace adotta questa identità per l'autorizzazione. Per una maggiore sicurezza, i nuovi sink ricevono un account di servizio univoco:

export-PROJECT_NUMBER-GENERATED_VALUE@gcp-sa-cloud-trace.iam.gserviceaccount.com

dove

PROJECT_NUMBERè il numero del progetto, Google Cloud in formato esadecimale, eGENERATED_VALUEè un valore generato in modo casuale.Non crei, possiedi o gestisci il account di servizio identificato dall'identità writer di un sink. Quando crei un sink, Trace crea l'account di servizio richiesto dal sink. Questo account di servizio non è incluso nell'elenco degli account di servizio per il tuo progetto finché non ha almeno un'associazione Identity and Access Management. Aggiungi questo binding quando configuri una destinazione del sink.

Per informazioni sull'utilizzo dell'identità writer, consulta Autorizzazioni di destinazione.

Come funzionano i sink

Ogni volta che un intervallo di traccia arriva in un progetto, Trace ne esporta una copia.

Le tracce ricevute da Trace prima della creazione del sink non possono essere esportate.

Controllo degli accessi

Per creare o modificare un sink, devi disporre di uno dei seguenti ruoli Identity and Access Management:

- Trace Admin

- Trace User

- Proprietario progetto

- Editor progetto

Per ulteriori informazioni, consulta Controllo degli accessi.

Per esportare le tracce in una destinazione, l'account di servizio writer del sink deve avere l'autorizzazione di scrittura nella destinazione. Per ulteriori informazioni sulle identità writer, consulta Proprietà del sink in questa pagina.

Quote e limiti

Cloud Trace utilizza l' API BigQuery Streaming per inviare gli intervalli di traccia alla destinazione. Cloud Trace esegue il batch delle chiamate API. Cloud Trace non implementa un meccanismo di ripetizione o limitazione. Gli intervalli di Trace potrebbero non essere esportati correttamente se la quantità di dati supera le quote di destinazione.

Per informazioni dettagliate su quote e limiti di BigQuery, consulta Quote e limiti.

Prezzi

L'esportazione delle tracce non comporta addebiti di Cloud Trace. Tuttavia, potresti incorrere in addebiti di BigQuery. Per ulteriori informazioni, consulta Prezzi di BigQuery.

Stima dei costi

BigQuery addebita un costo per l'importazione e l'archiviazione dei dati. Per stimare i costi mensili di BigQuery:

Stima il numero totale di intervalli di traccia importati in un mese.

Per informazioni su come visualizzare l'utilizzo, consulta Visualizzare l'utilizzo per account di fatturazione.

Stima i requisiti di streaming in base al numero di intervalli di traccia importati.

Ogni intervallo viene scritto in una riga della tabella. Ogni riga in BigQuery richiede almeno 1024 byte. Pertanto, un limite inferiore per i requisiti di streaming di BigQuery è assegnare 1024 byte a ogni intervallo. Ad esempio, se il tuo Google Cloud progetto ha importato 200 span, questi richiedono almeno 20.400 byte per l'inserimento di flussi di dati.

Utilizza il Calcolatore prezzi per stimare i costi di BigQuery dovuti ad archiviazione, inserimenti di streaming e query.

Visualizzare e gestire l'utilizzo di BigQuery

Puoi utilizzare Metrics Explorer per visualizzare l'utilizzo di BigQuery. Puoi anche creare una criterio di avviso che ti invii una notifica se l'utilizzo di BigQuery supera i limiti predefiniti. La tabella seguente contiene le impostazioni per creare una criterio di avviso. Puoi utilizzare le impostazioni nella tabella del riquadro di destinazione quando crei un grafico o utilizzi Esplora metriche.

| Nuova condizione Campo |

Valore |

|---|---|

| Risorsa e metrica | Nel menu Risorse, seleziona Set di dati BigQuery. Nel menu Categorie di metriche, seleziona Archiviazione. Seleziona una metrica dal menu Metriche. Le metriche specifiche per l'utilizzo includono Stored bytes, Uploaded bytes,

e Uploaded bytes billed. Per un elenco completo delle metriche disponibili, consulta

Metriche di BigQuery.

|

| Filtro | project_id: l' Google Cloud ID progetto. dataset_id: l'ID del set di dati. |

| Tra le serie temporali Raggruppa serie temporali per |

dataset_id: l'ID del set di dati. |

| Tra le serie temporali Aggregazione serie temporali |

sum |

| Finestra temporale continua | 1 m |

| Funzione finestra temporale continua | mean |

| Configura trigger di avviso Campo |

Valore |

|---|---|

| Tipo di condizione | Threshold |

| Trigger di avviso | Any time series violates |

| Posizione soglia | Above threshold |

| Valore di soglia | Sei tu a determinare il valore accettabile. |

| Finestra di ritest | 1 minute |

Passaggi successivi

Per configurare un sink, consulta Esportare le tracce.