In diesem Dokument wird beschrieben, wie Sie Logeinträge mit der Google Cloud Console abfragen, ansehen und analysieren. Dazu stehen Ihnen zwei Oberflächen zur Verfügung: der Log-Explorer und Observability Analytics. Mit beiden Oberflächen können Sie Logs abfragen, ansehen und analysieren. Sie verwenden jedoch unterschiedliche Abfragesprachen und haben unterschiedliche Funktionen:

Verwenden Sie den Log-Explorer zur Fehlerbehebung und zum Untersuchen von Logdaten.

Verwenden Sie Observability Analytics, um Ihre Log- und Tracedaten zu verknüpfen oder um Statistiken und Trends zu generieren.

Sie können Ihre Logs abfragen und Ihre Abfragen speichern, indem Sie Logging API-Befehle ausgeben. Sie können Ihre Logs auch mit der Google Cloud CLIabfragen.

Log-Explorer verwenden

Der Log-Explorer wurde entwickelt, um Sie bei der Fehlerbehebung und der Analyse der Leistung Ihrer Dienste und Anwendungen zu unterstützen. Ein Histogramm zeigt beispielsweise die Fehlerrate an. Wenn Sie einen Anstieg der Fehler oder etwas Interessantes sehen, können Sie die entsprechenden Logeinträge suchen und ansehen. Wenn ein Logeintrag mit einer Fehlergruppe verknüpft ist, wird er mit einem Menü mit Optionen versehen, über das Sie auf weitere Informationen zur Fehlergruppe zugreifen können.

Dieselbe Abfragesprache wird von der Cloud Logging API, der Google Cloud CLI, und dem Log-Explorer unterstützt. Um die Erstellung von Abfragen zu vereinfachen, wenn Sie den Log-Explorer verwenden, können Sie Abfragen erstellen über Menüs, durch Eingabe von Text und in einigen Fällen über Optionen, die bei der Anzeige eines einzelnen Logeintrags enthalten sind.

Der Log-Explorer unterstützt keine Aggregatvorgänge wie das Zählen der Anzahl von Logeinträgen, die ein bestimmtes Muster enthalten. Wenn Sie Aggregatvorgänge ausführen möchten, aktivieren Sie die Analyse für den Log-Bucket und verwenden Sie dann Observability Analytics.

Weitere Informationen zum Suchen und Ansehen von Logs mit dem Log-Explorer finden Sie unter Logs mit dem Log-Explorer aufrufen.

Observability Analytics kennenlernen

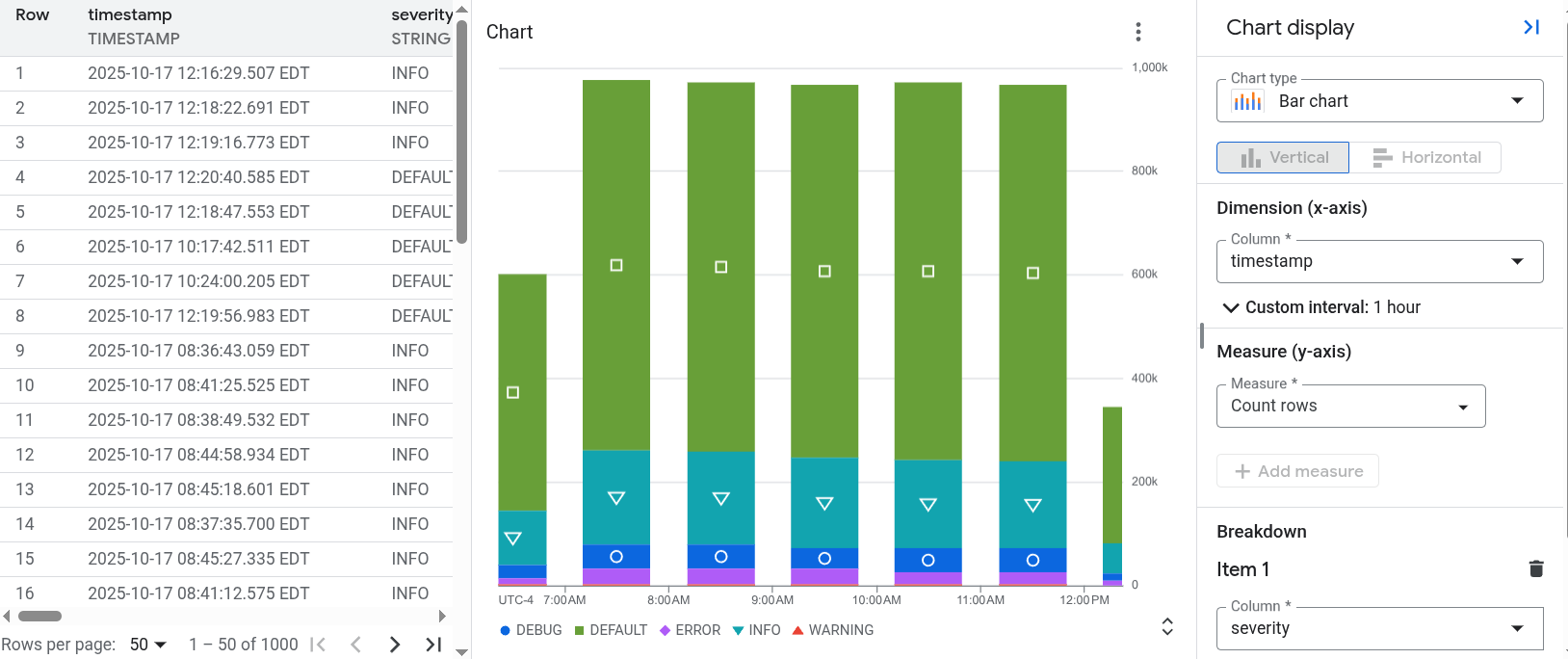

Mit Observability Analytics können Sie Statistiken generieren, indem Sie Abfragen ausführen, die Ihre Logdaten gruppieren und aggregieren. Diese Statistiken können Ihnen helfen, die Zeit zu verkürzen, die Sie für die Fehlerbehebung benötigen. Sie können sich die Abfrageergebnisse in einer Tabelle, einem Diagramm oder beidem ansehen. Diagramme können Ihnen helfen, Muster und Trends in Ihren Logdaten zu erkennen. Der folgende Screenshot zeigt beispielsweise ein Abfrageergebnis, das als Tabelle und Diagramm angezeigt wird:

Observability Analytics unterstützt Folgendes:

Logdaten gruppieren und aggregieren.

Sie können beispielsweise eine SQL-Abfrage ausführen, die Logeinträge nach Stunde gruppiert und dann für jede Gruppe die durchschnittliche Latenz für HTTP-Anfragen berechnet, die an eine bestimmte URL gesendet wurden.

SQL-Abfragen, die die Pipe-Syntax verwenden.

Abfragen von Logansichten und Analyseansichten.

Logansichten haben ein vom System definiertes Schema. Sie definieren das Schema für Analyseansichten.

Joins von Log- und Tracedaten.

Informationen zum Abfragen Ihrer Tracedaten, siehe Traces abfragen und analysieren.

Mit Cloud Logging können Sie Ihre Logdaten auch in BigQuery abfragen, ohne sie in BigQuery zu exportieren. Nachdem Sie Ihren Log-Bucket für die Verwendung von Observability Analytics aktualisiert haben, erstellen Sie ein verknüpftes Dataset. Sie können das verknüpfte Dataset mit BigQuery-Diensten abfragen.

Das Upgrade eines Log-Buckets wirkt sich nicht auf die Verwendung des Log-Explorers aus. Für den Log-Explorer müssen Ihre Logdaten nur in einem Log-Bucket gespeichert sein.

Beschränkungen

Für das Upgrade eines vorhandenen Log-Buckets zur Verwendung von Observability Analytics gelten die folgenden Einschränkungen:

- Der Log-Bucket wurde auf Google Cloud Projektebene erstellt.

- Der Log-Bucket ist entsperrt, es sei denn, es handelt sich um den

_RequiredBucket. - Es gibt keine ausstehenden Updates für den Bucket.

Logeinträge, die vor dem Upgrade eines Buckets geschrieben wurden, sind nicht sofort verfügbar. Nach Abschluss des Backfill-Vorgangs können Sie diese Logeinträge jedoch analysieren. Der Backfill-Vorgang kann mehrere Tage dauern.

Sie können die Seite Observability Analytics nicht verwenden, um Logansichten abzufragen, wenn für den Log-Bucket Zugriffssteuerungen auf Feldebene konfiguriert sind. Sie können jedoch Abfragen über die Log-Explorer Seite ausführen und ein verknüpftes BigQuery-Dataset abfragen. Da BigQuery Zugriffssteuerungen auf Feldebene nicht berücksichtigt, können Sie bei der Abfrage eines verknüpften Datasets alle Felder in den Logeinträgen abfragen.

Doppelte Logeinträge werden nicht entfernt, bevor eine Abfrage ausgeführt wird. Dieses Verhalten unterscheidet sich von der Abfrage von Logeinträgen mit dem Log-Explorer. Dort werden doppelte Einträge durch Vergleichen der Felder „Lognamen“, „Zeitstempel“ und „Einfüge-ID“ entfernt. Weitere Informationen finden Sie unter Fehlerbehebung: In meinen Observability Analytics-Ergebnissen sind doppelte Logeinträge vorhanden.

Einschränkungen für Joins

Für Joins von Ansichten gelten die folgenden Einschränkungen:

-

Die Speicherorte der Ansichten erfüllen eine der folgenden Bedingungen:

- Alle Ansichten haben denselben Speicherort.

- Alle Ansichten befinden sich entweder am Speicherort

globaloderus.

-

Wenn für Speicherressourcen kundenverwaltete Verschlüsselungsschlüssel (Customer Managed Encryption Keys, CMEK) verwendet werden, eine der folgenden Bedingungen erfüllt sein:

- Speicherressourcen, die CMEK verwenden, verwenden denselben Cloud KMS-Schlüssel.

- Speicherressourcen, die CMEK verwenden, haben einen gemeinsamen Vorfahren und dieser Vorfahre gibt einen Standard- Cloud KMS-Schlüssel an, der sich am selben Speicherort wie die Speicherressourcen befindet.

Wenn eine oder mehrere Speicherressourcen CMEK verwenden, verschlüsselt das System temporäre Daten, die durch den Join generiert werden, entweder mit dem gemeinsamen Cloud KMS-Schlüssel oder dem Standard-Cloud KMS-Schlüssel des Vorfahren.

Angenommen, Sie haben zwei Ansichten, die sich am selben Speicherort befinden. Dann können Sie diese Ansichten verknüpfen, wenn eine der folgenden Bedingungen erfüllt ist:

- Die Speicherressourcen verwenden keine CMEK.

- Eine Speicherressource verwendet CMEK und die andere nicht.

- Beide Speicherressourcen verwenden CMEK und denselben Cloud KMS-Schlüssel.

Beide Speicherressourcen verwenden CMEK, aber unterschiedliche Schlüssel. Die Ressourcen haben jedoch einen gemeinsamen Vorfahren, der einen Standard-Cloud KMS-Schlüssel angibt, der sich am selben Speicherort wie die Speicherressourcen befindet.

Angenommen, die Ressourcenhierarchie für einen Log-Bucket und einen Observability-Bucket umfasst dieselbe Organisation. Sie können Ansichten für diese Buckets verknüpfen, wenn Sie für diese Organisation, die Standardressourceneinstellungen für Cloud Logging und für Observability-Buckets mit demselben Standard-Cloud KMS-Schlüssel für den Speicherort konfiguriert haben.

Preise

Preisinformationen finden Sie auf der Seite Preise für Google Cloud Observability. Wenn Sie Logdaten an andere Google Cloud Dienste weiterleiten, finden Sie weitere Informationen in den folgenden Dokumenten:

Wenn Sie ein Upgrade eines Buckets zur Verwendung von Observability Analytics durchführen und dann ein verknüpftes Dataset erstellen, fallen keine BigQuery-Aufnahme- oder -Speicherkosten an. Wenn Sie ein verknüpftes Dataset für einen Log-Bucket erstellen, werden Ihre Logdaten nicht in BigQuery aufgenommen. Stattdessen erhalten Sie über das verknüpfte Dataset Lesezugriff auf die Logdaten, die in Ihrem Log-Bucket gespeichert sind.

BigQuery-Analysegebühren fallen an, wenn Sie SQL-Abfragen für verknüpfte BigQuery-Datasets ausführen, einschließlich der Verwendung der Seite BigQuery Studio, der BigQuery API und des BigQuery-Befehlszeilentools.

Blogs

Weitere Informationen zu Observability Analytics finden Sie in den folgenden Blogposts:

- Eine Übersicht über Observability Analytics finden Sie unter Observability Analytics in Cloud Logging is now GA.

- Informationen zum Erstellen von Diagrammen, die von Observability Analytics-Abfragen generiert werden, und zum Speichern dieser Diagramme in benutzerdefinierten Dashboards finden Sie unter Announcing Observability Analytics charts and dashboards in Cloud Logging in public preview.

- Informationen zum Analysieren von Audit-Logs mit Observability Analytics finden Sie unter Gleaning security insights from audit logs with Observability Analytics.

- Wenn Sie Logs an BigQuery weiterleiten und den Unterschied zwischen dieser Lösung und der Verwendung von Observability Analytics verstehen möchten, lesen Sie den BlogpostMoving to Observability Analytics for BigQuery export users.

Nächste Schritte

- Log-Bucket erstellen und für die Verwendung von Observability Analytics aktualisieren

- Vorhandenen Bucket für die Verwendung von Observability Analytics aktualisieren

Logs abfragen und ansehen:

Beispielabfragen: