Bereitgestellter Durchsatz (Provisioned Throughput, PT) ist ein Abo mit festen Kosten und fester Laufzeit, das in verschiedenen Laufzeiten verfügbar ist und Durchsatz auf der Gemini Enterprise Agent Platform reserviert. Um den Durchsatz zu reservieren, müssen Sie das Modell und die verfügbaren Standorte angeben, an denen das Modell ausgeführt wird.

Auf dieser Seite wird erläutert, wie Bereitgestellter Durchsatz funktioniert, wie Sie Überschreitungen steuern oder Bereitgestellter Durchsatz umgehen und wie Sie die Nutzung überwachen.

Wann sollte Provisioned Throughput verwendet werden?

Wenn einer der folgenden Punkte auf Ihren Anwendungsfall zutrifft, sollten Sie Provisioned Throughput verwenden:

- Ihre kritischen Arbeitslasten erfordern konstant einen hohen Durchsatz. Die Messung des Durchsatzes hängt vom Modell ab.

- Sie möchten Nutzern Ihrer Anwendungen eine konsistente und vorhersehbare Erfahrung bieten.

- Sie möchten deterministische Kosten für generative KI, indem Sie einen festen monatlichen oder wöchentlichen Preis bezahlen und die Überschreitung der Nutzungsgrenzen kontrollieren.

Bereitgestellter Durchsatz ist eine von mehreren Nutzungsoptionen für die Gemini Enterprise Agent Platform. Informationen zu allen Nutzungsoptionen finden Sie unter Nutzungsoptionen.

Funktionsweise von Bereitgestelltem Durchsatz

In diesem Abschnitt wird erläutert, wie Bereitgestellter Durchsatz funktioniert, indem die Kontingentprüfung während des Zeitraums für die Kontingenterzwingung verwendet wird.

Kontingentprüfung für bereitgestellten Durchsatz

Ihr maximales Kontingent für Bereitgestellten Durchsatz ist ein Vielfaches der Anzahl der gekauften Skalierungseinheiten der generativen KI (GSUs) und des Durchsatzes pro GSU. Sie wird jedes Mal geprüft, wenn Sie innerhalb Ihres Zeitraums für die Kontingentdurchsetzung eine Anfrage stellen. So wird das maximale Kontingent für den bereitgestellten Durchsatz durchgesetzt.

Wenn eine Anfrage eingeht, ist die tatsächliche Antwortgröße unbekannt. Da wir die Reaktionsgeschwindigkeit für Echtzeitanwendungen priorisieren, wird die Ausgabetoken-Größe durch den bereitgestellten Durchsatz geschätzt. Wenn der ursprüngliche Schätzwert das verfügbare maximale Kontingent für bereitgestellten Durchsatz überschreitet, wird die Anfrage als „Pay-as-you-go“ verarbeitet. Andernfalls wird sie als bereitgestellter Durchsatz verarbeitet. Dazu wird die ursprüngliche Schätzung mit Ihrem maximalen Kontingent für den bereitgestellten Durchsatz verglichen.

Wenn die Antwort generiert wird und die tatsächliche Größe des Ausgabetokens bekannt ist, werden die tatsächliche Nutzung und das Kontingent abgeglichen. Dazu wird die Differenz zwischen der Schätzung und der tatsächlichen Nutzung zu Ihrem verfügbaren Kontingent für den bereitgestellten Durchsatz hinzugefügt.

Zeiträume für die Durchsetzung des Kontingents für bereitgestellten Durchsatz

Bei der Gemini Enterprise Agent Platform wird ein dynamisches Zeitfenster verwendet, während das Kontingent für den bereitgestellten Durchsatz für Gemini-Modelle erzwungen wird. Das sorgt für optimale Stabilität bei Traffic, der zu Spitzen neigt. Anstelle eines festen Zeitraums wird das Kontingent auf der Agent Platform über einen flexiblen Zeitraum erzwungen, der sich automatisch anpasst, je nach Modelltyp und Anzahl der bereitgestellten GSUs. Daher kann es vorkommen, dass der priorisierte Traffic in einigen Fällen vorübergehend Ihr Kontingent pro Sekunde überschreitet. Sie dürfen Ihr Kontingent jedoch nicht über den gesamten Zeitraum überschreiten. Diese Zeiträume basieren auf der internen Uhrzeit der Agent Platform und sind unabhängig davon, wann Anfragen gestellt werden.

So funktioniert das Zeitfenster für die Kontingentdurchsetzung

Das Durchsetzungszeitfenster bestimmt, wie weit Sie Ihr Limit pro Sekunde überschreiten dürfen, bevor die Anfragen gedrosselt werden. Dieses Fenster wird automatisch angewendet. Beachten Sie, dass sich diese Zeiträume ändern können, um Leistung und Zuverlässigkeit zu optimieren.

Kleine GSU-Zuweisungen (3 GSUs oder weniger): Das Zeitfenster kann zwischen 40 und 120 Sekunden liegen, damit größere einzelne Anfragen ohne Unterbrechung verarbeitet werden können.

Wenn Sie beispielsweise 1 GSU von

gemini-2.5-flashkaufen, erhalten Sie einen durchschnittlichen kontinuierlichen Durchsatz von 2.690 Tokens pro Sekunde. Ihre Gesamtnutzung darf in einem beliebigen 120-Sekunden-Zeitraum 322.800 Tokens (2.690 Tokens pro Sekunde × 120 Sekunden) nicht überschreiten. Wenn Sie also eine Anfrage mit 70.000 Tokens pro Sekunde senden, die Gesamtnutzung über 120 Sekunden jedoch unter 322.800 Tokens bleibt, zählt der Burst von 70.000 Tokens pro Sekunde weiterhin als bereitgestellter Durchsatz, da die durchschnittliche Nutzung 2.690 Tokens pro Sekunde nicht überschreitet.Standardzuweisungen (mittelgroß) (mehr als 3 GSUs): Bei mittelgroßen GSU-Bereitstellungen (z. B. weniger als 50 GSUs) kann das Zeitfenster zwischen 5 und 30 Sekunden liegen. Die GSU-Grenzwerte und Kontextfenster variieren je nach Modell.

Wenn Sie beispielsweise 25 GSUs von

gemini-2.5-flashkaufen, erhalten Sie einen durchschnittlichen kontinuierlichen Durchsatz von 67.250 Tokens pro Sekunde (2.690 Tokens pro Sekunde × 25). Die Gesamtnutzung darf in einem beliebigen 30-Sekunden-Zeitraum 2.017.500 Tokens (67.250 Tokens pro Sekunde × 30 Sekunden) nicht überschreiten. Wenn Sie also eine Anfrage mit 1.000.000 Tokens pro Sekunde senden, die Gesamtnutzung über 30 Sekunden jedoch innerhalb von 2.017.500 Tokens bleibt, wird der Burst von 1.000.000 Tokens pro Sekunde weiterhin als bereitgestellter Durchsatz gezählt, da die durchschnittliche Nutzung 67.250 Tokens pro Sekunde nicht überschreitet.GSU-Zuweisungen mit hoher Präzision (im großen Maßstab): Bei GSU-Bereitstellungen im großen Maßstab (z. B. 50 GSUs oder mehr) kann das Zeitfenster zwischen 1 und 5 Sekunden liegen, damit Anfragen mit hoher Frequenz in der gesamten Infrastruktur mit maximaler Genauigkeit verarbeitet werden.

Wenn Sie beispielsweise 250 GSUs von

gemini-2.5-flashkaufen, erhalten Sie einen durchschnittlichen kontinuierlichen Durchsatz von 672.500 Tokens pro Sekunde (2.690 Tokens pro Sekunde × 250). Ihre Gesamtnutzung darf in einem beliebigen 5-Sekunden-Zeitraum 3.362.500 Tokens (672.500 Tokens pro Sekunde × 5 Sekunden) nicht überschreiten. Wenn Sie also eine Anfrage mit 5.000.000 Tokens pro Sekunde senden, wird sie nicht als bereitgestellter Durchsatz verarbeitet, da die Gesamtnutzung von 5.000.000 Tokens das Limit von 3.362.500 Tokens in einem 5-Sekunden-Zeitraum überschreitet. Eine Anfrage, die 1.000.000 Tokens pro Sekunde verwendet, kann hingegen als bereitgestellter Durchsatz verarbeitet werden, wenn die durchschnittliche Nutzung im 5-Sekunden-Zeitraum 672.500 Tokens pro Sekunde nicht überschreitet.

Überschreitungen steuern oder Provisioned Throughput umgehen

Mit der API können Sie Überschreitungen steuern, wenn Sie den gekauften Durchsatz überschreiten, oder Bereitgestellten Durchsatz pro Anfrage umgehen.

Lesen Sie sich die einzelnen Optionen durch, um herauszufinden, was Sie tun müssen, um Ihren Anwendungsfall zu erfüllen.

Standardverhalten

Wenn eine Anfrage das verbleibende Kontingent für Bereitgestellten Durchsatz überschreitet, wird die gesamte Anfrage standardmäßig als On-Demand-Anfrage verarbeitet und zum Pay-as-you-go-Tarif abgerechnet. In diesem Fall wird der Traffic in den Monitoring-Dashboards als Spillover angezeigt. Weitere Informationen zum Monitoring der Nutzung von Bereitgestelltem Durchsatz finden Sie unter Bereitgestellten Durchsatz überwachen.

Sobald Ihre Bestellung für Bereitgestellten Durchsatz aktiv ist, wird das Standardverhalten automatisch angewendet. Sie müssen Ihren Code nicht ändern, um Ihre Bestellung zu nutzen, solange Sie sie in der bereitgestellten Region nutzen.

Nur Provisioned Throughput verwenden

Wenn Sie Kosten verwalten, indem Sie On-Demand-Gebühren vermeiden, verwenden Sie nur Bereitgestellten Durchsatz.

Bei Anfragen, die den Bestellbetrag für Bereitgestellten Durchsatz überschreiten, wird der Fehler 429 zurückgegeben.

Wenn Sie Anfragen an die API senden, legen Sie den HTTP-Header X-Vertex-AI-LLM-Request-Type auf dedicated fest.

Nur „Pay as you go“ verwenden

Dies wird auch als „On-Demand-Nutzung“ bezeichnet. Anfragen umgehen den Bereitgestellten Durchsatz und werden direkt an Pay-as-you-go gesendet. Das kann für Tests oder Anwendungen in der Entwicklungsphase nützlich sein.

Wenn Sie Anfragen an die API senden, legen Sie den HTTP-Header X-Vertex-AI-LLM-Request-Type auf shared fest.

Beispiel

Python

Installieren

pip install --upgrade google-genai

Weitere Informationen finden Sie in der SDK-Referenzdokumentation.

Umgebungsvariablen für die Verwendung des Gen AI SDK mit Vertex AI festlegen:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=global export GOOGLE_GENAI_USE_VERTEXAI=True

Go

Informationen zum Installieren oder Aktualisieren von Go

Weitere Informationen finden Sie in der SDK-Referenzdokumentation.

Umgebungsvariablen für die Verwendung des Gen AI SDK mit Vertex AI festlegen:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=global export GOOGLE_GENAI_USE_VERTEXAI=True

Node.js

Installieren

npm install @google/genai

Weitere Informationen finden Sie in der SDK-Referenzdokumentation.

Umgebungsvariablen für die Verwendung des Gen AI SDK mit Vertex AI festlegen:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=global export GOOGLE_GENAI_USE_VERTEXAI=True

Java

Informationen zum Installieren oder Aktualisieren von Java

Weitere Informationen finden Sie in der SDK-Referenzdokumentation.

Umgebungsvariablen für die Verwendung des Gen AI SDK mit Vertex AI festlegen:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=global export GOOGLE_GENAI_USE_VERTEXAI=True

REST

Nachdem Sie Ihre Umgebung eingerichtet haben, können Sie mit REST einen Text-Prompt testen. Im folgenden Beispiel wird eine Anfrage an den Publisher gesendet Modellendpunkt zu erstellen.

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

-H "X-Vertex-AI-LLM-Request-Type: dedicated" \ # Options: dedicated, shared

$URL \

-d '{"contents": [{"role": "user", "parts": [{"text": "Hello."}]}]}'

Bereitgestellter Durchsatz mit einem API-Schlüssel verwenden

Wenn Sie bereitgestellten Durchsatz für ein bestimmtes Projekt, Google-Modell und eine bestimmte Region erworben haben und ihn verwenden möchten, um eine Anfrage mit einem API-Schlüssel zu senden, müssen Sie die Projekt-ID, das Modell, den Standort und den API-Schlüssel als Parameter in Ihre Anfrage aufnehmen.

Informationen zum Erstellen eines Google Cloud API-Schlüssels, der an ein Dienstkonto gebunden ist, finden Sie unter Google Cloud API-Schlüssel abrufen. Informationen zum Senden von Anfragen an die Gemini API mit einem API-Schlüssel finden Sie in der Kurzanleitung für die Gemini API in der Gemini Enterprise Agent Platform.

Das folgende Beispiel zeigt, wie Sie eine Anfrage mit einem API-Schlüssel senden, wenn Sie bereitgestellten Durchsatz verwenden:

REST

Nachdem Sie Ihre Umgebung eingerichtet haben, können Sie mit REST einen Text-Prompt testen. Im folgenden Beispiel wird eine Anfrage an den Publisher gesendet Modellendpunkt zu erstellen.

curl \

-X POST \

-H "Content-Type: application/json" \

"https://aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/MODEL_ID:generateContent?key=YOUR_API_KEY" \

-d $'{

"contents": [

{

"role": "user",

"parts": [

{

"text": "Explain how AI works in a few words"

}

]

}

]

}'

Provisioned Throughput überwachen

Sie können die Nutzung von Bereitgestellter Durchsatz mithilfe einer Reihe von Messwerten selbst überwachen, die für den Ressourcentyp aiplatform.googleapis.com/PublisherModel erfasst werden.

Die Überwachung des Bereitgestellten Durchsatz-Traffics ist eine Funktion in der öffentlichen Vorschau.

Dimensionen

Sie können Messwerte mit den folgenden Dimensionen filtern:

| Dimension | Werte |

|---|---|

type |

inputoutput |

request_type |

|

Pfadpräfix

Das Pfadpräfix für einen Messwert ist aiplatform.googleapis.com/publisher/online_serving.

Der vollständige Pfad für den Messwert /consumed_throughput ist beispielsweise aiplatform.googleapis.com/publisher/online_serving/consumed_throughput.

Messwerte

Die folgenden Cloud Monitoring-Messwerte sind für die Ressource aiplatform.googleapis.com/PublisherModel für die Gemini-Modelle verfügbar. Verwenden Sie die Anfragetypen dedicated, um nach der Nutzung von Bereitgestelltem Durchsatz zu filtern.

| Messwert | Anzeigename | Beschreibung |

|---|---|---|

/dedicated_gsu_limit |

Limit (GSU) | Dediziertes Limit in GSUs. Mit diesem Messwert können Sie das maximale Kontingent für bereitgestellten Durchsatz in GSUs ermitteln. |

/tokens |

Tokens | Verteilung der Anzahl der Eingabe- und Ausgabetokens. |

/token_count |

Tokenanzahl | Anzahl der gesammelten Eingabe- und Ausgabetokens. |

/consumed_token_throughput |

Token-Durchsatz | Durchsatznutzung, bei der die Abnahmerate in Tokens berücksichtigt und das Kontingent abgeglichen wird. Weitere Informationen finden Sie unter Kontingentprüfung für Bereitgestellten Durchsatz. Mit diesem Messwert können Sie nachvollziehen, wie Ihr Kontingent für Bereitgestellten Durchsatz genutzt wurde. |

/dedicated_token_limit |

Limit (Tokens pro Sekunde) | Dediziertes Limit in Tokens pro Sekunde. Mit diesem Messwert können Sie das maximale Kontingent für den bereitgestellten Durchsatz für tokenbasierte Modelle ermitteln. |

/characters |

Zeichen | Verteilung der Anzahl der Eingabe- und Ausgabezeichen. |

/character_count |

Anzahl der Zeichen | Anzahl der Zeichen für Eingabe und Ausgabe insgesamt. |

/consumed_throughput |

Zeichendurchsatz | Die Nutzung des Durchsatzes, die die Abnahmerate in Zeichen berücksichtigt und die Kontingentabstimmung Kontingentprüfung für Bereitgestellten Durchsatz umfasst. Mit diesem Messwert können Sie nachvollziehen, wie Ihr Kontingent für Bereitgestellten Durchsatz genutzt wurde. Bei tokenbasierten Modellen entspricht dieser Messwert dem in Tokens verbrauchten Durchsatz multipliziert mit 4. |

/dedicated_character_limit |

Limit (Zeichen pro Sekunde) | Ein dediziertes Limit in Zeichen pro Sekunde. Mit diesem Messwert können Sie das maximale Kontingent für bereitgestellten Durchsatz für zeichenbasierte Modelle ermitteln. |

/model_invocation_count |

Anzahl der Modellaufrufe | Anzahl der Modellaufrufe (Vorhersageanfragen). |

/model_invocation_latencies |

Latenzen beim Modellaufruf | Latenz beim Modellaufruf (Vorhersagelatenz). |

/first_token_latencies |

Latenzen für das erste Token | Dauer vom Empfang der Anfrage bis zur Rückgabe des ersten Tokens. |

Anthropic-Modelle haben auch einen Filter für den bereitgestellten Durchsatz, aber nur für tokens und token_count.

Dashboards

Standard-Monitoring-Dashboards für Bereitgestellter Durchsatz enthalten Messwerte, mit denen Sie Ihre Nutzung und die Nutzung von Bereitgestellter Durchsatz besser nachvollziehen können. So greifen Sie auf die Dashboards zu:

Rufen Sie in der Google Cloud Console die Seite Bereitgestellter Durchsatz auf.

Wenn Sie die Auslastung des bereitgestellten Durchsatzes jedes Modells in Ihren Bestellungen aufrufen möchten, wählen Sie den Tab Zusammenfassung der Auslastung aus.

In der Tabelle Auslastung des bereitgestellten Durchsatzes nach Modell sehen Sie für den ausgewählten Zeitraum Folgendes:

Gesamtzahl der GSU-Konten, die Sie hatten.

Spitzendurchsatznutzung in GSU.

Die durchschnittliche GSU-Nutzung.

Die Anzahl der Fälle, in denen Sie das Limit für den bereitgestellten Durchsatz erreicht haben.

Wählen Sie ein Modell aus der Tabelle Auslastung des bereitgestellten Durchsatzes nach Modell aus, um weitere Messwerte für das ausgewählte Modell aufzurufen.

Monitoring-Dashboards interpretieren

Bereitgestellter Durchsatz prüft das verfügbare Kontingent in Echtzeit auf Millisekundenebene für Anfragen, die gestellt werden. Diese Daten werden jedoch mit einem fortlaufenden Zeitraum für die Kontingentdurchsetzung verglichen, der auf der internen Uhrzeit der Agent Platform basiert. Dieser Vergleich ist unabhängig davon, wann die Anfragen gestellt werden. In den Monitoring-Dashboards werden Nutzungsmesswerte nach der Quotenabstimmung angezeigt. Diese Messwerte werden jedoch aggregiert, um auf Grundlage des ausgewählten Zeitraums Durchschnittswerte für die Dashboard-Abstimmungszeiträume zu erhalten. Der niedrigste Detaillierungsgrad, der von den Monitoring-Dashboards unterstützt wird, ist die Minute. Außerdem unterscheidet sich die Uhrzeit für die Monitoring-Dashboards von der der Agent-Plattform.

Diese Zeitunterschiede können gelegentlich zu Abweichungen zwischen den Daten in den Monitoring-Dashboards und der Echtzeitleistung führen. Das kann folgende Gründe haben:

Das Kontingent wird in Echtzeit durchgesetzt, in den Monitoring-Diagrammen werden die Daten jedoch je nach dem im Monitoring-Dashboard angegebenen Zeitraum in durchschnittlichen Dashboard-Abstimmungszeiträumen von einer Minute oder mehr zusammengefasst.

Die Agent-Plattform und die Monitoring-Dashboards verwenden unterschiedliche Systemuhren.

Wenn in einem Zeitraum von einer Sekunde ein Traffic-Burst Ihr Kontingent für den bereitgestellten Durchsatz basierend auf dem Zeitraum für die Durchsetzung überschreitet, wird die gesamte Anfrage als Spillover-Traffic verarbeitet. Die Gesamtauslastung des bereitgestellten Durchsatzes kann jedoch niedrig erscheinen, wenn die Monitoring-Daten für diese Sekunde innerhalb des 1-minütigen Ausrichtungszeitraums gemittelt werden, da die durchschnittliche Auslastung über den gesamten Ausrichtungszeitraum möglicherweise nicht 100 % überschreitet. Wenn Sie Spillover-Traffic sehen, bedeutet das, dass Ihr Kontingent für den bereitgestellten Durchsatz während des Kontingentdurchsetzungszeitraums, in dem diese spezifischen Anfragen gestellt wurden, vollständig genutzt wurde. Dies gilt unabhängig von der durchschnittlichen Auslastung, die in den Monitoring-Dashboards angezeigt wird.

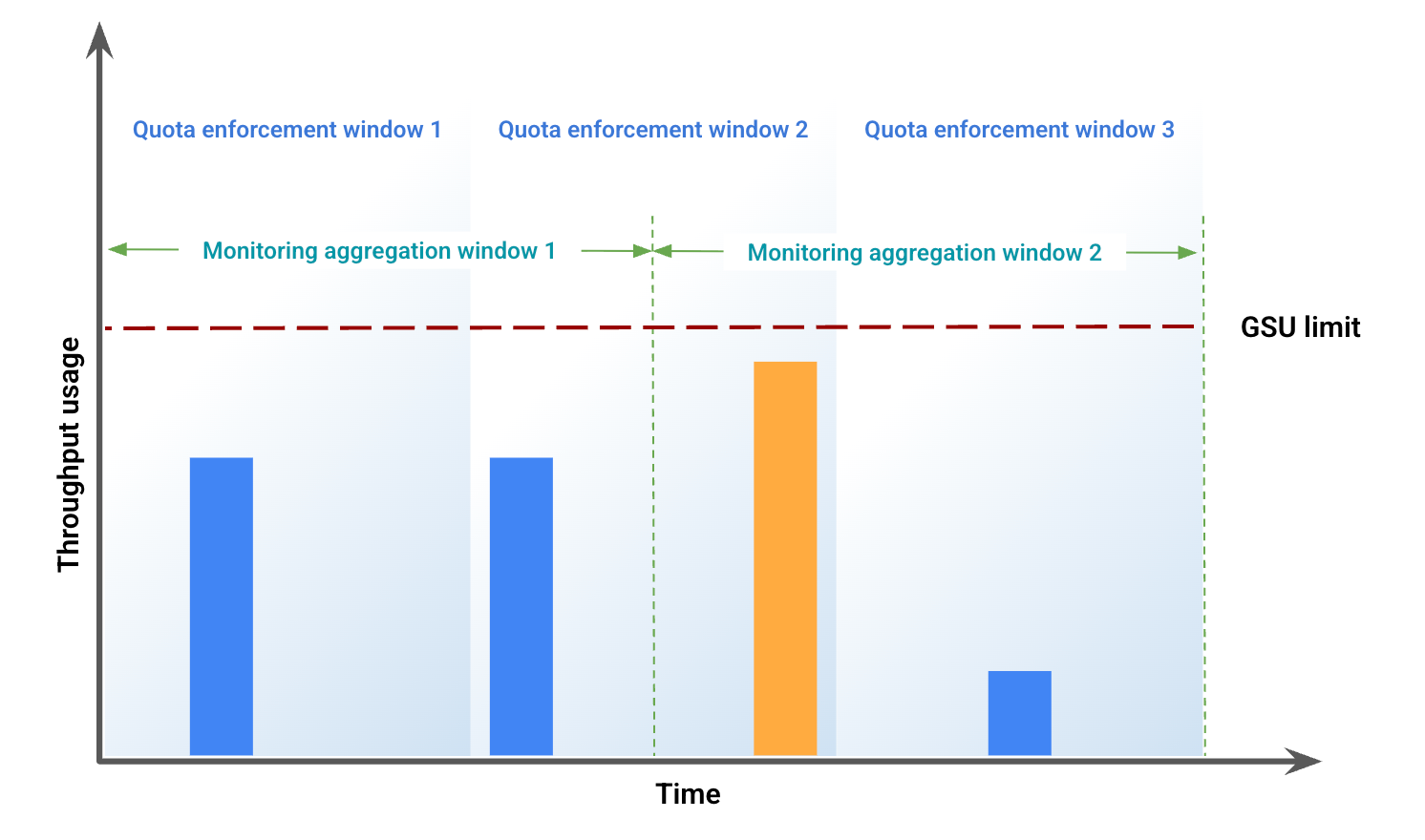

Beispiel für eine potenzielle Diskrepanz bei Monitoring-Daten

In diesem Beispiel werden einige der Abweichungen veranschaulicht, die durch eine falsche Ausrichtung des Zeitraums entstehen. Abbildung 1 zeigt die Durchsatznutzung über einen bestimmten Zeitraum. In dieser Abbildung:

Die blauen Balken stellen den Traffic dar, der als bereitgestellter Durchsatz zugelassen wurde.

Der orangefarbene Balken steht für Traffic, der die Nutzung über das GSU-Limit hinaus treibt und als Spillover verarbeitet wird.

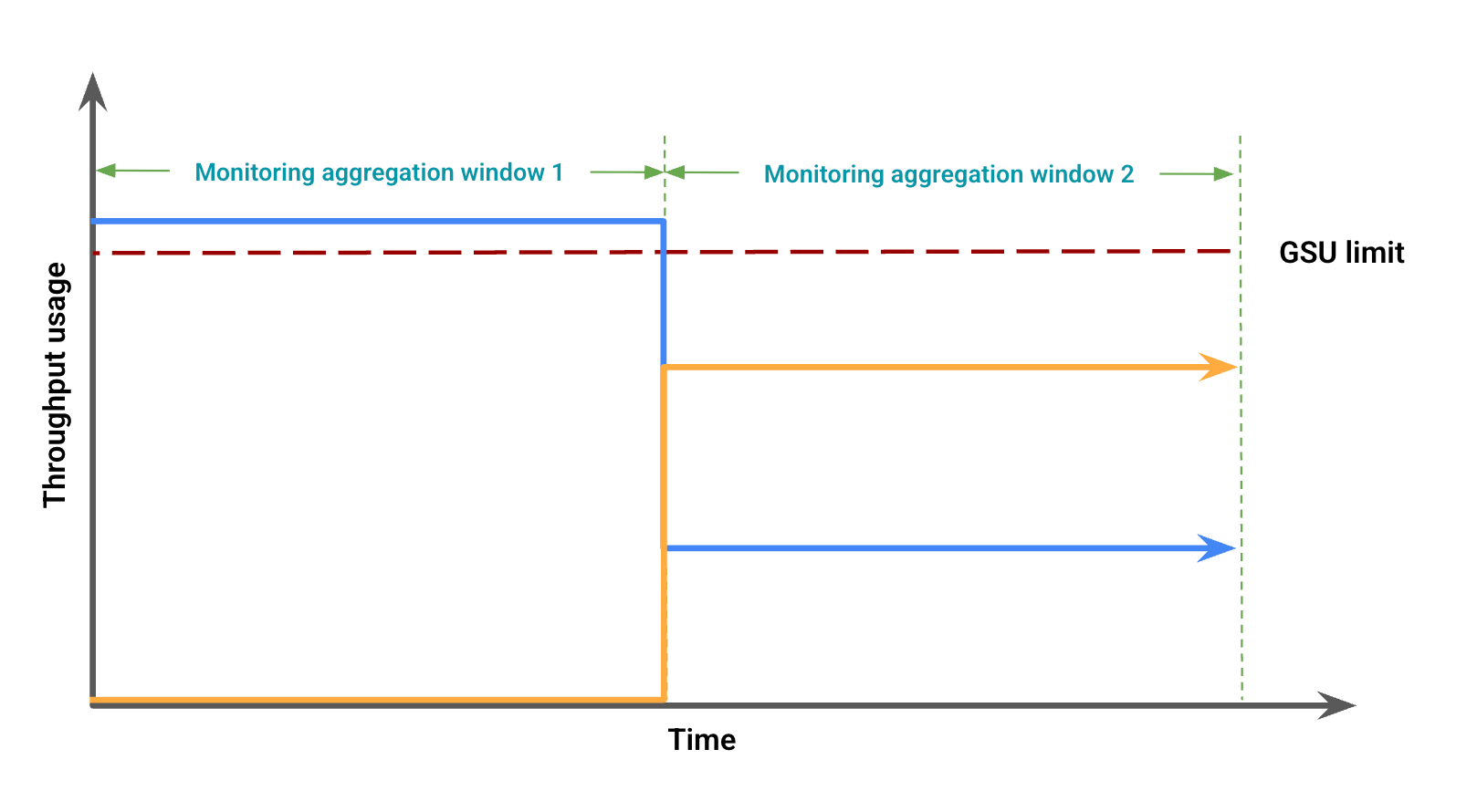

Abbildung 2 zeigt mögliche visuelle Abweichungen aufgrund von Fensterungsfehlern, die auf der Durchsatznutzung basieren. In dieser Abbildung:

Die blaue Linie steht für Traffic mit bereitgestelltem Durchsatz.

Die orangefarbene Linie steht für Spillover-Traffic.

In diesem Fall werden in den Überwachungsdaten möglicherweise die Nutzung des bereitgestellten Durchsatzes ohne Überschreitung für einen Überwachungsaggregationszeitraum angezeigt, während gleichzeitig die Nutzung des bereitgestellten Durchsatzes unter dem GSU-Limit mit einer Überschreitung in einem anderen Überwachungsaggregationszeitraum beobachtet wird.

Fehlerbehebung bei Monitoring-Dashboards

So können Sie unerwartete Spillover in Ihren Dashboards oder 429-Fehler beheben:

Vergrößern: Legen Sie den Zeitraum für Ihr Dashboard auf maximal 12 Stunden fest, um den kleinsten Ausrichtungszeitraum von 1 Minute zu erhalten. Bei großen Zeiträumen werden Spitzen, die zu einer Drosselung führen, ausgeglichen und die Durchschnittswerte für den Abstimmungszeitraum steigen.

Gesamt-Traffic prüfen: In den modellbezogenen Dashboards werden dedizierter und Spillover-Traffic als zwei separate Linien dargestellt. Das kann zu dem falschen Schluss führen, dass das Kontingent für den bereitgestellten Durchsatz nicht vollständig genutzt wird und vorzeitig auf Spillover-Traffic umgestellt wird. Wenn Ihr Traffic das verfügbare Kontingent überschreitet, wird die gesamte Anfrage als Spillover verarbeitet. Eine weitere hilfreiche Visualisierung erhalten Sie, wenn Sie dem Dashboard mithilfe des Metrics Explorer eine Abfrage hinzufügen und den Token-Durchsatz für das jeweilige Modell und die jeweilige Region einbeziehen. Fügen Sie keine zusätzlichen Aggregationen oder Filter hinzu, um den gesamten Traffic für alle Traffictypen (dediziert, Spillover und gemeinsam genutzt) zu sehen.

Genmedia-Modelle überwachen

Die Überwachung des bereitgestellten Durchsatzes ist bei Veo 3-Modellen nicht verfügbar.

Benachrichtigungen

Nachdem Sie Benachrichtigungen aktiviert haben, können Sie Standardbenachrichtigungen einrichten, um die Nutzung Ihres Traffics zu verwalten.

Benachrichtigungen aktivieren

So aktivieren Sie Benachrichtigungen im Dashboard:

Rufen Sie in der Google Cloud Console die Seite Bereitgestellter Durchsatz auf.

Wenn Sie die Auslastung des bereitgestellten Durchsatzes jedes Modells in Ihren Bestellungen aufrufen möchten, wählen Sie den Tab Zusammenfassung der Auslastung aus.

Wählen Sie Empfohlene Benachrichtigungen aus. Die folgenden Benachrichtigungen werden angezeigt:

Provisioned Throughput Usage Reached LimitProvisioned Throughput Utilization Exceeded 80%Provisioned Throughput Utilization Exceeded 90%

Sehen Sie sich die Benachrichtigungen an, die Ihnen helfen, Ihren Traffic zu verwalten.

Weitere Details zu Benachrichtigungen ansehen

So rufen Sie weitere Informationen zu Benachrichtigungen auf:

Rufen Sie die Seite Integrationen auf.

Geben Sie im Feld Filter vertex ein und drücken Sie die Eingabetaste. Die Google Gemini Enterprise Agent Platform wird angezeigt.

Wenn Sie weitere Informationen aufrufen möchten, klicken Sie auf Details ansehen. Der Bereich Google Gemini Enterprise Agent Platform details (Details zur Google Gemini Enterprise Agent Platform) wird angezeigt.

Wählen Sie den Tab Benachrichtigungen und dann eine Vorlage für eine Benachrichtigungsrichtlinie aus.