En este documento, usarás los siguientes componentes facturables de Google Cloud:

- Managed Service for Apache Spark

- Compute Engine

- Managed Airflow

Para generar una estimación de costos en función del uso previsto,

usa la calculadora de precios.

Antes de comenzar

Configura tu proyecto

- Accede a tu Google Cloud cuenta de. Si eres nuevo en Google Cloud, crea una cuenta para evaluar el rendimiento de nuestros productos en situaciones reales. Los clientes nuevos también obtienen $300 en créditos gratuitos para ejecutar, probar y, además, implementar cargas de trabajo.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc, Compute Engine, and Managed Airflow APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

Instala Google Cloud CLI.

-

Si usas un proveedor de identidad externo (IdP), primero debes acceder a la gcloud CLI con tu identidad federada.

-

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc, Compute Engine, and Managed Airflow APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

Instala Google Cloud CLI.

-

Si usas un proveedor de identidad externo (IdP), primero debes acceder a la gcloud CLI con tu identidad federada.

-

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init

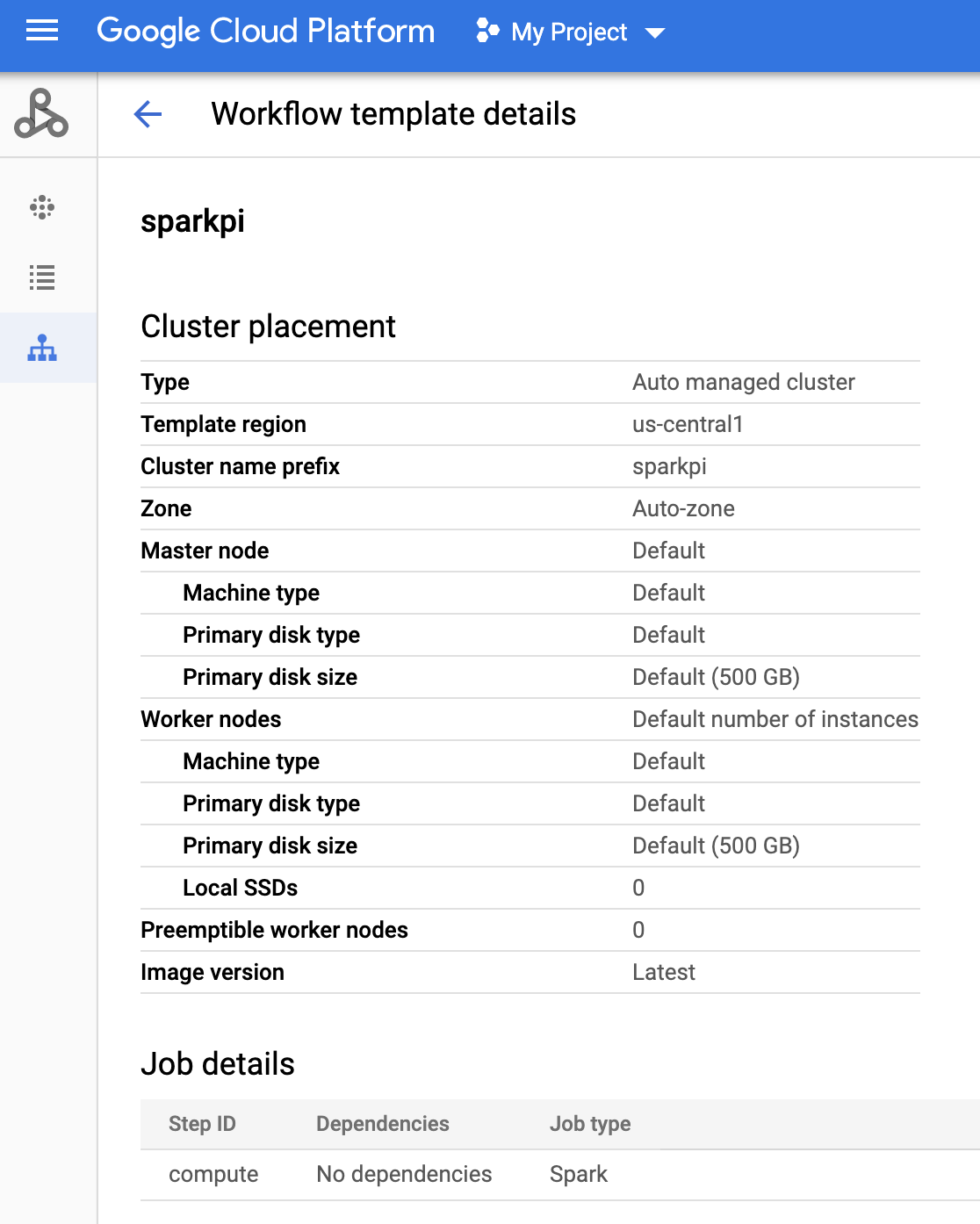

Crea una plantilla de flujo de trabajo de Managed Service para Apache Spark

Copia y ejecuta los siguientes comandos en una ventana de la terminal local o en Cloud Shell para crear y definir una plantilla de flujo de trabajo.

- Crea la plantilla de flujo de trabajo

sparkpi.gcloud dataproc workflow-templates create sparkpi \ --region=us-central1 - Agrega el trabajo de Spark a la plantilla de flujo de trabajo.

sparkpiLa marcastep-idde “compute” identifica el trabajo de SparkPi.gcloud dataproc workflow-templates add-job spark \ --workflow-template=sparkpi \ --step-id=compute \ --class=org.apache.spark.examples.SparkPi \ --jars=file:///usr/lib/spark/examples/jars/spark-examples.jar \ --region=us-central1 \ -- 1000 - Usa un clúster administrado,

de un solo nodo

para ejecutar el flujo de trabajo. Managed Service para Apache Spark creará el clúster, ejecutará el flujo de trabajo en él y, luego, borrará el clúster cuando este se complete.

gcloud dataproc workflow-templates set-managed-cluster sparkpi \ --cluster-name=sparkpi \ --single-node \ --region=us-central1 - Confirma la creación de la plantilla de flujo de trabajo.

Console

Haz clic en el nombre

sparkpien la página Flujos de trabajo de Managed Service para Apache Spark en la consola de para abrir la página Detalles de la plantilla de flujo de trabajo. Google Cloud Haz clic en el nombre de tu plantilla de flujo de trabajo para confirmar los atributos de la plantillasparkpi.

Comando de gcloud

Ejecuta el siguiente comando:

gcloud dataproc workflow-templates describe sparkpi --region=us-central1

Crea y sube un DAG a Cloud Storage

- Crea o usa un entorno existente de Managed Airflow.

- Configurar variables de entorno

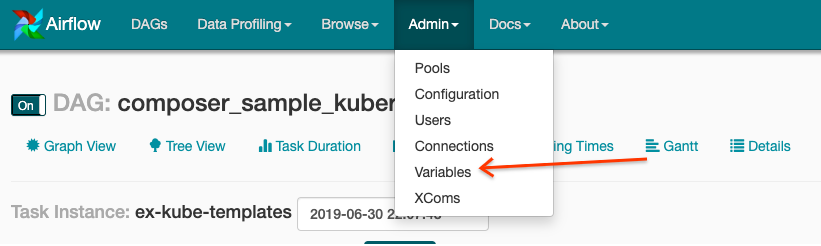

IU de Airflow

- En la barra de herramientas, haz clic en Administrador > Variables.

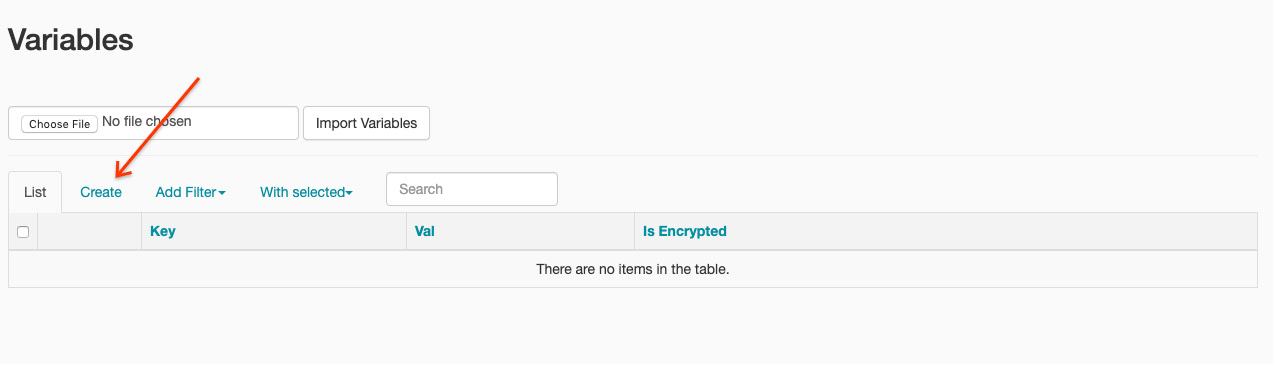

- Haz clic en Crear.

- Ingresa la siguiente información:

- Key:

project_id - Val: PROJECT_ID : Es el ID de tu Google Cloud proyecto de

- Key:

- Haz clic en Guardar.

Comando de gcloud

Ingresa los siguientes comandos:

ENVIRONMENTes el nombre del entorno de Managed AirflowLOCATIONes la región en la que se encuentra el entorno de Managed Airflow .PROJECT_IDes el ID del proyecto que contiene el entorno de Managed Airflow.

gcloud composer environments run ENVIRONMENT --location LOCATION variables set -- project_id PROJECT_ID - En la barra de herramientas, haz clic en Administrador > Variables.

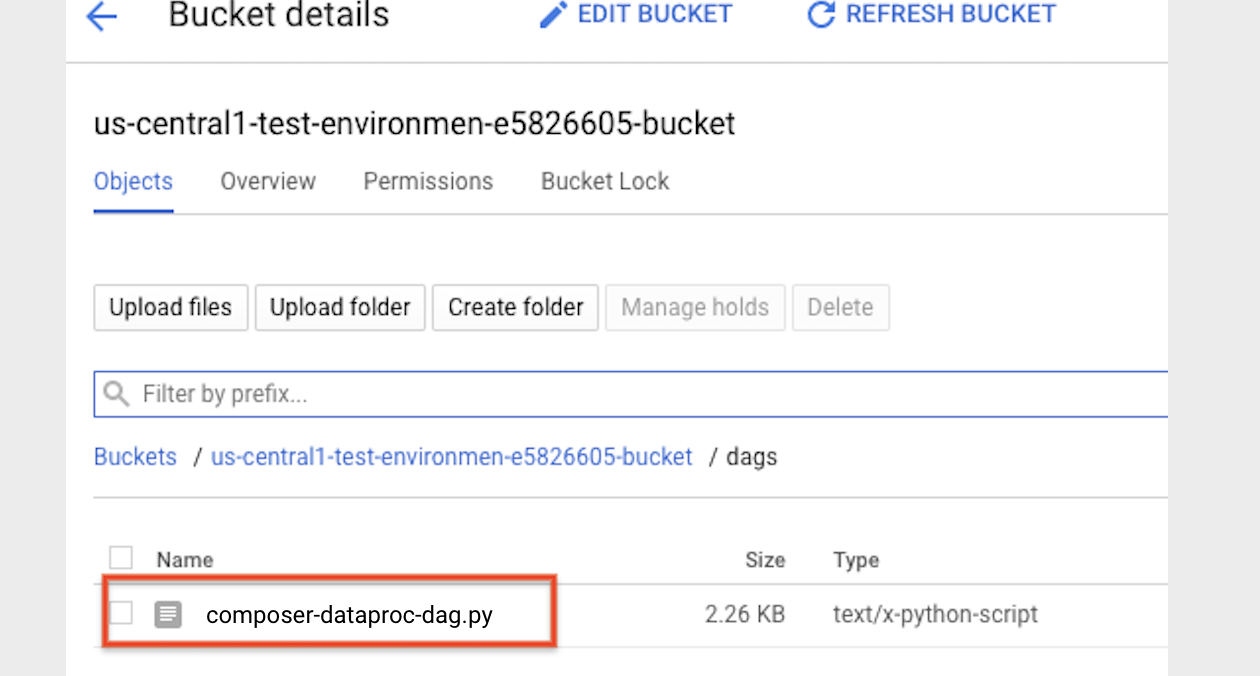

- Copia el siguiente código de DAG de forma local en un archivo llamado "composer-dataproc-dag.py",

que usa el

DataprocInstantiateWorkflowTemplateOperator.

Airflow 2

Airflow 1

- Sube tu

DAG a tu carpeta de entorno en Cloud Storage. Una vez que la carga se haya

completado de forma correcta, haz clic en el vínculo Carpeta de DAG

en la página del entorno de Managed Airflow.

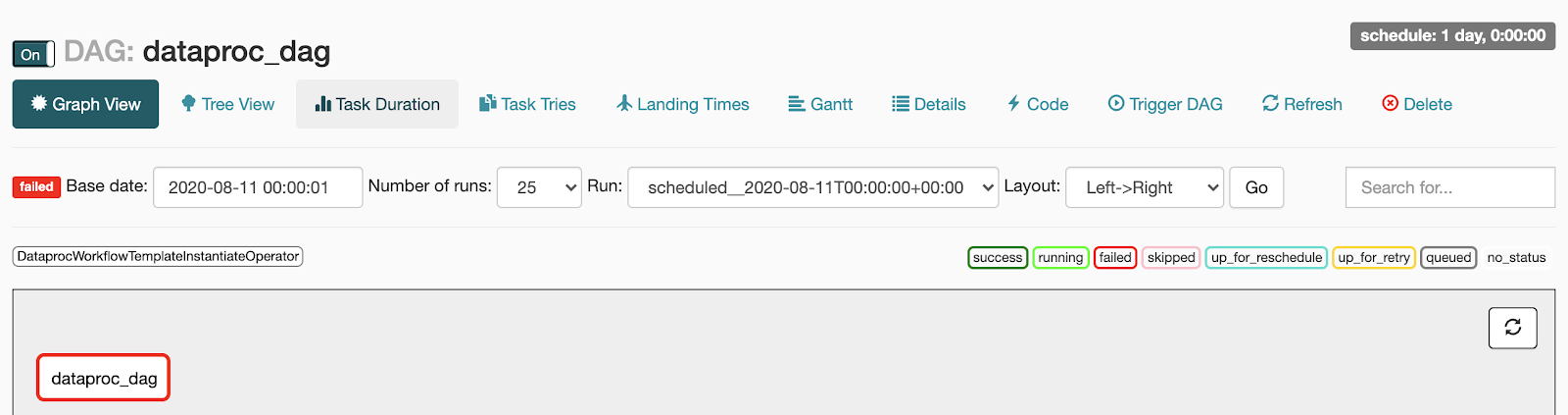

Visualiza el estado de una tarea

IU de Airflow

- Abre la interfaz web de Airflow.

- En la página de los DAG, haz clic en el nombre del DAG (por ejemplo,

dataproc_workflow_dag). - En la página de detalles de los DAG, haz clic en Graph View.

- Verifica el estado:

- Tarea con errores: la tarea estará encerrada en un cuadro rojo. También puedes mantener el puntero sobre la tarea y ver si aparece el mensaje Estado: con errores.

También puedes mantener el puntero sobre la tarea y ver si aparece el mensaje Estado: con errores.

- Éxito: La tarea tiene un cuadro verde a su alrededor.

También puedes mantener el puntero sobre la tarea y ver si aparece el mensaje Estado: correcto.

- Tarea con errores: la tarea estará encerrada en un cuadro rojo. También puedes mantener el puntero sobre la tarea y ver si aparece el mensaje Estado: con errores.

También puedes mantener el puntero sobre la tarea y ver si aparece el mensaje Estado: con errores.

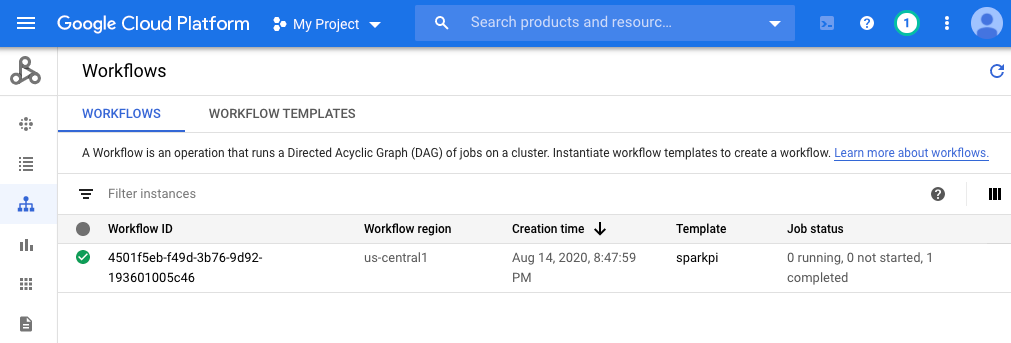

Console

Haz clic en la pestaña Flujos de trabajo para ver el estado del flujo de trabajo.

Comando de gcloud

gcloud dataproc operations list \

--region=us-central1 \

--filter="labels.goog-dataproc-workflow-template-id=sparkpi"

Limpia

Para evitar que se apliquen cargos a tu Google Cloud cuenta de, puedes borrar los recursos que usaste en este instructivo:

¿Qué sigue?

- Consulta Descripción general de las plantillas de flujo de trabajo de Managed Service para Apache Spark.

- Consulta Soluciones de programación del flujo de trabajo.