In diesem Dokument wird beschrieben, wie Sie die Datenherkunft für Ihre Managed Service for Apache Spark-Spark-Jobs entweder auf Projekt- oder Clusterebene aktivieren.

Die Datenherkunft ist ein Dataplex Universal Catalog-Feature, mit dem Sie verfolgen können, wie sich Daten durch Ihre Systeme bewegen – woher sie kommen, wohin sie übergeben werden und welche Transformationen auf sie angewendet werden.

Die Datenherkunft ist für alle Managed Service for Apache Spark-Spark-Jobs verfügbar, mit Ausnahme von SparkR- und Spark-Streaming-Jobs. Sie unterstützt BigQuery- und Cloud Storage-Datenquellen. Es ist in den Image-Versionen 2.0.74+, 2.1.22+, 2.2.50+, 2.3.1+ und 3.0 von Managed Service for Apache Spark enthalten.

Nachdem Sie die Funktion in Ihrem Managed Service for Apache Spark-Cluster aktiviert haben, werden in Managed Service for Apache Spark-Spark-Jobs Daten-Lineage-Ereignisse erfasst und in der Data Lineage API des Dataplex Universal Catalog veröffentlicht. Managed Service for Apache Spark wird über OpenLineage in die Data Lineage API eingebunden. Dazu wird das OpenLineage Spark-Plug-in verwendet.

Sie können über Dataplex Universal Catalog auf Informationen zur Datenherkunft zugreifen. Dazu haben Sie folgende Möglichkeiten:

Hinweis

Wählen Sie in der Google Cloud Console auf der Projektauswahlseite das Projekt aus, das den Managed Service for Apache Spark-Cluster enthält, für den Sie die Herkunft verfolgen möchten.

Aktivieren Sie die Data Lineage API.

Anstehende Änderungen an der Spark-Datenherkunft: In den Versionshinweisen für Managed Service for Apache Spark finden Sie die Ankündigung einer Änderung, durch die die Spark-Datenherkunft automatisch für Ihre Projekte und Cluster verfügbar wird, wenn Sie die Data Lineage API aktivieren (siehe Erfassung der Herkunft für einen Dienst steuern). Zusätzliche Einstellungen auf Projekt- oder Clusterebene sind dann nicht erforderlich.

Erforderliche Rollen

Wenn Sie einen Managed Service for Apache Spark-Cluster mit dem Standard-VM-Dienstkonto erstellen, hat er die Rolle Managed Service for Apache Spark Worker, die die Datenherkunft ermöglicht. Sie müssen nichts weiter unternehmen.

Wenn Sie jedoch einen Managed Service for Apache Spark-Cluster erstellen, der ein benutzerdefiniertes Dienstkonto verwendet, müssen Sie dem benutzerdefinierten Dienstkonto eine erforderliche Rolle zuweisen, um die Datenherkunft im Cluster zu aktivieren. Das wird im folgenden Absatz beschrieben.

Bitten Sie Ihren Administrator, Ihnen die folgenden IAM-Rollen für das benutzerdefinierte Dienstkonto Ihres Clusters zuzuweisen, um die Berechtigungen zu erhalten, die Sie zur Verwendung von Datenherkunft mit Managed Service for Apache Spark benötigen:

-

Weisen Sie eine der folgenden Rollen zu:

-

Managed Service for Apache Spark-Worker (

roles/dataproc.worker) -

Data Lineage-Bearbeiter (

roles/datalineage.editor) -

Data Lineage Producer (

roles/datalineage.producer) -

Data Lineage-Administrator (

roles/datalineage.admin)

-

Managed Service for Apache Spark-Worker (

Weitere Informationen zum Zuweisen von Rollen finden Sie unter Zugriff auf Projekte, Ordner und Organisationen verwalten.

Sie können die erforderlichen Berechtigungen auch über benutzerdefinierte Rollen oder andere vordefinierte Rollen erhalten.

Spark-Daten-Lineage aktivieren

Sie können die Spark-Datenherkunft auf Projekt- oder Clusterebene aktivieren.

Spark-Daten-Lineage auf Projektebene aktivieren

Nachdem Sie die Spark-Datenherkunft auf Projektebene aktiviert haben, wird die Spark-Datenherkunft für nachfolgende Spark-Jobs aktiviert, die in Managed Service for Apache Spark-Clustern im Projekt ausgeführt werden.

Wenn Sie die Spark-Datenherkunft auf Projektebene aktivieren möchten, legen Sie die folgenden benutzerdefinierten Projektmetadaten fest:

| Schlüssel | Wert |

|---|---|

DATAPROC_LINEAGE_ENABLED |

true |

DATAPROC_CLUSTER_SCOPES |

https://www.googleapis.com/auth/cloud-platformDas Festlegen dieses VM-Zugriffsbereichs ist nur für Cluster mit 2.0-Image-Versionen erforderlich. Sie wird automatisch für Cluster mit der Bildversion 2.1 und höher festgelegt. |

Sie können den Spark-Datenabstammungsdienst auf Projektebene deaktivieren, indem Sie die Metadaten DATAPROC_LINEAGE_ENABLED auf false setzen.

Spark-Daten-Lineage auf Clusterebene aktivieren

Wenn Sie die Spark-Datenherkunft beim Erstellen eines Clusters aktivieren, ist die Spark-Datenherkunft für unterstützte Spark-Jobs, die in Managed Service for Apache Spark-Clustern ausgeführt werden, aktiviert. Diese Einstellung überschreibt alle Einstellungen für die Spark-Datenherkunft auf Projektebene: Wenn die Spark-Datenherkunft auf Projektebene deaktiviert, aber auf Clusterebene aktiviert ist, hat die Clusterebene Vorrang und für unterstützte Spark-Jobs, die auf dem Cluster ausgeführt werden, ist die Datenherkunft aktiviert.

Wenn Sie die Spark-Datenherkunft in einem Cluster aktivieren möchten, erstellen Sie einen Managed Service for Apache Spark-Cluster, in dem die Cluster-Eigenschaft dataproc:dataproc.lineage.enabled auf true festgelegt ist.

Beispiel für die gcloud CLI:

gcloud dataproc clusters create CLUSTER_NAME \

--project PROJECT_ID \

--region REGION \

--properties 'dataproc:dataproc.lineage.enabled=true'Sie können die Spark-Datenherkunft für einen Cluster deaktivieren, indem Sie beim Erstellen des Clusters die Property dataproc:dataproc.lineage.enabled auf false festlegen.

Datenherkunft in einem Cluster deaktivieren: Wenn Sie einen Cluster erstellen möchten, in dem die Datenherkunft deaktiviert ist, legen Sie

dataproc:dataproc.lineage.enabled=falsefest. Nach der Clustererstellung können Sie die Spark-Datenherkunft im Cluster nicht mehr deaktivieren. Wenn Sie die Spark-Datenherkunft in einem vorhandenen Cluster deaktivieren möchten, können Sie den Cluster neu erstellen und die Eigenschaftdataproc:dataproc.lineage.enabledauffalsefestlegen.Bereich für Cluster mit Image-Version 2.0 festlegen:Für die Spark-Datenherkunft ist der

cloud-platform-Bereich für den VM-Zugriff auf den Managed Service for Apache Spark-Cluster erforderlich. In Managed Service for Apache Spark-Clustern, die mit der Image-Version2.1oder höher erstellt wurden, istcloud-platformaktiviert. Wenn Sie beim Erstellen eines Clusters die Image-Version2.0von Managed Service for Apache Spark angeben, legen Sie den Bereich aufcloud-platformfest.

Spark-Data-Lineage für einen Job deaktivieren

Wenn die Spark-Datenherkunft für einen Cluster aktiviert ist, können Sie sie für einen Job deaktivieren, indem Sie beim Senden des Jobs die Eigenschaft spark.extraListeners mit einem leeren Wert ("") übergeben.

gcloud dataproc jobs submit spark \

--cluster=CLUSTER_NAME \

--project PROJECT_ID \

--region REGION \

--class CLASS \

--jars=gs://APPLICATION_BUCKET/spark-application.jar \

--properties=spark.extraListeners=''Spark-Job senden

Wenn Sie einen unterstützten Spark-Job in einem Managed Service for Apache Spark-Cluster senden, der mit aktivierter Spark-Datenherkunft erstellt wurde, erfasst und meldet Managed Service for Apache Spark die Datenherkunftsinformationen an die Data Lineage API.

gcloud dataproc jobs submit spark \

--cluster=CLUSTER_NAME \

--project PROJECT_ID \

--region REGION \

--class CLASS \

--jars=gs://APPLICATION_BUCKET/spark-application.jar \

--properties=spark.openlineage.namespace=CUSTOM_NAMESPACE,spark.openlineage.appName=CUSTOM_APPNAMEHinweise:

- Das Hinzufügen der Eigenschaften

spark.openlineage.namespaceundspark.openlineage.appName, die zur eindeutigen Identifizierung des Jobs verwendet werden, ist optional. Wenn Sie diese Eigenschaften nicht hinzufügen, verwendet Managed Service for Apache Spark die folgenden Standardwerte:- Standardwert für

spark.openlineage.namespace: PROJECT_ID - Standardwert für

spark.openlineage.appName:spark.app.name

- Standardwert für

Lineage in Dataplex Universal Catalog ansehen

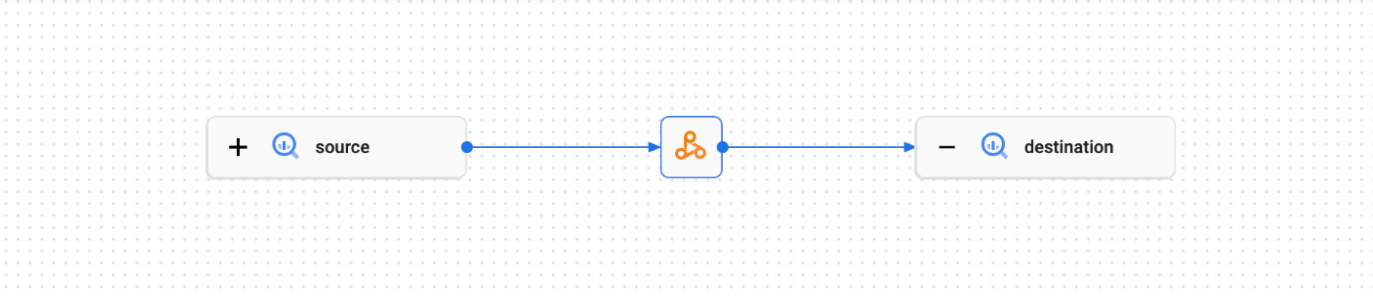

Ein Herkunftsdiagramm zeigt die Beziehungen zwischen den Ressourcen Ihres Projekts und den Prozessen, mit denen sie erstellt wurden. Sie können Informationen zum Datenursprung in der Google Cloud -Konsole ansehen oder sie in Form von JSON-Daten über die Data Lineage API abrufen.

PySpark-Beispielcode:

Der folgende PySpark-Job liest Daten aus einer öffentlichen BigQuery-Tabelle und schreibt die Ausgabe dann in eine neue Tabelle in einem vorhandenen BigQuery-Dataset. Dabei wird ein Cloud Storage-Bucket für die temporäre Speicherung verwendet.

#!/usr/bin/env python

from pyspark.sql import SparkSession

import sys

spark = SparkSession \

.builder \

.appName('LINEAGE_BQ_TO_BQ') \

.getOrCreate()

bucket = 'gs://BUCKET`

spark.conf.set('temporaryCloudStorageBucket', bucket)

source = 'bigquery-public-data:samples.shakespeare'

words = spark.read.format('bigquery') \

.option('table', source) \

.load()

words.createOrReplaceTempView('words')

word_count = spark.sql('SELECT word, SUM(word_count) AS word_count FROM words GROUP BY word')

destination_table = 'PROJECT_ID:DATASET.TABLE'

word_count.write.format('bigquery') \

.option('table', destination_table) \

.save()

Ersetzen Sie die folgenden Werte:

BUCKET: Der Name eines vorhandenen Cloud Storage-Bucket

PROJECT_ID, DATASET und TABLE: Die Projekt-ID, der Name eines vorhandenen BigQuery-Datasets und der Name einer neuen Tabelle, die im Dataset erstellt werden soll (die Tabelle darf nicht vorhanden sein)

Sie können das Lineage-Diagramm in der Dataplex Universal Catalog-UI ansehen.