Dataproc Metastore-Dienst bereitstellen

Auf dieser Seite erfahren Sie, wie Sie einen Dataproc Metastore-Dienst erstellen und eine Verbindung zu ihm von einem Managed Service for Apache Spark-Cluster aus herstellen. Anschließend stellen Sie eine SSH-Verbindung zum Cluster her, starten eine Instanz von Apache Hive und führen einige grundlegende Abfragen aus.

Dataproc Metastore bietet Ihnen einen vollständig kompatiblen Hive Metastore (HMS), der im Open-Source-Big-Data-Ökosystem als Standard für die Verwaltung technischer Metadaten gilt. Mit diesem Dienst können Sie die Metadaten Ihrer Data Lakes verwalten und die Interoperabilität zwischen den verschiedenen von Ihnen verwendeten Datenverarbeitungstools gewährleisten.

Eine detaillierte Anleitung dazu finden Sie direkt in der Google Cloud Console. Klicken Sie dazu einfach auf Anleitung:

Hinweis

- Melden Sie sich in Ihrem Google Cloud -Konto an. Wenn Sie noch kein Google Cloud-Nutzer sind, erstellen Sie ein Konto, um zu sehen, wie sich unsere Produkte in realen Szenarien schlagen. Neukunden erhalten außerdem ein Guthaben von 300 $, um Arbeitslasten auszuführen, zu testen und bereitzustellen.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc Metastore, Dataproc APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc Metastore, Dataproc APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Erforderliche Rollen

Bitten Sie Ihren Administrator, Ihnen die folgenden IAM-Rollen zuzuweisen, um die Berechtigungen zu erhalten, die Sie zum Erstellen eines Dataproc Metastore und eines Managed Service for Apache Spark-Clusters benötigen:

-

Vollständigen Zugriff auf alle Dataproc Metastore-Ressourcen gewähren, einschließlich des Festlegens von IAM-Berechtigungen:

(

roles/metastore.admin) für das Nutzerkonto oder Dienstkonto -

Vollständige Kontrolle über Dataproc Metastore-Ressourcen gewähren:

Dataproc Metastore-Editor (

roles/metastore.editor) für das Nutzerkonto oder Dienstkonto -

Einen Managed Service for Apache Spark-Cluster erstellen:

(

roles/dataproc.worker) für das Dienstkonto

Weitere Informationen zum Zuweisen von Rollen finden Sie unter Zugriff auf Projekte, Ordner und Organisationen verwalten.

Diese vordefinierten Rollen enthalten die Berechtigungen, die zum Erstellen eines Dataproc Metastore und eines Managed Service for Apache Spark-Clusters erforderlich sind. Maximieren Sie den Abschnitt Erforderliche Berechtigungen , um die notwendigen Berechtigungen anzuzeigen, die erforderlich sind:

Erforderliche Berechtigungen

Die folgenden Berechtigungen sind erforderlich, um einen Dataproc Metastore und einen Managed Service for Apache Spark-Cluster zu erstellen:

- Einen Dataproc Metastore-Dienst erstellen: metastore.services.create für das Nutzerkonto oder Dienstkonto

-

Einen Managed Service for Apache Spark-Cluster erstellen:

Managed Service for Apache Spark-Worker (

roles/dataproc.worker) für das Dienstkonto

Sie können diese Berechtigungen auch mit benutzerdefinierten Rollen oder anderen vordefinierten Rollen erhalten.

Weitere Informationen zu bestimmten Dataproc Metastore-Rollen und -Berechtigungen finden Sie unter Dataproc Metastore-IAM – Übersicht.Dataproc Metastore-Dienst erstellen

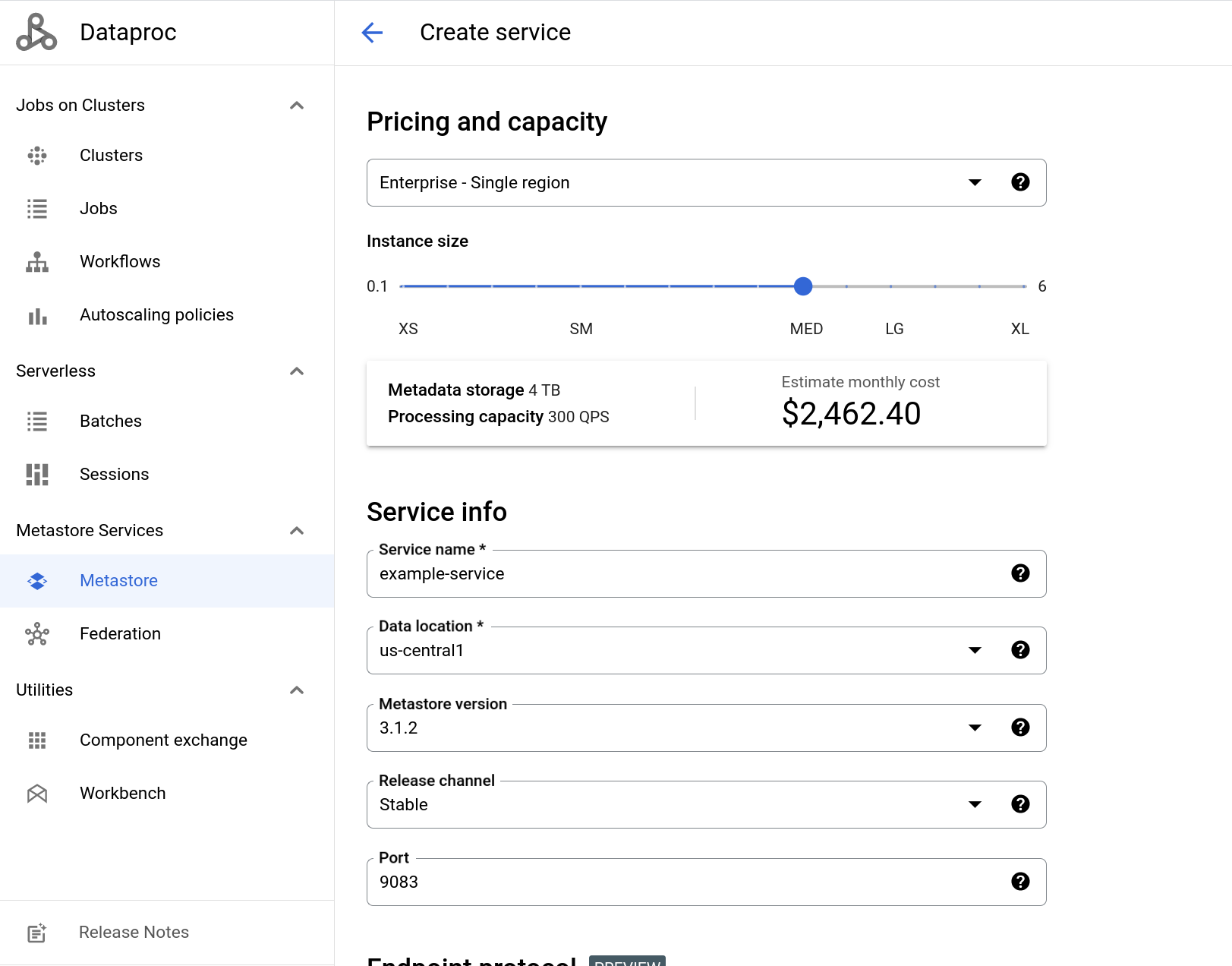

In der folgenden Anleitung wird gezeigt, wie Sie einen einfachen Dataproc Metastore-Dienst mit den bereitgestellten Standardeinstellungen erstellen.

Console

Öffnen Sie in der Google Cloud Console die Dataproc Metastore Seite.

Klicken Sie im Navigationsmenü auf + Erstellen.

Das Dialogfeld Metastore-Dienst erstellen wird geöffnet.

Wählen Sie Dataproc Metastore 2 aus.

Geben Sie im Feld Name des Dienstes

example-serviceein.Wählen Sie im Feld Speicherort der Daten

us-central1aus.Übernehmen Sie für die übrigen Optionen der Dienstkonfiguration die bereitgestellten Standardeinstellungen.

Klicken Sie auf Senden, um den Dienst zu erstellen und zu starten.

Ihr neuer Metastore-Dienst wird auf der Seite Dataproc Metastore angezeigt. Der Status ist Wird erstellt , bis der Dienst einsatzbereit ist. Wenn er bereit ist, ändert sich der Status in Aktiv. Die Bereitstellung des Dienstes kann einige Minuten dauern.

Der folgende Screenshot zeigt ein Beispiel für die Seite Dienst erstellen mit einigen der bereitgestellten Standardeinstellungen.

gcloud CLI

gcloud metastore services create example-service \

--location=us-central1 \

--instance-size=MEDIUMREST

Folgen Sie der API-Anleitung zum Erstellen eines Dienstes mit dem APIs Explorer.

Managed Service for Apache Spark-Cluster erstellen und Verbindung zu Dataproc Metastore herstellen

Als Nächstes erstellen Sie einen Managed Service for Apache Spark-Cluster und stellen eine Verbindung zu Ihrem Metastore vom Cluster aus her. Danach verwendet Ihr Cluster den Metastore-Dienst als HMS. Der hier erstellte Cluster verwendet die bereitgestellten Standardeinstellungen.

Console

Öffnen Sie in der Google Cloud Console die Seite Dataproc-Cluster.

Wählen Sie in der Navigationsleiste + Cluster erstellen aus.

Das Dialogfeld Cluster erstellen wird geöffnet und bietet mehrere Infrastrukturoptionen zur Auswahl.

Wählen Sie in der Zeile Cluster in Compute Engine die Option Erstellen aus.

Die Seite Managed Service for Apache Spark-Cluster in Compute Engine erstellen wird geöffnet.

Geben Sie im Feld Clustername

example-clusterein.Wählen Sie in den Menüs Region und Zone die Option

us-central1aus.Übernehmen Sie für die übrigen Optionen unter Cluster einrichten die bereitgestellten Standardeinstellungen.

Klicken Sie im Navigationsmenü auf den Tab Cluster anpassen (optional).

Wählen Sie im Abschnitt Dataproc Metastore den zuvor erstellten Metastore-Dienst aus.

Wenn Sie dieser Anleitung genau gefolgt sind, heißt er

example-service.Übernehmen Sie für die übrigen Optionen der Dienstkonfiguration die bereitgestellten Standardeinstellungen.

Klicken Sie auf Erstellen, um den Cluster zu erstellen.

Ihr neuer Cluster wird in der Liste Cluster angezeigt. Der Clusterstatus ist Wird bereitgestellt , bis der Cluster einsatzbereit ist. Wenn er bereit ist, ändert sich der Status in Aktiv. Die Bereitstellung des Clusters kann einige Minuten dauern.

gcloud CLI

Führen Sie den

folgenden gcloud dataproc clusters create

Befehl aus, um einen Cluster mit den bereitgestellten Standardeinstellungen zu erstellen:

gcloud dataproc clusters create example-cluster \

--dataproc-metastore=projects/PROJECT_ID/locations/us-central1/services/example-service \

--region=us-central1Ersetzen Sie PROJECT_ID durch die Projekt-ID des

Projekts, in dem Sie Ihren Dataproc Metastore-Dienst erstellt haben.

REST

Folgen Sie der API-Anleitung zum Erstellen eines Clusters mit dem APIs Explorer.

Mit einem Managed Service for Apache Spark-Cluster eine Verbindung zu Apache Hive herstellen

In den nächsten Schritten erfahren Sie, wie Sie einige Beispielbefehle in Apache Hive ausführen, um eine Datenbank und eine Tabelle zu erstellen.

Öffnen Sie als Nächstes eine SSH-Sitzung im Managed Service for Apache Spark-Cluster und starten Sie eine Hive-Sitzung.

- Öffnen Sie in der Google Cloud Console die VM Instanzen Seite.

- Klicken Sie in der Liste der Instanzen virtueller Maschinen neben

example-clusterauf SSH.

Im Stammverzeichnis des Knotens wird ein Browserfenster mit einer Ausgabe ähnlich der folgenden geöffnet:

Connected, host fingerprint: ssh-rsa ...

Linux cluster-1-m 3.16.0-0.bpo.4-amd64 ...

...

example-cluster@cluster-1-m:~$

Führen Sie in der SSH-Sitzung die folgenden Befehle aus, um Hive zu starten und eine Datenbank und eine Tabelle zu erstellen:

Starten Sie Hive.

hiveErstellen Sie eine Datenbank namens

myDatabase.create database myDatabase;Zeigen Sie die von Ihnen erstellte Datenbank an.

show databases;Verwenden Sie die von Ihnen erstellte Datenbank.

use myDatabase;Erstellen Sie eine Tabelle namens

myTable.create table myTable(id int,name string);Listen Sie die Tabellen unter

myDatabaseauf.show tables;Beschreiben Sie das Schema der von Ihnen erstellten Tabelle.

desc MyTable;

Die Ausführung dieser Befehle führt zu einer Ausgabe ähnlich der folgenden:

$hive

hive> show databases;

OK

default

hive> create database myDatabase;

OK

hive> use myDatabase;

OK

hive> create table myTable(id int,name string);

OK

hive> show tables;

OK

myTable

hive> desc myTable;

OK

id int

name string

Bereinigen

Mit den folgenden Schritten vermeiden Sie, dass Ihrem Google Cloud -Konto die auf dieser Seite verwendeten Ressourcen in Rechnung gestellt werden.

- Wechseln Sie in der Google Cloud Console zur Seite Ressourcen verwalten.

- Wenn das Projekt, das Sie löschen möchten, an eine Organisation geknüpft ist, maximieren Sie in der Spalte Name die Liste Organisation.

- Wählen Sie in der Projektliste das Projekt aus, das Sie löschen möchten, und klicken Sie dann auf Löschen.

- Geben Sie im Dialogfeld die Projekt-ID ein und klicken Sie auf Shut down (Herunterfahren), um das Projekt zu löschen.

Alternativ können Sie die Ressourcen löschen, die in dieser Anleitung verwendet werden:

Löschen Sie den Dataproc Metastore-Dienst.

Console

Öffnen Sie in der Google Cloud Console die Dataproc Metastore Seite:

Wählen Sie in der Dienstliste

example-serviceaus.Klicken Sie in der Navigationsleiste auf Löschen.

Das Dialogfeld Dienst löschen wird geöffnet.

Klicken Sie im Dialogfeld auf Löschen.

Ihr Dienst wird nicht mehr in der Dienstliste angezeigt.

gcloud CLI

Führen Sie den folgenden

gcloud metastore services delete-Befehl aus, um Ihren Dienst zu löschen.gcloud metastore services delete example-service \ --location=us-central1REST

Folgen Sie der API-Anleitung, um einen Dienst mithilfe des APIs Explorers zu löschen.

Alle Löschvorgänge werden sofort ausgeführt.

Löschen Sie den Cloud Storage-Bucket für den Dataproc Metastore-Dienst.

Löschen Sie den Managed Service for Apache Spark-Cluster der den Dataproc Metastore-Dienst verwendet hat.