משימות איכות הנתונים ב-Dataplex Universal Catalog מאפשרות להגדיר ולהריץ בדיקות של איכות הנתונים בטבלאות ב-BigQuery וב-Cloud Storage. בנוסף, משימות של איכות נתונים ב-Dataplex Universal Catalog מאפשרות להחיל אמצעי בקרה רגילים על נתונים בסביבות BigQuery.

מתי כדאי ליצור משימות של איכות הנתונים ב-Dataplex Universal Catalog

משימות של איכות הנתונים ב-Dataplex Universal Catalog יכולות לעזור לכם:

- אימות נתונים כחלק מצינור לייצור נתונים.

- חשוב לעקוב באופן שוטף אחרי איכות מערכי הנתונים בהשוואה לציפיות שלכם.

- יצירת דוחות על איכות הנתונים לצורך עמידה בדרישות רגולטוריות.

יתרונות

- מפרטים שאפשר להתאים אישית. אתם יכולים להשתמש בתחביר YAML הגמיש מאוד כדי להגדיר את הכללים לאיכות הנתונים.

- הטמעה ללא שרת. אין צורך בהגדרת תשתית כדי להשתמש ב-Dataplex Universal Catalog.

- העתקה ללא עותק ודחיפה אוטומטית. בדיקות YAML מומרות ל-SQL ומועברות ל-BigQuery, כך שלא מתבצעת העתקה של נתונים.

- בדיקות איכות נתונים שאפשר לתזמן. אפשר לתזמן בדיקות של איכות הנתונים באמצעות מתזמן ללא שרת ב-Dataplex Universal Catalog, או להשתמש ב-Dataplex API דרך מתזמנים חיצוניים כמו Cloud Composer לשילוב צינורות.

- חוויית שימוש מנוהלת. ב-Dataplex Universal Catalog נעשה שימוש במנוע קוד פתוח לבדיקת איכות הנתונים, CloudDQ, כדי להריץ בדיקות של איכות הנתונים. עם זאת, Dataplex Universal Catalog מספק חוויה מנוהלת חלקה לביצוע בדיקות איכות הנתונים.

איך עובדים עם משימות שקשורות לאיכות הנתונים

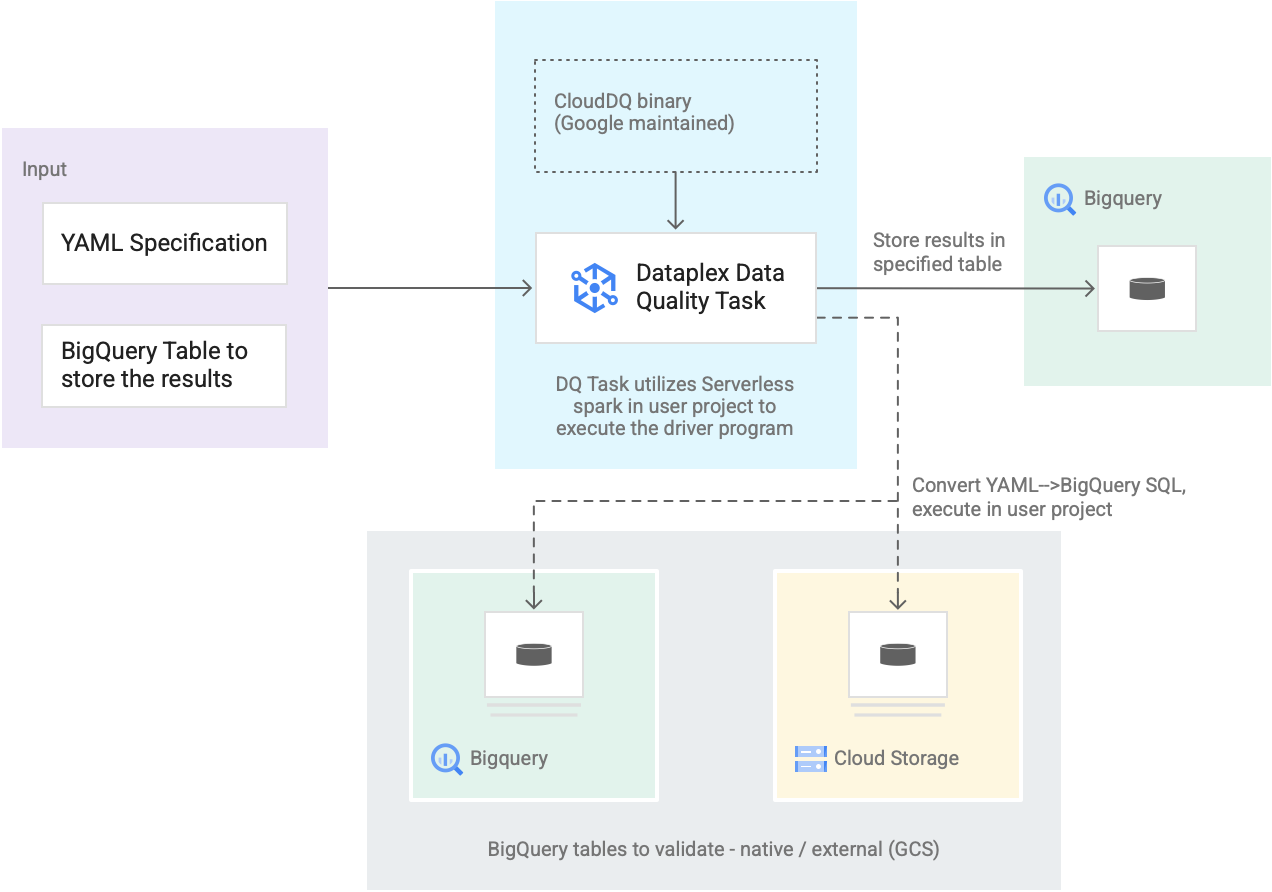

בתרשים הבא מוצג אופן הפעולה של משימות איכות הנתונים ב-Dataplex Universal Catalog:

- קלט ממשתמשים

- מפרט YAML: קבוצה של קובצי YAML אחד או יותר שמגדירים כללים לאיכות הנתונים על סמך תחביר המפרט. מאחסנים את קובצי ה-YAML בקטגוריה של Cloud Storage בפרויקט. משתמשים יכולים להריץ כמה כללים בו-זמנית, והכללים האלה יכולים לחול על טבלאות שונות ב-BigQuery, כולל טבלאות במערכי נתונים שונים או בפרויקטים שונים של Google Cloud. התקן תומך בהרצות מצטברות רק לצורך אימות נתונים חדשים. כדי ליצור מפרט YAML, אפשר לעיין במאמר בנושא יצירת קובץ מפרט.

- טבלת תוצאות ב-BigQuery: טבלה שהמשתמש מציין לאחסון התוצאות של אימות איכות הנתונים. הפרויקט שבו נמצאת הטבלה יכול להיות פרויקט שונה מהפרויקט שבו נעשה שימוש במשימת איכות הנתונים של Dataplex Universal Catalog. Google Cloud

- טבלאות לאימות

- במפרט ה-YAML, צריך לציין אילו טבלאות רוצים לאמת לפי אילו כללים, שנקרא גם rule binding. הטבלאות יכולות להיות טבלאות מקוריות של BigQuery או טבלאות חיצוניות של BigQuery ב-Cloud Storage. מפרט ה-YAML מאפשר לציין טבלאות בתוך אזור Dataplex Universal Catalog או מחוצה לו.

- טבלאות ב-BigQuery וב-Cloud Storage שעוברות אימות בהרצה אחת יכולות להיות שייכות לפרויקטים שונים.

- משימת איכות הנתונים ב-Dataplex Universal Catalog: משימת איכות הנתונים ב-Dataplex Universal Catalog מוגדרת באמצעות קובץ בינארי מוכן מראש של CloudDQ PySpark שמתוחזק, והיא מקבלת כקלט את מפרט ה-YAML ואת טבלת התוצאות ב-BigQuery. בדומה למשימות אחרות ב-Dataplex Universal Catalog, משימת איכות הנתונים של Dataplex Universal Catalog פועלת בסביבת Spark ללא שרתים, ממירה את מפרט ה-YAML לשאילתות BigQuery, ואז מריצה את השאילתות האלה בטבלאות שמוגדרות בקובץ המפרט.

תמחור

כשמריצים משימות של איכות נתונים ב-Dataplex Universal Catalog, מחויבים על השימוש ב-BigQuery וב-Serverless for Apache Spark (Batches).

המשימה של איכות הנתונים בקטלוג האוניברסלי של Dataplex ממירה את קובץ המפרט לשאילתות BigQuery ומריצה אותן בפרויקט של המשתמש. מחירון BigQuery

ב-Dataplex Universal Catalog נעשה שימוש ב-Spark כדי להריץ את תוכנת הדרייבר CloudDQ בקוד פתוח שנוצרה מראש ומתוחזקת על ידי Google. התוכנה ממירה את המפרט של המשתמש לשאילתות ב-BigQuery. ראו תמחור של Serverless for Apache Spark.

אין חיוב על שימוש ב-Dataplex Universal Catalog כדי לארגן נתונים או על שימוש בכלי לתזמון בלי שרת (serverless) ב-Dataplex Universal Catalog כדי לתזמן בדיקות של איכות הנתונים. תמחור של Dataplex Universal Catalog