ステップ 1: ワークロードを確立する

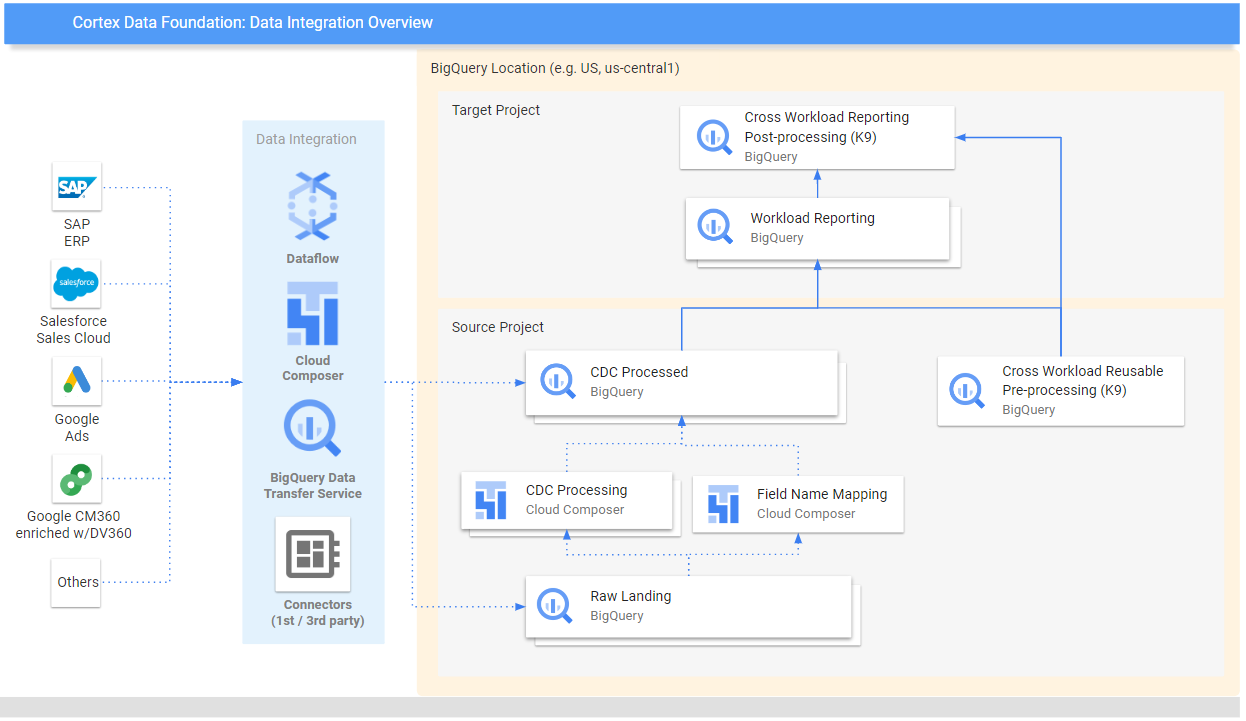

このページでは、Cortex Framework のコアであるデータ基盤を設定する最初のステップについて説明します。BigQuery ストレージ上に構築されたデータ基盤は、さまざまなソースから受信したデータを整理します。 整理されたデータは、分析と AI 開発での適用を簡素化します。

データ統合を設定する

Cortex Framework 内でデータを効率的に整理して使用するためのブループリントとして機能する、いくつかの重要なパラメータを定義することから始めます。 これらのパラメータは、特定のワークロード、選択したデータフロー、統合メカニズムによって異なる場合があります。次の図は、Cortex Framework Data Foundation 内のデータ統合の概要を示しています。

Cortex Framework 内でデータを効率的かつ効果的に活用するために、デプロイ前に次のパラメータを定義します。

プロジェクト

- ソース プロジェクト: 生データが存在するプロジェクト。データを保存してデプロイ プロセスを実行するには、少なくとも 1 つの Google Cloud プロジェクトが必要です。

- ターゲット プロジェクト(省略可): Cortex Framework Data Foundation が処理済みのデータモデルを保存するプロジェクト。ニーズに応じて、ソース プロジェクトと同じにすることも、別のプロジェクトにすることもできます。

ワークロードごとに別々のプロジェクトとデータセットのセットが必要な場合(たとえば、SAP 用のソース プロジェクトとターゲット プロジェクトのセットと、Salesforce 用のターゲット プロジェクトとソース プロジェクトのセット)、ワークロードごとに個別のデプロイを実行します。詳細については、省略可能な手順のセクションで、 さまざまなプロジェクトを使用してアクセスを分離する をご覧ください。

データモデル

- モデルをデプロイする: すべてのワークロードのモデルをデプロイする必要があるか、1 つのモデルセット(SAP、Salesforce、Meta など)のみをデプロイする必要があるかを選択します。詳細については、使用可能なデータソースとワークロードをご覧ください。

BigQuery データセット

- ソース データセット(未加工): ソースデータが複製される BigQuery データセット、またはテストデータが作成される BigQuery データセット。 データソースごとに個別のデータセットを用意することをおすすめします。たとえば、SAP 用の未加工データセットと Google 広告用の未加工データセットです。 このデータセットはソース プロジェクトに属します。

- CDC データセット: CDC 処理されたデータが最新の利用可能なレコードに格納される BigQuery データセット。一部のワークロードでは、フィールド名のマッピングが可能です。ソースごとに個別の CDC データセットを用意することをおすすめします。たとえば、SAP 用の CDC データセットと Salesforce 用の CDC データセットです。このデータセットはソース プロジェクトに属します。

- ターゲット レポート データセット: Data Foundation の事前定義されたデータモデルがデプロイされる BigQuery データセット。 ソースごとに個別のレポート データセットを用意することをおすすめします。たとえば、SAP 用のレポート データセットと Salesforce 用のレポート データセットです。このデータセットが存在しない場合は、デプロイ時に自動的に作成されます。このデータセットはターゲット プロジェクトに属します。

- 前処理 K9 データセット:

timeディメンションなど、ワークロード間で再利用可能な DAG コンポーネントをデプロイできる BigQuery データセット。変更しない限り、ワークロードはこのデータセットに依存します。このデータセットが存在しない場合は、デプロイ時に自動的に作成されます。このデータセットはソース プロジェクトに属します。 - 後処理 K9 データセット: ワークロード間のレポート作成や、追加の外部ソース DAG(Google トレンドの取り込みなど)をデプロイできる BigQuery データセット。このデータセットが存在しない場合は、デプロイ時に自動的に作成されます。このデータセットはターゲット プロジェクトに属します。

省略可: サンプルデータを生成する

独自のデータにアクセスできない場合や、データを設定するためのレプリケーション ツールがない場合、または Cortex Framework の動作を確認したいだけの場合でも、Cortex Framework はサンプルデータとテーブルを生成できます。ただし、CDC データセットと未加工データセットは事前に作成して特定する必要があります。

次の手順に沿って、データソースごとに未加工データと CDC の BigQuery データセットを作成します。

コンソール

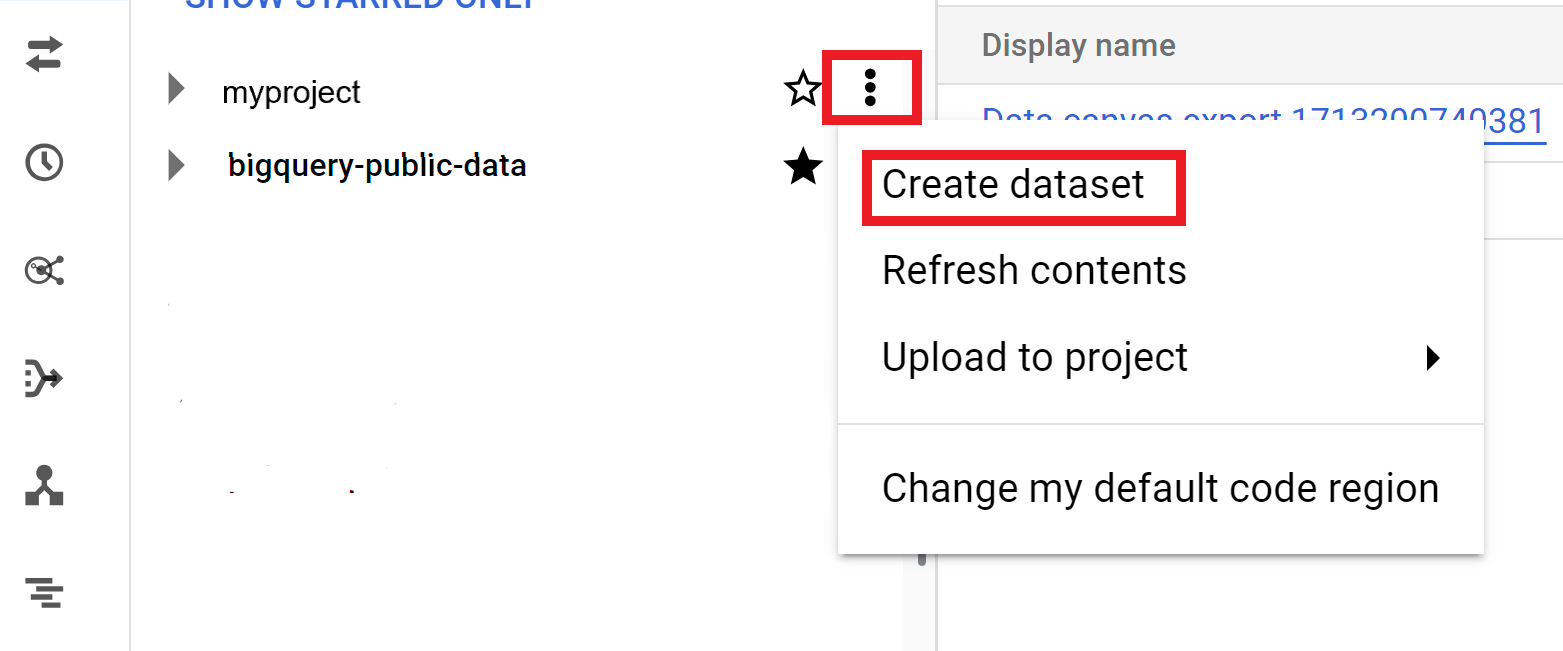

コンソールで [BigQuery] ページを開きます。 Google Cloud

[エクスプローラ] パネルで、データセットを作成するプロジェクトを選択します。

[アクション] オプションを開いて、[データセットを作成] をクリックします。

[データセットを作成] ページで次の操作を行います。

- [**データセット ID**] に、データセットの一意の 名前を入力します。

[**ロケーション タイプ**] で、データセットの地理的なロケーション を選択します。データセットの作成後はロケーションを変更できません。

(省略可)データセットのカスタマイズの詳細については、 データセットを作成する: コンソールをご覧ください。

[データセットを作成] をクリックします。

BigQuery

次のコマンドをコピーして、未加工データの新しいデータセットを作成します。

bq --location= LOCATION mk -d SOURCE_PROJECT: DATASET_RAW次のように置き換えます。

LOCATION:データセットのロケーション。SOURCE_PROJECT: ソース プロジェクト ID。DATASET_RAW: 未加工データのデータセットの名前。例:CORTEX_SFDC_RAW

次のコマンドをコピーして、CDC データの新しいデータセットを作成します。

bq --location=LOCATION mk -d SOURCE_PROJECT: DATASET_CDC次のように置き換えます。

LOCATION:データセットのロケーション。SOURCE_PROJECT: ソース プロジェクト ID。DATASET_CDC: CDC データのデータセットの名前。例:CORTEX_SFDC_CDC

次のコマンドを使用して、データセットが作成されたことを確認します。

bq ls(省略可)データセット作成の詳細については、 データセットの作成をご覧ください。

次のステップ

このステップが完了したら、次のデプロイ手順に進みます。

- ワークロードを確立する(このページ)。

- リポジトリのクローンを作成する。

- 統合メカニズムを決定する。

- コンポーネントを設定する。

- デプロイを構成する。

- デプロイを実行する。