Etapa 1: estabelecer cargas de trabalho

Esta página orienta você na etapa inicial de configuração da base de dados, o núcleo do Cortex Framework. Criada com base no armazenamento do BigQuery, a base de dados organiza os dados recebidos de várias fontes. Esses dados organizados simplificam a análise e a aplicação no desenvolvimento de IA.

Configurar a integração de dados

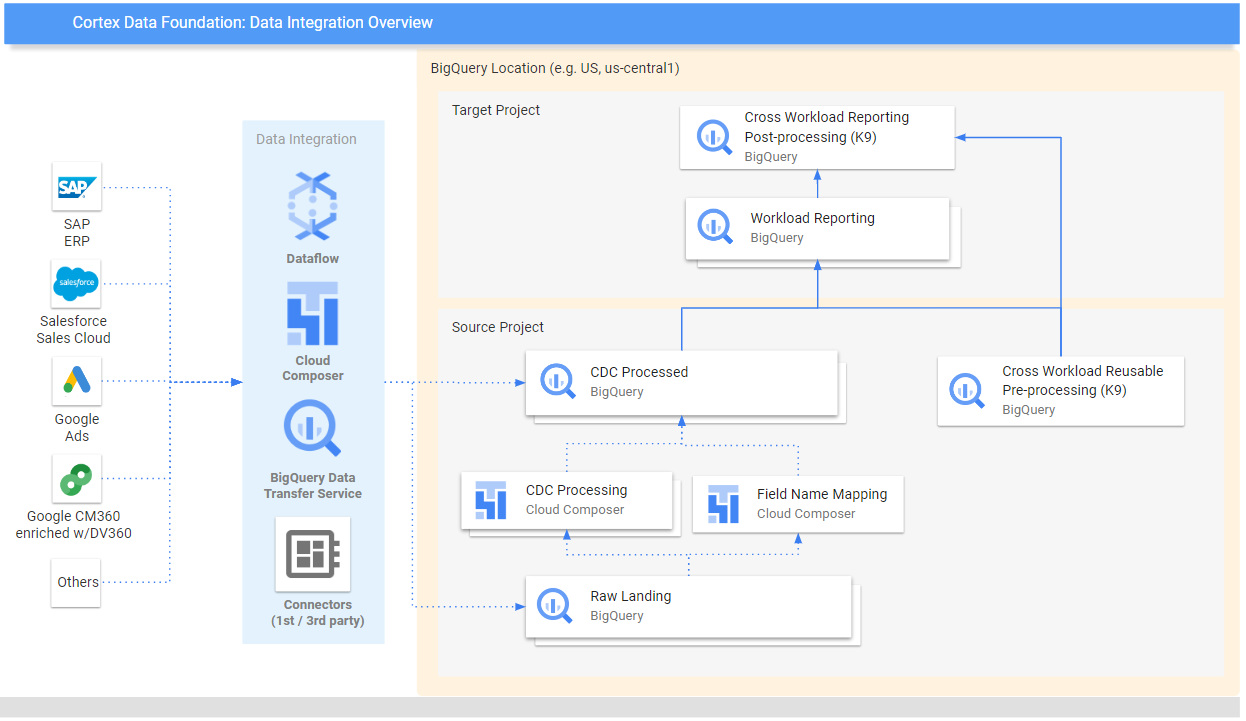

Comece definindo alguns parâmetros importantes para servir como um modelo para organizar e usar seus dados com eficiência no Cortex Framework. Lembre-se de que esses parâmetros podem variar dependendo da carga de trabalho específica, do fluxo de dados escolhido e do mecanismo de integração. O diagrama a seguir oferece uma visão geral da integração de dados na base de dados do Cortex Framework:

Defina os parâmetros a seguir antes da implantação para uma utilização eficiente e eficaz dos dados no Cortex Framework.

Projetos

- Projeto de origem:projeto em que seus dados brutos estão. Você precisa de pelo menos um Google Cloud projeto para armazenar dados e executar o processo de implantação.

- Projeto de destino (opcional) : projeto em que a base de dados do Cortex Framework armazena os modelos de dados processados. Ele pode ser o mesmo que o projeto de origem ou um diferente, dependendo das suas necessidades.

Se você quiser ter conjuntos separados de projetos e conjuntos de dados para cada carga de trabalho (por exemplo, um conjunto de projetos de origem e destino para o SAP e um conjunto diferente de projetos de destino e origem para o Salesforce), execute implantações separadas para cada carga de trabalho. Para mais informações, consulte Como usar projetos diferentes para separar o acesso na seção de etapas opcionais.

Modelo de dados

- Implantar modelos:escolha se você precisa implantar modelos para todas as cargas de trabalho ou apenas um conjunto de modelos (por exemplo, SAP, Salesforce e Meta). Para mais informações, consulte Fontes de dados e cargas de trabalho disponíveis.

Conjuntos de dados do BigQuery

- Conjunto de dados de origem (bruto) : conjunto de dados do BigQuery em que os dados de origem são replicados ou em que os dados de teste são criados. A recomendação é ter conjuntos de dados separados, um para cada fonte de dados. Por exemplo, um conjunto de dados brutos para o SAP e um conjunto de dados brutos para o Google Ads. Esse conjunto de dados pertence ao projeto de origem.

- Conjunto de dados CDC:conjunto de dados do BigQuery em que os dados processados do CDC são armazenados nos registros mais recentes disponíveis. Algumas cargas de trabalho permitem o mapeamento de nomes de campos. A recomendação é ter um conjunto de dados CDC separado para cada origem. Por exemplo, um conjunto de dados CDC para o SAP e um conjunto de dados CDC para o Salesforce. Esse conjunto de dados pertence ao projeto de origem.

- Conjunto de dados de relatórios de destino:conjunto de dados do BigQuery em que os modelos de dados predefinidos da base de dados são implantados. Recomendamos ter um conjunto de dados de relatórios separado para cada origem. Por exemplo, um conjunto de dados de relatórios para o SAP e um conjunto de dados de relatórios para o Salesforce. Esse conjunto de dados é criado automaticamente durante a implantação, se não existir. Esse conjunto de dados pertence ao projeto de destino.

- Conjunto de dados K9 de pré-processamento:conjunto de dados do BigQuery em que componentes DAG reutilizáveis de várias cargas de trabalho, como dimensões

time, podem ser implantados. As cargas de trabalho têm uma dependência desse conjunto de dados, a menos que sejam modificadas. Esse conjunto de dados é criado automaticamente durante a implantação, se não existir. Esse conjunto de dados pertence ao projeto de origem. - Conjunto de dados K9 de pós-processamento:conjunto de dados do BigQuery em que relatórios de várias cargas de trabalho e DAGs de origem externa adicionais (por exemplo, ingestão do Google Trends) podem ser implantados. Esse conjunto de dados é criado automaticamente durante a implantação, se não existir. Esse conjunto de dados pertence ao projeto de destino.

Opcional: gerar dados de amostra

O Cortex Framework pode gerar dados e tabelas de amostra para você se você não tiver acesso aos seus próprios dados ou ferramentas de replicação para configurar dados, ou mesmo se quiser apenas ver como o Cortex Framework funciona. No entanto, ainda é necessário criar e identificar os conjuntos de dados CDC e brutos com antecedência.

Crie conjuntos de dados do BigQuery para dados brutos e CDC por fonte de dados, seguindo estas instruções.

Console

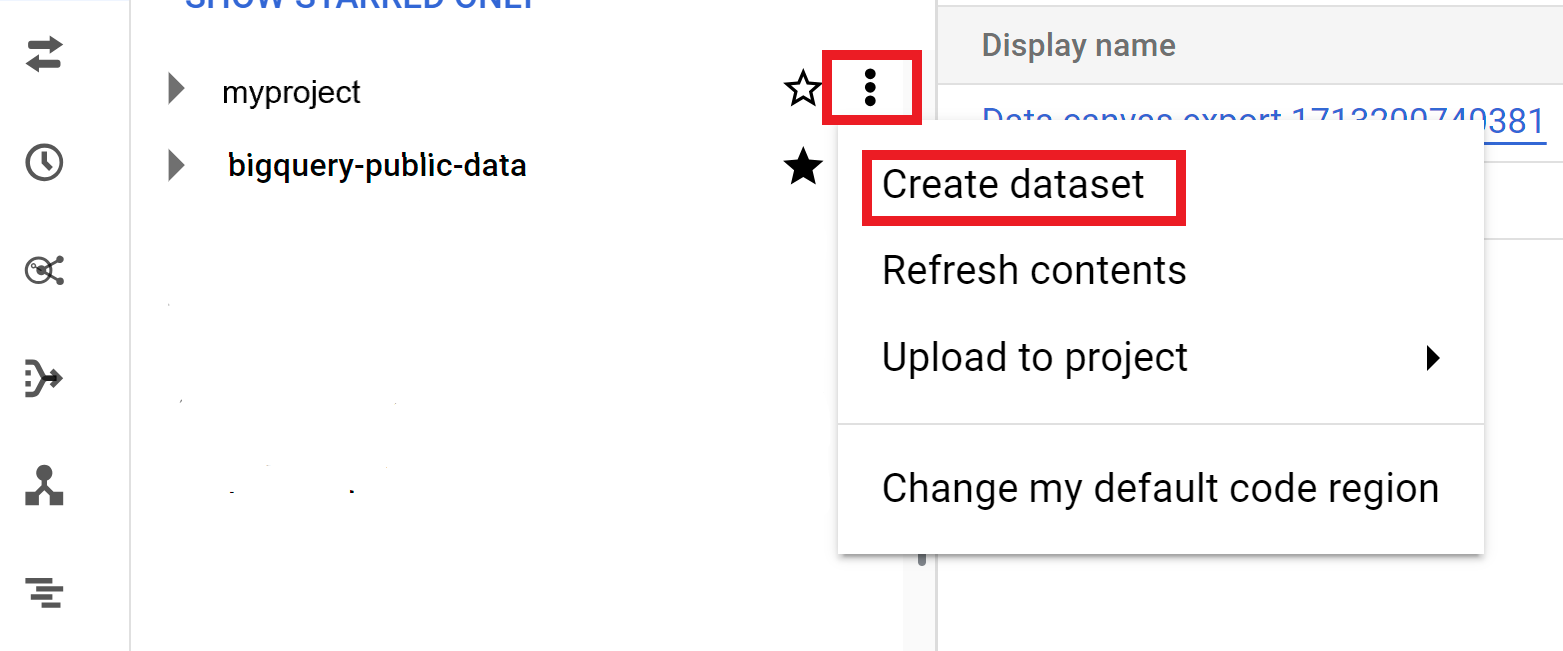

Abra a página do BigQuery no Google Cloud console.

No painel Explorer, selecione o projeto em que você quer criar o conjunto de dados.

Expanda a opção Ações e clique em Criar conjunto de dados.

Na página Criar conjunto de dados , faça o seguinte:

- Em ID do conjunto de dados, insira um nome exclusivo para o conjunto de dados.

Em Tipo de local, escolha um local geográfico para o conjunto de dados. Após a criação de um conjunto de dados, o local não pode ser alterado.

Opcional. Para mais detalhes de personalização do conjunto de dados, consulte Criar conjuntos de dados: console.

Clique em Criar conjunto de dados.

BigQuery

Crie um novo conjunto de dados para dados brutos copiando o comando a seguir:

bq --location= LOCATION mk -d SOURCE_PROJECT: DATASET_RAWSubstitua:

LOCATIONcom a localização do conjunto de dados.SOURCE_PROJECTpelo ID do projeto de origem.DATASET_RAWpelo nome do conjunto de dados para dados brutos. Por exemplo,CORTEX_SFDC_RAW.

Crie um novo conjunto de dados para dados CDC copiando o comando a seguir:

bq --location=LOCATION mk -d SOURCE_PROJECT: DATASET_CDCSubstitua:

LOCATIONcom a localização do conjunto de dados.SOURCE_PROJECTpelo ID do projeto de origem.DATASET_CDCpelo nome do conjunto de dados para dados CDC. Por exemplo,CORTEX_SFDC_CDC.

Confirme se os conjuntos de dados foram criados com o seguinte comando:

bq lsOpcional. Para mais informações sobre como criar conjuntos de dados, consulte Criar conjuntos de dados.

Próximas etapas

Depois de concluir esta etapa, avance para as seguintes etapas de implantação:

- Estabelecer cargas de trabalho (esta página).

- Clonar o repositório.

- Determinar o mecanismo de integração.

- Configurar componentes.

- Configurar a implantação.

- Executar a implantação.