Étape 3 : Déterminer le mécanisme d'intégration

Cette page décrit la troisième étape du déploiement de Cortex Framework Data Foundation, le cœur de Cortex Framework. Au cours de cette étape, vous configurez l'intégration à la source de données de votre choix. Si vous utilisez des exemples de données, ignorez cette étape.

Présentation de l'intégration

Cortex Framework vous aide à centraliser les données provenant de différentes sources, ainsi que d'autres plates-formes. Cela crée une source de référence unique pour vos données. Cortex Data Foundation s'intègre à chaque source de données de différentes manières, mais la plupart d'entre elles suivent une procédure similaire :

- Source vers couche brute : ingérez des données de la source de données vers l'ensemble de données brutes à l'aide d'API. Pour ce faire, utilisez des pipelines Dataflow déclenchés via des DAG Airflow gérés.

- Couche brute vers couche CDC : appliquez le traitement CDC à l'ensemble de données brutes et stockez la sortie dans l'ensemble de données CDC. Pour ce faire, utilisez des DAG Airflow gérés exécutant des requêtes SQL BigQuery.

- Couche CDC vers couche de reporting : créez des tables de reporting finales à partir de tables CDC dans l'ensemble de données de reporting. Pour ce faire, créez des vues d'exécution au-dessus des tables CDC ou exécutez des DAG Airflow gérés pour les données matérialisées dans les tables BigQuery, selon la configuration. Pour en savoir plus sur la configuration, consultez Personnaliser le fichier de paramètres de reporting.

Le fichier config.json configure les paramètres requis pour se connecter aux sources de données

afin de transférer des données à partir de différentes charges de travail. Consultez les options d'intégration pour chaque source de données dans les ressources suivantes.

- Opérationnel :

- Marketing:

- Développement durable :

Pour en savoir plus sur les diagrammes entité-association compatibles avec chaque

source de données, consultez le dossier docs dans le dépôt Cortex Framework Data Foundation.

Déploiement K9

Le déployeur K9 simplifie l'intégration de diverses sources de données. Le déployeur K9 est un ensemble de données prédéfini dans l'environnement BigQuery, chargé d'ingérer, de traiter et de modéliser des composants réutilisables dans différentes sources de données.

Par exemple, la dimension time est réutilisable dans toutes les sources de données où les tables peuvent avoir besoin de prendre des résultats analytiques basés sur un calendrier grégorien. Le déployeur K9 combine des données externes telles que la météo ou Google Trends avec d'autres sources de données (par exemple, SAP, Salesforce, Marketing). Cet ensemble de données enrichi permet d'obtenir des insights plus approfondis et une analyse plus complète.

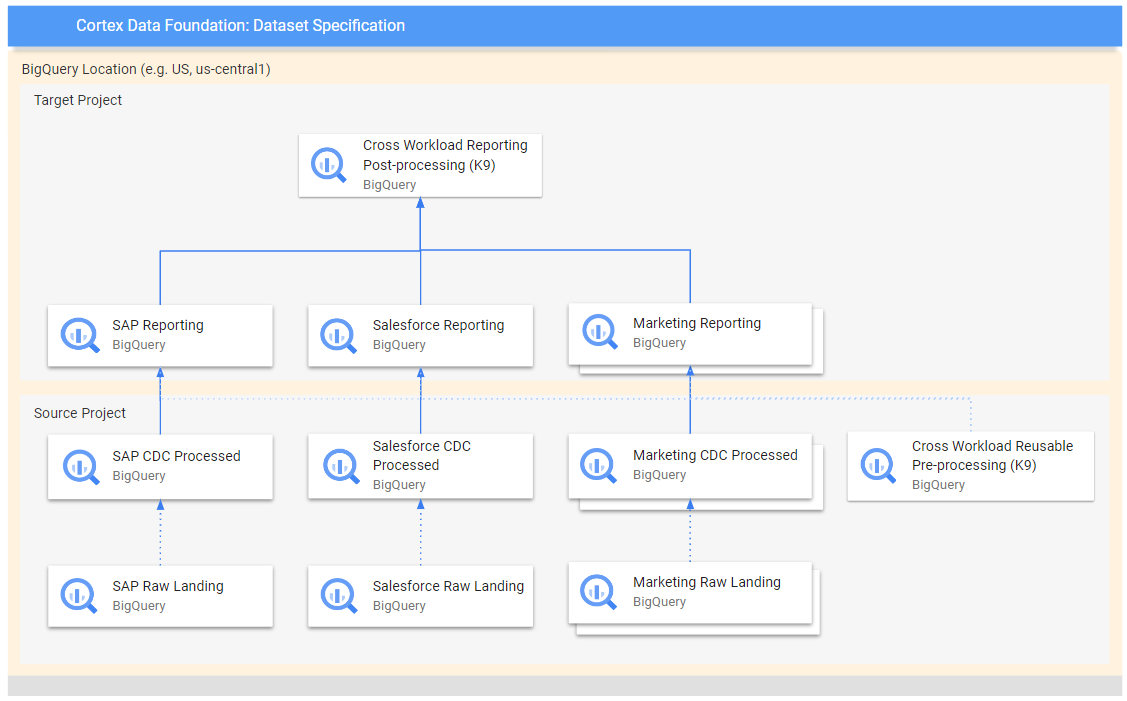

Le schéma suivant montre le flux de données de différentes sources brutes vers différentes couches de reporting :

Dans le schéma, le projet source contient les données brutes des sources de données choisies (SAP, Salesforce, et Marketing). Le projet cible contient des données traitées, dérivées du processus de capture de données modifiées (CDC).

L'étape de prétraitement K9 s'exécute avant le début du déploiement de toutes les charges de travail. Les modèles réutilisables sont donc disponibles lors de leur déploiement. Cette étape transforme les données provenant de différentes sources pour créer un ensemble de données cohérent et réutilisable.

Les étapes de post-traitement K9 se produisent une fois que toutes les charges de travail ont déployé leurs modèles de reporting pour activer le reporting entre les charges de travail ou augmenter les modèles afin de trouver les dépendances nécessaires dans chaque ensemble de données de reporting individuel.

Configurer le déploiement K9

Configurez les graphes orientés acycliques (DAG) et les modèles à générer dans le fichier manifeste K9.

L'étape de prétraitement K9 est importante, car elle garantit que toutes les charges de travail du pipeline de données ont accès à des données préparées de manière cohérente. Cela réduit la redondance et garantit la cohérence des données.

Pour en savoir plus sur la configuration d'ensembles de données externes pour K9, consultez Configurer des ensembles de données externes pour K9.

Étapes suivantes

Une fois cette étape terminée, passez aux étapes de déploiement suivantes :

- Établir des charges de travail.

- Cloner le dépôt.

- Déterminer le mécanisme d'intégration (cette page)

- Configurer les composants.

- Configurer le déploiement.

- Exécuter le déplier.