Schritt 3: Integrationsmechanismus festlegen

Auf dieser Seite wird der dritte Schritt zur Bereitstellung von Cortex Framework Data Foundation beschrieben, dem Kern von Cortex Framework. In diesem Schritt konfigurieren Sie die Integration mit der ausgewählten Datenquelle. Wenn Sie Beispieldaten verwenden, überspringen Sie diesen Schritt.

Überblick über die Integration

Mit Cortex Framework können Sie Daten aus verschiedenen Quellen sowie von anderen Plattformen zentralisieren. So schaffen Sie eine Single Source of Truth für Ihre Daten. Cortex Data Foundation wird auf unterschiedliche Weise in die einzelnen Datenquellen eingebunden, aber die meisten folgen einem ähnlichen Verfahren:

- Von der Quelle zur Rohdatenschicht:Daten aus der Datenquelle mithilfe von APIs in das Rohdaten-Dataset aufnehmen. Dies erfolgt über Dataflow-Pipelines, die durch verwaltete Airflow-DAGs ausgelöst werden.

- Von der Rohdatenschicht zur CDC-Schicht: CDC-Verarbeitung auf das Rohdaten-Dataset anwenden und die Ausgabe im CDC-Dataset speichern. Dies erfolgt durch verwaltete Airflow-DAGs, die BigQuery-SQL-Abfragen ausführen.

- Von der CDC-Schicht zur Berichtsschicht:Abschließende Berichtstabellen aus CDC-Tabellen im Berichts-Dataset erstellen. Dies erfolgt entweder durch das Erstellen von Laufzeitansichten auf Grundlage von CDC-Tabellen oder durch das Ausführen von verwalteten Airflow-DAGs für materialisierte Daten in BigQuery-Tabellen – je nach Konfiguration. Weitere Informationen zur Konfiguration finden Sie unter Datei mit Berichtseinstellungen anpassen.

In der Datei config.json werden die Einstellungen konfiguriert, die für die Verbindung zu Daten

quellen erforderlich sind, um Daten aus verschiedenen Arbeitslasten zu übertragen. Die Integrationsoptionen für jede Datenquelle finden Sie in den folgenden Ressourcen.

- Betrieblich:

- Marketing:

- Nachhaltigkeit:

Weitere Informationen zu den Entity-Relationship-Diagrammen , die von den einzelnen

Datenquellen unterstützt werden, finden Sie im Ordner docs im Repository von Cortex Framework Data Foundation.

K9-Bereitstellung

Der K9-Deployer vereinfacht die Integration verschiedener Datenquellen. Der K9-Deployer ist ein vordefiniertes Dataset in der BigQuery-Umgebung, das für die Aufnahme, Verarbeitung und Modellierung von Komponenten zuständig ist, die in verschiedenen Datenquellen wiederverwendet werden können.

Die Dimension time kann beispielsweise in allen Datenquellen wiederverwendet werden, in denen Tabellen analytische Ergebnisse auf Grundlage eines gregorianischen Kalenders liefern müssen. Der K9-Deployer kombiniert externe Daten wie Wetterdaten oder Google Trends mit anderen Datenquellen (z. B. SAP, Salesforce, Marketing). Dieses angereicherte Dataset ermöglicht detailliertere Einblicke und umfassendere Analysen.

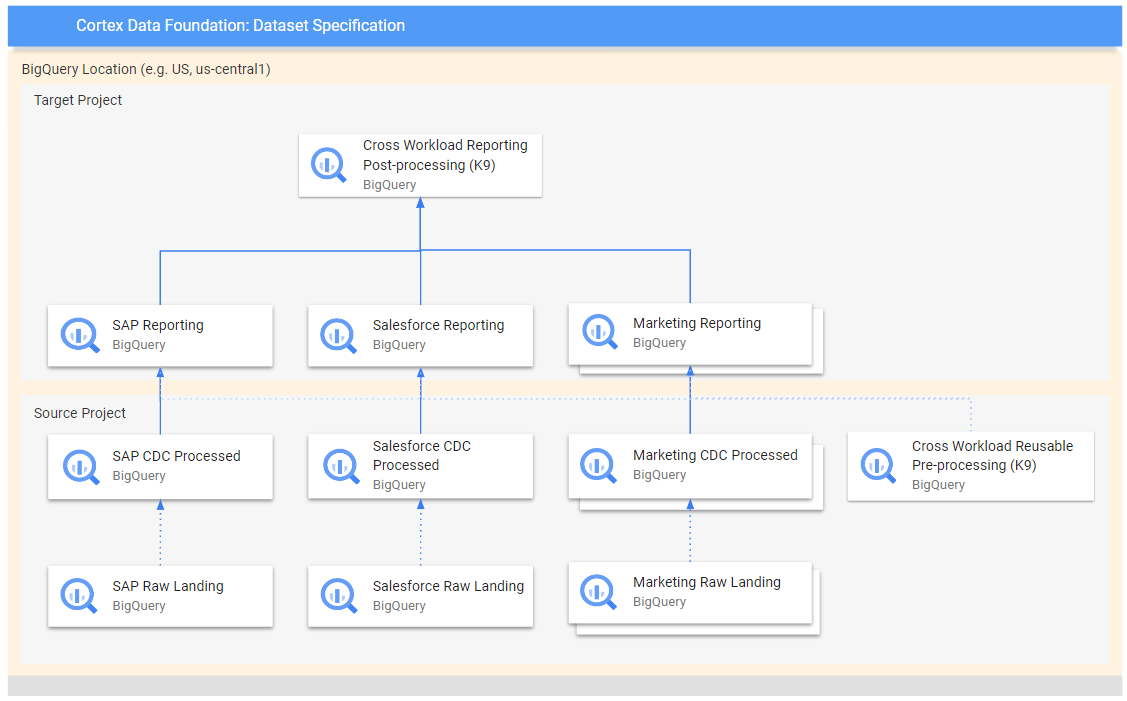

Das folgende Diagramm zeigt den Datenfluss von verschiedenen Rohdatenquellen zu verschiedenen Berichtsschichten:

Im Diagramm enthält das Quellprojekt die Rohdaten aus den ausgewählten Datenquellen (SAP, Salesforce, und Marketing). Während das Zielprojekt verarbeitete Daten enthält, die aus dem Change Data Capture-Prozess (CDC) abgeleitet wurden.

Der K9-Vorverarbeitungsschritt wird ausgeführt, bevor alle Arbeitslasten mit der Bereitstellung beginnen, sodass die wiederverwendbaren Modelle während der Bereitstellung verfügbar sind. In diesem Schritt werden Daten aus verschiedenen Quellen transformiert, um ein konsistentes und wiederverwendbares Dataset zu erstellen.

Die K9-Nachverarbeitungsschritte erfolgen, nachdem alle Arbeitslasten ihre Berichtsmodelle bereitgestellt haben, um berichtsübergreifende Berichte zu erstellen oder Modelle zu erweitern, um die erforderlichen Abhängigkeiten in den einzelnen Berichts-Datasets zu finden.

K9-Bereitstellung konfigurieren

Konfigurieren Sie die gerichteten azyklischen Graphen (DAGs) und Modelle, die generiert werden sollen in der K9-Manifestdatei.

Der K9-Vorverarbeitungsschritt ist wichtig, da er dafür sorgt, dass alle Arbeitslasten in der Datenpipeline Zugriff auf konsistent vorbereitete Daten haben. Dadurch werden Redundanz reduziert und die Datenkonsistenz sichergestellt.

Weitere Informationen zum Konfigurieren externer Datasets für K9 finden Sie unter Externe Datasets für K9 konfigurieren.

Nächste Schritte

Nachdem Sie diesen Schritt abgeschlossen haben, fahren Sie mit den folgenden Bereitstellungsschritten fort:

- Arbeitslasten einrichten.

- Repository klonen.

- Integrationsmechanismus festlegen (diese Seite).

- Komponenten einrichten.

- Bereitstellung konfigurieren.

- Bereitstellung ausführen.