Esegui un DAG Apache Airflow in Managed Airflow (Gen 3)

Managed Airflow (Gen 3) | Managed Airflow (Gen 2) | Managed Airflow (Legacy Gen 1)

Questa guida rapida mostra come creare un ambiente Managed Service for Apache Airflow ed eseguire un DAG di Apache Airflow in Managed Airflow (Gen 3).

Se non hai mai utilizzato Airflow, consulta il tutorial sui concetti di Airflow nella documentazione di Apache Airflow per saperne di più su concetti, oggetti e utilizzo di Airflow.

Se vuoi utilizzare Google Cloud CLI, consulta Esegui un DAG di Apache Airflow in Managed Service for Apache Airflow (Google Cloud CLI).

Se vuoi creare un ambiente utilizzando Terraform, consulta Creare ambienti (Terraform).

Prima di iniziare

- Accedi al tuo account Google Cloud . Se non conosci Google Cloud, crea un account per valutare le prestazioni dei nostri prodotti in scenari reali. I nuovi clienti ricevono anche 300 $di crediti senza costi per l'esecuzione, il test e il deployment dei workload.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Abilita l'API Managed Airflow.

Ruoli richiesti per abilitare le API

Per abilitare le API, devi disporre del ruolo IAM Amministratore utilizzo dei servizi (

roles/serviceusage.serviceUsageAdmin), che include l'autorizzazioneserviceusage.services.enable. Scopri come concedere i ruoli. -

Per ottenere le autorizzazioni necessarie per completare questa guida rapida, chiedi all'amministratore di concederti i seguenti ruoli IAM nel tuo progetto:

-

Per assegnare ruoli e autorizzazioni IAM:

Project IAM Admin (

roles/resourcemanager.projectIamAdmin) -

Per creare un account di servizio per l'ambiente Managed Airflow:

Create Service Accounts (

roles/iam.serviceAccountCreator) -

Per visualizzare, creare e gestire l'ambiente Managed Airflow:

- Amministratore ambienti e oggetti Storage (

roles/composer.environmentAndStorageObjectAdmin) - Service Account User (

roles/iam.serviceAccountUser)

- Amministratore ambienti e oggetti Storage (

-

Per visualizzare i log:

Visualizzatore log (

roles/logging.viewer)

Per saperne di più sulla concessione dei ruoli, consulta Gestisci l'accesso a progetti, cartelle e organizzazioni.

Potresti anche riuscire a ottenere le autorizzazioni richieste tramite i ruoli personalizzati o altri ruoli predefiniti.

-

Per assegnare ruoli e autorizzazioni IAM:

Project IAM Admin (

Crea il account di servizio di un ambiente

Quando crei un ambiente, specifichi un account di servizio. Questo service account è chiamato service account dell'ambiente. Il tuo ambiente utilizza questo account di servizio per eseguire la maggior parte delle operazioni.

Il account di servizio per il tuo ambiente non è un account utente. Un account di serviziot è un tipo speciale di account utilizzato da un'applicazione o da un'istanza di macchina virtuale (VM), non da una persona.

Per creare un account di servizio per il tuo ambiente:

Crea un nuovo service account, come descritto nella documentazione di Identity and Access Management.

Assegnagli un ruolo, come descritto nella documentazione di Identity and Access Management. Il ruolo richiesto è Worker Composer (

composer.worker).

Crea un ambiente

Nella console Google Cloud , vai alla pagina Crea ambiente.

Nel campo Nome, inserisci

example-environment.Nell'elenco a discesa Località, seleziona una regione per l'ambiente Managed Airflow. Questa guida utilizza la regione

us-central1.Per le altre opzioni di configurazione dell'ambiente, utilizza i valori predefiniti forniti.

Fai clic su Crea e attendi la creazione dell'ambiente.

Al termine, accanto al nome dell'ambiente viene visualizzato un segno di spunta verde.

Crea un file DAG

Un DAG di Airflow è una raccolta di attività organizzate che vuoi pianificare ed eseguire. I DAG sono definiti in file Python standard.

Questa guida utilizza un DAG di Airflow di esempio definito nel file quickstart.py.

Il codice Python in questo file esegue le seguenti operazioni:

- Crea un DAG,

composer_sample_dag. Questo DAG viene eseguito ogni giorno. - Esegue un'attività,

print_dag_run_conf. L'attività stampa la configurazione dell'esecuzione del DAG utilizzando l'operatore bash.

Salva una copia del file quickstart.py sulla tua macchina locale:

Carica il file DAG nel bucket dell'ambiente

Ogni ambiente Managed Airflow ha un bucket Cloud Storage

associato. Airflow in Managed Airflow pianifica solo

i DAG che si trovano nella cartella /dags di questo bucket.

Per pianificare il DAG, carica quickstart.py dalla tua macchina locale nella cartella /dags del tuo ambiente:

Nella console Google Cloud , vai alla pagina Ambienti.

Nell'elenco degli ambienti, fai clic sul nome del tuo ambiente,

example-environment. Viene visualizzata la pagina Dettagli ambiente.Fai clic su Apri cartella DAG. Viene visualizzata la pagina Dettagli bucket.

Fai clic su Carica file e seleziona la tua copia di

quickstart.py.Per caricare il file, fai clic su Apri.

Visualizzare il DAG

Dopo aver caricato il file DAG, Airflow esegue le seguenti operazioni:

- Analizza il file DAG che hai caricato. Potrebbero essere necessari alcuni minuti prima che il DAG sia disponibile per Airflow.

- Aggiunge il DAG all'elenco dei DAG disponibili.

- Esegue il DAG in base alla pianificazione fornita nel file DAG.

Verifica che il DAG venga elaborato senza errori e sia disponibile in Airflow visualizzandolo nell'interfaccia utente DAG. La UI DAG è l'interfaccia di Managed Airflow per visualizzare le informazioni sui DAG nella console Google Cloud . Managed Airflow fornisce anche l'accesso alla UI di Airflow, che è un'interfaccia web di Airflow nativa.

Attendi circa cinque minuti per dare ad Airflow il tempo di elaborare il file DAG che hai caricato in precedenza e di completare la prima esecuzione del DAG (spiegata in seguito).

Nella console Google Cloud , vai alla pagina Ambienti.

Nell'elenco degli ambienti, fai clic sul nome del tuo ambiente,

example-environment. Viene visualizzata la pagina Dettagli ambiente.Vai alla scheda DAG.

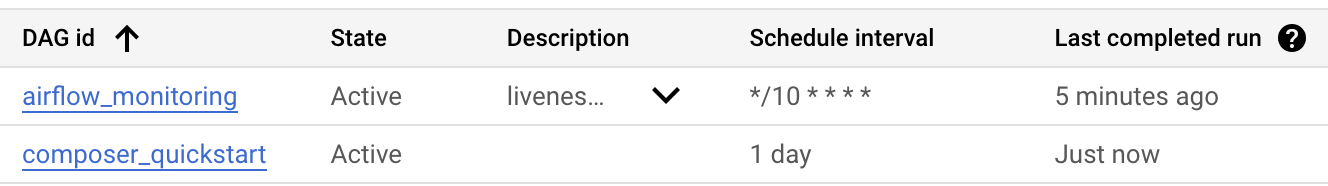

Verifica che il DAG

composer_quickstartsia presente nell'elenco dei DAG.

Figura 1. L'elenco dei DAG mostra il DAG composer_quickstart (fai clic per ingrandire)

Visualizzare i dettagli dell'esecuzione del DAG

Una singola esecuzione di un DAG è chiamata esecuzione di DAG. Airflow esegue immediatamente un'esecuzione DAG per il DAG di esempio perché la data di inizio nel file DAG è impostata su ieri. In questo modo, Airflow recupera la pianificazione del DAG specificato.

Il DAG di esempio contiene un'attività, print_dag_run_conf, che esegue il comando echo

nella console. Questo comando restituisce i metadati del DAG

(l'identificatore numerico dell'esecuzione del DAG).

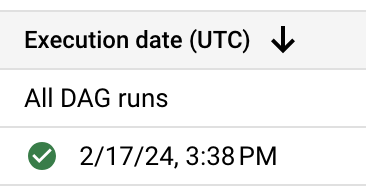

Nella scheda DAG, fai clic su

composer_quickstart. Si apre la scheda Esecuzioni per il DAG.Nell'elenco delle esecuzioni DAG, fai clic sulla prima voce.

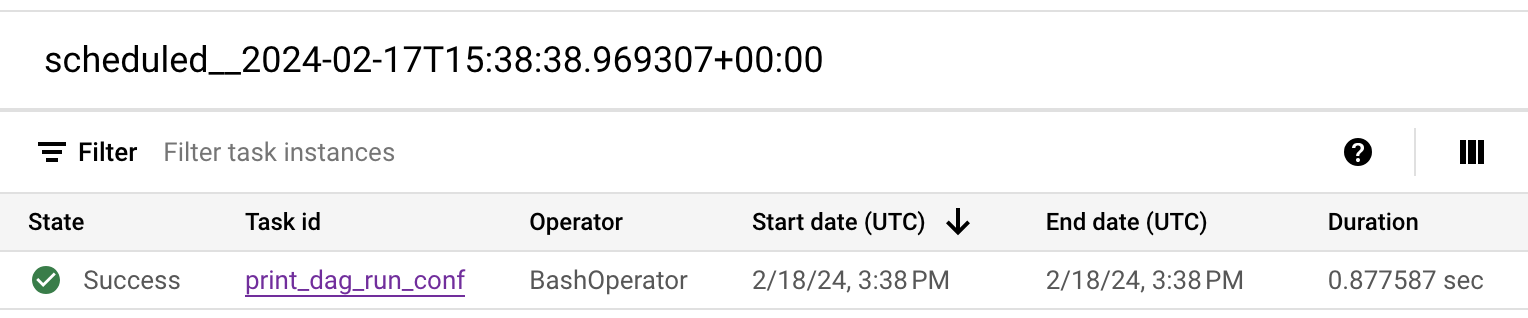

Figura 2. L'elenco delle esecuzioni di DAG per il DAG composer_quickstart (fai clic per ingrandire) Vengono visualizzati i dettagli dell'esecuzione del DAG, che illustrano le informazioni sulle singole attività del DAG di esempio.

Figura 3. L'elenco delle attività eseguite nell'esecuzione del DAG (fai clic per ingrandire) La sezione Log per l'esecuzione del DAG elenca i log per tutte le attività nell'esecuzione del DAG. Puoi visualizzare l'output del comando

echonei log.

Figura 4. Log dell'attività print_dag_run_conf (fai clic per ingrandire)

Esegui la pulizia

Per evitare che al tuo account Google Cloud vengano addebitati costi relativi alle risorse utilizzate in questa pagina, segui questi passaggi.

Elimina le risorse utilizzate in questo tutorial:

Elimina l'ambiente Managed Airflow:

Nella console Google Cloud , vai alla pagina Ambienti.

Seleziona

example-environmente fai clic su Elimina.Attendi l'eliminazione dell'ambiente.

Elimina il bucket del tuo ambiente. L'eliminazione dell'ambiente Managed Airflow non comporta l'eliminazione del relativo bucket.

Nella console Google Cloud , vai alla pagina Storage > Browser.

Seleziona il bucket dell'ambiente e fai clic su Elimina. Ad esempio, questo bucket può essere denominato

us-central1-example-environ-c1616fe8-bucket.

Passaggi successivi