Lakehouse for Apache Iceberg ist eine verwaltete Data Lakehouse-Plattform aufGoogle Cloud. Auf dieser Plattform fungiert der Lakehouse-Laufzeitkatalog als vollständig verwalteter, serverloser Metastore-Dienst. Er bietet eine einzige zuverlässige Informationsquelle für Ihr Data Lakehouse, sodass mehrere Engines – darunter Apache Spark, Apache Flink, Apache Hive und BigQuery – Tabellen und Metadaten gemeinsam nutzen können, ohne Dateien zu kopieren.

Um Abfrage-Engines mit dem Metastore zu verbinden, konfigurieren Sie einen Client mit einem bestimmten Katalogtyp, z. B. dem Endpunkt des Apache Iceberg REST-Katalogs. Dieser Endpunkt verwaltet Tabellenmetadaten und verwendet ein Warehouse für Speicherorte, das von einem Cloud Storage-Bucket unterstützt wird, um die zugrunde liegenden Metadaten und Datendateien zu speichern. Weitere Informationen zur Auswahl eines Katalogs finden Sie unter Katalogtypen und Endpunktkonfiguration.

Der Lakehouse-Laufzeitkatalog unterstützt die Speicherdienstdelegation, auch bekannt als Credential Vending. Dadurch wird die Sicherheit verbessert, da kein direkter Zugriff auf Cloud Storage-Bucket erforderlich ist. Außerdem ist Knowledge Catalog für einheitliche Governance, Lineage und Datenqualität eingebunden. Wenn Tabellen im Lakehouse-Laufzeitkatalog registriert werden, werden entsprechende Einträge automatisch im Katalog für geschäftliche Metadaten (Knowledge Catalog) registriert. So lassen sich Daten konsistent ermitteln und verwalten, ohne dass Dateien verschoben oder kopiert werden müssen.

Hauptfunktionen

Als wichtiger Bestandteil von Lakehouse for Apache Iceberg bietet der Lakehouse-Laufzeitkatalog mehrere Vorteile für die Datenverwaltung und -analyse, darunter eine serverlose Architektur, Engine-Interoperabilität mit offenen APIs, eine einheitliche Benutzeroberfläche sowie leistungsstarke Analysen, Streaming und KI, wenn Sie ihn mit BigQuery verwenden. Weitere Informationen zu diesen Vorteilen finden Sie unter Was ist Lakehouse?.

Integration der Lakehouse-Architektur in Google Cloud -Dienste

Informationen dazu, wie Ihre Daten in Lakehouse verwaltet werden, finden Sie unter Google Cloud -Dienste in die Lakehouse for Apache Iceberg-Architektur einbinden. Bei Apache Iceberg werden Daten nicht in monolithischen Tabellen gespeichert. Stattdessen wird eine mehrschichtige Architektur von Metadatendateien verwendet, um Datendateien in einer zusammenhängenden Tabellenstruktur mit ACID-Transaktionsunterstützung zu organisieren.

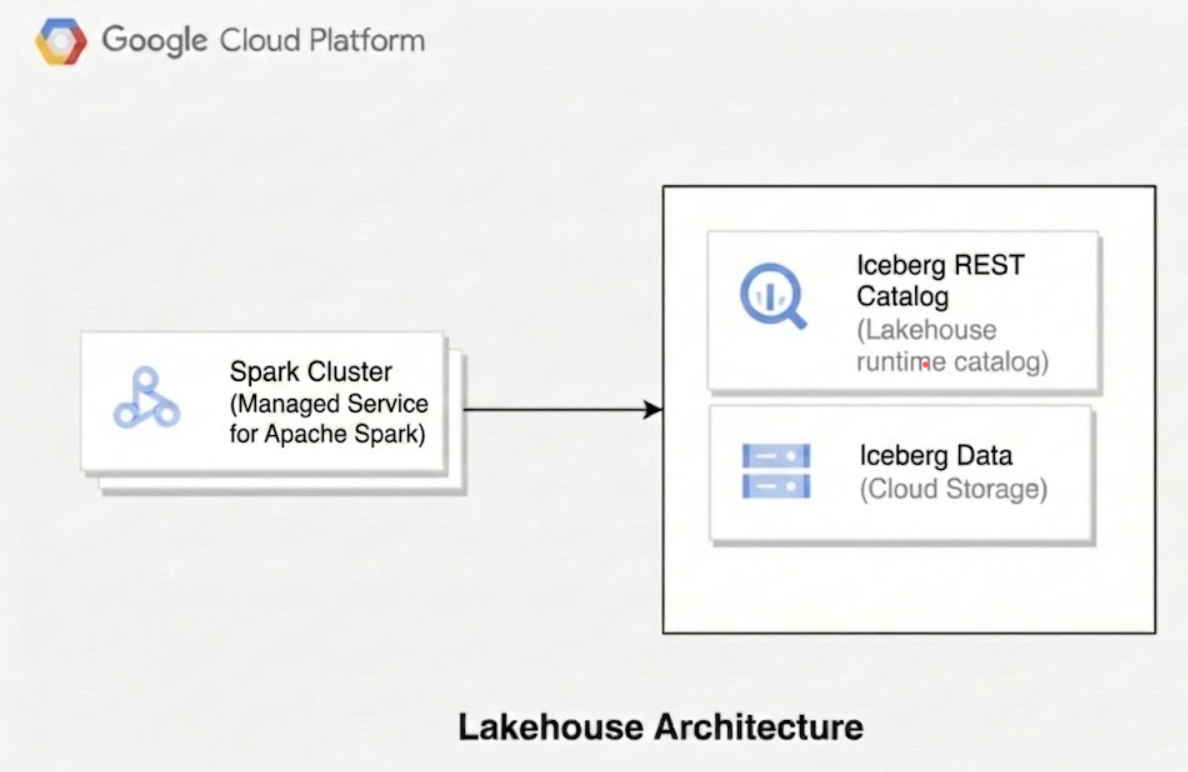

Das folgende Diagramm veranschaulicht, wie Compute-Engines wie Managed Service for Apache Spark den Lakehouse-Laufzeitkatalog verwenden, um Tabellenmetadaten zu verwalten, um zugrunde liegende Parquet-Datendateien direkt in Cloud Storage zu lesen und zu schreiben.

Wenn Sie Lakehouse for Apache Iceberg verwenden, besteht die technische Architektur aus drei verschiedenen Ebenen:

Katalogebene:

- Wichtiges Iceberg-Konzept: Im Katalog wird der aktuelle Status der Tabelle gespeichert, indem ein Zeiger auf die neueste Metadatendatei verwaltet wird. Diese Ebene erleichtert die ACID-Konformität und die Transaktionsisolation, um sicherzustellen, dass sich gleichzeitige Schreibvorgänge nicht gegenseitig stören.

- Lakehouse-Implementierung: Der Lakehouse-Laufzeitkatalog fungiert als regionaler Metastore-Dienst der obersten Ebene. In diesem Dienst erstellen Sie einzelne Kataloge, um Ihre Datenhierarchie zu verwalten. Client-Abfrage-Engines stellen über bestimmte Endpunktkatalogtypen wie den Endpunkt Apache Iceberg REST-Katalog eine Verbindung zu diesen Katalogen her. Der Metastore verwaltet Transaktions-Commits, die Bereitstellung von Anmeldedaten für die Delegierung des Speicherzugriffs und die Zeigerverwaltung in Ihren Katalogen.

Metadatenebene:

- Iceberg-Kernkonzept: In dieser Ebene werden die Tabellenstruktur, Snapshots und Dateispeicherorte mithilfe einer Hierarchie aus drei Dateitypen erfasst:

- Metadatendateien: Hier werden das Tabellenschema, die Partitionsspezifikation und ein Log mit Snapshot-Zeigern gespeichert.

- Manifestlisten: Sie stellen einen einzelnen Snapshot der Tabelle dar, indem sie eine Sammlung von Manifestdateien gruppieren.

- Manifestdateien: Daten werden auf der Ebene der einzelnen Dateien erfasst. Es werden Dateipfade, Partitionsinformationen und Statistiken auf Spaltenebene gespeichert, z. B. Zeilenanzahl sowie Mindest- und Höchstwerte, die zur Abfrageoptimierung und zum Entfernen von Partitionen verwendet werden.

- Lakehouse-Implementierung: In einem Katalogcontainer organisieren Sie Ihre Daten in logischen Namespaces (ähnlich wie Datasets) und Tabellen. Für jede Tabelle generiert und verwaltet der Lakehouse-Laufzeitkatalog die zugrunde liegende Iceberg-Metadatenhierarchie. Diese beginnt mit einer

metadata.json-Datei auf der Stammebene, die auf die Manifestlisten- und Manifestdateien verweist. Im Lakehouse-Laufzeitkatalog werden diese Dateien direkt in Ihrem angegebenen Warehouse-Speicherort gespeichert.

- Iceberg-Kernkonzept: In dieser Ebene werden die Tabellenstruktur, Snapshots und Dateispeicherorte mithilfe einer Hierarchie aus drei Dateitypen erfasst:

Datenschicht:

- Iceberg-Kernkonzept: Diese Komponente ist der zugrunde liegende Speicher, in dem sich die eigentlichen Rohdatensätze befinden, in der Regel in optimierten spalten- oder zeilenbasierten offenen Dateiformaten wie Parquet, ORC oder Avro.

- Lakehouse-Implementierung: Wenn Sie einen Cloud Storage-Bucket (

gs://) als Speicherort für Ihr Data Warehouse konfigurieren, werden die physischen Datendateien, auf die in Ihren Tabellen verwiesen wird, sicher in Ihrem Bucket gespeichert. Der Lakehouse-Laufzeitkatalog verwaltet den Zugriff über die Delegierung des Speicherzugriffs (Bereitstellung von Anmeldedaten) und stellt kurzlebige Zugriffstokens direkt für Client-Engines bereit. So können Engines Datendateien sicher lesen und schreiben, ohne dass umfassende, direkte IAM-Berechtigungen für den zugrunde liegenden Bucket erforderlich sind.

Kompatibilität und Konfiguration der Abfrage-Engine

Um Daten im Lakehouse-Laufzeitkatalog zu analysieren und zu verwalten, können Sie verschiedene Open-Source- und Enterprise-Abfrage-Engines verbinden. Je nach Ihrer vorhandenen Architektur und den Anforderungen Ihrer Arbeitslasten können Sie aus mehreren unterstützten Engines auswählen und den entsprechenden Katalogendpunkt konfigurieren.

Unterstützte Engines

Der Lakehouse-Laufzeitkatalog ist mit mehreren Abfrage-Engines kompatibel, darunter Apache Spark, Apache Flink, Apache Hive und Trino. In der folgenden Tabelle finden Sie Links zur Dokumentation für die einzelnen Engines:

| Engine | Dokumentation |

|---|---|

| Apache Spark | Kurzanleitung: Mit Spark und dem Iceberg-REST-Katalogendpunkt verwenden |

| Apache Hive | Mit Spark und dem Hive-Katalog verwenden |

| Apache Flink | Mit Apache Flink verwenden |

| Trino | Mit Trino verwenden |

Katalogtypen und Endpunktkonfiguration

Wenn Sie Client-Engines für die Verbindung mit dem Metastore des Lakehouse-Laufzeitkatalogs konfigurieren, wählen Sie einen bestimmten Katalog-Endpunkt aus, z. B. den Apache Iceberg-REST-Katalog-Endpunkt oder den Apache Hive-Endpunkt. Die beste Option hängt von Ihrem Anwendungsfall ab, wie in der folgenden Tabelle dargestellt:

| Anwendungsfall | Empfehlung |

|---|---|

| Neue Nutzer des Lakehouse-Laufzeitkatalogs, die mit ihrer Open-Source-Engine auf Daten in Cloud Storage zugreifen möchten und Interoperabilität mit anderen Engines benötigen, einschließlich BigQuery und AlloyDB for PostgreSQL. | Verwenden Sie den Apache Iceberg REST-Katalogendpunkt. |

| Nutzer, die Apache Hive- oder Spark-Arbeitslasten ausführen, die von der Hive Metastore-Schnittstelle abhängen, und einen vollständig verwalteten Metastore-Dienst benötigen. | Verwenden Sie den Apache Hive-Katalogendpunkt. |

| Vorhandene Nutzer des Lakehouse-Laufzeitkatalogs, die aktuelle Tabellen mit dem benutzerdefinierten Apache Iceberg-Katalog für den BigQuery-Endpunkt erstellt haben. | Verwenden Sie weiterhin den benutzerdefinierten Apache Iceberg-Katalog für den BigQuery-Endpunkt, aber verwenden Sie den Apache Iceberg-REST-Katalog für neue Workflows. Tabellen, die mit dem benutzerdefinierten Apache Iceberg-Katalog für den BigQuery-Endpunkt erstellt wurden, sind über die BigQuery-Katalogföderation mit dem Apache Iceberg REST-Katalogendpunkt sichtbar. |

Einschränkungen des Lakehouse-Laufzeitkatalogs

Für Tabellen im Lakehouse-Laufzeitkatalog gelten die folgenden Einschränkungen:

Tabellenverwaltung

- Sie können Tabellen mit dem Apache Iceberg REST-Katalogendpunkt nicht mit DDL-Anweisungen (Datendefinitionssprache) oder DML-Anweisungen (Datenbearbeitungssprache) von BigQuery erstellen oder ändern. Sie können diese Tabellen mit der BigQuery API (mit dem bq-Befehlszeilentool oder Clientbibliotheken) ändern. Dabei besteht jedoch das Risiko, dass Sie Änderungen vornehmen, die mit der externen Engine nicht kompatibel sind.

- Tabellen im Lakehouse-Laufzeitkatalog unterstützen keine Umbenennungsvorgänge oder die Spark SQL-Anweisung

ALTER TABLE ... RENAME TO. - Tabellen im Lakehouse-Laufzeitkatalog unterstützen kein Clustering.

- Tabellen im Lakehouse-Laufzeitkatalog unterstützen keine flexiblen Spaltennamen.

- Der Lakehouse-Laufzeitkatalog unterstützt keine Apache Iceberg-Ansichten.

Abfragen

- Die Abfrageleistung für Tabellen im Lakehouse-Laufzeitkatalog über die BigQuery-Engine ist mitunter geringer als bei der Abfrage von Daten in BigQuery-Standardtabellen. Im Allgemeinen sollte die Abfragegeschwindigkeit dem Lesen von Daten aus Cloud Storage entsprechen.

- Ein BigQuery-Probelauf einer Abfrage, die eine Tabelle im Lakehouse-Laufzeitkatalog verwendet, kann eine Untergrenze von 0 Byte an Daten melden, auch wenn Zeilen zurückgegeben werden. Dieses Ergebnis tritt auf, weil die Datenmenge, die aus der Tabelle verarbeitet wird, erst nach Ausführung der vollständigen Abfrage bestimmt werden kann. Für die Ausführung der Abfrage fallen weiterhin Kosten für die Verarbeitung dieser Daten an.

- Sie können in einer Abfrage mit einer Platzhaltertabelle nicht auf eine Tabelle im Lakehouse-Laufzeitkatalog verweisen.

API und Metadaten

- Sie können die

tabledata.list-Methode nicht verwenden, um Daten aus Tabellen im Lakehouse-Laufzeitkatalog abzurufen. Stattdessen können Sie Abfrageergebnisse in einer BigQuery-Tabelle speichern und dann die Methodetabledata.listfür diese Tabelle verwenden. - Die Anzeige von Tabellenspeicherstatistiken für Tabellen im Lakehouse-Laufzeitkatalog wird nicht unterstützt.

Kontingente und Limits

- Für Tabellen im Lakehouse-Laufzeitkatalog in BigQuery gelten dieselben Kontingente und Limits wie für Standardtabellen.

Unterschiede zum klassischen BigLake-Metastore

Die wichtigsten Unterschiede zwischen dem Lakehouse-Laufzeitkatalog und dem BigLake-Metastore (klassisch) sind:

- Der Lakehouse-Laufzeitkatalog unterstützt eine direkte Integration mit Open-Source-Engines wie Spark. So lässt sich Redundanz beim Speichern von Metadaten und Ausführen von Jobs vermeiden. Auf Tabellen im Lakehouse-Laufzeitkatalog kann direkt über mehrere Open-Source-Engines und BigQuery zugegriffen werden.

- Der Lakehouse-Laufzeitkatalog unterstützt den Apache Iceberg-REST-Katalogendpunkt, der klassische BigLake Metastore jedoch nicht.