Google Cloud menyediakan image yang berisi sistem operasi, framework, library, dan driver umum. Google Cloud mengoptimalkan image yang telah dikonfigurasi sebelumnya ini untuk mendukung workload kecerdasan buatan (AI) dan machine learning (ML) Anda.

Dokumen ini memberikan ringkasan tentang image yang Anda gunakan untuk men-deploy, mengelola, dan menjalankan workload di lingkungan AI Hypercomputer Anda.

Memahami kategori gambar

Gambar dikelompokkan ke dalam kategori berikut:

- Framework dan library AI dan ML: Image Docker yang telah dikonfigurasi sebelumnya dengan biner untuk framework dan library ML guna menyederhanakan pembuatan, pelatihan, dan penggunaan model ML. Di AI Hypercomputer, Anda dapat menggunakan image Docker Deep Learning Software Layer (DLSL) untuk menjalankan model ML seperti NeMO dan MaxText di cluster Google Kubernetes Engine (GKE).

- Deployment dan orkestrasi cluster: image sistem operasi (OS) yang Anda gunakan untuk men-deploy dan mengelola infrastruktur yang dioptimalkan untuk performa tempat workload AI Anda berjalan. Anda dapat men-deploy workload AI di cluster GKE, cluster Slurm, atau instance Compute Engine.

Untuk mengetahui informasi selengkapnya, lihat

Ringkasan pembuatan VM dan cluster.

Image sistem operasi berikut tersedia untuk deployment cluster atau instance:

- Image node GKE: Anda dapat menggunakan image ini untuk men-deploy cluster GKE.

- Image OS Slurm: Cluster Toolkit membangun dan men-deploy image ini, yang menginstal software sistem yang diperlukan untuk node Slurm.

- Image OS akselerator: Anda dapat menggunakan image ini untuk membuat instance individual atau grup instance.

Framework dan library AI dan ML

Google Cloud menyediakan image Docker yang memaketkan framework dan library AI dan ML populer. Image ini menyediakan software yang diperlukan untuk menyederhanakan pengembangan, pelatihan, dan deployment model di cluster yang dioptimalkan untuk AI yang berjalan di AI Hypercomputer.

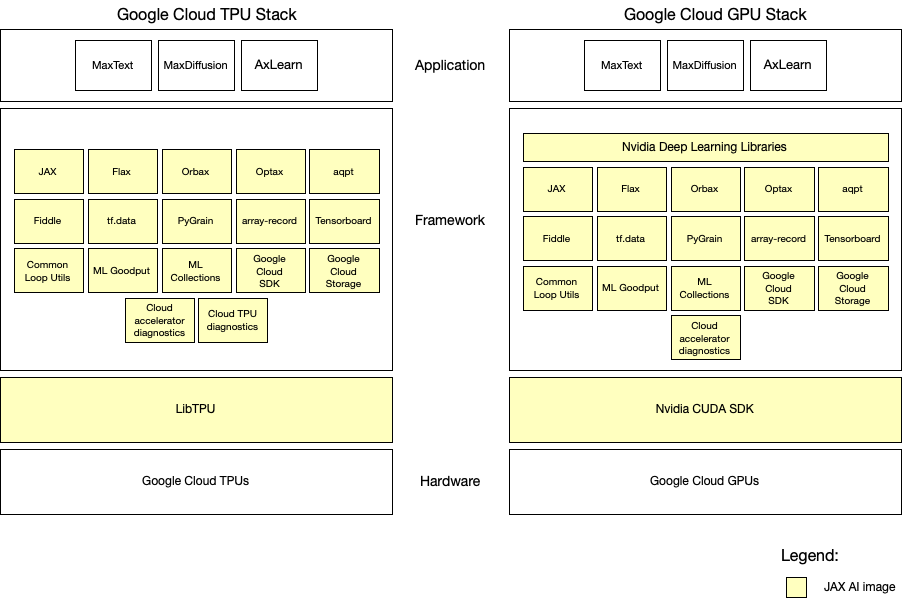

Gambar AI JAX

Image AI JAX (JAII, sebelumnya dikenal sebagai JAX Stable Stack Images) untuk Google Cloud TPU dan GPU menawarkan image Docker siap pakai yang berisi framework JAX, kumpulan library yang kompatibel, dan setelan untuk infrastruktur Google Cloud . Image TPU AI JAX telah dikonfigurasi sebelumnya dengan library JAX dan library TPU. Image GPU AI JAX telah dikonfigurasi sebelumnya dengan library JAX dan library CUDA/NVIDIA yang relevan.

Lapisan hardware

Gambar AI JAX berada di atas lapisan hardware yang terdiri dari akselerator (TPU atau GPU) dan VM terkait. Untuk menggunakan image AI JAX, Anda harus menyediakan VM TPU atau GPU. Anda dapat melakukannya menggunakan TPU API, Compute Engine API, atau GKE API.

Lapisan framework

Lapisan framework menyediakan alat dan library untuk membangun workload ML. Image AI JAX menyediakan dasar yang telah dikonfigurasi sebelumnya untuk workload ML berbasis JAX, termasuk library JAX inti dan dependensi penting lainnya, untuk memastikan pengalaman pengembangan yang konsisten dan berperforma tinggi.

Lapisan LibTPU dalam gambar AI JAX dibuat dan dibundel secara khusus dengan versi JAX masing-masing. Menggunakan versi JAX yang berbeda dapat menyebabkan perilaku atau error yang tidak terduga.

Lapisan CUDA dalam image AI JAX mencakup komponen yang dikelola oleh NVIDIA, seperti NGC CUDA Deep Learning Image, yang digunakan sebagai image dasar GPU Training Image. Image GPU juga berisi Transformer Engine, library NVIDIA kustom untuk mempercepat model transformer di GPU NVIDIA.

Paket khusus aplikasi tambahan, di luar yang disediakan dalam image AI JAX, mungkin diperlukan untuk workload machine learning spesifik Anda.

Library di JAX AI Images:

Gambar TPU

| Fungsi | Nama Paket |

|---|---|

| Library atau Komponen Inti | |

| Framework ML | JAX dan JAX lib |

| LibTPU | Rilis stabil Cloud LibTPU |

| Library Lapisan/Model | Flax |

| Checkpointing | Orbax |

| Kuantisasi | Qwix |

| Pengoptimal | Optax |

| Kernel Kustom | Tokamax |

| Konfigurasi | Fiddle |

| Pipeline input | tf.data |

| Pembuatan profil, proses debug | Tensorboard |

| Utils | Utilitas loop umum |

| Alat Khusus Cloud | |

| Google Cloud | |

| Diagnostik | |

Gambar GPU

| Fungsi | Nama Paket |

|---|---|

| Library atau Komponen Inti | |

| Framework ML | JAX dan JAX lib |

| Library NVIDIA CUDA | Gambar DL CUDA |

| Library Lapisan/Model | Flax |

| Checkpointing | Orbax |

| Pengoptimal | |

| Konfigurasi | Fiddle |

| Pipeline input | |

| Pembuatan profil, proses debug | Tensorboard |

| Utils | |

| Alat Khusus Cloud | |

| Google Cloud | |

| Diagnostik | Diagnostik Cloud Accelerator |

Gambar AI JAX saat ini

Gambar TPU

| Gambar AI JAX | Tanggal rilis |

|---|---|

| JAX 0.9.0 Revisi 1 | 2026-02-03 |

| JAX 0.8.2 Revisi 1 | 2026-01-14 |

| JAX 0.8.1 Revisi 1 | 2025-11-21 |

| JAX 0.8.0 Revisi 1 | 2025-10-28 |

| JAX 0.7.2 Revisi 1 | 2025-09-30 |

| JAX 0.7.0 Revisi 1 | 2025-07-29 |

| JAX 0.6.1 Revisi 1 | 2025-06-05 |

| JAX 0.5.2 Revisi 2 | 2025-04-25 |

| JAX 0.5.2 Revisi 1 | 2025-03-17 |

| JAX 0.4.37 Revisi 1 | 2024-12-12 |

| JAX 0.4.35 Revisi 1 | 2024-10-30 |

Gambar GPU

| Gambar AI JAX | Tanggal rilis |

|---|---|

| JAX 0.7.2 dengan CUDA DL 25.06 Revisi 1 | 2025-09-30 |

| JAX 0.6.1 dengan CUDA DL 25.03 Revisi 1 | 2025-06-05 |

| JAX 0.5.1 dengan CUDA DL 25.02 Revisi 1 | 2025-03-17 |

Lapisan aplikasi

Anda menerapkan workload ML spesifik di lapisan aplikasi yang berada di atas lapisan framework. Lapisan aplikasi berisi kode, model, dan logika khusus aplikasi Anda, yang semuanya dibangun menggunakan alat dan library yang disediakan oleh lapisan framework.

Meskipun image ini memberikan fondasi yang kuat dan teruji dengan baik untuk beban kerja AI berbasis JAX, Anda mungkin perlu menambahkan dependensi khusus aplikasi. Saat melakukannya, sebaiknya Anda melakukannya dengan cara yang meminimalkan gangguan pada lapisan dasar yang telah dikonfigurasi sebelumnya, yang mencakup JAX dan dependensi intinya. Memperkenalkan dependensi tingkat aplikasi yang menggantikan atau berkonflik dengan dependensi yang ada dapat menyebabkan efek samping seperti:

- Perilaku yang Tidak Terduga: beban kerja ML Anda mungkin menunjukkan perilaku yang berbeda dari sebelumnya setelah Anda memperkenalkan dependensi tambahan pada image AI JAX.

- Regresi Performa: mengganti library terkait JAX yang dioptimalkan dapat berdampak negatif pada manfaat performa yang diberikan oleh gambar AI JAX

- Masalah Stabilitas: konflik antara dependensi yang Anda tambahkan dan dependensi JAX inti dapat menyebabkan ketidakstabilan dan error runtime dalam aplikasi Anda.

Frekuensi Rilis

Awalnya, gambar AI JAX disediakan setiap tiga bulan dengan tujuan jangka pendek berupa jadwal rilis yang disinkronkan dengan setiap rilis JAX. Dengan demikian, Anda dapat memanfaatkan fitur dan peningkatan terbaru segera setelah tersedia.

Dukungan

Setiap rilis image AI JAX mematuhi siklus proses dukungan berbatas waktu. Dalam jangka waktu ini, kami menangani kategori permintaan tertentu untuk modifikasi pada gambar AI JAX yang sudah ada:

- Kerentanan keamanan: kami memprioritaskan penanganan kerentanan keamanan yang ditemukan dalam image dasar atau dependensi image Docker JAX Stable Stack. Gambar yang diperbarui akan dirilis untuk mengurangi potensi risiko.

- Perubahan yang menyebabkan gangguan: jika terjadi perubahan yang menyebabkan gangguan signifikan pada library atau framework pokok yang digunakan oleh gambar AI JAX, Google Cloud mengevaluasi dan menerapkan update yang diperlukan untuk mempertahankan kompatibilitas. Hal ini mungkin melibatkan pembangunan ulang image Docker dengan dependensi yang telah diupdate.

Jika kerentanan keamanan atau bug ditemukan di library dalam JAII, kami akan menggabungkan library yang diupdate ke dalam JAII, menyematkan semua versi library lainnya untuk mempertahankan stabilitas secara keseluruhan. Tindakan ini akan menghasilkan revisi JAII baru.

Perubahan minimal untuk revisi:

Jika bug ditemukan dalam paket "X" dalam JAX-0.4.30-rev1, kami akan mengupdate "X" ke rilis berikutnya (misalnya, v2.0) sambil mencoba mempertahankan semua paket lainnya tanpa perubahan. Hal ini menghasilkan revisi baru: JAX-0.4.30-rev2, yang akan dirilis secepat mungkin.

Image Docker Deep Learning Software Layer (DLSL)

Image ini memaketkan NVIDIA CUDA, NCCL, framework ML, dan model. VM ini menyediakan lingkungan siap pakai untuk workload deep learning. Image Docker DLSL yang telah dibuat sebelumnya ini berfungsi lancar dengan cluster GKE Anda karena kami menguji dan memverifikasi image ini selama pengujian regresi dan reproduksibilitas internal.

Image Docker DLSL memberikan manfaat berikut:

- Software yang telah dikonfigurasi sebelumnya: Image Docker DLSL mereplikasi penyiapan yang digunakan oleh pengujian regresi dan reproduksibilitas internal. Image ini menyediakan lingkungan yang telah dikonfigurasi sebelumnya, diuji, dan dioptimalkan, sehingga menghemat banyak waktu dan tenaga dalam penginstalan dan konfigurasi.

- Pengelolaan versi: Image Docker DLSL sering diupdate. Update versi ini menyediakan framework dan driver versi stabil terbaru, dan update ini juga menangani patch keamanan.

- Kompatibilitas infrastruktur: Image Docker DLSL dibuat dan diuji agar berfungsi lancar dengan jenis mesin GPU yang tersedia di AI Hypercomputer.

- Petunjuk panduan memulai: beberapa image Docker DLSL memiliki resep contoh yang menunjukkan cara memulai workload yang menggunakan image yang telah dikonfigurasi sebelumnya.

Plugin gIB NeMo + PyTorch + NCCL

Image Docker ini didasarkan pada image NGC NVIDIA NeMo. Paket ini berisi plugin gIB NCCL Google dan memaketkan semua biner NCCL yang diperlukan untuk menjalankan workload di setiap mesin akselerator yang didukung. Image ini juga mencakup Google Cloud

alat seperti gcsfuse dan

gcloud CLI untuk men-deploy workload ke

Google Kubernetes Engine.

| Versi gambar DLSL | Versi dependensi | Seri mesin | Tanggal rilis | Akhir tanggal dukungan | Nama gambar DLSL |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 3 Juli 2025 | 3 Juli 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 3 Juli 2025 | 3 Juli 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 14 Maret 2025 | 14 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2 Februari 2025 | 2 Februari 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2 Februari 2025 | 2 Februari 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 7 Februari 2025 | 7 Februari 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 Maret 2025 | 12 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 Tinggi (8 GPU) | 12 Maret 2025 | 12 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

Image Docker ini didasarkan pada image NVIDIA NeMo NGC dan

mencakup Google Cloud alat seperti

gcsfuse dan

gcloud CLI untuk men-deploy workload ke

Google Kubernetes Engine.

| Versi gambar DLSL | Versi dependensi | Seri mesin | Tanggal rilis | Akhir tanggal dukungan | Nama gambar DLSL |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | 19 Desember 2024 | 19 Desember 2025 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 Maret 2025 | 12 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 Tinggi (8 GPU) | 12 Maret 2025 | 12 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

Toolbox MaxText + JAX

Image Docker ini didasarkan pada image toolbox NVIDIA JAX dan mencakup

Google Cloud alat seperti

gcsfuse dan

gcloud CLI untuk men-deploy workload ke

Google Kubernetes Engine.

| Versi gambar DLSL | Versi dependensi | Seri mesin | Tanggal rilis | Akhir tanggal dukungan | Nama gambar DLSL |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 11 Maret 2025 | 11 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 17 Maret 2025 | 17 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 Tinggi (8 GPU) | 17 Maret 2025 | 17 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

Stack stabil MaxText + JAX

Image Docker ini didasarkan pada

stack stabil JAX

dan MaxText. Image ini juga mencakup dependensi seperti dnsutils untuk menjalankan workload di Google Kubernetes Engine.

| Versi gambar DLSL | Versi dependensi | Seri mesin | Tanggal rilis | Akhir tanggal dukungan | Nama gambar DLSL |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 17 Maret 2025 | 17 Maret 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

Deployment dan orkestrasi cluster

Image OS mencakup semua komponen software yang diperlukan untuk men-deploy sistem operasi pada instance komputasi atau node GKE. Sistem operasi mengelola resource hardware yang mendasarinya, seperti akselerator dan jaringan. Hal ini menyediakan resource komputasi untuk workload AI Anda.

Image node GKE

GKE men-deploy cluster menggunakan image node. Image node ini tersedia untuk berbagai sistem operasi seperti Container-Optimized OS, Ubuntu, dan Windows Server. Image node Container-Optimized OS dengan containerd (cos_containerd) yang perlu Anda deploy untuk cluster GKE Autopilot mencakup pengoptimalan untuk mendukung workload AI dan ML Anda.

Untuk mengetahui informasi selengkapnya tentang image node ini, lihat Image node.

Image OS Slurm

Cluster Slurm men-deploy node komputasi dan pengontrol sebagai instance komputasi di Compute Engine.

Untuk menyediakan cluster Slurm yang dioptimalkan untuk AI, Anda harus menggunakan Cluster Toolkit. Selama deployment cluster Slurm, blueprint cluster akan otomatis membuat image OS kustom yang menginstal software sistem yang diperlukan untuk pengelolaan cluster dan beban kerja di node Slurm. Anda dapat mengubah cetak biru default sebelum men-deploy-nya untuk menyesuaikan beberapa software yang disertakan dalam image Anda.

Bagian berikut merangkum software yang diinstal cetak biru cluster di node Slurm A4, A3 Ultra, A3 Mega, dan A3 High (8 GPU). Blueprint cluster memperluas image OS Ubuntu LTS Accelerator.

A4X Max

Blueprint A4X Max yang tersedia di GitHub menyertakan software berikut secara default:

- Ubuntu 24.04 LTS

- Slurm: versi 25.05.2

- Dependensi Slurm berikut:

mungemariadblibjwtlmod

- Open MPI: versi 5.0.x

- Klien dan server NFS

- Driver seri NVIDIA 580

- NVIDIA Enroot

- NVIDIA Pyxis

- Alat NVIDIA berikut:

- Data Center GPU Manager (

dcgmi) nvidia-container-toolkit: versi 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager (

- CUDA Toolkit: versi 13.0

- Plugin NCCL untuk A4X Max (

nccl-gib-a4x-max-arm64) - Driver DOCA-OFED

- Agen Operasional

- Cloud Storage FUSE

A4X

Blueprint A4X yang tersedia di GitHub menyertakan software berikut secara default:

- Ubuntu 24.04 LTS

- Slurm: versi 25.05.2

- Dependensi Slurm berikut:

mungemariadblibjwtlmod

- Open MPI: versi 5.0.x

- Klien dan server NFS

- Driver seri NVIDIA 570

- NVIDIA Enroot

- NVIDIA Pyxis

- Alat NVIDIA berikut:

- Data Center GPU Manager (

dcgmi) nvidia-container-toolkit: versi 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager (

- CUDA Toolkit: versi 12.8

- Plugin NCCL untuk A4X (

nccl-plugin-gib-arm64) - Agen Operasional

- Cloud Storage FUSE

A4

Blueprint A4 yang tersedia di GitHub menyertakan software berikut secara default:

- Ubuntu 22.04 LTS

- Slurm: versi 25.05.2

- Dependensi Slurm berikut:

mungemariadblibjwtlmod

- Open MPI: rilis terbaru 4.1.x

- PMIx: versi 4.2.9

- Klien dan server NFS

- Driver seri NVIDIA 570

- Runtime container enroot NVIDIA: versi 3.5.0 dengan perbaikan bug pasca-rilis

- NVIDIA pyxis

- Alat NVIDIA berikut:

- Data Center GPU Manager (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- Data Center GPU Manager (

- CUDA Toolkit: versi 12.8

- Dukungan Infiniband, termasuk

ibverbs-utils - Agen Operasional

- Cloud Storage FUSE

A3 Ultra

Blueprint A3 Ultra yang tersedia di GitHub menyertakan software berikut secara default:

- Ubuntu 22.04 LTS

- Slurm: versi 24.11.2

- Dependensi Slurm berikut:

mungemariadblibjwtlmod

- Open MPI: rilis terbaru 4.1.x

- PMIx: versi 4.2.9

- Klien dan server NFS

- Driver seri NVIDIA 570

- Runtime container enroot NVIDIA: versi 3.5.0 dengan perbaikan bug pasca-rilis

- NVIDIA pyxis

- Alat NVIDIA berikut:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- Data Center GPU Manager (

- CUDA Toolkit: versi 12.8

- Dukungan Infiniband, termasuk

ibverbs-utils - Agen Operasional

- Cloud Storage FUSE

A3 Mega

Blueprint A3 Mega yang tersedia di GitHub menyertakan software berikut secara default:

- Ubuntu 22.04 LTS

- Slurm: versi 24.11.2

- Dependensi Slurm berikut:

mungemariadblibjwtlmod

- Open MPI: rilis terbaru 4.1.x

- PMIx: versi 4.2.9

- Klien dan server NFS

- Driver seri NVIDIA 550

- Runtime container enroot NVIDIA: versi 3.4.1

- NVIDIA pyxis

- Alat NVIDIA berikut:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- Data Center GPU Manager (

- CUDA Toolkit: versi 12.4

- Dukungan Infiniband, termasuk

ibverbs-utils - TCPXO untuk A3 Mega: penginstal khusus untuk NCCL TCPXO dan stack jaringan 1,6 Tbps

- Agen Operasional

- Cloud Storage FUSE

A3 Tinggi

Blueprint A3 High (8 GPU) yang tersedia di GitHub menyertakan software berikut secara default:

- Ubuntu 22.04 LTS

- Slurm: versi 24.11.2

- Dependensi Slurm berikut:

mungemariadblibjwtlmod

- Open MPI: rilis terbaru 4.1.x

- PMIx: versi 4.2.9

- Klien dan server NFS

- Driver seri NVIDIA 535 atau 550

- Runtime container enroot NVIDIA: versi 3.4.1

- NVIDIA pyxis

- Alat NVIDIA berikut:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- Data Center GPU Manager (

- CUDA Toolkit: versi 12.2 atau 12.4

- Dukungan Infiniband, termasuk

ibverbs-utils - TCPX untuk A3 Tinggi (8 GPU): penginstal khusus untuk NCCL TCPX (GPUDirect-TCPX) dan stack jaringan 800 Gbps (4 NIC)

- Agen Operasional

- Cloud Storage FUSE

OS image akselerator

AI Hypercomputer memungkinkan Anda menyediakan instance komputasi individual atau grup instance komputasi. Jika ingin membuat instance ini, Anda harus menentukan image OS selama pembuatan instance.

Google Cloud menawarkan serangkaian OS image untuk pembuatan instance. Google Cloud juga menawarkan serangkaian OS image akselerator khusus untuk instance yang dioptimalkan untuk AI. Image OS ini mencakup driver inti untuk fungsi GPU dan jaringan, seperti driver NVIDIA, driver Mellanox, dan dependensinya.

Untuk mengetahui informasi selengkapnya tentang setiap OS, lihat halaman Detail sistem operasi di dokumentasi Compute Engine.

Image OS akselerator tersedia untuk sistem operasi Rocky Linux dan Ubuntu LTS.

Akselerator Rocky Linux

Image OS akselerator Rocky Linux berikut tersedia untuk setiap seri mesin:

| Versi OS | Kelompok gambar | Arsitektur | Seri mesin | Project gambar |

|---|---|---|---|---|

| Akselerator Rocky Linux 9 | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

| Akselerator Rocky Linux 8 | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

Akselerator Ubuntu LTS

Image OS akselerator Ubuntu LTS berikut tersedia untuk setiap seri mesin:

| Versi OS | Kelompok gambar | Arsitektur | Seri mesin | Project gambar |

|---|---|---|---|---|

| Akselerator Ubuntu 24.04 LTS | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

| Akselerator Ubuntu 22.04 LTS | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |