Google Cloud 提供內含常見作業系統、架構、程式庫和驅動程式的映像檔。 Google Cloud 將這些預先設定的映像檔最佳化,支援人工智慧 (AI) 和機器學習 (ML) 工作負載。

本文概述用於在 AI Hypercomputer 環境中部署、管理及執行工作負載的映像檔。

瞭解圖像類別

圖片會歸入下列類別:

- AI 和機器學習架構、程式庫:預先設定機器學習架構和程式庫二進位檔的 Docker 映像檔,可簡化機器學習模型的建立、訓練和使用程序。在 AI Hypercomputer 上,您可以使用深度學習軟體層 (DLSL) Docker 映像檔,在 Google Kubernetes Engine (GKE) 叢集執行 NeMO 和 MaxText 等機器學習模型。

- 叢集部署和自動化調度管理:您用來部署及管理效能最佳化基礎架構的作業系統 (OS) 映像檔,AI 工作負載會在該基礎架構上執行。您可以在 GKE 叢集、Slurm 叢集或 Compute Engine 執行個體上,部署 AI 工作負載。詳情請參閱「VM 和叢集建立總覽」。下列作業系統映像檔可用於叢集或執行個體部署作業:

- GKE 節點映像檔:您可以使用這些映像檔部署 GKE 叢集。

- Slurm OS 映像檔:Cluster Toolkit 會建構及部署這些映像檔,並為 Slurm 節點安裝必要的系統軟體。

- 加速器 OS 映像檔:您可以使用這些映像檔建立個別或群組執行個體。

AI 和機器學習架構與程式庫

Google Cloud 提供 Docker 映像檔,其中包含熱門的 AI 和 ML 架構與程式庫。這些映像檔提供所需的軟體,可簡化在 AI Hypercomputer 上執行的 AI 最佳化叢集模型開發、訓練和部署作業。

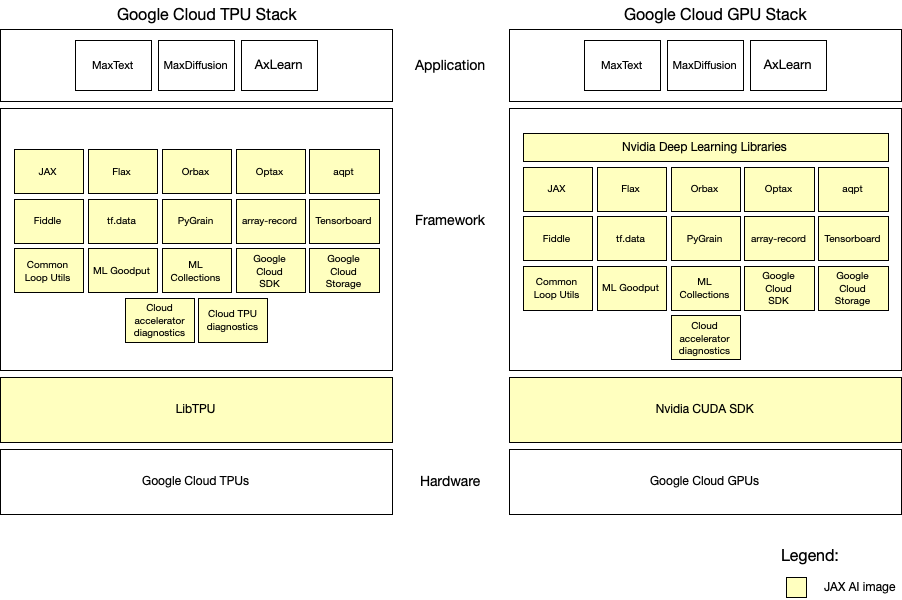

JAX AI 圖像

適用於Google Cloud TPU 和 GPU 的 JAX AI 映像檔 (JAII,舊稱 JAX Stable Stack 映像檔) 提供可立即使用的 Docker 映像檔,其中包含 JAX 框架、精選的相容程式庫,以及 Google Cloud 基礎架構的設定。JAX AI TPU 映像檔已預先設定 JAX 程式庫和 TPU 程式庫。JAX AI GPU 映像檔已預先設定 JAX 程式庫和相關的 CUDA/NVIDIA 程式庫。

硬體層

JAX AI 圖片位於硬體層之上,硬體層由加速器 (TPU 或 GPU) 和相關聯的 VM 組成。如要使用 JAX AI 圖片,您需要佈建 TPU 或 GPU VM。您可以使用 TPU API、Compute Engine API 或 GKE API 執行這項操作。

架構層

架構層提供建構機器學習工作負載的工具和程式庫。JAX AI 映像檔為以 JAX 為基礎的機器學習工作負載提供預先設定的基礎,包括核心 JAX 程式庫和其他必要依附元件,確保開發體驗一致且高效能。

JAX AI 映像檔中的 LibTPU 層是專門建構而成,並與對應的 JAX 版本一併封裝。使用其他 JAX 版本可能會導致非預期的行為或錯誤。

JAX AI 映像檔中的 CUDA 層包含 NVIDIA 管理的元件,例如 NGC CUDA 深度學習映像檔 (用做 GPU 訓練映像檔的基本映像檔)。GPU 映像檔也包含 Transformer Engine,這是 NVIDIA 的自訂程式庫,可加速 NVIDIA GPU 上的 Transformer 模型。

除了 JAX AI 映像檔提供的套件外,您可能還需要其他應用程式專屬套件,才能執行特定的機器學習工作負載。

JAX AI 圖像中的程式庫:

TPU 映像檔

| 功能 | 套裝組合名稱 |

|---|---|

| 核心程式庫或元件 | |

| 機器學習框架 | JAX 和 JAX 程式庫 |

| LibTPU | Cloud LibTPU 穩定版發布 |

| 圖層/模型庫 | Flax |

| 查核點機制 | Orbax |

| 量化 | Qwix |

| 最佳化工具 | Optax |

| 自訂核心 | Tokamax |

| 設定 | Fiddle |

| 輸入管道 | tf.data |

| 剖析、偵錯 | Tensorboard |

| Utils | 常見迴圈公用程式 |

| 雲端專屬工具 | |

| Google Cloud | |

| 診斷 | |

GPU 映像檔

| 功能 | 套裝組合名稱 |

|---|---|

| 核心程式庫或元件 | |

| 機器學習框架 | JAX 和 JAX 程式庫 |

| NVIDIA CUDA 程式庫 | CUDA DL 映像檔 |

| 圖層/模型庫 | Flax |

| 查核點機制 | Orbax |

| 最佳化工具 | |

| 設定 | Fiddle |

| 輸入管道 | |

| 剖析、偵錯 | Tensorboard |

| Utils | |

| 雲端專屬工具 | |

| Google Cloud | |

| 診斷 | Cloud Accelerator 診斷 |

目前 JAX AI 圖像

TPU 映像檔

| JAX AI 圖片 | 發布日期 |

|---|---|

| JAX 0.9.0 修訂版本 1 | 2026-02-03 |

| JAX 0.8.2 修訂版本 1 | 2026-01-14 |

| JAX 0.8.1 修訂版本 1 | 2025-11-21 |

| JAX 0.8.0 修訂版 1 | 2025-10-28 |

| JAX 0.7.2 修訂版本 1 | 2025-09-30 |

| JAX 0.7.0 修訂版本 1 | 2025-07-29 |

| JAX 0.6.1 修訂版本 1 | 2025-06-05 |

| JAX 0.5.2 修訂版本 2 | 2025-04-25 |

| JAX 0.5.2 修訂版本 1 | 2025-03-17 |

| JAX 0.4.37 修訂版本 1 | 2024-12-12 |

| JAX 0.4.35 修訂版本 1 | 2024-10-30 |

GPU 映像檔

| JAX AI 圖片 | 發布日期 |

|---|---|

| JAX 0.7.2,搭配 CUDA DL 25.06 修訂版本 1 | 2025-09-30 |

| JAX 0.6.1,搭配 CUDA DL 25.03 修訂版本 1 | 2025-06-05 |

| JAX 0.5.1,搭配 CUDA DL 25.02 修訂版本 1 | 2025-03-17 |

應用程式層

您會在應用程式層實作特定的機器學習工作負載,而應用程式層位於架構層的頂端。應用程式層包含應用程式專屬的程式碼、模型和邏輯,全都是使用架構層提供的工具和程式庫建構而成。

雖然這個映像檔為 JAX 型 AI 工作負載提供穩健且經過充分測試的基礎,但您可能需要新增應用程式專屬的依附元件。這麼做時,建議您盡量減少對預先設定的基礎層 (包括 JAX 和其核心依附元件) 的干擾。導入會覆寫或與現有依附元件衝突的應用程式層級依附元件,可能會導致下列副作用:

- 非預期行為:在 JAX AI 映像檔中導入其他依附元件後,機器學習工作負載的行為可能與先前不同。

- 效能回歸:覆寫最佳化 JAX 相關程式庫可能會對 JAX AI 圖像提供的效能優勢造成負面影響

- 穩定性問題:新增的依附元件與核心 JAX 依附元件之間的衝突,可能會導致應用程式不穩定,並發生執行階段錯誤。

發布頻率

JAX AI 圖片最初會每季提供一次,短期目標是與每次 JAX 發布同步發布時間表。這樣一來,您就能在第一時間享有最新的功能和改善項目。

支援

每個 JAX AI 圖片版本都遵循支援生命週期,但支援時間有限。在此時間範圍內,我們會處理現有 JAX AI 圖像的特定類別修改要求:

- 安全漏洞:我們會優先處理在 JAX Stable Stack Docker 映像檔的基礎映像檔或依附元件中發現的安全漏洞。我們將發布更新版映像檔,以降低潛在風險。

- 重大破壞性變更:如果 JAX AI 圖像使用的基礎程式庫或架構發生重大破壞性變更, Google Cloud會評估並實作必要更新,以維持相容性。這可能需要使用更新的依附元件重建 Docker 映像檔。

如果 JAII 內的程式庫發現安全漏洞或錯誤,我們會將更新後的程式庫併入 JAII,並固定所有其他程式庫版本,以維持整體穩定性。這會產生新的 JAII 修訂版本。

修訂版本變更內容下限:

如果在 JAX-0.4.30-rev1 中發現「X」套件有錯誤,我們會將「X」更新至下一個版本 (例如 v2.0),同時盡量維持所有其他套件不變。這會產生新的修訂版本:JAX-0.4.30-rev2,我們會盡快發布。

深度學習軟體層 (DLSL) Docker 映像檔

這些映像檔會封裝 NVIDIA CUDA、NCCL、機器學習架構和模型。這些映像檔提供立即可用的環境,可執行深度學習工作負載。這些預先建構的 DLSL Docker 映像檔與 GKE 叢集可順暢搭配運作,因為我們會在內部重現性和迴歸測試期間測試及驗證這些映像檔。

DLSL Docker 映像檔具有下列優點:

- 預先設定的軟體:DLSL Docker 映像檔會複製內部重現性和迴歸測試所用的設定。這些映像檔提供預先設定、測試及最佳化的環境,可大幅節省安裝和設定時間與精力。

- 版本管理:DLSL Docker 映像檔會經常更新。這些版本更新提供最新穩定版的架構和驅動程式,並解決安全性修補程式問題。

- 基礎架構相容性:DLSL Docker 映像檔經過建構和測試,可與 AI Hypercomputer 提供的 GPU 機型順暢搭配使用。

- 快速入門操作說明:部分 DLSL Docker 映像檔附有範例配方,說明如何啟動使用預先設定映像檔的工作負載。

NeMo + PyTorch + NCCL gIB 外掛程式

這些 Docker 映像檔是以 NVIDIA NeMo NGC 映像檔為基礎。這些檔案包含 Google 的 NCCL gIB 外掛程式,以及在各支援的加速器機器上執行工作負載所需的所有 NCCL 二進位檔。這些映像檔也包含 Google Cloud等工具,例如 gcsfuse 和

gcloud CLI,可將工作負載部署至 Google Kubernetes Engine。

| DLSL 圖片集錦 | 依附元件版本 | 機器系列 | 發布日期 | 終止支援日期 | DLSL 圖片名稱 |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 2025 年 7 月 3 日 | 2026 年 7 月 3 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 2025 年 7 月 3 日 | 2026 年 7 月 3 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 2025 年 3 月 14 日 | 2026 年 3 月 14 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2025 年 2 月 2 日 | 2026 年 2 月 2 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2025 年 2 月 2 日 | 2026 年 2 月 2 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 2025 年 2 月 7 日 | 2026 年 2 月 7 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 個 GPU) | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

這個 Docker 映像檔是以 NVIDIA NeMo NGC 映像檔為基礎,並包含 gcsfuse 和

gcloud CLI 等工具,可將工作負載部署至 Google Kubernetes Engine。 Google Cloud

| DLSL 圖片集錦 | 依附元件版本 | 機器系列 | 發布日期 | 終止支援日期 | DLSL 圖片名稱 |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | 2024 年 12 月 19 日 | 2025 年 12 月 19 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 個 GPU) | 2025 年 3 月 12 日 | 2026 年 3 月 12 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

MaxText + JAX 工具箱

這個 Docker 映像檔是以 NVIDIA JAX 工具箱映像檔為基礎,並包含Google Cloud 等工具,例如 gcsfuse 和

gcloud CLI,可將工作負載部署至 Google Kubernetes Engine。

| DLSL 圖片集錦 | 依附元件版本 | 機器系列 | 發布日期 | 終止支援日期 | DLSL 圖片名稱 |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 2025 年 3 月 11 日 | 2026 年 3 月 11 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 2025 年 3 月 17 日 | 2026 年 3 月 17 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High (8 個 GPU) | 2025 年 3 月 17 日 | 2026 年 3 月 17 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

MaxText + JAX 穩定版堆疊

這個 Docker 映像檔是以 JAX 穩定版堆疊和 MaxText 為基礎。這個映像檔也包含在 Google Kubernetes Engine 上執行工作負載時所需的依附元件,例如 dnsutils。

| DLSL 圖片集錦 | 依附元件版本 | 機器系列 | 發布日期 | 終止支援日期 | DLSL 圖片名稱 |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 2025 年 3 月 17 日 | 2026 年 3 月 17 日 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

叢集部署與自動調度管理

OS 映像檔包含在運算執行個體或 GKE 節點上部署作業系統的所有必要軟體元件。作業系統會管理基礎硬體資源,例如加速器和網路。為 AI 工作負載提供運算資源。

GKE 節點映像檔

GKE 會使用節點映像檔部署叢集。這些節點映像檔適用於各種作業系統,例如 Container-Optimized OS、Ubuntu 和 Windows Server。您需要部署 GKE Autopilot 叢集的 Container-Optimized OS with containerd (cos_containerd) 節點映像檔,已針對支援 AI 和 ML 工作負載進行最佳化。

如要進一步瞭解這些節點映像檔,請參閱節點映像檔。

Slurm OS 映像檔

Slurm 叢集會將運算和控制器節點部署為 Compute Engine 上的運算執行個體。

如要佈建 AI 適用的 Slurm 叢集,您必須使用 Cluster Toolkit。部署 Slurm 叢集時,叢集藍圖會自動建構自訂 OS 映像檔,在 Slurm 節點上安裝叢集和工作負載管理所需的系統軟體。您可以先修改預設藍圖,再部署藍圖,自訂映像檔內含的部分軟體。

以下章節會摘要說明叢集藍圖在 A4、A3 Ultra、A3 Mega 和 A3 High (8 個 GPU) Slurm 節點上安裝的軟體。叢集藍圖會擴充 Ubuntu LTS 加速器 OS 映像檔。

A4X Max

GitHub 上的 A4X Max 藍圖預設包含下列軟體:

- Ubuntu 24.04 LTS

- Slurm:25.05.2 版

- 下列 Slurm 依附元件:

mungemariadblibjwtlmod

- Open MPI:5.0.x 版

- NFS 用戶端和伺服器

- NVIDIA 580 系列驅動程式

- NVIDIA Enroot

- NVIDIA Pyxis

- 下列 NVIDIA 工具:

- 資料中心 GPU 管理員 (

dcgmi) nvidia-container-toolkit:1.17.7 版nvidia-imexnvidia-fabricmanager

- 資料中心 GPU 管理員 (

- CUDA Toolkit:13.0 版

- 適用於 A4X Max 的 NCCL 外掛程式 (

nccl-gib-a4x-max-arm64) - DOCA-OFED 驅動程式

- Ops Agent

- Cloud Storage FUSE

A4X

GitHub 上的 A4X 藍圖預設包含下列軟體:

- Ubuntu 24.04 LTS

- Slurm:25.05.2 版

- 下列 Slurm 依附元件:

mungemariadblibjwtlmod

- Open MPI:5.0.x 版

- NFS 用戶端和伺服器

- NVIDIA 570 系列驅動程式

- NVIDIA Enroot

- NVIDIA Pyxis

- 下列 NVIDIA 工具:

- 資料中心 GPU 管理員 (

dcgmi) nvidia-container-toolkit:1.17.7 版nvidia-imexnvidia-fabricmanager

- 資料中心 GPU 管理員 (

- CUDA Toolkit:12.8 版

- 適用於 A4X 的 NCCL 外掛程式 (

nccl-plugin-gib-arm64) - Ops Agent

- Cloud Storage FUSE

A4

GitHub 上的 A4 藍圖預設包含下列軟體:

- Ubuntu 22.04 LTS

- Slurm:25.05.2 版

- 下列 Slurm 依附元件:

mungemariadblibjwtlmod

- Open MPI:最新版本 4.1.x

- PMIx:4.2.9 版

- NFS 用戶端和伺服器

- NVIDIA 570 系列驅動程式

- NVIDIA enroot container runtime: 3.5.0 版,並修正發布後發現的錯誤

- NVIDIA pyxis

- 下列 NVIDIA 工具:

- 資料中心 GPU 管理員 (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- 資料中心 GPU 管理員 (

- CUDA Toolkit:12.8 版

- 支援 Infiniband,包括

ibverbs-utils - Ops Agent

- Cloud Storage FUSE

A3 Ultra

GitHub 上的 A3 Ultra 藍圖預設包含下列軟體:

- Ubuntu 22.04 LTS

- Slurm:24.11.2 版

- 下列 Slurm 依附元件:

mungemariadblibjwtlmod

- Open MPI:最新版本 4.1.x

- PMIx:4.2.9 版

- NFS 用戶端和伺服器

- NVIDIA 570 系列驅動程式

- NVIDIA enroot container runtime: 3.5.0 版,並修正發布後發現的錯誤

- NVIDIA pyxis

- 下列 NVIDIA 工具:

- 資料中心 GPU 管理員 (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- 資料中心 GPU 管理員 (

- CUDA Toolkit:12.8 版

- 支援 Infiniband,包括

ibverbs-utils - Ops Agent

- Cloud Storage FUSE

A3 Mega

GitHub 上的 A3 Mega 藍圖預設包含下列軟體:

- Ubuntu 22.04 LTS

- Slurm:24.11.2 版

- 下列 Slurm 依附元件:

mungemariadblibjwtlmod

- Open MPI:最新版本 4.1.x

- PMIx:4.2.9 版

- NFS 用戶端和伺服器

- NVIDIA 550 系列驅動程式

- NVIDIA enroot 容器 執行階段: 3.4.1 版

- NVIDIA pyxis

- 下列 NVIDIA 工具:

- 資料中心 GPU 管理員 (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- 資料中心 GPU 管理員 (

- CUDA Toolkit:12.4 版

- 支援 Infiniband,包括

ibverbs-utils - A3 Mega 的 TCPXO:NCCL TCPXO 和 1.6 Tbps 網路堆疊的專用安裝程式

- Ops Agent

- Cloud Storage FUSE

A3 High

GitHub 上的 A3 High (8 個 GPU) 藍圖預設包含下列軟體:

- Ubuntu 22.04 LTS

- Slurm:24.11.2 版

- 下列 Slurm 依附元件:

mungemariadblibjwtlmod

- Open MPI:最新版本 4.1.x

- PMIx:4.2.9 版

- NFS 用戶端和伺服器

- NVIDIA 535 或 550 系列驅動程式

- NVIDIA enroot container runtime:3.4.1 版

- NVIDIA pyxis

- 下列 NVIDIA 工具:

- 資料中心 GPU 管理員 (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- 資料中心 GPU 管理員 (

- CUDA Toolkit:12.2 或 12.4 版

- 支援 Infiniband,包括

ibverbs-utils - 適用於 A3 High (8 個 GPU) 的 TCPX:NCCL TCPX (GPUDirect-TCPX) 和 800 Gbps 網路堆疊 (4 個 NIC) 的專用安裝程式

- Ops Agent

- Cloud Storage FUSE

加速器 OS 映像檔

您可以使用 AI Hypercomputer 佈建個別運算執行個體或運算執行個體群組。如要建立這些執行個體,您必須在建立執行個體時指定 OS 映像檔。

Google Cloud 提供一系列OS 映像檔,用於建立執行個體。 Google Cloud 也提供專用的加速器 OS 映像檔,用於 AI 最佳化執行個體。這些作業系統映像檔包含 GPU 和網路功能的核心驅動程式,例如 NVIDIA 驅動程式、Mellanox 驅動程式及其依附元件。

如要進一步瞭解每個 OS,請參閱 Compute Engine 說明文件的「作業系統詳細資料」頁面。

加速器 OS 映像檔適用於 Rocky Linux 和 Ubuntu LTS 作業系統。

Rocky Linux 加速器

下列 Rocky Linux 加速器 OS 映像檔適用於各個機器系列:

| 作業系統版本 | 映像檔系列 | 架構 | 機器系列 | 映像檔專案 |

|---|---|---|---|---|

| Rocky Linux 9 加速器 | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

手臂 | A4X Max、A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

手臂 | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | rocky-linux-accelerator-cloud |

|

| Rocky Linux 8 加速器 | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

手臂 | A4X Max、A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | rocky-linux-accelerator-cloud |

Ubuntu LTS 加速器

下列 Ubuntu LTS 加速器 OS 映像檔適用於各個機器系列:

| 作業系統版本 | 映像檔系列 | 架構 | 機器系列 | 映像檔專案 |

|---|---|---|---|---|

| Ubuntu 24.04 LTS 加速器 | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

手臂 | A4X Max、A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

手臂 | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | ubuntu-os-accelerator-images |

|

| Ubuntu 22.04 LTS 加速器 | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

手臂 | A4X Max、A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

手臂 | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4、A3 Ultra、A3 Mega、A3 High (8 個 GPU) | ubuntu-os-accelerator-images |