Google Cloud 일반적인 운영체제, 프레임워크, 라이브러리, 드라이버가 포함된 이미지를 제공합니다. Google Cloud 이러한 사전 구성된 이미지를 최적화하여 인공지능 (AI) 및 머신러닝 (ML) 워크로드를 지원합니다.

이 문서에서는 AI 하이퍼컴퓨터 환경에서 워크로드를 배포, 관리, 실행하는 데 사용하는 이미지를 간략하게 설명합니다.

이미지 카테고리 이해하기

이미지는 다음 카테고리로 그룹화됩니다.

- AI 및 ML 프레임워크와 라이브러리: ML 모델의 생성, 학습, 사용을 간소화하기 위해 ML 프레임워크 및 라이브러리의 바이너리로 사전 구성된 Docker 이미지입니다. AI 하이퍼컴퓨터에서는 딥 러닝 소프트웨어 계층 (DLSL) Docker 이미지를 사용하여 Google Kubernetes Engine (GKE) 클러스터에서 NeMO 및 MaxText와 같은 ML 모델을 실행할 수 있습니다.

- 클러스터 배포 및 조정: AI 워크로드가 실행되는 성능 최적화 인프라를 배포하고 관리하는 데 사용하는 운영체제 (OS) 이미지입니다. AI 워크로드를 GKE 클러스터, Slurm 클러스터 또는 Compute Engine 인스턴스에 배포할 수 있습니다.

자세한 내용은 VM 및 클러스터 생성 개요를 참고하세요.

클러스터 또는 인스턴스 배포에 사용할 수 있는 운영체제 이미지는 다음과 같습니다.

- GKE 노드 이미지: 이러한 이미지를 사용하여 GKE 클러스터를 배포할 수 있습니다.

- Slurm OS 이미지: Cluster Toolkit은 Slurm 노드에 필요한 시스템 소프트웨어를 설치하는 이러한 이미지를 빌드하고 배포합니다.

- 액셀러레이터 OS 이미지: 이러한 이미지를 사용하여 개별 인스턴스 또는 인스턴스 그룹을 만들 수 있습니다.

AI 및 ML 프레임워크 및 라이브러리

Google Cloud 는 널리 사용되는 AI 및 ML 프레임워크와 라이브러리를 패키징하는 Docker 이미지를 제공합니다. 이러한 이미지는 AI 하이퍼컴퓨터에서 실행되는 AI 최적화 클러스터에서 모델의 개발, 학습, 배포를 간소화하는 데 필요한 소프트웨어를 제공합니다.

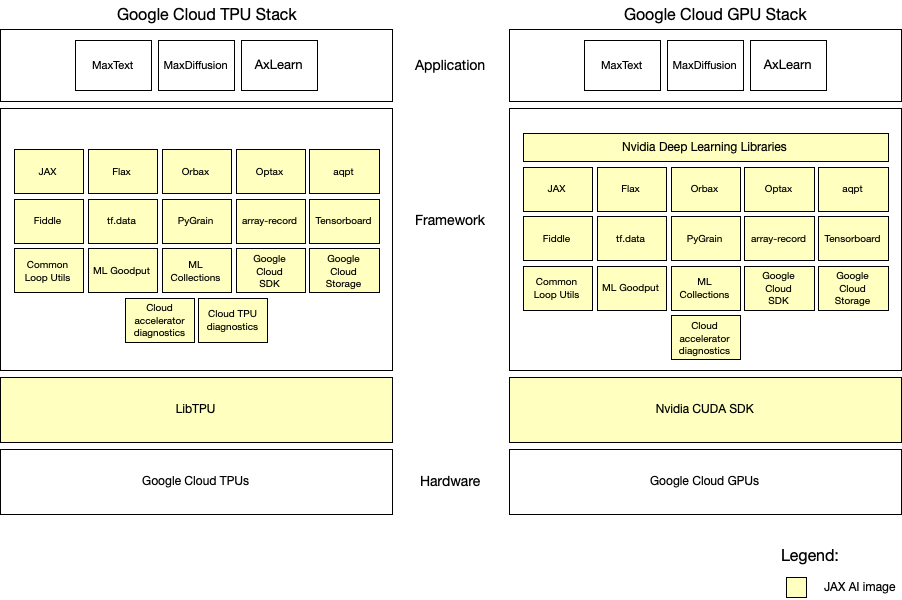

JAX AI 이미지

Google Cloud TPU 및 GPU용 JAX AI 이미지 (JAII, 이전 명칭: JAX Stable Stack 이미지)는 JAX 프레임워크, 호환 라이브러리의 선별된 컬렉션, Google Cloud 인프라 설정이 포함된 즉시 사용 가능한 Docker 이미지를 제공합니다. JAX AI TPU 이미지는 JAX 라이브러리와 TPU 라이브러리가 사전 구성되어 있습니다. JAX AI GPU 이미지는 JAX 라이브러리 및 관련 CUDA/NVIDIA 라이브러리와 함께 사전 구성됩니다.

하드웨어 계층

JAX AI 이미지는 하드웨어 레이어 위에 있으며, 하드웨어 레이어는 액셀러레이터 (TPU 또는 GPU)와 연결된 VM으로 구성됩니다. JAX AI 이미지를 사용하려면 TPU 또는 GPU VM을 프로비저닝해야 합니다. TPU API, Compute Engine API 또는 GKE API를 사용하여 이 작업을 수행할 수 있습니다.

프레임워크 레이어

프레임워크 레이어는 ML 워크로드를 빌드하기 위한 도구와 라이브러리를 제공합니다. JAX AI 이미지는 핵심 JAX 라이브러리 및 기타 필수 종속 항목을 비롯한 JAX 기반 ML 워크로드의 사전 구성된 기반을 제공하여 일관되고 고성능 개발 환경을 보장합니다.

JAX AI 이미지의 LibTPU 레이어는 각각의 JAX 버전으로 특별히 빌드되고 번들로 제공됩니다. 다른 JAX 버전을 사용하면 예기치 않은 동작이나 오류가 발생할 수 있습니다.

JAX AI 이미지의 CUDA 레이어에는 GPU 학습 이미지의 기본 이미지로 사용되는 NGC CUDA Deep Learning Image와 같이 NVIDIA에서 관리하는 구성요소가 포함됩니다. GPU 이미지에는 NVIDIA GPU에서 트랜스포머 모델을 가속화하기 위한 맞춤 NVIDIA 라이브러리인 Transformer Engine도 포함되어 있습니다.

JAX AI 이미지에 제공된 패키지 외에 특정 머신러닝 워크로드에 필요한 애플리케이션별 패키지가 추가로 필요할 수 있습니다.

JAX AI 이미지의 라이브러리:

TPU 이미지

| 기능 | 패키지 이름 |

|---|---|

| 핵심 라이브러리 또는 구성요소 | |

| ML 프레임워크 | JAX 및 JAX lib |

| LibTPU | Cloud LibTPU 안정화 버전 |

| 레이어/모델 라이브러리 | Flax |

| 체크포인트 | Orbax |

| 양자화 | Qwix |

| 최적화 도구 | Optax |

| 맞춤 커널 | Tokamax |

| 구성 | Fiddle |

| 입력 파이프라인 | tf.data |

| 프로파일링, 디버깅 | Tensorboard |

| Utils | 일반 루프 유틸리티 |

| 클라우드별 도구 | |

| Google Cloud | |

| 진단 | |

GPU 이미지

| 기능 | 패키지 이름 |

|---|---|

| 핵심 라이브러리 또는 구성요소 | |

| ML 프레임워크 | JAX 및 JAX lib |

| NVIDIA CUDA 라이브러리 | CUDA DL 이미지 |

| 레이어/모델 라이브러리 | Flax |

| 체크포인트 | Orbax |

| 최적화 도구 | |

| 구성 | Fiddle |

| 입력 파이프라인 | |

| 프로파일링, 디버깅 | Tensorboard |

| Utils | |

| 클라우드별 도구 | |

| Google Cloud | |

| 진단 | Cloud Accelerator 진단 |

현재 JAX AI 이미지

TPU 이미지

| JAX AI 이미지 | 출시일 |

|---|---|

| JAX 0.9.0 버전 1 | 2026-02-03 |

| JAX 0.8.2 버전 1 | 2026-01-14 |

| JAX 0.8.1 버전 1 | 2025-11-21 |

| JAX 0.8.0 버전 1 | 2025-10-28 |

| JAX 0.7.2 버전 1 | 2025-09-30 |

| JAX 0.7.0 버전 1 | 2025-07-29 |

| JAX 0.6.1 버전 1 | 2025-06-05 |

| JAX 0.5.2 버전 2 | 2025-04-25 |

| JAX 0.5.2 버전 1 | 2025-03-17 |

| JAX 0.4.37 버전 1 | 2024-12-12 |

| JAX 0.4.35 버전 1 | 2024-10-30 |

GPU 이미지

| JAX AI 이미지 | 출시일 |

|---|---|

| CUDA DL 25.06 버전 1이 적용된 JAX 0.7.2 | 2025-09-30 |

| CUDA DL 25.03 버전 1이 적용된 JAX 0.6.1 | 2025-06-05 |

| CUDA DL 25.02 버전 1이 적용된 JAX 0.5.1 | 2025-03-17 |

애플리케이션 계층

프레임워크 계층 위에 있는 애플리케이션 계층에서 특정 ML 워크로드를 구현합니다. 애플리케이션 레이어에는 프레임워크 레이어에서 제공하는 도구와 라이브러리를 사용하여 빌드된 애플리케이션별 코드, 모델, 로직이 포함됩니다.

이 이미지는 JAX 기반 AI 워크로드에 안정적이고 잘 테스트된 기반을 제공하지만 애플리케이션별 종속 항목을 추가해야 할 수 있습니다. 이때 JAX 및 핵심 종속 항목을 포함하는 사전 구성된 기본 레이어와의 간섭을 최소화하는 방식으로 실행하는 것이 좋습니다. 기존 종속 항목을 재정의하거나 충돌하는 애플리케이션 수준 종속 항목을 도입하면 다음과 같은 부작용이 발생할 수 있습니다.

- 예상치 못한 동작: ML 워크로드가 JAX AI 이미지에 추가 종속 항목을 도입하기 전과 다른 동작을 보일 수 있습니다.

- 성능 회귀: 최적화된 JAX 관련 라이브러리를 재정의하면 JAX AI 이미지에서 제공하는 성능 이점에 부정적인 영향을 줄 수 있습니다.

- 안정성 문제: 추가된 종속 항목과 핵심 JAX 종속 항목 간의 충돌로 인해 애플리케이션 내에 불안정성과 런타임 오류가 발생할 수 있습니다.

출시 주기

처음에는 JAX AI 이미지가 분기별로 제공되며, 단기적으로는 모든 JAX 출시와 동기화된 출시 일정을 목표로 합니다. 이렇게 하면 최신 기능과 개선사항이 제공되는 즉시 이를 활용할 수 있습니다.

지원

각 JAX AI 이미지 출시에는 제한된 기간의 지원 수명 주기가 적용됩니다. 이 기간 내에 기존 JAX AI 이미지의 수정 요청에 대한 특정 카테고리를 처리합니다.

- 보안 취약점: JAX 안정화 스택 Docker 이미지의 기본 이미지 또는 종속 항목에서 발견된 보안 취약점 해결을 우선시합니다. 잠재적 위험을 완화하기 위해 업데이트된 이미지가 출시됩니다.

- 브레이킹 체인지: JAX AI 이미지에서 사용하는 기본 라이브러리나 프레임워크에 중요한 브레이킹 체인지가 있는 경우 Google Cloud에서는 호환성을 유지하기 위해 필요한 업데이트를 평가하고 구현합니다. 여기에는 업데이트된 종속 항목으로 Docker 이미지를 다시 빌드하는 작업이 포함될 수 있습니다.

JAII 내 라이브러리에서 보안 취약점이나 버그가 발견되면 업데이트된 라이브러리를 JAII에 통합하여 전반적인 안정성을 유지하기 위해 다른 모든 라이브러리 버전을 고정합니다. 이렇게 하면 새 JAII 버전이 생성됩니다.

버전의 최소 변경사항:

JAX-0.4.30-rev1 내의 패키지 'X'에서 버그가 발견되면 다른 모든 패키지는 변경되지 않은 상태로 유지하면서 'X'를 다음 버전 (예: v2.0)으로 업데이트합니다. 이로 인해 새 버전인 JAX-0.4.30-rev2가 생성되며, 이 버전은 최대한 빨리 출시될 예정입니다.

딥 러닝 소프트웨어 레이어 (DLSL) Docker 이미지

이러한 이미지는 NVIDIA CUDA, NCCL, ML 프레임워크, 모델을 패키징합니다. 딥 러닝 워크로드에 바로 사용할 수 있는 환경을 제공합니다. 이러한 사전 빌드된 DLSL Docker 이미지는 내부 재현성 및 회귀 테스트 중에 테스트하고 확인하므로 GKE 클러스터와 원활하게 작동합니다.

DLSL Docker 이미지는 다음과 같은 이점을 제공합니다.

- 사전 구성된 소프트웨어: DLSL Docker 이미지는 내부 재현성 및 회귀 테스트에서 사용하는 설정을 복제합니다. 이러한 이미지는 사전 구성되고 테스트되고 최적화된 환경을 제공하므로 설치 및 구성에 드는 시간과 노력을 크게 절약할 수 있습니다.

- 버전 관리: DLSL Docker 이미지는 자주 업데이트됩니다. 이러한 버전 업데이트는 안정화 버전의 최신 프레임워크와 드라이버를 제공하며 업데이트는 보안 패치도 처리합니다.

- 인프라 호환성: DLSL Docker 이미지는 AI 하이퍼컴퓨터에서 사용할 수 있는 GPU 머신 유형과 원활하게 작동하도록 빌드되고 테스트됩니다.

- 빠른 시작 안내: 일부 DLSL Docker 이미지에는 사전 구성된 이미지를 사용하는 워크로드를 시작하는 방법을 보여주는 샘플 레시피가 함께 제공됩니다.

NeMo + PyTorch + NCCL gIB 플러그인

이러한 Docker 이미지는 NVIDIA NeMo NGC 이미지를 기반으로 합니다. 여기에는 Google의 NCCL gIB 플러그인이 포함되어 있으며 지원되는 각 가속기 머신에서 워크로드를 실행하는 데 필요한 모든 NCCL 바이너리가 번들로 제공됩니다. 이러한 이미지에는 Google Kubernetes Engine에 워크로드를 배포하기 위한 gcsfuse 및

gcloud CLI와 같은 도구도 포함되어 있습니다. Google Cloud

| DLSL 이미지 버전 | 종속 항목 버전 | 머신 계열 | 출시일 | 지원 종료일 | DLSL 이미지 이름 |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 2025년 7월 3일 | 2026년 7월 3일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 2025년 7월 3일 | 2026년 7월 3일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 2025년 3월 14일 | 2026년 3월 14일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2025년 2월 2일 | 2026년 2월 2일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2025년 2월 2일 | 2026년 2월 2일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 2025년 2월 7일 | 2026년 2월 7일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 2025년 3월 12일 | 2026년 3월 12일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (GPU 8개) | 2025년 3월 12일 | 2026년 3월 12일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

이 Docker 이미지는 NVIDIA NeMo NGC 이미지를 기반으로 하며 Google Kubernetes Engine에 워크로드를 배포하기 위한 gcsfuse 및

gcloud CLI와 같은 도구가 포함되어 있습니다. Google Cloud

| DLSL 이미지 버전 | 종속 항목 버전 | 머신 계열 | 출시일 | 지원 종료일 | DLSL 이미지 이름 |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | 2024년 12월 19일 | 2025년 12월 19일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 2025년 3월 12일 | 2026년 3월 12일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (GPU 8개) | 2025년 3월 12일 | 2026년 3월 12일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

MaxText + JAX 도구 상자

이 Docker 이미지는 NVIDIA JAX 툴박스 이미지를 기반으로 하며 Google Kubernetes Engine에 워크로드를 배포하기 위한Google Cloud 도구(예: gcsfuse,

gcloud CLI)가 포함되어 있습니다.

| DLSL 이미지 버전 | 종속 항목 버전 | 머신 계열 | 출시일 | 지원 종료일 | DLSL 이미지 이름 |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 2025년 3월 11일 | 2026년 3월 11일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 2025년 3월 17일 | 2026년 3월 17일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High (GPU 8개) | 2025년 3월 17일 | 2026년 3월 17일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

MaxText + JAX 안정화 스택

이 Docker 이미지는 JAX 안정화 스택 및 MaxText를 기반으로 합니다. 이 이미지에는 Google Kubernetes Engine에서 워크로드를 실행하기 위한 dnsutils와 같은 종속 항목도 포함되어 있습니다.

| DLSL 이미지 버전 | 종속 항목 버전 | 머신 계열 | 출시일 | 지원 종료일 | DLSL 이미지 이름 |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 2025년 3월 17일 | 2026년 3월 17일 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

클러스터 배포 및 조정

OS 이미지에는 컴퓨팅 인스턴스 또는 GKE 노드에 운영체제를 배포하는 데 필요한 모든 소프트웨어 구성요소가 포함되어 있습니다. 운영체제는 가속기, 네트워킹과 같은 기본 하드웨어 리소스를 관리합니다. AI 워크로드에 컴퓨팅 리소스를 제공합니다.

GKE 노드 이미지

GKE는 노드 이미지를 사용하여 클러스터를 배포합니다. 이러한 노드 이미지는 Container-Optimized OS, Ubuntu, Windows Server와 같은 다양한 운영체제에서 사용할 수 있습니다. GKE Autopilot 클러스터를 배포하는 데 필요한 containerd가 포함된 Container-Optimized OS (cos_containerd) 노드 이미지에는 AI 및 ML 워크로드를 지원하기 위한 최적화가 포함되어 있습니다.

이러한 노드 이미지에 대한 자세한 내용은 노드 이미지를 참고하세요.

Slurm OS 이미지

Slurm 클러스터는 Compute Engine에서 컴퓨팅 인스턴스로 컴퓨팅 및 컨트롤러 노드를 배포합니다.

AI 최적화 Slurm 클러스터를 프로비저닝하려면 Cluster Toolkit을 사용해야 합니다. Slurm 클러스터 배포 중에 클러스터 청사진은 Slurm 노드에 클러스터 및 워크로드 관리에 필요한 시스템 소프트웨어를 설치하는 맞춤 OS 이미지를 자동으로 빌드합니다. 기본 청사진을 수정하여 이미지가 포함하는 일부 소프트웨어를 맞춤설정할 수 있습니다.

다음 섹션에서는 클러스터 청사진이 A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) Slurm 노드에 설치하는 소프트웨어를 요약합니다. 클러스터 청사진은 Ubuntu LTS 액셀러레이터 OS 이미지를 확장합니다.

A4X Max

GitHub에서 제공되는 A4X Max 블루프린트에는 기본적으로 다음 소프트웨어가 포함되어 있습니다.

- Ubuntu 24.04 LTS

- Slurm: 버전 25.05.2

- 다음 Slurm 종속 항목:

mungemariadblibjwtlmod

- Open MPI: 버전 5.0.x

- NFS 클라이언트 및 서버

- NVIDIA 580 시리즈 드라이버

- NVIDIA Enroot

- NVIDIA Pyxis

- 다음 NVIDIA 도구:

- 데이터 센터 GPU 관리자 (

dcgmi) nvidia-container-toolkit: 버전 1.17.7nvidia-imexnvidia-fabricmanager

- 데이터 센터 GPU 관리자 (

- CUDA 툴킷: 버전 13.0

- A4X Max용 NCCL 플러그인 (

nccl-gib-a4x-max-arm64) - DOCA-OFED 드라이버

- 운영 에이전트

- Cloud Storage FUSE

A4X

GitHub에서 제공되는 A4X 블루프린트에는 기본적으로 다음 소프트웨어가 포함되어 있습니다.

- Ubuntu 24.04 LTS

- Slurm: 버전 25.05.2

- 다음 Slurm 종속 항목:

mungemariadblibjwtlmod

- Open MPI: 버전 5.0.x

- NFS 클라이언트 및 서버

- NVIDIA 570 시리즈 드라이버

- NVIDIA Enroot

- NVIDIA Pyxis

- 다음 NVIDIA 도구:

- 데이터 센터 GPU 관리자 (

dcgmi) nvidia-container-toolkit: 버전 1.17.7nvidia-imexnvidia-fabricmanager

- 데이터 센터 GPU 관리자 (

- CUDA 툴킷: 버전 12.8

- A4X용 NCCL 플러그인 (

nccl-plugin-gib-arm64) - 운영 에이전트

- Cloud Storage FUSE

A4

GitHub에서 제공되는 A4 청사진에는 기본적으로 다음 소프트웨어가 포함되어 있습니다.

- Ubuntu 22.04 LTS

- Slurm: 버전 25.05.2

- 다음 Slurm 종속 항목:

mungemariadblibjwtlmod

- Open MPI: 4.1.x의 최신 버전

- PMIx: 버전 4.2.9

- NFS 클라이언트 및 서버

- NVIDIA 570 시리즈 드라이버

- NVIDIA enroot 컨테이너 런타임: 버전 3.5.0(출시 후 버그 수정 포함)

- NVIDIA pyxis

- 다음 NVIDIA 도구:

- 데이터 센터 GPU 관리자 (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- 데이터 센터 GPU 관리자 (

- CUDA 툴킷: 버전 12.8

ibverbs-utils를 포함한 Infiniband 지원- 운영 에이전트

- Cloud Storage FUSE

A3 Ultra

GitHub에서 제공되는 A3 Ultra 블루프린트에는 기본적으로 다음 소프트웨어가 포함되어 있습니다.

- Ubuntu 22.04 LTS

- Slurm: 버전 24.11.2

- 다음 Slurm 종속 항목:

mungemariadblibjwtlmod

- Open MPI: 최신 버전의 4.1.x

- PMIx: 버전 4.2.9

- NFS 클라이언트 및 서버

- NVIDIA 570 시리즈 드라이버

- NVIDIA enroot 컨테이너 런타임: 버전 3.5.0(출시 후 버그 수정 포함)

- NVIDIA pyxis

- 다음 NVIDIA 도구:

- 데이터 센터 GPU 관리자 (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- 데이터 센터 GPU 관리자 (

- CUDA 툴킷: 버전 12.8

ibverbs-utils를 포함한 Infiniband 지원- 운영 에이전트

- Cloud Storage FUSE

A3 Mega

GitHub에서 제공되는 A3 Mega 청사진에는 기본적으로 다음 소프트웨어가 포함되어 있습니다.

- Ubuntu 22.04 LTS

- Slurm: 버전 24.11.2

- 다음 Slurm 종속 항목:

mungemariadblibjwtlmod

- Open MPI: 4.1.x의 최신 버전

- PMIx: 버전 4.2.9

- NFS 클라이언트 및 서버

- NVIDIA 550 시리즈 드라이버

- NVIDIA enroot 컨테이너 런타임: 버전 3.4.1

- NVIDIA pyxis

- 다음 NVIDIA 도구:

- 데이터 센터 GPU 관리자 (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- 데이터 센터 GPU 관리자 (

- CUDA 툴킷: 버전 12.4

ibverbs-utils를 포함한 Infiniband 지원- A3 Mega용 TCPXO: NCCL TCPXO 및 1.6Tbps 네트워크 스택용 특정 설치 프로그램

- 운영 에이전트

- Cloud Storage FUSE

A3 High

GitHub에서 제공되는 A3 High (GPU 8개) 청사진에는 기본적으로 다음 소프트웨어가 포함되어 있습니다.

- Ubuntu 22.04 LTS

- Slurm: 버전 24.11.2

- 다음 Slurm 종속 항목:

mungemariadblibjwtlmod

- Open MPI: 4.1.x의 최신 버전

- PMIx: 버전 4.2.9

- NFS 클라이언트 및 서버

- NVIDIA 535 또는 550 시리즈 드라이버

- NVIDIA enroot 컨테이너 런타임: 버전 3.4.1

- NVIDIA pyxis

- 다음 NVIDIA 도구:

- 데이터 센터 GPU 관리자 (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- 데이터 센터 GPU 관리자 (

- CUDA 툴킷: 버전 12.2 또는 12.4

ibverbs-utils를 포함한 Infiniband 지원- A3 High (GPU 8개): NCCL TCPX (GPUDirect-TCPX) 및 800Gbps 네트워크 스택 (NIC 4개)용 특정 설치 프로그램

- 운영 에이전트

- Cloud Storage FUSE

가속기 OS 이미지

AI 하이퍼컴퓨터를 사용하면 개별 컴퓨팅 인스턴스 또는 컴퓨팅 인스턴스 그룹을 프로비저닝할 수 있습니다. 이러한 인스턴스를 만들려면 인스턴스 생성 중에 OS 이미지를 지정해야 합니다.

Google Cloud 에서는 인스턴스 생성을 위한 OS 이미지 모음을 제공합니다. Google Cloud 에서는 AI 최적화 인스턴스를 위한 특화된 가속기 OS 이미지 모음도 제공합니다. 이러한 OS 이미지에는 NVIDIA 드라이버, Mellanox 드라이버, 종속 항목과 같은 GPU 및 네트워킹 기능의 핵심 드라이버가 포함되어 있습니다.

각 OS에 대한 자세한 내용은 Compute Engine 문서의 운영체제 세부정보 페이지를 참고하세요.

가속기 OS 이미지는 Rocky Linux 및 Ubuntu LTS 운영체제에서 사용할 수 있습니다.

Rocky Linux 액셀러레이터

각 머신 시리즈에 사용할 수 있는 Rocky Linux 가속기 OS 이미지는 다음과 같습니다.

| OS 버전 | 이미지 계열 | 아키텍처 | 머신 계열 | 이미지 프로젝트 |

|---|---|---|---|---|

| Rocky Linux 9 가속기 | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | rocky-linux-accelerator-cloud |

|

| Rocky Linux 8 가속기 | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | rocky-linux-accelerator-cloud |

Ubuntu LTS 액셀러레이터

각 머신 시리즈에 사용할 수 있는 Ubuntu LTS 가속기 OS 이미지는 다음과 같습니다.

| OS 버전 | 이미지 계열 | 아키텍처 | 머신 계열 | 이미지 프로젝트 |

|---|---|---|---|---|

| Ubuntu 24.04 LTS 액셀러레이터 | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | ubuntu-os-accelerator-images |

|

| Ubuntu 22.04 LTS 액셀러레이터 | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (GPU 8개) | ubuntu-os-accelerator-images |