Google Cloud stellt Images mit gängigen Betriebssystemen, Frameworks, Bibliotheken und Treibern bereit. Google Cloud optimiert diese vorkonfigurierten Images, um Ihre Arbeitslasten im Bereich künstliche Intelligenz (KI) und maschinelles Lernen (ML) zu unterstützen.

Dieses Dokument bietet einen Überblick über die Images, die Sie zum Bereitstellen, Verwalten und Ausführen von Arbeitslasten in Ihrer AI Hypercomputer-Umgebung verwenden.

Bildkategorien

Bilder werden in die folgenden Kategorien eingeteilt:

- KI- und ML-Frameworks und ‑Bibliotheken: Docker-Images, die mit Binärdateien für ML-Frameworks und ‑Bibliotheken vorkonfiguriert sind, um die Erstellung, das Training und die Verwendung von ML-Modellen zu vereinfachen. Auf AI Hypercomputer können Sie DLSL-Docker-Images (Deep Learning Software Layer) verwenden, um ML-Modelle wie NeMO und MaxText in einem Google Kubernetes Engine-Cluster (GKE) auszuführen.

- Clusterbereitstellung und ‑orchestrierung: Betriebssystemimages, die Sie zum Bereitstellen und Verwalten der leistungsoptimierten Infrastruktur verwenden, auf der Ihre KI-Arbeitslasten ausgeführt werden. Sie können Ihre KI-Arbeitslasten in GKE-Clustern, Slurm-Clustern oder Compute Engine-Instanzen bereitstellen.

Weitere Informationen finden Sie unter VM- und Clustererstellung – Übersicht.

Die folgenden Betriebssystem-Images sind für die Bereitstellung von Clustern oder Instanzen verfügbar:

- GKE-Knoten-Images: Mit diesen Images können Sie GKE-Cluster bereitstellen.

- Slurm-Betriebssystem-Images: Das Cluster Toolkit erstellt und stellt diese Images bereit, mit denen die erforderliche Systemsoftware für Slurm-Knoten installiert wird.

- Betriebssystem-Images für Beschleuniger: Mit diesen Images können Sie einzelne Instanzen oder Gruppen von Instanzen erstellen.

KI- und ML-Frameworks und ‑Bibliotheken

Google Cloud bietet Docker-Images, in denen beliebte KI- und ML-Frameworks und ‑Bibliotheken enthalten sind. Diese Images enthalten die Software, die erforderlich ist, um die Entwicklung, das Training und die Bereitstellung von Modellen in Ihren KI-optimierten Clustern, die auf AI Hypercomputer ausgeführt werden, zu vereinfachen.

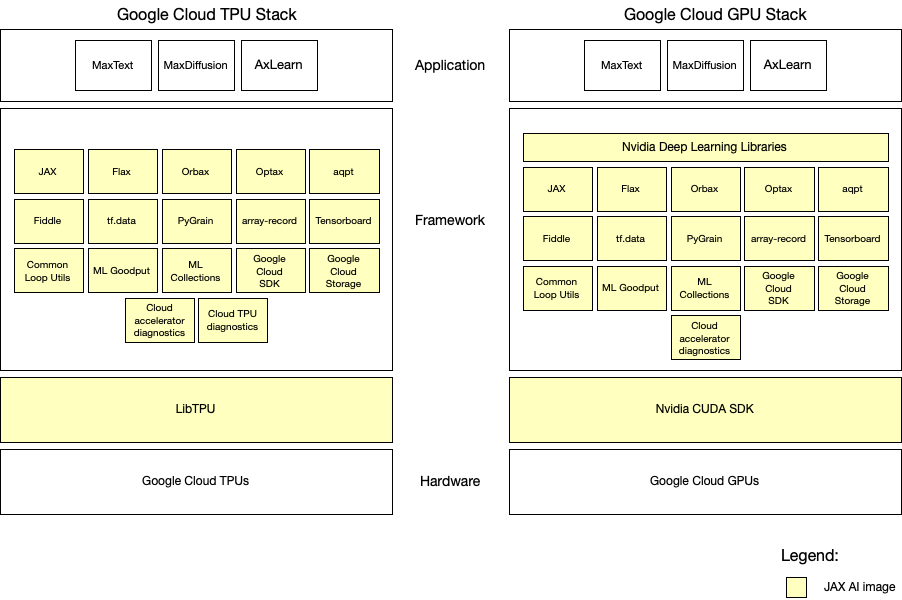

JAX AI-Images

Die JAX AI-Images (JAII, früher als JAX Stable Stack Images bezeichnet) fürGoogle Cloud TPUs und GPUs bieten sofort einsatzbereite Docker-Images, die das JAX-Framework, eine kuratierte Sammlung kompatibler Bibliotheken und Einstellungen für die Google Cloud Infrastruktur enthalten. JAX AI TPU-Images sind mit JAX-Bibliotheken und TPU-Bibliotheken vorkonfiguriert. JAX AI-GPU-Images sind mit JAX-Bibliotheken und relevanten CUDA-/NVIDIA-Bibliotheken vorkonfiguriert.

Hardwareebene

JAX AI-Images befinden sich über der Hardwareschicht, die aus den Beschleunigern (TPU oder GPU) und den zugehörigen VMs besteht. Wenn Sie ein JAX AI-Image verwenden möchten, müssen Sie TPU- oder GPU-VMs bereitstellen. Sie können dazu die TPU API, die Compute Engine API oder die GKE API verwenden.

Framework-Ebene

Die Framework-Ebene bietet Tools und Bibliotheken zum Erstellen von ML-Arbeitslasten. JAX AI-Images bieten eine vorkonfigurierte Basis für JAX-basierte ML-Arbeitslasten, einschließlich der JAX-Kernbibliothek und anderer wichtiger Abhängigkeiten, um eine konsistente und leistungsstarke Entwicklung zu ermöglichen.

Die LibTPU-Ebene im JAX AI-Image wird speziell für die jeweilige JAX-Version erstellt und mit ihr gebündelt. Die Verwendung einer anderen JAX-Version kann zu unerwartetem Verhalten oder Fehlern führen.

Die CUDA-Ebene im JAX AI-Image enthält von NVIDIA verwaltete Komponenten wie das NGC CUDA Deep Learning-Image, das als Basis-Image des GPU-Trainings-Image verwendet wird. Das GPU-Image enthält auch Transformer Engine, eine benutzerdefinierte NVIDIA-Bibliothek zum Beschleunigen von Transformer-Modellen auf NVIDIA-GPUs.

Für Ihre spezifische ML-Arbeitslast sind möglicherweise zusätzliche anwendungsspezifische Pakete erforderlich, die über die im JAX-KI-Image bereitgestellten Pakete hinausgehen.

Bibliotheken in JAX AI-Images:

TPU-Images

| Funktionen | Paketname |

|---|---|

| Kernbibliotheken oder ‑komponenten | |

| ML-Framework | JAX und JAX-Bibliothek |

| LibTPU | Stabile Version von Cloud LibTPU |

| Ebenen-/Modellbibliothek | Flax |

| Prüfpunkte | Orbax |

| Quantisierung | Qwix |

| Optimierungstools | Optax |

| Benutzerdefinierte Kernels | Tokamax |

| Konfiguration | Fiddle |

| Eingabe-Pipeline | tf.data |

| Profilerstellung, Debugging | TensorBoard |

| Utils | Häufig verwendete Loop-Dienstprogramme |

| Cloudspezifische Tools | |

| Google Cloud | |

| Diagnose | |

GPU-Images

| Funktionen | Paketname |

|---|---|

| Kernbibliotheken oder ‑komponenten | |

| ML-Framework | JAX und JAX-Bibliothek |

| NVIDIA CUDA-Bibliotheken | CUDA DL Image |

| Ebenen-/Modellbibliothek | Flax |

| Prüfpunkte | Orbax |

| Optimierungstools | |

| Konfiguration | Fiddle |

| Eingabe-Pipeline | |

| Profilerstellung, Debugging | TensorBoard |

| Utils |

Häufig verwendete Schleifen-Utils ML-Goodput-Messung ML-Sammlungen |

| Cloudspezifische Tools | |

| Google Cloud | |

| Diagnose | Cloud Accelerator Diagnostics |

Aktuelle JAX AI-Images

TPU-Images

| JAX AI-Image | Releasedatum |

|---|---|

| JAX 0.9.0, Revision 1 | 2026-02-03 |

| JAX 0.8.2, Revision 1 | 2026-01-14 |

| JAX 0.8.1, Revision 1 | 2025-11-21 |

| JAX 0.8.0, Revision 1 | 2025-10-28 |

| JAX 0.7.2 Revision 1 | 2025-09-30 |

| JAX 0.7.0, Revision 1 | 2025-07-29 |

| JAX 0.6.1, Revision 1 | 2025-06-05 |

| JAX 0.5.2 Revision 2 | 2025-04-25 |

| JAX 0.5.2 Revision 1 | 2025-03-17 |

| JAX 0.4.37 Revision 1 | 2024-12-12 |

| JAX 0.4.35 Revision 1 | 2024-10-30 |

GPU-Images

| JAX AI-Image | Releasedatum |

|---|---|

| JAX 0.7.2 mit CUDA DL 25.06 Revision 1 | 2025-09-30 |

| JAX 0.6.1 mit CUDA DL 25.03 Revision 1 | 2025-06-05 |

| JAX 0.5.1 mit CUDA DL 25.02 Revision 1 | 2025-03-17 |

Anwendungsebene

Sie implementieren Ihre spezifischen ML-Arbeitslasten auf der Anwendungsebene, die sich über der Framework-Ebene befindet. Die Anwendungsschicht enthält Ihren anwendungsspezifischen Code, Ihre Modelle und Ihre Logik, die alle mit den Tools und Bibliotheken der Framework-Schicht erstellt wurden.

Dieses Image bietet zwar eine robuste und gut getestete Grundlage für JAX-basierte KI-Arbeitslasten, Sie müssen jedoch möglicherweise anwendungsspezifische Abhängigkeiten hinzufügen. Wir empfehlen, dabei so vorzugehen, dass die voreingestellte Basisebene, die JAX und seine wichtigsten Abhängigkeiten enthält, so wenig wie möglich beeinträchtigt wird. Wenn Sie Abhängigkeiten auf Anwendungsebene einführen, die die vorhandenen Abhängigkeiten überschreiben oder mit ihnen in Konflikt stehen, kann dies zu Nebeneffekten führen, z. B.:

- Unerwartetes Verhalten: Ihre ML-Arbeitslasten verhalten sich möglicherweise anders als vor dem Hinzufügen zusätzlicher Abhängigkeiten zum JAX AI-Image.

- Leistungsbeeinträchtigungen: Das Überschreiben optimierter JAX-bezogener Bibliotheken kann sich negativ auf die Leistungsvorteile auswirken, die durch das JAX KI-Bild bereitgestellt werden.

- Stabilitätsprobleme: Konflikte zwischen den hinzugefügten Abhängigkeiten und den JAX-Kernabhängigkeiten können zu Instabilität und Laufzeitfehlern in Ihrer Anwendung führen.

Release-Rhythmus

Anfangs werden JAX KI-Bilder vierteljährlich bereitgestellt. Das kurzfristige Ziel ist ein synchronisierter Veröffentlichungszeitplan mit jedem JAX-Release. So können Sie von den neuesten Funktionen und Verbesserungen profitieren, sobald sie verfügbar sind.

Support

Jede JAX AI-Image-Version unterliegt einem Support-Lebenszyklus mit begrenzter Dauer. Innerhalb dieses Zeitrahmens bearbeiten wir bestimmte Kategorien von Anfragen zur Änderung vorhandener JAX AI-Bilder:

- Sicherheitslücken: Wir priorisieren die Behebung von Sicherheitslücken, die in den Basis-Images oder Abhängigkeiten von JAX Stable Stack-Docker-Images entdeckt werden. Aktualisierte Images werden veröffentlicht, um potenzielle Risiken zu minimieren.

- Nicht abwärtskompatible Änderungen: Bei erheblichen nicht abwärtskompatiblen Änderungen in den zugrunde liegenden Bibliotheken oder Frameworks, die von JAX AI Image verwendet werden, Google Cloudbewertet und implementiert notwendige Updates, um die Kompatibilität aufrechtzuerhalten. Dazu müssen Sie möglicherweise Docker-Images mit aktualisierten Abhängigkeiten neu erstellen.

Wenn in einer Bibliothek innerhalb einer JAII eine Sicherheitslücke oder ein Fehler entdeckt wird, wird die aktualisierte Bibliothek in die JAII aufgenommen und alle anderen Bibliotheksversionen werden angepinnt, um die allgemeine Stabilität zu gewährleisten. Dadurch wird eine neue JAII-Version erstellt.

Minimale Änderung für Überarbeitungen:

Wenn in Paket „X“ in JAX-0.4.30-rev1 ein Fehler gefunden wird, aktualisieren wir „X“ auf die nächste Version (z. B. v2.0) und versuchen, alle anderen Pakete unverändert zu lassen. Dies führt zu einer neuen Revision: JAX-0.4.30-rev2, die so schnell wie möglich veröffentlicht wird.

Docker-Images für die Deep Learning Software Layer (DLSL)

Diese Images enthalten NVIDIA CUDA, NCCL, ein ML-Framework und ein Modell. Sie bieten eine sofort einsatzbereite Umgebung für Deep-Learning-Arbeitslasten. Diese vorgefertigten DLSL-Docker-Images funktionieren nahtlos mit Ihren GKE-Clustern, da wir sie bei internen Reproduzierbarkeits- und Regressionstests testen und überprüfen.

DLSL-Docker-Images bieten folgende Vorteile:

- Vorkonfigurierte Software: DLSL-Docker-Images bilden die Einrichtung nach, die für interne Reproduzierbarkeits- und Regressionstests verwendet wird. Diese Images bieten eine vorkonfigurierte, getestete und optimierte Umgebung, was bei der Installation und Konfiguration viel Zeit und Aufwand spart.

- Versionsverwaltung: DLSL-Docker-Images werden häufig aktualisiert. Diese Versionsupdates enthalten die aktuelle stabile Version von Frameworks und Treibern und beheben auch Sicherheitspatches.

- Infrastrukturkompatibilität: DLSL-Docker-Images werden so erstellt und getestet, dass sie nahtlos mit den GPU-Maschinentypen funktionieren, die auf AI Hypercomputer verfügbar sind.

- Schnellstartanleitung: Einige DLSL-Docker-Images haben begleitende Beispielrezepte, die zeigen, wie Sie Ihre Arbeitslasten starten, die die vorkonfigurierten Images verwenden.

NeMo + PyTorch + NCCL gIB-Plug-in

Diese Docker-Images basieren auf dem NVIDIA NeMo NGC-Image. Sie enthalten das NCCL gIB-Plug-in von Google und bündeln alle NCCL-Binärdateien, die zum Ausführen von Arbeitslasten auf jeder unterstützten Beschleuniger-VM erforderlich sind. Diese Images enthalten auch Google Cloud-Tools wie gcsfuse und die

gcloud-Befehlszeile zum Bereitstellen von Arbeitslasten in Google Kubernetes Engine.

| DLSL-Bildversion | Version der Abhängigkeiten | Maschinenserie | Releasedatum | Enddatum des Supports | DLSL-Bildname |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 3. Juli 2025 | 3. Juli 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 3. Juli 2025 | 3. Juli 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 14. März 2025 | 14. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2. Februar 2025 | 2. Februar 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2. Februar 2025 | 2. Februar 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 7. Februar 2025 | 7. Februar 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12. März 2025 | 12. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPUs) | 12. März 2025 | 12. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

Dieses Docker-Image basiert auf dem NVIDIA NeMo NGC-Image und enthält Google Cloud -Tools wie gcsfuse und die

gcloud CLI zum Bereitstellen von Arbeitslasten in Google Kubernetes Engine.

| DLSL-Bildversion | Version der Abhängigkeiten | Maschinenserie | Releasedatum | Enddatum des Supports | DLSL-Bildname |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | 19. Dezember 2024 | 19. Dezember 2025 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12. März 2025 | 12. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPUs) | 12. März 2025 | 12. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

MaxText + JAX-Toolbox

Dieses Docker-Image basiert auf dem NVIDIA JAX-Toolbox-Image und enthältGoogle Cloud -Tools wie gcsfuse und die

gcloud CLI zum Bereitstellen von Arbeitslasten in Google Kubernetes Engine.

| DLSL-Bildversion | Version der Abhängigkeiten | Maschinenserie | Releasedatum | Enddatum des Supports | DLSL-Bildname |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 11. März 2025 | 11. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 17. März 2025 | 17. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High (8 GPUs) | 17. März 2025 | 17. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

MaxText + JAX Stable Stack

Dieses Docker-Image basiert auf dem JAX Stable Stack und MaxText. Dieses Image enthält auch Abhängigkeiten wie dnsutils zum Ausführen von Arbeitslasten in Google Kubernetes Engine.

| DLSL-Bildversion | Version der Abhängigkeiten | Maschinenserie | Releasedatum | Enddatum des Supports | DLSL-Bildname |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 17. März 2025 | 17. März 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

Clusterbereitstellung und ‑orchestrierung

Betriebssystem-Images enthalten alle erforderlichen Softwarekomponenten, um ein Betriebssystem auf einer Compute-Instanz oder einem GKE-Knoten bereitzustellen. Das Betriebssystem verwaltet zugrunde liegende Hardwareressourcen wie Beschleuniger und Netzwerke. Dadurch werden die Rechenressourcen für Ihre KI-Arbeitslast bereitgestellt.

GKE-Knoten-Images

GKE stellt Cluster mit Knoten-Images bereit. Diese Knoten-Images sind für verschiedene Betriebssysteme wie Container-Optimized OS, Ubuntu und Windows Server verfügbar. Die Knoten-Images von Container-Optimized OS mit containerd (cos_containerd), die Sie zum Bereitstellen von GKE Autopilot-Clustern benötigen, enthalten Optimierungen zur Unterstützung Ihrer KI- und ML-Arbeitslasten.

Weitere Informationen zu diesen Knoten-Images finden Sie unter Knoten-Images.

Slurm-Betriebssystem-Images

In Slurm-Clustern werden Rechen- und Controllknoten als Recheninstanzen in Compute Engine bereitgestellt.

Wenn Sie KI-optimierte Slurm-Cluster bereitstellen möchten, müssen Sie das Cluster Toolkit verwenden. Bei der Bereitstellung des Slurm-Clusters wird mit dem Cluster-Blueprint automatisch ein benutzerdefiniertes Betriebssystem-Image erstellt, in dem die erforderliche Systemsoftware für die Cluster- und Arbeitslastverwaltung auf den Slurm-Knoten installiert wird. Sie können die Standard-Blueprints ändern, bevor Sie sie bereitstellen, um die Software anzupassen, die in Ihren Images enthalten ist.

Im folgenden Abschnitt wird die Software zusammengefasst, die mit dem Cluster-Blueprint auf Ihren A4-, A3 Ultra-, A3 Mega- und A3 High-Slurm-Knoten (8 GPUs) installiert wird. Cluster-Blueprints basieren auf den Ubuntu LTS-Accelerator-Betriebssystem-Images.

A4X Max

Der A4X Max-Blueprint, der auf GitHub verfügbar ist, enthält standardmäßig die folgende Software:

- Ubuntu 24.04 LTS

- Slurm: Version 25.05.2

- Die folgenden Slurm-Abhängigkeiten:

mungemariadblibjwtlmod

- Open MPI: Version 5.0.x

- NFS-Client und ‑Server

- NVIDIA-Treiber der 580er-Serie

- NVIDIA Enroot

- NVIDIA Pyxis

- Die folgenden NVIDIA-Tools:

- Data Center GPU Manager (

dcgmi) nvidia-container-toolkit: Version 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager (

- CUDA Toolkit: Version 13.0

- NCCL-Plug-in für A4X Max (

nccl-gib-a4x-max-arm64) - DOCA-OFED-Treiber

- Ops-Agent

- Cloud Storage FUSE

A4X

Der auf GitHub verfügbare A4X-Blueprint enthält standardmäßig die folgende Software:

- Ubuntu 24.04 LTS

- Slurm: Version 25.05.2

- Die folgenden Slurm-Abhängigkeiten:

mungemariadblibjwtlmod

- Open MPI: Version 5.0.x

- NFS-Client und ‑Server

- Treiber der NVIDIA 570-Serie

- NVIDIA Enroot

- NVIDIA Pyxis

- Die folgenden NVIDIA-Tools:

- Data Center GPU Manager (

dcgmi) nvidia-container-toolkit: Version 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager (

- CUDA Toolkit: Version 12.8

- NCCL-Plug-in für A4X (

nccl-plugin-gib-arm64) - Ops-Agent

- Cloud Storage FUSE

A4

Die A4-Blaupause, die auf GitHub verfügbar ist, enthält standardmäßig die folgende Software:

- Ubuntu 22.04 LTS

- Slurm: Version 25.05.2

- Die folgenden Slurm-Abhängigkeiten:

mungemariadblibjwtlmod

- Open MPI: die aktuelle Version von 4.1.x

- PMIx: Version 4.2.9

- NFS-Client und ‑Server

- Treiber der NVIDIA 570-Serie

- NVIDIA-Enroot-Container-Laufzeit: Version 3.5.0 mit Bugfix nach der Veröffentlichung

- NVIDIA pyxis

- Die folgenden NVIDIA-Tools:

- Data Center GPU Manager (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- Data Center GPU Manager (

- CUDA Toolkit: Version 12.8

- Infiniband-Unterstützung, einschließlich

ibverbs-utils - Ops-Agent

- Cloud Storage FUSE

A3 Ultra

Der A3 Ultra-Blueprint, der auf GitHub verfügbar ist, enthält standardmäßig die folgende Software:

- Ubuntu 22.04 LTS

- Slurm: Version 24.11.2

- Die folgenden Slurm-Abhängigkeiten:

mungemariadblibjwtlmod

- Open MPI: die aktuelle Version von 4.1.x

- PMIx: Version 4.2.9

- NFS-Client und ‑Server

- Treiber der NVIDIA 570-Serie

- NVIDIA-Enroot-Container-Laufzeit: Version 3.5.0 mit Bugfix nach der Veröffentlichung

- NVIDIA pyxis

- Die folgenden NVIDIA-Tools:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- Data Center GPU Manager (

- CUDA Toolkit: Version 12.8

- Infiniband-Unterstützung, einschließlich

ibverbs-utils - Ops-Agent

- Cloud Storage FUSE

A3 Mega

Der A3 Mega-Blueprint, der auf GitHub verfügbar ist, enthält standardmäßig die folgende Software:

- Ubuntu 22.04 LTS

- Slurm: Version 24.11.2

- Die folgenden Slurm-Abhängigkeiten:

mungemariadblibjwtlmod

- Open MPI: die aktuelle Version von 4.1.x

- PMIx: Version 4.2.9

- NFS-Client und ‑Server

- NVIDIA-Treiber der 550er-Serie

- NVIDIA-Enroot-Container-Laufzeit: Version 3.4.1

- NVIDIA pyxis

- Die folgenden NVIDIA-Tools:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- Data Center GPU Manager (

- CUDA Toolkit: Version 12.4

- Infiniband-Unterstützung, einschließlich

ibverbs-utils - TCPXO für A3 Mega: Spezielles Installationsprogramm für NCCL TCPXO und den 1,6 Tbps-Netzwerkstack

- Ops-Agent

- Cloud Storage FUSE

A3 High

Der auf GitHub verfügbare A3 High-Blueprint (8 GPUs) enthält standardmäßig die folgende Software:

- Ubuntu 22.04 LTS

- Slurm: Version 24.11.2

- Die folgenden Slurm-Abhängigkeiten:

mungemariadblibjwtlmod

- Open MPI: die aktuelle Version von 4.1.x

- PMIx: Version 4.2.9

- NFS-Client und ‑Server

- NVIDIA-Treiber der Serien 535 oder 550

- NVIDIA-Enroot-Container-Laufzeit: Version 3.4.1

- NVIDIA pyxis

- Die folgenden NVIDIA-Tools:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- Data Center GPU Manager (

- CUDA Toolkit: Version 12.2 oder 12.4

- Infiniband-Unterstützung, einschließlich

ibverbs-utils - TCPX für A3 High (8 GPUs): Spezielles Installationsprogramm für NCCL TCPX (GPUDirect-TCPX) und den 800‑Gbit/s-Netzwerk-Stack (4 NICs)

- Ops-Agent

- Cloud Storage FUSE

Beschleuniger-Betriebssystem-Images

Mit AI Hypercomputer können Sie einzelne Compute-Instanzen oder Gruppen von Compute-Instanzen bereitstellen. Wenn Sie diese Instanzen erstellen möchten, müssen Sie beim Erstellen der Instanz ein Betriebssystem-Image angeben.

Google Cloud bietet eine Reihe von Betriebssystem-Images für die Instanzerstellung. Google Cloud bietet auch eine Reihe spezieller Beschleuniger-Betriebssystem-Images für KI-optimierte Instanzen. Diese Betriebssystem-Images enthalten die wichtigsten Treiber für GPU- und Netzwerkfunktionen, z. B. NVIDIA-Treiber, Mellanox-Treiber und ihre Abhängigkeiten.

Weitere Informationen zu den einzelnen Betriebssystemen finden Sie in der Compute Engine-Dokumentation auf der Seite Details zu Betriebssystemen.

Beschleuniger-Betriebssystem-Images sind für die Betriebssysteme Rocky Linux und Ubuntu LTS verfügbar.

Rocky Linux-Beschleuniger

Die folgenden Rocky Linux-Beschleuniger-Betriebssystem-Images sind für jede Maschinenserie verfügbar:

| Betriebssystemversion | Image-Familie | Architektur | Maschinenserie | Image-Projekt |

|---|---|---|---|---|

| Rocky Linux 9-Beschleuniger | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

| Rocky Linux 8-Beschleuniger | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

Ubuntu LTS-Beschleuniger

Die folgenden Ubuntu LTS-Beschleuniger-Betriebssystem-Images sind für jede Maschinenserie verfügbar:

| Betriebssystemversion | Image-Familie | Architektur | Maschinenserie | Image-Projekt |

|---|---|---|---|---|

| Ubuntu 24.04 LTS-Beschleuniger | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

| Ubuntu 22.04 LTS-Beschleuniger | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |